DeepCoder通過14B開放模型實現高編碼效率

介紹 DeepCoder-14B:開源編碼模型的新前沿

Together AI 和 Agentica 的團隊推出了 DeepCoder-14B,這是一款突破性的編碼模型,與頂尖專有模型如 OpenAI 的 o3-mini 並駕齊驅。這項令人振奮的發展基於 DeepSeek-R1 的基礎,提供了更高的靈活性,用於將高效能的程式碼生成和推理整合到實際應用中。更令人讚賞的是,創作者採取了完全開源的做法,包括模型的訓練數據、程式碼、日誌和系統優化。這一舉措將催化研究並加速該領域的進展。

小巧包裝中的出色表現

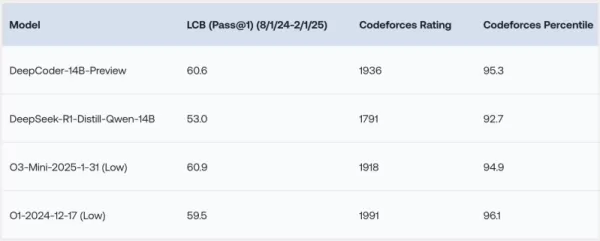

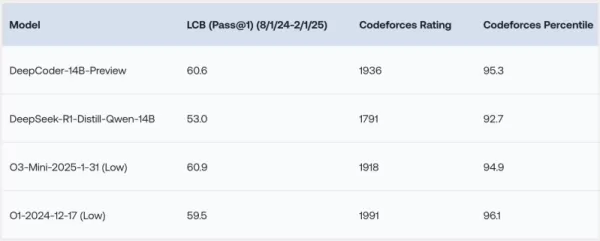

DeepCoder-14B 在多個編碼基準測試中表現出色,例如 LiveCodeBench (LCB)、Codeforces 和 HumanEval+。研究團隊的實驗顯示,該模型的性能與領先模型如 o3-mini (低階) 和 o1 相當。研究人員在他們的部落格文章中自豪地表示:「我們的模型在所有編碼基準測試中展現出強大的性能……與 o3-mini (低階) 和 o1 的表現相當。」

特別引人注目的是,雖然 DeepCoder-14B 主要針對編碼任務進行訓練,但它在數學推理方面也顯示出顯著的進步,在 AIME 2024 基準測試中獲得了 73.8% 的分數。這比其基礎模型 DeepSeek-R1-Distill-Qwen-14B 提高了 4.1%,表明通過強化學習 (RL) 在程式碼上培養的推理技能可以有效地轉移到其他領域。

*來源:Together AI* DeepCoder-14B 最令人興奮的特點或許是其效率。僅有 140 億個參數,它在性能上表現出色,同時比許多其他領先模型更小巧、更節省資源。

DeepCoder 成功的背後創新

開發 DeepCoder-14B 涉及克服多項挑戰,特別是在使用強化學習訓練編碼模型時。一個主要障礙是訓練數據的整理。與數學任務不同,高質量、可驗證的數據在數學領域中較為豐富,而編碼數據可能較為稀缺。DeepCoder 團隊通過實施嚴格的數據收集和過濾管道,解決了這個問題,確保數據的有效性、複雜性和避免重複。這個過程產生了 24,000 個高質量問題,形成了強化學習訓練的堅實基礎。

團隊還設計了一個簡單的獎勵函數,只有當生成的程式碼在設定的時間限制內成功通過所有抽樣單元測試時才會獎勵模型。這種方法,結合高質量的訓練範例,確保模型專注於解決核心問題,而不是利用捷徑。

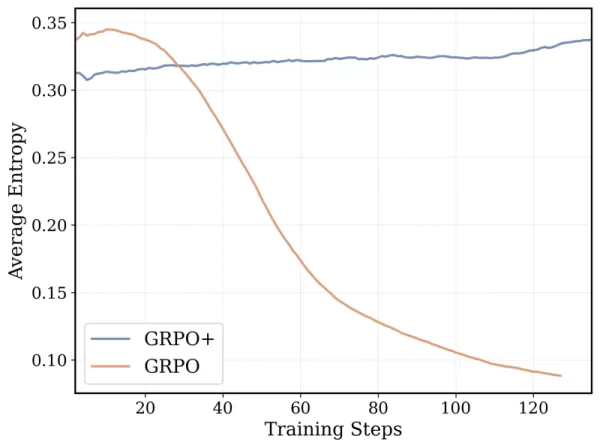

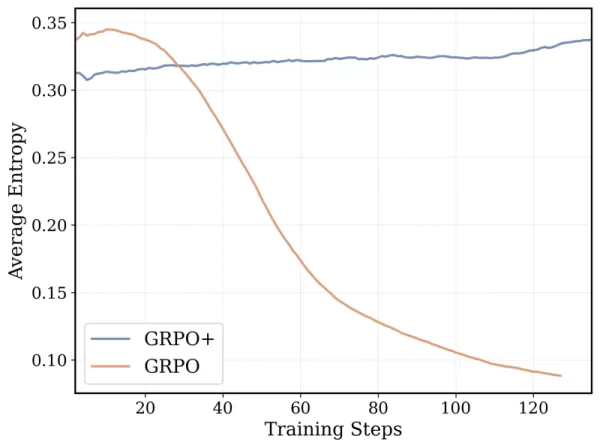

DeepCoder-14B 的訓練演算法基於群組相對策略優化 (GRPO),這在 DeepSeek-R1 中已獲得成功。然而,團隊進行了重大修改,以增強穩定性並實現更長的訓練時間。

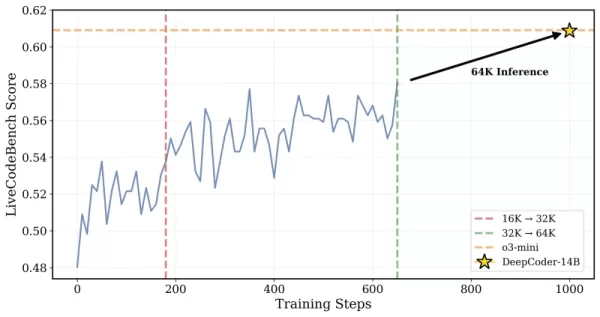

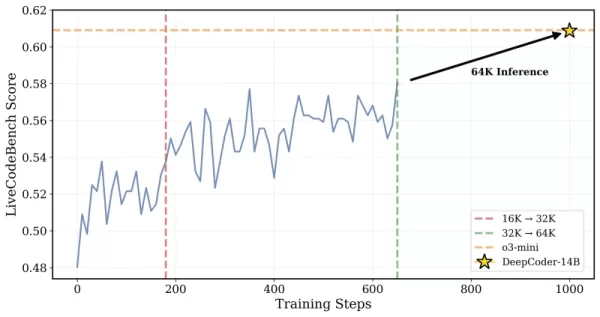

*GRPO+ 使 DeepCoder-14B 能持續更長時間而不崩潰 來源:Together AI* 此外,團隊逐步擴展了模型的上下文窗口,從較短的序列開始,逐步增加。他們還引入了一種過濾方法,以避免在解決複雜提示時因超出上下文限制而懲罰模型。

*DeepCoder 在 32K 上下文問題上進行訓練,但也能解決 64K 任務 來源:Together AI* 研究人員解釋了他們的方法:「為了在保持長上下文推理的同時實現高效訓練,我們引入了超長過濾技術……這項技術在訓練期間遮罩截斷序列,以避免模型因生成深思熟慮但超出當前上下文限制的冗長輸出而受到懲罰。」訓練從 16K 上下文窗口擴展到 32K,使模型能夠處理需要高達 64K 令牌的問題。

優化長上下文強化學習訓練

使用強化學習訓練大型模型,特別是在生成長序列的任務如編碼時,眾所周知是緩慢且資源密集的。抽樣步驟中,模型為每個範例生成數千個令牌,由於回應長度的變化,通常會導致顯著的延遲。

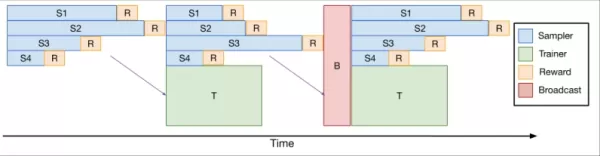

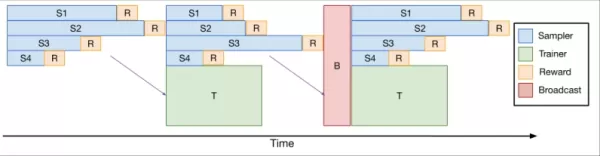

為了解決這個問題,團隊開發了 verl-pipeline,這是基於開源 verl 庫的優化擴展,用於從人類反饋進行強化學習 (RLHF)。他們的「一次性流水線」創新重新組織了抽樣和模型更新,以最小化瓶頸並減少加速器上的閒置時間。

*一次性流水線* 他們的實驗顯示,一次性流水線能將編碼強化學習任務的速度提升高達 2 倍,與標準方法相比。這項優化對於在合理時間內(32 個 H100 上 2.5 週)訓練 DeepCoder-14B 至關重要,現在已作為 verl-pipeline 的一部分開源,供社群使用。

企業影響與開源協作

研究人員已在 GitHub 和 Hugging Face 上以寬鬆許可證公開了 DeepCoder-14B 的所有訓練和操作資源。他們表示:「通過完全分享我們的數據集、程式碼和訓練配方,我們賦予社群重現我們的工作並使強化學習訓練對所有人可及。」

DeepCoder-14B 體現了 AI 領域中高效、開放可用的模型日益增長的趨勢。對於企業來說,這意味著更多的選擇和對先進模型的更大可及性。高效能的程式碼生成和推理不再是大公司或願意支付高額 API 費用的組織獨享。各種規模的組織現在都可以利用這些能力,根據其特定需求定制解決方案,並在自己的環境中安全部署。

這種轉變將降低 AI 採用的門檻,促進一個由開源協作驅動的更具競爭力和創新性的生態系統。

相關文章

Multiverse Computing 推出免費壓縮生成式人工智慧模型

大型語言模型面臨著重大挑戰:其龐大的體積。西班牙新創公司Multiverse Computing正透過開發壓縮模型來解決此問題,旨在彌合尖端AI能力與企業實際可負擔部署方案之間的差距。其核心創新在於「CompactifAI」壓縮技術——這項受量子運算原理啟發的技術,已被這家巴斯克公司用於優化OpenAI的模型。即日起,開發者可在Hugging Face平台免費使用Multiverse增強版的Hyp

Multiverse Computing 推出免費壓縮生成式人工智慧模型

大型語言模型面臨著重大挑戰:其龐大的體積。西班牙新創公司Multiverse Computing正透過開發壓縮模型來解決此問題,旨在彌合尖端AI能力與企業實際可負擔部署方案之間的差距。其核心創新在於「CompactifAI」壓縮技術——這項受量子運算原理啟發的技術,已被這家巴斯克公司用於優化OpenAI的模型。即日起,開發者可在Hugging Face平台免費使用Multiverse增強版的Hyp

秘密追蹤數據揭露人工智慧模型遭竊事件

一種新方法能在數秒內對ChatGPT等模型進行隱形水印處理,無需重新訓練,既不會在標準輸出中留下痕跡,又能抵禦所有實際的移除嘗試。 水印技術與「版權誘餌」的核心差異在於:無論可見或隱藏的水印,通常設計為貫穿整個資料集(如圖像資料集)的恆定存在,藉此對隨意複製行為形成持續威懾。相對地,虛構條目是將一小段文字(通常為單詞或定義)植入龐大通用資料庫,旨在證明盜用行為。其原理在於:當整部作品遭未經授權複製

秘密追蹤數據揭露人工智慧模型遭竊事件

一種新方法能在數秒內對ChatGPT等模型進行隱形水印處理,無需重新訓練,既不會在標準輸出中留下痕跡,又能抵禦所有實際的移除嘗試。 水印技術與「版權誘餌」的核心差異在於:無論可見或隱藏的水印,通常設計為貫穿整個資料集(如圖像資料集)的恆定存在,藉此對隨意複製行為形成持續威懾。相對地,虛構條目是將一小段文字(通常為單詞或定義)植入龐大通用資料庫,旨在證明盜用行為。其原理在於:當整部作品遭未經授權複製

人工智慧系統被騙批准荒謬科學論文

最新研究揭示,人工智慧系統現已能生成虛假科學論文,且其他AI模型會誤判其為真實研究。這些偽造研究能成功繞過過往有效的檢測方法,凸顯研究生態系統面臨崩潰風險——可能陷入機器人欺騙機器人的循環漩渦。 諷刺的是,正處於AI創新前沿的學術研究領域,如今卻正面臨主要由AI引發的可信度危機。自約四年前機器學習的潛在影響顯現以來,其已深刻重塑了研究、投稿與同行評審流程。最新爭議涉及低品質問卷調查論文的批量生產。

相關專題推薦

評論 (14)

0/500

人工智慧系統被騙批准荒謬科學論文

最新研究揭示,人工智慧系統現已能生成虛假科學論文,且其他AI模型會誤判其為真實研究。這些偽造研究能成功繞過過往有效的檢測方法,凸顯研究生態系統面臨崩潰風險——可能陷入機器人欺騙機器人的循環漩渦。 諷刺的是,正處於AI創新前沿的學術研究領域,如今卻正面臨主要由AI引發的可信度危機。自約四年前機器學習的潛在影響顯現以來,其已深刻重塑了研究、投稿與同行評審流程。最新爭議涉及低品質問卷調查論文的批量生產。

相關專題推薦

評論 (14)

0/500

![RyanTaylor]()

Interesting! I've been following the open-source vs. proprietary model race. DeepCoder-14B matching o3-mini is a big deal for accessibility. Hope this pushes the big players to open up more, or at least lower their prices. The compute cost for training these 14B models must be insane though. 🤔

![FrankRodriguez]()

Wow, DeepCoder-14B sounds like a game-changer! I'm stoked to see open-source models catching up to the big players. Can't wait to try it out for my side projects—hope it’s as fast as they claim! 🚀

![GregoryBaker]()

DeepCoder-14B sounds like a game-changer! Can't wait to try it out and see how it stacks up against the big players. 🚀

![BillyLewis]()

Wow, DeepCoder-14B sounds like a game-changer for open-source coding! I'm curious how it stacks up against o3-mini in real-world projects. Anyone tried it yet? 🚀

![RaymondWalker]()

¡DeepCoder-14B es una locura! Un modelo de código abierto que compite con los grandes. ¿Será el fin de los modelos propietarios? 🤔

介紹 DeepCoder-14B:開源編碼模型的新前沿

Together AI 和 Agentica 的團隊推出了 DeepCoder-14B,這是一款突破性的編碼模型,與頂尖專有模型如 OpenAI 的 o3-mini 並駕齊驅。這項令人振奮的發展基於 DeepSeek-R1 的基礎,提供了更高的靈活性,用於將高效能的程式碼生成和推理整合到實際應用中。更令人讚賞的是,創作者採取了完全開源的做法,包括模型的訓練數據、程式碼、日誌和系統優化。這一舉措將催化研究並加速該領域的進展。

小巧包裝中的出色表現

DeepCoder-14B 在多個編碼基準測試中表現出色,例如 LiveCodeBench (LCB)、Codeforces 和 HumanEval+。研究團隊的實驗顯示,該模型的性能與領先模型如 o3-mini (低階) 和 o1 相當。研究人員在他們的部落格文章中自豪地表示:「我們的模型在所有編碼基準測試中展現出強大的性能……與 o3-mini (低階) 和 o1 的表現相當。」

特別引人注目的是,雖然 DeepCoder-14B 主要針對編碼任務進行訓練,但它在數學推理方面也顯示出顯著的進步,在 AIME 2024 基準測試中獲得了 73.8% 的分數。這比其基礎模型 DeepSeek-R1-Distill-Qwen-14B 提高了 4.1%,表明通過強化學習 (RL) 在程式碼上培養的推理技能可以有效地轉移到其他領域。

DeepCoder-14B 最令人興奮的特點或許是其效率。僅有 140 億個參數,它在性能上表現出色,同時比許多其他領先模型更小巧、更節省資源。

DeepCoder 成功的背後創新

開發 DeepCoder-14B 涉及克服多項挑戰,特別是在使用強化學習訓練編碼模型時。一個主要障礙是訓練數據的整理。與數學任務不同,高質量、可驗證的數據在數學領域中較為豐富,而編碼數據可能較為稀缺。DeepCoder 團隊通過實施嚴格的數據收集和過濾管道,解決了這個問題,確保數據的有效性、複雜性和避免重複。這個過程產生了 24,000 個高質量問題,形成了強化學習訓練的堅實基礎。

團隊還設計了一個簡單的獎勵函數,只有當生成的程式碼在設定的時間限制內成功通過所有抽樣單元測試時才會獎勵模型。這種方法,結合高質量的訓練範例,確保模型專注於解決核心問題,而不是利用捷徑。

DeepCoder-14B 的訓練演算法基於群組相對策略優化 (GRPO),這在 DeepSeek-R1 中已獲得成功。然而,團隊進行了重大修改,以增強穩定性並實現更長的訓練時間。

此外,團隊逐步擴展了模型的上下文窗口,從較短的序列開始,逐步增加。他們還引入了一種過濾方法,以避免在解決複雜提示時因超出上下文限制而懲罰模型。

研究人員解釋了他們的方法:「為了在保持長上下文推理的同時實現高效訓練,我們引入了超長過濾技術……這項技術在訓練期間遮罩截斷序列,以避免模型因生成深思熟慮但超出當前上下文限制的冗長輸出而受到懲罰。」訓練從 16K 上下文窗口擴展到 32K,使模型能夠處理需要高達 64K 令牌的問題。

優化長上下文強化學習訓練

使用強化學習訓練大型模型,特別是在生成長序列的任務如編碼時,眾所周知是緩慢且資源密集的。抽樣步驟中,模型為每個範例生成數千個令牌,由於回應長度的變化,通常會導致顯著的延遲。

為了解決這個問題,團隊開發了 verl-pipeline,這是基於開源 verl 庫的優化擴展,用於從人類反饋進行強化學習 (RLHF)。他們的「一次性流水線」創新重新組織了抽樣和模型更新,以最小化瓶頸並減少加速器上的閒置時間。

他們的實驗顯示,一次性流水線能將編碼強化學習任務的速度提升高達 2 倍,與標準方法相比。這項優化對於在合理時間內(32 個 H100 上 2.5 週)訓練 DeepCoder-14B 至關重要,現在已作為 verl-pipeline 的一部分開源,供社群使用。

企業影響與開源協作

研究人員已在 GitHub 和 Hugging Face 上以寬鬆許可證公開了 DeepCoder-14B 的所有訓練和操作資源。他們表示:「通過完全分享我們的數據集、程式碼和訓練配方,我們賦予社群重現我們的工作並使強化學習訓練對所有人可及。」

DeepCoder-14B 體現了 AI 領域中高效、開放可用的模型日益增長的趨勢。對於企業來說,這意味著更多的選擇和對先進模型的更大可及性。高效能的程式碼生成和推理不再是大公司或願意支付高額 API 費用的組織獨享。各種規模的組織現在都可以利用這些能力,根據其特定需求定制解決方案,並在自己的環境中安全部署。

這種轉變將降低 AI 採用的門檻,促進一個由開源協作驅動的更具競爭力和創新性的生態系統。

Multiverse Computing 推出免費壓縮生成式人工智慧模型

大型語言模型面臨著重大挑戰:其龐大的體積。西班牙新創公司Multiverse Computing正透過開發壓縮模型來解決此問題,旨在彌合尖端AI能力與企業實際可負擔部署方案之間的差距。其核心創新在於「CompactifAI」壓縮技術——這項受量子運算原理啟發的技術,已被這家巴斯克公司用於優化OpenAI的模型。即日起,開發者可在Hugging Face平台免費使用Multiverse增強版的Hyp

Multiverse Computing 推出免費壓縮生成式人工智慧模型

大型語言模型面臨著重大挑戰:其龐大的體積。西班牙新創公司Multiverse Computing正透過開發壓縮模型來解決此問題,旨在彌合尖端AI能力與企業實際可負擔部署方案之間的差距。其核心創新在於「CompactifAI」壓縮技術——這項受量子運算原理啟發的技術,已被這家巴斯克公司用於優化OpenAI的模型。即日起,開發者可在Hugging Face平台免費使用Multiverse增強版的Hyp

秘密追蹤數據揭露人工智慧模型遭竊事件

一種新方法能在數秒內對ChatGPT等模型進行隱形水印處理,無需重新訓練,既不會在標準輸出中留下痕跡,又能抵禦所有實際的移除嘗試。 水印技術與「版權誘餌」的核心差異在於:無論可見或隱藏的水印,通常設計為貫穿整個資料集(如圖像資料集)的恆定存在,藉此對隨意複製行為形成持續威懾。相對地,虛構條目是將一小段文字(通常為單詞或定義)植入龐大通用資料庫,旨在證明盜用行為。其原理在於:當整部作品遭未經授權複製

秘密追蹤數據揭露人工智慧模型遭竊事件

一種新方法能在數秒內對ChatGPT等模型進行隱形水印處理,無需重新訓練,既不會在標準輸出中留下痕跡,又能抵禦所有實際的移除嘗試。 水印技術與「版權誘餌」的核心差異在於:無論可見或隱藏的水印,通常設計為貫穿整個資料集(如圖像資料集)的恆定存在,藉此對隨意複製行為形成持續威懾。相對地,虛構條目是將一小段文字(通常為單詞或定義)植入龐大通用資料庫,旨在證明盜用行為。其原理在於:當整部作品遭未經授權複製

人工智慧系統被騙批准荒謬科學論文

最新研究揭示,人工智慧系統現已能生成虛假科學論文,且其他AI模型會誤判其為真實研究。這些偽造研究能成功繞過過往有效的檢測方法,凸顯研究生態系統面臨崩潰風險——可能陷入機器人欺騙機器人的循環漩渦。 諷刺的是,正處於AI創新前沿的學術研究領域,如今卻正面臨主要由AI引發的可信度危機。自約四年前機器學習的潛在影響顯現以來,其已深刻重塑了研究、投稿與同行評審流程。最新爭議涉及低品質問卷調查論文的批量生產。

人工智慧系統被騙批准荒謬科學論文

最新研究揭示,人工智慧系統現已能生成虛假科學論文,且其他AI模型會誤判其為真實研究。這些偽造研究能成功繞過過往有效的檢測方法,凸顯研究生態系統面臨崩潰風險——可能陷入機器人欺騙機器人的循環漩渦。 諷刺的是,正處於AI創新前沿的學術研究領域,如今卻正面臨主要由AI引發的可信度危機。自約四年前機器學習的潛在影響顯現以來,其已深刻重塑了研究、投稿與同行評審流程。最新爭議涉及低品質問卷調查論文的批量生產。

Interesting! I've been following the open-source vs. proprietary model race. DeepCoder-14B matching o3-mini is a big deal for accessibility. Hope this pushes the big players to open up more, or at least lower their prices. The compute cost for training these 14B models must be insane though. 🤔

Wow, DeepCoder-14B sounds like a game-changer! I'm stoked to see open-source models catching up to the big players. Can't wait to try it out for my side projects—hope it’s as fast as they claim! 🚀

DeepCoder-14B sounds like a game-changer! Can't wait to try it out and see how it stacks up against the big players. 🚀

Wow, DeepCoder-14B sounds like a game-changer for open-source coding! I'm curious how it stacks up against o3-mini in real-world projects. Anyone tried it yet? 🚀

¡DeepCoder-14B es una locura! Un modelo de código abierto que compite con los grandes. ¿Será el fin de los modelos propietarios? 🤔

首頁

首頁