腾讯发布HunyuanCustom用于单图视频定制

本文探讨了腾讯推出的HunyuanCustom,一种多模态视频生成模型。附带的研究论文内容广泛,项目页面提供的示例视频存在挑战,因此需要更广泛的概述,由于格式和处理要求,视频内容的完整再现受限,以提高清晰度。

注意,论文中将基于API的生成系统Kling称为“Keling”。为保持一致性,本文全程使用“Kling”。

腾讯推出了其Hunyuan Video模型的先进迭代版本,名为HunyuanCustom。据报道,该版本通过仅使用一张单图即可创建深伪风格的视频定制,超越了对Hunyuan LoRA模型的需求:

点击播放。提示:“一名男子在厨房准备螺蛳粉时享受音乐。”与专有和开源方法(包括主要竞争对手Kling)相比,HunyuanCustom表现突出。 来源:https://hunyuancustom.github.io/(注意:资源密集型网站)

在上述视频中,最左侧列显示HunyuanCustom的单张源图像输入,旁边一列展示系统对提示的解释。其余列展示其他系统的输出:Kling、Vidu、Pika、Hailuo和SkyReels-A2(基于Wan)。

以下视频展示了此次发布的三个核心场景:人物与物体、单角色复制和虚拟服装试穿:

点击播放。来自Hunyuan Video支持站点的三个精选示例。

这些示例揭示了仅依赖单张源图像而非多视角的限制。

在第一个片段中,男子面向摄像头,头部移动幅度不超过20-25度。超过此范围,系统难以从单张正面图像准确推断其侧面轮廓。

在第二个片段中,女孩在视频中保持微笑表情,与其静态源图像一致。没有额外的参考图像,HunyuanCustom无法可靠地描绘她的中性表情,面部也基本保持正面,类似于前一个示例。

在最后一个片段中,源素材不完整——一名女子和虚拟服装——导致渲染被裁剪,这是处理有限数据的实用解决方法。

虽然HunyuanCustom支持多张图像输入(例如,人物与零食或人物与服装),但不支持单一角色的不同角度或表情。这可能限制其完全替代HunyuanVideo的LoRA模型生态系统,后者使用20-60张图像以确保角色在不同角度和表情下的一致性渲染。

音频整合

对于音频,HunyuanCustom采用LatentSync系统,业余爱好者配置较为困难,用于同步用户提供的音频和文本的唇部动作:

包含音频,点击播放。来自HunyuanCustom补充站点的唇部同步示例合集。

目前没有英文示例,但结果看起来很有前景,特别是如果设置过程对用户友好。

视频编辑能力

HunyuanCustom在视频到视频(V2V)编辑方面表现出色,允许使用单张参考图像对现有视频中的元素进行针对性替换。补充材料中的一个示例说明了这一点:

点击播放。中心物体被修改,周围元素在HunyuanCustom的V2V过程中被微妙调整。

与典型的V2V工作流程类似,整个视频略有修改,重点在目标区域,如毛绒玩具。高级流水线可能会保留更多原始内容,类似于Adobe Firefly的方法,尽管这在开源社区中尚未充分探索。

其他示例展示了在目标整合方面的精度提升,如下述合集所示:

点击播放。HunyuanCustom中V2V内容插入的多种示例,展示了对未更改元素的尊重。

进化升级

HunyuanCustom基于Hunyuan Video项目,引入了针对性的架构增强,而非彻底重构。这些升级旨在无需特定主题微调(如LoRA或文本反转)即可保持帧间角色一致性。

此次发布是2024年12月HunyuanVideo模型的精炼版本,而非全新模型。

现有HunyuanVideo LoRA用户可能质疑其与此次更新的兼容性,或是否需要开发新的LoRA以利用增强的定制功能。

通常,重大微调会改变模型权重,足以使之前的LoRA不兼容。然而,像Pony Diffusion for Stable Diffusion XL这样的微调已创建了独立的生态系统,拥有专用LoRA库,表明HunyuanCustom可能也有类似潜力。

发布详情

研究论文标题为HunyuanCustom:用于定制视频生成的多模态驱动架构,链接到一个现已活跃的GitHub存储库,包含代码和权重以供本地部署,并计划整合ComfyUI。

目前,项目的Hugging Face页面无法访问,但通过微信扫码可使用基于API的演示。

HunyuanCustom整合了多种项目,内容相当全面,可能是由于许可要求需完全披露。

提供两种模型变体:720x1280px版本需要80GB GPU内存以获得最佳性能(最低24GB,但速度慢)和512x896px版本需要60GB。测试仅限于Linux,但社区努力可能很快使其适配Windows和较低VRAM配置,如之前的Hunyuan Video模型所示。

由于附带材料量大,本概述对HunyuanCustom的功能采取了高层次方法。

技术洞察

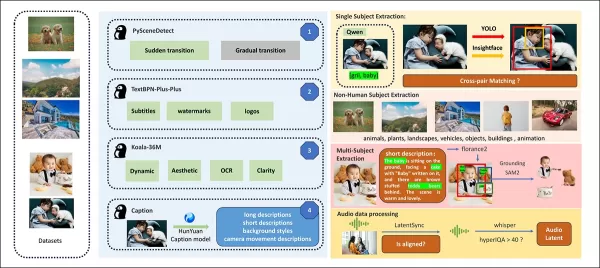

HunyuanCustom的数据流水线符合GDPR,整合了合成和开源视频数据集,如OpenHumanVid,涵盖八个类别:人类、动物、植物、风景、车辆、物体、建筑和动漫。

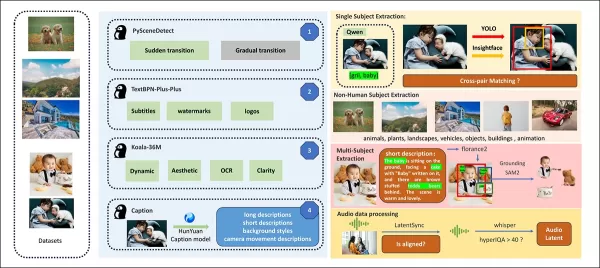

来自发布论文,概述了HunyuanCustom数据构建流水线中的多样化贡献包。 来源:https://arxiv.org/pdf/2505.04512

视频使用PySceneDetect分割成单镜头片段,TextBPN-Plus-Plus过滤掉包含过多文本、字幕或水印的内容。

片段标准化为五秒,短边调整为512或720像素。使用Koala-36M以自定义0.06阈值确保美学质量。

人类身份提取利用Qwen7B、YOLO11X和InsightFace,非人类主体则使用QwenVL和Grounded SAM 2处理,丢弃小型边界框。

使用Grounded SAM 2进行语义分割的示例,应用于Hunyuan Control项目。 来源:https://github.com/IDEA-Research/Grounded-SAM-2

多主体提取使用Florence2进行标注,Grounded SAM 2进行分割,随后进行聚类和时间帧分割。

片段通过Hunyuan团队的专有结构化标注增强,添加描述和相机运动提示等元数据。

掩码增强防止过拟合,确保适应多样化的物体形状。音频同步使用LatentSync,丢弃低于质量阈值的片段。HyperIQA过滤得分低于40的视频,Whisper处理有效音频以用于下游任务。

LLaVA模型在生成字幕和对齐视觉与文本内容以确保语义一致性方面发挥核心作用,特别是在复杂或多主体场景中。

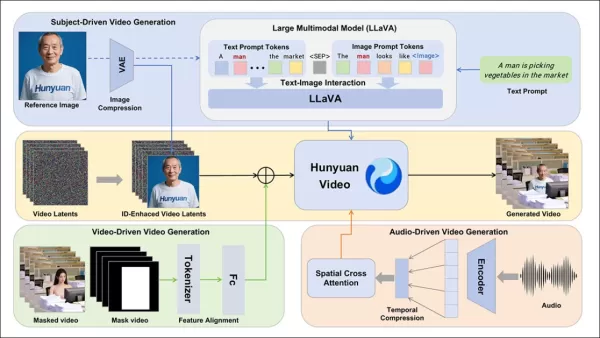

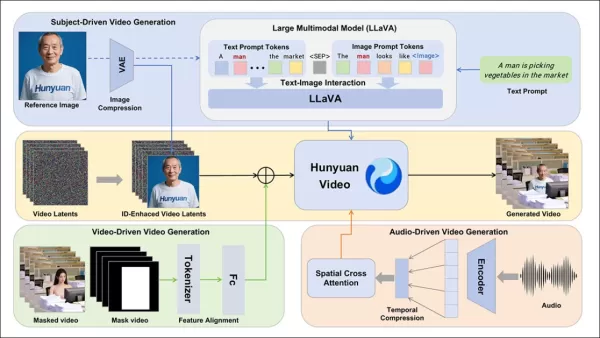

HunyuanCustom框架支持基于文本、图像、音频和视频输入的身份一致性视频生成。

视频定制

为实现从参考图像和提示生成视频,开发了两个基于LLaVA的模块,调整HunyuanVideo的输入以接受图像和文本。提示直接嵌入图像或使用简短身份描述标记,使用分隔符平衡图像和文本的影响。

身份增强模块解决了LLaVA在短视频片段中丢失细粒度空间细节的问题,这对保持主体一致性至关重要。

参考图像通过HunyuanVideo的因果3D-VAE调整大小并编码,其潜在表示沿时间轴插入,并添加空间偏移以指导生成而非直接复制。

训练使用Flow Matching,噪声来自logit-normal分布,联合微调LLaVA和视频生成器以实现图像-提示引导和身份一致性。

对于多主体提示,每个图像-文本对以不同时间位置单独嵌入,支持多主体交互场景。

音频与视觉整合

HunyuanCustom支持使用用户提供的音频和文本进行音频驱动生成,使角色在相关场景中说话。

身份解耦AudioNet模块将音频特征与视频时间线对齐,使用空间交叉注意力隔离帧并保持主体一致性。

时间注入模块通过多层感知器优化动作时机,将音频映射到潜在序列,确保手势与音频节奏对齐。

对于视频编辑,HunyuanCustom在不重新生成整个视频的情况下替换现有片段中的主体,适合针对性外观或动作更改。

点击播放。来自补充站点的另一个示例。

系统使用预训练的因果3D-VAE压缩参考视频,与生成流水线的潜在表示对齐以实现轻量级处理。神经网络将干净输入视频与噪声潜在表示对齐,逐帧特征添加比预压缩合并更有效。

性能评估

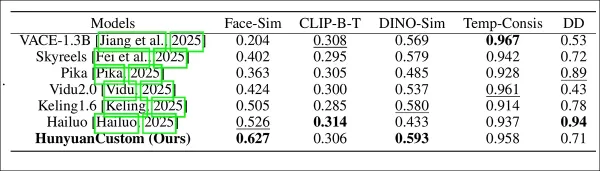

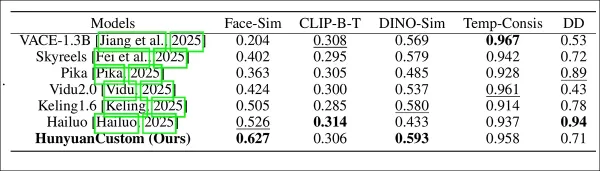

测试指标包括ArcFace用于面部身份一致性,YOLO11x和Dino 2用于主体相似性,CLIP-B用于文本-视频对齐和时间一致性,VBench用于动作强度。

竞争对手包括闭源系统(Hailuo、Vidu 2.0、Kling 1.6、Pika)和开源框架(VACE、SkyReels-A2)。

模型性能评估,比较HunyuanCustom与领先视频定制方法在身份一致性(Face-Sim)、主体相似性(DINO-Sim)、文本-视频对齐(CLIP-B-T)、时间一致性(Temp-Consis)和动作强度(DD)方面的表现。最佳和次佳结果分别以粗体和下划线显示。

作者指出:

“HunyuanCustom在身份和主体一致性方面表现出色,提示遵循度和时间稳定性具有竞争力。Hailuo因强大的文本对齐在剪辑得分上领先,但在非人类主体一致性上表现不佳。Vidu和VACE在动作强度上落后,可能是由于模型规模较小。”

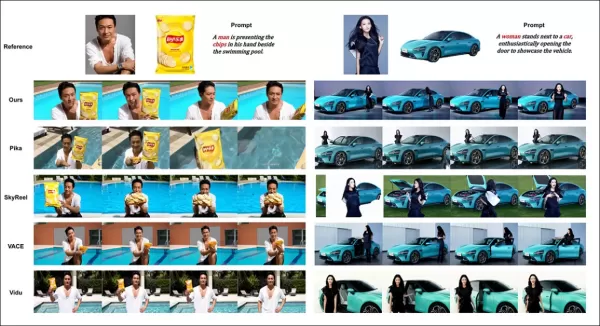

虽然项目站点提供了众多比较视频,但其布局更注重美观而非比较的便捷性。建议读者直接查看视频以获得更清晰的见解:

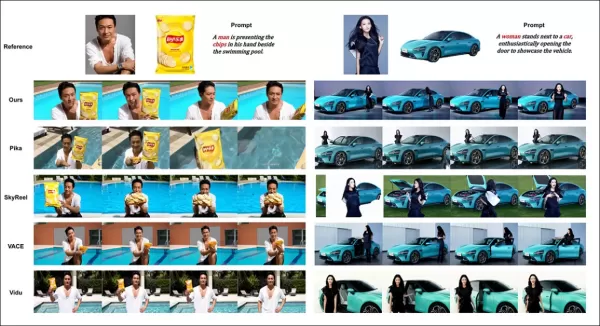

来自论文,关于以物体为中心视频定制的比较。观众应参考源PDF以获得更好的分辨率,项目站点的视频提供更清晰的见解。

作者声明:

“Vidu、SkyReels A2和HunyuanCustom在提示对齐和主体一致性上表现强劲,但我们的视频质量超越Vidu和SkyReels,这得益于Hunyuanvideo-13B的坚实基础。”

“在商业解决方案中,Kling提供高质量视频,但在首帧出现复制粘贴效果,偶尔出现主体模糊,影响观看体验。”

Pika在时间一致性上表现不佳,引入了因数据整理不佳导致的字幕伪影。Hailuo保留了面部身份,但在全身一致性上表现不佳。VACE在开源方法中无法保持身份一致性,而HunyuanCustom在身份保留、质量和多样性方面表现强劲。

多主体视频定制测试得出了相似的结果:

使用多主体视频定制的比较。请参阅PDF以获取更好的细节和分辨率。

论文指出:

“Pika生成指定主体,但显示帧不稳定性,主体消失或无法遵循提示。Vidu和VACE部分捕捉人类身份,但丢失非人类物体细节。SkyReels A2出现严重的帧不稳定和伪影。HunyuanCustom有效捕捉所有主体身份,遵循提示,并保持高视觉质量和稳定性。”

虚拟人类广告测试集成了产品与人物:

来自定性测试轮次的神经“产品植入”示例。请参阅PDF以获取更好的细节和分辨率。

作者声明:

“HunyuanCustom保持人类身份和产品细节,包括文本,交互自然,提示遵循度高,展示了其在广告视频中的潜力。”

音频驱动定制测试突出了灵活的场景和姿态控制:

音频轮次的部分结果——视频结果可能更佳。由于尺寸限制,仅显示PDF图的上半部分。请参阅源PDF以获取更好的细节。

作者指出:

“之前的音频驱动方法将姿态和环境限制在输入图像上,限制了应用。HunyuanCustom通过文本描述的场景和姿态实现灵活的音频驱动动画。”

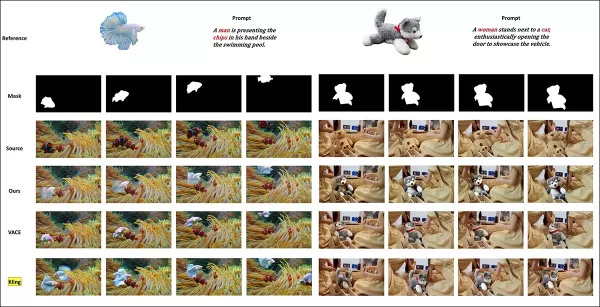

视频主体替换测试比较了HunyuanCustom与VACE和Kling 1.6:

测试视频到视频模式的主体替换。请参阅源PDF以获取更好的细节和分辨率。

研究人员声明:

“VACE因严格的掩码遵循产生边界伪影,破坏动作连续性。Kling显示复制粘贴效果,背景整合不佳。HunyuanCustom避免伪影,确保无缝整合,并保持强大的身份保留,在视频编辑中表现出色。”

结论

HunyuanCustom是一个引人注目的发布,满足了视频合成中对唇部同步的日益增长的需求,增强了如Hunyuan Video等系统的真实感。尽管由于项目站点视频布局的限制,比较其能力存在挑战,但腾讯的模型在与Kling等顶级竞争对手的竞争中表现出色,标志着定制视频生成领域的显著进展。

* 一些视频过宽、过短或分辨率过高,无法在VLC或Windows Media Player等标准播放器中播放,显示黑屏。

首次发布于2025年5月8日,星期四

相关文章

独家报道:Luma AI推出基于"统一智能"模型的创意智能助手

周四,人工智能视频生成初创公司Luma推出了Luma Agents系统,该系统旨在管理涵盖文本、图像、视频和音频的完整创意工作流程。这些智能代理由Luma的统一智能模型家族驱动,其架构经过训练成为单一的多模态推理引擎。Luma将该代理定位为广告公司、营销部门、设计工作室及企业的变革性工具。据称,这些代理不仅能规划并生成文本、图像、视频和音频内容,还能协同其他AI模型运作,包括Luma的Ray 3.

独家报道:Luma AI推出基于"统一智能"模型的创意智能助手

周四,人工智能视频生成初创公司Luma推出了Luma Agents系统,该系统旨在管理涵盖文本、图像、视频和音频的完整创意工作流程。这些智能代理由Luma的统一智能模型家族驱动,其架构经过训练成为单一的多模态推理引擎。Luma将该代理定位为广告公司、营销部门、设计工作室及企业的变革性工具。据称,这些代理不仅能规划并生成文本、图像、视频和音频内容,还能协同其他AI模型运作,包括Luma的Ray 3.

索拉的最新更新提供了宠物人工智能视频、社交工具和即将推出的安卓应用程序

OpenAI 正在预览其爆款人工智能视频创作应用 Sora 的一系列新功能,该应用在 9 月底推出后迅速攀升至 App Store 榜首。该应用在美国和加拿大仍保持着第一的位置,不久将增加视频编辑功能,让用户创建宠物和其他物品的角色 "浮雕",增强社交功能等。该公司还确认 Android 版本 "即将推出"。Sora 的负责人比尔-皮布尔斯(Bill Peebles)在 X 上宣布了这一消息,称这

索拉的最新更新提供了宠物人工智能视频、社交工具和即将推出的安卓应用程序

OpenAI 正在预览其爆款人工智能视频创作应用 Sora 的一系列新功能,该应用在 9 月底推出后迅速攀升至 App Store 榜首。该应用在美国和加拿大仍保持着第一的位置,不久将增加视频编辑功能,让用户创建宠物和其他物品的角色 "浮雕",增强社交功能等。该公司还确认 Android 版本 "即将推出"。Sora 的负责人比尔-皮布尔斯(Bill Peebles)在 X 上宣布了这一消息,称这

人工智能视频生成朝着完全控制

诸如Hunyuan和Wan 2.1之类的视频基础模型已经取得了长足的进步,但是当涉及电影和电视制作所需的详细控制时,尤其是在视觉效果领域(VFX)所需的详细控制。在专业的VFX Studios中,这些模型以及早期的Image-Bas

相关专题推荐

评论 (1)

0/500

人工智能视频生成朝着完全控制

诸如Hunyuan和Wan 2.1之类的视频基础模型已经取得了长足的进步,但是当涉及电影和电视制作所需的详细控制时,尤其是在视觉效果领域(VFX)所需的详细控制。在专业的VFX Studios中,这些模型以及早期的Image-Bas

相关专题推荐

评论 (1)

0/500

本文探讨了腾讯推出的HunyuanCustom,一种多模态视频生成模型。附带的研究论文内容广泛,项目页面提供的示例视频存在挑战,因此需要更广泛的概述,由于格式和处理要求,视频内容的完整再现受限,以提高清晰度。

注意,论文中将基于API的生成系统Kling称为“Keling”。为保持一致性,本文全程使用“Kling”。

腾讯推出了其Hunyuan Video模型的先进迭代版本,名为HunyuanCustom。据报道,该版本通过仅使用一张单图即可创建深伪风格的视频定制,超越了对Hunyuan LoRA模型的需求:

点击播放。提示:“一名男子在厨房准备螺蛳粉时享受音乐。”与专有和开源方法(包括主要竞争对手Kling)相比,HunyuanCustom表现突出。 来源:https://hunyuancustom.github.io/(注意:资源密集型网站)

在上述视频中,最左侧列显示HunyuanCustom的单张源图像输入,旁边一列展示系统对提示的解释。其余列展示其他系统的输出:Kling、Vidu、Pika、Hailuo和SkyReels-A2(基于Wan)。

以下视频展示了此次发布的三个核心场景:人物与物体、单角色复制和虚拟服装试穿:

点击播放。来自Hunyuan Video支持站点的三个精选示例。

这些示例揭示了仅依赖单张源图像而非多视角的限制。

在第一个片段中,男子面向摄像头,头部移动幅度不超过20-25度。超过此范围,系统难以从单张正面图像准确推断其侧面轮廓。

在第二个片段中,女孩在视频中保持微笑表情,与其静态源图像一致。没有额外的参考图像,HunyuanCustom无法可靠地描绘她的中性表情,面部也基本保持正面,类似于前一个示例。

在最后一个片段中,源素材不完整——一名女子和虚拟服装——导致渲染被裁剪,这是处理有限数据的实用解决方法。

虽然HunyuanCustom支持多张图像输入(例如,人物与零食或人物与服装),但不支持单一角色的不同角度或表情。这可能限制其完全替代HunyuanVideo的LoRA模型生态系统,后者使用20-60张图像以确保角色在不同角度和表情下的一致性渲染。

音频整合

对于音频,HunyuanCustom采用LatentSync系统,业余爱好者配置较为困难,用于同步用户提供的音频和文本的唇部动作:

包含音频,点击播放。来自HunyuanCustom补充站点的唇部同步示例合集。

目前没有英文示例,但结果看起来很有前景,特别是如果设置过程对用户友好。

视频编辑能力

HunyuanCustom在视频到视频(V2V)编辑方面表现出色,允许使用单张参考图像对现有视频中的元素进行针对性替换。补充材料中的一个示例说明了这一点:

点击播放。中心物体被修改,周围元素在HunyuanCustom的V2V过程中被微妙调整。

与典型的V2V工作流程类似,整个视频略有修改,重点在目标区域,如毛绒玩具。高级流水线可能会保留更多原始内容,类似于Adobe Firefly的方法,尽管这在开源社区中尚未充分探索。

其他示例展示了在目标整合方面的精度提升,如下述合集所示:

点击播放。HunyuanCustom中V2V内容插入的多种示例,展示了对未更改元素的尊重。

进化升级

HunyuanCustom基于Hunyuan Video项目,引入了针对性的架构增强,而非彻底重构。这些升级旨在无需特定主题微调(如LoRA或文本反转)即可保持帧间角色一致性。

此次发布是2024年12月HunyuanVideo模型的精炼版本,而非全新模型。

现有HunyuanVideo LoRA用户可能质疑其与此次更新的兼容性,或是否需要开发新的LoRA以利用增强的定制功能。

通常,重大微调会改变模型权重,足以使之前的LoRA不兼容。然而,像Pony Diffusion for Stable Diffusion XL这样的微调已创建了独立的生态系统,拥有专用LoRA库,表明HunyuanCustom可能也有类似潜力。

发布详情

研究论文标题为HunyuanCustom:用于定制视频生成的多模态驱动架构,链接到一个现已活跃的GitHub存储库,包含代码和权重以供本地部署,并计划整合ComfyUI。

目前,项目的Hugging Face页面无法访问,但通过微信扫码可使用基于API的演示。

HunyuanCustom整合了多种项目,内容相当全面,可能是由于许可要求需完全披露。

提供两种模型变体:720x1280px版本需要80GB GPU内存以获得最佳性能(最低24GB,但速度慢)和512x896px版本需要60GB。测试仅限于Linux,但社区努力可能很快使其适配Windows和较低VRAM配置,如之前的Hunyuan Video模型所示。

由于附带材料量大,本概述对HunyuanCustom的功能采取了高层次方法。

技术洞察

HunyuanCustom的数据流水线符合GDPR,整合了合成和开源视频数据集,如OpenHumanVid,涵盖八个类别:人类、动物、植物、风景、车辆、物体、建筑和动漫。

来自发布论文,概述了HunyuanCustom数据构建流水线中的多样化贡献包。 来源:https://arxiv.org/pdf/2505.04512

视频使用PySceneDetect分割成单镜头片段,TextBPN-Plus-Plus过滤掉包含过多文本、字幕或水印的内容。

片段标准化为五秒,短边调整为512或720像素。使用Koala-36M以自定义0.06阈值确保美学质量。

人类身份提取利用Qwen7B、YOLO11X和InsightFace,非人类主体则使用QwenVL和Grounded SAM 2处理,丢弃小型边界框。

使用Grounded SAM 2进行语义分割的示例,应用于Hunyuan Control项目。 来源:https://github.com/IDEA-Research/Grounded-SAM-2

多主体提取使用Florence2进行标注,Grounded SAM 2进行分割,随后进行聚类和时间帧分割。

片段通过Hunyuan团队的专有结构化标注增强,添加描述和相机运动提示等元数据。

掩码增强防止过拟合,确保适应多样化的物体形状。音频同步使用LatentSync,丢弃低于质量阈值的片段。HyperIQA过滤得分低于40的视频,Whisper处理有效音频以用于下游任务。

LLaVA模型在生成字幕和对齐视觉与文本内容以确保语义一致性方面发挥核心作用,特别是在复杂或多主体场景中。

HunyuanCustom框架支持基于文本、图像、音频和视频输入的身份一致性视频生成。

视频定制

为实现从参考图像和提示生成视频,开发了两个基于LLaVA的模块,调整HunyuanVideo的输入以接受图像和文本。提示直接嵌入图像或使用简短身份描述标记,使用分隔符平衡图像和文本的影响。

身份增强模块解决了LLaVA在短视频片段中丢失细粒度空间细节的问题,这对保持主体一致性至关重要。

参考图像通过HunyuanVideo的因果3D-VAE调整大小并编码,其潜在表示沿时间轴插入,并添加空间偏移以指导生成而非直接复制。

训练使用Flow Matching,噪声来自logit-normal分布,联合微调LLaVA和视频生成器以实现图像-提示引导和身份一致性。

对于多主体提示,每个图像-文本对以不同时间位置单独嵌入,支持多主体交互场景。

音频与视觉整合

HunyuanCustom支持使用用户提供的音频和文本进行音频驱动生成,使角色在相关场景中说话。

身份解耦AudioNet模块将音频特征与视频时间线对齐,使用空间交叉注意力隔离帧并保持主体一致性。

时间注入模块通过多层感知器优化动作时机,将音频映射到潜在序列,确保手势与音频节奏对齐。

对于视频编辑,HunyuanCustom在不重新生成整个视频的情况下替换现有片段中的主体,适合针对性外观或动作更改。

点击播放。来自补充站点的另一个示例。

系统使用预训练的因果3D-VAE压缩参考视频,与生成流水线的潜在表示对齐以实现轻量级处理。神经网络将干净输入视频与噪声潜在表示对齐,逐帧特征添加比预压缩合并更有效。

性能评估

测试指标包括ArcFace用于面部身份一致性,YOLO11x和Dino 2用于主体相似性,CLIP-B用于文本-视频对齐和时间一致性,VBench用于动作强度。

竞争对手包括闭源系统(Hailuo、Vidu 2.0、Kling 1.6、Pika)和开源框架(VACE、SkyReels-A2)。

模型性能评估,比较HunyuanCustom与领先视频定制方法在身份一致性(Face-Sim)、主体相似性(DINO-Sim)、文本-视频对齐(CLIP-B-T)、时间一致性(Temp-Consis)和动作强度(DD)方面的表现。最佳和次佳结果分别以粗体和下划线显示。

作者指出:

“HunyuanCustom在身份和主体一致性方面表现出色,提示遵循度和时间稳定性具有竞争力。Hailuo因强大的文本对齐在剪辑得分上领先,但在非人类主体一致性上表现不佳。Vidu和VACE在动作强度上落后,可能是由于模型规模较小。”

虽然项目站点提供了众多比较视频,但其布局更注重美观而非比较的便捷性。建议读者直接查看视频以获得更清晰的见解:

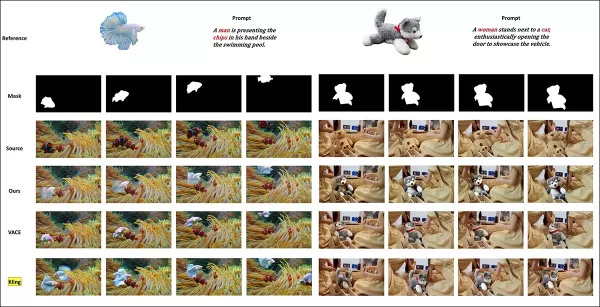

来自论文,关于以物体为中心视频定制的比较。观众应参考源PDF以获得更好的分辨率,项目站点的视频提供更清晰的见解。

作者声明:

“Vidu、SkyReels A2和HunyuanCustom在提示对齐和主体一致性上表现强劲,但我们的视频质量超越Vidu和SkyReels,这得益于Hunyuanvideo-13B的坚实基础。”

“在商业解决方案中,Kling提供高质量视频,但在首帧出现复制粘贴效果,偶尔出现主体模糊,影响观看体验。”

Pika在时间一致性上表现不佳,引入了因数据整理不佳导致的字幕伪影。Hailuo保留了面部身份,但在全身一致性上表现不佳。VACE在开源方法中无法保持身份一致性,而HunyuanCustom在身份保留、质量和多样性方面表现强劲。

多主体视频定制测试得出了相似的结果:

使用多主体视频定制的比较。请参阅PDF以获取更好的细节和分辨率。

论文指出:

“Pika生成指定主体,但显示帧不稳定性,主体消失或无法遵循提示。Vidu和VACE部分捕捉人类身份,但丢失非人类物体细节。SkyReels A2出现严重的帧不稳定和伪影。HunyuanCustom有效捕捉所有主体身份,遵循提示,并保持高视觉质量和稳定性。”

虚拟人类广告测试集成了产品与人物:

来自定性测试轮次的神经“产品植入”示例。请参阅PDF以获取更好的细节和分辨率。

作者声明:

“HunyuanCustom保持人类身份和产品细节,包括文本,交互自然,提示遵循度高,展示了其在广告视频中的潜力。”

音频驱动定制测试突出了灵活的场景和姿态控制:

音频轮次的部分结果——视频结果可能更佳。由于尺寸限制,仅显示PDF图的上半部分。请参阅源PDF以获取更好的细节。

作者指出:

“之前的音频驱动方法将姿态和环境限制在输入图像上,限制了应用。HunyuanCustom通过文本描述的场景和姿态实现灵活的音频驱动动画。”

视频主体替换测试比较了HunyuanCustom与VACE和Kling 1.6:

测试视频到视频模式的主体替换。请参阅源PDF以获取更好的细节和分辨率。

研究人员声明:

“VACE因严格的掩码遵循产生边界伪影,破坏动作连续性。Kling显示复制粘贴效果,背景整合不佳。HunyuanCustom避免伪影,确保无缝整合,并保持强大的身份保留,在视频编辑中表现出色。”

结论

HunyuanCustom是一个引人注目的发布,满足了视频合成中对唇部同步的日益增长的需求,增强了如Hunyuan Video等系统的真实感。尽管由于项目站点视频布局的限制,比较其能力存在挑战,但腾讯的模型在与Kling等顶级竞争对手的竞争中表现出色,标志着定制视频生成领域的显著进展。

* 一些视频过宽、过短或分辨率过高,无法在VLC或Windows Media Player等标准播放器中播放,显示黑屏。

首次发布于2025年5月8日,星期四

独家报道:Luma AI推出基于"统一智能"模型的创意智能助手

周四,人工智能视频生成初创公司Luma推出了Luma Agents系统,该系统旨在管理涵盖文本、图像、视频和音频的完整创意工作流程。这些智能代理由Luma的统一智能模型家族驱动,其架构经过训练成为单一的多模态推理引擎。Luma将该代理定位为广告公司、营销部门、设计工作室及企业的变革性工具。据称,这些代理不仅能规划并生成文本、图像、视频和音频内容,还能协同其他AI模型运作,包括Luma的Ray 3.

独家报道:Luma AI推出基于"统一智能"模型的创意智能助手

周四,人工智能视频生成初创公司Luma推出了Luma Agents系统,该系统旨在管理涵盖文本、图像、视频和音频的完整创意工作流程。这些智能代理由Luma的统一智能模型家族驱动,其架构经过训练成为单一的多模态推理引擎。Luma将该代理定位为广告公司、营销部门、设计工作室及企业的变革性工具。据称,这些代理不仅能规划并生成文本、图像、视频和音频内容,还能协同其他AI模型运作,包括Luma的Ray 3.

索拉的最新更新提供了宠物人工智能视频、社交工具和即将推出的安卓应用程序

OpenAI 正在预览其爆款人工智能视频创作应用 Sora 的一系列新功能,该应用在 9 月底推出后迅速攀升至 App Store 榜首。该应用在美国和加拿大仍保持着第一的位置,不久将增加视频编辑功能,让用户创建宠物和其他物品的角色 "浮雕",增强社交功能等。该公司还确认 Android 版本 "即将推出"。Sora 的负责人比尔-皮布尔斯(Bill Peebles)在 X 上宣布了这一消息,称这

索拉的最新更新提供了宠物人工智能视频、社交工具和即将推出的安卓应用程序

OpenAI 正在预览其爆款人工智能视频创作应用 Sora 的一系列新功能,该应用在 9 月底推出后迅速攀升至 App Store 榜首。该应用在美国和加拿大仍保持着第一的位置,不久将增加视频编辑功能,让用户创建宠物和其他物品的角色 "浮雕",增强社交功能等。该公司还确认 Android 版本 "即将推出"。Sora 的负责人比尔-皮布尔斯(Bill Peebles)在 X 上宣布了这一消息,称这

人工智能视频生成朝着完全控制

诸如Hunyuan和Wan 2.1之类的视频基础模型已经取得了长足的进步,但是当涉及电影和电视制作所需的详细控制时,尤其是在视觉效果领域(VFX)所需的详细控制。在专业的VFX Studios中,这些模型以及早期的Image-Bas

人工智能视频生成朝着完全控制

诸如Hunyuan和Wan 2.1之类的视频基础模型已经取得了长足的进步,但是当涉及电影和电视制作所需的详细控制时,尤其是在视觉效果领域(VFX)所需的详细控制。在专业的VFX Studios中,这些模型以及早期的Image-Bas

首页

首页