在真實視頻內容中揭示微妙而有影響力的AI修改

2019年,一段關於時任美國眾議院議長南希·佩洛西的欺騙性影片廣泛流傳。這段影片經過編輯,使她看起來像是醉酒狀態,清楚提醒人們操縱媒體多麼容易誤導公眾。儘管手法簡單,這一事件凸顯了即使是基本的音視頻編輯也可能造成的潛在傷害。

當時,深度偽造技術主要由基於自編碼器的面部替換技術主導,這些技術自2017年底開始出現。這些早期系統難以實現佩洛西影片中看到的細微變化,更多專注於較明顯的面部替換。

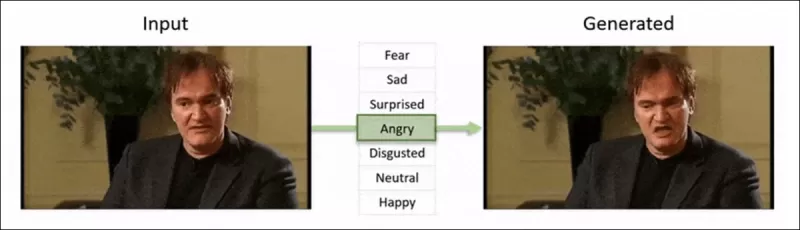

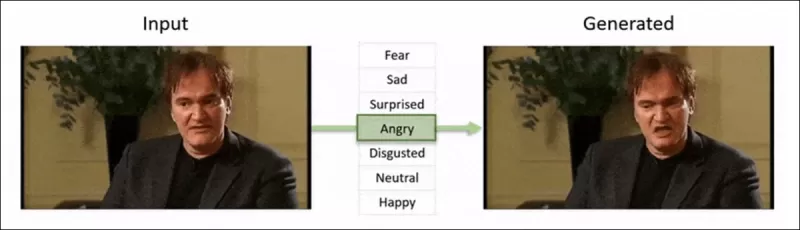

2022年的‘神經情感導演’框架改變了知名人物的情緒。 來源:https://www.youtube.com/watch?v=Li6W8pRDMJQ

2022年的‘神經情感導演’框架改變了知名人物的情緒。 來源:https://www.youtube.com/watch?v=Li6W8pRDMJQ

時至今日,電影和電視產業越來越探索AI驅動的後期製作編輯。這一趨勢引發了興趣與批評,因為AI實現了以往無法達到的完美主義水平。作為回應,研究社群開發了多個專注於面部捕捉「局部編輯」的項目,如擴散視頻自編碼器、時空縫合、ChatFace、MagicFace和DISCO。

2025年1月的MagicFace項目進行表情編輯。 來源:https://arxiv.org/pdf/2501.02260

2025年1月的MagicFace項目進行表情編輯。 來源:https://arxiv.org/pdf/2501.02260

新面孔,新挑戰

然而,用於創建這些細微編輯的技術進展遠快於我們檢測它們的能力。大多數深度偽造檢測方法已過時,專注於較舊的技術和數據集。直到最近來自印度的研究人員取得突破。

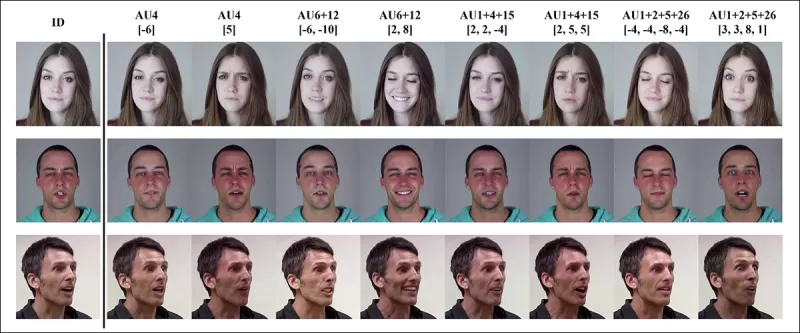

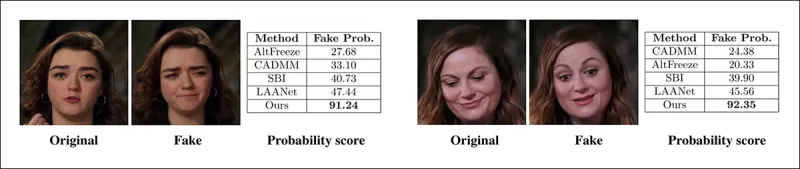

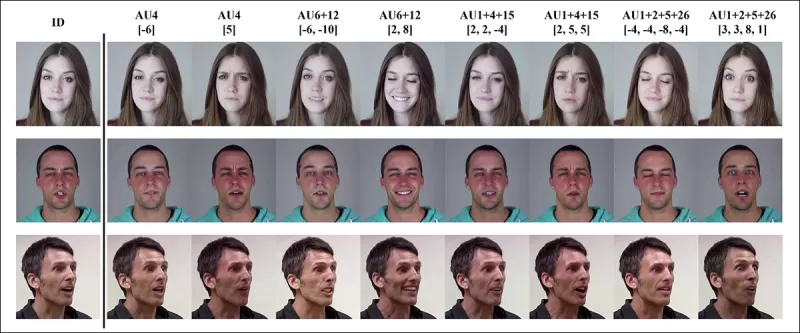

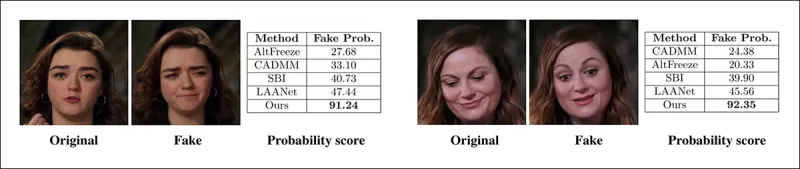

檢測深度偽造中的細微局部編輯:真實影片被更改以生成具有細微變化的偽造影片,例如抬高眉毛、修改性別特徵以及表情轉向厭惡(此處以單幀圖示)。 來源:https://arxiv.org/pdf/2503.22121

檢測深度偽造中的細微局部編輯:真實影片被更改以生成具有細微變化的偽造影片,例如抬高眉毛、修改性別特徵以及表情轉向厭惡(此處以單幀圖示)。 來源:https://arxiv.org/pdf/2503.22121

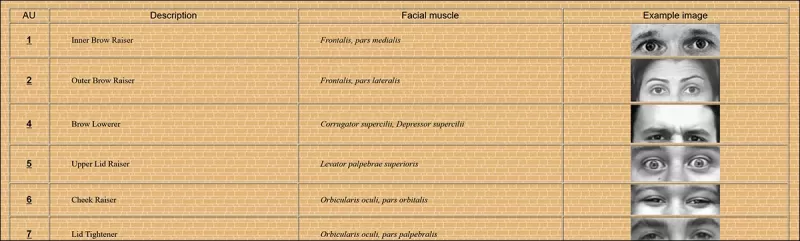

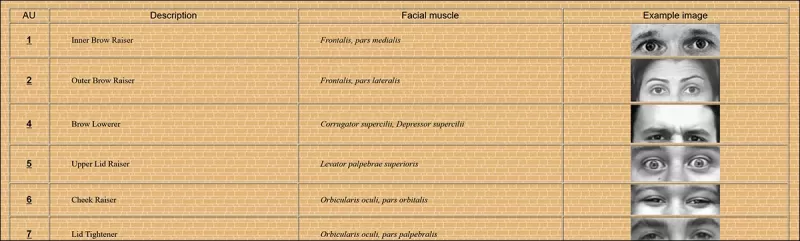

這項新研究針對細微、局部化的面部操縱檢測,這類偽造往往被忽視。該方法不尋找廣泛的不一致或身份不匹配,而是聚焦於細微的表情變化或特定面部特徵的微小編輯。它利用了面部動作編碼系統(FACS),將面部表情分解為64個可變區域。

FACS中的部分64個表情

FACS中的部分64個表情

相關文章

YouTube 將 AI 深度偽造偵測功能擴展至政治人物、政府官員及記者

週二,YouTube 宣布將其深度偽造(deepfake)偵測技術擴展至特定群體,包括政府官員、政治候選人及記者。該工具能識別由人工智慧生成的肖像,並允許試點計畫的參與者要求移除其認為違反 YouTube 政策且未經授權的內容。該偵測系統在經過前期測試階段後,去年首度向約 400 萬名 YouTube 合作夥伴計畫的創作者推出。與 YouTube 現有的版權內容識別系統(Content ID)類似

YouTube 將 AI 深度偽造偵測功能擴展至政治人物、政府官員及記者

週二,YouTube 宣布將其深度偽造(deepfake)偵測技術擴展至特定群體,包括政府官員、政治候選人及記者。該工具能識別由人工智慧生成的肖像,並允許試點計畫的參與者要求移除其認為違反 YouTube 政策且未經授權的內容。該偵測系統在經過前期測試階段後,去年首度向約 400 萬名 YouTube 合作夥伴計畫的創作者推出。與 YouTube 現有的版權內容識別系統(Content ID)類似

YouTube 加強針對政治人物、公職人員及新聞工作者的 AI 深度偽造防護措施

YouTube 週二宣布,將把其用於識別 AI 生成深度偽造影片的肖像檢測技術,擴展至針對政府官員、政治候選人及新聞工作者的試點計畫。參與此試點計畫的人士將能使用一項工具,用以查找未經授權且使用其肖像的 AI 生成內容,並在該內容違反 YouTube 政策時提交移除請求。這項技術最初於去年在 YouTube 合作夥伴計畫中向約 400 萬名創作者推出,是基於先前測試的成果。這項肖像檢測功能運作方式

YouTube 加強針對政治人物、公職人員及新聞工作者的 AI 深度偽造防護措施

YouTube 週二宣布,將把其用於識別 AI 生成深度偽造影片的肖像檢測技術,擴展至針對政府官員、政治候選人及新聞工作者的試點計畫。參與此試點計畫的人士將能使用一項工具,用以查找未經授權且使用其肖像的 AI 生成內容,並在該內容違反 YouTube 政策時提交移除請求。這項技術最初於去年在 YouTube 合作夥伴計畫中向約 400 萬名創作者推出,是基於先前測試的成果。這項肖像檢測功能運作方式

獨家報導:Luma AI 推出搭載「統一智能」模型的創意代理程式

週四,AI影片生成新創公司Luma推出「Luma Agents」系統,旨在管理涵蓋文字、圖像、影片及音訊的完整創意工作流程。這些代理程式由Luma的統一智能模型家族驅動,其架構經訓練成為單一多模態推理引擎。Luma將其代理程式定位為廣告代理商、行銷部門、設計工作室及企業的變革性工具。據Luma表示,這些代理程式不僅能規劃與製作文字、圖像、影片及音訊內容,還能與其他AI模型協同運作,例如Luma的R

相關專題推薦

評論 (46)

0/500

獨家報導:Luma AI 推出搭載「統一智能」模型的創意代理程式

週四,AI影片生成新創公司Luma推出「Luma Agents」系統,旨在管理涵蓋文字、圖像、影片及音訊的完整創意工作流程。這些代理程式由Luma的統一智能模型家族驅動,其架構經訓練成為單一多模態推理引擎。Luma將其代理程式定位為廣告代理商、行銷部門、設計工作室及企業的變革性工具。據Luma表示,這些代理程式不僅能規劃與製作文字、圖像、影片及音訊內容,還能與其他AI模型協同運作,例如Luma的R

相關專題推薦

評論 (46)

0/500

![RalphMitchell]()

この記事を読んで、AIによる映像改ざんがこんなに簡単にできるなんて怖いですね。ペロシ議長の例は氷山の一角で、もっと巧妙な偽動画がSNSで拡散される可能性があります。一般ユーザーとして、どうやって本物と偽物を見分ければいいのか悩みます。技術の進歩は素晴らしいけど、悪用されないための規制も必要じゃないかな🤔

![JustinHarris]()

Honestly, this Pelosi video case is a perfect example of how 'low-tech' AI manipulation can be the most dangerous. It doesn't need deepfakes; just slowing down footage creates a narrative. Makes you wonder what subtle edits we're already consuming daily without a second thought. The real battle for truth is in these tiny, almost invisible tweaks. 😳

![DavidRodriguez]()

Dieser Artikel erinnert mich daran, wie wichtig Medienkompetenz heute ist. Die Pelosi-Video-Manipulation war ja noch relativ plump, aber mit aktueller KI wird das bestimmt viel subtiler. Macht mir schon etwas Sorgen, vor Wahlen oder so. Wie soll man da noch zwischen echt und fake unterscheiden? 😕

![WilliamCarter]()

That Pelosi video from 2019 is wild! It’s scary how a few tweaks can make someone look totally drunk. AI’s power to mess with videos is both cool and creepy—makes you wonder what’s real anymore. 😬

![JuanMartínez]()

This Pelosi video incident is wild! 🤯 It’s scary how a few tweaks can make someone look totally out of it. Makes me wonder how much of what we see online is real anymore. AI’s cool, but this kind of stuff could mess with trust big time.

2019年,一段關於時任美國眾議院議長南希·佩洛西的欺騙性影片廣泛流傳。這段影片經過編輯,使她看起來像是醉酒狀態,清楚提醒人們操縱媒體多麼容易誤導公眾。儘管手法簡單,這一事件凸顯了即使是基本的音視頻編輯也可能造成的潛在傷害。

當時,深度偽造技術主要由基於自編碼器的面部替換技術主導,這些技術自2017年底開始出現。這些早期系統難以實現佩洛西影片中看到的細微變化,更多專注於較明顯的面部替換。

2022年的‘神經情感導演’框架改變了知名人物的情緒。 來源:https://www.youtube.com/watch?v=Li6W8pRDMJQ

2022年的‘神經情感導演’框架改變了知名人物的情緒。 來源:https://www.youtube.com/watch?v=Li6W8pRDMJQ

時至今日,電影和電視產業越來越探索AI驅動的後期製作編輯。這一趨勢引發了興趣與批評,因為AI實現了以往無法達到的完美主義水平。作為回應,研究社群開發了多個專注於面部捕捉「局部編輯」的項目,如擴散視頻自編碼器、時空縫合、ChatFace、MagicFace和DISCO。

2025年1月的MagicFace項目進行表情編輯。 來源:https://arxiv.org/pdf/2501.02260

2025年1月的MagicFace項目進行表情編輯。 來源:https://arxiv.org/pdf/2501.02260

新面孔,新挑戰

然而,用於創建這些細微編輯的技術進展遠快於我們檢測它們的能力。大多數深度偽造檢測方法已過時,專注於較舊的技術和數據集。直到最近來自印度的研究人員取得突破。

檢測深度偽造中的細微局部編輯:真實影片被更改以生成具有細微變化的偽造影片,例如抬高眉毛、修改性別特徵以及表情轉向厭惡(此處以單幀圖示)。 來源:https://arxiv.org/pdf/2503.22121

檢測深度偽造中的細微局部編輯:真實影片被更改以生成具有細微變化的偽造影片,例如抬高眉毛、修改性別特徵以及表情轉向厭惡(此處以單幀圖示)。 來源:https://arxiv.org/pdf/2503.22121

這項新研究針對細微、局部化的面部操縱檢測,這類偽造往往被忽視。該方法不尋找廣泛的不一致或身份不匹配,而是聚焦於細微的表情變化或特定面部特徵的微小編輯。它利用了面部動作編碼系統(FACS),將面部表情分解為64個可變區域。

FACS中的部分64個表情

FACS中的部分64個表情

YouTube 將 AI 深度偽造偵測功能擴展至政治人物、政府官員及記者

週二,YouTube 宣布將其深度偽造(deepfake)偵測技術擴展至特定群體,包括政府官員、政治候選人及記者。該工具能識別由人工智慧生成的肖像,並允許試點計畫的參與者要求移除其認為違反 YouTube 政策且未經授權的內容。該偵測系統在經過前期測試階段後,去年首度向約 400 萬名 YouTube 合作夥伴計畫的創作者推出。與 YouTube 現有的版權內容識別系統(Content ID)類似

YouTube 將 AI 深度偽造偵測功能擴展至政治人物、政府官員及記者

週二,YouTube 宣布將其深度偽造(deepfake)偵測技術擴展至特定群體,包括政府官員、政治候選人及記者。該工具能識別由人工智慧生成的肖像,並允許試點計畫的參與者要求移除其認為違反 YouTube 政策且未經授權的內容。該偵測系統在經過前期測試階段後,去年首度向約 400 萬名 YouTube 合作夥伴計畫的創作者推出。與 YouTube 現有的版權內容識別系統(Content ID)類似

YouTube 加強針對政治人物、公職人員及新聞工作者的 AI 深度偽造防護措施

YouTube 週二宣布,將把其用於識別 AI 生成深度偽造影片的肖像檢測技術,擴展至針對政府官員、政治候選人及新聞工作者的試點計畫。參與此試點計畫的人士將能使用一項工具,用以查找未經授權且使用其肖像的 AI 生成內容,並在該內容違反 YouTube 政策時提交移除請求。這項技術最初於去年在 YouTube 合作夥伴計畫中向約 400 萬名創作者推出,是基於先前測試的成果。這項肖像檢測功能運作方式

YouTube 加強針對政治人物、公職人員及新聞工作者的 AI 深度偽造防護措施

YouTube 週二宣布,將把其用於識別 AI 生成深度偽造影片的肖像檢測技術,擴展至針對政府官員、政治候選人及新聞工作者的試點計畫。參與此試點計畫的人士將能使用一項工具,用以查找未經授權且使用其肖像的 AI 生成內容,並在該內容違反 YouTube 政策時提交移除請求。這項技術最初於去年在 YouTube 合作夥伴計畫中向約 400 萬名創作者推出,是基於先前測試的成果。這項肖像檢測功能運作方式

獨家報導:Luma AI 推出搭載「統一智能」模型的創意代理程式

週四,AI影片生成新創公司Luma推出「Luma Agents」系統,旨在管理涵蓋文字、圖像、影片及音訊的完整創意工作流程。這些代理程式由Luma的統一智能模型家族驅動,其架構經訓練成為單一多模態推理引擎。Luma將其代理程式定位為廣告代理商、行銷部門、設計工作室及企業的變革性工具。據Luma表示,這些代理程式不僅能規劃與製作文字、圖像、影片及音訊內容,還能與其他AI模型協同運作,例如Luma的R

獨家報導:Luma AI 推出搭載「統一智能」模型的創意代理程式

週四,AI影片生成新創公司Luma推出「Luma Agents」系統,旨在管理涵蓋文字、圖像、影片及音訊的完整創意工作流程。這些代理程式由Luma的統一智能模型家族驅動,其架構經訓練成為單一多模態推理引擎。Luma將其代理程式定位為廣告代理商、行銷部門、設計工作室及企業的變革性工具。據Luma表示,這些代理程式不僅能規劃與製作文字、圖像、影片及音訊內容,還能與其他AI模型協同運作,例如Luma的R

この記事を読んで、AIによる映像改ざんがこんなに簡単にできるなんて怖いですね。ペロシ議長の例は氷山の一角で、もっと巧妙な偽動画がSNSで拡散される可能性があります。一般ユーザーとして、どうやって本物と偽物を見分ければいいのか悩みます。技術の進歩は素晴らしいけど、悪用されないための規制も必要じゃないかな🤔

Honestly, this Pelosi video case is a perfect example of how 'low-tech' AI manipulation can be the most dangerous. It doesn't need deepfakes; just slowing down footage creates a narrative. Makes you wonder what subtle edits we're already consuming daily without a second thought. The real battle for truth is in these tiny, almost invisible tweaks. 😳

Dieser Artikel erinnert mich daran, wie wichtig Medienkompetenz heute ist. Die Pelosi-Video-Manipulation war ja noch relativ plump, aber mit aktueller KI wird das bestimmt viel subtiler. Macht mir schon etwas Sorgen, vor Wahlen oder so. Wie soll man da noch zwischen echt und fake unterscheiden? 😕

That Pelosi video from 2019 is wild! It’s scary how a few tweaks can make someone look totally drunk. AI’s power to mess with videos is both cool and creepy—makes you wonder what’s real anymore. 😬

This Pelosi video incident is wild! 🤯 It’s scary how a few tweaks can make someone look totally out of it. Makes me wonder how much of what we see online is real anymore. AI’s cool, but this kind of stuff could mess with trust big time.

首頁

首頁