研究:OpenAI模型記憶的受版權保護內容

近期一項研究表明,OpenAI確實可能使用了受版權保護的材料來訓練其部分AI模型,為該公司面臨的持續法律爭議增添了燃料。作者、程式設計師和其他內容創作者指控OpenAI未經許可使用他們的作品(如書籍和程式碼)來開發其AI模型。雖然OpenAI以合理使用為由進行辯護,但原告認為美國版權法並未為訓練數據提供例外。

這項研究由華盛頓大學、哥本哈根大學和史丹佛大學的研究人員合作進行,介紹了一種新技術,用於檢測通過API存取的模型(如OpenAI的模型)中「記憶」的訓練數據。AI模型基本上從大量數據中學習以識別模式,使其能夠創作文稿、圖像等。雖然大多數輸出並非訓練數據的直接複製品,但由於學習過程,某些輸出難免是複製品。例如,圖像模型已知會重現電影截圖,而語言模型則被發現幾乎是在抄襲新聞文章。

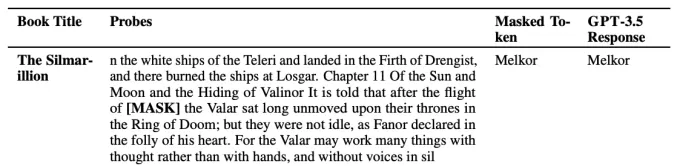

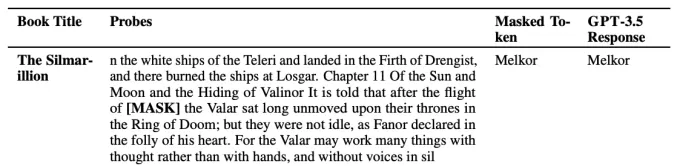

研究中描述的方法聚焦於「高驚訝度」詞彙——在特定情境中不常見的詞。例如,在句子「Jack和我靜坐不動,雷達嗡嗡作響」中,「雷達」是一個高驚訝度詞,因為相較於「引擎」或「收音機」等詞,它較不常與「嗡嗡作響」連繫。

研究人員測試了多個OpenAI模型,包括GPT-4和GPT-3.5,方法是從小說書籍和新紐約時報文章的摘錄中移除高驚訝度詞彙,並要求模型預測這些缺失的詞。如果模型能準確猜出這些詞,則表明它們在訓練過程中記憶了這些文本。

一個讓模型「猜測」高驚訝度詞的例子。圖片來源:OpenAI 結果顯示,GPT-4很可能記憶了受版權保護的電子書數據集BookMIA中的部分熱門小說書籍內容。它似乎也記憶了一些紐約時報的文章,儘管頻率較低。華盛頓大學博士生兼研究合著者Abhilasha Ravichander向TechCrunch強調,這些發現凸顯了可能用於訓練這些模型的「具爭議性數據」。「為了擁有值得信賴的大型語言模型,我們需要能夠探查、審計和科學檢驗的模型,」Ravichander表示。「我們的工作旨在提供一個探查大型語言模型的工具,但整個生態系統對數據透明度的需求確實很大。」

OpenAI一直推動放寬使用受版權保護數據來開發AI模型的規則。雖然該公司已與一些內容持有者簽訂了授權協議,並為版權持有人提供退出選項,但它也向各國政府遊說,試圖為AI訓練建立「合理使用」規則。

相關文章

薩提亞·納德拉準備利用與OpenAI的新合作關係

週三,一位華爾街分析師直接詢問了微軟執行長薩蒂亞·納德拉,修訂後的OpenAI合作關係將如何影響公司的財務狀況。 納德拉將這一新協議描述為對各方都有利的結果。“我們對與OpenAI的合作感到滿意。我始終非常重視任何合作關係,並確保它能夠實現雙贏。只有這樣,雙方才能保持良好的合作伙伴關係。” 他強調,微軟仍然可以使用OpenAI的智慧財產權,包括其模型和智慧體產品,但不再需要為此向OpenAI支付費用。 談到在2032年之前可以免費使用OpenAI最先進的人工智慧技術,納德拉表示:“

薩提亞·納德拉準備利用與OpenAI的新合作關係

週三,一位華爾街分析師直接詢問了微軟執行長薩蒂亞·納德拉,修訂後的OpenAI合作關係將如何影響公司的財務狀況。 納德拉將這一新協議描述為對各方都有利的結果。“我們對與OpenAI的合作感到滿意。我始終非常重視任何合作關係,並確保它能夠實現雙贏。只有這樣,雙方才能保持良好的合作伙伴關係。” 他強調,微軟仍然可以使用OpenAI的智慧財產權,包括其模型和智慧體產品,但不再需要為此向OpenAI支付費用。 談到在2032年之前可以免費使用OpenAI最先進的人工智慧技術,納德拉表示:“

OpenAI 勾勒出以公共財富基金、機器人稅及每週四天工作制為核心的人工智慧經濟藍圖

當各國政府正竭力應對超智能機器帶來的經濟衝擊之際,OpenAI 發布了一系列政策提案,闡述在「智能時代」中財富與工作可能如何重塑。這些構想將傳統的左翼機制——例如公共財富基金與擴大的社會安全網——與根本上資本主義、市場導向的經濟框架相融合。OpenAI 的提案本質上是一份願望清單,這份公開聲明有助於民選官員、投資者及公眾理解這家市值 8,520 億美元的公司,如何看待人工智慧在重塑勞動與經濟的過程

OpenAI 勾勒出以公共財富基金、機器人稅及每週四天工作制為核心的人工智慧經濟藍圖

當各國政府正竭力應對超智能機器帶來的經濟衝擊之際,OpenAI 發布了一系列政策提案,闡述在「智能時代」中財富與工作可能如何重塑。這些構想將傳統的左翼機制——例如公共財富基金與擴大的社會安全網——與根本上資本主義、市場導向的經濟框架相融合。OpenAI 的提案本質上是一份願望清單,這份公開聲明有助於民選官員、投資者及公眾理解這家市值 8,520 億美元的公司,如何看待人工智慧在重塑勞動與經濟的過程

葛瑞格・布洛克曼揭露伊隆・馬斯克如何離開 OpenAI

2017年8月下旬,OpenAI(當時還是一家小型非營利研究實驗室)的核心成員召開會議,商討如何成立營利實體以將其技術商業化,並籌集實現通用人工智慧(AGI)所需的資金。伊隆·馬斯克要求對公司擁有完全控制權,並剛向每位共同創辦人贈送了一輛特斯拉Model 3。技術長格雷格·布羅克曼表示,他認為這是在馬斯克與山姆·奧特曼為各自對公司未來的願景爭取支持之際,試圖用這份禮物來收買他們。 OpenAI的研

相關專題推薦

評論 (33)

0/500

葛瑞格・布洛克曼揭露伊隆・馬斯克如何離開 OpenAI

2017年8月下旬,OpenAI(當時還是一家小型非營利研究實驗室)的核心成員召開會議,商討如何成立營利實體以將其技術商業化,並籌集實現通用人工智慧(AGI)所需的資金。伊隆·馬斯克要求對公司擁有完全控制權,並剛向每位共同創辦人贈送了一輛特斯拉Model 3。技術長格雷格·布羅克曼表示,他認為這是在馬斯克與山姆·奧特曼為各自對公司未來的願景爭取支持之際,試圖用這份禮物來收買他們。 OpenAI的研

相關專題推薦

評論 (33)

0/500

![JackAllen]()

这篇文章提到的版权问题确实让人担忧,以后AI生成的内容会不会都带着'侵权'的标签?想想就觉得挺讽刺的,毕竟这些模型训练数据不透明,普通用户根本不知道输出里夹带了什么'私货'。希望有更严格的管理办法吧。

![WilliamGonzalez]()

This is wild! OpenAI might’ve gobbled up copyrighted stuff to train their models? I’m not shocked, but it’s kinda shady. Hope those authors and coders get some justice! 😤

![GregoryBaker]()

This is wild! OpenAI might've trained their models on copyrighted stuff? 😳 I wonder how many books and code snippets got swept up in that data vacuum. Ethics in AI is such a messy topic right now.

![JohnGarcia]()

Me sorprendió un poco que OpenAI podría haber usado material con derechos de autor para entrenar sus modelos. Es un poco decepcionante, pero supongo que es el salvaje oeste allá en el mundo de la IA. 🤔 ¿Quizás deberían ser más cuidadosos la próxima vez?

![TimothyMitchell]()

OpenAIが著作権付きの資料を使ってAIを訓練しているという研究は本当に驚きですね!クリエイターにとっては残念ですが、AIの訓練方法について知るのは面白いです。もっと透明性が必要かもしれませんね?🤔

近期一項研究表明,OpenAI確實可能使用了受版權保護的材料來訓練其部分AI模型,為該公司面臨的持續法律爭議增添了燃料。作者、程式設計師和其他內容創作者指控OpenAI未經許可使用他們的作品(如書籍和程式碼)來開發其AI模型。雖然OpenAI以合理使用為由進行辯護,但原告認為美國版權法並未為訓練數據提供例外。

這項研究由華盛頓大學、哥本哈根大學和史丹佛大學的研究人員合作進行,介紹了一種新技術,用於檢測通過API存取的模型(如OpenAI的模型)中「記憶」的訓練數據。AI模型基本上從大量數據中學習以識別模式,使其能夠創作文稿、圖像等。雖然大多數輸出並非訓練數據的直接複製品,但由於學習過程,某些輸出難免是複製品。例如,圖像模型已知會重現電影截圖,而語言模型則被發現幾乎是在抄襲新聞文章。

研究中描述的方法聚焦於「高驚訝度」詞彙——在特定情境中不常見的詞。例如,在句子「Jack和我靜坐不動,雷達嗡嗡作響」中,「雷達」是一個高驚訝度詞,因為相較於「引擎」或「收音機」等詞,它較不常與「嗡嗡作響」連繫。

研究人員測試了多個OpenAI模型,包括GPT-4和GPT-3.5,方法是從小說書籍和新紐約時報文章的摘錄中移除高驚訝度詞彙,並要求模型預測這些缺失的詞。如果模型能準確猜出這些詞,則表明它們在訓練過程中記憶了這些文本。

華盛頓大學博士生兼研究合著者Abhilasha Ravichander向TechCrunch強調,這些發現凸顯了可能用於訓練這些模型的「具爭議性數據」。「為了擁有值得信賴的大型語言模型,我們需要能夠探查、審計和科學檢驗的模型,」Ravichander表示。「我們的工作旨在提供一個探查大型語言模型的工具,但整個生態系統對數據透明度的需求確實很大。」

OpenAI一直推動放寬使用受版權保護數據來開發AI模型的規則。雖然該公司已與一些內容持有者簽訂了授權協議,並為版權持有人提供退出選項,但它也向各國政府遊說,試圖為AI訓練建立「合理使用」規則。

薩提亞·納德拉準備利用與OpenAI的新合作關係

週三,一位華爾街分析師直接詢問了微軟執行長薩蒂亞·納德拉,修訂後的OpenAI合作關係將如何影響公司的財務狀況。 納德拉將這一新協議描述為對各方都有利的結果。“我們對與OpenAI的合作感到滿意。我始終非常重視任何合作關係,並確保它能夠實現雙贏。只有這樣,雙方才能保持良好的合作伙伴關係。” 他強調,微軟仍然可以使用OpenAI的智慧財產權,包括其模型和智慧體產品,但不再需要為此向OpenAI支付費用。 談到在2032年之前可以免費使用OpenAI最先進的人工智慧技術,納德拉表示:“

薩提亞·納德拉準備利用與OpenAI的新合作關係

週三,一位華爾街分析師直接詢問了微軟執行長薩蒂亞·納德拉,修訂後的OpenAI合作關係將如何影響公司的財務狀況。 納德拉將這一新協議描述為對各方都有利的結果。“我們對與OpenAI的合作感到滿意。我始終非常重視任何合作關係,並確保它能夠實現雙贏。只有這樣,雙方才能保持良好的合作伙伴關係。” 他強調,微軟仍然可以使用OpenAI的智慧財產權,包括其模型和智慧體產品,但不再需要為此向OpenAI支付費用。 談到在2032年之前可以免費使用OpenAI最先進的人工智慧技術,納德拉表示:“

OpenAI 勾勒出以公共財富基金、機器人稅及每週四天工作制為核心的人工智慧經濟藍圖

當各國政府正竭力應對超智能機器帶來的經濟衝擊之際,OpenAI 發布了一系列政策提案,闡述在「智能時代」中財富與工作可能如何重塑。這些構想將傳統的左翼機制——例如公共財富基金與擴大的社會安全網——與根本上資本主義、市場導向的經濟框架相融合。OpenAI 的提案本質上是一份願望清單,這份公開聲明有助於民選官員、投資者及公眾理解這家市值 8,520 億美元的公司,如何看待人工智慧在重塑勞動與經濟的過程

OpenAI 勾勒出以公共財富基金、機器人稅及每週四天工作制為核心的人工智慧經濟藍圖

當各國政府正竭力應對超智能機器帶來的經濟衝擊之際,OpenAI 發布了一系列政策提案,闡述在「智能時代」中財富與工作可能如何重塑。這些構想將傳統的左翼機制——例如公共財富基金與擴大的社會安全網——與根本上資本主義、市場導向的經濟框架相融合。OpenAI 的提案本質上是一份願望清單,這份公開聲明有助於民選官員、投資者及公眾理解這家市值 8,520 億美元的公司,如何看待人工智慧在重塑勞動與經濟的過程

葛瑞格・布洛克曼揭露伊隆・馬斯克如何離開 OpenAI

2017年8月下旬,OpenAI(當時還是一家小型非營利研究實驗室)的核心成員召開會議,商討如何成立營利實體以將其技術商業化,並籌集實現通用人工智慧(AGI)所需的資金。伊隆·馬斯克要求對公司擁有完全控制權,並剛向每位共同創辦人贈送了一輛特斯拉Model 3。技術長格雷格·布羅克曼表示,他認為這是在馬斯克與山姆·奧特曼為各自對公司未來的願景爭取支持之際,試圖用這份禮物來收買他們。 OpenAI的研

葛瑞格・布洛克曼揭露伊隆・馬斯克如何離開 OpenAI

2017年8月下旬,OpenAI(當時還是一家小型非營利研究實驗室)的核心成員召開會議,商討如何成立營利實體以將其技術商業化,並籌集實現通用人工智慧(AGI)所需的資金。伊隆·馬斯克要求對公司擁有完全控制權,並剛向每位共同創辦人贈送了一輛特斯拉Model 3。技術長格雷格·布羅克曼表示,他認為這是在馬斯克與山姆·奧特曼為各自對公司未來的願景爭取支持之際,試圖用這份禮物來收買他們。 OpenAI的研

这篇文章提到的版权问题确实让人担忧,以后AI生成的内容会不会都带着'侵权'的标签?想想就觉得挺讽刺的,毕竟这些模型训练数据不透明,普通用户根本不知道输出里夹带了什么'私货'。希望有更严格的管理办法吧。

This is wild! OpenAI might’ve gobbled up copyrighted stuff to train their models? I’m not shocked, but it’s kinda shady. Hope those authors and coders get some justice! 😤

This is wild! OpenAI might've trained their models on copyrighted stuff? 😳 I wonder how many books and code snippets got swept up in that data vacuum. Ethics in AI is such a messy topic right now.

Me sorprendió un poco que OpenAI podría haber usado material con derechos de autor para entrenar sus modelos. Es un poco decepcionante, pero supongo que es el salvaje oeste allá en el mundo de la IA. 🤔 ¿Quizás deberían ser más cuidadosos la próxima vez?

OpenAIが著作権付きの資料を使ってAIを訓練しているという研究は本当に驚きですね!クリエイターにとっては残念ですが、AIの訓練方法について知るのは面白いです。もっと透明性が必要かもしれませんね?🤔

首頁

首頁