Исследование: модели OpenAI запомнили контент, защищенные авторским правом

Недавнее исследование предполагает, что OpenAI действительно могла использовать материалы, защищенные авторским правом, для обучения некоторых своих моделей ИИ, что подогревает продолжающиеся судебные тяжбы, с которыми сталкивается компания. Авторы, программисты и другие создатели контента обвиняют OpenAI в использовании их произведений — таких как книги и код — без разрешения для разработки своих моделей ИИ. Хотя OpenAI защищается, ссылаясь на добросовестное использование, истцы утверждают, что закон США об авторском праве не предусматривает исключений для обучающих данных.

Исследование, проведенное в сотрудничестве между исследователями из Вашингтонского университета, Копенгагенского университета и Стэнфорда, представляет новую технику для обнаружения «запомненных» обучающих данных в моделях, доступных через API, таких как модели от OpenAI. Модели ИИ по сути обучаются на огромных объемах данных, чтобы распознавать шаблоны, что позволяет им создавать эссе, изображения и многое другое. Хотя большинство выходных данных не являются прямыми копиями обучающих данных, некоторые неизбежно оказываются таковыми из-за процесса обучения. Например, известно, что модели изображений воспроизводят скриншоты из фильмов, а языковые модели уличены в практически плагиате новостных статей.

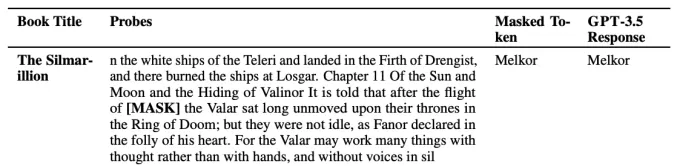

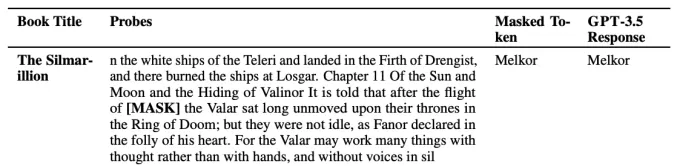

Метод, описанный в исследовании, фокусируется на «высокоудивительных» словах — словах, которые необычны в данном контексте. Например, в предложении «Джек и я сидели совершенно неподвижно, пока радар гудел», слово «радар» будет высокоудивительным, поскольку оно менее ожидаемо, чем слова вроде «двигатель» или «радио» перед словом «гудел».

Исследователи протестировали несколько моделей OpenAI, включая GPT-4 и GPT-3.5, удаляя высокоудивительные слова из отрывков художественных книг и статей New York Times и прося модели предсказать эти пропущенные слова. Если модели точно угадывали слова, это указывало на то, что они запомнили текст во время обучения.

Пример того, как модель «угадывает» высокоудивительное слово. Источник изображения: OpenAI Результаты показали, что GPT-4, вероятно, запомнила части популярных художественных книг, включая те, что находятся в наборе данных BookMIA с защищенными авторским правом электронными книгами. Также оказалось, что она запомнила некоторые статьи New York Times, хотя и с меньшей частотой.Абилаша Равичандер, докторант Вашингтонского университета и соавтор исследования, подчеркнула в беседе с TechCrunch, что эти результаты подчеркивают «спорные данные», которые могли быть использованы для обучения этих моделей. «Чтобы иметь большие языковые модели, которым можно доверять, нам нужны модели, которые мы можем исследовать, проверять и изучать научно», — заявила Равичандер. «Наша работа направлена на предоставление инструмента для исследования больших языковых моделей, но существует реальная потребность в большей прозрачности данных во всей экосистеме».

OpenAI настаивает на более мягких правилах использования данных, защищенных авторским правом, для разработки моделей ИИ. Хотя у компании есть некоторые соглашения о лицензировании контента и она предлагает варианты отказа для правообладателей, она лоббировала различные правительства, чтобы установить правила «добросовестного использования» специально для обучения ИИ.

Связанная статья

OpenAI описывает экономику искусственного интеллекта с участием государственных инвестиционных фондов, налогами на роботов и четырехдневной рабочей неделей

В то время как правительства пытаются справиться с экономическими последствиями появления сверхинтеллектуальных машин, компания OpenAI опубликовала ряд предложений по формированию политики, в которых

OpenAI описывает экономику искусственного интеллекта с участием государственных инвестиционных фондов, налогами на роботов и четырехдневной рабочей неделей

В то время как правительства пытаются справиться с экономическими последствиями появления сверхинтеллектуальных машин, компания OpenAI опубликовала ряд предложений по формированию политики, в которых

Грег Брокман рассказывает, как Илон Маск покинул OpenAI

В конце августа 2017 года ключевые фигуры OpenAI — на тот момент небольшой некоммерческой исследовательской лаборатории — собрались, чтобы обсудить, как создать коммерческую структуру для продвижения

Грег Брокман рассказывает, как Илон Маск покинул OpenAI

В конце августа 2017 года ключевые фигуры OpenAI — на тот момент небольшой некоммерческой исследовательской лаборатории — собрались, чтобы обсудить, как создать коммерческую структуру для продвижения

Пентагон заключил соглашения с Nvidia, Microsoft и AWS о внедрении технологий искусственного интеллекта в секретные сети.

После предыдущих соглашений с Google, SpaceX и OpenAI, Министерство обороны США в пятницу объявило о подписании договоров с Nvidia, Microsoft, Amazon Web Services и Reflection AI о использовании их технологий и моделей искусственного интеллекта в сек

Рекомендации по связанным специальным темам

Комментарии (33)

Пентагон заключил соглашения с Nvidia, Microsoft и AWS о внедрении технологий искусственного интеллекта в секретные сети.

После предыдущих соглашений с Google, SpaceX и OpenAI, Министерство обороны США в пятницу объявило о подписании договоров с Nvidia, Microsoft, Amazon Web Services и Reflection AI о использовании их технологий и моделей искусственного интеллекта в сек

Рекомендации по связанным специальным темам

Комментарии (33)

![JackAllen]()

这篇文章提到的版权问题确实让人担忧,以后AI生成的内容会不会都带着'侵权'的标签?想想就觉得挺讽刺的,毕竟这些模型训练数据不透明,普通用户根本不知道输出里夹带了什么'私货'。希望有更严格的管理办法吧。

![WilliamGonzalez]()

This is wild! OpenAI might’ve gobbled up copyrighted stuff to train their models? I’m not shocked, but it’s kinda shady. Hope those authors and coders get some justice! 😤

![GregoryBaker]()

This is wild! OpenAI might've trained their models on copyrighted stuff? 😳 I wonder how many books and code snippets got swept up in that data vacuum. Ethics in AI is such a messy topic right now.

![JohnGarcia]()

Me sorprendió un poco que OpenAI podría haber usado material con derechos de autor para entrenar sus modelos. Es un poco decepcionante, pero supongo que es el salvaje oeste allá en el mundo de la IA. 🤔 ¿Quizás deberían ser más cuidadosos la próxima vez?

![TimothyMitchell]()

OpenAIが著作権付きの資料を使ってAIを訓練しているという研究は本当に驚きですね!クリエイターにとっては残念ですが、AIの訓練方法について知るのは面白いです。もっと透明性が必要かもしれませんね?🤔

Недавнее исследование предполагает, что OpenAI действительно могла использовать материалы, защищенные авторским правом, для обучения некоторых своих моделей ИИ, что подогревает продолжающиеся судебные тяжбы, с которыми сталкивается компания. Авторы, программисты и другие создатели контента обвиняют OpenAI в использовании их произведений — таких как книги и код — без разрешения для разработки своих моделей ИИ. Хотя OpenAI защищается, ссылаясь на добросовестное использование, истцы утверждают, что закон США об авторском праве не предусматривает исключений для обучающих данных.

Исследование, проведенное в сотрудничестве между исследователями из Вашингтонского университета, Копенгагенского университета и Стэнфорда, представляет новую технику для обнаружения «запомненных» обучающих данных в моделях, доступных через API, таких как модели от OpenAI. Модели ИИ по сути обучаются на огромных объемах данных, чтобы распознавать шаблоны, что позволяет им создавать эссе, изображения и многое другое. Хотя большинство выходных данных не являются прямыми копиями обучающих данных, некоторые неизбежно оказываются таковыми из-за процесса обучения. Например, известно, что модели изображений воспроизводят скриншоты из фильмов, а языковые модели уличены в практически плагиате новостных статей.

Метод, описанный в исследовании, фокусируется на «высокоудивительных» словах — словах, которые необычны в данном контексте. Например, в предложении «Джек и я сидели совершенно неподвижно, пока радар гудел», слово «радар» будет высокоудивительным, поскольку оно менее ожидаемо, чем слова вроде «двигатель» или «радио» перед словом «гудел».

Исследователи протестировали несколько моделей OpenAI, включая GPT-4 и GPT-3.5, удаляя высокоудивительные слова из отрывков художественных книг и статей New York Times и прося модели предсказать эти пропущенные слова. Если модели точно угадывали слова, это указывало на то, что они запомнили текст во время обучения.

Абилаша Равичандер, докторант Вашингтонского университета и соавтор исследования, подчеркнула в беседе с TechCrunch, что эти результаты подчеркивают «спорные данные», которые могли быть использованы для обучения этих моделей. «Чтобы иметь большие языковые модели, которым можно доверять, нам нужны модели, которые мы можем исследовать, проверять и изучать научно», — заявила Равичандер. «Наша работа направлена на предоставление инструмента для исследования больших языковых моделей, но существует реальная потребность в большей прозрачности данных во всей экосистеме».

OpenAI настаивает на более мягких правилах использования данных, защищенных авторским правом, для разработки моделей ИИ. Хотя у компании есть некоторые соглашения о лицензировании контента и она предлагает варианты отказа для правообладателей, она лоббировала различные правительства, чтобы установить правила «добросовестного использования» специально для обучения ИИ.

OpenAI описывает экономику искусственного интеллекта с участием государственных инвестиционных фондов, налогами на роботов и четырехдневной рабочей неделей

В то время как правительства пытаются справиться с экономическими последствиями появления сверхинтеллектуальных машин, компания OpenAI опубликовала ряд предложений по формированию политики, в которых

OpenAI описывает экономику искусственного интеллекта с участием государственных инвестиционных фондов, налогами на роботов и четырехдневной рабочей неделей

В то время как правительства пытаются справиться с экономическими последствиями появления сверхинтеллектуальных машин, компания OpenAI опубликовала ряд предложений по формированию политики, в которых

Грег Брокман рассказывает, как Илон Маск покинул OpenAI

В конце августа 2017 года ключевые фигуры OpenAI — на тот момент небольшой некоммерческой исследовательской лаборатории — собрались, чтобы обсудить, как создать коммерческую структуру для продвижения

Грег Брокман рассказывает, как Илон Маск покинул OpenAI

В конце августа 2017 года ключевые фигуры OpenAI — на тот момент небольшой некоммерческой исследовательской лаборатории — собрались, чтобы обсудить, как создать коммерческую структуру для продвижения

Пентагон заключил соглашения с Nvidia, Microsoft и AWS о внедрении технологий искусственного интеллекта в секретные сети.

После предыдущих соглашений с Google, SpaceX и OpenAI, Министерство обороны США в пятницу объявило о подписании договоров с Nvidia, Microsoft, Amazon Web Services и Reflection AI о использовании их технологий и моделей искусственного интеллекта в сек

Пентагон заключил соглашения с Nvidia, Microsoft и AWS о внедрении технологий искусственного интеллекта в секретные сети.

После предыдущих соглашений с Google, SpaceX и OpenAI, Министерство обороны США в пятницу объявило о подписании договоров с Nvidia, Microsoft, Amazon Web Services и Reflection AI о использовании их технологий и моделей искусственного интеллекта в сек

这篇文章提到的版权问题确实让人担忧,以后AI生成的内容会不会都带着'侵权'的标签?想想就觉得挺讽刺的,毕竟这些模型训练数据不透明,普通用户根本不知道输出里夹带了什么'私货'。希望有更严格的管理办法吧。

This is wild! OpenAI might’ve gobbled up copyrighted stuff to train their models? I’m not shocked, but it’s kinda shady. Hope those authors and coders get some justice! 😤

This is wild! OpenAI might've trained their models on copyrighted stuff? 😳 I wonder how many books and code snippets got swept up in that data vacuum. Ethics in AI is such a messy topic right now.

Me sorprendió un poco que OpenAI podría haber usado material con derechos de autor para entrenar sus modelos. Es un poco decepcionante, pero supongo que es el salvaje oeste allá en el mundo de la IA. 🤔 ¿Quizás deberían ser más cuidadosos la próxima vez?

OpenAIが著作権付きの資料を使ってAIを訓練しているという研究は本当に驚きですね!クリエイターにとっては残念ですが、AIの訓練方法について知るのは面白いです。もっと透明性が必要かもしれませんね?🤔

Дом

Дом