調査:Openaiモデルは著作権で保護されたコンテンツを記憶しました

最近の研究によると、OpenAIがそのAIモデルの一部を訓練するために著作権のある素材を使用した可能性があることが示唆されており、 同社が直面している進行中の法廷闘争にさらなる火種を投じています。作家、プログラマー、その他のコンテンツクリエイターは、OpenAIがそのAIモデルを開発するために、 本やコードなどの彼らの作品を許可なく使用したと非難しています。OpenAIはフェアユースを主張して自らを弁護していますが、 原告側は米国著作権法には訓練データに対する例外規定がないと主張しています。

この研究は、ワシントン大学、コペンハーゲン大学、スタンフォード大学の研究者による共同研究であり、 OpenAIのようなAPIを通じてアクセスされるモデルで「記憶された」訓練データを検出する新しい技術を導入しています。 AIモデルは、膨大なデータからパターンを認識することを学び、エッセイや画像などを生成できるようになります。 ほとんどの出力は訓練データの直接のコピーではありませんが、学習プロセスのため、一部は必然的にそうなることがあります。 例えば、画像モデルは映画のスクリーンショットを再現することが知られており、言語モデルはニュース記事をほぼ剽窃していると指摘されています。

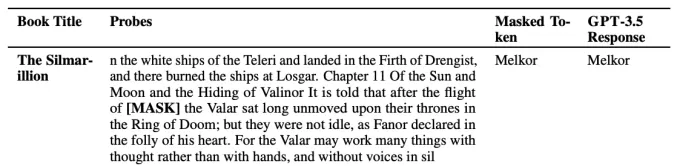

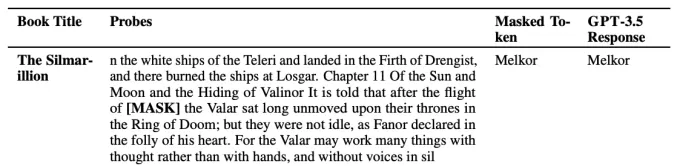

研究で説明されている手法は、「高サプライザル」な単語、つまり特定の文脈で異常な単語に焦点を当てています。 例えば、「ジャックと私はレーダーがブーンと鳴る中、完全に静かに座っていた」という文で、「レーダー」は「エンジン」や「ラジオ」などの単語が「ブーンと鳴る」に先行することが期待されるよりも予測しにくいため、高サプライザルな単語となります。

研究者たちは、GPT-4やGPT-3.5を含むいくつかのOpenAIモデルをテストしました。フィクションの本やニューヨーク・タイムズの記事から高サプライザルな単語を削除し、モデルにその欠落した単語を予測させました。モデルが正確に単語を推測した場合、それは訓練中にそのテキストを記憶していたことを示唆しています。

モデルが「高サプライザル」な単語を「推測」する例。画像クレジット:OpenAI 研究の結果、GPT-4がBookMIAデータセットの著作権付き電子書籍を含む人気のフィクション本の一部を記憶していた可能性が高いことが示されました。また、ニューヨーク・タイムズの記事もいくつか記憶していたようですが、その頻度は低かったです。

ワシントン大学の博士課程学生であり、研究の共著者であるアビラシャ・ラビチャンダー氏は、TechCrunchに対し、これらの発見がこれらのモデルを訓練するために使用された可能性のある「問題のあるデータ」を強調していると述べました。「信頼できる大規模言語モデルを持つためには、科学的かつ監査可能で調査可能なモデルが必要です」とラビチャンダー氏は述べました。「私たちの研究は大規模言語モデルを調査するツールを提供することを目指していますが、エコシステム全体でデータの透明性を高める必要が本当にあるのです。」

OpenAIは、AIモデルの開発に著作権のあるデータを使用するルールを緩和することを推進しています。同社は一部のコンテンツライセンス契約を持ち、著作権者にオプトアウトのオプションを提供していますが、AI訓練に特化した「フェアユース」のルールを確立するよう、さまざまな政府に働きかけています。

関連記事

非営利団体、AIエージェントを活用してチャリティ募金活動を強化

大手テック企業がAIの "エージェント "をビジネスの生産性向上剤として推進する一方で、ある非営利団体はAIが社会的利益に貢献する可能性を実証している。オープン・フィランソロピーが支援する慈善研究グループ、セージ・フューチャーは最近、AIモデルが慈善活動の資金調達にどのように協力できるかを示す革新的な実験を行った。この非営利団体は、OpenAIのGPT-4oとo1、AnthropicのClau

非営利団体、AIエージェントを活用してチャリティ募金活動を強化

大手テック企業がAIの "エージェント "をビジネスの生産性向上剤として推進する一方で、ある非営利団体はAIが社会的利益に貢献する可能性を実証している。オープン・フィランソロピーが支援する慈善研究グループ、セージ・フューチャーは最近、AIモデルが慈善活動の資金調達にどのように協力できるかを示す革新的な実験を行った。この非営利団体は、OpenAIのGPT-4oとo1、AnthropicのClau

トップAI研究所は、人類はAIシステムを理解する力を失いつつあると警告する

OpenAI、Google DeepMind、Anthropic、Metaの研究者は、前例のない団結を示し、競争上の相違を脇に置いて、責任あるAI開発について集団で警告を発した。これらの通常ライバル関係にある組織から40人以上の一流の科学者が、AIの意思決定プロセスの透明性を確保するための窓が急速に狭まっていることを強調する画期的な研究論文を共同執筆した。この共同研究は、現代のAIシステムにおける

トップAI研究所は、人類はAIシステムを理解する力を失いつつあると警告する

OpenAI、Google DeepMind、Anthropic、Metaの研究者は、前例のない団結を示し、競争上の相違を脇に置いて、責任あるAI開発について集団で警告を発した。これらの通常ライバル関係にある組織から40人以上の一流の科学者が、AIの意思決定プロセスの透明性を確保するための窓が急速に狭まっていることを強調する画期的な研究論文を共同執筆した。この共同研究は、現代のAIシステムにおける

ChatGPT、ファイルアクセスにGoogle DriveとDropboxの統合を追加

ChatGPTが企業向け新機能で生産性を向上OpenAIは、ChatGPTを包括的なビジネス生産性ツールに変える2つの強力な新機能を発表しました:自動会議文書化とシームレスなクラウドストレージ統合です。革命的な録音機能新しく導入された "記録モード "は、自動テープ起こしや分析を可能にします:重要なビジネス会議創造的なブレーンストーミングセッション 個人の思考プロセスこの

コメント (32)

0/200

ChatGPT、ファイルアクセスにGoogle DriveとDropboxの統合を追加

ChatGPTが企業向け新機能で生産性を向上OpenAIは、ChatGPTを包括的なビジネス生産性ツールに変える2つの強力な新機能を発表しました:自動会議文書化とシームレスなクラウドストレージ統合です。革命的な録音機能新しく導入された "記録モード "は、自動テープ起こしや分析を可能にします:重要なビジネス会議創造的なブレーンストーミングセッション 個人の思考プロセスこの

コメント (32)

0/200

![WilliamGonzalez]() WilliamGonzalez

WilliamGonzalez

2025年8月25日 18:01:06 JST

2025年8月25日 18:01:06 JST

This is wild! OpenAI might’ve gobbled up copyrighted stuff to train their models? I’m not shocked, but it’s kinda shady. Hope those authors and coders get some justice! 😤

0

0

![GregoryBaker]() GregoryBaker

GregoryBaker

2025年8月23日 20:01:18 JST

2025年8月23日 20:01:18 JST

This is wild! OpenAI might've trained their models on copyrighted stuff? 😳 I wonder how many books and code snippets got swept up in that data vacuum. Ethics in AI is such a messy topic right now.

0

0

![JohnGarcia]() JohnGarcia

JohnGarcia

2025年4月24日 0:10:14 JST

2025年4月24日 0:10:14 JST

Me sorprendió un poco que OpenAI podría haber usado material con derechos de autor para entrenar sus modelos. Es un poco decepcionante, pero supongo que es el salvaje oeste allá en el mundo de la IA. 🤔 ¿Quizás deberían ser más cuidadosos la próxima vez?

0

0

![TimothyMitchell]() TimothyMitchell

TimothyMitchell

2025年4月22日 9:12:42 JST

2025年4月22日 9:12:42 JST

OpenAIが著作権付きの資料を使ってAIを訓練しているという研究は本当に驚きですね!クリエイターにとっては残念ですが、AIの訓練方法について知るのは面白いです。もっと透明性が必要かもしれませんね?🤔

0

0

![WillLopez]() WillLopez

WillLopez

2025年4月21日 20:49:05 JST

2025年4月21日 20:49:05 JST

오픈AI가 저작권 있는 자료를 사용해 AI를 훈련했다는 연구는 정말 충격적이에요! 창작자들에게는 안타까운 일이지만, AI가 어떻게 훈련되는지 아는 건 흥미로워요. 오픈AI가 더 투명해져야 할까요? 🤔

0

0

![WillMitchell]() WillMitchell

WillMitchell

2025年4月21日 12:30:11 JST

2025年4月21日 12:30:11 JST

Este estudio sobre los modelos de OpenAI usando contenido con derechos de autor es bastante aterrador! 😱 Está genial que la IA se esté volviendo más inteligente, pero usar libros y códigos sin permiso no parece correcto. ¡Espero que lo resuelvan pronto! 🤞

0

0

最近の研究によると、OpenAIがそのAIモデルの一部を訓練するために著作権のある素材を使用した可能性があることが示唆されており、 同社が直面している進行中の法廷闘争にさらなる火種を投じています。作家、プログラマー、その他のコンテンツクリエイターは、OpenAIがそのAIモデルを開発するために、 本やコードなどの彼らの作品を許可なく使用したと非難しています。OpenAIはフェアユースを主張して自らを弁護していますが、 原告側は米国著作権法には訓練データに対する例外規定がないと主張しています。

この研究は、ワシントン大学、コペンハーゲン大学、スタンフォード大学の研究者による共同研究であり、 OpenAIのようなAPIを通じてアクセスされるモデルで「記憶された」訓練データを検出する新しい技術を導入しています。 AIモデルは、膨大なデータからパターンを認識することを学び、エッセイや画像などを生成できるようになります。 ほとんどの出力は訓練データの直接のコピーではありませんが、学習プロセスのため、一部は必然的にそうなることがあります。 例えば、画像モデルは映画のスクリーンショットを再現することが知られており、言語モデルはニュース記事をほぼ剽窃していると指摘されています。

研究で説明されている手法は、「高サプライザル」な単語、つまり特定の文脈で異常な単語に焦点を当てています。 例えば、「ジャックと私はレーダーがブーンと鳴る中、完全に静かに座っていた」という文で、「レーダー」は「エンジン」や「ラジオ」などの単語が「ブーンと鳴る」に先行することが期待されるよりも予測しにくいため、高サプライザルな単語となります。

研究者たちは、GPT-4やGPT-3.5を含むいくつかのOpenAIモデルをテストしました。フィクションの本やニューヨーク・タイムズの記事から高サプライザルな単語を削除し、モデルにその欠落した単語を予測させました。モデルが正確に単語を推測した場合、それは訓練中にそのテキストを記憶していたことを示唆しています。

ワシントン大学の博士課程学生であり、研究の共著者であるアビラシャ・ラビチャンダー氏は、TechCrunchに対し、これらの発見がこれらのモデルを訓練するために使用された可能性のある「問題のあるデータ」を強調していると述べました。「信頼できる大規模言語モデルを持つためには、科学的かつ監査可能で調査可能なモデルが必要です」とラビチャンダー氏は述べました。「私たちの研究は大規模言語モデルを調査するツールを提供することを目指していますが、エコシステム全体でデータの透明性を高める必要が本当にあるのです。」

OpenAIは、AIモデルの開発に著作権のあるデータを使用するルールを緩和することを推進しています。同社は一部のコンテンツライセンス契約を持ち、著作権者にオプトアウトのオプションを提供していますが、AI訓練に特化した「フェアユース」のルールを確立するよう、さまざまな政府に働きかけています。

非営利団体、AIエージェントを活用してチャリティ募金活動を強化

大手テック企業がAIの "エージェント "をビジネスの生産性向上剤として推進する一方で、ある非営利団体はAIが社会的利益に貢献する可能性を実証している。オープン・フィランソロピーが支援する慈善研究グループ、セージ・フューチャーは最近、AIモデルが慈善活動の資金調達にどのように協力できるかを示す革新的な実験を行った。この非営利団体は、OpenAIのGPT-4oとo1、AnthropicのClau

非営利団体、AIエージェントを活用してチャリティ募金活動を強化

大手テック企業がAIの "エージェント "をビジネスの生産性向上剤として推進する一方で、ある非営利団体はAIが社会的利益に貢献する可能性を実証している。オープン・フィランソロピーが支援する慈善研究グループ、セージ・フューチャーは最近、AIモデルが慈善活動の資金調達にどのように協力できるかを示す革新的な実験を行った。この非営利団体は、OpenAIのGPT-4oとo1、AnthropicのClau

トップAI研究所は、人類はAIシステムを理解する力を失いつつあると警告する

OpenAI、Google DeepMind、Anthropic、Metaの研究者は、前例のない団結を示し、競争上の相違を脇に置いて、責任あるAI開発について集団で警告を発した。これらの通常ライバル関係にある組織から40人以上の一流の科学者が、AIの意思決定プロセスの透明性を確保するための窓が急速に狭まっていることを強調する画期的な研究論文を共同執筆した。この共同研究は、現代のAIシステムにおける

トップAI研究所は、人類はAIシステムを理解する力を失いつつあると警告する

OpenAI、Google DeepMind、Anthropic、Metaの研究者は、前例のない団結を示し、競争上の相違を脇に置いて、責任あるAI開発について集団で警告を発した。これらの通常ライバル関係にある組織から40人以上の一流の科学者が、AIの意思決定プロセスの透明性を確保するための窓が急速に狭まっていることを強調する画期的な研究論文を共同執筆した。この共同研究は、現代のAIシステムにおける

ChatGPT、ファイルアクセスにGoogle DriveとDropboxの統合を追加

ChatGPTが企業向け新機能で生産性を向上OpenAIは、ChatGPTを包括的なビジネス生産性ツールに変える2つの強力な新機能を発表しました:自動会議文書化とシームレスなクラウドストレージ統合です。革命的な録音機能新しく導入された "記録モード "は、自動テープ起こしや分析を可能にします:重要なビジネス会議創造的なブレーンストーミングセッション 個人の思考プロセスこの

ChatGPT、ファイルアクセスにGoogle DriveとDropboxの統合を追加

ChatGPTが企業向け新機能で生産性を向上OpenAIは、ChatGPTを包括的なビジネス生産性ツールに変える2つの強力な新機能を発表しました:自動会議文書化とシームレスなクラウドストレージ統合です。革命的な録音機能新しく導入された "記録モード "は、自動テープ起こしや分析を可能にします:重要なビジネス会議創造的なブレーンストーミングセッション 個人の思考プロセスこの

2025年8月25日 18:01:06 JST

2025年8月25日 18:01:06 JST

This is wild! OpenAI might’ve gobbled up copyrighted stuff to train their models? I’m not shocked, but it’s kinda shady. Hope those authors and coders get some justice! 😤

0

0

2025年8月23日 20:01:18 JST

2025年8月23日 20:01:18 JST

This is wild! OpenAI might've trained their models on copyrighted stuff? 😳 I wonder how many books and code snippets got swept up in that data vacuum. Ethics in AI is such a messy topic right now.

0

0

2025年4月24日 0:10:14 JST

2025年4月24日 0:10:14 JST

Me sorprendió un poco que OpenAI podría haber usado material con derechos de autor para entrenar sus modelos. Es un poco decepcionante, pero supongo que es el salvaje oeste allá en el mundo de la IA. 🤔 ¿Quizás deberían ser más cuidadosos la próxima vez?

0

0

2025年4月22日 9:12:42 JST

2025年4月22日 9:12:42 JST

OpenAIが著作権付きの資料を使ってAIを訓練しているという研究は本当に驚きですね!クリエイターにとっては残念ですが、AIの訓練方法について知るのは面白いです。もっと透明性が必要かもしれませんね?🤔

0

0

2025年4月21日 20:49:05 JST

2025年4月21日 20:49:05 JST

오픈AI가 저작권 있는 자료를 사용해 AI를 훈련했다는 연구는 정말 충격적이에요! 창작자들에게는 안타까운 일이지만, AI가 어떻게 훈련되는지 아는 건 흥미로워요. 오픈AI가 더 투명해져야 할까요? 🤔

0

0

2025年4月21日 12:30:11 JST

2025年4月21日 12:30:11 JST

Este estudio sobre los modelos de OpenAI usando contenido con derechos de autor es bastante aterrador! 😱 Está genial que la IA se esté volviendo más inteligente, pero usar libros y códigos sin permiso no parece correcto. ¡Espero que lo resuelvan pronto! 🤞

0

0