OpenAI Dévoile Deux Modèles d'IA Open-Weight Avancés

OpenAI a révélé mardi la sortie de deux modèles de raisonnement IA open-weight, offrant des capacités comparables à sa série o. Les deux modèles sont disponibles en téléchargement gratuit sur Hugging Face, OpenAI les présentant comme "les plus performants" sur plusieurs benchmarks pour les modèles ouverts.

Les modèles sont proposés en deux variantes : le robuste gpt-oss-120b, utilisable sur un seul GPU Nvidia, et le léger gpt-oss-20b, conçu pour fonctionner sur un ordinateur portable standard avec 16 Go de mémoire.

Ce lancement marque le premier modèle de langage ouvert d'OpenAI depuis GPT-2, introduit il y a plus de cinq ans.

Lors d'un briefing, OpenAI a noté que ses modèles ouverts peuvent gérer des requêtes complexes en se connectant à des systèmes IA basés sur le cloud plus avancés, comme rapporté précédemment par TechCrunch. Cela permet aux développeurs de lier le modèle ouvert aux modèles propriétaires d'OpenAI pour des tâches comme le traitement d'images lorsque nécessaire.

Bien qu'OpenAI ait initialement adopté les modèles IA open-source, il est largement passé à un modèle de développement propriétaire, alimentant une activité florissante en fournissant un accès API aux entreprises et aux développeurs.

En janvier, le PDG Sam Altman a reconnu qu'OpenAI avait peut-être fait fausse route en ne privilégiant pas les technologies open-source. L'entreprise fait maintenant face à une forte concurrence de la part de laboratoires d'IA chinois comme DeepSeek, Alibaba’s Qwen, et Moonshot AI, qui ont gagné du terrain avec leurs modèles ouverts très performants. (Les modèles Llama de Meta, autrefois leaders dans l'espace de l'IA ouverte, ont pris du retard au cours de la dernière année.)

En juillet, l'administration Trump a encouragé les développeurs d'IA américains à ouvrir davantage de technologies pour promouvoir une IA alignée sur les valeurs américaines à l'échelle mondiale.

Les Leaders Technologiques et VC en Tête d'Affiche de Disrupt 2025

Netflix, ElevenLabs, Wayve, et Sequoia Capital figurent parmi les noms prestigieux de l'agenda de Disrupt 2025, partageant des idées pour stimuler le succès et l'innovation des startups. Ne manquez pas le 20e anniversaire de TechCrunch Disrupt pour avoir l'opportunité d'apprendre des plus grandes voix de la technologie — réservez votre billet maintenant et économisez jusqu'à 675 $ avant l'augmentation des prix le 7 août.

Les Leaders Technologiques et VC en Tête d'Affiche de Disrupt 2025

Netflix, ElevenLabs, Wayve, et Sequoia Capital figurent parmi les noms prestigieux de l'agenda de Disrupt 2025, partageant des idées pour stimuler le succès et l'innovation des startups. Ne manquez pas le 20e anniversaire de TechCrunch Disrupt pour avoir l'opportunité d'apprendre des plus grandes voix de la technologie — réservez votre billet maintenant et économisez jusqu'à 675 $ avant l'augmentation des prix.

San Francisco | 27-29 octobre 2025 INSCRIVEZ-VOUS MAINTENANTAvec gpt-oss, OpenAI vise à séduire les développeurs et à s'aligner sur l'élan de l'administration Trump, les deux ayant noté la montée des laboratoires d'IA chinois dans l'arène open-source.

« Depuis notre fondation en 2015, la mission d'OpenAI a été de faire progresser l'AGI au bénéfice de toute l'humanité », a déclaré le PDG Sam Altman dans un communiqué à TechCrunch. « Nous sommes ravis de voir le monde construire sur un cadre IA ouvert ancré dans les valeurs démocratiques américaines, librement accessible et largement bénéfique. »

(Photo par Tomohiro Ohsumi/Getty Images) Crédits image : Tomohiro Ohsumi / Getty Images Aperçu des Performances des Modèles

OpenAI a conçu son modèle ouvert pour dominer parmi les systèmes IA open-weight, et l'entreprise affirme avoir atteint cet objectif.

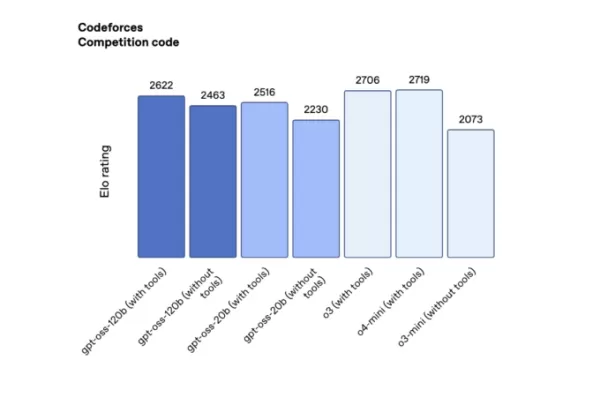

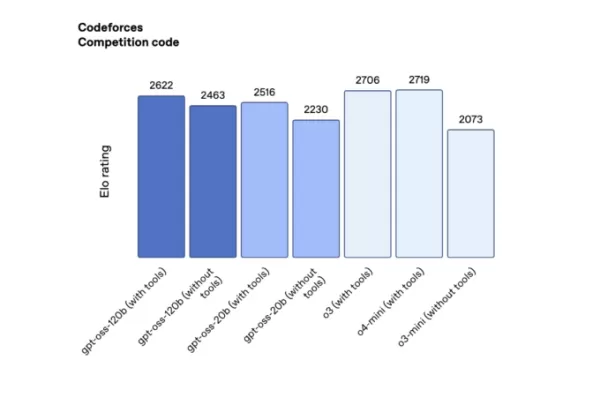

Dans des tests de codage compétitifs sur Codeforces (avec outils), gpt-oss-120b a obtenu un score de 2622 et gpt-oss-20b un score de 2516, surpassant le R1 de DeepSeek mais restant derrière o3 et o4-mini.

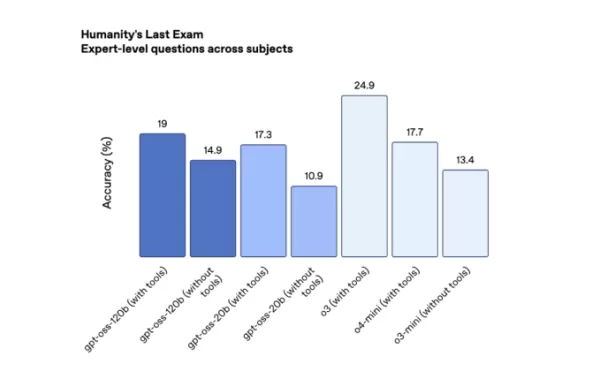

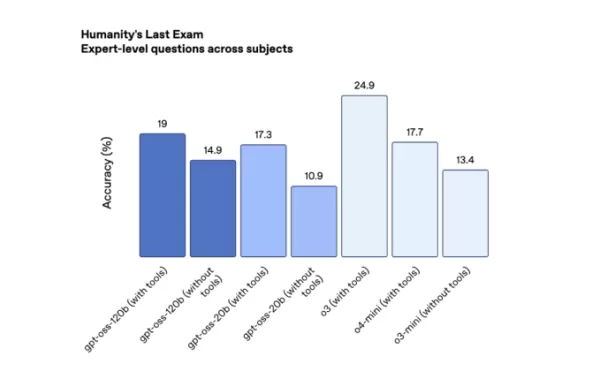

Performance du modèle ouvert d'OpenAI sur Codeforces (crédit : OpenAI). Sur l'Examen Final de l'Humanité, un test rigoureux crowdsourcé couvrant plusieurs sujets (avec outils), gpt-oss-120b et gpt-oss-20b ont atteint 19 % et 17,3 %, respectivement, surpassant les principaux modèles ouverts de DeepSeek et Qwen mais restant en deçà de o3.

Performance du modèle ouvert d'OpenAI sur HLE (crédit : OpenAI). Notamment, les modèles ouverts d'OpenAI présentent des taux d'hallucination significativement plus élevés que ses derniers modèles de raisonnement, o3 et o4-mini.

Les hallucinations sont devenues plus prononcées dans les récents modèles de raisonnement IA d'OpenAI, l'entreprise admettant qu'elle enquête encore sur la cause. Dans un livre blanc, OpenAI a noté que « les modèles plus petits, avec moins de connaissances du monde, sont attendus à halluciner davantage que les grands modèles de pointe. »

Sur PersonQA, le benchmark interne d'OpenAI pour évaluer la précision des modèles concernant les individus, gpt-oss-120b et gpt-oss-20b ont halluciné dans 49 % et 53 % des réponses, respectivement — plus du triple du taux du modèle o1 (16 %) et supérieur à o4-mini (36 %).

Entraînement des Nouveaux Modèles

OpenAI indique que ses modèles ouverts ont été développés en utilisant des techniques similaires à celles de ses modèles propriétaires. Chacun utilise une approche de mélange d'experts (MoE), activant moins de paramètres par requête pour une plus grande efficacité. Pour gpt-oss-120b, avec 117 milliards de paramètres au total, seuls 5,1 milliards sont utilisés par token.

Les modèles ouverts ont été entraînés avec un apprentissage par renforcement à haute capacité de calcul (RL), une méthode post-entraînement utilisant des clusters GPU Nvidia pour affiner la prise de décision IA dans des environnements simulés. Cela reflète l'entraînement de la série o d'OpenAI et inclut un processus de chaîne de pensée, nécessitant du temps et des ressources supplémentaires pour raisonner sur les réponses.

Cet entraînement permet aux modèles ouverts d'exceller dans l'alimentation d'agents IA, en supportant des outils comme la recherche web ou l'exécution de code Python dans leur processus de raisonnement. Cependant, ils sont limités aux tâches textuelles uniquement, incapables de traiter ou de générer des images ou de l'audio, contrairement aux autres modèles d'OpenAI.

Les modèles gpt-oss-120b et gpt-oss-20b sont publiés sous la licence Apache 2.0, permettant aux entreprises de les monétiser sans frais ni autorisation d'OpenAI.

Contrairement aux modèles entièrement open-source de laboratoires comme AI2, OpenAI ne divulguera pas les données d'entraînement de ses modèles ouverts, une décision probablement influencée par des procès en cours alléguant une utilisation inappropriée de matériel sous copyright dans l'entraînement IA.

OpenAI a reporté la sortie de ses modèles ouverts à plusieurs reprises pour répondre aux préoccupations de sécurité. Au-delà des protocoles de sécurité standard, l'entreprise a évalué si des acteurs malveillants pourraient affiner gpt-oss à des fins nuisibles, telles que des cyberattaques ou la création d'armes biologiques ou chimiques.

Les tests par OpenAI et des évaluateurs externes ont révélé que gpt-oss peut légèrement améliorer les capacités biologiques mais n'atteint pas le seuil de « haute capacité » de danger de l'entreprise, même après ajustement.

Bien que les modèles d'OpenAI dominent parmi les modèles ouverts, les développeurs attendent avec impatience la sortie du R2 de DeepSeek et d'un nouveau modèle ouvert du laboratoire de superintelligence de Meta.

Article connexe

Satya Nadella est prêt à tirer parti du nouvel accord avec OpenAI

Mercredi, un analyste de Wall Street a demandé directement au PDG de Microsoft, Satya Nadella, en quoi le nouveau partenariat avec OpenAI affecterait les résultats financiers de l’entreprise.Nadella a décrit ce nouvel accord comme une victoire pour

Satya Nadella est prêt à tirer parti du nouvel accord avec OpenAI

Mercredi, un analyste de Wall Street a demandé directement au PDG de Microsoft, Satya Nadella, en quoi le nouveau partenariat avec OpenAI affecterait les résultats financiers de l’entreprise.Nadella a décrit ce nouvel accord comme une victoire pour

OpenAI présente les grandes lignes d'une économie de l'IA fondée sur des fonds de richesse publique, une taxe sur les robots et la semaine de quatre jours

Alors que les gouvernements peinent à gérer l’impact économique des machines superintelligentes, OpenAI a publié une série de propositions politiques décrivant comment la richesse et le travail pourra

OpenAI présente les grandes lignes d'une économie de l'IA fondée sur des fonds de richesse publique, une taxe sur les robots et la semaine de quatre jours

Alors que les gouvernements peinent à gérer l’impact économique des machines superintelligentes, OpenAI a publié une série de propositions politiques décrivant comment la richesse et le travail pourra

Greg Brockman révèle comment Elon Musk a quitté OpenAI

Fin août 2017, les principaux dirigeants d’OpenAI — alors un petit laboratoire de recherche à but non lucratif — se sont réunis pour discuter de la manière dont ils allaient créer une entité à but luc

Recommandations de sujets spéciaux liés

commentaires (2)

Greg Brockman révèle comment Elon Musk a quitté OpenAI

Fin août 2017, les principaux dirigeants d’OpenAI — alors un petit laboratoire de recherche à but non lucratif — se sont réunis pour discuter de la manière dont ils allaient créer une entité à but luc

Recommandations de sujets spéciaux liés

commentaires (2)

![CharlesYoung]()

OpenAI qui met ses modèles en libre accès sur Hugging Face, c'est assez inattendu venant d'eux... À la fois je suis impressionné par la performance revendiquée, et légèrement inquiet de la concurrence déloyale que ça pourrait créer pour les petits joueurs. Mais bon, en tant que développeur, je vais certainement télécharger et tester ça tout de suite ! 😄

OpenAI a révélé mardi la sortie de deux modèles de raisonnement IA open-weight, offrant des capacités comparables à sa série o. Les deux modèles sont disponibles en téléchargement gratuit sur Hugging Face, OpenAI les présentant comme "les plus performants" sur plusieurs benchmarks pour les modèles ouverts.

Les modèles sont proposés en deux variantes : le robuste gpt-oss-120b, utilisable sur un seul GPU Nvidia, et le léger gpt-oss-20b, conçu pour fonctionner sur un ordinateur portable standard avec 16 Go de mémoire.

Ce lancement marque le premier modèle de langage ouvert d'OpenAI depuis GPT-2, introduit il y a plus de cinq ans.

Lors d'un briefing, OpenAI a noté que ses modèles ouverts peuvent gérer des requêtes complexes en se connectant à des systèmes IA basés sur le cloud plus avancés, comme rapporté précédemment par TechCrunch. Cela permet aux développeurs de lier le modèle ouvert aux modèles propriétaires d'OpenAI pour des tâches comme le traitement d'images lorsque nécessaire.

Bien qu'OpenAI ait initialement adopté les modèles IA open-source, il est largement passé à un modèle de développement propriétaire, alimentant une activité florissante en fournissant un accès API aux entreprises et aux développeurs.

En janvier, le PDG Sam Altman a reconnu qu'OpenAI avait peut-être fait fausse route en ne privilégiant pas les technologies open-source. L'entreprise fait maintenant face à une forte concurrence de la part de laboratoires d'IA chinois comme DeepSeek, Alibaba’s Qwen, et Moonshot AI, qui ont gagné du terrain avec leurs modèles ouverts très performants. (Les modèles Llama de Meta, autrefois leaders dans l'espace de l'IA ouverte, ont pris du retard au cours de la dernière année.)

En juillet, l'administration Trump a encouragé les développeurs d'IA américains à ouvrir davantage de technologies pour promouvoir une IA alignée sur les valeurs américaines à l'échelle mondiale.

Les Leaders Technologiques et VC en Tête d'Affiche de Disrupt 2025

Netflix, ElevenLabs, Wayve, et Sequoia Capital figurent parmi les noms prestigieux de l'agenda de Disrupt 2025, partageant des idées pour stimuler le succès et l'innovation des startups. Ne manquez pas le 20e anniversaire de TechCrunch Disrupt pour avoir l'opportunité d'apprendre des plus grandes voix de la technologie — réservez votre billet maintenant et économisez jusqu'à 675 $ avant l'augmentation des prix le 7 août.

Les Leaders Technologiques et VC en Tête d'Affiche de Disrupt 2025

Netflix, ElevenLabs, Wayve, et Sequoia Capital figurent parmi les noms prestigieux de l'agenda de Disrupt 2025, partageant des idées pour stimuler le succès et l'innovation des startups. Ne manquez pas le 20e anniversaire de TechCrunch Disrupt pour avoir l'opportunité d'apprendre des plus grandes voix de la technologie — réservez votre billet maintenant et économisez jusqu'à 675 $ avant l'augmentation des prix.

San Francisco | 27-29 octobre 2025 INSCRIVEZ-VOUS MAINTENANTAvec gpt-oss, OpenAI vise à séduire les développeurs et à s'aligner sur l'élan de l'administration Trump, les deux ayant noté la montée des laboratoires d'IA chinois dans l'arène open-source.

« Depuis notre fondation en 2015, la mission d'OpenAI a été de faire progresser l'AGI au bénéfice de toute l'humanité », a déclaré le PDG Sam Altman dans un communiqué à TechCrunch. « Nous sommes ravis de voir le monde construire sur un cadre IA ouvert ancré dans les valeurs démocratiques américaines, librement accessible et largement bénéfique. »

Aperçu des Performances des Modèles

OpenAI a conçu son modèle ouvert pour dominer parmi les systèmes IA open-weight, et l'entreprise affirme avoir atteint cet objectif.

Dans des tests de codage compétitifs sur Codeforces (avec outils), gpt-oss-120b a obtenu un score de 2622 et gpt-oss-20b un score de 2516, surpassant le R1 de DeepSeek mais restant derrière o3 et o4-mini.

Sur l'Examen Final de l'Humanité, un test rigoureux crowdsourcé couvrant plusieurs sujets (avec outils), gpt-oss-120b et gpt-oss-20b ont atteint 19 % et 17,3 %, respectivement, surpassant les principaux modèles ouverts de DeepSeek et Qwen mais restant en deçà de o3.

Notamment, les modèles ouverts d'OpenAI présentent des taux d'hallucination significativement plus élevés que ses derniers modèles de raisonnement, o3 et o4-mini.

Les hallucinations sont devenues plus prononcées dans les récents modèles de raisonnement IA d'OpenAI, l'entreprise admettant qu'elle enquête encore sur la cause. Dans un livre blanc, OpenAI a noté que « les modèles plus petits, avec moins de connaissances du monde, sont attendus à halluciner davantage que les grands modèles de pointe. »

Sur PersonQA, le benchmark interne d'OpenAI pour évaluer la précision des modèles concernant les individus, gpt-oss-120b et gpt-oss-20b ont halluciné dans 49 % et 53 % des réponses, respectivement — plus du triple du taux du modèle o1 (16 %) et supérieur à o4-mini (36 %).

Entraînement des Nouveaux Modèles

OpenAI indique que ses modèles ouverts ont été développés en utilisant des techniques similaires à celles de ses modèles propriétaires. Chacun utilise une approche de mélange d'experts (MoE), activant moins de paramètres par requête pour une plus grande efficacité. Pour gpt-oss-120b, avec 117 milliards de paramètres au total, seuls 5,1 milliards sont utilisés par token.

Les modèles ouverts ont été entraînés avec un apprentissage par renforcement à haute capacité de calcul (RL), une méthode post-entraînement utilisant des clusters GPU Nvidia pour affiner la prise de décision IA dans des environnements simulés. Cela reflète l'entraînement de la série o d'OpenAI et inclut un processus de chaîne de pensée, nécessitant du temps et des ressources supplémentaires pour raisonner sur les réponses.

Cet entraînement permet aux modèles ouverts d'exceller dans l'alimentation d'agents IA, en supportant des outils comme la recherche web ou l'exécution de code Python dans leur processus de raisonnement. Cependant, ils sont limités aux tâches textuelles uniquement, incapables de traiter ou de générer des images ou de l'audio, contrairement aux autres modèles d'OpenAI.

Les modèles gpt-oss-120b et gpt-oss-20b sont publiés sous la licence Apache 2.0, permettant aux entreprises de les monétiser sans frais ni autorisation d'OpenAI.

Contrairement aux modèles entièrement open-source de laboratoires comme AI2, OpenAI ne divulguera pas les données d'entraînement de ses modèles ouverts, une décision probablement influencée par des procès en cours alléguant une utilisation inappropriée de matériel sous copyright dans l'entraînement IA.

OpenAI a reporté la sortie de ses modèles ouverts à plusieurs reprises pour répondre aux préoccupations de sécurité. Au-delà des protocoles de sécurité standard, l'entreprise a évalué si des acteurs malveillants pourraient affiner gpt-oss à des fins nuisibles, telles que des cyberattaques ou la création d'armes biologiques ou chimiques.

Les tests par OpenAI et des évaluateurs externes ont révélé que gpt-oss peut légèrement améliorer les capacités biologiques mais n'atteint pas le seuil de « haute capacité » de danger de l'entreprise, même après ajustement.

Bien que les modèles d'OpenAI dominent parmi les modèles ouverts, les développeurs attendent avec impatience la sortie du R2 de DeepSeek et d'un nouveau modèle ouvert du laboratoire de superintelligence de Meta.

Satya Nadella est prêt à tirer parti du nouvel accord avec OpenAI

Mercredi, un analyste de Wall Street a demandé directement au PDG de Microsoft, Satya Nadella, en quoi le nouveau partenariat avec OpenAI affecterait les résultats financiers de l’entreprise.Nadella a décrit ce nouvel accord comme une victoire pour

Satya Nadella est prêt à tirer parti du nouvel accord avec OpenAI

Mercredi, un analyste de Wall Street a demandé directement au PDG de Microsoft, Satya Nadella, en quoi le nouveau partenariat avec OpenAI affecterait les résultats financiers de l’entreprise.Nadella a décrit ce nouvel accord comme une victoire pour

OpenAI présente les grandes lignes d'une économie de l'IA fondée sur des fonds de richesse publique, une taxe sur les robots et la semaine de quatre jours

Alors que les gouvernements peinent à gérer l’impact économique des machines superintelligentes, OpenAI a publié une série de propositions politiques décrivant comment la richesse et le travail pourra

OpenAI présente les grandes lignes d'une économie de l'IA fondée sur des fonds de richesse publique, une taxe sur les robots et la semaine de quatre jours

Alors que les gouvernements peinent à gérer l’impact économique des machines superintelligentes, OpenAI a publié une série de propositions politiques décrivant comment la richesse et le travail pourra

Greg Brockman révèle comment Elon Musk a quitté OpenAI

Fin août 2017, les principaux dirigeants d’OpenAI — alors un petit laboratoire de recherche à but non lucratif — se sont réunis pour discuter de la manière dont ils allaient créer une entité à but luc

Greg Brockman révèle comment Elon Musk a quitté OpenAI

Fin août 2017, les principaux dirigeants d’OpenAI — alors un petit laboratoire de recherche à but non lucratif — se sont réunis pour discuter de la manière dont ils allaient créer une entité à but luc

OpenAI qui met ses modèles en libre accès sur Hugging Face, c'est assez inattendu venant d'eux... À la fois je suis impressionné par la performance revendiquée, et légèrement inquiet de la concurrence déloyale que ça pourrait créer pour les petits joueurs. Mais bon, en tant que développeur, je vais certainement télécharger et tester ça tout de suite ! 😄

Maison

Maison