OpenAI Apresenta Dois Modelos Avançados de IA de Peso Aberto

A OpenAI anunciou na terça-feira o lançamento de dois modelos de raciocínio de IA de peso aberto, com capacidades comparáveis à sua série o. Ambos os modelos estão disponíveis para download gratuito no Hugging Face, com a OpenAI destacando-os como "de alto desempenho" em vários benchmarks para modelos abertos.

Os modelos são oferecidos em duas variantes: o robusto gpt-oss-120b, operável em uma única GPU Nvidia, e o leve gpt-oss-20b, projetado para rodar em um laptop padrão com 16GB de memória.

Este lançamento representa o primeiro modelo de linguagem aberto da OpenAI desde o GPT-2, introduzido há mais de cinco anos.

Durante uma coletiva, a OpenAI observou que seus modelos abertos podem lidar com consultas complexas conectando-se a sistemas de IA baseados em nuvem mais avançados, conforme relatado anteriormente pela TechCrunch. Isso permite que desenvolvedores conectem o modelo aberto aos modelos proprietários da OpenAI para tarefas como processamento de imagens, quando necessário.

Embora a OpenAI inicialmente tenha adotado modelos de IA de código aberto, ela migrou amplamente para um modelo de desenvolvimento proprietário, impulsionando um negócio próspero ao fornecer acesso à API para empresas e desenvolvedores.

Em janeiro, o CEO Sam Altman reconheceu que a OpenAI pode ter errado ao não priorizar tecnologias de código aberto. A empresa agora enfrenta forte concorrência de laboratórios de IA chineses como DeepSeek, Alibaba’s Qwen e Moonshot AI, que ganharam tração com seus modelos abertos altamente capazes. (Os modelos Llama da Meta, outrora líderes no espaço de IA aberta, ficaram para trás no último ano.)

Em julho, a Administração Trump incentivou desenvolvedores de IA dos EUA a abrir mais tecnologia para avançar a IA alinhada com os valores americanos globalmente.

Líderes de Tecnologia e VC em Destaque no Disrupt 2025

Netflix, ElevenLabs, Wayve e Sequoia Capital estão entre os nomes proeminentes na agenda do Disrupt 2025, compartilhando insights para impulsionar o sucesso e a inovação de startups. Não perca o 20º aniversário do TechCrunch Disrupt para aprender com as principais vozes da tecnologia — garanta seu ingresso agora e economize até $675 antes que os preços aumentem em 7 de agosto.

Líderes de Tecnologia e VC em Destaque no Disrupt 2025

Netflix, ElevenLabs, Wayve e Sequoia Capital estão entre os nomes proeminentes na agenda do Disrupt 2025, compartilhando insights para impulsionar o sucesso e a inovação de startups. Não perca o 20º aniversário do TechCrunch Disrupt para aprender com as principais vozes da tecnologia — garanta seu ingresso agora e economize até $675 antes que os preços aumentem.

San Francisco | 27-29 de outubro de 2025 REGISTRE-SE AGORACom o gpt-oss, a OpenAI pretende conquistar desenvolvedores e se alinhar com o incentivo da Administração Trump, já que ambos notaram a ascensão de laboratórios de IA chineses na arena de código aberto.

“Desde nossa fundação em 2015, a missão da OpenAI tem sido avançar a AGI em benefício de toda a humanidade,” disse o CEO Sam Altman em uma declaração à TechCrunch. “Estamos entusiasmados em ver o mundo construindo em um framework de IA aberto enraizado nos valores democráticos dos EUA, livremente acessível e amplamente benéfico.”

(Foto por Tomohiro Ohsumi/Getty Images) Créditos da Imagem: Tomohiro Ohsumi / Getty Images Visão Geral do Desempenho do Modelo

A OpenAI projetou seu modelo aberto para liderar entre os sistemas de IA de peso aberto, e a empresa afirma que alcançou esse objetivo.

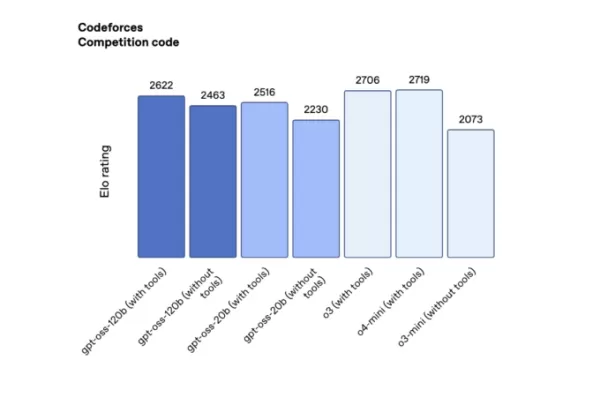

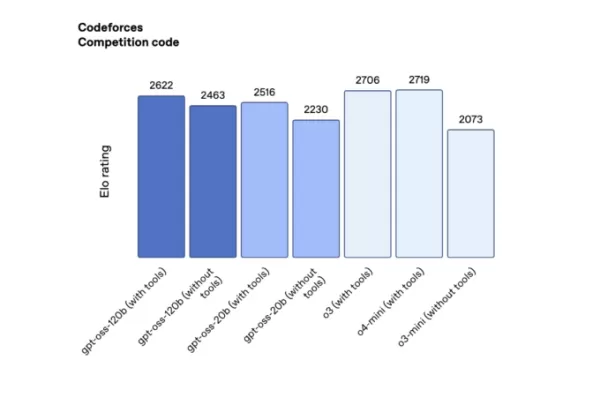

Em testes de codificação competitiva no Codeforces (com ferramentas), o gpt-oss-120b pontuou 2622 e o gpt-oss-20b pontuou 2516, superando o R1 da DeepSeek, mas ficando atrás do o3 e o4-mini.

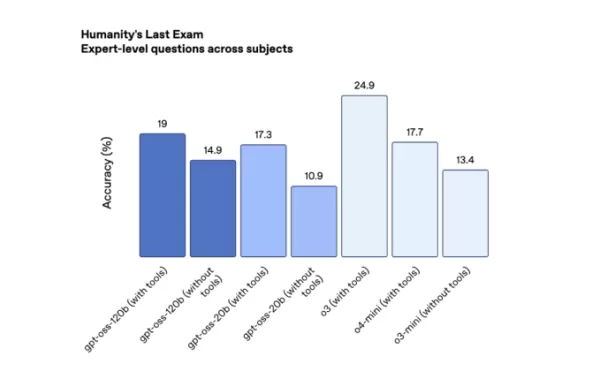

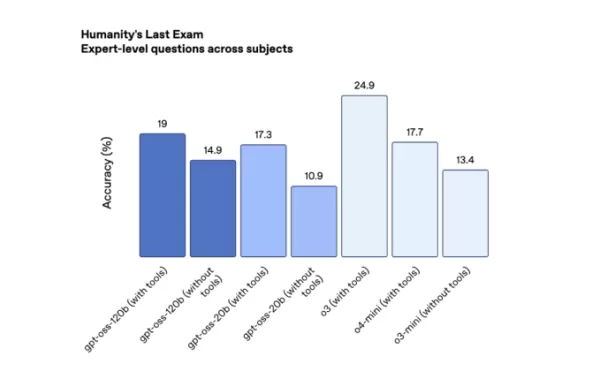

Desempenho do modelo aberto da OpenAI no Codeforces (crédito: OpenAI). No Último Exame da Humanidade, um teste rigoroso de crowdsourcing abrangendo várias disciplinas (com ferramentas), o gpt-oss-120b e o gpt-oss-20b alcançaram 19% e 17,3%, respectivamente, superando os principais modelos abertos da DeepSeek e Qwen, mas ficando aquém do o3.

Desempenho do modelo aberto da OpenAI no HLE (crédito: OpenAI). Notavelmente, os modelos abertos da OpenAI exibem taxas de alucinação significativamente mais altas do que seus modelos de raciocínio mais recentes, o3 e o4-mini.

As alucinações tornaram-se mais pronunciadas nos modelos de raciocínio de IA recentes da OpenAI, com a empresa admitindo que ainda está investigando a causa. Em um white paper, a OpenAI observou que “modelos menores, com menos conhecimento do mundo, são esperados para alucinar mais do que modelos de fronteira maiores.”

No PersonQA, benchmark interno da OpenAI para avaliar a precisão do modelo sobre indivíduos, o gpt-oss-120b e o gpt-oss-20b alucinaram em 49% e 53% das respostas, respectivamente — mais de três vezes a taxa do modelo o1 (16%) e maior que o o4-mini (36%).

Treinamento dos Novos Modelos

A OpenAI afirma que seus modelos abertos foram desenvolvidos usando técnicas semelhantes aos seus modelos proprietários. Cada um utiliza uma abordagem de mistura de especialistas (MoE), ativando menos parâmetros por consulta para maior eficiência. Para o gpt-oss-120b, com 117 bilhões de parâmetros totais, apenas 5,1 bilhões são usados por token.

Os modelos abertos foram treinados com aprendizado por reforço de alta computação (RL), um método de pós-treinamento usando clusters de GPU Nvidia para refinar a tomada de decisão de IA em configurações simuladas. Isso reflete o treinamento da série o da OpenAI e inclui um processo de cadeia de pensamento, exigindo tempo e recursos extras para raciocinar nas respostas.

Este treinamento permite que os modelos abertos se destaquem ao alimentar agentes de IA, suportando ferramentas como busca na web ou execução de código Python dentro de seu processo de raciocínio. No entanto, eles estão limitados a tarefas apenas de texto, incapazes de processar ou gerar imagens ou áudio, ao contrário de outros modelos da OpenAI.

Os modelos gpt-oss-120b e gpt-oss-20b são lançados sob a licença Apache 2.0, permitindo que empresas os monetizem sem taxas ou permissão da OpenAI.

Diferentemente dos modelos totalmente de código aberto de laboratórios como AI2, a OpenAI não divulgará os dados de treinamento de seus modelos abertos, uma decisão provavelmente influenciada por processos judiciais em curso que alegam uso indevido de material protegido por direitos autorais no treinamento de IA.

A OpenAI adiou o lançamento de seus modelos abertos várias vezes para abordar preocupações de segurança. Além dos protocolos de segurança padrão, a empresa avaliou se atores maliciosos poderiam ajustar o gpt-oss para fins prejudiciais, como ataques cibernéticos ou criação de armas biológicas ou químicas.

Testes da OpenAI e avaliadores externos descobriram que o gpt-oss pode aumentar ligeiramente as capacidades biológicas, mas não atinge o limiar de “alta capacidade” da empresa para perigo, mesmo após ajustes.

Embora os modelos da OpenAI liderem entre os modelos abertos, os desenvolvedores estão aguardando o lançamento do R2 da DeepSeek e um novo modelo aberto do laboratório de superinteligência da Meta.

Artigo relacionado

Satya Nadella está pronto para aproveitar o novo acordo com a OpenAI

Na quarta-feira, um analista da Wall Street perguntou diretamente ao CEO da Microsoft, Satya Nadella, como a nova parceria com a OpenAI afetaria os resultados financeiros da empresa.Nadella descreveu o novo acordo como uma vitória para todos. “Estam

Satya Nadella está pronto para aproveitar o novo acordo com a OpenAI

Na quarta-feira, um analista da Wall Street perguntou diretamente ao CEO da Microsoft, Satya Nadella, como a nova parceria com a OpenAI afetaria os resultados financeiros da empresa.Nadella descreveu o novo acordo como uma vitória para todos. “Estam

A OpenAI traça os contornos da economia da IA com fundos de riqueza pública, impostos sobre robôs e a semana de quatro dias

Enquanto os governos lutam para lidar com o impacto econômico das máquinas superinteligentes, a OpenAI divulgou um conjunto de propostas de políticas que delineiam como a riqueza e o trabalho poderiam

A OpenAI traça os contornos da economia da IA com fundos de riqueza pública, impostos sobre robôs e a semana de quatro dias

Enquanto os governos lutam para lidar com o impacto econômico das máquinas superinteligentes, a OpenAI divulgou um conjunto de propostas de políticas que delineiam como a riqueza e o trabalho poderiam

Greg Brockman revela como Elon Musk deixou a OpenAI

No final de agosto de 2017, figuras-chave da OpenAI — na época, um pequeno laboratório de pesquisa sem fins lucrativos — se reuniram para discutir como criariam uma entidade com fins lucrativos para c

Recomendações de tópicos especiais relacionados

Comentários (2)

Greg Brockman revela como Elon Musk deixou a OpenAI

No final de agosto de 2017, figuras-chave da OpenAI — na época, um pequeno laboratório de pesquisa sem fins lucrativos — se reuniram para discutir como criariam uma entidade com fins lucrativos para c

Recomendações de tópicos especiais relacionados

Comentários (2)

![CharlesYoung]()

OpenAI qui met ses modèles en libre accès sur Hugging Face, c'est assez inattendu venant d'eux... À la fois je suis impressionné par la performance revendiquée, et légèrement inquiet de la concurrence déloyale que ça pourrait créer pour les petits joueurs. Mais bon, en tant que développeur, je vais certainement télécharger et tester ça tout de suite ! 😄

A OpenAI anunciou na terça-feira o lançamento de dois modelos de raciocínio de IA de peso aberto, com capacidades comparáveis à sua série o. Ambos os modelos estão disponíveis para download gratuito no Hugging Face, com a OpenAI destacando-os como "de alto desempenho" em vários benchmarks para modelos abertos.

Os modelos são oferecidos em duas variantes: o robusto gpt-oss-120b, operável em uma única GPU Nvidia, e o leve gpt-oss-20b, projetado para rodar em um laptop padrão com 16GB de memória.

Este lançamento representa o primeiro modelo de linguagem aberto da OpenAI desde o GPT-2, introduzido há mais de cinco anos.

Durante uma coletiva, a OpenAI observou que seus modelos abertos podem lidar com consultas complexas conectando-se a sistemas de IA baseados em nuvem mais avançados, conforme relatado anteriormente pela TechCrunch. Isso permite que desenvolvedores conectem o modelo aberto aos modelos proprietários da OpenAI para tarefas como processamento de imagens, quando necessário.

Embora a OpenAI inicialmente tenha adotado modelos de IA de código aberto, ela migrou amplamente para um modelo de desenvolvimento proprietário, impulsionando um negócio próspero ao fornecer acesso à API para empresas e desenvolvedores.

Em janeiro, o CEO Sam Altman reconheceu que a OpenAI pode ter errado ao não priorizar tecnologias de código aberto. A empresa agora enfrenta forte concorrência de laboratórios de IA chineses como DeepSeek, Alibaba’s Qwen e Moonshot AI, que ganharam tração com seus modelos abertos altamente capazes. (Os modelos Llama da Meta, outrora líderes no espaço de IA aberta, ficaram para trás no último ano.)

Em julho, a Administração Trump incentivou desenvolvedores de IA dos EUA a abrir mais tecnologia para avançar a IA alinhada com os valores americanos globalmente.

Líderes de Tecnologia e VC em Destaque no Disrupt 2025

Netflix, ElevenLabs, Wayve e Sequoia Capital estão entre os nomes proeminentes na agenda do Disrupt 2025, compartilhando insights para impulsionar o sucesso e a inovação de startups. Não perca o 20º aniversário do TechCrunch Disrupt para aprender com as principais vozes da tecnologia — garanta seu ingresso agora e economize até $675 antes que os preços aumentem em 7 de agosto.

Líderes de Tecnologia e VC em Destaque no Disrupt 2025

Netflix, ElevenLabs, Wayve e Sequoia Capital estão entre os nomes proeminentes na agenda do Disrupt 2025, compartilhando insights para impulsionar o sucesso e a inovação de startups. Não perca o 20º aniversário do TechCrunch Disrupt para aprender com as principais vozes da tecnologia — garanta seu ingresso agora e economize até $675 antes que os preços aumentem.

San Francisco | 27-29 de outubro de 2025 REGISTRE-SE AGORACom o gpt-oss, a OpenAI pretende conquistar desenvolvedores e se alinhar com o incentivo da Administração Trump, já que ambos notaram a ascensão de laboratórios de IA chineses na arena de código aberto.

“Desde nossa fundação em 2015, a missão da OpenAI tem sido avançar a AGI em benefício de toda a humanidade,” disse o CEO Sam Altman em uma declaração à TechCrunch. “Estamos entusiasmados em ver o mundo construindo em um framework de IA aberto enraizado nos valores democráticos dos EUA, livremente acessível e amplamente benéfico.”

Visão Geral do Desempenho do Modelo

A OpenAI projetou seu modelo aberto para liderar entre os sistemas de IA de peso aberto, e a empresa afirma que alcançou esse objetivo.

Em testes de codificação competitiva no Codeforces (com ferramentas), o gpt-oss-120b pontuou 2622 e o gpt-oss-20b pontuou 2516, superando o R1 da DeepSeek, mas ficando atrás do o3 e o4-mini.

No Último Exame da Humanidade, um teste rigoroso de crowdsourcing abrangendo várias disciplinas (com ferramentas), o gpt-oss-120b e o gpt-oss-20b alcançaram 19% e 17,3%, respectivamente, superando os principais modelos abertos da DeepSeek e Qwen, mas ficando aquém do o3.

Notavelmente, os modelos abertos da OpenAI exibem taxas de alucinação significativamente mais altas do que seus modelos de raciocínio mais recentes, o3 e o4-mini.

As alucinações tornaram-se mais pronunciadas nos modelos de raciocínio de IA recentes da OpenAI, com a empresa admitindo que ainda está investigando a causa. Em um white paper, a OpenAI observou que “modelos menores, com menos conhecimento do mundo, são esperados para alucinar mais do que modelos de fronteira maiores.”

No PersonQA, benchmark interno da OpenAI para avaliar a precisão do modelo sobre indivíduos, o gpt-oss-120b e o gpt-oss-20b alucinaram em 49% e 53% das respostas, respectivamente — mais de três vezes a taxa do modelo o1 (16%) e maior que o o4-mini (36%).

Treinamento dos Novos Modelos

A OpenAI afirma que seus modelos abertos foram desenvolvidos usando técnicas semelhantes aos seus modelos proprietários. Cada um utiliza uma abordagem de mistura de especialistas (MoE), ativando menos parâmetros por consulta para maior eficiência. Para o gpt-oss-120b, com 117 bilhões de parâmetros totais, apenas 5,1 bilhões são usados por token.

Os modelos abertos foram treinados com aprendizado por reforço de alta computação (RL), um método de pós-treinamento usando clusters de GPU Nvidia para refinar a tomada de decisão de IA em configurações simuladas. Isso reflete o treinamento da série o da OpenAI e inclui um processo de cadeia de pensamento, exigindo tempo e recursos extras para raciocinar nas respostas.

Este treinamento permite que os modelos abertos se destaquem ao alimentar agentes de IA, suportando ferramentas como busca na web ou execução de código Python dentro de seu processo de raciocínio. No entanto, eles estão limitados a tarefas apenas de texto, incapazes de processar ou gerar imagens ou áudio, ao contrário de outros modelos da OpenAI.

Os modelos gpt-oss-120b e gpt-oss-20b são lançados sob a licença Apache 2.0, permitindo que empresas os monetizem sem taxas ou permissão da OpenAI.

Diferentemente dos modelos totalmente de código aberto de laboratórios como AI2, a OpenAI não divulgará os dados de treinamento de seus modelos abertos, uma decisão provavelmente influenciada por processos judiciais em curso que alegam uso indevido de material protegido por direitos autorais no treinamento de IA.

A OpenAI adiou o lançamento de seus modelos abertos várias vezes para abordar preocupações de segurança. Além dos protocolos de segurança padrão, a empresa avaliou se atores maliciosos poderiam ajustar o gpt-oss para fins prejudiciais, como ataques cibernéticos ou criação de armas biológicas ou químicas.

Testes da OpenAI e avaliadores externos descobriram que o gpt-oss pode aumentar ligeiramente as capacidades biológicas, mas não atinge o limiar de “alta capacidade” da empresa para perigo, mesmo após ajustes.

Embora os modelos da OpenAI liderem entre os modelos abertos, os desenvolvedores estão aguardando o lançamento do R2 da DeepSeek e um novo modelo aberto do laboratório de superinteligência da Meta.

Satya Nadella está pronto para aproveitar o novo acordo com a OpenAI

Na quarta-feira, um analista da Wall Street perguntou diretamente ao CEO da Microsoft, Satya Nadella, como a nova parceria com a OpenAI afetaria os resultados financeiros da empresa.Nadella descreveu o novo acordo como uma vitória para todos. “Estam

Satya Nadella está pronto para aproveitar o novo acordo com a OpenAI

Na quarta-feira, um analista da Wall Street perguntou diretamente ao CEO da Microsoft, Satya Nadella, como a nova parceria com a OpenAI afetaria os resultados financeiros da empresa.Nadella descreveu o novo acordo como uma vitória para todos. “Estam

A OpenAI traça os contornos da economia da IA com fundos de riqueza pública, impostos sobre robôs e a semana de quatro dias

Enquanto os governos lutam para lidar com o impacto econômico das máquinas superinteligentes, a OpenAI divulgou um conjunto de propostas de políticas que delineiam como a riqueza e o trabalho poderiam

A OpenAI traça os contornos da economia da IA com fundos de riqueza pública, impostos sobre robôs e a semana de quatro dias

Enquanto os governos lutam para lidar com o impacto econômico das máquinas superinteligentes, a OpenAI divulgou um conjunto de propostas de políticas que delineiam como a riqueza e o trabalho poderiam

Greg Brockman revela como Elon Musk deixou a OpenAI

No final de agosto de 2017, figuras-chave da OpenAI — na época, um pequeno laboratório de pesquisa sem fins lucrativos — se reuniram para discutir como criariam uma entidade com fins lucrativos para c

Greg Brockman revela como Elon Musk deixou a OpenAI

No final de agosto de 2017, figuras-chave da OpenAI — na época, um pequeno laboratório de pesquisa sem fins lucrativos — se reuniram para discutir como criariam uma entidade com fins lucrativos para c

OpenAI qui met ses modèles en libre accès sur Hugging Face, c'est assez inattendu venant d'eux... À la fois je suis impressionné par la performance revendiquée, et légèrement inquiet de la concurrence déloyale que ça pourrait créer pour les petits joueurs. Mais bon, en tant que développeur, je vais certainement télécharger et tester ça tout de suite ! 😄

Lar

Lar