“更少的是:检索更少的文档如何增强AI响应”

检索增强生成(RAG)是一种构建AI系统的创新方法,结合语言模型与外部知识源,以提高准确性并减少事实错误。本质上,AI会搜索与用户查询相关的文档,并利用这些信息生成更精确的回答。这种方法因其能让大型语言模型(LLMs)基于真实数据,减少幻觉风险而获得认可。

你可能认为给AI提供更多文档会导致更明智的回答。然而,来自耶路撒冷希伯来大学的一项最新研究表明情况并非如此:在向AI提供信息时,少即是多。

更少文档,更好回答

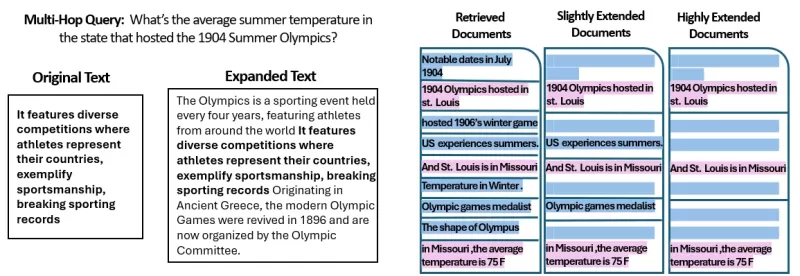

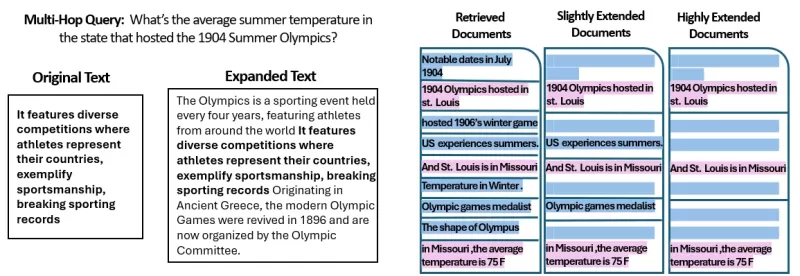

该研究深入探讨了提供给RAG系统的文档数量如何影响其性能。研究人员保持总文本长度一致,将文档数量从20份减少到2-4份相关文档,并扩展这些文档以匹配原始文本量。这使他们能够孤立地研究文档数量对性能的影响。

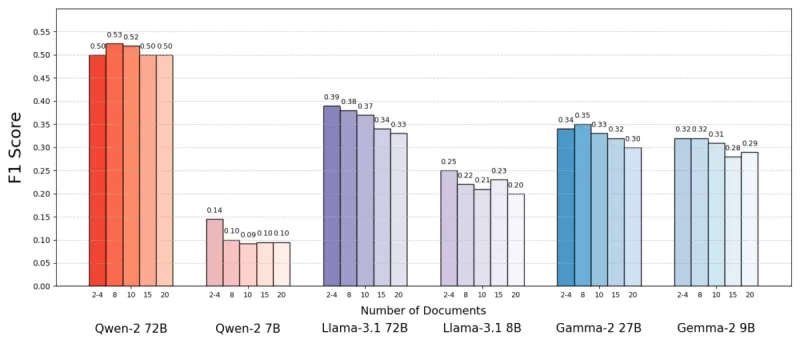

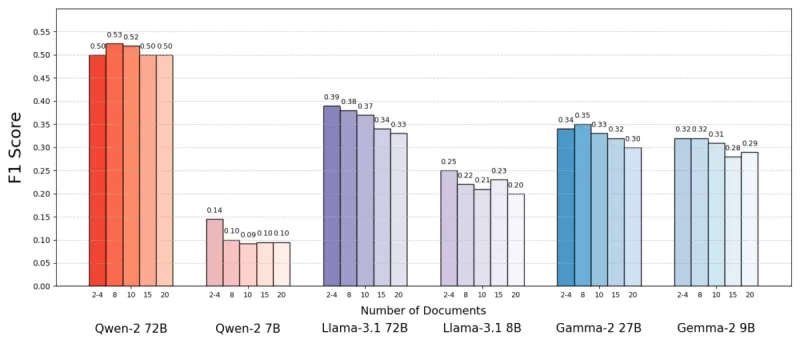

使用MuSiQue数据集(包含与维基百科段落配对的琐事问题),他们发现AI模型在使用更少文档时通常表现更好。当系统专注于少数关键文档而非广泛的文档集合时,准确性提高了高达10%(以F1分数衡量)。这一趋势在多种开源语言模型(如Meta的Llama)中都成立,Qwen-2是例外,其在多文档情况下仍保持性能。

来源:Levy等人

来源:Levy等人

这一令人惊讶的结果挑战了普遍认为更多信息总是有帮助的观念。即使文本量相同,多份文档的存在似乎使AI任务复杂化,引入的噪声多于信号。

为什么在RAG中少即是多

当我们考虑AI模型如何处理信息时,“少即是多”的原则就显得合理。使用更少、更相关的文档,AI可以专注于关键语境而不会分心,就像学生专注于最相关的学习材料一样。

研究中,当模型仅获得与答案直接相关的文档时,表现更好,因为这种更清晰、专注的语境使提取正确信息变得更容易。相反,当AI需要筛选大量文档时,常常因相关与无关内容的混合而挣扎。相似但无关的文档可能误导模型,增加幻觉风险。

有趣的是,研究发现AI更容易忽略明显无关的文档,而对那些微妙偏离主题的文档更感困惑。这表明现实的干扰文档比随机文档更具迷惑性。通过将文档限制在必要范围内,我们降低了设置此类陷阱的可能性。

此外,使用更少文档降低了计算开销,使系统更高效且成本效益更高。这种方法不仅提高了准确性,还提升了RAG系统的整体性能。

来源:Levy等人

来源:Levy等人

重新思考RAG:未来方向

这些发现对依赖外部知识的未来AI系统设计具有重大意义。它表明,专注于检索文档的质量和相关性,而非数量,可能提升性能。研究作者提倡平衡相关性和多样性的检索方法,确保全面覆盖而不让模型被无关文本淹没。

未来研究可能探索更好的检索系统或重新排序器,以识别真正有价值的文档,并改进语言模型处理多源信息的方式。增强模型本身,如Qwen-2的表现,可能为使其对多样化输入更稳健提供见解。

随着AI系统开发更大的语境窗口,处理更多文本的能力变得不如确保文本相关和精选重要。题为“更多文档,相同长度”的研究强调了专注于最相关信息以提高AI准确性和效率的重要性。

总之,这项研究挑战了我们对AI系统数据输入的假设。通过仔细选择更少、更好的文档,我们可以创建更智能、更精简的RAG系统,提供更准确、更可信的回答。

相关文章

Manus 推出 "广泛研究 "人工智能工具,100 多个代理可进行网络搜索

中国人工智能创新企业 Manus 曾因其面向消费者和专业用户的开创性多代理编排平台而备受关注,如今它又推出了一项突破性的技术应用,对传统的人工智能研究方法提出了挑战。重新思考人工智能驱动的研究OpenAI、谷歌和 xAI 等竞争对手开发了专门的 "深度研究"(Deep Research)代理,能够进行长达数小时的调查并生成详细的报告,与之不同的是,Manus 通过其新的 "广度研究"(Wide R

Manus 推出 "广泛研究 "人工智能工具,100 多个代理可进行网络搜索

中国人工智能创新企业 Manus 曾因其面向消费者和专业用户的开创性多代理编排平台而备受关注,如今它又推出了一项突破性的技术应用,对传统的人工智能研究方法提出了挑战。重新思考人工智能驱动的研究OpenAI、谷歌和 xAI 等竞争对手开发了专门的 "深度研究"(Deep Research)代理,能够进行长达数小时的调查并生成详细的报告,与之不同的是,Manus 通过其新的 "广度研究"(Wide R

法学硕士为何无视指示以及如何有效解决这一问题

了解大型语言模型跳过指令的原因大型语言模型(LLM)改变了我们与人工智能的交互方式,使从对话界面到自动内容生成和编程辅助等各种高级应用成为可能。然而,用户经常会遇到一个令人沮丧的限制:这些模型偶尔会忽略特定指令,尤其是在复杂或冗长的提示中。这种任务执行不完整的问题不仅会影响输出质量,还会降低用户对这些系统的信心。研究这种行为背后的根本原因,可以为优化 LLM 交互提供有价值的见解。LLM 处

法学硕士为何无视指示以及如何有效解决这一问题

了解大型语言模型跳过指令的原因大型语言模型(LLM)改变了我们与人工智能的交互方式,使从对话界面到自动内容生成和编程辅助等各种高级应用成为可能。然而,用户经常会遇到一个令人沮丧的限制:这些模型偶尔会忽略特定指令,尤其是在复杂或冗长的提示中。这种任务执行不完整的问题不仅会影响输出质量,还会降低用户对这些系统的信心。研究这种行为背后的根本原因,可以为优化 LLM 交互提供有价值的见解。LLM 处

经过法律诉讼,Pebble 重新获得了原品牌名称

鹅卵石的回归名称与一切Pebble 的爱好者们可以欢呼雀跃了--这个备受喜爱的智能手表品牌不仅卷土重来,还夺回了自己的标志性名称。"Core Devices 公司首席执行官 Eric Migicovsky 在公司博客更新中透露:"我们已经成功地重新获得了 Pebble 商标,其顺利程度着实让我感到惊讶。这意味着之前发布的 Core 2 Duo 现在将正式命名为 Pebble 2 Duo,而 Cor

评论 (47)

0/200

经过法律诉讼,Pebble 重新获得了原品牌名称

鹅卵石的回归名称与一切Pebble 的爱好者们可以欢呼雀跃了--这个备受喜爱的智能手表品牌不仅卷土重来,还夺回了自己的标志性名称。"Core Devices 公司首席执行官 Eric Migicovsky 在公司博客更新中透露:"我们已经成功地重新获得了 Pebble 商标,其顺利程度着实让我感到惊讶。这意味着之前发布的 Core 2 Duo 现在将正式命名为 Pebble 2 Duo,而 Cor

评论 (47)

0/200

![LarryWilliams]() LarryWilliams

LarryWilliams

2025-09-10 08:30:32

2025-09-10 08:30:32

La RAG est révolutionnaire, mais je me demande si limiter les documents récupérés pourrait parfois manquer des infos cruciales 🤔. Perso, j'opterais pour un juste milieu entre précision et exhaustivité !

0

0

![BruceBrown]() BruceBrown

BruceBrown

2025-07-29 20:25:16

2025-07-29 20:25:16

This article on RAG is super intriguing! Fewer documents leading to better AI responses? Mind blown 🤯. Makes me wonder how this could streamline chatbots for customer service. Anyone tried this yet?

0

0

![JasonMartin]() JasonMartin

JasonMartin

2025-04-26 14:04:32

2025-04-26 14:04:32

Adoro como essa ferramenta torna as respostas do AI mais precisas usando menos documentos. É como mágica! Mas às vezes parece que está faltando alguma informação. Ainda assim, uma ótima ferramenta para respostas rápidas e confiáveis. 👍

0

0

![JuanMoore]() JuanMoore

JuanMoore

2025-04-24 06:29:07

2025-04-24 06:29:07

I love how this tool makes AI responses more accurate by using fewer documents. It's like magic! But sometimes it feels like it's missing out on some info. Still, a great tool for quick, reliable answers. 👍

0

0

![GregoryJones]() GregoryJones

GregoryJones

2025-04-23 00:50:26

2025-04-23 00:50:26

「少ない方が良い」というAIの応答方法はかなりクール!少ないドキュメントから正確な答えを得るなんて、登録したいですね!魔法のようですが、もっと早く動いてほしいです。でも、AI技術の前進の一歩としては素晴らしいですね!🚀

0

0

![BrianMartinez]() BrianMartinez

BrianMartinez

2025-04-21 19:14:10

2025-04-21 19:14:10

This app really simplifies things! By retrieving fewer but more relevant documents, the AI responses are much more accurate and to the point. It's like having a smart assistant that knows exactly what you need. Only wish it was a bit faster. Still, a great tool! 😊

0

0

检索增强生成(RAG)是一种构建AI系统的创新方法,结合语言模型与外部知识源,以提高准确性并减少事实错误。本质上,AI会搜索与用户查询相关的文档,并利用这些信息生成更精确的回答。这种方法因其能让大型语言模型(LLMs)基于真实数据,减少幻觉风险而获得认可。

你可能认为给AI提供更多文档会导致更明智的回答。然而,来自耶路撒冷希伯来大学的一项最新研究表明情况并非如此:在向AI提供信息时,少即是多。

更少文档,更好回答

该研究深入探讨了提供给RAG系统的文档数量如何影响其性能。研究人员保持总文本长度一致,将文档数量从20份减少到2-4份相关文档,并扩展这些文档以匹配原始文本量。这使他们能够孤立地研究文档数量对性能的影响。

使用MuSiQue数据集(包含与维基百科段落配对的琐事问题),他们发现AI模型在使用更少文档时通常表现更好。当系统专注于少数关键文档而非广泛的文档集合时,准确性提高了高达10%(以F1分数衡量)。这一趋势在多种开源语言模型(如Meta的Llama)中都成立,Qwen-2是例外,其在多文档情况下仍保持性能。

来源:Levy等人

来源:Levy等人

这一令人惊讶的结果挑战了普遍认为更多信息总是有帮助的观念。即使文本量相同,多份文档的存在似乎使AI任务复杂化,引入的噪声多于信号。

为什么在RAG中少即是多

当我们考虑AI模型如何处理信息时,“少即是多”的原则就显得合理。使用更少、更相关的文档,AI可以专注于关键语境而不会分心,就像学生专注于最相关的学习材料一样。

研究中,当模型仅获得与答案直接相关的文档时,表现更好,因为这种更清晰、专注的语境使提取正确信息变得更容易。相反,当AI需要筛选大量文档时,常常因相关与无关内容的混合而挣扎。相似但无关的文档可能误导模型,增加幻觉风险。

有趣的是,研究发现AI更容易忽略明显无关的文档,而对那些微妙偏离主题的文档更感困惑。这表明现实的干扰文档比随机文档更具迷惑性。通过将文档限制在必要范围内,我们降低了设置此类陷阱的可能性。

此外,使用更少文档降低了计算开销,使系统更高效且成本效益更高。这种方法不仅提高了准确性,还提升了RAG系统的整体性能。

来源:Levy等人

来源:Levy等人

重新思考RAG:未来方向

这些发现对依赖外部知识的未来AI系统设计具有重大意义。它表明,专注于检索文档的质量和相关性,而非数量,可能提升性能。研究作者提倡平衡相关性和多样性的检索方法,确保全面覆盖而不让模型被无关文本淹没。

未来研究可能探索更好的检索系统或重新排序器,以识别真正有价值的文档,并改进语言模型处理多源信息的方式。增强模型本身,如Qwen-2的表现,可能为使其对多样化输入更稳健提供见解。

随着AI系统开发更大的语境窗口,处理更多文本的能力变得不如确保文本相关和精选重要。题为“更多文档,相同长度”的研究强调了专注于最相关信息以提高AI准确性和效率的重要性。

总之,这项研究挑战了我们对AI系统数据输入的假设。通过仔细选择更少、更好的文档,我们可以创建更智能、更精简的RAG系统,提供更准确、更可信的回答。

Manus 推出 "广泛研究 "人工智能工具,100 多个代理可进行网络搜索

中国人工智能创新企业 Manus 曾因其面向消费者和专业用户的开创性多代理编排平台而备受关注,如今它又推出了一项突破性的技术应用,对传统的人工智能研究方法提出了挑战。重新思考人工智能驱动的研究OpenAI、谷歌和 xAI 等竞争对手开发了专门的 "深度研究"(Deep Research)代理,能够进行长达数小时的调查并生成详细的报告,与之不同的是,Manus 通过其新的 "广度研究"(Wide R

Manus 推出 "广泛研究 "人工智能工具,100 多个代理可进行网络搜索

中国人工智能创新企业 Manus 曾因其面向消费者和专业用户的开创性多代理编排平台而备受关注,如今它又推出了一项突破性的技术应用,对传统的人工智能研究方法提出了挑战。重新思考人工智能驱动的研究OpenAI、谷歌和 xAI 等竞争对手开发了专门的 "深度研究"(Deep Research)代理,能够进行长达数小时的调查并生成详细的报告,与之不同的是,Manus 通过其新的 "广度研究"(Wide R

法学硕士为何无视指示以及如何有效解决这一问题

了解大型语言模型跳过指令的原因大型语言模型(LLM)改变了我们与人工智能的交互方式,使从对话界面到自动内容生成和编程辅助等各种高级应用成为可能。然而,用户经常会遇到一个令人沮丧的限制:这些模型偶尔会忽略特定指令,尤其是在复杂或冗长的提示中。这种任务执行不完整的问题不仅会影响输出质量,还会降低用户对这些系统的信心。研究这种行为背后的根本原因,可以为优化 LLM 交互提供有价值的见解。LLM 处

法学硕士为何无视指示以及如何有效解决这一问题

了解大型语言模型跳过指令的原因大型语言模型(LLM)改变了我们与人工智能的交互方式,使从对话界面到自动内容生成和编程辅助等各种高级应用成为可能。然而,用户经常会遇到一个令人沮丧的限制:这些模型偶尔会忽略特定指令,尤其是在复杂或冗长的提示中。这种任务执行不完整的问题不仅会影响输出质量,还会降低用户对这些系统的信心。研究这种行为背后的根本原因,可以为优化 LLM 交互提供有价值的见解。LLM 处

经过法律诉讼,Pebble 重新获得了原品牌名称

鹅卵石的回归名称与一切Pebble 的爱好者们可以欢呼雀跃了--这个备受喜爱的智能手表品牌不仅卷土重来,还夺回了自己的标志性名称。"Core Devices 公司首席执行官 Eric Migicovsky 在公司博客更新中透露:"我们已经成功地重新获得了 Pebble 商标,其顺利程度着实让我感到惊讶。这意味着之前发布的 Core 2 Duo 现在将正式命名为 Pebble 2 Duo,而 Cor

经过法律诉讼,Pebble 重新获得了原品牌名称

鹅卵石的回归名称与一切Pebble 的爱好者们可以欢呼雀跃了--这个备受喜爱的智能手表品牌不仅卷土重来,还夺回了自己的标志性名称。"Core Devices 公司首席执行官 Eric Migicovsky 在公司博客更新中透露:"我们已经成功地重新获得了 Pebble 商标,其顺利程度着实让我感到惊讶。这意味着之前发布的 Core 2 Duo 现在将正式命名为 Pebble 2 Duo,而 Cor

2025-09-10 08:30:32

2025-09-10 08:30:32

La RAG est révolutionnaire, mais je me demande si limiter les documents récupérés pourrait parfois manquer des infos cruciales 🤔. Perso, j'opterais pour un juste milieu entre précision et exhaustivité !

0

0

2025-07-29 20:25:16

2025-07-29 20:25:16

This article on RAG is super intriguing! Fewer documents leading to better AI responses? Mind blown 🤯. Makes me wonder how this could streamline chatbots for customer service. Anyone tried this yet?

0

0

2025-04-26 14:04:32

2025-04-26 14:04:32

Adoro como essa ferramenta torna as respostas do AI mais precisas usando menos documentos. É como mágica! Mas às vezes parece que está faltando alguma informação. Ainda assim, uma ótima ferramenta para respostas rápidas e confiáveis. 👍

0

0

2025-04-24 06:29:07

2025-04-24 06:29:07

I love how this tool makes AI responses more accurate by using fewer documents. It's like magic! But sometimes it feels like it's missing out on some info. Still, a great tool for quick, reliable answers. 👍

0

0

2025-04-23 00:50:26

2025-04-23 00:50:26

「少ない方が良い」というAIの応答方法はかなりクール!少ないドキュメントから正確な答えを得るなんて、登録したいですね!魔法のようですが、もっと早く動いてほしいです。でも、AI技術の前進の一歩としては素晴らしいですね!🚀

0

0

2025-04-21 19:14:10

2025-04-21 19:14:10

This app really simplifies things! By retrieving fewer but more relevant documents, the AI responses are much more accurate and to the point. It's like having a smart assistant that knows exactly what you need. Only wish it was a bit faster. Still, a great tool! 😊

0

0