Licenças de IA abertas: revelando restrições ocultas

Esta semana, o Google revelou o Gemma 3, uma família de modelos de IA abertos que foram elogiados por sua eficiência. No entanto, desenvolvedores no X expressaram frustração com a licença do Gemma 3, que apresenta riscos significativos para aplicações comerciais. Esse problema não é exclusivo do Gemma 3; empresas como a Meta também impõem termos de licenciamento personalizados e não padronizados em seus modelos abertos, criando obstáculos legais para negócios. Empresas menores, em particular, estão preocupadas que o Google e empresas similares possam subitamente impor cláusulas mais rigorosas, interrompendo suas operações.

Nick Vidal, chefe de comunidade na Open Source Initiative, destacou o problema ao TechCrunch, afirmando: "O licenciamento restritivo e inconsistente dos chamados modelos de IA 'abertos' está criando uma incerteza significativa, especialmente para adoção comercial. Embora esses modelos sejam comercializados como abertos, os termos reais impõem vários obstáculos legais e práticos que desencorajam as empresas de integrá-los em seus produtos ou serviços."

Desenvolvedores de modelos abertos frequentemente optam por licenças proprietárias em vez de padrões como Apache e MIT por razões específicas. Por exemplo, a startup de IA Cohere deixou claro que apoia trabalhos científicos, mas não comerciais, em seus modelos. No entanto, as licenças do Gemma e do Llama da Meta incluem restrições que limitam como as empresas podem usá-los sem riscos legais.

A licença do Llama 3 da Meta, por exemplo, proíbe desenvolvedores de usar a saída do modelo para melhorar qualquer modelo além do Llama 3 ou seus derivados. Ela também impede empresas com mais de 700 milhões de usuários ativos mensais de implantar modelos Llama sem uma licença especial. A licença do Gemma, embora menos restritiva, permite que o Google restrinja o uso se acreditar que há uma violação de sua política de uso proibido ou de leis aplicáveis.

Esses termos se estendem a modelos derivados do Llama ou Gemma, incluindo aqueles treinados com dados sintéticos gerados pelo Gemma. Florian Brand, pesquisador de IA na Universidade de Trier, argumenta que tais licenças "não podem ser razoavelmente chamadas de 'código aberto'". Ele disse ao TechCrunch: "A maioria das empresas tem um conjunto de licenças aprovadas, como a Apache 2.0, então qualquer licença personalizada representa muito trabalho e custo. Empresas pequenas sem equipes jurídicas ou dinheiro para advogados optarão por modelos com licenças padrão."

Brand também observou que, embora empresas como o Google ainda não tenham aplicado esses termos de forma agressiva, a mera ameaça pode desencorajar a adoção. "Essas restrições têm um impacto no ecossistema de IA — até mesmo em pesquisadores de IA como eu", disse ele.

Han-Chung Lee, diretor de aprendizado de máquina na Moody's, e Eric Tramel, cientista aplicado sênior na startup de IA Gretel, concordam que licenças personalizadas como as do Gemma e do Llama tornam os modelos "inutilizáveis" em muitos cenários comerciais. Tramel levantou preocupações sobre o potencial de "retomadas" e a confusão sobre o licenciamento de derivados de modelos. Ele alertou que os modelos poderiam ser usados como um "cavalo de Troia" para obter insights sobre casos de negócios bem-sucedidos e, em seguida, usar ações legais para entrar nesses mercados.

Apesar de suas licenças restritivas, alguns modelos como o Llama tiveram uma adoção generalizada, sendo baixados milhões de vezes e integrados em produtos por grandes corporações como o Spotify. No entanto, Yacine Jernite, chefe de aprendizado de máquina e sociedade na startup de IA Hugging Face, acredita que eles poderiam ser ainda mais bem-sucedidos com licenças permissivas. Ele instou provedores como o Google a adotar estruturas de licenças abertas e colaborar mais diretamente com os usuários em termos amplamente aceitos.

Jernite observou: "Dada a falta de consenso sobre esses termos e o fato de que muitas das suposições subjacentes ainda não foram testadas em tribunais, tudo isso serve principalmente como uma declaração de intenções desses atores. Se certas cláusulas forem interpretadas de forma muito ampla, muito trabalho valioso ficará em terreno legal incerto, o que é particularmente assustador para organizações que constroem produtos comerciais bem-sucedidos."

Vidal enfatizou a necessidade de modelos de IA que possam ser livremente integrados, modificados e compartilhados sem o medo de mudanças repentinas de licença ou ambiguidade legal. Ele afirmou: "O cenário atual de licenciamento de modelos de IA está repleto de confusão, termos restritivos e alegações enganosas de abertura. Em vez de redefinir 'aberto' para atender aos interesses corporativos, a indústria de IA deve se alinhar com os princípios estabelecidos de código aberto para criar um ecossistema verdadeiramente aberto."

Artigo relacionado

O DeepL, conhecido pela tradução de textos, agora se volta para a tradução de voz

A DeepL, empresa de tradução mais conhecida por suas ferramentas baseadas em texto, lançou hoje um pacote de tradução de voz para voz voltado para cenários como reuniões, conversas em dispositivos móv

O DeepL, conhecido pela tradução de textos, agora se volta para a tradução de voz

A DeepL, empresa de tradução mais conhecida por suas ferramentas baseadas em texto, lançou hoje um pacote de tradução de voz para voz voltado para cenários como reuniões, conversas em dispositivos móv

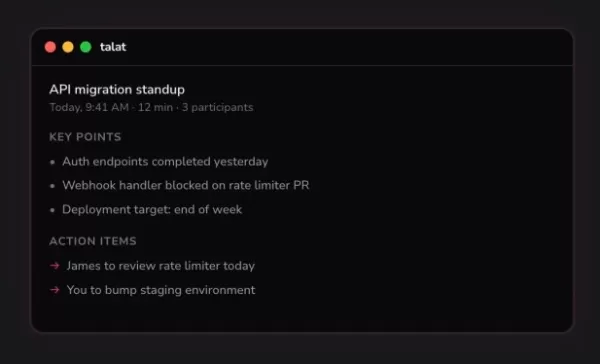

As anotações de reuniões da IA da Talat ficam armazenadas no seu dispositivo, e não na nuvem

O Granola, aplicativo de anotações com inteligência artificial avaliado em US$ 250 milhões, vem ganhando força entre fundadores de empresas de tecnologia e investidores de capital de risco. Mas um des

As anotações de reuniões da IA da Talat ficam armazenadas no seu dispositivo, e não na nuvem

O Granola, aplicativo de anotações com inteligência artificial avaliado em US$ 250 milhões, vem ganhando força entre fundadores de empresas de tecnologia e investidores de capital de risco. Mas um des

O novo Roewe i6 chega ao mercado por 659.000 yuans, equipado com o Snapdragon 8155 e o modelo de grande escala Doubao

A SAIC Roewe lançou hoje o novo Roewe i6, um sedã compacto que adota integralmente a linguagem visual do Roewe D7. Sua distinta grade frontal grande e vertical e a barra de luzes horizontal se estende

Recomendações de tópicos especiais relacionados

Comentários (52)

O novo Roewe i6 chega ao mercado por 659.000 yuans, equipado com o Snapdragon 8155 e o modelo de grande escala Doubao

A SAIC Roewe lançou hoje o novo Roewe i6, um sedã compacto que adota integralmente a linguagem visual do Roewe D7. Sua distinta grade frontal grande e vertical e a barra de luzes horizontal se estende

Recomendações de tópicos especiais relacionados

Comentários (52)

![DanielJohnson]()

Diese Diskussion über „Open AI“ Lizenzen ist wichtiger, als viele denken. Meta hat mit Llama auch schon solche überraschenden Klauseln reingepackt. Für kleine Firmen, die auf sowas setzen, ist das echt ein Minenfeld. Man denkt, man nutzt frei verfügbare Technologie, und plötzlich lauert die nächste Rechnung oder Rechtsstreit. Da ist die Euphorie über neue Modelle schnell verflogen. Die Branche braucht hier echt mehr Transparenz und faire Spielregeln für alle, nicht nur für die Tech-Giganten. 🤔

![WillGarcía]()

これって…結局は『Open』じゃないんだね 😅 ライセンス条項の細かい所を読むと、商用利用が結構厽しめに制限されているみたい。技術的には素晴らしいと思うけど、こういう伏兵みたいな規約が増えてくると、結局自分でモデルを作った方が安上がりなんじゃないか、って思っちゃうな。

![WalterWalker]()

Gemma 3のライセンス条件をざっと見たけど、やっぱり大企業の「オープン」戦略って本当の意味でのオープンソース精神からは程遠いよね。結局は彼らのエコシステムに縛り付けるための仕組みじゃないかと疑いたくなるわ… 🤨 開発者はいつもリスクトレードオフを迫られる立場で、なんだか気の毒だな。

![WillieRodriguez]()

Gemma 3 heißt plötzlich 'open', aber die Lizenz liest sich wie eine Knebelklausel. 🤔 Komischerweise wird das Risiko für kommerzielle Anwendungen erst auffällig, wenn Entwickler drauf stoßen. Meta ist auch nicht besser. Diese großen Tech-Firmen schaffen eine eigene Art von 'Open Source' – mit unsichtbaren Zäunen. Irgendwann merkt man: frei ist nur der Code, nicht die Nutzung. Gibt's überhaupt noch echte Alternativen?

![RichardJackson]()

あれ?オープンAIモデルのはずなのに商用制限が結構あるんだ。GoogleのGemma 3もMetaも結局は自社の利益を守りたいだけ?企業向けに使うなら、ライセンス条項をしっかり確認しないと危険かも…🤔

Esta semana, o Google revelou o Gemma 3, uma família de modelos de IA abertos que foram elogiados por sua eficiência. No entanto, desenvolvedores no X expressaram frustração com a licença do Gemma 3, que apresenta riscos significativos para aplicações comerciais. Esse problema não é exclusivo do Gemma 3; empresas como a Meta também impõem termos de licenciamento personalizados e não padronizados em seus modelos abertos, criando obstáculos legais para negócios. Empresas menores, em particular, estão preocupadas que o Google e empresas similares possam subitamente impor cláusulas mais rigorosas, interrompendo suas operações.

Nick Vidal, chefe de comunidade na Open Source Initiative, destacou o problema ao TechCrunch, afirmando: "O licenciamento restritivo e inconsistente dos chamados modelos de IA 'abertos' está criando uma incerteza significativa, especialmente para adoção comercial. Embora esses modelos sejam comercializados como abertos, os termos reais impõem vários obstáculos legais e práticos que desencorajam as empresas de integrá-los em seus produtos ou serviços."

Desenvolvedores de modelos abertos frequentemente optam por licenças proprietárias em vez de padrões como Apache e MIT por razões específicas. Por exemplo, a startup de IA Cohere deixou claro que apoia trabalhos científicos, mas não comerciais, em seus modelos. No entanto, as licenças do Gemma e do Llama da Meta incluem restrições que limitam como as empresas podem usá-los sem riscos legais.

A licença do Llama 3 da Meta, por exemplo, proíbe desenvolvedores de usar a saída do modelo para melhorar qualquer modelo além do Llama 3 ou seus derivados. Ela também impede empresas com mais de 700 milhões de usuários ativos mensais de implantar modelos Llama sem uma licença especial. A licença do Gemma, embora menos restritiva, permite que o Google restrinja o uso se acreditar que há uma violação de sua política de uso proibido ou de leis aplicáveis.

Esses termos se estendem a modelos derivados do Llama ou Gemma, incluindo aqueles treinados com dados sintéticos gerados pelo Gemma. Florian Brand, pesquisador de IA na Universidade de Trier, argumenta que tais licenças "não podem ser razoavelmente chamadas de 'código aberto'". Ele disse ao TechCrunch: "A maioria das empresas tem um conjunto de licenças aprovadas, como a Apache 2.0, então qualquer licença personalizada representa muito trabalho e custo. Empresas pequenas sem equipes jurídicas ou dinheiro para advogados optarão por modelos com licenças padrão."

Brand também observou que, embora empresas como o Google ainda não tenham aplicado esses termos de forma agressiva, a mera ameaça pode desencorajar a adoção. "Essas restrições têm um impacto no ecossistema de IA — até mesmo em pesquisadores de IA como eu", disse ele.

Han-Chung Lee, diretor de aprendizado de máquina na Moody's, e Eric Tramel, cientista aplicado sênior na startup de IA Gretel, concordam que licenças personalizadas como as do Gemma e do Llama tornam os modelos "inutilizáveis" em muitos cenários comerciais. Tramel levantou preocupações sobre o potencial de "retomadas" e a confusão sobre o licenciamento de derivados de modelos. Ele alertou que os modelos poderiam ser usados como um "cavalo de Troia" para obter insights sobre casos de negócios bem-sucedidos e, em seguida, usar ações legais para entrar nesses mercados.

Apesar de suas licenças restritivas, alguns modelos como o Llama tiveram uma adoção generalizada, sendo baixados milhões de vezes e integrados em produtos por grandes corporações como o Spotify. No entanto, Yacine Jernite, chefe de aprendizado de máquina e sociedade na startup de IA Hugging Face, acredita que eles poderiam ser ainda mais bem-sucedidos com licenças permissivas. Ele instou provedores como o Google a adotar estruturas de licenças abertas e colaborar mais diretamente com os usuários em termos amplamente aceitos.

Jernite observou: "Dada a falta de consenso sobre esses termos e o fato de que muitas das suposições subjacentes ainda não foram testadas em tribunais, tudo isso serve principalmente como uma declaração de intenções desses atores. Se certas cláusulas forem interpretadas de forma muito ampla, muito trabalho valioso ficará em terreno legal incerto, o que é particularmente assustador para organizações que constroem produtos comerciais bem-sucedidos."

Vidal enfatizou a necessidade de modelos de IA que possam ser livremente integrados, modificados e compartilhados sem o medo de mudanças repentinas de licença ou ambiguidade legal. Ele afirmou: "O cenário atual de licenciamento de modelos de IA está repleto de confusão, termos restritivos e alegações enganosas de abertura. Em vez de redefinir 'aberto' para atender aos interesses corporativos, a indústria de IA deve se alinhar com os princípios estabelecidos de código aberto para criar um ecossistema verdadeiramente aberto."

O DeepL, conhecido pela tradução de textos, agora se volta para a tradução de voz

A DeepL, empresa de tradução mais conhecida por suas ferramentas baseadas em texto, lançou hoje um pacote de tradução de voz para voz voltado para cenários como reuniões, conversas em dispositivos móv

O DeepL, conhecido pela tradução de textos, agora se volta para a tradução de voz

A DeepL, empresa de tradução mais conhecida por suas ferramentas baseadas em texto, lançou hoje um pacote de tradução de voz para voz voltado para cenários como reuniões, conversas em dispositivos móv

As anotações de reuniões da IA da Talat ficam armazenadas no seu dispositivo, e não na nuvem

O Granola, aplicativo de anotações com inteligência artificial avaliado em US$ 250 milhões, vem ganhando força entre fundadores de empresas de tecnologia e investidores de capital de risco. Mas um des

As anotações de reuniões da IA da Talat ficam armazenadas no seu dispositivo, e não na nuvem

O Granola, aplicativo de anotações com inteligência artificial avaliado em US$ 250 milhões, vem ganhando força entre fundadores de empresas de tecnologia e investidores de capital de risco. Mas um des

O novo Roewe i6 chega ao mercado por 659.000 yuans, equipado com o Snapdragon 8155 e o modelo de grande escala Doubao

A SAIC Roewe lançou hoje o novo Roewe i6, um sedã compacto que adota integralmente a linguagem visual do Roewe D7. Sua distinta grade frontal grande e vertical e a barra de luzes horizontal se estende

O novo Roewe i6 chega ao mercado por 659.000 yuans, equipado com o Snapdragon 8155 e o modelo de grande escala Doubao

A SAIC Roewe lançou hoje o novo Roewe i6, um sedã compacto que adota integralmente a linguagem visual do Roewe D7. Sua distinta grade frontal grande e vertical e a barra de luzes horizontal se estende

Diese Diskussion über „Open AI“ Lizenzen ist wichtiger, als viele denken. Meta hat mit Llama auch schon solche überraschenden Klauseln reingepackt. Für kleine Firmen, die auf sowas setzen, ist das echt ein Minenfeld. Man denkt, man nutzt frei verfügbare Technologie, und plötzlich lauert die nächste Rechnung oder Rechtsstreit. Da ist die Euphorie über neue Modelle schnell verflogen. Die Branche braucht hier echt mehr Transparenz und faire Spielregeln für alle, nicht nur für die Tech-Giganten. 🤔

これって…結局は『Open』じゃないんだね 😅 ライセンス条項の細かい所を読むと、商用利用が結構厽しめに制限されているみたい。技術的には素晴らしいと思うけど、こういう伏兵みたいな規約が増えてくると、結局自分でモデルを作った方が安上がりなんじゃないか、って思っちゃうな。

Gemma 3のライセンス条件をざっと見たけど、やっぱり大企業の「オープン」戦略って本当の意味でのオープンソース精神からは程遠いよね。結局は彼らのエコシステムに縛り付けるための仕組みじゃないかと疑いたくなるわ… 🤨 開発者はいつもリスクトレードオフを迫られる立場で、なんだか気の毒だな。

Gemma 3 heißt plötzlich 'open', aber die Lizenz liest sich wie eine Knebelklausel. 🤔 Komischerweise wird das Risiko für kommerzielle Anwendungen erst auffällig, wenn Entwickler drauf stoßen. Meta ist auch nicht besser. Diese großen Tech-Firmen schaffen eine eigene Art von 'Open Source' – mit unsichtbaren Zäunen. Irgendwann merkt man: frei ist nur der Code, nicht die Nutzung. Gibt's überhaupt noch echte Alternativen?

あれ?オープンAIモデルのはずなのに商用制限が結構あるんだ。GoogleのGemma 3もMetaも結局は自社の利益を守りたいだけ?企業向けに使うなら、ライセンス条項をしっかり確認しないと危険かも…🤔

Lar

Lar