Google, 로봇용 온디바이스 Gemini AI 모델 출시

Google DeepMind, 오프라인 로봇 제어를 위한 Gemini Robotics On-Device 공개

Google DeepMind가 로봇 분야에서 흥미로운 업데이트를 발표했습니다—Gemini Robotics On-Device, 인터넷 연결 없이 작업을 수행할 수 있는 새로운 언어 모델입니다. 이는 이전 Gemini Robotics 모델(3월 출시)을 기반으로 하지만 핵심 업그레이드: 로컬 처리를 제공합니다.

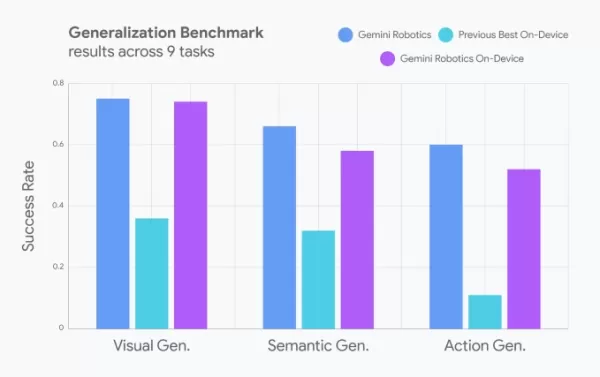

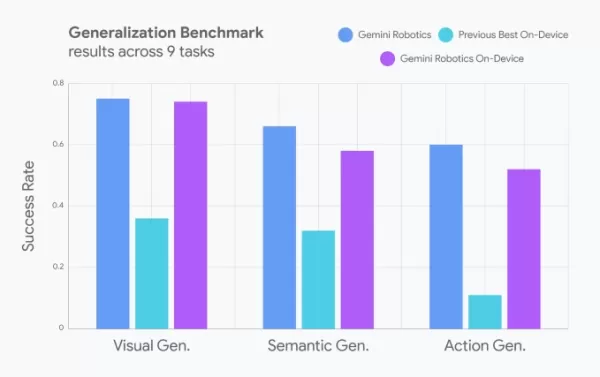

개발자는 이제 자연어 프롬프트를 사용해 로봇 움직임을 미세 조정할 수 있어 다양한 작업에 로봇을 쉽게 적응시킬 수 있습니다. Google은 이 모델의 성능이 클라우드 기반 모델과 거의 동등하며 다른 온디바이스 모델을 능가한다고 주장했습니다(구체적으로 어떤 모델인지는 밝히지 않았습니다).

이미지 제공: Google 실세계 로봇 기술: 세탁부터 조립 라인까지

데모에서 이 모델을 실행하는 로봇은 다음을 성공적으로 수행했습니다:

- 가방 지퍼 열기

- 옷 접기

- 새로운 객체에 적응 (예: 산업용 벨트에서 부품 조립)

원래 ALOHA 로봇용으로 훈련된 이 모델은 이후 다음에 맞게 조정되었습니다:

- Franka FR3 (양팔 산업용 로봇)

- Apptronik의 Apollo 휴머노이드

Gemini Robotics SDK: 데모로 로봇 훈련

Google은 또한 Gemini Robotics SDK를 발표했으며, 이를 통해 개발자는 MuJoCo 물리 시뮬레이터에서 50-100개의 작업 데모를 사용해 로봇을 훈련할 수 있습니다. 이는 실세계 응용 프로그램에 로봇 학습을 가속화할 수 있습니다.

더 큰 그림: AI의 로봇 공학 진출

Google만 이 경쟁에 참여하는 것은 아닙니다:

- Nvidia는 휴머노이드용 기초 모델을 개발 중입니다

- Hugging Face는 오픈 모델과 실제 로봇을 연구 중입니다

- RLWRLD (한국 스타트업)는 로봇 공학용 기초 모델을 개발 중입니다

AI 기반 로봇의 미래가 뜨거워지고 있으며, 이는 오프라인, 온디바이스, 실시간으로 일어나고 있습니다.

더 많은 기술 인사이트를 원하시나요?

Boston, MA (7월 15일)에서 열리는 TechCrunch Disrupt에 참여해 AI, 로봇 공학, 벤처 트렌드에 대한 심층 탐구를 경험하세요. 모든 스테이지 패스에서 $200 이상 할인 받고 Precursor Ventures, NEA, Index Ventures, Underscore VC의 리더들과 연결하세요.

👉 지금 등록하세요

관련 기사

구글, 인도에서 크롬용 제미니 서비스 출시

수요일, 구글은 크롬용 제미니(Gemini) 통합 기능을 인도, 캐나다, 뉴질랜드를 포함한 새로운 지역으로 확대한다고 발표했습니다. 이번 업데이트를 통해 데스크톱 사용자는 사이드바를 통해 제미니에 접속할 수 있게 되며, 여기서 구글의 AI 챗봇에게 화면상의 콘텐츠에 대해 질문하거나, 지메일(Gmail), 킵(Keep), 드라이브(Drive), 유튜브(You

구글, 인도에서 크롬용 제미니 서비스 출시

수요일, 구글은 크롬용 제미니(Gemini) 통합 기능을 인도, 캐나다, 뉴질랜드를 포함한 새로운 지역으로 확대한다고 발표했습니다. 이번 업데이트를 통해 데스크톱 사용자는 사이드바를 통해 제미니에 접속할 수 있게 되며, 여기서 구글의 AI 챗봇에게 화면상의 콘텐츠에 대해 질문하거나, 지메일(Gmail), 킵(Keep), 드라이브(Drive), 유튜브(You

유튜브, 정치인·공직자·언론인을 대상으로 AI 딥페이크 탐지 기능 확대

화요일, 유튜브는 딥페이크 탐지 기술을 일부 정부 관계자, 정치 후보자 및 언론인 대상으로 확대한다고 발표했다. 이 도구는 AI로 생성된 유사 영상을 식별하며, 시범 운영 참여자들은 유튜브 정책을 위반한다고 판단되는 무단 콘텐츠의 삭제를 요청할 수 있다.이 탐지 시스템은 초기 테스트 단계를 거친 후, 작년 유튜브 파트너 프로그램에 가입된 약 400만 명의

유튜브, 정치인·공직자·언론인을 대상으로 AI 딥페이크 탐지 기능 확대

화요일, 유튜브는 딥페이크 탐지 기술을 일부 정부 관계자, 정치 후보자 및 언론인 대상으로 확대한다고 발표했다. 이 도구는 AI로 생성된 유사 영상을 식별하며, 시범 운영 참여자들은 유튜브 정책을 위반한다고 판단되는 무단 콘텐츠의 삭제를 요청할 수 있다.이 탐지 시스템은 초기 테스트 단계를 거친 후, 작년 유튜브 파트너 프로그램에 가입된 약 400만 명의

유튜브, 안내형 답변이 포함된 AI 기반 검색 기능 테스트 중

많은 사용자가 요리법이나 여행 계획을 검색할 때 유튜브를 찾아 관련 동영상을 찾곤 합니다. 이제 유튜브는 텍스트와 동영상 콘텐츠를 결합해 단계별 결과를 제공하는 AI 기반 대화형 검색 도구를 선보입니다.새로운 'Ask YouTube' 기능을 통해 사용자는 "샌프란시스코에서 산타바바라까지 3일간의 로드트립을 계획해 주세요"와 같은 질문을 할 수 있으며, 단순

관련 특별 주제 추천

의견 (3)

0/500

유튜브, 안내형 답변이 포함된 AI 기반 검색 기능 테스트 중

많은 사용자가 요리법이나 여행 계획을 검색할 때 유튜브를 찾아 관련 동영상을 찾곤 합니다. 이제 유튜브는 텍스트와 동영상 콘텐츠를 결합해 단계별 결과를 제공하는 AI 기반 대화형 검색 도구를 선보입니다.새로운 'Ask YouTube' 기능을 통해 사용자는 "샌프란시스코에서 산타바바라까지 3일간의 로드트립을 계획해 주세요"와 같은 질문을 할 수 있으며, 단순

관련 특별 주제 추천

의견 (3)

0/500

![JuanLewis]()

Super cool that robots can now think offline with Gemini! Imagine them zipping around without Wi-Fi, making decisions on the fly. Can’t wait to see this in action at home! 🤖

![RonaldNelson]()

This is wild! Robots running Gemini AI offline? Google’s pushing the future hard. Can’t wait to see how this shakes up industries, but I’m low-key worried about robots getting too smart too fast. 😅

Google DeepMind, 오프라인 로봇 제어를 위한 Gemini Robotics On-Device 공개

Google DeepMind가 로봇 분야에서 흥미로운 업데이트를 발표했습니다—Gemini Robotics On-Device, 인터넷 연결 없이 작업을 수행할 수 있는 새로운 언어 모델입니다. 이는 이전 Gemini Robotics 모델(3월 출시)을 기반으로 하지만 핵심 업그레이드: 로컬 처리를 제공합니다.

개발자는 이제 자연어 프롬프트를 사용해 로봇 움직임을 미세 조정할 수 있어 다양한 작업에 로봇을 쉽게 적응시킬 수 있습니다. Google은 이 모델의 성능이 클라우드 기반 모델과 거의 동등하며 다른 온디바이스 모델을 능가한다고 주장했습니다(구체적으로 어떤 모델인지는 밝히지 않았습니다).

실세계 로봇 기술: 세탁부터 조립 라인까지

데모에서 이 모델을 실행하는 로봇은 다음을 성공적으로 수행했습니다:

- 가방 지퍼 열기

- 옷 접기

- 새로운 객체에 적응 (예: 산업용 벨트에서 부품 조립)

원래 ALOHA 로봇용으로 훈련된 이 모델은 이후 다음에 맞게 조정되었습니다:

- Franka FR3 (양팔 산업용 로봇)

- Apptronik의 Apollo 휴머노이드

Gemini Robotics SDK: 데모로 로봇 훈련

Google은 또한 Gemini Robotics SDK를 발표했으며, 이를 통해 개발자는 MuJoCo 물리 시뮬레이터에서 50-100개의 작업 데모를 사용해 로봇을 훈련할 수 있습니다. 이는 실세계 응용 프로그램에 로봇 학습을 가속화할 수 있습니다.

더 큰 그림: AI의 로봇 공학 진출

Google만 이 경쟁에 참여하는 것은 아닙니다:

- Nvidia는 휴머노이드용 기초 모델을 개발 중입니다

- Hugging Face는 오픈 모델과 실제 로봇을 연구 중입니다

- RLWRLD (한국 스타트업)는 로봇 공학용 기초 모델을 개발 중입니다

AI 기반 로봇의 미래가 뜨거워지고 있으며, 이는 오프라인, 온디바이스, 실시간으로 일어나고 있습니다.

더 많은 기술 인사이트를 원하시나요?

Boston, MA (7월 15일)에서 열리는 TechCrunch Disrupt에 참여해 AI, 로봇 공학, 벤처 트렌드에 대한 심층 탐구를 경험하세요. 모든 스테이지 패스에서 $200 이상 할인 받고 Precursor Ventures, NEA, Index Ventures, Underscore VC의 리더들과 연결하세요.

👉 지금 등록하세요

구글, 인도에서 크롬용 제미니 서비스 출시

수요일, 구글은 크롬용 제미니(Gemini) 통합 기능을 인도, 캐나다, 뉴질랜드를 포함한 새로운 지역으로 확대한다고 발표했습니다. 이번 업데이트를 통해 데스크톱 사용자는 사이드바를 통해 제미니에 접속할 수 있게 되며, 여기서 구글의 AI 챗봇에게 화면상의 콘텐츠에 대해 질문하거나, 지메일(Gmail), 킵(Keep), 드라이브(Drive), 유튜브(You

구글, 인도에서 크롬용 제미니 서비스 출시

수요일, 구글은 크롬용 제미니(Gemini) 통합 기능을 인도, 캐나다, 뉴질랜드를 포함한 새로운 지역으로 확대한다고 발표했습니다. 이번 업데이트를 통해 데스크톱 사용자는 사이드바를 통해 제미니에 접속할 수 있게 되며, 여기서 구글의 AI 챗봇에게 화면상의 콘텐츠에 대해 질문하거나, 지메일(Gmail), 킵(Keep), 드라이브(Drive), 유튜브(You

유튜브, 정치인·공직자·언론인을 대상으로 AI 딥페이크 탐지 기능 확대

화요일, 유튜브는 딥페이크 탐지 기술을 일부 정부 관계자, 정치 후보자 및 언론인 대상으로 확대한다고 발표했다. 이 도구는 AI로 생성된 유사 영상을 식별하며, 시범 운영 참여자들은 유튜브 정책을 위반한다고 판단되는 무단 콘텐츠의 삭제를 요청할 수 있다.이 탐지 시스템은 초기 테스트 단계를 거친 후, 작년 유튜브 파트너 프로그램에 가입된 약 400만 명의

유튜브, 정치인·공직자·언론인을 대상으로 AI 딥페이크 탐지 기능 확대

화요일, 유튜브는 딥페이크 탐지 기술을 일부 정부 관계자, 정치 후보자 및 언론인 대상으로 확대한다고 발표했다. 이 도구는 AI로 생성된 유사 영상을 식별하며, 시범 운영 참여자들은 유튜브 정책을 위반한다고 판단되는 무단 콘텐츠의 삭제를 요청할 수 있다.이 탐지 시스템은 초기 테스트 단계를 거친 후, 작년 유튜브 파트너 프로그램에 가입된 약 400만 명의

유튜브, 안내형 답변이 포함된 AI 기반 검색 기능 테스트 중

많은 사용자가 요리법이나 여행 계획을 검색할 때 유튜브를 찾아 관련 동영상을 찾곤 합니다. 이제 유튜브는 텍스트와 동영상 콘텐츠를 결합해 단계별 결과를 제공하는 AI 기반 대화형 검색 도구를 선보입니다.새로운 'Ask YouTube' 기능을 통해 사용자는 "샌프란시스코에서 산타바바라까지 3일간의 로드트립을 계획해 주세요"와 같은 질문을 할 수 있으며, 단순

유튜브, 안내형 답변이 포함된 AI 기반 검색 기능 테스트 중

많은 사용자가 요리법이나 여행 계획을 검색할 때 유튜브를 찾아 관련 동영상을 찾곤 합니다. 이제 유튜브는 텍스트와 동영상 콘텐츠를 결합해 단계별 결과를 제공하는 AI 기반 대화형 검색 도구를 선보입니다.새로운 'Ask YouTube' 기능을 통해 사용자는 "샌프란시스코에서 산타바바라까지 3일간의 로드트립을 계획해 주세요"와 같은 질문을 할 수 있으며, 단순

Super cool that robots can now think offline with Gemini! Imagine them zipping around without Wi-Fi, making decisions on the fly. Can’t wait to see this in action at home! 🤖

This is wild! Robots running Gemini AI offline? Google’s pushing the future hard. Can’t wait to see how this shakes up industries, but I’m low-key worried about robots getting too smart too fast. 😅

집

집