漏れたデータによって暴露された中国のAI検閲

中国がAIを活用して検閲能力を強化したことは、13万3000件のコンテンツが中国政府によって機密性のためにフラグ付けされた漏洩データベースによって明らかにされ、新たなレベルに達しています。この高度な大規模言語モデル(LLM)は、農村部の貧困から共産党内の腐敗、さらには微妙な政治的風刺まで、幅広いトピックに関連するコンテンツを自動的に検出し、検閲するように設計されています。

2019年6月4日に撮影されたこの写真は、中国西部の新疆地域、カシュガルの南にあるイェンギサールの住宅地で、有刺鉄線の背後にある中国国旗を示しています。画像クレジット:Greg Baker / AFP / Getty Images カリフォルニア大学バークレー校で中国の検閲を専門とする研究者、シャオ・チャンによると、このデータベースは中国政府またはその関連団体がLLMを使用して抑圧努力を強化している「明確な証拠」です。従来の人間のモデレーターやキーワードフィルタリングに依存する方法とは異なり、このAI駆動のアプローチは、国家が管理する情報管理の効率と精度を大幅に向上させることができます。

セキュリティ研究者のNetAskariが、Baiduサーバー上で保護されていないElasticsearchデータベースで発見したこのデータセットには、2024年12月からの最近のエントリーが含まれています。データセットを作成したのが誰かは不明ですが、その目的は明らかです:汚染、食品安全、金融詐欺、労働争議、軍事問題などの機密トピックに関連するコンテンツを特定し、フラグ付けするLLMを訓練することです。歴史的類推や台湾への言及を含む政治的風刺も、優先度の高いターゲットです。

画像クレジット:Charles Rollet トレーニングデータには、腐敗した警察官への不満、農村部の貧困に関する報告、共産党から追放された役人に関するニュースなど、社会不安を引き起こす可能性のあるさまざまなコンテンツの例が含まれています。データセットには、台湾や軍事関連のトピックへの広範な言及も含まれており、「台湾」という中国語が1万5000回以上出現しています。

データセットの意図された用途は「世論工作」と記述されており、Article 19のマイケル・キャスターが説明するところでは、通常、中国サイバースペース管理局(CAC)に関連し、検閲とプロパガンダの努力を伴います。これは、中国の習近平国家主席がインターネットを共産党の世論工作の「最前線」と見なす見解と一致しています。

この発展は、権威主義政権が抑圧目的でAI技術を採用する広範な傾向の一部です。OpenAIは最近、中国と思われる未特定のアクターが生成AIを使用してソーシャルメディアを監視し、反政府的な投稿を中国政府に転送していたと報告しました。同じ技術は、著名な中国の反体制派、蔡霞に対する批判的なコメントを生成するためにも使用されました。

中国の従来の検閲方法は、ブラックリストに登録された用語をブロックする基本的なアルゴリズムに依存していますが、LLMの使用は大きな進歩を表しています。これらのAIシステムは、大規模な微妙な批判を検出し、データを処理するにつれて継続的に改善することができます。

「AI駆動の検閲がどのように進化しているかを強調することは、特にDeepSeekのような中国のAIモデルが注目を集めている時期に、国家が公共の言論をより高度に制御していることを示すために重要だと思います」と、シャオ・チャンはTechCrunchに語りました。

関連記事

ドイツの裁判所はテラダイン・ロボティクス側の主張を認め、エリート・ロボッツに対する仮処分を認めた

テラダインの子会社であるユニバーサル・ロボッツは、先日開催されたMODEX見本市において、UR協働ロボットアームを搭載した移動式マニピュレーターを展示した。出典:テラダイン今週ドイツでハノーバー・メッセが開幕する中、ハンブルク地方裁判所はエリート・ロボッツ・ドイッチランド社に対し仮処分命令を下した。この判決は、テラダイン・ロボティクス社が提起した著作権侵害訴訟を受けて下されたものである。テラダイン

ドイツの裁判所はテラダイン・ロボティクス側の主張を認め、エリート・ロボッツに対する仮処分を認めた

テラダインの子会社であるユニバーサル・ロボッツは、先日開催されたMODEX見本市において、UR協働ロボットアームを搭載した移動式マニピュレーターを展示した。出典:テラダイン今週ドイツでハノーバー・メッセが開幕する中、ハンブルク地方裁判所はエリート・ロボッツ・ドイッチランド社に対し仮処分命令を下した。この判決は、テラダイン・ロボティクス社が提起した著作権侵害訴訟を受けて下されたものである。テラダイン

ヒュンダイ、AWでMobEDロボットを発表 AIが製造業を変革

現代自動車グループは、2026年AW(スマートファクトリー&オートメーションワールド)において、MobEDロボットを含む韓国製システムを展示する。出典:現代自動車グループ現代自動車グループのロボティクス研究所は、来週ソウルで開催されるスマートファクトリー&オートメーションワールド(AW)で、モビリティプラットフォーム「MobED」を初公開する。製造、物流、その他の分野でロボティクスと人工知能の採用

ヒュンダイ、AWでMobEDロボットを発表 AIが製造業を変革

現代自動車グループは、2026年AW(スマートファクトリー&オートメーションワールド)において、MobEDロボットを含む韓国製システムを展示する。出典:現代自動車グループ現代自動車グループのロボティクス研究所は、来週ソウルで開催されるスマートファクトリー&オートメーションワールド(AW)で、モビリティプラットフォーム「MobED」を初公開する。製造、物流、その他の分野でロボティクスと人工知能の採用

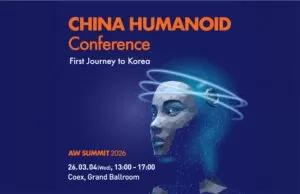

ソウルオートメーションワールドで中国のヒューマノイドロボットメーカーが展示

中国を代表する5つのヒューマノイドロボット企業がソウルで展示・発表を行う。出典:AW 2026ヒューマノイドロボットが世界の技術リーダー、投資家、産業関係者の関心を集める中、中国を代表する5社のヒューマノイド開発企業が来週、初めて韓国に集結する。「アジアを代表する製造AX展示会」と称される「Smart Factory & Automation World (AW) 2026」では、AGIBOT、フ

関連特集おすすめ

コメント (38)

0/500

ソウルオートメーションワールドで中国のヒューマノイドロボットメーカーが展示

中国を代表する5つのヒューマノイドロボット企業がソウルで展示・発表を行う。出典:AW 2026ヒューマノイドロボットが世界の技術リーダー、投資家、産業関係者の関心を集める中、中国を代表する5社のヒューマノイド開発企業が来週、初めて韓国に集結する。「アジアを代表する製造AX展示会」と称される「Smart Factory & Automation World (AW) 2026」では、AGIBOT、フ

関連特集おすすめ

コメント (38)

0/500

![HarryRoberts]()

Whoa, 133,000 flagged posts? That's wild! China's AI censorship game is intense, but I'm curious—how do they even decide what's 'sensitive'? Sounds like a slippery slope. 😬

![CharlesGonzalez]()

This leak is wild! 133,000 flagged posts show how deep China's AI censorship goes. It's like a digital Big Brother on steroids. 😳 Makes you wonder how much we're not seeing online.

![ElijahWalker]()

This leak is wild! 133,000 flagged posts? That’s a scary peek into how AI’s being used to control speech in China. Makes you wonder how much is being filtered without us knowing. 😳

![MichaelDavis]()

Essa ferramenta é reveladora! Mostra como a censura por AI na China é profunda. O vazamento do banco de dados é um pouco assustador, mas é importante saber o que está acontecendo nos bastidores. Definitivamente, algo que todos interessados em liberdade na internet devem conhecer. Fique de olho nisso! 👀

![SebastianAnderson]()

Los datos filtrados sobre la censura de IA en China son escalofriantes. Es aterrador pensar en cómo se está utilizando la IA para controlar la información. Necesitamos más transparencia y menos censura, ¿no crees? 🤔

中国がAIを活用して検閲能力を強化したことは、13万3000件のコンテンツが中国政府によって機密性のためにフラグ付けされた漏洩データベースによって明らかにされ、新たなレベルに達しています。この高度な大規模言語モデル(LLM)は、農村部の貧困から共産党内の腐敗、さらには微妙な政治的風刺まで、幅広いトピックに関連するコンテンツを自動的に検出し、検閲するように設計されています。

カリフォルニア大学バークレー校で中国の検閲を専門とする研究者、シャオ・チャンによると、このデータベースは中国政府またはその関連団体がLLMを使用して抑圧努力を強化している「明確な証拠」です。従来の人間のモデレーターやキーワードフィルタリングに依存する方法とは異なり、このAI駆動のアプローチは、国家が管理する情報管理の効率と精度を大幅に向上させることができます。

セキュリティ研究者のNetAskariが、Baiduサーバー上で保護されていないElasticsearchデータベースで発見したこのデータセットには、2024年12月からの最近のエントリーが含まれています。データセットを作成したのが誰かは不明ですが、その目的は明らかです:汚染、食品安全、金融詐欺、労働争議、軍事問題などの機密トピックに関連するコンテンツを特定し、フラグ付けするLLMを訓練することです。歴史的類推や台湾への言及を含む政治的風刺も、優先度の高いターゲットです。

トレーニングデータには、腐敗した警察官への不満、農村部の貧困に関する報告、共産党から追放された役人に関するニュースなど、社会不安を引き起こす可能性のあるさまざまなコンテンツの例が含まれています。データセットには、台湾や軍事関連のトピックへの広範な言及も含まれており、「台湾」という中国語が1万5000回以上出現しています。

データセットの意図された用途は「世論工作」と記述されており、Article 19のマイケル・キャスターが説明するところでは、通常、中国サイバースペース管理局(CAC)に関連し、検閲とプロパガンダの努力を伴います。これは、中国の習近平国家主席がインターネットを共産党の世論工作の「最前線」と見なす見解と一致しています。

この発展は、権威主義政権が抑圧目的でAI技術を採用する広範な傾向の一部です。OpenAIは最近、中国と思われる未特定のアクターが生成AIを使用してソーシャルメディアを監視し、反政府的な投稿を中国政府に転送していたと報告しました。同じ技術は、著名な中国の反体制派、蔡霞に対する批判的なコメントを生成するためにも使用されました。

中国の従来の検閲方法は、ブラックリストに登録された用語をブロックする基本的なアルゴリズムに依存していますが、LLMの使用は大きな進歩を表しています。これらのAIシステムは、大規模な微妙な批判を検出し、データを処理するにつれて継続的に改善することができます。

「AI駆動の検閲がどのように進化しているかを強調することは、特にDeepSeekのような中国のAIモデルが注目を集めている時期に、国家が公共の言論をより高度に制御していることを示すために重要だと思います」と、シャオ・チャンはTechCrunchに語りました。

ドイツの裁判所はテラダイン・ロボティクス側の主張を認め、エリート・ロボッツに対する仮処分を認めた

テラダインの子会社であるユニバーサル・ロボッツは、先日開催されたMODEX見本市において、UR協働ロボットアームを搭載した移動式マニピュレーターを展示した。出典:テラダイン今週ドイツでハノーバー・メッセが開幕する中、ハンブルク地方裁判所はエリート・ロボッツ・ドイッチランド社に対し仮処分命令を下した。この判決は、テラダイン・ロボティクス社が提起した著作権侵害訴訟を受けて下されたものである。テラダイン

ドイツの裁判所はテラダイン・ロボティクス側の主張を認め、エリート・ロボッツに対する仮処分を認めた

テラダインの子会社であるユニバーサル・ロボッツは、先日開催されたMODEX見本市において、UR協働ロボットアームを搭載した移動式マニピュレーターを展示した。出典:テラダイン今週ドイツでハノーバー・メッセが開幕する中、ハンブルク地方裁判所はエリート・ロボッツ・ドイッチランド社に対し仮処分命令を下した。この判決は、テラダイン・ロボティクス社が提起した著作権侵害訴訟を受けて下されたものである。テラダイン

ヒュンダイ、AWでMobEDロボットを発表 AIが製造業を変革

現代自動車グループは、2026年AW(スマートファクトリー&オートメーションワールド)において、MobEDロボットを含む韓国製システムを展示する。出典:現代自動車グループ現代自動車グループのロボティクス研究所は、来週ソウルで開催されるスマートファクトリー&オートメーションワールド(AW)で、モビリティプラットフォーム「MobED」を初公開する。製造、物流、その他の分野でロボティクスと人工知能の採用

ヒュンダイ、AWでMobEDロボットを発表 AIが製造業を変革

現代自動車グループは、2026年AW(スマートファクトリー&オートメーションワールド)において、MobEDロボットを含む韓国製システムを展示する。出典:現代自動車グループ現代自動車グループのロボティクス研究所は、来週ソウルで開催されるスマートファクトリー&オートメーションワールド(AW)で、モビリティプラットフォーム「MobED」を初公開する。製造、物流、その他の分野でロボティクスと人工知能の採用

ソウルオートメーションワールドで中国のヒューマノイドロボットメーカーが展示

中国を代表する5つのヒューマノイドロボット企業がソウルで展示・発表を行う。出典:AW 2026ヒューマノイドロボットが世界の技術リーダー、投資家、産業関係者の関心を集める中、中国を代表する5社のヒューマノイド開発企業が来週、初めて韓国に集結する。「アジアを代表する製造AX展示会」と称される「Smart Factory & Automation World (AW) 2026」では、AGIBOT、フ

ソウルオートメーションワールドで中国のヒューマノイドロボットメーカーが展示

中国を代表する5つのヒューマノイドロボット企業がソウルで展示・発表を行う。出典:AW 2026ヒューマノイドロボットが世界の技術リーダー、投資家、産業関係者の関心を集める中、中国を代表する5社のヒューマノイド開発企業が来週、初めて韓国に集結する。「アジアを代表する製造AX展示会」と称される「Smart Factory & Automation World (AW) 2026」では、AGIBOT、フ

Whoa, 133,000 flagged posts? That's wild! China's AI censorship game is intense, but I'm curious—how do they even decide what's 'sensitive'? Sounds like a slippery slope. 😬

This leak is wild! 133,000 flagged posts show how deep China's AI censorship goes. It's like a digital Big Brother on steroids. 😳 Makes you wonder how much we're not seeing online.

This leak is wild! 133,000 flagged posts? That’s a scary peek into how AI’s being used to control speech in China. Makes you wonder how much is being filtered without us knowing. 😳

Essa ferramenta é reveladora! Mostra como a censura por AI na China é profunda. O vazamento do banco de dados é um pouco assustador, mas é importante saber o que está acontecendo nos bastidores. Definitivamente, algo que todos interessados em liberdade na internet devem conhecer. Fique de olho nisso! 👀

Los datos filtrados sobre la censura de IA en China son escalofriantes. Es aterrador pensar en cómo se está utilizando la IA para controlar la información. Necesitamos más transparencia y menos censura, ¿no crees? 🤔

家

家