中國人工智能審查制度被洩漏的數據暴露

中國利用AI增強其審查能力已達到新水平,一個洩露的數據庫顯示,中國政府標記了133,000個敏感內容示例。這種精密的大型語言模型(LLM)旨在自動檢測和審查與廣泛主題相關的內容,從農村貧困到共產黨內部的腐敗,甚至是微妙的政治諷刺。

這張攝於2019年6月4日的照片顯示,中國新疆西部焉耆地區喀什以南的一個住宅區內,中國國旗在鐵絲網後。圖片來源:Greg Baker / AFP / Getty Images 據專攻中國審查研究的加州大學伯克利分校研究員蕭強表示,這個數據庫是“明確證據”,證明中國政府或其關聯機構正在使用LLM來加強其壓制行動。與依賴人工審核和關鍵詞過濾的傳統方法不同,這種AI驅動的方法能顯著提升國家控制資訊管理的效率和精確度。

該數據集由安全研究員NetAskari在百度伺服器上一個未受保護的Elasticsearch數據庫中發現,包含2024年12月的最新條目。目前尚不清楚數據集的具體創建者,但其目的顯而易見:訓練LLM以識別和標記與敏感話題相關的內容,如污染、食品安全、金融詐騙、勞資糾紛和軍事事務。政治諷刺,尤其是涉及歷史類比或台灣的內容,也是高度優先的目標。

圖片來源:Charles Rollet 訓練數據包括可能引發社會動盪的各種內容示例,如對腐敗警察的投訴、農村貧困報導,以及被開除的共產黨官員的新聞。數據集還廣泛提及台灣和軍事相關話題,其中“台灣”一詞出現超過15,000次。

數據集的預定用途被描述為“輿論工作”,Article 19的Michael Caster解釋,這一術語通常與中國國家互聯網資訊辦公室(CAC)相關,涉及審查和宣傳工作。這與中國國家主席習近平將互聯網視為共產黨輿論工作“前線”的觀點一致。

這一發展是專制政權採用AI技術進行壓制目的的更廣泛趨勢的一部分。OpenAI最近報告稱,一個可能來自中國的未知行動者使用生成式AI監控社交媒體,並將反政府帖子轉發給中國政府。同一技術還被用於生成對著名中國異見人士蔡霞的批評評論。

雖然中國的傳統審查方法依賴基本算法來屏蔽黑名單術語,但LLM的使用代表了重大進展。這些AI系統能夠在大規模檢測甚至微妙的批評,並隨著處理更多數據而不斷改進。

“我認為必須強調AI驅動的審查如何演變,使國家對公共話語的控制更加精密,特別是在DeepSeek等中國AI模型掀起波瀾的時刻,”蕭強對TechCrunch表示。

相關文章

德國法院支持泰瑞達機器人公司,對 Elite Robots 頒布禁制令

泰瑞達(Teradyne)旗下子公司 Universal Robots 近日在 MODEX 貿易展上展示了其配備 UR 協作機器人手臂的移動式操作機器人。來源:泰瑞達隨著漢諾威工業博覽會本週在德國揭幕,漢堡地區法院針對 Elite Robots Deutschland GmbH 頒布了初步禁制令。此裁決是針對泰瑞達機器人公司(Teradyne Robotics A/S)提起的著作權侵權訴訟所作出的

德國法院支持泰瑞達機器人公司,對 Elite Robots 頒布禁制令

泰瑞達(Teradyne)旗下子公司 Universal Robots 近日在 MODEX 貿易展上展示了其配備 UR 協作機器人手臂的移動式操作機器人。來源:泰瑞達隨著漢諾威工業博覽會本週在德國揭幕,漢堡地區法院針對 Elite Robots Deutschland GmbH 頒布了初步禁制令。此裁決是針對泰瑞達機器人公司(Teradyne Robotics A/S)提起的著作權侵權訴訟所作出的

現代汽車於AW展會首度亮相MobED機器人,人工智慧正重塑製造業格局

現代汽車將於2026年自動化世界博覽會(AW)展示其MobED機器人及其他韓國系統。來源:現代汽車集團隨著機器人與人工智慧在製造、物流等領域的應用日益普及,現代汽車集團機器人實驗室將於下週在首爾舉行的「智慧工廠與自動化世界博覽會」(AW)首度公開其MobED移動平台。本次活動亦將匯聚其他頂尖工業機器人供應商。這款名為「移動偏心機器人」(MobED)的設備於2025年12月首度亮相,採用四組獨立控制

現代汽車於AW展會首度亮相MobED機器人,人工智慧正重塑製造業格局

現代汽車將於2026年自動化世界博覽會(AW)展示其MobED機器人及其他韓國系統。來源:現代汽車集團隨著機器人與人工智慧在製造、物流等領域的應用日益普及,現代汽車集團機器人實驗室將於下週在首爾舉行的「智慧工廠與自動化世界博覽會」(AW)首度公開其MobED移動平台。本次活動亦將匯聚其他頂尖工業機器人供應商。這款名為「移動偏心機器人」(MobED)的設備於2025年12月首度亮相,採用四組獨立控制

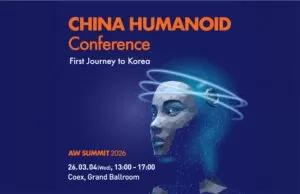

首爾自動化世界展將展示中國人形機器人製造商

中國五家知名人形機器人企業將於首爾參展並進行技術展示。來源:AW 2026隨著人形機器人日益受到全球科技領袖、投資者及產業參與者的關注,中國五大頂尖人形機器人開發商將於下週首度齊聚韓國。被譽為「亞洲頂級製造自動化博覽會」的「智能工廠與自動化世界(AW)2026」已確認AGIBOT、傅立葉、華為、樂聚及Unitree參展。這些企業將在AW 2026的配套活動「中國人形機器人大會」——亦稱「中國人形機

相關專題推薦

評論 (38)

0/500

首爾自動化世界展將展示中國人形機器人製造商

中國五家知名人形機器人企業將於首爾參展並進行技術展示。來源:AW 2026隨著人形機器人日益受到全球科技領袖、投資者及產業參與者的關注,中國五大頂尖人形機器人開發商將於下週首度齊聚韓國。被譽為「亞洲頂級製造自動化博覽會」的「智能工廠與自動化世界(AW)2026」已確認AGIBOT、傅立葉、華為、樂聚及Unitree參展。這些企業將在AW 2026的配套活動「中國人形機器人大會」——亦稱「中國人形機

相關專題推薦

評論 (38)

0/500

![HarryRoberts]()

Whoa, 133,000 flagged posts? That's wild! China's AI censorship game is intense, but I'm curious—how do they even decide what's 'sensitive'? Sounds like a slippery slope. 😬

![CharlesGonzalez]()

This leak is wild! 133,000 flagged posts show how deep China's AI censorship goes. It's like a digital Big Brother on steroids. 😳 Makes you wonder how much we're not seeing online.

![ElijahWalker]()

This leak is wild! 133,000 flagged posts? That’s a scary peek into how AI’s being used to control speech in China. Makes you wonder how much is being filtered without us knowing. 😳

![MichaelDavis]()

Essa ferramenta é reveladora! Mostra como a censura por AI na China é profunda. O vazamento do banco de dados é um pouco assustador, mas é importante saber o que está acontecendo nos bastidores. Definitivamente, algo que todos interessados em liberdade na internet devem conhecer. Fique de olho nisso! 👀

![SebastianAnderson]()

Los datos filtrados sobre la censura de IA en China son escalofriantes. Es aterrador pensar en cómo se está utilizando la IA para controlar la información. Necesitamos más transparencia y menos censura, ¿no crees? 🤔

中國利用AI增強其審查能力已達到新水平,一個洩露的數據庫顯示,中國政府標記了133,000個敏感內容示例。這種精密的大型語言模型(LLM)旨在自動檢測和審查與廣泛主題相關的內容,從農村貧困到共產黨內部的腐敗,甚至是微妙的政治諷刺。

據專攻中國審查研究的加州大學伯克利分校研究員蕭強表示,這個數據庫是“明確證據”,證明中國政府或其關聯機構正在使用LLM來加強其壓制行動。與依賴人工審核和關鍵詞過濾的傳統方法不同,這種AI驅動的方法能顯著提升國家控制資訊管理的效率和精確度。

該數據集由安全研究員NetAskari在百度伺服器上一個未受保護的Elasticsearch數據庫中發現,包含2024年12月的最新條目。目前尚不清楚數據集的具體創建者,但其目的顯而易見:訓練LLM以識別和標記與敏感話題相關的內容,如污染、食品安全、金融詐騙、勞資糾紛和軍事事務。政治諷刺,尤其是涉及歷史類比或台灣的內容,也是高度優先的目標。

訓練數據包括可能引發社會動盪的各種內容示例,如對腐敗警察的投訴、農村貧困報導,以及被開除的共產黨官員的新聞。數據集還廣泛提及台灣和軍事相關話題,其中“台灣”一詞出現超過15,000次。

數據集的預定用途被描述為“輿論工作”,Article 19的Michael Caster解釋,這一術語通常與中國國家互聯網資訊辦公室(CAC)相關,涉及審查和宣傳工作。這與中國國家主席習近平將互聯網視為共產黨輿論工作“前線”的觀點一致。

這一發展是專制政權採用AI技術進行壓制目的的更廣泛趨勢的一部分。OpenAI最近報告稱,一個可能來自中國的未知行動者使用生成式AI監控社交媒體,並將反政府帖子轉發給中國政府。同一技術還被用於生成對著名中國異見人士蔡霞的批評評論。

雖然中國的傳統審查方法依賴基本算法來屏蔽黑名單術語,但LLM的使用代表了重大進展。這些AI系統能夠在大規模檢測甚至微妙的批評,並隨著處理更多數據而不斷改進。

“我認為必須強調AI驅動的審查如何演變,使國家對公共話語的控制更加精密,特別是在DeepSeek等中國AI模型掀起波瀾的時刻,”蕭強對TechCrunch表示。

德國法院支持泰瑞達機器人公司,對 Elite Robots 頒布禁制令

泰瑞達(Teradyne)旗下子公司 Universal Robots 近日在 MODEX 貿易展上展示了其配備 UR 協作機器人手臂的移動式操作機器人。來源:泰瑞達隨著漢諾威工業博覽會本週在德國揭幕,漢堡地區法院針對 Elite Robots Deutschland GmbH 頒布了初步禁制令。此裁決是針對泰瑞達機器人公司(Teradyne Robotics A/S)提起的著作權侵權訴訟所作出的

德國法院支持泰瑞達機器人公司,對 Elite Robots 頒布禁制令

泰瑞達(Teradyne)旗下子公司 Universal Robots 近日在 MODEX 貿易展上展示了其配備 UR 協作機器人手臂的移動式操作機器人。來源:泰瑞達隨著漢諾威工業博覽會本週在德國揭幕,漢堡地區法院針對 Elite Robots Deutschland GmbH 頒布了初步禁制令。此裁決是針對泰瑞達機器人公司(Teradyne Robotics A/S)提起的著作權侵權訴訟所作出的

現代汽車於AW展會首度亮相MobED機器人,人工智慧正重塑製造業格局

現代汽車將於2026年自動化世界博覽會(AW)展示其MobED機器人及其他韓國系統。來源:現代汽車集團隨著機器人與人工智慧在製造、物流等領域的應用日益普及,現代汽車集團機器人實驗室將於下週在首爾舉行的「智慧工廠與自動化世界博覽會」(AW)首度公開其MobED移動平台。本次活動亦將匯聚其他頂尖工業機器人供應商。這款名為「移動偏心機器人」(MobED)的設備於2025年12月首度亮相,採用四組獨立控制

現代汽車於AW展會首度亮相MobED機器人,人工智慧正重塑製造業格局

現代汽車將於2026年自動化世界博覽會(AW)展示其MobED機器人及其他韓國系統。來源:現代汽車集團隨著機器人與人工智慧在製造、物流等領域的應用日益普及,現代汽車集團機器人實驗室將於下週在首爾舉行的「智慧工廠與自動化世界博覽會」(AW)首度公開其MobED移動平台。本次活動亦將匯聚其他頂尖工業機器人供應商。這款名為「移動偏心機器人」(MobED)的設備於2025年12月首度亮相,採用四組獨立控制

首爾自動化世界展將展示中國人形機器人製造商

中國五家知名人形機器人企業將於首爾參展並進行技術展示。來源:AW 2026隨著人形機器人日益受到全球科技領袖、投資者及產業參與者的關注,中國五大頂尖人形機器人開發商將於下週首度齊聚韓國。被譽為「亞洲頂級製造自動化博覽會」的「智能工廠與自動化世界(AW)2026」已確認AGIBOT、傅立葉、華為、樂聚及Unitree參展。這些企業將在AW 2026的配套活動「中國人形機器人大會」——亦稱「中國人形機

首爾自動化世界展將展示中國人形機器人製造商

中國五家知名人形機器人企業將於首爾參展並進行技術展示。來源:AW 2026隨著人形機器人日益受到全球科技領袖、投資者及產業參與者的關注,中國五大頂尖人形機器人開發商將於下週首度齊聚韓國。被譽為「亞洲頂級製造自動化博覽會」的「智能工廠與自動化世界(AW)2026」已確認AGIBOT、傅立葉、華為、樂聚及Unitree參展。這些企業將在AW 2026的配套活動「中國人形機器人大會」——亦稱「中國人形機

Whoa, 133,000 flagged posts? That's wild! China's AI censorship game is intense, but I'm curious—how do they even decide what's 'sensitive'? Sounds like a slippery slope. 😬

This leak is wild! 133,000 flagged posts show how deep China's AI censorship goes. It's like a digital Big Brother on steroids. 😳 Makes you wonder how much we're not seeing online.

This leak is wild! 133,000 flagged posts? That’s a scary peek into how AI’s being used to control speech in China. Makes you wonder how much is being filtered without us knowing. 😳

Essa ferramenta é reveladora! Mostra como a censura por AI na China é profunda. O vazamento do banco de dados é um pouco assustador, mas é importante saber o que está acontecendo nos bastidores. Definitivamente, algo que todos interessados em liberdade na internet devem conhecer. Fique de olho nisso! 👀

Los datos filtrados sobre la censura de IA en China son escalofriantes. Es aterrador pensar en cómo se está utilizando la IA para controlar la información. Necesitamos más transparencia y menos censura, ¿no crees? 🤔

首頁

首頁