La consommation d'énergie de Chatgpt est plus faible que prévu

ChatGPT, le chatbot d'OpenAI, n'est peut-être pas aussi énergivore qu'on le pensait. Mais sa consommation d'énergie varie beaucoup selon son utilisation et les modèles d'IA qui répondent aux questions, selon une nouvelle étude.

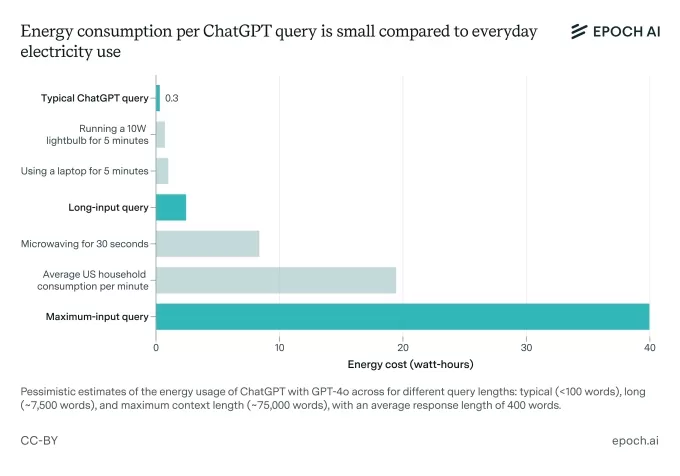

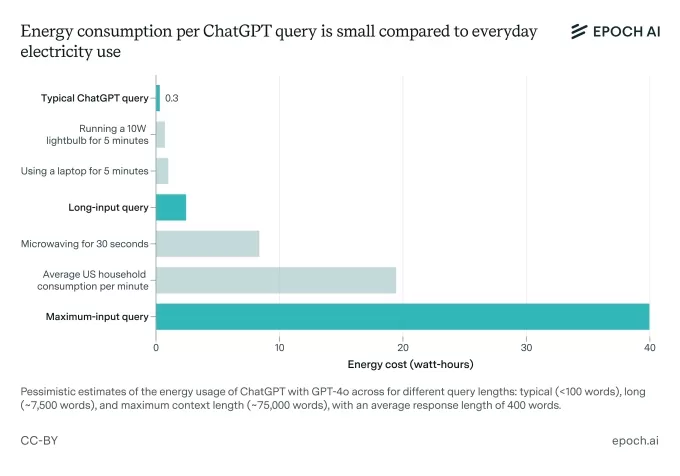

Epoch AI, un groupe de recherche à but non lucratif, a tenté de calculer la consommation d'une requête typique de ChatGPT. On a peut-être entendu que ChatGPT consomme environ 3 watt-heures pour répondre à une question, soit 10 fois plus qu'une recherche Google. Mais Epoch pense que c'est exagéré.

En utilisant le dernier modèle par défaut d'OpenAI, GPT-4o, comme référence, Epoch a constaté qu'une requête moyenne de ChatGPT consomme environ 0,3 watt-heure. C'est moins que ce que nécessitent de nombreux appareils ménagers.

« La consommation d'énergie n'est vraiment pas un gros problème comparé à l'utilisation d'appareils normaux, au chauffage ou à la climatisation de votre maison, ou à la conduite d'une voiture », a déclaré Joshua You, l'analyste de données chez Epoch qui a réalisé l'analyse, à TechCrunch.

La consommation d'énergie de l'IA et son impact sur l'environnement sont des sujets brûlants alors que les entreprises d'IA cherchent à agrandir leurs centres de données de manière exponentielle. La semaine dernière, plus de 100 organisations ont signé une lettre ouverte exhortant l'industrie de l'IA et les régulateurs à s'assurer que les nouveaux centres de données d'IA ne drainent pas les ressources naturelles et ne forcent pas les services publics à dépendre de sources d'énergie non renouvelables.

You a déclaré à TechCrunch que son analyse a été motivée par ce qu'il considérait comme des recherches obsolètes. Il a souligné que le rapport estimant 3 watt-heures supposait qu'OpenAI utilisait des puces plus anciennes et moins efficaces pour exécuter ses modèles.

Crédits image : Epoch AI « J'ai vu beaucoup de discussions publiques qui reconnaissaient correctement que l'IA consommera beaucoup d'énergie dans les années à venir, mais qui ne décrivaient pas précisément l'énergie utilisée par l'IA aujourd'hui », a déclaré You. « De plus, certains de mes collègues ont remarqué que l'estimation la plus répandue de 3 watt-heures par requête était basée sur des recherches assez anciennes et semblait trop élevée d'après quelques calculs approximatifs. »

Bien sûr, l'estimation d'Epoch de 0,3 watt-heure n'est qu'une approximation. OpenAI n'a pas partagé les détails nécessaires pour un calcul précis.

L'analyse ne prend pas non plus en compte les coûts énergétiques supplémentaires des fonctionnalités de ChatGPT comme la génération d'images ou le traitement de longues entrées. You a admis que les requêtes ChatGPT avec de « longues entrées » — comme celles avec de longs fichiers joints — consomment probablement plus d'électricité au départ qu'une question typique.

You a indiqué qu'il s'attend cependant à ce que la consommation d'énergie de base de ChatGPT augmente.

« L'IA deviendra plus avancée, entraîner cette IA nécessitera probablement beaucoup plus d'énergie, et cette IA future pourrait être utilisée beaucoup plus intensément — en gérant beaucoup plus de tâches, et des tâches plus complexes, que la manière dont les gens utilisent ChatGPT aujourd'hui », a déclaré You.

Bien qu'il y ait eu récemment des avancées intéressantes en matière d'efficacité de l'IA, l'ampleur de l'utilisation de l'IA devrait entraîner une croissance massive d'infrastructures énergivores. Dans les deux prochaines années, les centres de données d'IA pourraient nécessiter presque toute la capacité énergétique de la Californie en 2022 (68 GW), selon un rapport Rand. D'ici 2030, entraîner un modèle de pointe pourrait nécessiter une puissance équivalente à huit réacteurs nucléaires (8 GW), selon le rapport.

ChatGPT atteint à lui seul un grand nombre de personnes, et ce nombre ne fait qu'augmenter, ce qui signifie que ses besoins en serveurs sont énormes. OpenAI, avec plusieurs partenaires d'investissement, prévoit de dépenser des milliards pour de nouveaux projets de centres de données d'IA au cours des prochaines années.

L'accent d'OpenAI, comme celui du reste de l'industrie de l'IA, se porte sur les modèles de raisonnement. Ces modèles peuvent effectuer plus de tâches mais nécessitent plus de puissance de calcul pour fonctionner. Contrairement aux modèles comme GPT-4o, qui répondent presque instantanément, les modèles de raisonnement « réfléchissent » pendant quelques secondes à quelques minutes avant de répondre, ce qui consomme plus de puissance de calcul — et donc plus d'énergie.

« Les modèles de raisonnement prendront de plus en plus en charge des tâches que les anciens modèles ne peuvent pas faire, et généreront plus de [données] pour ce faire, et les deux nécessitent plus de centres de données », a déclaré You.

OpenAI a commencé à lancer des modèles de raisonnement plus économes en énergie comme o3-mini. Mais il semble peu probable, du moins pour l'instant, que ces gains d'efficacité compensent les demandes énergétiques accrues du processus de « réflexion » des modèles de raisonnement et de l'utilisation croissante de l'IA dans le monde.

You a suggéré que si vous êtes préoccupé par votre empreinte énergétique liée à l'IA, vous devriez utiliser des applications comme ChatGPT moins souvent, ou choisir des modèles qui consomment moins de puissance de calcul — si cela est possible.

« Vous pourriez essayer d'utiliser des modèles d'IA plus petits comme [OpenAI's] GPT-4o-mini », a déclaré You, « et les utiliser avec parcimonie de manière à nécessiter le traitement ou la génération d'un grand volume de données. »

Article connexe

OpenAI présente les grandes lignes d'une économie de l'IA fondée sur des fonds de richesse publique, une taxe sur les robots et la semaine de quatre jours

Alors que les gouvernements peinent à gérer l’impact économique des machines superintelligentes, OpenAI a publié une série de propositions politiques décrivant comment la richesse et le travail pourra

OpenAI présente les grandes lignes d'une économie de l'IA fondée sur des fonds de richesse publique, une taxe sur les robots et la semaine de quatre jours

Alors que les gouvernements peinent à gérer l’impact économique des machines superintelligentes, OpenAI a publié une série de propositions politiques décrivant comment la richesse et le travail pourra

Greg Brockman révèle comment Elon Musk a quitté OpenAI

Fin août 2017, les principaux dirigeants d’OpenAI — alors un petit laboratoire de recherche à but non lucratif — se sont réunis pour discuter de la manière dont ils allaient créer une entité à but luc

Greg Brockman révèle comment Elon Musk a quitté OpenAI

Fin août 2017, les principaux dirigeants d’OpenAI — alors un petit laboratoire de recherche à but non lucratif — se sont réunis pour discuter de la manière dont ils allaient créer une entité à but luc

Le Pentagone signe des accords avec Nvidia, Microsoft et AWS pour déployer l’intelligence artificielle sur les réseaux classés.

Après avoir précédemment conclu des accords avec Google, SpaceX et OpenAI, le Département de la Défense américain a annoncé vendredi qu’il avait signé des contrats avec Nvidia, Microsoft, Amazon Web Services et Reflection AI pour mettre en œuvre leur

Recommandations de sujets spéciaux liés

commentaires (34)

Le Pentagone signe des accords avec Nvidia, Microsoft et AWS pour déployer l’intelligence artificielle sur les réseaux classés.

Après avoir précédemment conclu des accords avec Google, SpaceX et OpenAI, le Département de la Défense américain a annoncé vendredi qu’il avait signé des contrats avec Nvidia, Microsoft, Amazon Web Services et Reflection AI pour mettre en œuvre leur

Recommandations de sujets spéciaux liés

commentaires (34)

![PaulTaylor]()

¡Vaya, qué sorpresa! 😮 Siempre pensé que ChatGPT era un monstruo energético, pero parece que no es tan malo. Me pregunto cómo se compara con otros modelos de IA en términos de eficiencia. ¿Habrá un ranking público pronto? Sería muy útil para los usuarios conscientes del medio ambiente.

![PaulHill]()

Wow, ChatGPT’s energy use is lower than I thought! Still, it’s wild how much it varies by model and usage. Makes me wonder how sustainable scaling up AI will be in the long run. 🤔

![WillPerez]()

Surprising to see ChatGPT's energy use isn't as bad as hyped! Still, makes me wonder how much power those massive AI models really burn through when we’re all chatting away. 🤔

![CharlesRoberts]()

A energia usada pelo ChatGPT é surpreendentemente baixa! Pensei que fosse um devorador de energia, mas não é tão ruim assim. Ainda assim, é louco como pode variar muito dependendo do modelo e do uso. Faz você pensar no futuro da IA, né? 🤔 Continuem o bom trabalho, OpenAI!

ChatGPT, le chatbot d'OpenAI, n'est peut-être pas aussi énergivore qu'on le pensait. Mais sa consommation d'énergie varie beaucoup selon son utilisation et les modèles d'IA qui répondent aux questions, selon une nouvelle étude.

Epoch AI, un groupe de recherche à but non lucratif, a tenté de calculer la consommation d'une requête typique de ChatGPT. On a peut-être entendu que ChatGPT consomme environ 3 watt-heures pour répondre à une question, soit 10 fois plus qu'une recherche Google. Mais Epoch pense que c'est exagéré.

En utilisant le dernier modèle par défaut d'OpenAI, GPT-4o, comme référence, Epoch a constaté qu'une requête moyenne de ChatGPT consomme environ 0,3 watt-heure. C'est moins que ce que nécessitent de nombreux appareils ménagers.

« La consommation d'énergie n'est vraiment pas un gros problème comparé à l'utilisation d'appareils normaux, au chauffage ou à la climatisation de votre maison, ou à la conduite d'une voiture », a déclaré Joshua You, l'analyste de données chez Epoch qui a réalisé l'analyse, à TechCrunch.

La consommation d'énergie de l'IA et son impact sur l'environnement sont des sujets brûlants alors que les entreprises d'IA cherchent à agrandir leurs centres de données de manière exponentielle. La semaine dernière, plus de 100 organisations ont signé une lettre ouverte exhortant l'industrie de l'IA et les régulateurs à s'assurer que les nouveaux centres de données d'IA ne drainent pas les ressources naturelles et ne forcent pas les services publics à dépendre de sources d'énergie non renouvelables.

You a déclaré à TechCrunch que son analyse a été motivée par ce qu'il considérait comme des recherches obsolètes. Il a souligné que le rapport estimant 3 watt-heures supposait qu'OpenAI utilisait des puces plus anciennes et moins efficaces pour exécuter ses modèles.

« J'ai vu beaucoup de discussions publiques qui reconnaissaient correctement que l'IA consommera beaucoup d'énergie dans les années à venir, mais qui ne décrivaient pas précisément l'énergie utilisée par l'IA aujourd'hui », a déclaré You. « De plus, certains de mes collègues ont remarqué que l'estimation la plus répandue de 3 watt-heures par requête était basée sur des recherches assez anciennes et semblait trop élevée d'après quelques calculs approximatifs. »

Bien sûr, l'estimation d'Epoch de 0,3 watt-heure n'est qu'une approximation. OpenAI n'a pas partagé les détails nécessaires pour un calcul précis.

L'analyse ne prend pas non plus en compte les coûts énergétiques supplémentaires des fonctionnalités de ChatGPT comme la génération d'images ou le traitement de longues entrées. You a admis que les requêtes ChatGPT avec de « longues entrées » — comme celles avec de longs fichiers joints — consomment probablement plus d'électricité au départ qu'une question typique.

You a indiqué qu'il s'attend cependant à ce que la consommation d'énergie de base de ChatGPT augmente.

« L'IA deviendra plus avancée, entraîner cette IA nécessitera probablement beaucoup plus d'énergie, et cette IA future pourrait être utilisée beaucoup plus intensément — en gérant beaucoup plus de tâches, et des tâches plus complexes, que la manière dont les gens utilisent ChatGPT aujourd'hui », a déclaré You.

Bien qu'il y ait eu récemment des avancées intéressantes en matière d'efficacité de l'IA, l'ampleur de l'utilisation de l'IA devrait entraîner une croissance massive d'infrastructures énergivores. Dans les deux prochaines années, les centres de données d'IA pourraient nécessiter presque toute la capacité énergétique de la Californie en 2022 (68 GW), selon un rapport Rand. D'ici 2030, entraîner un modèle de pointe pourrait nécessiter une puissance équivalente à huit réacteurs nucléaires (8 GW), selon le rapport.

ChatGPT atteint à lui seul un grand nombre de personnes, et ce nombre ne fait qu'augmenter, ce qui signifie que ses besoins en serveurs sont énormes. OpenAI, avec plusieurs partenaires d'investissement, prévoit de dépenser des milliards pour de nouveaux projets de centres de données d'IA au cours des prochaines années.

L'accent d'OpenAI, comme celui du reste de l'industrie de l'IA, se porte sur les modèles de raisonnement. Ces modèles peuvent effectuer plus de tâches mais nécessitent plus de puissance de calcul pour fonctionner. Contrairement aux modèles comme GPT-4o, qui répondent presque instantanément, les modèles de raisonnement « réfléchissent » pendant quelques secondes à quelques minutes avant de répondre, ce qui consomme plus de puissance de calcul — et donc plus d'énergie.

« Les modèles de raisonnement prendront de plus en plus en charge des tâches que les anciens modèles ne peuvent pas faire, et généreront plus de [données] pour ce faire, et les deux nécessitent plus de centres de données », a déclaré You.

OpenAI a commencé à lancer des modèles de raisonnement plus économes en énergie comme o3-mini. Mais il semble peu probable, du moins pour l'instant, que ces gains d'efficacité compensent les demandes énergétiques accrues du processus de « réflexion » des modèles de raisonnement et de l'utilisation croissante de l'IA dans le monde.

You a suggéré que si vous êtes préoccupé par votre empreinte énergétique liée à l'IA, vous devriez utiliser des applications comme ChatGPT moins souvent, ou choisir des modèles qui consomment moins de puissance de calcul — si cela est possible.

« Vous pourriez essayer d'utiliser des modèles d'IA plus petits comme [OpenAI's] GPT-4o-mini », a déclaré You, « et les utiliser avec parcimonie de manière à nécessiter le traitement ou la génération d'un grand volume de données. »

OpenAI présente les grandes lignes d'une économie de l'IA fondée sur des fonds de richesse publique, une taxe sur les robots et la semaine de quatre jours

Alors que les gouvernements peinent à gérer l’impact économique des machines superintelligentes, OpenAI a publié une série de propositions politiques décrivant comment la richesse et le travail pourra

OpenAI présente les grandes lignes d'une économie de l'IA fondée sur des fonds de richesse publique, une taxe sur les robots et la semaine de quatre jours

Alors que les gouvernements peinent à gérer l’impact économique des machines superintelligentes, OpenAI a publié une série de propositions politiques décrivant comment la richesse et le travail pourra

Greg Brockman révèle comment Elon Musk a quitté OpenAI

Fin août 2017, les principaux dirigeants d’OpenAI — alors un petit laboratoire de recherche à but non lucratif — se sont réunis pour discuter de la manière dont ils allaient créer une entité à but luc

Greg Brockman révèle comment Elon Musk a quitté OpenAI

Fin août 2017, les principaux dirigeants d’OpenAI — alors un petit laboratoire de recherche à but non lucratif — se sont réunis pour discuter de la manière dont ils allaient créer une entité à but luc

Le Pentagone signe des accords avec Nvidia, Microsoft et AWS pour déployer l’intelligence artificielle sur les réseaux classés.

Après avoir précédemment conclu des accords avec Google, SpaceX et OpenAI, le Département de la Défense américain a annoncé vendredi qu’il avait signé des contrats avec Nvidia, Microsoft, Amazon Web Services et Reflection AI pour mettre en œuvre leur

Le Pentagone signe des accords avec Nvidia, Microsoft et AWS pour déployer l’intelligence artificielle sur les réseaux classés.

Après avoir précédemment conclu des accords avec Google, SpaceX et OpenAI, le Département de la Défense américain a annoncé vendredi qu’il avait signé des contrats avec Nvidia, Microsoft, Amazon Web Services et Reflection AI pour mettre en œuvre leur

¡Vaya, qué sorpresa! 😮 Siempre pensé que ChatGPT era un monstruo energético, pero parece que no es tan malo. Me pregunto cómo se compara con otros modelos de IA en términos de eficiencia. ¿Habrá un ranking público pronto? Sería muy útil para los usuarios conscientes del medio ambiente.

Wow, ChatGPT’s energy use is lower than I thought! Still, it’s wild how much it varies by model and usage. Makes me wonder how sustainable scaling up AI will be in the long run. 🤔

Surprising to see ChatGPT's energy use isn't as bad as hyped! Still, makes me wonder how much power those massive AI models really burn through when we’re all chatting away. 🤔

A energia usada pelo ChatGPT é surpreendentemente baixa! Pensei que fosse um devorador de energia, mas não é tão ruim assim. Ainda assim, é louco como pode variar muito dependendo do modelo e do uso. Faz você pensar no futuro da IA, né? 🤔 Continuem o bom trabalho, OpenAI!

Maison

Maison