Uso de energia do ChatGPT mais baixo do que o esperado

ChatGPT, o chatbot da OpenAI, pode não ser o grande consumidor de energia que pensávamos. Mas, seu uso de energia pode variar muito dependendo de como é utilizado e quais modelos de IA estão respondendo às perguntas, de acordo com um novo estudo.

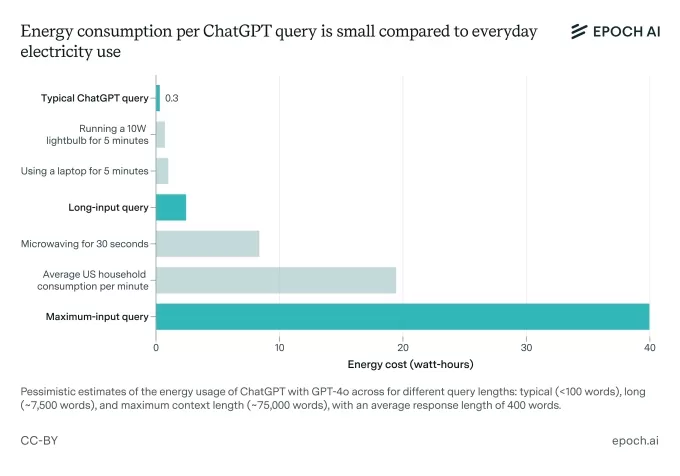

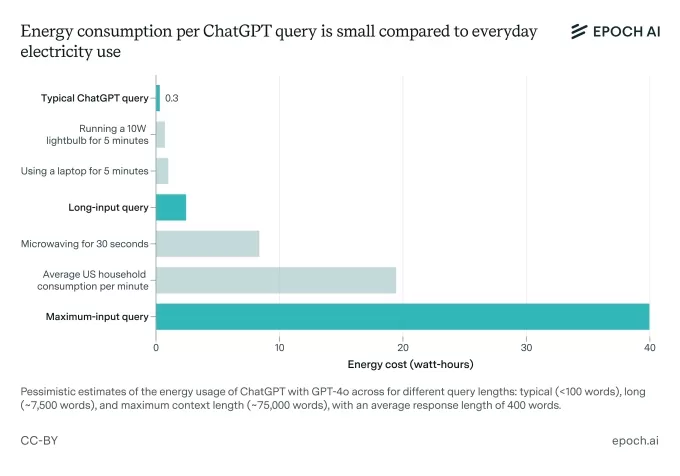

Epoch AI, um grupo de pesquisa sem fins lucrativos, tentou descobrir quanta energia uma consulta típica do ChatGPT consome. Você pode ter ouvido que o ChatGPT precisa de cerca de 3 watt-horas para responder a uma única pergunta, o que é 10 vezes mais que uma pesquisa no Google. Mas a Epoch acha que isso é um pouco exagerado.

Usando o modelo padrão mais recente da OpenAI, GPT-4o, como referência, a Epoch descobriu que a consulta média do ChatGPT usa cerca de 0,3 watt-horas. Isso é menos do que muitos eletrodomésticos precisam.

"O uso de energia realmente não é grande coisa comparado ao uso de eletrodomésticos comuns ou aquecimento ou resfriamento da sua casa, ou dirigir um carro," disse Joshua You, o analista de dados da Epoch que fez a análise, ao TechCrunch.

O uso de energia da IA, e seu impacto no meio ambiente, é um tema quente, já que as empresas de IA estão buscando expandir seus data centers de forma agressiva. Na última semana, mais de 100 organizações assinaram uma carta aberta pedindo à indústria de IA e aos reguladores que garantam que os novos data centers de IA não esgotem os recursos naturais e forcem as concessionárias a dependerem de fontes de energia não renováveis.

You disse ao TechCrunch que sua análise foi motivada pelo que ele considerou pesquisas desatualizadas. Ele apontou que o relatório que estimou 3 watt-horas por consulta presumia que a OpenAI estava usando chips mais antigos e menos eficientes para rodar seus modelos.

Créditos da imagem: Epoch AI "Eu vi muito discurso público que corretamente reconheceu que a IA consumiria muita energia nos próximos anos, mas não descreveu com precisão a energia que está sendo usada pela IA hoje," disse You. "Além disso, alguns dos meus colegas notaram que a estimativa mais amplamente reportada de 3 watt-horas por consulta era baseada em pesquisas bastante antigas, e com base em cálculos simples parecia ser muito alta."

Claro, a estimativa de 0,3 watt-horas da Epoch também é apenas uma estimativa. A OpenAI não compartilhou os detalhes necessários para fazer um cálculo preciso.

A análise também não leva em conta os custos extras de energia de recursos do ChatGPT, como geração de imagens ou processamento de entradas longas. You admitiu que consultas do ChatGPT com "entradas longas" — como aquelas com arquivos extensos anexados — provavelmente usam mais eletricidade de imediato do que uma pergunta típica.

You disse que espera que o consumo de energia base do ChatGPT aumente, no entanto.

"A IA ficará mais avançada, treinar essa IA provavelmente exigirá muito mais energia, e essa IA futura pode ser usada de forma muito mais intensa — lidando com muito mais tarefas, e tarefas mais complexas, do que como as pessoas usam o ChatGPT hoje," disse You.

Embora tenha havido alguns avanços interessantes na eficiência da IA ultimamente, espera-se que a escala em que a IA está sendo usada impulsione um enorme crescimento de infraestrutura faminta por energia. Nos próximos dois anos, os data centers de IA podem precisar de quase toda a capacidade de energia da Califórnia em 2022 (68 GW), segundo um relatório da Rand. Até 2030, treinar um modelo de ponta pode precisar de energia equivalente a oito reatores nucleares (8 GW), previu o relatório.

O ChatGPT sozinho alcança muitas pessoas, e esse número só está crescendo, o que significa que suas demandas por servidores são enormes. A OpenAI, junto com vários parceiros de investimento, planeja gastar bilhões em novos projetos de data centers de IA nos próximos anos.

O foco da OpenAI, junto com o resto da indústria de IA, está mudando para modelos de raciocínio. Esses modelos podem realizar mais tarefas, mas precisam de mais poder computacional para funcionar. Diferentemente de modelos como GPT-4o, que respondem às consultas quase instantaneamente, os modelos de raciocínio "pensam" por segundos a minutos antes de responder, o que consome mais poder computacional — e, portanto, mais energia.

"Modelos de raciocínio assumirão cada vez mais tarefas que modelos mais antigos não conseguem, e gerarão mais [dados] para isso, e ambos exigem mais data centers," disse You.

A OpenAI começou a lançar modelos de raciocínio mais eficientes em termos de energia, como o o3-mini. Mas parece improvável, pelo menos por enquanto, que esses ganhos de eficiência compensem as demandas de energia aumentadas do processo de "pensamento" dos modelos de raciocínio e do uso crescente de IA em todo o mundo.

You sugeriu que, se você está preocupado com sua pegada energética de IA, deve usar aplicativos como o ChatGPT com menos frequência, ou escolher modelos que usem menos poder computacional — se isso for possível.

"Você poderia tentar usar modelos de IA menores, como o GPT-4o-mini da OpenAI," disse You, "e usá-los com moderação, de uma maneira que exija processar ou gerar muitos dados."

Artigo relacionado

A OpenAI traça os contornos da economia da IA com fundos de riqueza pública, impostos sobre robôs e a semana de quatro dias

Enquanto os governos lutam para lidar com o impacto econômico das máquinas superinteligentes, a OpenAI divulgou um conjunto de propostas de políticas que delineiam como a riqueza e o trabalho poderiam

A OpenAI traça os contornos da economia da IA com fundos de riqueza pública, impostos sobre robôs e a semana de quatro dias

Enquanto os governos lutam para lidar com o impacto econômico das máquinas superinteligentes, a OpenAI divulgou um conjunto de propostas de políticas que delineiam como a riqueza e o trabalho poderiam

Greg Brockman revela como Elon Musk deixou a OpenAI

No final de agosto de 2017, figuras-chave da OpenAI — na época, um pequeno laboratório de pesquisa sem fins lucrativos — se reuniram para discutir como criariam uma entidade com fins lucrativos para c

Greg Brockman revela como Elon Musk deixou a OpenAI

No final de agosto de 2017, figuras-chave da OpenAI — na época, um pequeno laboratório de pesquisa sem fins lucrativos — se reuniram para discutir como criariam uma entidade com fins lucrativos para c

O Pentágono assinou acordos com a Nvidia, a Microsoft e a AWS para implementar inteligência artificial em redes confidenciais.

Após alcançar acordos anteriores com a Google, a SpaceX e a OpenAI, o Departamento de Defesa dos EUA anunciou na sexta-feira que assinou contratos com a Nvidia, a Microsoft, a Amazon Web Services e a Reflection AI para utilizar suas tecnologias e mod

Recomendações de tópicos especiais relacionados

Comentários (34)

O Pentágono assinou acordos com a Nvidia, a Microsoft e a AWS para implementar inteligência artificial em redes confidenciais.

Após alcançar acordos anteriores com a Google, a SpaceX e a OpenAI, o Departamento de Defesa dos EUA anunciou na sexta-feira que assinou contratos com a Nvidia, a Microsoft, a Amazon Web Services e a Reflection AI para utilizar suas tecnologias e mod

Recomendações de tópicos especiais relacionados

Comentários (34)

![PaulTaylor]()

¡Vaya, qué sorpresa! 😮 Siempre pensé que ChatGPT era un monstruo energético, pero parece que no es tan malo. Me pregunto cómo se compara con otros modelos de IA en términos de eficiencia. ¿Habrá un ranking público pronto? Sería muy útil para los usuarios conscientes del medio ambiente.

![PaulHill]()

Wow, ChatGPT’s energy use is lower than I thought! Still, it’s wild how much it varies by model and usage. Makes me wonder how sustainable scaling up AI will be in the long run. 🤔

![WillPerez]()

Surprising to see ChatGPT's energy use isn't as bad as hyped! Still, makes me wonder how much power those massive AI models really burn through when we’re all chatting away. 🤔

![CharlesRoberts]()

A energia usada pelo ChatGPT é surpreendentemente baixa! Pensei que fosse um devorador de energia, mas não é tão ruim assim. Ainda assim, é louco como pode variar muito dependendo do modelo e do uso. Faz você pensar no futuro da IA, né? 🤔 Continuem o bom trabalho, OpenAI!

ChatGPT, o chatbot da OpenAI, pode não ser o grande consumidor de energia que pensávamos. Mas, seu uso de energia pode variar muito dependendo de como é utilizado e quais modelos de IA estão respondendo às perguntas, de acordo com um novo estudo.

Epoch AI, um grupo de pesquisa sem fins lucrativos, tentou descobrir quanta energia uma consulta típica do ChatGPT consome. Você pode ter ouvido que o ChatGPT precisa de cerca de 3 watt-horas para responder a uma única pergunta, o que é 10 vezes mais que uma pesquisa no Google. Mas a Epoch acha que isso é um pouco exagerado.

Usando o modelo padrão mais recente da OpenAI, GPT-4o, como referência, a Epoch descobriu que a consulta média do ChatGPT usa cerca de 0,3 watt-horas. Isso é menos do que muitos eletrodomésticos precisam.

"O uso de energia realmente não é grande coisa comparado ao uso de eletrodomésticos comuns ou aquecimento ou resfriamento da sua casa, ou dirigir um carro," disse Joshua You, o analista de dados da Epoch que fez a análise, ao TechCrunch.

O uso de energia da IA, e seu impacto no meio ambiente, é um tema quente, já que as empresas de IA estão buscando expandir seus data centers de forma agressiva. Na última semana, mais de 100 organizações assinaram uma carta aberta pedindo à indústria de IA e aos reguladores que garantam que os novos data centers de IA não esgotem os recursos naturais e forcem as concessionárias a dependerem de fontes de energia não renováveis.

You disse ao TechCrunch que sua análise foi motivada pelo que ele considerou pesquisas desatualizadas. Ele apontou que o relatório que estimou 3 watt-horas por consulta presumia que a OpenAI estava usando chips mais antigos e menos eficientes para rodar seus modelos.

"Eu vi muito discurso público que corretamente reconheceu que a IA consumiria muita energia nos próximos anos, mas não descreveu com precisão a energia que está sendo usada pela IA hoje," disse You. "Além disso, alguns dos meus colegas notaram que a estimativa mais amplamente reportada de 3 watt-horas por consulta era baseada em pesquisas bastante antigas, e com base em cálculos simples parecia ser muito alta."

Claro, a estimativa de 0,3 watt-horas da Epoch também é apenas uma estimativa. A OpenAI não compartilhou os detalhes necessários para fazer um cálculo preciso.

A análise também não leva em conta os custos extras de energia de recursos do ChatGPT, como geração de imagens ou processamento de entradas longas. You admitiu que consultas do ChatGPT com "entradas longas" — como aquelas com arquivos extensos anexados — provavelmente usam mais eletricidade de imediato do que uma pergunta típica.

You disse que espera que o consumo de energia base do ChatGPT aumente, no entanto.

"A IA ficará mais avançada, treinar essa IA provavelmente exigirá muito mais energia, e essa IA futura pode ser usada de forma muito mais intensa — lidando com muito mais tarefas, e tarefas mais complexas, do que como as pessoas usam o ChatGPT hoje," disse You.

Embora tenha havido alguns avanços interessantes na eficiência da IA ultimamente, espera-se que a escala em que a IA está sendo usada impulsione um enorme crescimento de infraestrutura faminta por energia. Nos próximos dois anos, os data centers de IA podem precisar de quase toda a capacidade de energia da Califórnia em 2022 (68 GW), segundo um relatório da Rand. Até 2030, treinar um modelo de ponta pode precisar de energia equivalente a oito reatores nucleares (8 GW), previu o relatório.

O ChatGPT sozinho alcança muitas pessoas, e esse número só está crescendo, o que significa que suas demandas por servidores são enormes. A OpenAI, junto com vários parceiros de investimento, planeja gastar bilhões em novos projetos de data centers de IA nos próximos anos.

O foco da OpenAI, junto com o resto da indústria de IA, está mudando para modelos de raciocínio. Esses modelos podem realizar mais tarefas, mas precisam de mais poder computacional para funcionar. Diferentemente de modelos como GPT-4o, que respondem às consultas quase instantaneamente, os modelos de raciocínio "pensam" por segundos a minutos antes de responder, o que consome mais poder computacional — e, portanto, mais energia.

"Modelos de raciocínio assumirão cada vez mais tarefas que modelos mais antigos não conseguem, e gerarão mais [dados] para isso, e ambos exigem mais data centers," disse You.

A OpenAI começou a lançar modelos de raciocínio mais eficientes em termos de energia, como o o3-mini. Mas parece improvável, pelo menos por enquanto, que esses ganhos de eficiência compensem as demandas de energia aumentadas do processo de "pensamento" dos modelos de raciocínio e do uso crescente de IA em todo o mundo.

You sugeriu que, se você está preocupado com sua pegada energética de IA, deve usar aplicativos como o ChatGPT com menos frequência, ou escolher modelos que usem menos poder computacional — se isso for possível.

"Você poderia tentar usar modelos de IA menores, como o GPT-4o-mini da OpenAI," disse You, "e usá-los com moderação, de uma maneira que exija processar ou gerar muitos dados."

A OpenAI traça os contornos da economia da IA com fundos de riqueza pública, impostos sobre robôs e a semana de quatro dias

Enquanto os governos lutam para lidar com o impacto econômico das máquinas superinteligentes, a OpenAI divulgou um conjunto de propostas de políticas que delineiam como a riqueza e o trabalho poderiam

A OpenAI traça os contornos da economia da IA com fundos de riqueza pública, impostos sobre robôs e a semana de quatro dias

Enquanto os governos lutam para lidar com o impacto econômico das máquinas superinteligentes, a OpenAI divulgou um conjunto de propostas de políticas que delineiam como a riqueza e o trabalho poderiam

Greg Brockman revela como Elon Musk deixou a OpenAI

No final de agosto de 2017, figuras-chave da OpenAI — na época, um pequeno laboratório de pesquisa sem fins lucrativos — se reuniram para discutir como criariam uma entidade com fins lucrativos para c

Greg Brockman revela como Elon Musk deixou a OpenAI

No final de agosto de 2017, figuras-chave da OpenAI — na época, um pequeno laboratório de pesquisa sem fins lucrativos — se reuniram para discutir como criariam uma entidade com fins lucrativos para c

O Pentágono assinou acordos com a Nvidia, a Microsoft e a AWS para implementar inteligência artificial em redes confidenciais.

Após alcançar acordos anteriores com a Google, a SpaceX e a OpenAI, o Departamento de Defesa dos EUA anunciou na sexta-feira que assinou contratos com a Nvidia, a Microsoft, a Amazon Web Services e a Reflection AI para utilizar suas tecnologias e mod

O Pentágono assinou acordos com a Nvidia, a Microsoft e a AWS para implementar inteligência artificial em redes confidenciais.

Após alcançar acordos anteriores com a Google, a SpaceX e a OpenAI, o Departamento de Defesa dos EUA anunciou na sexta-feira que assinou contratos com a Nvidia, a Microsoft, a Amazon Web Services e a Reflection AI para utilizar suas tecnologias e mod

¡Vaya, qué sorpresa! 😮 Siempre pensé que ChatGPT era un monstruo energético, pero parece que no es tan malo. Me pregunto cómo se compara con otros modelos de IA en términos de eficiencia. ¿Habrá un ranking público pronto? Sería muy útil para los usuarios conscientes del medio ambiente.

Wow, ChatGPT’s energy use is lower than I thought! Still, it’s wild how much it varies by model and usage. Makes me wonder how sustainable scaling up AI will be in the long run. 🤔

Surprising to see ChatGPT's energy use isn't as bad as hyped! Still, makes me wonder how much power those massive AI models really burn through when we’re all chatting away. 🤔

A energia usada pelo ChatGPT é surpreendentemente baixa! Pensei que fosse um devorador de energia, mas não é tão ruim assim. Ainda assim, é louco como pode variar muito dependendo do modelo e do uso. Faz você pensar no futuro da IA, né? 🤔 Continuem o bom trabalho, OpenAI!

Lar

Lar