El uso de energía de ChatGPT más bajo de lo esperado

ChatGPT, el chatbot de OpenAI, podría no ser el devorador de energía que pensábamos. Sin embargo, su consumo de energía puede variar mucho dependiendo de cómo se use y qué modelos de IA respondan a las preguntas, según un nuevo estudio.

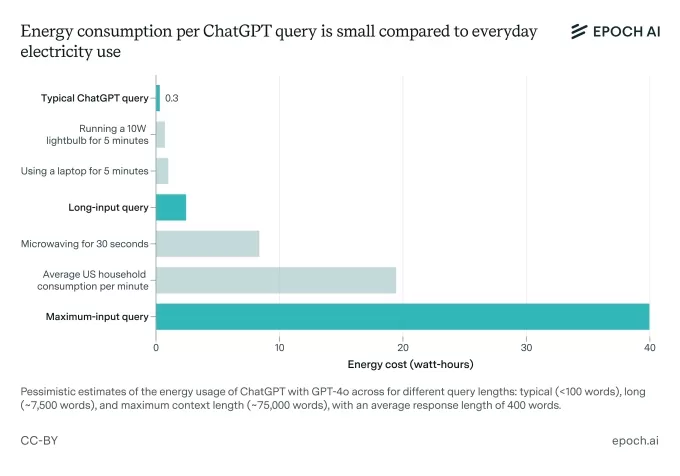

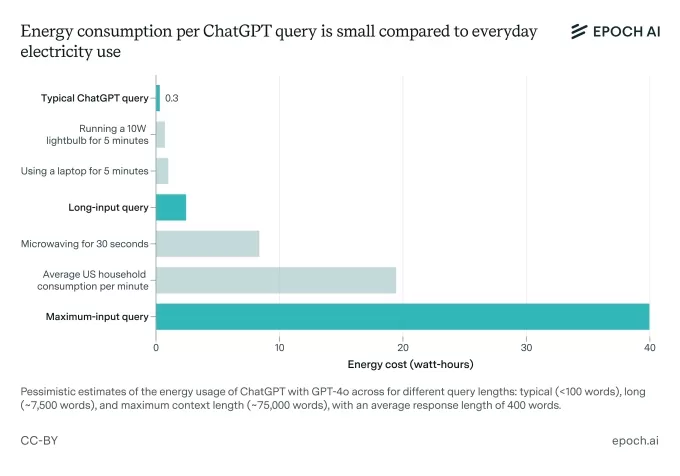

Epoch AI, un grupo de investigación sin fines de lucro, intentó calcular cuánta energía consume una consulta típica de ChatGPT. Es posible que hayas oído que ChatGPT necesita alrededor de 3 vatios-hora para responder una sola pregunta, lo que es 10 veces más que una búsqueda en Google. Pero Epoch cree que eso es un poco exagerado.

Usando el modelo predeterminado más reciente de OpenAI, GPT-4o, como referencia, Epoch descubrió que la consulta promedio de ChatGPT en realidad usa alrededor de 0.3 vatios-hora. Eso es menos de lo que necesitan muchos electrodomésticos.

"El consumo de energía realmente no es gran cosa en comparación con el uso de electrodomésticos normales o la calefacción o refrigeración de tu hogar, o conducir un coche," dijo Joshua You, el analista de datos de Epoch que realizó el análisis, a TechCrunch.

El consumo de energía de la IA y su impacto en el medio ambiente es un tema candente, ya que las empresas de IA buscan expandir sus centros de datos como locas. La semana pasada, más de 100 organizaciones firmaron una carta abierta instando a la industria de la IA y a los reguladores a asegurar que los nuevos centros de datos de IA no agoten los recursos naturales y obliguen a las empresas de servicios públicos a depender de fuentes de energía no renovables.

You le dijo a TechCrunch que su análisis fue motivado por lo que consideró una investigación desactualizada. Señaló que el informe que estimó los 3 vatios-hora asumía que OpenAI usaba chips más antiguos y menos eficientes para ejecutar sus modelos.

Créditos de la imagen: Epoch AI "He visto mucho discurso público que reconocía correctamente que la IA iba a consumir mucha energía en los próximos años, pero no describía con precisión la energía que se destina a la IA hoy," dijo You. "Además, algunos de mis colegas notaron que la estimación más ampliamente reportada de 3 vatios-hora por consulta se basaba en una investigación bastante antigua, y según algunos cálculos rápidos parecía ser demasiado alta."

Claro, la cifra de 0.3 vatios-hora de Epoch también es solo una estimación. OpenAI no ha compartido los detalles necesarios para hacer un cálculo preciso.

El análisis también no considera los costos energéticos adicionales de funciones de ChatGPT como la generación de imágenes o el procesamiento de entradas largas. You admitió que las consultas de ChatGPT con "entradas largas" —como aquellas con archivos largos adjuntos— probablemente usan más electricidad de inicio que una pregunta típica.

You dijo que sí espera que el consumo de energía base de ChatGPT aumente.

"La IA se volverá más avanzada, entrenar esta IA probablemente requerirá mucha más energía, y esta IA futura podría usarse de manera mucho más intensa —manejando muchas más tareas y tareas más complejas que como la gente usa ChatGPT hoy," dijo You.

Aunque ha habido algunos avances interesantes en la eficiencia de la IA recientemente, se espera que la escala en la que se usa la IA impulse un enorme crecimiento de infraestructura que consume mucha energía. En los próximos dos años, los centros de datos de IA podrían necesitar casi toda la capacidad de energía de California en 2022 (68 GW), según un informe de Rand. Para 2030, entrenar un modelo de vanguardia podría necesitar energía equivalente a ocho reactores nucleares (8 GW), predijo el informe.

ChatGPT por sí solo llega a un montón de personas, y ese número solo está creciendo, lo que significa que las demandas de sus servidores son enormes. OpenAI, junto con varios socios de inversión, planea gastar miles de millones en nuevos proyectos de centros de datos de IA en los próximos años.

El enfoque de OpenAI, junto con el resto de la industria de la IA, está cambiando hacia modelos de razonamiento. Estos modelos pueden realizar más tareas, pero necesitan más poder computacional para funcionar. A diferencia de modelos como GPT-4o, que responden consultas casi instantáneamente, los modelos de razonamiento "piensan" durante segundos o minutos antes de responder, lo que consume más poder computacional —y, por lo tanto, más energía.

"Los modelos de razonamiento asumirán cada vez más tareas que los modelos más antiguos no pueden, y generarán más [datos] para hacerlo, y ambos requieren más centros de datos," dijo You.

OpenAI ha comenzado a lanzar modelos de razonamiento más eficientes en consumo de energía como o3-mini. Pero parece poco probable, al menos por ahora, que estas ganancias de eficiencia compensen las mayores demandas de energía del proceso de "pensamiento" de los modelos de razonamiento y el creciente uso de la IA en todo el mundo.

You sugirió que si te preocupa tu huella energética de IA, deberías usar aplicaciones como ChatGPT con menos frecuencia o elegir modelos que usen menos poder computacional —si eso es posible.

"Podrías intentar usar modelos de IA más pequeños como [OpenAI's] GPT-4o-mini," dijo You, "y usarlos con moderación de una manera que requiera procesar o generar una gran cantidad de datos."

Artículo relacionado

OpenAI esboza la economía de la IA con fondos de riqueza pública, impuestos sobre los robots y la semana laboral de cuatro días

Mientras los gobiernos se esfuerzan por gestionar el impacto económico de las máquinas superinteligentes, OpenAI ha publicado una serie de propuestas políticas en las que se esboza cómo podrían reconf

OpenAI esboza la economía de la IA con fondos de riqueza pública, impuestos sobre los robots y la semana laboral de cuatro días

Mientras los gobiernos se esfuerzan por gestionar el impacto económico de las máquinas superinteligentes, OpenAI ha publicado una serie de propuestas políticas en las que se esboza cómo podrían reconf

Greg Brockman desvela cómo Elon Musk abandonó OpenAI

A finales de agosto de 2017, las figuras clave de OpenAI —por entonces un pequeño laboratorio de investigación sin ánimo de lucro— se reunieron para debatir cómo crearían una entidad con fines lucrati

Greg Brockman desvela cómo Elon Musk abandonó OpenAI

A finales de agosto de 2017, las figuras clave de OpenAI —por entonces un pequeño laboratorio de investigación sin ánimo de lucro— se reunieron para debatir cómo crearían una entidad con fines lucrati

El Pentágono firma acuerdos con Nvidia, Microsoft y AWS para implementar inteligencia artificial en redes clasificadas.

Después de haber alcanzado acuerdos previamente con Google, SpaceX y OpenAI, el Departamento de Defensa de los Estados Unidos anunció el viernes que ha firmado contratos con Nvidia, Microsoft, Amazon Web Services y Reflection AI para utilizar sus tec

Recomendaciones de temas especiales relacionados

comentario (34)

0/500

El Pentágono firma acuerdos con Nvidia, Microsoft y AWS para implementar inteligencia artificial en redes clasificadas.

Después de haber alcanzado acuerdos previamente con Google, SpaceX y OpenAI, el Departamento de Defensa de los Estados Unidos anunció el viernes que ha firmado contratos con Nvidia, Microsoft, Amazon Web Services y Reflection AI para utilizar sus tec

Recomendaciones de temas especiales relacionados

comentario (34)

0/500

![PaulTaylor]()

¡Vaya, qué sorpresa! 😮 Siempre pensé que ChatGPT era un monstruo energético, pero parece que no es tan malo. Me pregunto cómo se compara con otros modelos de IA en términos de eficiencia. ¿Habrá un ranking público pronto? Sería muy útil para los usuarios conscientes del medio ambiente.

![PaulHill]()

Wow, ChatGPT’s energy use is lower than I thought! Still, it’s wild how much it varies by model and usage. Makes me wonder how sustainable scaling up AI will be in the long run. 🤔

![WillPerez]()

Surprising to see ChatGPT's energy use isn't as bad as hyped! Still, makes me wonder how much power those massive AI models really burn through when we’re all chatting away. 🤔

![CharlesRoberts]()

A energia usada pelo ChatGPT é surpreendentemente baixa! Pensei que fosse um devorador de energia, mas não é tão ruim assim. Ainda assim, é louco como pode variar muito dependendo do modelo e do uso. Faz você pensar no futuro da IA, né? 🤔 Continuem o bom trabalho, OpenAI!

ChatGPT, el chatbot de OpenAI, podría no ser el devorador de energía que pensábamos. Sin embargo, su consumo de energía puede variar mucho dependiendo de cómo se use y qué modelos de IA respondan a las preguntas, según un nuevo estudio.

Epoch AI, un grupo de investigación sin fines de lucro, intentó calcular cuánta energía consume una consulta típica de ChatGPT. Es posible que hayas oído que ChatGPT necesita alrededor de 3 vatios-hora para responder una sola pregunta, lo que es 10 veces más que una búsqueda en Google. Pero Epoch cree que eso es un poco exagerado.

Usando el modelo predeterminado más reciente de OpenAI, GPT-4o, como referencia, Epoch descubrió que la consulta promedio de ChatGPT en realidad usa alrededor de 0.3 vatios-hora. Eso es menos de lo que necesitan muchos electrodomésticos.

"El consumo de energía realmente no es gran cosa en comparación con el uso de electrodomésticos normales o la calefacción o refrigeración de tu hogar, o conducir un coche," dijo Joshua You, el analista de datos de Epoch que realizó el análisis, a TechCrunch.

El consumo de energía de la IA y su impacto en el medio ambiente es un tema candente, ya que las empresas de IA buscan expandir sus centros de datos como locas. La semana pasada, más de 100 organizaciones firmaron una carta abierta instando a la industria de la IA y a los reguladores a asegurar que los nuevos centros de datos de IA no agoten los recursos naturales y obliguen a las empresas de servicios públicos a depender de fuentes de energía no renovables.

You le dijo a TechCrunch que su análisis fue motivado por lo que consideró una investigación desactualizada. Señaló que el informe que estimó los 3 vatios-hora asumía que OpenAI usaba chips más antiguos y menos eficientes para ejecutar sus modelos.

"He visto mucho discurso público que reconocía correctamente que la IA iba a consumir mucha energía en los próximos años, pero no describía con precisión la energía que se destina a la IA hoy," dijo You. "Además, algunos de mis colegas notaron que la estimación más ampliamente reportada de 3 vatios-hora por consulta se basaba en una investigación bastante antigua, y según algunos cálculos rápidos parecía ser demasiado alta."

Claro, la cifra de 0.3 vatios-hora de Epoch también es solo una estimación. OpenAI no ha compartido los detalles necesarios para hacer un cálculo preciso.

El análisis también no considera los costos energéticos adicionales de funciones de ChatGPT como la generación de imágenes o el procesamiento de entradas largas. You admitió que las consultas de ChatGPT con "entradas largas" —como aquellas con archivos largos adjuntos— probablemente usan más electricidad de inicio que una pregunta típica.

You dijo que sí espera que el consumo de energía base de ChatGPT aumente.

"La IA se volverá más avanzada, entrenar esta IA probablemente requerirá mucha más energía, y esta IA futura podría usarse de manera mucho más intensa —manejando muchas más tareas y tareas más complejas que como la gente usa ChatGPT hoy," dijo You.

Aunque ha habido algunos avances interesantes en la eficiencia de la IA recientemente, se espera que la escala en la que se usa la IA impulse un enorme crecimiento de infraestructura que consume mucha energía. En los próximos dos años, los centros de datos de IA podrían necesitar casi toda la capacidad de energía de California en 2022 (68 GW), según un informe de Rand. Para 2030, entrenar un modelo de vanguardia podría necesitar energía equivalente a ocho reactores nucleares (8 GW), predijo el informe.

ChatGPT por sí solo llega a un montón de personas, y ese número solo está creciendo, lo que significa que las demandas de sus servidores son enormes. OpenAI, junto con varios socios de inversión, planea gastar miles de millones en nuevos proyectos de centros de datos de IA en los próximos años.

El enfoque de OpenAI, junto con el resto de la industria de la IA, está cambiando hacia modelos de razonamiento. Estos modelos pueden realizar más tareas, pero necesitan más poder computacional para funcionar. A diferencia de modelos como GPT-4o, que responden consultas casi instantáneamente, los modelos de razonamiento "piensan" durante segundos o minutos antes de responder, lo que consume más poder computacional —y, por lo tanto, más energía.

"Los modelos de razonamiento asumirán cada vez más tareas que los modelos más antiguos no pueden, y generarán más [datos] para hacerlo, y ambos requieren más centros de datos," dijo You.

OpenAI ha comenzado a lanzar modelos de razonamiento más eficientes en consumo de energía como o3-mini. Pero parece poco probable, al menos por ahora, que estas ganancias de eficiencia compensen las mayores demandas de energía del proceso de "pensamiento" de los modelos de razonamiento y el creciente uso de la IA en todo el mundo.

You sugirió que si te preocupa tu huella energética de IA, deberías usar aplicaciones como ChatGPT con menos frecuencia o elegir modelos que usen menos poder computacional —si eso es posible.

"Podrías intentar usar modelos de IA más pequeños como [OpenAI's] GPT-4o-mini," dijo You, "y usarlos con moderación de una manera que requiera procesar o generar una gran cantidad de datos."

OpenAI esboza la economía de la IA con fondos de riqueza pública, impuestos sobre los robots y la semana laboral de cuatro días

Mientras los gobiernos se esfuerzan por gestionar el impacto económico de las máquinas superinteligentes, OpenAI ha publicado una serie de propuestas políticas en las que se esboza cómo podrían reconf

OpenAI esboza la economía de la IA con fondos de riqueza pública, impuestos sobre los robots y la semana laboral de cuatro días

Mientras los gobiernos se esfuerzan por gestionar el impacto económico de las máquinas superinteligentes, OpenAI ha publicado una serie de propuestas políticas en las que se esboza cómo podrían reconf

Greg Brockman desvela cómo Elon Musk abandonó OpenAI

A finales de agosto de 2017, las figuras clave de OpenAI —por entonces un pequeño laboratorio de investigación sin ánimo de lucro— se reunieron para debatir cómo crearían una entidad con fines lucrati

Greg Brockman desvela cómo Elon Musk abandonó OpenAI

A finales de agosto de 2017, las figuras clave de OpenAI —por entonces un pequeño laboratorio de investigación sin ánimo de lucro— se reunieron para debatir cómo crearían una entidad con fines lucrati

El Pentágono firma acuerdos con Nvidia, Microsoft y AWS para implementar inteligencia artificial en redes clasificadas.

Después de haber alcanzado acuerdos previamente con Google, SpaceX y OpenAI, el Departamento de Defensa de los Estados Unidos anunció el viernes que ha firmado contratos con Nvidia, Microsoft, Amazon Web Services y Reflection AI para utilizar sus tec

El Pentágono firma acuerdos con Nvidia, Microsoft y AWS para implementar inteligencia artificial en redes clasificadas.

Después de haber alcanzado acuerdos previamente con Google, SpaceX y OpenAI, el Departamento de Defensa de los Estados Unidos anunció el viernes que ha firmado contratos con Nvidia, Microsoft, Amazon Web Services y Reflection AI para utilizar sus tec

¡Vaya, qué sorpresa! 😮 Siempre pensé que ChatGPT era un monstruo energético, pero parece que no es tan malo. Me pregunto cómo se compara con otros modelos de IA en términos de eficiencia. ¿Habrá un ranking público pronto? Sería muy útil para los usuarios conscientes del medio ambiente.

Wow, ChatGPT’s energy use is lower than I thought! Still, it’s wild how much it varies by model and usage. Makes me wonder how sustainable scaling up AI will be in the long run. 🤔

Surprising to see ChatGPT's energy use isn't as bad as hyped! Still, makes me wonder how much power those massive AI models really burn through when we’re all chatting away. 🤔

A energia usada pelo ChatGPT é surpreendentemente baixa! Pensei que fosse um devorador de energia, mas não é tão ruim assim. Ainda assim, é louco como pode variar muito dependendo do modelo e do uso. Faz você pensar no futuro da IA, né? 🤔 Continuem o bom trabalho, OpenAI!

Hogar

Hogar