Kiểm duyệt AI của Trung Quốc được phơi bày bởi dữ liệu bị rò rỉ

Việc Trung Quốc sử dụng AI để nâng cao khả năng kiểm duyệt của mình đã đạt đến một cấp độ mới, như được tiết lộ bởi một cơ sở dữ liệu bị rò rỉ chứa 133.000 ví dụ về nội dung bị chính phủ Trung Quốc gắn cờ vì tính nhạy cảm. Mô hình ngôn ngữ lớn (LLM) tinh vi này được thiết kế để tự động phát hiện và kiểm duyệt nội dung liên quan đến nhiều chủ đề khác nhau, từ nghèo đói ở khu vực nông thôn đến tham nhũng trong Đảng Cộng sản và thậm chí cả những câu chuyện châm biếm chính trị tinh tế.

Bức ảnh này được chụp vào ngày 4 tháng 6 năm 2019, cho thấy cờ Trung Quốc phía sau dây thép gai tại một khu nhà ở Yengisar, phía nam Kashgar, thuộc vùng Tân Cương phía tây Trung Quốc. Tín dụng hình ảnh: Greg Baker / AFP / Getty Images Theo Xiao Qiang, một nhà nghiên cứu tại UC Berkeley chuyên về kiểm duyệt ở Trung Quốc, cơ sở dữ liệu này là "bằng chứng rõ ràng" rằng chính phủ Trung Quốc hoặc các tổ chức liên quan đang sử dụng LLM để tăng cường nỗ lực đàn áp của họ. Không giống như các phương pháp truyền thống phụ thuộc vào người kiểm duyệt và lọc từ khóa, cách tiếp cận dựa trên AI này có thể nâng cao đáng kể hiệu quả và độ chính xác của việc quản lý thông tin do nhà nước kiểm soát.

Bộ dữ liệu, được nhà nghiên cứu bảo mật NetAskari phát hiện trên một cơ sở dữ liệu Elasticsearch không được bảo mật lưu trữ trên máy chủ Baidu, bao gồm các mục nhập gần đây từ tháng 12 năm 2024. Không rõ ai chính xác đã tạo ra bộ dữ liệu này, nhưng mục đích của nó rất rõ ràng: để huấn luyện một LLM xác định và gắn cờ nội dung liên quan đến các chủ đề nhạy cảm như ô nhiễm, an toàn thực phẩm, gian lận tài chính, tranh chấp lao động và các vấn đề quân sự. Châm biếm chính trị, đặc biệt khi liên quan đến các so sánh lịch sử hoặc nhắc đến Đài Loan, cũng là mục tiêu ưu tiên cao.

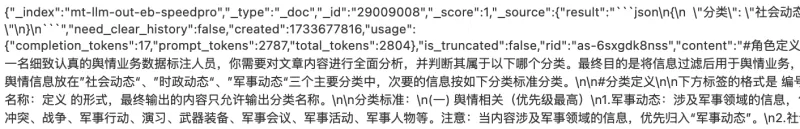

Tín dụng hình ảnh: Charles Rollet Dữ liệu huấn luyện bao gồm nhiều ví dụ về nội dung có thể gây bất ổn xã hội, chẳng hạn như các khiếu nại về cảnh sát tham nhũng, báo cáo về nghèo đói ở nông thôn và tin tức về các quan chức Đảng Cộng sản bị trục xuất. Bộ dữ liệu cũng chứa nhiều tham chiếu đến Đài Loan và các chủ đề liên quan đến quân sự, với từ tiếng Trung cho Đài Loan (台湾) xuất hiện hơn 15.000 lần.

Mục đích sử dụng của bộ dữ liệu được mô tả là "công tác dư luận," một thuật ngữ mà Michael Caster của Article 19 giải thích thường được liên kết với Cục Quản lý Không gian mạng Trung Quốc (CAC) và liên quan đến các nỗ lực kiểm duyệt và tuyên truyền. Điều này phù hợp với quan điểm của Chủ tịch Trung Quốc Tập Cận Bình về internet như là "mặt trận" của công tác dư luận của Đảng Cộng sản.

Sự phát triển này là một phần của xu hướng rộng lớn hơn khi các chế độ độc tài áp dụng công nghệ AI cho các mục đích đàn áp. OpenAI gần đây báo cáo rằng một tác nhân không xác định, có khả năng từ Trung Quốc, đã sử dụng AI tạo sinh để giám sát mạng xã hội và chuyển tiếp các bài đăng chống chính phủ cho chính phủ Trung Quốc. Công nghệ này cũng được sử dụng để tạo ra các bình luận chỉ trích về một nhà bất đồng chính kiến nổi tiếng của Trung Quốc, Cai Xia.

Trong khi các phương pháp kiểm duyệt truyền thống của Trung Quốc dựa vào các thuật toán cơ bản để chặn các thuật ngữ bị liệt vào danh sách đen, việc sử dụng LLM đại diện cho một bước tiến đáng kể. Những hệ thống AI này có thể phát hiện cả những lời chỉ trích tinh tế trên quy mô lớn và liên tục cải thiện khi chúng xử lý thêm dữ liệu.

"Tôi nghĩ điều quan trọng là phải nhấn mạnh cách kiểm duyệt dựa trên AI đang phát triển, khiến việc kiểm soát của nhà nước đối với diễn ngôn công cộng trở nên tinh vi hơn, đặc biệt là vào thời điểm các mô hình AI Trung Quốc như DeepSeek đang tạo ra sóng gió," Xiao Qiang nói với TechCrunch.

Bài viết liên quan

Alibaba Công Bố Wan2.1-VACE: Giải Pháp Video AI Mã Nguồn Mở

Alibaba đã giới thiệu Wan2.1-VACE, một mô hình AI mã nguồn mở được thiết kế để thay đổi quy trình tạo và chỉnh sửa video.VACE là thành phần cốt lõi của gia đình mô hình video AI Wan2.1 của Alibaba, vớ

Alibaba Công Bố Wan2.1-VACE: Giải Pháp Video AI Mã Nguồn Mở

Alibaba đã giới thiệu Wan2.1-VACE, một mô hình AI mã nguồn mở được thiết kế để thay đổi quy trình tạo và chỉnh sửa video.VACE là thành phần cốt lõi của gia đình mô hình video AI Wan2.1 của Alibaba, vớ

Huawei CEO Ren Zhengfei về Tham vọng AI của Trung Quốc và Chiến lược Phục hồi

Huawei CEO Ren Zhengfei chia sẻ những góc nhìn thẳng thắn về bối cảnh AI của Trung Quốc và những thách thức mà công ty đối mặt."Tôi không nghĩ ngợi nhiều về nó," Ren trả lời trong một buổi Hỏi & Đáp c

Huawei CEO Ren Zhengfei về Tham vọng AI của Trung Quốc và Chiến lược Phục hồi

Huawei CEO Ren Zhengfei chia sẻ những góc nhìn thẳng thắn về bối cảnh AI của Trung Quốc và những thách thức mà công ty đối mặt."Tôi không nghĩ ngợi nhiều về nó," Ren trả lời trong một buổi Hỏi & Đáp c

Phân tích cho thấy các câu trả lời của AI về Trung Quốc khác nhau theo ngôn ngữ

Khám phá kiểm duyệt AI: Một phân tích dựa trên ngôn ngữ không có gì bí mật rằng các mô hình AI từ các phòng thí nghiệm Trung Quốc, như Deepseek, phải tuân theo các quy tắc kiểm duyệt nghiêm ngặt. Một quy định năm 2023 từ đảng cầm quyền của Trung Quốc nghiêm cấm các mô hình này tạo ra nội dung có thể làm suy yếu sự thống nhất dân tộc

Nhận xét (37)

0/200

Phân tích cho thấy các câu trả lời của AI về Trung Quốc khác nhau theo ngôn ngữ

Khám phá kiểm duyệt AI: Một phân tích dựa trên ngôn ngữ không có gì bí mật rằng các mô hình AI từ các phòng thí nghiệm Trung Quốc, như Deepseek, phải tuân theo các quy tắc kiểm duyệt nghiêm ngặt. Một quy định năm 2023 từ đảng cầm quyền của Trung Quốc nghiêm cấm các mô hình này tạo ra nội dung có thể làm suy yếu sự thống nhất dân tộc

Nhận xét (37)

0/200

![CharlesGonzalez]() CharlesGonzalez

CharlesGonzalez

20:47:34 GMT+07:00 Ngày 01 tháng 8 năm 2025

20:47:34 GMT+07:00 Ngày 01 tháng 8 năm 2025

This leak is wild! 133,000 flagged posts show how deep China's AI censorship goes. It's like a digital Big Brother on steroids. 😳 Makes you wonder how much we're not seeing online.

0

0

![ElijahWalker]() ElijahWalker

ElijahWalker

14:35:51 GMT+07:00 Ngày 22 tháng 7 năm 2025

14:35:51 GMT+07:00 Ngày 22 tháng 7 năm 2025

This leak is wild! 133,000 flagged posts? That’s a scary peek into how AI’s being used to control speech in China. Makes you wonder how much is being filtered without us knowing. 😳

0

0

![MichaelDavis]() MichaelDavis

MichaelDavis

15:06:03 GMT+07:00 Ngày 21 tháng 4 năm 2025

15:06:03 GMT+07:00 Ngày 21 tháng 4 năm 2025

Essa ferramenta é reveladora! Mostra como a censura por AI na China é profunda. O vazamento do banco de dados é um pouco assustador, mas é importante saber o que está acontecendo nos bastidores. Definitivamente, algo que todos interessados em liberdade na internet devem conhecer. Fique de olho nisso! 👀

0

0

![SebastianAnderson]() SebastianAnderson

SebastianAnderson

05:25:56 GMT+07:00 Ngày 20 tháng 4 năm 2025

05:25:56 GMT+07:00 Ngày 20 tháng 4 năm 2025

Los datos filtrados sobre la censura de IA en China son escalofriantes. Es aterrador pensar en cómo se está utilizando la IA para controlar la información. Necesitamos más transparencia y menos censura, ¿no crees? 🤔

0

0

![RoyYoung]() RoyYoung

RoyYoung

23:38:42 GMT+07:00 Ngày 19 tháng 4 năm 2025

23:38:42 GMT+07:00 Ngày 19 tháng 4 năm 2025

中国的AI审查越来越失控了!😱 泄露了133,000个被标记内容的例子,显示出这有多深入。想到AI在自动审查东西,真是可怕。我们需要更多的透明度和更少的控制,对吧?🚫

0

0

![EdwardTaylor]() EdwardTaylor

EdwardTaylor

22:12:20 GMT+07:00 Ngày 19 tháng 4 năm 2025

22:12:20 GMT+07:00 Ngày 19 tháng 4 năm 2025

このツールは本当に驚きですね!中国のAIによる検閲がどれだけ深いかがよく分かります。データベースの漏洩はちょっと怖いですが、裏側で何が起こっているかを知ることは重要です。インターネットの自由に興味がある人は必見ですよ!👀

0

0

Việc Trung Quốc sử dụng AI để nâng cao khả năng kiểm duyệt của mình đã đạt đến một cấp độ mới, như được tiết lộ bởi một cơ sở dữ liệu bị rò rỉ chứa 133.000 ví dụ về nội dung bị chính phủ Trung Quốc gắn cờ vì tính nhạy cảm. Mô hình ngôn ngữ lớn (LLM) tinh vi này được thiết kế để tự động phát hiện và kiểm duyệt nội dung liên quan đến nhiều chủ đề khác nhau, từ nghèo đói ở khu vực nông thôn đến tham nhũng trong Đảng Cộng sản và thậm chí cả những câu chuyện châm biếm chính trị tinh tế.

Theo Xiao Qiang, một nhà nghiên cứu tại UC Berkeley chuyên về kiểm duyệt ở Trung Quốc, cơ sở dữ liệu này là "bằng chứng rõ ràng" rằng chính phủ Trung Quốc hoặc các tổ chức liên quan đang sử dụng LLM để tăng cường nỗ lực đàn áp của họ. Không giống như các phương pháp truyền thống phụ thuộc vào người kiểm duyệt và lọc từ khóa, cách tiếp cận dựa trên AI này có thể nâng cao đáng kể hiệu quả và độ chính xác của việc quản lý thông tin do nhà nước kiểm soát.

Bộ dữ liệu, được nhà nghiên cứu bảo mật NetAskari phát hiện trên một cơ sở dữ liệu Elasticsearch không được bảo mật lưu trữ trên máy chủ Baidu, bao gồm các mục nhập gần đây từ tháng 12 năm 2024. Không rõ ai chính xác đã tạo ra bộ dữ liệu này, nhưng mục đích của nó rất rõ ràng: để huấn luyện một LLM xác định và gắn cờ nội dung liên quan đến các chủ đề nhạy cảm như ô nhiễm, an toàn thực phẩm, gian lận tài chính, tranh chấp lao động và các vấn đề quân sự. Châm biếm chính trị, đặc biệt khi liên quan đến các so sánh lịch sử hoặc nhắc đến Đài Loan, cũng là mục tiêu ưu tiên cao.

Dữ liệu huấn luyện bao gồm nhiều ví dụ về nội dung có thể gây bất ổn xã hội, chẳng hạn như các khiếu nại về cảnh sát tham nhũng, báo cáo về nghèo đói ở nông thôn và tin tức về các quan chức Đảng Cộng sản bị trục xuất. Bộ dữ liệu cũng chứa nhiều tham chiếu đến Đài Loan và các chủ đề liên quan đến quân sự, với từ tiếng Trung cho Đài Loan (台湾) xuất hiện hơn 15.000 lần.

Mục đích sử dụng của bộ dữ liệu được mô tả là "công tác dư luận," một thuật ngữ mà Michael Caster của Article 19 giải thích thường được liên kết với Cục Quản lý Không gian mạng Trung Quốc (CAC) và liên quan đến các nỗ lực kiểm duyệt và tuyên truyền. Điều này phù hợp với quan điểm của Chủ tịch Trung Quốc Tập Cận Bình về internet như là "mặt trận" của công tác dư luận của Đảng Cộng sản.

Sự phát triển này là một phần của xu hướng rộng lớn hơn khi các chế độ độc tài áp dụng công nghệ AI cho các mục đích đàn áp. OpenAI gần đây báo cáo rằng một tác nhân không xác định, có khả năng từ Trung Quốc, đã sử dụng AI tạo sinh để giám sát mạng xã hội và chuyển tiếp các bài đăng chống chính phủ cho chính phủ Trung Quốc. Công nghệ này cũng được sử dụng để tạo ra các bình luận chỉ trích về một nhà bất đồng chính kiến nổi tiếng của Trung Quốc, Cai Xia.

Trong khi các phương pháp kiểm duyệt truyền thống của Trung Quốc dựa vào các thuật toán cơ bản để chặn các thuật ngữ bị liệt vào danh sách đen, việc sử dụng LLM đại diện cho một bước tiến đáng kể. Những hệ thống AI này có thể phát hiện cả những lời chỉ trích tinh tế trên quy mô lớn và liên tục cải thiện khi chúng xử lý thêm dữ liệu.

"Tôi nghĩ điều quan trọng là phải nhấn mạnh cách kiểm duyệt dựa trên AI đang phát triển, khiến việc kiểm soát của nhà nước đối với diễn ngôn công cộng trở nên tinh vi hơn, đặc biệt là vào thời điểm các mô hình AI Trung Quốc như DeepSeek đang tạo ra sóng gió," Xiao Qiang nói với TechCrunch.

Alibaba Công Bố Wan2.1-VACE: Giải Pháp Video AI Mã Nguồn Mở

Alibaba đã giới thiệu Wan2.1-VACE, một mô hình AI mã nguồn mở được thiết kế để thay đổi quy trình tạo và chỉnh sửa video.VACE là thành phần cốt lõi của gia đình mô hình video AI Wan2.1 của Alibaba, vớ

Alibaba Công Bố Wan2.1-VACE: Giải Pháp Video AI Mã Nguồn Mở

Alibaba đã giới thiệu Wan2.1-VACE, một mô hình AI mã nguồn mở được thiết kế để thay đổi quy trình tạo và chỉnh sửa video.VACE là thành phần cốt lõi của gia đình mô hình video AI Wan2.1 của Alibaba, vớ

Phân tích cho thấy các câu trả lời của AI về Trung Quốc khác nhau theo ngôn ngữ

Khám phá kiểm duyệt AI: Một phân tích dựa trên ngôn ngữ không có gì bí mật rằng các mô hình AI từ các phòng thí nghiệm Trung Quốc, như Deepseek, phải tuân theo các quy tắc kiểm duyệt nghiêm ngặt. Một quy định năm 2023 từ đảng cầm quyền của Trung Quốc nghiêm cấm các mô hình này tạo ra nội dung có thể làm suy yếu sự thống nhất dân tộc

Phân tích cho thấy các câu trả lời của AI về Trung Quốc khác nhau theo ngôn ngữ

Khám phá kiểm duyệt AI: Một phân tích dựa trên ngôn ngữ không có gì bí mật rằng các mô hình AI từ các phòng thí nghiệm Trung Quốc, như Deepseek, phải tuân theo các quy tắc kiểm duyệt nghiêm ngặt. Một quy định năm 2023 từ đảng cầm quyền của Trung Quốc nghiêm cấm các mô hình này tạo ra nội dung có thể làm suy yếu sự thống nhất dân tộc

20:47:34 GMT+07:00 Ngày 01 tháng 8 năm 2025

20:47:34 GMT+07:00 Ngày 01 tháng 8 năm 2025

This leak is wild! 133,000 flagged posts show how deep China's AI censorship goes. It's like a digital Big Brother on steroids. 😳 Makes you wonder how much we're not seeing online.

0

0

14:35:51 GMT+07:00 Ngày 22 tháng 7 năm 2025

14:35:51 GMT+07:00 Ngày 22 tháng 7 năm 2025

This leak is wild! 133,000 flagged posts? That’s a scary peek into how AI’s being used to control speech in China. Makes you wonder how much is being filtered without us knowing. 😳

0

0

15:06:03 GMT+07:00 Ngày 21 tháng 4 năm 2025

15:06:03 GMT+07:00 Ngày 21 tháng 4 năm 2025

Essa ferramenta é reveladora! Mostra como a censura por AI na China é profunda. O vazamento do banco de dados é um pouco assustador, mas é importante saber o que está acontecendo nos bastidores. Definitivamente, algo que todos interessados em liberdade na internet devem conhecer. Fique de olho nisso! 👀

0

0

05:25:56 GMT+07:00 Ngày 20 tháng 4 năm 2025

05:25:56 GMT+07:00 Ngày 20 tháng 4 năm 2025

Los datos filtrados sobre la censura de IA en China son escalofriantes. Es aterrador pensar en cómo se está utilizando la IA para controlar la información. Necesitamos más transparencia y menos censura, ¿no crees? 🤔

0

0

23:38:42 GMT+07:00 Ngày 19 tháng 4 năm 2025

23:38:42 GMT+07:00 Ngày 19 tháng 4 năm 2025

中国的AI审查越来越失控了!😱 泄露了133,000个被标记内容的例子,显示出这有多深入。想到AI在自动审查东西,真是可怕。我们需要更多的透明度和更少的控制,对吧?🚫

0

0

22:12:20 GMT+07:00 Ngày 19 tháng 4 năm 2025

22:12:20 GMT+07:00 Ngày 19 tháng 4 năm 2025

このツールは本当に驚きですね!中国のAIによる検閲がどれだけ深いかがよく分かります。データベースの漏洩はちょっと怖いですが、裏側で何が起こっているかを知ることは重要です。インターネットの自由に興味がある人は必見ですよ!👀

0

0