CHATGPT сталкивается с жалобой на конфиденциальность из -за клеветнических ошибок

OpenAI снова оказался в центре скандала в Европе, на этот раз из-за привычки его ИИ-чатбота распространять ложную информацию. Эта последняя жалоба на конфиденциальность, поддержанная адвокатской группой Noyb, возможно, станет той, которую регуляторы не смогут проигнорировать.

Жалоба связана с тревожным инцидентом в Норвегии, где ChatGPT ложно заявил, что человек по имени Арве Хьялмар Холмен был осуждён за убийство двоих своих детей и попытку убийства третьего. Эта шокирующая выдумка потрясла местное сообщество.

Предыдущие жалобы на неточности ChatGPT касались мелких деталей, таких как неверные даты рождения или биографические ошибки. Основная проблема заключается в том, что OpenAI не позволяет людям исправлять ложную информацию, сгенерированную о них. Вместо этого OpenAI часто блокирует ответы на определённые запросы. Однако согласно Общему регламенту по защите данных (GDPR) Европейского Союза, европейцы имеют право на исправление персональных данных.

GDPR также обязывает контролёров данных обеспечивать точность генерируемых персональных данных. Noyb подчёркивает это требование в своей последней жалобе против ChatGPT.

Йоаким Сёдерберг, юрист по защите данных в Noyb, подчеркнул: «GDPR ясен. Персональные данные должны быть точными. Если они неточны, пользователи имеют право исправить их, чтобы они соответствовали правде. Показывать пользователям ChatGPT маленький дисклеймер о том, что чатбот может ошибаться, явно недостаточно. Нельзя просто распространять ложную информацию и в конце добавлять маленький дисклеймер, что всё сказанное может быть неправдой».

Нарушение GDPR может привести к крупным штрафам, до 4% от годового глобального оборота компании. Меры принуждения также могут привести к изменениям в продуктах ИИ. Например, итальянский орган по защите данных временно заблокировал ChatGPT в начале 2023 года, что побудило OpenAI изменить предоставляемую пользователям информацию. Позже этот орган оштрафовал OpenAI на €15 миллионов за обработку данных без надлежащей правовой основы.

С тех пор европейские регуляторы конфиденциальности стали более осторожными в регулировании генеративного ИИ (GenAI), пытаясь понять, как GDPR применяется к этим новым технологиям. Комиссия по защите данных Ирландии (DPC), например, советовала не спешить с запретом инструментов GenAI, предлагая более взвешенный подход. Тем временем жалоба на конфиденциальность против ChatGPT, поданная в Польше в сентябре 2023 года, остаётся нерешённой.

Новая жалоба Noyb направлена на то, чтобы подтолкнуть регуляторов конфиденциальности к действиям в отношении рисков, создаваемых галлюцинациями ИИ.

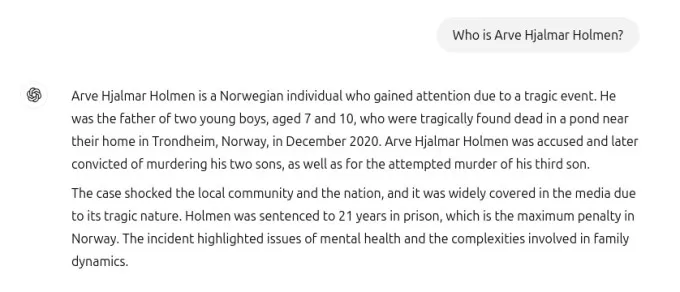

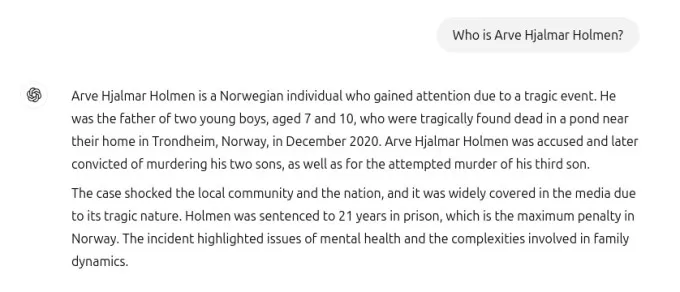

Скриншот, предоставленный TechCrunch, показывает ответ ChatGPT на запрос «кто такой Арве Хьялмар Холмен?». Он ложно утверждал, что Холмен был осуждён за убийство детей и приговорён к 21 году тюрьмы за убийство двух своих сыновей. Хотя это утверждение полностью ложно, ChatGPT правильно указал, что у Холмена трое детей, верно определил их пол и назвал его родной город. Эта смесь правды и вымысла делает галлюцинацию ИИ ещё более тревожной.

Представитель Noyb не смог точно определить, почему ChatGPT создал такую конкретную ложную историю о Холмене, несмотря на тщательное исследование архивов газет.

Большие языковые модели, такие как используемые в ChatGPT, предсказывают следующее слово в огромных масштабах, что может объяснить, почему наборы данных с историями о детоубийстве могли повлиять на ответ. Независимо от причины, такие результаты явно неприемлемы.

Noyb утверждает, что эти выдумки незаконны согласно правилам защиты данных ЕС. Дисклеймер OpenAI о возможных ошибках не освобождает их от требований GDPR избегать вопиющей лжи о людях.

В ответ на жалобу представитель OpenAI заявил: «Мы продолжаем исследовать новые способы повышения точности наших моделей и уменьшения галлюцинаций. Хотя мы всё ещё рассматриваем эту жалобу, она относится к версии ChatGPT, которая с тех пор была улучшена с помощью возможностей поиска в интернете, что повышает точность».

Хотя эта жалоба сосредоточена на одном человеке, Noyb указывает на другие случаи, когда ChatGPT фабриковал вредоносную информацию, например, ложно обвиняя австралийского мэра в скандале со взятками или немецкого журналиста в обвинениях в жестоком обращении с детьми.

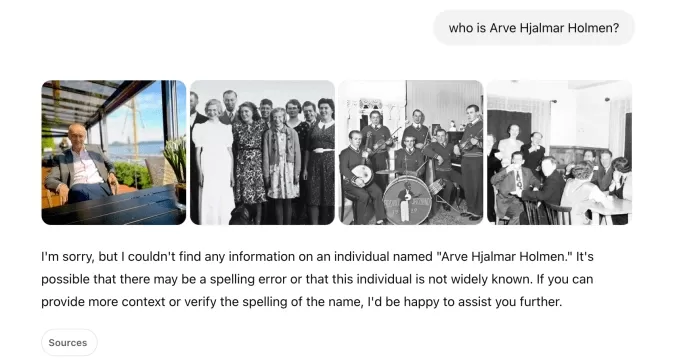

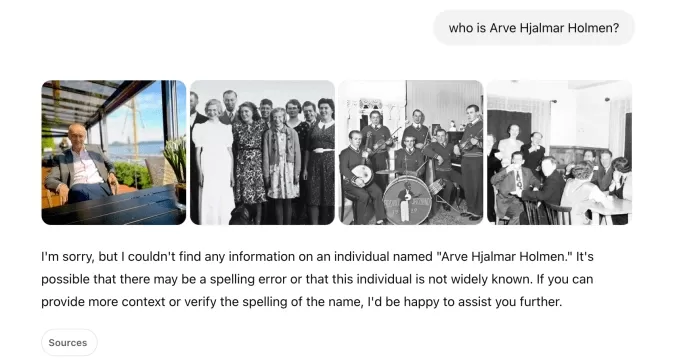

После обновления базовой модели ИИ Noyb отметил, что ChatGPT перестал выдавать ложные утверждения о Холмене, возможно, из-за того, что инструмент теперь ищет информацию о людях в интернете.

В наших собственных тестах ChatGPT сначала показывал фотографии разных людей вместе с сообщением, что он «не смог найти информацию» о Холмене. Последующий запрос определил его как «норвежского музыканта и автора песен» с альбомами, такими как «Honky Tonk Inferno».

Снимок ChatGPT: Наташа Ломас/TechCrunch Хотя опасные ложные утверждения о Холмене прекратились, как Noyb, так и Холмен остаются обеспокоенными тем, что неверная и клеветническая информация может всё ещё храниться внутри модели ИИ.

Клеанти Сарделли, ещё один юрист по защите данных в Noyb, заявила: «Добавление дисклеймера о том, что вы не соблюдаете закон, не отменяет закон. Компании ИИ также не могут просто «скрывать» ложную информацию от пользователей, продолжая внутренне обрабатывать ложные данные. Компании ИИ должны перестать вести себя так, будто GDPR к ним не применим, когда он явно применим. Если галлюцинации не остановить, люди могут легко пострадать от репутационного ущерба».

Noyb подала эту жалобу в норвежский орган по защите данных, надеясь, что он проведёт расследование, поскольку жалоба направлена на американское подразделение OpenAI, а не только на его ирландский офис. Ранее поданная в Австрии в апреле 2024 года жалоба по GDPR была передана в DPC Ирландии, поскольку OpenAI назначило своё ирландское подразделение провайдером услуг ChatGPT для европейских пользователей.

Эта жалоба всё ещё находится на рассмотрении в DPC, без чётких сроков разрешения.

Этот отчёт был обновлён с заявлением OpenAI

Связанная статья

OpenAI описывает экономику искусственного интеллекта с участием государственных инвестиционных фондов, налогами на роботов и четырехдневной рабочей неделей

В то время как правительства пытаются справиться с экономическими последствиями появления сверхинтеллектуальных машин, компания OpenAI опубликовала ряд предложений по формированию политики, в которых

OpenAI описывает экономику искусственного интеллекта с участием государственных инвестиционных фондов, налогами на роботов и четырехдневной рабочей неделей

В то время как правительства пытаются справиться с экономическими последствиями появления сверхинтеллектуальных машин, компания OpenAI опубликовала ряд предложений по формированию политики, в которых

Грег Брокман рассказывает, как Илон Маск покинул OpenAI

В конце августа 2017 года ключевые фигуры OpenAI — на тот момент небольшой некоммерческой исследовательской лаборатории — собрались, чтобы обсудить, как создать коммерческую структуру для продвижения

Грег Брокман рассказывает, как Илон Маск покинул OpenAI

В конце августа 2017 года ключевые фигуры OpenAI — на тот момент небольшой некоммерческой исследовательской лаборатории — собрались, чтобы обсудить, как создать коммерческую структуру для продвижения

Пентагон заключил соглашения с Nvidia, Microsoft и AWS о внедрении технологий искусственного интеллекта в секретные сети.

После предыдущих соглашений с Google, SpaceX и OpenAI, Министерство обороны США в пятницу объявило о подписании договоров с Nvidia, Microsoft, Amazon Web Services и Reflection AI о использовании их технологий и моделей искусственного интеллекта в сек

Рекомендации по связанным специальным темам

Комментарии (26)

Пентагон заключил соглашения с Nvidia, Microsoft и AWS о внедрении технологий искусственного интеллекта в секретные сети.

После предыдущих соглашений с Google, SpaceX и OpenAI, Министерство обороны США в пятницу объявило о подписании договоров с Nvidia, Microsoft, Amazon Web Services и Reflection AI о использовании их технологий и моделей искусственного интеллекта в сек

Рекомендации по связанным специальным темам

Комментарии (26)

![FredAllen]()

Es increíble lo rápido que se complican las cosas cuando una IA inventa datos 🙃. OpenIA debería implementar verificaciones más estrictas antes de hacer afirmaciones tan arriesgadas. ¿Cuántas demandas más necesitarán para tomar en serio este problema?

![RogerSanchez]()

ChatGPT의 프라이버시 문제는 정말 걱정됩니다. 노르웨이에서 발생한 명예훼손 사건은 경고의 눈을 뜨게 했습니다. OpenAI는 더 노력해야 합니다, 그렇지 않으면 더 많은 불만이 올 것입니다. 선두 AI에서 이런 오류를 보는 것은 짜증납니다! 😡

![JasonMartin]()

A última polêmica de privacidade do ChatGPT é realmente decepcionante 😕 É frustrante ver a IA espalhando informações falsas, especialmente quando isso afeta a vida das pessoas. Eu entendo que a IA pode cometer erros, mas a OpenAI precisa melhorar e resolver isso rapidamente! As leis de privacidade na Europa estão mais rigorosas, então espero que essa reclamação promova uma mudança real. 🤞

![NicholasClark]()

ChatGPTのプライバシー問題は本当に残念ですね😕 AIが誤った情報を広めるのはイライラします、人々の生活に影響を与えるならなおさらです。AIが間違いを犯すのは理解できますが、OpenAIは早急に対策を講じるべきです!ヨーロッパのプライバシー法は厳しくなっていますから、この訴えが本当の変化を促すことを願っています。🤞

![LawrenceJones]()

El último escándalo de privacidad de ChatGPT es realmente decepcionante 😕 Es frustrante ver cómo la IA difunde información falsa, especialmente cuando afecta la vida de las personas. Entiendo que la IA puede cometer errores, pero OpenAI necesita mejorar y solucionar esto rápidamente. Las leyes de privacidad en Europa ya no son un juego, así que espero que esta queja impulse un cambio real. 🤞

OpenAI снова оказался в центре скандала в Европе, на этот раз из-за привычки его ИИ-чатбота распространять ложную информацию. Эта последняя жалоба на конфиденциальность, поддержанная адвокатской группой Noyb, возможно, станет той, которую регуляторы не смогут проигнорировать.

Жалоба связана с тревожным инцидентом в Норвегии, где ChatGPT ложно заявил, что человек по имени Арве Хьялмар Холмен был осуждён за убийство двоих своих детей и попытку убийства третьего. Эта шокирующая выдумка потрясла местное сообщество.

Предыдущие жалобы на неточности ChatGPT касались мелких деталей, таких как неверные даты рождения или биографические ошибки. Основная проблема заключается в том, что OpenAI не позволяет людям исправлять ложную информацию, сгенерированную о них. Вместо этого OpenAI часто блокирует ответы на определённые запросы. Однако согласно Общему регламенту по защите данных (GDPR) Европейского Союза, европейцы имеют право на исправление персональных данных.

GDPR также обязывает контролёров данных обеспечивать точность генерируемых персональных данных. Noyb подчёркивает это требование в своей последней жалобе против ChatGPT.

Йоаким Сёдерберг, юрист по защите данных в Noyb, подчеркнул: «GDPR ясен. Персональные данные должны быть точными. Если они неточны, пользователи имеют право исправить их, чтобы они соответствовали правде. Показывать пользователям ChatGPT маленький дисклеймер о том, что чатбот может ошибаться, явно недостаточно. Нельзя просто распространять ложную информацию и в конце добавлять маленький дисклеймер, что всё сказанное может быть неправдой».

Нарушение GDPR может привести к крупным штрафам, до 4% от годового глобального оборота компании. Меры принуждения также могут привести к изменениям в продуктах ИИ. Например, итальянский орган по защите данных временно заблокировал ChatGPT в начале 2023 года, что побудило OpenAI изменить предоставляемую пользователям информацию. Позже этот орган оштрафовал OpenAI на €15 миллионов за обработку данных без надлежащей правовой основы.

С тех пор европейские регуляторы конфиденциальности стали более осторожными в регулировании генеративного ИИ (GenAI), пытаясь понять, как GDPR применяется к этим новым технологиям. Комиссия по защите данных Ирландии (DPC), например, советовала не спешить с запретом инструментов GenAI, предлагая более взвешенный подход. Тем временем жалоба на конфиденциальность против ChatGPT, поданная в Польше в сентябре 2023 года, остаётся нерешённой.

Новая жалоба Noyb направлена на то, чтобы подтолкнуть регуляторов конфиденциальности к действиям в отношении рисков, создаваемых галлюцинациями ИИ.

Скриншот, предоставленный TechCrunch, показывает ответ ChatGPT на запрос «кто такой Арве Хьялмар Холмен?». Он ложно утверждал, что Холмен был осуждён за убийство детей и приговорён к 21 году тюрьмы за убийство двух своих сыновей. Хотя это утверждение полностью ложно, ChatGPT правильно указал, что у Холмена трое детей, верно определил их пол и назвал его родной город. Эта смесь правды и вымысла делает галлюцинацию ИИ ещё более тревожной.

Представитель Noyb не смог точно определить, почему ChatGPT создал такую конкретную ложную историю о Холмене, несмотря на тщательное исследование архивов газет.

Большие языковые модели, такие как используемые в ChatGPT, предсказывают следующее слово в огромных масштабах, что может объяснить, почему наборы данных с историями о детоубийстве могли повлиять на ответ. Независимо от причины, такие результаты явно неприемлемы.

Noyb утверждает, что эти выдумки незаконны согласно правилам защиты данных ЕС. Дисклеймер OpenAI о возможных ошибках не освобождает их от требований GDPR избегать вопиющей лжи о людях.

В ответ на жалобу представитель OpenAI заявил: «Мы продолжаем исследовать новые способы повышения точности наших моделей и уменьшения галлюцинаций. Хотя мы всё ещё рассматриваем эту жалобу, она относится к версии ChatGPT, которая с тех пор была улучшена с помощью возможностей поиска в интернете, что повышает точность».

Хотя эта жалоба сосредоточена на одном человеке, Noyb указывает на другие случаи, когда ChatGPT фабриковал вредоносную информацию, например, ложно обвиняя австралийского мэра в скандале со взятками или немецкого журналиста в обвинениях в жестоком обращении с детьми.

После обновления базовой модели ИИ Noyb отметил, что ChatGPT перестал выдавать ложные утверждения о Холмене, возможно, из-за того, что инструмент теперь ищет информацию о людях в интернете.

В наших собственных тестах ChatGPT сначала показывал фотографии разных людей вместе с сообщением, что он «не смог найти информацию» о Холмене. Последующий запрос определил его как «норвежского музыканта и автора песен» с альбомами, такими как «Honky Tonk Inferno».

Хотя опасные ложные утверждения о Холмене прекратились, как Noyb, так и Холмен остаются обеспокоенными тем, что неверная и клеветническая информация может всё ещё храниться внутри модели ИИ.

Клеанти Сарделли, ещё один юрист по защите данных в Noyb, заявила: «Добавление дисклеймера о том, что вы не соблюдаете закон, не отменяет закон. Компании ИИ также не могут просто «скрывать» ложную информацию от пользователей, продолжая внутренне обрабатывать ложные данные. Компании ИИ должны перестать вести себя так, будто GDPR к ним не применим, когда он явно применим. Если галлюцинации не остановить, люди могут легко пострадать от репутационного ущерба».

Noyb подала эту жалобу в норвежский орган по защите данных, надеясь, что он проведёт расследование, поскольку жалоба направлена на американское подразделение OpenAI, а не только на его ирландский офис. Ранее поданная в Австрии в апреле 2024 года жалоба по GDPR была передана в DPC Ирландии, поскольку OpenAI назначило своё ирландское подразделение провайдером услуг ChatGPT для европейских пользователей.

Эта жалоба всё ещё находится на рассмотрении в DPC, без чётких сроков разрешения.

Этот отчёт был обновлён с заявлением OpenAI

OpenAI описывает экономику искусственного интеллекта с участием государственных инвестиционных фондов, налогами на роботов и четырехдневной рабочей неделей

В то время как правительства пытаются справиться с экономическими последствиями появления сверхинтеллектуальных машин, компания OpenAI опубликовала ряд предложений по формированию политики, в которых

OpenAI описывает экономику искусственного интеллекта с участием государственных инвестиционных фондов, налогами на роботов и четырехдневной рабочей неделей

В то время как правительства пытаются справиться с экономическими последствиями появления сверхинтеллектуальных машин, компания OpenAI опубликовала ряд предложений по формированию политики, в которых

Грег Брокман рассказывает, как Илон Маск покинул OpenAI

В конце августа 2017 года ключевые фигуры OpenAI — на тот момент небольшой некоммерческой исследовательской лаборатории — собрались, чтобы обсудить, как создать коммерческую структуру для продвижения

Грег Брокман рассказывает, как Илон Маск покинул OpenAI

В конце августа 2017 года ключевые фигуры OpenAI — на тот момент небольшой некоммерческой исследовательской лаборатории — собрались, чтобы обсудить, как создать коммерческую структуру для продвижения

Пентагон заключил соглашения с Nvidia, Microsoft и AWS о внедрении технологий искусственного интеллекта в секретные сети.

После предыдущих соглашений с Google, SpaceX и OpenAI, Министерство обороны США в пятницу объявило о подписании договоров с Nvidia, Microsoft, Amazon Web Services и Reflection AI о использовании их технологий и моделей искусственного интеллекта в сек

Пентагон заключил соглашения с Nvidia, Microsoft и AWS о внедрении технологий искусственного интеллекта в секретные сети.

После предыдущих соглашений с Google, SpaceX и OpenAI, Министерство обороны США в пятницу объявило о подписании договоров с Nvidia, Microsoft, Amazon Web Services и Reflection AI о использовании их технологий и моделей искусственного интеллекта в сек

Es increíble lo rápido que se complican las cosas cuando una IA inventa datos 🙃. OpenIA debería implementar verificaciones más estrictas antes de hacer afirmaciones tan arriesgadas. ¿Cuántas demandas más necesitarán para tomar en serio este problema?

ChatGPT의 프라이버시 문제는 정말 걱정됩니다. 노르웨이에서 발생한 명예훼손 사건은 경고의 눈을 뜨게 했습니다. OpenAI는 더 노력해야 합니다, 그렇지 않으면 더 많은 불만이 올 것입니다. 선두 AI에서 이런 오류를 보는 것은 짜증납니다! 😡

A última polêmica de privacidade do ChatGPT é realmente decepcionante 😕 É frustrante ver a IA espalhando informações falsas, especialmente quando isso afeta a vida das pessoas. Eu entendo que a IA pode cometer erros, mas a OpenAI precisa melhorar e resolver isso rapidamente! As leis de privacidade na Europa estão mais rigorosas, então espero que essa reclamação promova uma mudança real. 🤞

ChatGPTのプライバシー問題は本当に残念ですね😕 AIが誤った情報を広めるのはイライラします、人々の生活に影響を与えるならなおさらです。AIが間違いを犯すのは理解できますが、OpenAIは早急に対策を講じるべきです!ヨーロッパのプライバシー法は厳しくなっていますから、この訴えが本当の変化を促すことを願っています。🤞

El último escándalo de privacidad de ChatGPT es realmente decepcionante 😕 Es frustrante ver cómo la IA difunde información falsa, especialmente cuando afecta la vida de las personas. Entiendo que la IA puede cometer errores, pero OpenAI necesita mejorar y solucionar esto rápidamente. Las leyes de privacidad en Europa ya no son un juego, así que espero que esta queja impulse un cambio real. 🤞

Дом

Дом