Новый законопроект AI, представленный в Калифорнии автором SB 1047

Сенатор штата Калифорния Скотт Винер, вызвавший бурные споры с прошлогодним противоречивым законопроектом о безопасности ИИ SB 1047, вернулся с новым законопроектом, который, вероятно, снова всколыхнёт Кремниевую долину. В пятницу Винер представил SB 53, который направлен на защиту сотрудников крупных лабораторий ИИ от репрессий, если они выразят обеспокоенность тем, что системы ИИ их компаний представляют «критический риск» для общества. Кроме того, законопроект предлагает создание CalCompute, публичного облачного вычислительного кластера, предназначенного для предоставления исследователям и стартапам вычислительных мощностей, необходимых для разработки ИИ в интересах общества.

Предыдущий законопроект Винера, SB 1047, вызвал ожесточённые национальные дебаты о том, как управлять крупными системами ИИ, которые потенциально могут привести к катастрофическим событиям, таким как значительные человеческие жертвы или кибератаки, наносящие ущерб более чем на 500 миллионов долларов. Несмотря на споры, губернатор Гэвин Ньюсом наложил вето на законопроект в сентябре, утверждая, что это не правильный подход.

Последствия SB 1047 были серьёзными. Крупные игроки Кремниевой долины утверждали, что законопроект подорвёт преимущество Америки в глобальной гонке ИИ, подпитываемой, по их мнению, необоснованными страхами апокалиптических сценариев, вызванных ИИ. Винер в ответ обвинил некоторых венчурных капиталистов в организации «пропагандистской кампании» против его законопроекта. В частности, утверждение Y Combinator о том, что SB 1047 может привести к тюремному заключению основателей стартапов, эксперты назвали вводящим в заблуждение.

SB 53, похоже, представляет собой стратегический поворот, сосредоточившись на менее спорных элементах SB 1047. Он акцентирует внимание на защите информаторов и создании CalCompute. Однако Винер не отступает от темы экзистенциальных рисков ИИ. SB 53 чётко защищает информаторов, которые считают, что их работодатели разрабатывают системы ИИ, которые могут представлять «критический риск», определяемый как предвидимый или значительный риск, который может привести к гибели или серьёзным травмам более 100 человек или ущербу более чем на 1 миллиард долларов.

Законопроект нацелен на разработчиков передовых моделей ИИ, таких как OpenAI, Anthropic и xAI, запрещая им принимать меры против сотрудников, которые сообщают о своих опасениях генеральному прокурору Калифорнии, федеральным властям или другим сотрудникам. Эти разработчики также должны отчитываться перед информаторами о внутренних процессах, вызывающих обеспокоенность.

Что касается CalCompute, SB 53 предусматривает создание группы, включающей представителей Университета Калифорнии и других исследователей, для планирования его разработки. Они определят размер кластера и круг лиц, которые получат к нему доступ.

SB 53 находится на ранней стадии законодательного процесса и должен получить одобрение законодательных органов Калифорнии, прежде чем попадёт на стол губернатора Ньюсома. Реакция Кремниевой долины на этот новый законопроект будет внимательно отслеживаться.

Принятие законопроектов о безопасности ИИ в 2025 году может оказаться сложнее, чем в 2024 году, когда Калифорния приняла 18 связанных с ИИ законопроектов. Движение за безопасность ИИ, похоже, теряет импульс, особенно после комментариев вице-президента Джей Ди Вэнса на Парижском саммите по действиям в области ИИ, где он сделал акцент на инновациях в ИИ, а не на безопасности. Хотя CalCompute может рассматриваться как способ продвижения прогресса в области ИИ, будущее законодательных инициатив, сосредоточенных на экзистенциальных рисках ИИ, остаётся неопределённым.

[ttpp][yyxx]

Связанная статья

Бум венчурных инвестиций в сферу искусственного интеллекта привел к тому, что выручка за один квартал превысила триллион юаней, что дало старт новой волне инноваций

Объем глобальных венчурных инвестиций в сферу искусственного интеллекта стремительно растет. В первом квартале этого года было завершено почти 600 раундов финансирования, связанных с ИИ, на общую сумм

Бум венчурных инвестиций в сферу искусственного интеллекта привел к тому, что выручка за один квартал превысила триллион юаней, что дало старт новой волне инноваций

Объем глобальных венчурных инвестиций в сферу искусственного интеллекта стремительно растет. В первом квартале этого года было завершено почти 600 раундов финансирования, связанных с ИИ, на общую сумм

OpenAI прекращает поддержку крупных моделей o3 и GPT-4.5

Будучи лидером в области искусственного интеллекта, каждый технический шаг OpenAI вызывает значительный резонанс в отрасли. Недавно компания сделала важное заявление: она выведет из эксплуатации две к

OpenAI прекращает поддержку крупных моделей o3 и GPT-4.5

Будучи лидером в области искусственного интеллекта, каждый технический шаг OpenAI вызывает значительный резонанс в отрасли. Недавно компания сделала важное заявление: она выведет из эксплуатации две к

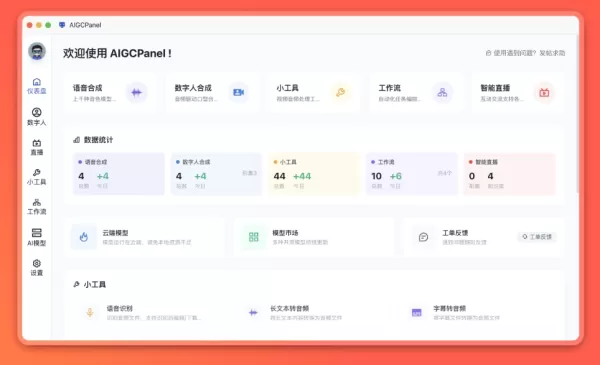

AIGCPanel 2.0.0 — крупное обновление: движок рабочих процессов открывает новую эру автоматизированного создания цифровых персонажей

AIGCPanel, мощный инструмент для создания локальных цифровых персонажей, только что выпустил версию 2.0.0, которую называют «самым значительным обновлением на сегодняшний день». Эта радикальная перера

Рекомендации по связанным специальным темам

Комментарии (29)

AIGCPanel 2.0.0 — крупное обновление: движок рабочих процессов открывает новую эру автоматизированного создания цифровых персонажей

AIGCPanel, мощный инструмент для создания локальных цифровых персонажей, только что выпустил версию 2.0.0, которую называют «самым значительным обновлением на сегодняшний день». Эта радикальная перера

Рекомендации по связанным специальным темам

Комментарии (29)

![ChristopherBrown]()

加州又出新法案了?SB 1047作者這次推SB 53,要保護吹哨的AI實驗室員工。矽谷大佬們現在應該很頭痛吧🤔 不過這種保護機制確實有必要,畢竟AI發展這麼快,內部監督不能只靠企業自律。但具體執行起來會不會變相鼓勵惡意舉報?法案細節還得再觀察。

![AndrewGarcía]()

Mais uma lei de IA na Califórnia? Parece que os políticos adoram regular uma indústria que mal entendem 😅 Será que dessa vez vão acertar ou só criar mais confusão para as startups? #AImasNaoTanto

![ThomasYoung]()

Mais uma lei de IA na Califórnia? 🙄 Parece que os políticos adoram regular tecnologia que nem entendem. Será que dessa vez vão consultar engenheiros antes de escrever as regras? Pelo menos a proteção contra retaliação faz sentido, mas duvido que vá funcionar na prática...

![JerryLee]()

This new AI bill sounds like a game-changer! Protecting whistleblowers in AI labs is crucial—those folks need a voice without fear of getting canned. But I bet Silicon Valley's big shots are sweating bullets over this one. 😅 Curious to see how it plays out!

![AlbertThomas]()

위너 상원의원의 새로운 AI 법안은 유망하게 들리지만, 꽤 많은 논쟁을 불러일으키고 있어요. AI 연구소 직원들을 보복으로부터 보호하는 것은 중요하지만, 일부는 이것이 혁신을 늦출까봐 걱정하고 있어요. 미묘한 균형이지만, 누군가가 이런 문제를 다루고 있다는 것이 기쁩니다. 어떻게 될지 지켜봐야겠네요! 🤔

![RalphHill]()

O novo projeto de lei de IA do senador Wiener parece promissor, mas está causando bastante debate. Proteger os funcionários dos laboratórios de IA de represálias é importante, mas alguns temem que isso possa desacelerar a inovação. É um equilíbrio delicado, mas estou feliz que alguém esteja abordando esses problemas. Vamos ver como isso se desenrola! 🤔

Сенатор штата Калифорния Скотт Винер, вызвавший бурные споры с прошлогодним противоречивым законопроектом о безопасности ИИ SB 1047, вернулся с новым законопроектом, который, вероятно, снова всколыхнёт Кремниевую долину. В пятницу Винер представил SB 53, который направлен на защиту сотрудников крупных лабораторий ИИ от репрессий, если они выразят обеспокоенность тем, что системы ИИ их компаний представляют «критический риск» для общества. Кроме того, законопроект предлагает создание CalCompute, публичного облачного вычислительного кластера, предназначенного для предоставления исследователям и стартапам вычислительных мощностей, необходимых для разработки ИИ в интересах общества.

Предыдущий законопроект Винера, SB 1047, вызвал ожесточённые национальные дебаты о том, как управлять крупными системами ИИ, которые потенциально могут привести к катастрофическим событиям, таким как значительные человеческие жертвы или кибератаки, наносящие ущерб более чем на 500 миллионов долларов. Несмотря на споры, губернатор Гэвин Ньюсом наложил вето на законопроект в сентябре, утверждая, что это не правильный подход.

Последствия SB 1047 были серьёзными. Крупные игроки Кремниевой долины утверждали, что законопроект подорвёт преимущество Америки в глобальной гонке ИИ, подпитываемой, по их мнению, необоснованными страхами апокалиптических сценариев, вызванных ИИ. Винер в ответ обвинил некоторых венчурных капиталистов в организации «пропагандистской кампании» против его законопроекта. В частности, утверждение Y Combinator о том, что SB 1047 может привести к тюремному заключению основателей стартапов, эксперты назвали вводящим в заблуждение.

SB 53, похоже, представляет собой стратегический поворот, сосредоточившись на менее спорных элементах SB 1047. Он акцентирует внимание на защите информаторов и создании CalCompute. Однако Винер не отступает от темы экзистенциальных рисков ИИ. SB 53 чётко защищает информаторов, которые считают, что их работодатели разрабатывают системы ИИ, которые могут представлять «критический риск», определяемый как предвидимый или значительный риск, который может привести к гибели или серьёзным травмам более 100 человек или ущербу более чем на 1 миллиард долларов.

Законопроект нацелен на разработчиков передовых моделей ИИ, таких как OpenAI, Anthropic и xAI, запрещая им принимать меры против сотрудников, которые сообщают о своих опасениях генеральному прокурору Калифорнии, федеральным властям или другим сотрудникам. Эти разработчики также должны отчитываться перед информаторами о внутренних процессах, вызывающих обеспокоенность.

Что касается CalCompute, SB 53 предусматривает создание группы, включающей представителей Университета Калифорнии и других исследователей, для планирования его разработки. Они определят размер кластера и круг лиц, которые получат к нему доступ.

SB 53 находится на ранней стадии законодательного процесса и должен получить одобрение законодательных органов Калифорнии, прежде чем попадёт на стол губернатора Ньюсома. Реакция Кремниевой долины на этот новый законопроект будет внимательно отслеживаться.

Принятие законопроектов о безопасности ИИ в 2025 году может оказаться сложнее, чем в 2024 году, когда Калифорния приняла 18 связанных с ИИ законопроектов. Движение за безопасность ИИ, похоже, теряет импульс, особенно после комментариев вице-президента Джей Ди Вэнса на Парижском саммите по действиям в области ИИ, где он сделал акцент на инновациях в ИИ, а не на безопасности. Хотя CalCompute может рассматриваться как способ продвижения прогресса в области ИИ, будущее законодательных инициатив, сосредоточенных на экзистенциальных рисках ИИ, остаётся неопределённым.

[ttpp][yyxx]

Бум венчурных инвестиций в сферу искусственного интеллекта привел к тому, что выручка за один квартал превысила триллион юаней, что дало старт новой волне инноваций

Объем глобальных венчурных инвестиций в сферу искусственного интеллекта стремительно растет. В первом квартале этого года было завершено почти 600 раундов финансирования, связанных с ИИ, на общую сумм

Бум венчурных инвестиций в сферу искусственного интеллекта привел к тому, что выручка за один квартал превысила триллион юаней, что дало старт новой волне инноваций

Объем глобальных венчурных инвестиций в сферу искусственного интеллекта стремительно растет. В первом квартале этого года было завершено почти 600 раундов финансирования, связанных с ИИ, на общую сумм

OpenAI прекращает поддержку крупных моделей o3 и GPT-4.5

Будучи лидером в области искусственного интеллекта, каждый технический шаг OpenAI вызывает значительный резонанс в отрасли. Недавно компания сделала важное заявление: она выведет из эксплуатации две к

OpenAI прекращает поддержку крупных моделей o3 и GPT-4.5

Будучи лидером в области искусственного интеллекта, каждый технический шаг OpenAI вызывает значительный резонанс в отрасли. Недавно компания сделала важное заявление: она выведет из эксплуатации две к

AIGCPanel 2.0.0 — крупное обновление: движок рабочих процессов открывает новую эру автоматизированного создания цифровых персонажей

AIGCPanel, мощный инструмент для создания локальных цифровых персонажей, только что выпустил версию 2.0.0, которую называют «самым значительным обновлением на сегодняшний день». Эта радикальная перера

AIGCPanel 2.0.0 — крупное обновление: движок рабочих процессов открывает новую эру автоматизированного создания цифровых персонажей

AIGCPanel, мощный инструмент для создания локальных цифровых персонажей, только что выпустил версию 2.0.0, которую называют «самым значительным обновлением на сегодняшний день». Эта радикальная перера

加州又出新法案了?SB 1047作者這次推SB 53,要保護吹哨的AI實驗室員工。矽谷大佬們現在應該很頭痛吧🤔 不過這種保護機制確實有必要,畢竟AI發展這麼快,內部監督不能只靠企業自律。但具體執行起來會不會變相鼓勵惡意舉報?法案細節還得再觀察。

Mais uma lei de IA na Califórnia? Parece que os políticos adoram regular uma indústria que mal entendem 😅 Será que dessa vez vão acertar ou só criar mais confusão para as startups? #AImasNaoTanto

Mais uma lei de IA na Califórnia? 🙄 Parece que os políticos adoram regular tecnologia que nem entendem. Será que dessa vez vão consultar engenheiros antes de escrever as regras? Pelo menos a proteção contra retaliação faz sentido, mas duvido que vá funcionar na prática...

This new AI bill sounds like a game-changer! Protecting whistleblowers in AI labs is crucial—those folks need a voice without fear of getting canned. But I bet Silicon Valley's big shots are sweating bullets over this one. 😅 Curious to see how it plays out!

위너 상원의원의 새로운 AI 법안은 유망하게 들리지만, 꽤 많은 논쟁을 불러일으키고 있어요. AI 연구소 직원들을 보복으로부터 보호하는 것은 중요하지만, 일부는 이것이 혁신을 늦출까봐 걱정하고 있어요. 미묘한 균형이지만, 누군가가 이런 문제를 다루고 있다는 것이 기쁩니다. 어떻게 될지 지켜봐야겠네요! 🤔

O novo projeto de lei de IA do senador Wiener parece promissor, mas está causando bastante debate. Proteger os funcionários dos laboratórios de IA de represálias é importante, mas alguns temem que isso possa desacelerar a inovação. É um equilíbrio delicado, mas estou feliz que alguém esteja abordando esses problemas. Vamos ver como isso se desenrola! 🤔

Дом

Дом