Nuevo proyecto de ley AI presentado en California por el autor de SB 1047

El senador estatal de California, Scott Wiener, quien causó revuelo con el controvertido proyecto de ley de seguridad de IA SB 1047 del año pasado, está de vuelta con otro proyecto que promete generar controversia en Silicon Valley. El viernes, Wiener presentó el SB 53, que busca proteger a los empleados de los principales laboratorios de IA contra represalias si expresan preocupaciones sobre los sistemas de IA de su empresa que representen un "riesgo crítico" para la sociedad. Además, el proyecto propone la creación de CalCompute, un clúster de computación en la nube público diseñado para proporcionar a investigadores y startups el poder computacional necesario para desarrollar IA en beneficio del público.

El proyecto anterior de Wiener, SB 1047, desató un intenso debate nacional sobre cómo gestionar los grandes sistemas de IA que podrían conducir a eventos catastróficos, como una pérdida significativa de vidas o ciberataques que causen daños superiores a $500 millones. A pesar de la controversia, el gobernador Gavin Newsom vetó el proyecto en septiembre, argumentando que no era el enfoque correcto.

Las repercusiones del SB 1047 fueron intensas. Los magnates de Silicon Valley argumentaron que el proyecto socavaría la ventaja de Estados Unidos en la carrera global de IA, impulsada por lo que consideraban temores infundados de escenarios apocalípticos inducidos por la IA. Wiener contraatacó, acusando a algunos capitalistas de riesgo de orquestar una "campaña de propaganda" contra su proyecto. En particular, la afirmación de Y Combinator de que el SB 1047 podría encarcelar a fundadores de startups fue calificada como engañosa por expertos.

El SB 53 parece ser un cambio estratégico, centrándose en los elementos menos controvertidos del SB 1047. Pone énfasis en las protecciones para denunciantes y en el establecimiento de CalCompute. Sin embargo, Wiener no retrocede ante los riesgos existenciales de la IA. El SB 53 protege claramente a los denunciantes que creen que sus empleadores están desarrollando sistemas de IA que podrían representar un "riesgo crítico", definido como un riesgo previsible o material que podría resultar en la muerte o lesiones graves de más de 100 personas, o daños superiores a $1,000 millones.

El proyecto se dirige a los desarrolladores de modelos de IA de vanguardia como OpenAI, Anthropic y xAI, prohibiéndoles tomar represalias contra empleados que informen preocupaciones al Fiscal General de California, autoridades federales u otros empleados. Estos desarrolladores también deben informar a los denunciantes sobre los procesos internos señalados como preocupantes.

En cuanto a CalCompute, el SB 53 establecería un grupo que incluye representantes de la Universidad de California y otros investigadores para planificar su desarrollo. Ellos decidirán el tamaño del clúster y quién tendrá acceso a él.

El SB 53 aún está en las primeras etapas del proceso legislativo, necesitando la aprobación de los cuerpos legislativos de California antes de llegar al escritorio del gobernador Newsom. La respuesta de Silicon Valley a este nuevo proyecto será observada de cerca.

Aprobar proyectos de ley de seguridad de IA en 2025 podría ser más complicado que en 2024, cuando California aprobó 18 proyectos relacionados con la IA. El movimiento de seguridad de IA parece estar perdiendo impulso, especialmente tras los comentarios del vicepresidente J.D. Vance en la Cumbre de Acción de IA de París, donde enfatizó la innovación en IA por encima de la seguridad. Aunque CalCompute podría ser visto como un impulso al progreso de la IA, el futuro de los esfuerzos legislativos centrados en los riesgos existenciales de la IA sigue siendo incierto.

[ttpp][yyxx]

Artículo relacionado

OpenAI retira los modelos a gran escala o3 y GPT-4.5

Como líder en inteligencia artificial, cada movimiento técnico de OpenAI tiene un gran impacto en el sector. Recientemente, la empresa hizo un importante anuncio: retirará dos modelos clásicos —o3 y G

OpenAI retira los modelos a gran escala o3 y GPT-4.5

Como líder en inteligencia artificial, cada movimiento técnico de OpenAI tiene un gran impacto en el sector. Recientemente, la empresa hizo un importante anuncio: retirará dos modelos clásicos —o3 y G

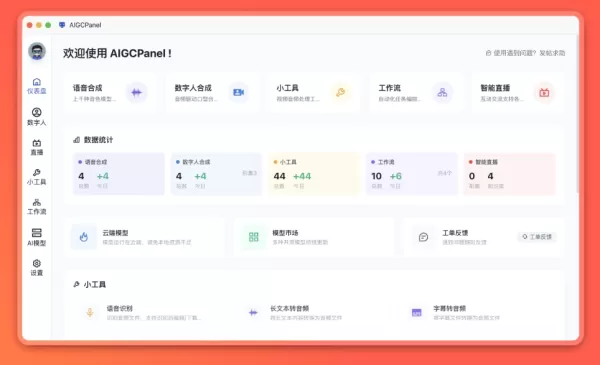

Actualización importante de AIGCPanel 2.0.0: el motor de flujos de trabajo abre una nueva era en la creación automatizada de seres humanos digitales

AIGCPanel, una potente herramienta para la creación de humanos digitales a nivel local, acaba de lanzar la versión 2.0.0, considerada «la actualización más importante hasta la fecha». Esta revisión pr

Actualización importante de AIGCPanel 2.0.0: el motor de flujos de trabajo abre una nueva era en la creación automatizada de seres humanos digitales

AIGCPanel, una potente herramienta para la creación de humanos digitales a nivel local, acaba de lanzar la versión 2.0.0, considerada «la actualización más importante hasta la fecha». Esta revisión pr

BuzzFeed lanza una filial dedicada a aplicaciones basura basadas en IA

En medio de una grave crisis empresarial, el antiguo gigante de los medios digitales BuzzFeed está poniendo en marcha un ambicioso proyecto de autorrescate basado en la inteligencia artificial. En la

Recomendaciones de temas especiales relacionados

comentario (29)

0/500

BuzzFeed lanza una filial dedicada a aplicaciones basura basadas en IA

En medio de una grave crisis empresarial, el antiguo gigante de los medios digitales BuzzFeed está poniendo en marcha un ambicioso proyecto de autorrescate basado en la inteligencia artificial. En la

Recomendaciones de temas especiales relacionados

comentario (29)

0/500

![ChristopherBrown]()

加州又出新法案了?SB 1047作者這次推SB 53,要保護吹哨的AI實驗室員工。矽谷大佬們現在應該很頭痛吧🤔 不過這種保護機制確實有必要,畢竟AI發展這麼快,內部監督不能只靠企業自律。但具體執行起來會不會變相鼓勵惡意舉報?法案細節還得再觀察。

![AndrewGarcía]()

Mais uma lei de IA na Califórnia? Parece que os políticos adoram regular uma indústria que mal entendem 😅 Será que dessa vez vão acertar ou só criar mais confusão para as startups? #AImasNaoTanto

![ThomasYoung]()

Mais uma lei de IA na Califórnia? 🙄 Parece que os políticos adoram regular tecnologia que nem entendem. Será que dessa vez vão consultar engenheiros antes de escrever as regras? Pelo menos a proteção contra retaliação faz sentido, mas duvido que vá funcionar na prática...

![JerryLee]()

This new AI bill sounds like a game-changer! Protecting whistleblowers in AI labs is crucial—those folks need a voice without fear of getting canned. But I bet Silicon Valley's big shots are sweating bullets over this one. 😅 Curious to see how it plays out!

![AlbertThomas]()

위너 상원의원의 새로운 AI 법안은 유망하게 들리지만, 꽤 많은 논쟁을 불러일으키고 있어요. AI 연구소 직원들을 보복으로부터 보호하는 것은 중요하지만, 일부는 이것이 혁신을 늦출까봐 걱정하고 있어요. 미묘한 균형이지만, 누군가가 이런 문제를 다루고 있다는 것이 기쁩니다. 어떻게 될지 지켜봐야겠네요! 🤔

![RalphHill]()

O novo projeto de lei de IA do senador Wiener parece promissor, mas está causando bastante debate. Proteger os funcionários dos laboratórios de IA de represálias é importante, mas alguns temem que isso possa desacelerar a inovação. É um equilíbrio delicado, mas estou feliz que alguém esteja abordando esses problemas. Vamos ver como isso se desenrola! 🤔

El senador estatal de California, Scott Wiener, quien causó revuelo con el controvertido proyecto de ley de seguridad de IA SB 1047 del año pasado, está de vuelta con otro proyecto que promete generar controversia en Silicon Valley. El viernes, Wiener presentó el SB 53, que busca proteger a los empleados de los principales laboratorios de IA contra represalias si expresan preocupaciones sobre los sistemas de IA de su empresa que representen un "riesgo crítico" para la sociedad. Además, el proyecto propone la creación de CalCompute, un clúster de computación en la nube público diseñado para proporcionar a investigadores y startups el poder computacional necesario para desarrollar IA en beneficio del público.

El proyecto anterior de Wiener, SB 1047, desató un intenso debate nacional sobre cómo gestionar los grandes sistemas de IA que podrían conducir a eventos catastróficos, como una pérdida significativa de vidas o ciberataques que causen daños superiores a $500 millones. A pesar de la controversia, el gobernador Gavin Newsom vetó el proyecto en septiembre, argumentando que no era el enfoque correcto.

Las repercusiones del SB 1047 fueron intensas. Los magnates de Silicon Valley argumentaron que el proyecto socavaría la ventaja de Estados Unidos en la carrera global de IA, impulsada por lo que consideraban temores infundados de escenarios apocalípticos inducidos por la IA. Wiener contraatacó, acusando a algunos capitalistas de riesgo de orquestar una "campaña de propaganda" contra su proyecto. En particular, la afirmación de Y Combinator de que el SB 1047 podría encarcelar a fundadores de startups fue calificada como engañosa por expertos.

El SB 53 parece ser un cambio estratégico, centrándose en los elementos menos controvertidos del SB 1047. Pone énfasis en las protecciones para denunciantes y en el establecimiento de CalCompute. Sin embargo, Wiener no retrocede ante los riesgos existenciales de la IA. El SB 53 protege claramente a los denunciantes que creen que sus empleadores están desarrollando sistemas de IA que podrían representar un "riesgo crítico", definido como un riesgo previsible o material que podría resultar en la muerte o lesiones graves de más de 100 personas, o daños superiores a $1,000 millones.

El proyecto se dirige a los desarrolladores de modelos de IA de vanguardia como OpenAI, Anthropic y xAI, prohibiéndoles tomar represalias contra empleados que informen preocupaciones al Fiscal General de California, autoridades federales u otros empleados. Estos desarrolladores también deben informar a los denunciantes sobre los procesos internos señalados como preocupantes.

En cuanto a CalCompute, el SB 53 establecería un grupo que incluye representantes de la Universidad de California y otros investigadores para planificar su desarrollo. Ellos decidirán el tamaño del clúster y quién tendrá acceso a él.

El SB 53 aún está en las primeras etapas del proceso legislativo, necesitando la aprobación de los cuerpos legislativos de California antes de llegar al escritorio del gobernador Newsom. La respuesta de Silicon Valley a este nuevo proyecto será observada de cerca.

Aprobar proyectos de ley de seguridad de IA en 2025 podría ser más complicado que en 2024, cuando California aprobó 18 proyectos relacionados con la IA. El movimiento de seguridad de IA parece estar perdiendo impulso, especialmente tras los comentarios del vicepresidente J.D. Vance en la Cumbre de Acción de IA de París, donde enfatizó la innovación en IA por encima de la seguridad. Aunque CalCompute podría ser visto como un impulso al progreso de la IA, el futuro de los esfuerzos legislativos centrados en los riesgos existenciales de la IA sigue siendo incierto.

[ttpp][yyxx]

OpenAI retira los modelos a gran escala o3 y GPT-4.5

Como líder en inteligencia artificial, cada movimiento técnico de OpenAI tiene un gran impacto en el sector. Recientemente, la empresa hizo un importante anuncio: retirará dos modelos clásicos —o3 y G

OpenAI retira los modelos a gran escala o3 y GPT-4.5

Como líder en inteligencia artificial, cada movimiento técnico de OpenAI tiene un gran impacto en el sector. Recientemente, la empresa hizo un importante anuncio: retirará dos modelos clásicos —o3 y G

Actualización importante de AIGCPanel 2.0.0: el motor de flujos de trabajo abre una nueva era en la creación automatizada de seres humanos digitales

AIGCPanel, una potente herramienta para la creación de humanos digitales a nivel local, acaba de lanzar la versión 2.0.0, considerada «la actualización más importante hasta la fecha». Esta revisión pr

Actualización importante de AIGCPanel 2.0.0: el motor de flujos de trabajo abre una nueva era en la creación automatizada de seres humanos digitales

AIGCPanel, una potente herramienta para la creación de humanos digitales a nivel local, acaba de lanzar la versión 2.0.0, considerada «la actualización más importante hasta la fecha». Esta revisión pr

BuzzFeed lanza una filial dedicada a aplicaciones basura basadas en IA

En medio de una grave crisis empresarial, el antiguo gigante de los medios digitales BuzzFeed está poniendo en marcha un ambicioso proyecto de autorrescate basado en la inteligencia artificial. En la

BuzzFeed lanza una filial dedicada a aplicaciones basura basadas en IA

En medio de una grave crisis empresarial, el antiguo gigante de los medios digitales BuzzFeed está poniendo en marcha un ambicioso proyecto de autorrescate basado en la inteligencia artificial. En la

加州又出新法案了?SB 1047作者這次推SB 53,要保護吹哨的AI實驗室員工。矽谷大佬們現在應該很頭痛吧🤔 不過這種保護機制確實有必要,畢竟AI發展這麼快,內部監督不能只靠企業自律。但具體執行起來會不會變相鼓勵惡意舉報?法案細節還得再觀察。

Mais uma lei de IA na Califórnia? Parece que os políticos adoram regular uma indústria que mal entendem 😅 Será que dessa vez vão acertar ou só criar mais confusão para as startups? #AImasNaoTanto

Mais uma lei de IA na Califórnia? 🙄 Parece que os políticos adoram regular tecnologia que nem entendem. Será que dessa vez vão consultar engenheiros antes de escrever as regras? Pelo menos a proteção contra retaliação faz sentido, mas duvido que vá funcionar na prática...

This new AI bill sounds like a game-changer! Protecting whistleblowers in AI labs is crucial—those folks need a voice without fear of getting canned. But I bet Silicon Valley's big shots are sweating bullets over this one. 😅 Curious to see how it plays out!

위너 상원의원의 새로운 AI 법안은 유망하게 들리지만, 꽤 많은 논쟁을 불러일으키고 있어요. AI 연구소 직원들을 보복으로부터 보호하는 것은 중요하지만, 일부는 이것이 혁신을 늦출까봐 걱정하고 있어요. 미묘한 균형이지만, 누군가가 이런 문제를 다루고 있다는 것이 기쁩니다. 어떻게 될지 지켜봐야겠네요! 🤔

O novo projeto de lei de IA do senador Wiener parece promissor, mas está causando bastante debate. Proteger os funcionários dos laboratórios de IA de represálias é importante, mas alguns temem que isso possa desacelerar a inovação. É um equilíbrio delicado, mas estou feliz que alguém esteja abordando esses problemas. Vamos ver como isso se desenrola! 🤔

Hogar

Hogar