Novo projeto de lei de IA introduzido na Califórnia pelo autor do SB 1047

Senador estadual da Califórnia Scott Wiener, que causou polêmica com o projeto de lei de segurança de IA SB 1047 no último ano, está de volta com outro projeto que promete agitar o Vale do Silício. Na sexta-feira, Wiener apresentou o SB 53, que visa proteger funcionários de grandes laboratórios de IA contra retaliações caso levantem preocupações sobre os sistemas de IA de suas empresas representarem um "risco crítico" para a sociedade. Além disso, o projeto propõe a criação do CalCompute, um cluster de computação em nuvem pública projetado para fornecer a pesquisadores e startups o poder computacional necessário para desenvolver IA para o bem público.

O projeto anterior de Wiener, SB 1047, gerou intenso debate nacional sobre como gerenciar grandes sistemas de IA que poderiam potencialmente levar a eventos catastróficos, como perda significativa de vidas ou ciberataques causando danos superiores a US$ 500 milhões. Apesar da controvérsia, o governador Gavin Newsom vetou o projeto em setembro, argumentando que não era a abordagem correta.

A reação ao SB 1047 foi intensa. Magnatas do Vale do Silício argumentaram que o projeto minaria a vantagem da América na corrida global de IA, alimentada por temores que consideravam infundados de cenários apocalípticos induzidos por IA. Wiener retrucou, acusando alguns capitalistas de risco de orquestrarem uma "campanha de propaganda" contra seu projeto. Notavelmente, a alegação da Y Combinator de que o SB 1047 poderia prender fundadores de startups foi considerada enganosa por especialistas.

O SB 53 parece ser uma mudança estratégica, focando nos elementos menos controversos do SB 1047. Ele enfatiza proteções a denunciantes e o estabelecimento do CalCompute. Wiener, no entanto, não recua em relação aos riscos existenciais da IA. O SB 53 protege claramente denunciantes que acreditam que seus empregadores estão desenvolvendo sistemas de IA que poderiam representar um "risco crítico", definido como um risco previsível ou material que poderia resultar na morte ou lesão grave de mais de 100 pessoas, ou danos superiores a US$ 1 bilhão.

O projeto tem como alvo desenvolvedores de modelos de IA de ponta, como OpenAI, Anthropic e xAI, proibindo-os de retaliar contra funcionários que relatam preocupações ao Procurador-Geral da Califórnia, autoridades federais ou outros funcionários. Esses desenvolvedores também devem relatar aos denunciantes sobre processos internos sinalizados como preocupantes.

Quanto ao CalCompute, o SB 53 criaria um grupo incluindo representantes da Universidade da Califórnia e outros pesquisadores para planejar seu desenvolvimento. Eles decidirão o tamanho do cluster e quem terá acesso a ele.

O SB 53 ainda está nas fases iniciais do processo legislativo, precisando da aprovação dos corpos legislativos da Califórnia antes de chegar à mesa do governador Newsom. A resposta do Vale do Silício a este novo projeto será observada de perto.

Aprovar projetos de lei de segurança de IA em 2025 pode ser mais difícil do que em 2024, quando a Califórnia aprovou 18 projetos relacionados à IA. O movimento de segurança de IA parece estar perdendo força, especialmente após os comentários do vice-presidente J.D. Vance no AI Action Summit de Paris, onde ele enfatizou a inovação em IA em vez da segurança. Embora o CalCompute possa ser visto como uma promoção do progresso da IA, o futuro dos esforços legislativos focados em riscos existenciais da IA permanece incerto.

[ttpp][yyxx]

Artigo relacionado

A OpenAI retira de circulação os modelos de grande porte o3 e GPT-4.5

Como pioneira em inteligência artificial, cada iniciativa técnica da OpenAI causa grande repercussão no setor. Recentemente, a empresa fez um grande anúncio: retirará dois modelos clássicos — o o3 e o

A OpenAI retira de circulação os modelos de grande porte o3 e GPT-4.5

Como pioneira em inteligência artificial, cada iniciativa técnica da OpenAI causa grande repercussão no setor. Recentemente, a empresa fez um grande anúncio: retirará dois modelos clássicos — o o3 e o

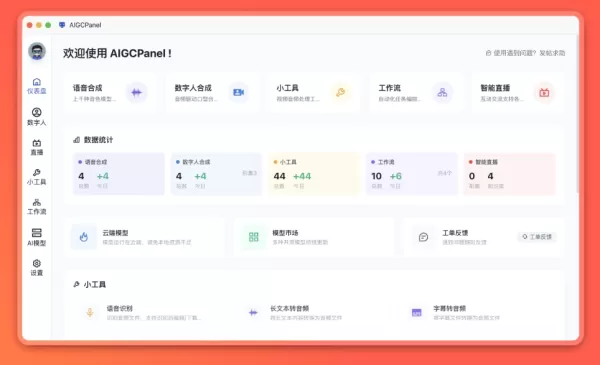

Atualização importante do AIGCPanel 2.0.0: o mecanismo de fluxo de trabalho inaugura uma nova era na criação automatizada de humanos digitais

O AIGCPanel, uma poderosa ferramenta para a criação local de humanos digitais, acaba de lançar a versão 2.0.0 — anunciada como “a atualização mais significativa até agora”. Essa reformulação completa

Atualização importante do AIGCPanel 2.0.0: o mecanismo de fluxo de trabalho inaugura uma nova era na criação automatizada de humanos digitais

O AIGCPanel, uma poderosa ferramenta para a criação local de humanos digitais, acaba de lançar a versão 2.0.0 — anunciada como “a atualização mais significativa até agora”. Essa reformulação completa

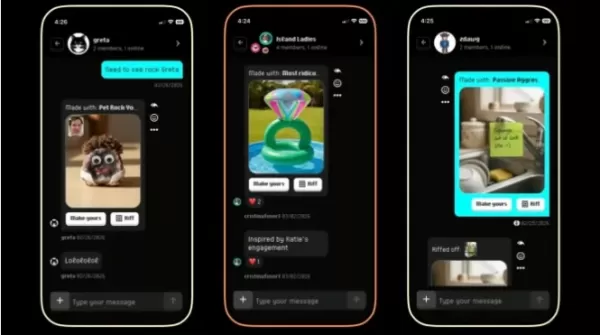

BuzzFeed lança subsidiária de aplicativos inúteis baseados em IA

Em meio a uma grave crise empresarial, a antiga gigante da mídia digital BuzzFeed está lançando uma ambiciosa iniciativa de recuperação impulsionada pela inteligência artificial. Na recente conferênci

Recomendações de tópicos especiais relacionados

Comentários (29)

BuzzFeed lança subsidiária de aplicativos inúteis baseados em IA

Em meio a uma grave crise empresarial, a antiga gigante da mídia digital BuzzFeed está lançando uma ambiciosa iniciativa de recuperação impulsionada pela inteligência artificial. Na recente conferênci

Recomendações de tópicos especiais relacionados

Comentários (29)

![ChristopherBrown]()

加州又出新法案了?SB 1047作者這次推SB 53,要保護吹哨的AI實驗室員工。矽谷大佬們現在應該很頭痛吧🤔 不過這種保護機制確實有必要,畢竟AI發展這麼快,內部監督不能只靠企業自律。但具體執行起來會不會變相鼓勵惡意舉報?法案細節還得再觀察。

![AndrewGarcía]()

Mais uma lei de IA na Califórnia? Parece que os políticos adoram regular uma indústria que mal entendem 😅 Será que dessa vez vão acertar ou só criar mais confusão para as startups? #AImasNaoTanto

![ThomasYoung]()

Mais uma lei de IA na Califórnia? 🙄 Parece que os políticos adoram regular tecnologia que nem entendem. Será que dessa vez vão consultar engenheiros antes de escrever as regras? Pelo menos a proteção contra retaliação faz sentido, mas duvido que vá funcionar na prática...

![JerryLee]()

This new AI bill sounds like a game-changer! Protecting whistleblowers in AI labs is crucial—those folks need a voice without fear of getting canned. But I bet Silicon Valley's big shots are sweating bullets over this one. 😅 Curious to see how it plays out!

![AlbertThomas]()

위너 상원의원의 새로운 AI 법안은 유망하게 들리지만, 꽤 많은 논쟁을 불러일으키고 있어요. AI 연구소 직원들을 보복으로부터 보호하는 것은 중요하지만, 일부는 이것이 혁신을 늦출까봐 걱정하고 있어요. 미묘한 균형이지만, 누군가가 이런 문제를 다루고 있다는 것이 기쁩니다. 어떻게 될지 지켜봐야겠네요! 🤔

![RalphHill]()

O novo projeto de lei de IA do senador Wiener parece promissor, mas está causando bastante debate. Proteger os funcionários dos laboratórios de IA de represálias é importante, mas alguns temem que isso possa desacelerar a inovação. É um equilíbrio delicado, mas estou feliz que alguém esteja abordando esses problemas. Vamos ver como isso se desenrola! 🤔

Senador estadual da Califórnia Scott Wiener, que causou polêmica com o projeto de lei de segurança de IA SB 1047 no último ano, está de volta com outro projeto que promete agitar o Vale do Silício. Na sexta-feira, Wiener apresentou o SB 53, que visa proteger funcionários de grandes laboratórios de IA contra retaliações caso levantem preocupações sobre os sistemas de IA de suas empresas representarem um "risco crítico" para a sociedade. Além disso, o projeto propõe a criação do CalCompute, um cluster de computação em nuvem pública projetado para fornecer a pesquisadores e startups o poder computacional necessário para desenvolver IA para o bem público.

O projeto anterior de Wiener, SB 1047, gerou intenso debate nacional sobre como gerenciar grandes sistemas de IA que poderiam potencialmente levar a eventos catastróficos, como perda significativa de vidas ou ciberataques causando danos superiores a US$ 500 milhões. Apesar da controvérsia, o governador Gavin Newsom vetou o projeto em setembro, argumentando que não era a abordagem correta.

A reação ao SB 1047 foi intensa. Magnatas do Vale do Silício argumentaram que o projeto minaria a vantagem da América na corrida global de IA, alimentada por temores que consideravam infundados de cenários apocalípticos induzidos por IA. Wiener retrucou, acusando alguns capitalistas de risco de orquestrarem uma "campanha de propaganda" contra seu projeto. Notavelmente, a alegação da Y Combinator de que o SB 1047 poderia prender fundadores de startups foi considerada enganosa por especialistas.

O SB 53 parece ser uma mudança estratégica, focando nos elementos menos controversos do SB 1047. Ele enfatiza proteções a denunciantes e o estabelecimento do CalCompute. Wiener, no entanto, não recua em relação aos riscos existenciais da IA. O SB 53 protege claramente denunciantes que acreditam que seus empregadores estão desenvolvendo sistemas de IA que poderiam representar um "risco crítico", definido como um risco previsível ou material que poderia resultar na morte ou lesão grave de mais de 100 pessoas, ou danos superiores a US$ 1 bilhão.

O projeto tem como alvo desenvolvedores de modelos de IA de ponta, como OpenAI, Anthropic e xAI, proibindo-os de retaliar contra funcionários que relatam preocupações ao Procurador-Geral da Califórnia, autoridades federais ou outros funcionários. Esses desenvolvedores também devem relatar aos denunciantes sobre processos internos sinalizados como preocupantes.

Quanto ao CalCompute, o SB 53 criaria um grupo incluindo representantes da Universidade da Califórnia e outros pesquisadores para planejar seu desenvolvimento. Eles decidirão o tamanho do cluster e quem terá acesso a ele.

O SB 53 ainda está nas fases iniciais do processo legislativo, precisando da aprovação dos corpos legislativos da Califórnia antes de chegar à mesa do governador Newsom. A resposta do Vale do Silício a este novo projeto será observada de perto.

Aprovar projetos de lei de segurança de IA em 2025 pode ser mais difícil do que em 2024, quando a Califórnia aprovou 18 projetos relacionados à IA. O movimento de segurança de IA parece estar perdendo força, especialmente após os comentários do vice-presidente J.D. Vance no AI Action Summit de Paris, onde ele enfatizou a inovação em IA em vez da segurança. Embora o CalCompute possa ser visto como uma promoção do progresso da IA, o futuro dos esforços legislativos focados em riscos existenciais da IA permanece incerto.

[ttpp][yyxx]

A OpenAI retira de circulação os modelos de grande porte o3 e GPT-4.5

Como pioneira em inteligência artificial, cada iniciativa técnica da OpenAI causa grande repercussão no setor. Recentemente, a empresa fez um grande anúncio: retirará dois modelos clássicos — o o3 e o

A OpenAI retira de circulação os modelos de grande porte o3 e GPT-4.5

Como pioneira em inteligência artificial, cada iniciativa técnica da OpenAI causa grande repercussão no setor. Recentemente, a empresa fez um grande anúncio: retirará dois modelos clássicos — o o3 e o

Atualização importante do AIGCPanel 2.0.0: o mecanismo de fluxo de trabalho inaugura uma nova era na criação automatizada de humanos digitais

O AIGCPanel, uma poderosa ferramenta para a criação local de humanos digitais, acaba de lançar a versão 2.0.0 — anunciada como “a atualização mais significativa até agora”. Essa reformulação completa

Atualização importante do AIGCPanel 2.0.0: o mecanismo de fluxo de trabalho inaugura uma nova era na criação automatizada de humanos digitais

O AIGCPanel, uma poderosa ferramenta para a criação local de humanos digitais, acaba de lançar a versão 2.0.0 — anunciada como “a atualização mais significativa até agora”. Essa reformulação completa

BuzzFeed lança subsidiária de aplicativos inúteis baseados em IA

Em meio a uma grave crise empresarial, a antiga gigante da mídia digital BuzzFeed está lançando uma ambiciosa iniciativa de recuperação impulsionada pela inteligência artificial. Na recente conferênci

BuzzFeed lança subsidiária de aplicativos inúteis baseados em IA

Em meio a uma grave crise empresarial, a antiga gigante da mídia digital BuzzFeed está lançando uma ambiciosa iniciativa de recuperação impulsionada pela inteligência artificial. Na recente conferênci

加州又出新法案了?SB 1047作者這次推SB 53,要保護吹哨的AI實驗室員工。矽谷大佬們現在應該很頭痛吧🤔 不過這種保護機制確實有必要,畢竟AI發展這麼快,內部監督不能只靠企業自律。但具體執行起來會不會變相鼓勵惡意舉報?法案細節還得再觀察。

Mais uma lei de IA na Califórnia? Parece que os políticos adoram regular uma indústria que mal entendem 😅 Será que dessa vez vão acertar ou só criar mais confusão para as startups? #AImasNaoTanto

Mais uma lei de IA na Califórnia? 🙄 Parece que os políticos adoram regular tecnologia que nem entendem. Será que dessa vez vão consultar engenheiros antes de escrever as regras? Pelo menos a proteção contra retaliação faz sentido, mas duvido que vá funcionar na prática...

This new AI bill sounds like a game-changer! Protecting whistleblowers in AI labs is crucial—those folks need a voice without fear of getting canned. But I bet Silicon Valley's big shots are sweating bullets over this one. 😅 Curious to see how it plays out!

위너 상원의원의 새로운 AI 법안은 유망하게 들리지만, 꽤 많은 논쟁을 불러일으키고 있어요. AI 연구소 직원들을 보복으로부터 보호하는 것은 중요하지만, 일부는 이것이 혁신을 늦출까봐 걱정하고 있어요. 미묘한 균형이지만, 누군가가 이런 문제를 다루고 있다는 것이 기쁩니다. 어떻게 될지 지켜봐야겠네요! 🤔

O novo projeto de lei de IA do senador Wiener parece promissor, mas está causando bastante debate. Proteger os funcionários dos laboratórios de IA de represálias é importante, mas alguns temem que isso possa desacelerar a inovação. É um equilíbrio delicado, mas estou feliz que alguém esteja abordando esses problemas. Vamos ver como isso se desenrola! 🤔

Lar

Lar