AIボイスクローン&ディープフェイク詐欺:詐欺から身を守る方法

デジタル技術の進歩に伴い、サイバー犯罪者はAIを利用した音声クローンやディープフェイク技術など、ますます洗練された手法を導入している。法執行機関は、これらのツールが、信頼できる連絡先になりすまし、高度にパーソナライズされた詐欺を作成するために武器化されていると警告しています。この包括的なガイドでは、このような新たな脅威を検証し、検知戦略を提供し、金銭的・個人的被害から保護するための対策を概説します。

主なポイント

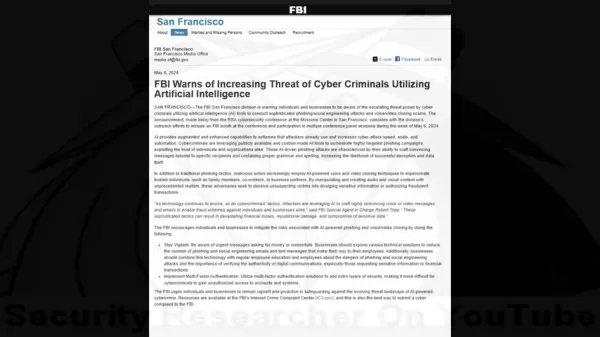

FBIの警告によると、個人や組織を標的としたAIを利用したサイバー犯罪が増加しています。

詐欺師は現在、巧妙な手口で音声クローンやディープフェイク・ビデオ技術を活用しています。

個人情報の取得により、高度な標的型ソーシャル・エンジニアリング攻撃が可能に。

音声/視覚の異常を識別することは、依然として詐欺の検知に不可欠です。

多層的な検証システムとセキュリティ・プロトコルは、不可欠な保護を提供する。

包括的な意識向上トレーニングは、こうした詐欺に対する脆弱性を大幅に軽減する。

AIを利用した詐欺の脅威の高まり

FBIの警告を理解する

セキュリティ専門家とサイバー犯罪者の間のデジタル軍拡競争は、利用しやすいAIツールの出現によって危険な新段階に入った。ニッチな研究技術として始まったものが、詐欺師の手中にある強力な武器となったのだ。

セキュリティ専門家は、犯罪者が従来のソーシャル・エンジニアリングとAIが生成したメディアを組み合わせて、人間の信頼に対する本能を迂回するという憂慮すべき傾向を記録している。FBIの警告は、このようなテクニックが、用心深い懐疑心をも覆すことのできる、前例のない信憑性のある詐欺シナリオをいかにして作り出すかを強調している。

AIボイスクローニングとディープフェイクの仕組み

現代の詐欺の手口は、機械学習と心理操作の不穏な組み合わせを採用している。攻撃者は、成功率を最大化するために綿密なプロセスに従っている。

攻撃のライフサイクルには通常3つの段階がある:

- データ収集:データ収集: 詐欺師は、ソーシャルメディア、スピーチ、ビデオ通話から音声サンプルを採取する。

- 音声合成:AIモデルが音声パターンを分析し、合成レプリカを生成する。

- マルチメディア偽造:高度なツールは、偽の音声を操作されたビデオ要素と同期させる。

金銭的影響の統計

これらのAIを利用した詐欺の金銭的影響は、その壊滅的な有効性を示している:

- 2023年、アメリカ人は音声クローン詐欺によって1億ドル以上を失う。

- 1件あたりの平均損失額は14,000ドル

- 世界の詐欺被害額は年間1兆300億ドル

AI詐欺を見破る検知戦略

攻撃手法

犯罪の手口を理解することは、潜在的なターゲットが赤信号を認識するのに役立ちます:

- 信頼を確立する:既知の連絡先のクローン音声を使用

- 情報を集める:ソーシャル・エンジニアリングでターゲットを調査

- 攻撃の実行パーソナライズされた欺瞞シナリオの展開

AI操作の特定

合成メディアの警告サインには以下が含まれます:

- 一貫性のない声の特徴やテンポ

- 不自然な発話パターンや言い回し

- 音声品質の機械的アーチファクト

- 台本通りに見える感情的な反応

- 個人的な言及における事実誤認

保護対策

検証のベストプラクティス

防御戦略には以下が含まれる:

- 確立された連絡ルートによる独立した検証

- 頻繁な接触による認証コードの事前手配

- 通常とは異なる要求に対する直接の確認

セキュリティの強化

技術的セーフガードには以下が含まれる:

- 多要素認証の義務化

- 定期的なクレデンシャルのローテーション・ポリシー

- 不正監視システム

意識向上トレーニング

教育イニシアチブは以下をカバーすべきである:

- 現在の詐欺の手口とケーススタディ

- 心理操作のテクニック

- 不審な通信に対する対応プロトコル

データ・プライバシー管理

以下の方法により、攻撃対象領域を減らす:

- ソーシャルメディアへの露出の監査

- 個人情報共有の制限

- 厳格なデータ取り扱いポリシーの導入

利点と課題

長所

非常にリアルななりすましを実現

本能的な信頼反応を引き起こす

説得力のあるマルチメディアコンテンツを作成

短所

大きな金銭的損失の可能性

心理的・風評的被害

デジタル信頼エコシステムの侵食

よくある質問

AIボイスクローニングはどのように機能するのですか?

この技術は、音声サンプルを分析し、スピーチパターン、トーン、ケイデンスを模倣した合成レプリカを作成することで、説得力のあるなりすましを可能にします。

ディープフェイク動画の指標は何ですか?

不自然な顔の動き、一貫性のない照明/肌色、エッジ周辺や動作中のアーチファクトを確認してください。

不審な救難信号にはどう対応すべきですか?

何らかの行動を起こしたり、情報を提供したりする前に、複数の独立したチャンネルを通じて確認してください。

関連する質問

AIのディープフェイクは違法ですか?

法的地位は、管轄区域や使用状況によって異なります。ほとんどの国では、詐欺、嫌がらせ、または非合意のコンテンツに使用されるディープフェイクを禁止しています。

AI詐欺から企業を守るには?

主な保護には、従業員トレーニング、技術的セーフガード、検証プロトコル、インシデント対応計画が含まれます。

関連記事

新しいETSI AIセキュリティ規格の概要

ETSI EN 304 223は、組織がガバナンス体制に組み込むべき人工知能に関する基本的なセキュリティ要件を定めています。企業が機械学習を中核的なワークフローに統合する中、この欧州規格はAIモデルおよびシステムを保護するための具体的な規定を定めています。これは、各国標準化機関によって正式に承認された、AIサイバーセキュリティに関する世界的に適用可能な初の欧州規格であり、国際市場におけるその信頼性

新しいETSI AIセキュリティ規格の概要

ETSI EN 304 223は、組織がガバナンス体制に組み込むべき人工知能に関する基本的なセキュリティ要件を定めています。企業が機械学習を中核的なワークフローに統合する中、この欧州規格はAIモデルおよびシステムを保護するための具体的な規定を定めています。これは、各国標準化機関によって正式に承認された、AIサイバーセキュリティに関する世界的に適用可能な初の欧州規格であり、国際市場におけるその信頼性

Gmailが、パーソナライズされたAIインボックスや検索機能のAIサマリーなどを提供開始

Googleは、Gmail向けに新しいAI搭載の受信トレイを導入しました。この機能により、タスクの状況をパーソナライズされた概要で確認でき、重要な更新情報も常に把握できるようになります。これに加え、Gmailでは検索機能に「AI概要」を導入し、Grammarlyに似た校正ツールも提供を開始しています。これまで有料会員限定だったいくつかのAI機能が、すべてのユーザーに利用可能になりました。新しい「A

Gmailが、パーソナライズされたAIインボックスや検索機能のAIサマリーなどを提供開始

Googleは、Gmail向けに新しいAI搭載の受信トレイを導入しました。この機能により、タスクの状況をパーソナライズされた概要で確認でき、重要な更新情報も常に把握できるようになります。これに加え、Gmailでは検索機能に「AI概要」を導入し、Grammarlyに似た校正ツールも提供を開始しています。これまで有料会員限定だったいくつかのAI機能が、すべてのユーザーに利用可能になりました。新しい「A

山東省初の百度AI漫画ドラマ制作拠点が淄博で開設

4月27日、山東省は淄博師範学院にて同省初の「百度AI漫画ドラマ制作拠点」を正式に開設し、デジタル文化コンテンツ制作において新たな節目を迎えた。この拠点は産学連携の新たな一章を切り開き、AI技術と文化コンテンツ制作教育の深い融合を通じて、デジタル文化コンテンツ制作人材を育成するための革新的なモデルを模索することを目指している。除幕式において、大学側は、同基地が革新的な人材育成および政府・大学・企業

関連特集おすすめ

コメント (2)

0/500

山東省初の百度AI漫画ドラマ制作拠点が淄博で開設

4月27日、山東省は淄博師範学院にて同省初の「百度AI漫画ドラマ制作拠点」を正式に開設し、デジタル文化コンテンツ制作において新たな節目を迎えた。この拠点は産学連携の新たな一章を切り開き、AI技術と文化コンテンツ制作教育の深い融合を通じて、デジタル文化コンテンツ制作人材を育成するための革新的なモデルを模索することを目指している。除幕式において、大学側は、同基地が革新的な人材育成および政府・大学・企業

関連特集おすすめ

コメント (2)

0/500

![LarryEvans]()

La technologie de synthèse vocale devient vraiment flippante... J'ai déjà reçu un appel suspect imitant la voix de mon frère. Heureusement que j'ai raccroché à temps 😰 Est-ce qu'on devrait légaliser des mots-code secrets en famille ?

デジタル技術の進歩に伴い、サイバー犯罪者はAIを利用した音声クローンやディープフェイク技術など、ますます洗練された手法を導入している。法執行機関は、これらのツールが、信頼できる連絡先になりすまし、高度にパーソナライズされた詐欺を作成するために武器化されていると警告しています。この包括的なガイドでは、このような新たな脅威を検証し、検知戦略を提供し、金銭的・個人的被害から保護するための対策を概説します。

主なポイント

FBIの警告によると、個人や組織を標的としたAIを利用したサイバー犯罪が増加しています。

詐欺師は現在、巧妙な手口で音声クローンやディープフェイク・ビデオ技術を活用しています。

個人情報の取得により、高度な標的型ソーシャル・エンジニアリング攻撃が可能に。

音声/視覚の異常を識別することは、依然として詐欺の検知に不可欠です。

多層的な検証システムとセキュリティ・プロトコルは、不可欠な保護を提供する。

包括的な意識向上トレーニングは、こうした詐欺に対する脆弱性を大幅に軽減する。

AIを利用した詐欺の脅威の高まり

FBIの警告を理解する

セキュリティ専門家とサイバー犯罪者の間のデジタル軍拡競争は、利用しやすいAIツールの出現によって危険な新段階に入った。ニッチな研究技術として始まったものが、詐欺師の手中にある強力な武器となったのだ。

セキュリティ専門家は、犯罪者が従来のソーシャル・エンジニアリングとAIが生成したメディアを組み合わせて、人間の信頼に対する本能を迂回するという憂慮すべき傾向を記録している。FBIの警告は、このようなテクニックが、用心深い懐疑心をも覆すことのできる、前例のない信憑性のある詐欺シナリオをいかにして作り出すかを強調している。

AIボイスクローニングとディープフェイクの仕組み

現代の詐欺の手口は、機械学習と心理操作の不穏な組み合わせを採用している。攻撃者は、成功率を最大化するために綿密なプロセスに従っている。

攻撃のライフサイクルには通常3つの段階がある:

- データ収集:データ収集: 詐欺師は、ソーシャルメディア、スピーチ、ビデオ通話から音声サンプルを採取する。

- 音声合成:AIモデルが音声パターンを分析し、合成レプリカを生成する。

- マルチメディア偽造:高度なツールは、偽の音声を操作されたビデオ要素と同期させる。

金銭的影響の統計

これらのAIを利用した詐欺の金銭的影響は、その壊滅的な有効性を示している:

- 2023年、アメリカ人は音声クローン詐欺によって1億ドル以上を失う。

- 1件あたりの平均損失額は14,000ドル

- 世界の詐欺被害額は年間1兆300億ドル

AI詐欺を見破る検知戦略

攻撃手法

犯罪の手口を理解することは、潜在的なターゲットが赤信号を認識するのに役立ちます:

- 信頼を確立する:既知の連絡先のクローン音声を使用

- 情報を集める:ソーシャル・エンジニアリングでターゲットを調査

- 攻撃の実行パーソナライズされた欺瞞シナリオの展開

AI操作の特定

合成メディアの警告サインには以下が含まれます:

- 一貫性のない声の特徴やテンポ

- 不自然な発話パターンや言い回し

- 音声品質の機械的アーチファクト

- 台本通りに見える感情的な反応

- 個人的な言及における事実誤認

保護対策

検証のベストプラクティス

防御戦略には以下が含まれる:

- 確立された連絡ルートによる独立した検証

- 頻繁な接触による認証コードの事前手配

- 通常とは異なる要求に対する直接の確認

セキュリティの強化

技術的セーフガードには以下が含まれる:

- 多要素認証の義務化

- 定期的なクレデンシャルのローテーション・ポリシー

- 不正監視システム

意識向上トレーニング

教育イニシアチブは以下をカバーすべきである:

- 現在の詐欺の手口とケーススタディ

- 心理操作のテクニック

- 不審な通信に対する対応プロトコル

データ・プライバシー管理

以下の方法により、攻撃対象領域を減らす:

- ソーシャルメディアへの露出の監査

- 個人情報共有の制限

- 厳格なデータ取り扱いポリシーの導入

利点と課題

長所

非常にリアルななりすましを実現

本能的な信頼反応を引き起こす

説得力のあるマルチメディアコンテンツを作成

短所

大きな金銭的損失の可能性

心理的・風評的被害

デジタル信頼エコシステムの侵食

よくある質問

AIボイスクローニングはどのように機能するのですか?

この技術は、音声サンプルを分析し、スピーチパターン、トーン、ケイデンスを模倣した合成レプリカを作成することで、説得力のあるなりすましを可能にします。

ディープフェイク動画の指標は何ですか?

不自然な顔の動き、一貫性のない照明/肌色、エッジ周辺や動作中のアーチファクトを確認してください。

不審な救難信号にはどう対応すべきですか?

何らかの行動を起こしたり、情報を提供したりする前に、複数の独立したチャンネルを通じて確認してください。

関連する質問

AIのディープフェイクは違法ですか?

法的地位は、管轄区域や使用状況によって異なります。ほとんどの国では、詐欺、嫌がらせ、または非合意のコンテンツに使用されるディープフェイクを禁止しています。

AI詐欺から企業を守るには?

主な保護には、従業員トレーニング、技術的セーフガード、検証プロトコル、インシデント対応計画が含まれます。

新しいETSI AIセキュリティ規格の概要

ETSI EN 304 223は、組織がガバナンス体制に組み込むべき人工知能に関する基本的なセキュリティ要件を定めています。企業が機械学習を中核的なワークフローに統合する中、この欧州規格はAIモデルおよびシステムを保護するための具体的な規定を定めています。これは、各国標準化機関によって正式に承認された、AIサイバーセキュリティに関する世界的に適用可能な初の欧州規格であり、国際市場におけるその信頼性

新しいETSI AIセキュリティ規格の概要

ETSI EN 304 223は、組織がガバナンス体制に組み込むべき人工知能に関する基本的なセキュリティ要件を定めています。企業が機械学習を中核的なワークフローに統合する中、この欧州規格はAIモデルおよびシステムを保護するための具体的な規定を定めています。これは、各国標準化機関によって正式に承認された、AIサイバーセキュリティに関する世界的に適用可能な初の欧州規格であり、国際市場におけるその信頼性

Gmailが、パーソナライズされたAIインボックスや検索機能のAIサマリーなどを提供開始

Googleは、Gmail向けに新しいAI搭載の受信トレイを導入しました。この機能により、タスクの状況をパーソナライズされた概要で確認でき、重要な更新情報も常に把握できるようになります。これに加え、Gmailでは検索機能に「AI概要」を導入し、Grammarlyに似た校正ツールも提供を開始しています。これまで有料会員限定だったいくつかのAI機能が、すべてのユーザーに利用可能になりました。新しい「A

Gmailが、パーソナライズされたAIインボックスや検索機能のAIサマリーなどを提供開始

Googleは、Gmail向けに新しいAI搭載の受信トレイを導入しました。この機能により、タスクの状況をパーソナライズされた概要で確認でき、重要な更新情報も常に把握できるようになります。これに加え、Gmailでは検索機能に「AI概要」を導入し、Grammarlyに似た校正ツールも提供を開始しています。これまで有料会員限定だったいくつかのAI機能が、すべてのユーザーに利用可能になりました。新しい「A

山東省初の百度AI漫画ドラマ制作拠点が淄博で開設

4月27日、山東省は淄博師範学院にて同省初の「百度AI漫画ドラマ制作拠点」を正式に開設し、デジタル文化コンテンツ制作において新たな節目を迎えた。この拠点は産学連携の新たな一章を切り開き、AI技術と文化コンテンツ制作教育の深い融合を通じて、デジタル文化コンテンツ制作人材を育成するための革新的なモデルを模索することを目指している。除幕式において、大学側は、同基地が革新的な人材育成および政府・大学・企業

山東省初の百度AI漫画ドラマ制作拠点が淄博で開設

4月27日、山東省は淄博師範学院にて同省初の「百度AI漫画ドラマ制作拠点」を正式に開設し、デジタル文化コンテンツ制作において新たな節目を迎えた。この拠点は産学連携の新たな一章を切り開き、AI技術と文化コンテンツ制作教育の深い融合を通じて、デジタル文化コンテンツ制作人材を育成するための革新的なモデルを模索することを目指している。除幕式において、大学側は、同基地が革新的な人材育成および政府・大学・企業

La technologie de synthèse vocale devient vraiment flippante... J'ai déjà reçu un appel suspect imitant la voix de mon frère. Heureusement que j'ai raccroché à temps 😰 Est-ce qu'on devrait légaliser des mots-code secrets en famille ?

家

家