Les images générées par l'IA suscitent des controverses sur l'intégrité électorale

L'avènement de l'intelligence artificielle a entraîné une vague d'avancées technologiques, mais il a également semé le trouble dans notre capacité à distinguer le vrai du faux. Récemment, les images générées par l'IA circulant sur les réseaux sociaux ont suscité des inquiétudes quant à leur potentiel à fausser les conversations politiques et à menacer l'intégrité des élections. Il est crucial que nous comprenions pleinement l'ampleur de ces technologies pour maintenir des discussions publiques informées et préserver la confiance en ce que nous voyons.

La controverse des images politiques générées par l'IA

L'essor du contenu généré par l'IA

L'intelligence artificielle a atteint un point où elle peut créer des images, des vidéos et des audios qui semblent incroyablement réels. C'est une prouesse impressionnante, sans aucun doute, mais c'est aussi un peu effrayant, surtout en matière de politique et d'élections. Le pouvoir de produire un contenu convaincant mais totalement fictif peut déstabiliser le public et ébranler notre confiance dans les informations que nous consommons. La capacité des réseaux sociaux à propager ce contenu à une vitesse fulgurante aggrave les choses, rendant difficile la maîtrise du récit et l'arrêt de la désinformation.

À mesure que les outils d'IA deviennent plus accessibles, il est plus facile que jamais pour quiconque ayant de mauvaises intentions de manipuler l'opinion publique. Ces créations d'IA, souvent appelées médias synthétiques ou deepfakes, mettent à l'épreuve notre capacité à penser de manière critique et à rester avertis des médias. Le potentiel de déformer la perception publique et d'éroder la confiance dans nos institutions est un problème majeur, nous poussant à prendre des mesures proactives et à établir des limites éthiques pour contenir les risques.

Les campagnes politiques peuvent utiliser cette technologie pour simuler des soutiens ou diffamer des adversaires, influençant ainsi le vote des électeurs. Sans signes clairs ou outils pour repérer ces faux, le grand public pourrait avoir du mal à distinguer le vrai du faux, prenant des décisions basées sur de fausses informations. Ce type de tromperie généralisée pourrait ébranler les fondements mêmes de la démocratie, rendant urgent de trouver des solutions technologiques et politiques pour y faire face.

Alors, comment nous protéger contre l'utilisation abusive de l'IA dans les campagnes politiques et garantir que les électeurs aient accès à la vérité ? Cela nécessitera une combinaison d'avancées technologiques, d'éducation à la culture médiatique et de cadres politiques solides. L'utilisation de contenus générés par l'IA soulève d'importantes questions sur l'honnêteté, la transparence et la responsabilité, soulignant le besoin pour chacun de s'impliquer et de défendre les valeurs démocratiques à l'ère de l'IA.

L'utilisation d'images générées par l'IA par Trump

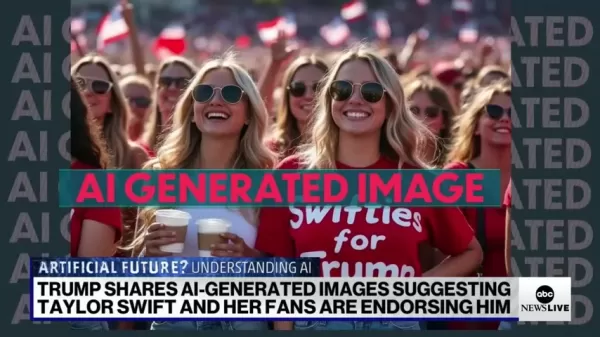

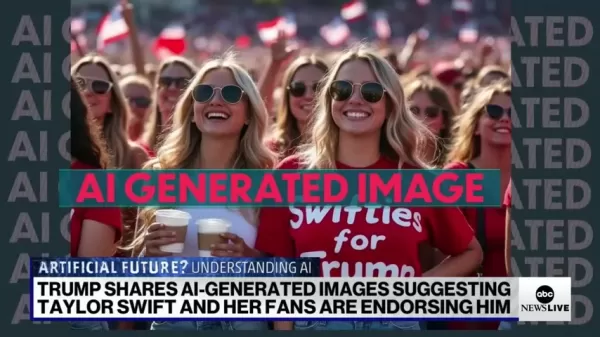

L'ancien président Trump a déclenché une tempête en publiant des images générées par l'IA sur les réseaux sociaux, suscitant un débat animé sur l'éthique et les conséquences de l'utilisation de tels contenus en politique.

En partageant des images suggérant que Taylor Swift et ses fans le soutenaient, Trump a soulevé des questions sur la manipulation de son image publique. Certaines de ces images étaient réelles, tandis que d'autres étaient générées par l'IA, causant confusion et soulevant des interrogations sur le niveau de transparence requis dans les messages politiques.

Les images montraient des femmes portant des t-shirts "Swifties pour Trump", suggérant un soutien de la part d'un groupe qui pourrait ne pas réellement partager ses idées politiques. Cette démarche soulève des questions éthiques sur la légitimité d'utiliser l'IA pour simuler des soutiens ou manipuler l'opinion publique. Ne pas indiquer clairement que certaines images étaient générées par l'IA ne fait qu'embrouiller davantage les choses, pouvant tromper ceux qui ignorent qu'ils regardent quelque chose d'artificiel.

Bien que certaines images aient été effectivement générées par l'IA, d'autres étaient de véritables photos de partisans de Trump. Mélanger le réel et le faux ainsi peut compliquer la tâche des spectateurs pour distinguer ce qui est vrai, brouillant les frontières entre les messages honnêtes et trompeurs. Cette confusion peut éroder la confiance et semer le doute dans les discussions publiques, car les gens perdent confiance en leur capacité à distinguer le vrai du faux.

Le partage de ces images pourrait également être perçu comme une stratégie pour séduire des groupes d'électeurs spécifiques, comme les fans de Taylor Swift, qu'ils le soutiennent réellement ou non. En créant l'illusion d'un soutien généralisé, même artificiellement généré, les campagnes politiques pourraient influencer les électeurs indécis ou galvaniser leur base. Cela montre comment l'IA peut être un outil puissant de persuasion, capable de façonner l'opinion publique et d'influencer les résultats des élections.

Lorsque de grandes figures politiques utilisent du contenu généré par l'IA, c'est un signal d'alarme pour le public, qui doit être plus vigilant et averti des médias. À mesure que la technologie de l'IA progresse, il est crucial pour les individus de réfléchir de manière critique au contenu qu'ils voient en ligne et de rechercher des sources fiables. Les médias, les écoles et les agences gouvernementales ont tous un rôle à jouer pour renforcer la pensée critique et sensibiliser aux dangers des médias manipulés.

Confusion et désinformation

Le partage d'images générées par l'IA et d'autres contenus manipulés en ligne alimente un problème croissant de confusion et de désinformation.

Lorsque les gens sont confrontés à un mélange d'informations vraies et fausses, il est difficile de démêler le vrai. Ce désordre peut éroder la confiance dans les médias, les institutions et même les relations personnelles, rendant difficile un consensus sur des questions importantes.

L'un des plus grands obstacles dans la lutte contre la désinformation est la rapidité avec laquelle elle se propage sur les réseaux sociaux. Les contenus faux ou trompeurs peuvent devenir viraux en un éclair, atteignant des millions de personnes avant que les vérificateurs de faits ne puissent réagir. Cette propagation rapide rend difficile l'arrêt des dégâts causés par la désinformation, car elle peut s'enraciner dans l'esprit des gens et influencer leurs opinions.

Un autre défi est la sophistication des techniques de manipulation modernes. Les contenus générés par l'IA, les deepfakes et autres médias synthétiques deviennent si convaincants que même les experts ont du mal à les repérer. Cela signifie que les vérifications des faits traditionnelles et l'analyse des médias ne suffisent plus, nous poussant à développer de nouveaux outils et méthodes pour riposter.

Les chambres d'écho et les bulles de filtrage en ligne aggravent les choses. Les algorithmes des réseaux sociaux nous montrent souvent des contenus correspondant à nos points de vue existants, créant des chambres d'écho où nous sommes principalement exposés à des perspectives similaires. Cela peut renforcer nos biais et compliquer l'engagement avec des points de vue différents, entraînant plus de polarisation et de division.

Pour lutter contre la confusion et la désinformation, nous avons besoin d'une approche multidimensionnelle incluant des solutions technologiques, une éducation à la culture médiatique et des changements politiques. Les plateformes de réseaux sociaux devraient investir dans des outils alimentés par l'IA pour repérer et signaler les contenus manipulés. Les écoles devraient enseigner la culture médiatique, montrant aux élèves comment évaluer les sources de manière critique et repérer les techniques de manipulation. Les décideurs politiques devraient envisager des réglementations qui tiennent les gens responsables de la propagation de désinformation tout en protégeant la liberté d'expression. Ce n'est qu'en travaillant ensemble que nous pouvons espérer freiner la propagation de la désinformation et favoriser un public plus informé et engagé.

Examen des images réelles par rapport aux images générées par l'IA

Le défi de distinguer l'authenticité

Différencier les images réelles de celles générées par l'IA devient de plus en plus difficile chaque jour, grâce à la sophistication de l'intelligence artificielle. L'IA peut désormais créer des images si réalistes qu'il est difficile pour une personne moyenne de les distinguer des vraies photos. Cette capacité a des implications majeures sur la confiance que nous pouvons accorder à ce que nous voyons, en particulier dans des domaines sensibles comme les nouvelles et les communications politiques.

Une des raisons pour lesquelles il est si difficile de repérer la différence est la rapidité avec laquelle les algorithmes d'IA s'améliorent. Ces algorithmes deviennent très doués pour reproduire les textures, l'éclairage et les détails des scènes réelles, créant des images presque impossibles à distinguer du réel. De plus, l'IA peut créer des images de personnes, d'objets et d'événements qui n'ont jamais existé, fabriquant des réalités convaincantes mais totalement fictives.

Un autre facteur est que beaucoup de gens connaissent peu les techniques de manipulation de l'IA. Sans une compréhension de base de ce que l'IA peut faire, il est plus facile pour les gens d'être trompés. Si vous ne savez pas comment fonctionne l'IA, il est difficile d'évaluer de manière critique les images que vous voyez en ligne.

Le manque d'étiquetage clair et de transparence rend les choses encore plus compliquées. Les réseaux sociaux et les médias ne marquent souvent pas les images générées par l'IA, laissant aux spectateurs le soin de déterminer ce qui est réel. Ce manque de transparence facilite la propagation de contenus trompeurs, car les gens pourraient supposer que les images non étiquetées sont authentiques.

Pour relever ces défis, nous avons besoin d'une approche à plusieurs volets qui inclut des solutions technologiques, une éducation à la culture médiatique et des changements politiques. Les solutions technologiques, comme les outils de détection alimentés par l'IA, peuvent aider à repérer et signaler les images manipulées. L'éducation à la culture médiatique peut apprendre aux gens à évaluer les sources de manière critique et à repérer les techniques de manipulation. Les changements politiques peuvent promouvoir plus de transparence et de responsabilité dans l'utilisation des contenus générés par l'IA.

En combinant ces efforts, nous pouvons mieux nous protéger contre l'utilisation trompeuse de l'IA dans les médias visuels et renforcer la confiance dans les images qui façonnent nos discussions publiques. Développer et adopter largement ces outils est crucial pour maintenir l'honnêteté des médias visuels et garantir que les gens puissent prendre des décisions éclairées basées sur des informations fiables.

Stratégies pour repérer les contenus générés par l'IA

Guide étape par étape pour la vérification visuelle

Avec des contenus générés par l'IA de plus en plus sophistiqués, il est important d'être vigilant et d'utiliser des méthodes spécifiques pour vérifier l'authenticité de ce que nous voyons. Voici un guide étape par étape pour vous aider :

- Examinez les détails de l'image : Regardez de près l'image pour repérer tout ce qui semble anormal. Les images générées par l'IA présentent souvent des défauts ou des incohérences subtiles. Cherchez :

- Textures non naturelles : Textures qui semblent trop lisses ou manquent de détails attendus.

- Anomalies d'éclairage : Éclairage qui ne correspond pas à la scène ou présente des ombres incohérentes.

- Distorsions de l'arrière-plan : Éléments d'arrière-plan flous ou qui n'ont pas de sens.

- Recherche d'image inversée : Utilisez des moteurs de recherche comme Google Images, TinEye ou Yandex Images pour effectuer une recherche d'image inversée. Cela peut vous aider à voir si l'image a été utilisée ailleurs ou correspond à des motifs connus générés par l'IA.

- Vérifiez la source : Assurez-vous que la source qui a publié l'image est crédible. Recherchez des médias réputés, des sites web officiels ou des organisations de confiance. Méfiez-vous des sources anonymes ou des sites connus pour propager de la désinformation.

- Recoupez les informations : Comparez l'image et les informations qui l'accompagnent avec d'autres sources pour confirmer leur exactitude. Vérifiez auprès de plusieurs médias, sites de vérification des faits et experts pour vous assurer que tout correspond.

- Utilisez des outils de détection d'IA : Utilisez des outils de détection d'IA qui peuvent analyser les images et repérer les contenus potentiellement générés par l'IA. Ces outils s'améliorent pour fournir des informations sur la possible manipulation d'une image.

- Consultez des experts : Si vous avez encore des doutes, consultez des experts en analyse numérique ou en analyse des médias. Ils disposent des connaissances et des outils spécialisés pour repérer les signes subtils de manipulation.

En suivant ces étapes, vous pouvez améliorer votre capacité à repérer les contenus générés par l'IA et vous protéger contre la désinformation. Rester informé et un peu sceptique est essentiel dans le monde numérique d'aujourd'hui, où les images trompeuses peuvent se propager rapidement et influencer l'opinion publique. Un public sceptique et informé est crucial pour maintenir la confiance et la crédibilité à l'ère de l'IA.

Évaluation des images générées par l'IA : avantages et inconvénients

Avantages

- Créativité accrue : L'IA peut stimuler la créativité en générant de nouvelles combinaisons et styles d'images.

- Efficacité de la création de contenu : L'IA rend la création de contenu plus rapide et efficace, économisant temps et ressources.

- Accessibilité : L'IA rend la génération d'images accessible à tous, pas seulement aux professionnels.

- Personnalisation : L'IA permet une génération d'images hautement personnalisée pour répondre à des besoins spécifiques.

Inconvénients

- Risque de désinformation : L'IA facilite la création et la propagation d'images trompeuses.

- Problèmes d'authenticité : L'IA brouille la frontière entre le vrai et le faux, rendant difficile la confiance en ce que nous voyons.

- Questions éthiques : L'IA soulève des questions éthiques sur la manipulation, la transparence et la responsabilité.

- Perte d'emplois : L'IA pourrait remplacer les artistes et créateurs de contenu humains à mesure que l'automatisation augmente.

Questions fréquemment posées

Comment puis-je identifier efficacement les images générées par l'IA ?

Pour repérer les images générées par l'IA, il faut examiner attentivement les détails et utiliser les outils à votre disposition. Vérifiez les incohérences dans l'éclairage, les textures et les éléments d'arrière-plan. Utilisez des recherches d'images inversées pour voir si l'image a été utilisée ailleurs. Les outils de détection d'IA peuvent fournir des informations sur une possible manipulation de l'image. Recouper les informations avec plusieurs sources et consulter des experts peut confirmer davantage l'authenticité de l'image.

Quelles sont les solutions potentielles pour lutter contre la propagation de la désinformation générée par l'IA ?

Lutter contre la désinformation générée par l'IA nécessite une approche multidimensionnelle. Nous avons besoin de solutions technologiques, d'une éducation à la culture médiatique et de changements politiques. Les plateformes de réseaux sociaux devraient investir dans des outils de détection d'IA, tandis que les écoles devraient enseigner la culture médiatique. Les décideurs politiques devraient envisager des réglementations qui favorisent la transparence et la responsabilité dans l'utilisation des contenus générés par l'IA.

Comment les images générées par l'IA affectent-elles l'intégrité des élections ?

Les images générées par l'IA peuvent compromettre l'intégrité des élections en propageant de la désinformation et en manipulant l'opinion publique. Les faux soutiens, les représentations négatives des candidats et autres contenus trompeurs peuvent influencer le sentiment des électeurs et affecter les résultats des élections. Mélanger contenu réel et faux érode la confiance et introduit de l'incertitude dans les discussions publiques.

Pourquoi est-il important d'étiqueter les contenus générés par l'IA ?

Étiqueter les contenus générés par l'IA est crucial pour la transparence et la responsabilité. Sans étiquettes claires, les gens pourraient consommer des médias manipulés sans le savoir, ce qui conduit à des décisions mal informées. L'étiquetage aide les spectateurs à évaluer de manière critique le contenu et à faire des jugements éclairés sur son exactitude et sa validité.

Questions connexes

Quel rôle jouent les plateformes de réseaux sociaux dans la lutte contre la désinformation générée par l'IA ?

Les plateformes de réseaux sociaux ont un rôle important à jouer pour lutter contre la désinformation générée par l'IA. Elles doivent investir dans des outils de détection d'IA, mettre en place des politiques d'étiquetage claires et promouvoir la culture médiatique parmi leurs utilisateurs. En prenant des mesures proactives pour combattre les contenus trompeurs, les plateformes de réseaux sociaux peuvent aider à protéger l'intégrité des élections et maintenir la confiance du public.

Comment les institutions éducatives peuvent-elles promouvoir la culture médiatique et les compétences de pensée critique ?

Les institutions éducatives peuvent promouvoir la culture médiatique et la pensée critique en les intégrant dans leurs programmes. Les élèves devraient apprendre à évaluer les sources d'information, à repérer les techniques de manipulation et à recouper les informations avec plusieurs sources. En favorisant la pensée critique, les écoles peuvent former des citoyens informés et engagés, moins susceptibles de tomber dans le piège de la désinformation.

Quelles réglementations ou politiques pourraient aider à lutter contre la désinformation générée par l'IA sans porter atteinte à la liberté d'expression ?

Lutter contre la désinformation générée par l'IA tout en protégeant la liberté d'expression nécessite une élaboration minutieuse des politiques. Les exigences de transparence, comme l'étiquetage obligatoire des contenus générés par l'IA, peuvent informer le public sans restreindre la parole. Des mesures de responsabilité, comme tenir les gens responsables de la propagation de désinformation connue, peuvent dissuader les mauvais acteurs. Trouver le bon équilibre entre réglementation et liberté d'expression est essentiel pour maintenir un discours public sain et démocratique.

Article connexe

Claude a été utilisé pour créer des paquets npm malveillants : plus de 670 paquets compromis menacent l'open source

Un incident de cybersécurité récent met en lumière la manière dont les grands modèles linguistiques (LLM) sont détournés pour développer des logiciels malveillants. Le chercheur en sécurité Sibi Moosa

Claude a été utilisé pour créer des paquets npm malveillants : plus de 670 paquets compromis menacent l'open source

Un incident de cybersécurité récent met en lumière la manière dont les grands modèles linguistiques (LLM) sont détournés pour développer des logiciels malveillants. Le chercheur en sécurité Sibi Moosa

Reliance dévoile un plan d'investissement de 110 milliards de dollars dans l'IA alors que l'Inde accélère sa transition technologique

Mukesh Ambani, le président milliardaire du conglomérat indien Reliance, a annoncé jeudi un plan de 10 000 milliards de roupies (environ 110 milliards de dollars) visant à mettre en place une infrastr

Reliance dévoile un plan d'investissement de 110 milliards de dollars dans l'IA alors que l'Inde accélère sa transition technologique

Mukesh Ambani, le président milliardaire du conglomérat indien Reliance, a annoncé jeudi un plan de 10 000 milliards de roupies (environ 110 milliards de dollars) visant à mettre en place une infrastr

Zhiyuan WITA met fin à son projet d'interaction avec des robots « nus » en déposant sa première demande d'agrément

Le secteur de l'intelligence incarnée a franchi une étape importante. Selon la dernière annonce de l'Administration du cyberespace de Shanghai, le grand modèle WITA développé par Zhiyuan a mené à bien

Recommandations de sujets spéciaux liés

commentaires (2)

Zhiyuan WITA met fin à son projet d'interaction avec des robots « nus » en déposant sa première demande d'agrément

Le secteur de l'intelligence incarnée a franchi une étape importante. Selon la dernière annonce de l'Administration du cyberespace de Shanghai, le grand modèle WITA développé par Zhiyuan a mené à bien

Recommandations de sujets spéciaux liés

commentaires (2)

L'avènement de l'intelligence artificielle a entraîné une vague d'avancées technologiques, mais il a également semé le trouble dans notre capacité à distinguer le vrai du faux. Récemment, les images générées par l'IA circulant sur les réseaux sociaux ont suscité des inquiétudes quant à leur potentiel à fausser les conversations politiques et à menacer l'intégrité des élections. Il est crucial que nous comprenions pleinement l'ampleur de ces technologies pour maintenir des discussions publiques informées et préserver la confiance en ce que nous voyons.

La controverse des images politiques générées par l'IA

L'essor du contenu généré par l'IA

L'intelligence artificielle a atteint un point où elle peut créer des images, des vidéos et des audios qui semblent incroyablement réels. C'est une prouesse impressionnante, sans aucun doute, mais c'est aussi un peu effrayant, surtout en matière de politique et d'élections. Le pouvoir de produire un contenu convaincant mais totalement fictif peut déstabiliser le public et ébranler notre confiance dans les informations que nous consommons. La capacité des réseaux sociaux à propager ce contenu à une vitesse fulgurante aggrave les choses, rendant difficile la maîtrise du récit et l'arrêt de la désinformation.

À mesure que les outils d'IA deviennent plus accessibles, il est plus facile que jamais pour quiconque ayant de mauvaises intentions de manipuler l'opinion publique. Ces créations d'IA, souvent appelées médias synthétiques ou deepfakes, mettent à l'épreuve notre capacité à penser de manière critique et à rester avertis des médias. Le potentiel de déformer la perception publique et d'éroder la confiance dans nos institutions est un problème majeur, nous poussant à prendre des mesures proactives et à établir des limites éthiques pour contenir les risques.

Les campagnes politiques peuvent utiliser cette technologie pour simuler des soutiens ou diffamer des adversaires, influençant ainsi le vote des électeurs. Sans signes clairs ou outils pour repérer ces faux, le grand public pourrait avoir du mal à distinguer le vrai du faux, prenant des décisions basées sur de fausses informations. Ce type de tromperie généralisée pourrait ébranler les fondements mêmes de la démocratie, rendant urgent de trouver des solutions technologiques et politiques pour y faire face.

Alors, comment nous protéger contre l'utilisation abusive de l'IA dans les campagnes politiques et garantir que les électeurs aient accès à la vérité ? Cela nécessitera une combinaison d'avancées technologiques, d'éducation à la culture médiatique et de cadres politiques solides. L'utilisation de contenus générés par l'IA soulève d'importantes questions sur l'honnêteté, la transparence et la responsabilité, soulignant le besoin pour chacun de s'impliquer et de défendre les valeurs démocratiques à l'ère de l'IA.

L'utilisation d'images générées par l'IA par Trump

L'ancien président Trump a déclenché une tempête en publiant des images générées par l'IA sur les réseaux sociaux, suscitant un débat animé sur l'éthique et les conséquences de l'utilisation de tels contenus en politique.

En partageant des images suggérant que Taylor Swift et ses fans le soutenaient, Trump a soulevé des questions sur la manipulation de son image publique. Certaines de ces images étaient réelles, tandis que d'autres étaient générées par l'IA, causant confusion et soulevant des interrogations sur le niveau de transparence requis dans les messages politiques.

Les images montraient des femmes portant des t-shirts "Swifties pour Trump", suggérant un soutien de la part d'un groupe qui pourrait ne pas réellement partager ses idées politiques. Cette démarche soulève des questions éthiques sur la légitimité d'utiliser l'IA pour simuler des soutiens ou manipuler l'opinion publique. Ne pas indiquer clairement que certaines images étaient générées par l'IA ne fait qu'embrouiller davantage les choses, pouvant tromper ceux qui ignorent qu'ils regardent quelque chose d'artificiel.

Bien que certaines images aient été effectivement générées par l'IA, d'autres étaient de véritables photos de partisans de Trump. Mélanger le réel et le faux ainsi peut compliquer la tâche des spectateurs pour distinguer ce qui est vrai, brouillant les frontières entre les messages honnêtes et trompeurs. Cette confusion peut éroder la confiance et semer le doute dans les discussions publiques, car les gens perdent confiance en leur capacité à distinguer le vrai du faux.

Le partage de ces images pourrait également être perçu comme une stratégie pour séduire des groupes d'électeurs spécifiques, comme les fans de Taylor Swift, qu'ils le soutiennent réellement ou non. En créant l'illusion d'un soutien généralisé, même artificiellement généré, les campagnes politiques pourraient influencer les électeurs indécis ou galvaniser leur base. Cela montre comment l'IA peut être un outil puissant de persuasion, capable de façonner l'opinion publique et d'influencer les résultats des élections.

Lorsque de grandes figures politiques utilisent du contenu généré par l'IA, c'est un signal d'alarme pour le public, qui doit être plus vigilant et averti des médias. À mesure que la technologie de l'IA progresse, il est crucial pour les individus de réfléchir de manière critique au contenu qu'ils voient en ligne et de rechercher des sources fiables. Les médias, les écoles et les agences gouvernementales ont tous un rôle à jouer pour renforcer la pensée critique et sensibiliser aux dangers des médias manipulés.

Confusion et désinformation

Le partage d'images générées par l'IA et d'autres contenus manipulés en ligne alimente un problème croissant de confusion et de désinformation.

Lorsque les gens sont confrontés à un mélange d'informations vraies et fausses, il est difficile de démêler le vrai. Ce désordre peut éroder la confiance dans les médias, les institutions et même les relations personnelles, rendant difficile un consensus sur des questions importantes.

L'un des plus grands obstacles dans la lutte contre la désinformation est la rapidité avec laquelle elle se propage sur les réseaux sociaux. Les contenus faux ou trompeurs peuvent devenir viraux en un éclair, atteignant des millions de personnes avant que les vérificateurs de faits ne puissent réagir. Cette propagation rapide rend difficile l'arrêt des dégâts causés par la désinformation, car elle peut s'enraciner dans l'esprit des gens et influencer leurs opinions.

Un autre défi est la sophistication des techniques de manipulation modernes. Les contenus générés par l'IA, les deepfakes et autres médias synthétiques deviennent si convaincants que même les experts ont du mal à les repérer. Cela signifie que les vérifications des faits traditionnelles et l'analyse des médias ne suffisent plus, nous poussant à développer de nouveaux outils et méthodes pour riposter.

Les chambres d'écho et les bulles de filtrage en ligne aggravent les choses. Les algorithmes des réseaux sociaux nous montrent souvent des contenus correspondant à nos points de vue existants, créant des chambres d'écho où nous sommes principalement exposés à des perspectives similaires. Cela peut renforcer nos biais et compliquer l'engagement avec des points de vue différents, entraînant plus de polarisation et de division.

Pour lutter contre la confusion et la désinformation, nous avons besoin d'une approche multidimensionnelle incluant des solutions technologiques, une éducation à la culture médiatique et des changements politiques. Les plateformes de réseaux sociaux devraient investir dans des outils alimentés par l'IA pour repérer et signaler les contenus manipulés. Les écoles devraient enseigner la culture médiatique, montrant aux élèves comment évaluer les sources de manière critique et repérer les techniques de manipulation. Les décideurs politiques devraient envisager des réglementations qui tiennent les gens responsables de la propagation de désinformation tout en protégeant la liberté d'expression. Ce n'est qu'en travaillant ensemble que nous pouvons espérer freiner la propagation de la désinformation et favoriser un public plus informé et engagé.

Examen des images réelles par rapport aux images générées par l'IA

Le défi de distinguer l'authenticité

Différencier les images réelles de celles générées par l'IA devient de plus en plus difficile chaque jour, grâce à la sophistication de l'intelligence artificielle. L'IA peut désormais créer des images si réalistes qu'il est difficile pour une personne moyenne de les distinguer des vraies photos. Cette capacité a des implications majeures sur la confiance que nous pouvons accorder à ce que nous voyons, en particulier dans des domaines sensibles comme les nouvelles et les communications politiques.

Une des raisons pour lesquelles il est si difficile de repérer la différence est la rapidité avec laquelle les algorithmes d'IA s'améliorent. Ces algorithmes deviennent très doués pour reproduire les textures, l'éclairage et les détails des scènes réelles, créant des images presque impossibles à distinguer du réel. De plus, l'IA peut créer des images de personnes, d'objets et d'événements qui n'ont jamais existé, fabriquant des réalités convaincantes mais totalement fictives.

Un autre facteur est que beaucoup de gens connaissent peu les techniques de manipulation de l'IA. Sans une compréhension de base de ce que l'IA peut faire, il est plus facile pour les gens d'être trompés. Si vous ne savez pas comment fonctionne l'IA, il est difficile d'évaluer de manière critique les images que vous voyez en ligne.

Le manque d'étiquetage clair et de transparence rend les choses encore plus compliquées. Les réseaux sociaux et les médias ne marquent souvent pas les images générées par l'IA, laissant aux spectateurs le soin de déterminer ce qui est réel. Ce manque de transparence facilite la propagation de contenus trompeurs, car les gens pourraient supposer que les images non étiquetées sont authentiques.

Pour relever ces défis, nous avons besoin d'une approche à plusieurs volets qui inclut des solutions technologiques, une éducation à la culture médiatique et des changements politiques. Les solutions technologiques, comme les outils de détection alimentés par l'IA, peuvent aider à repérer et signaler les images manipulées. L'éducation à la culture médiatique peut apprendre aux gens à évaluer les sources de manière critique et à repérer les techniques de manipulation. Les changements politiques peuvent promouvoir plus de transparence et de responsabilité dans l'utilisation des contenus générés par l'IA.

En combinant ces efforts, nous pouvons mieux nous protéger contre l'utilisation trompeuse de l'IA dans les médias visuels et renforcer la confiance dans les images qui façonnent nos discussions publiques. Développer et adopter largement ces outils est crucial pour maintenir l'honnêteté des médias visuels et garantir que les gens puissent prendre des décisions éclairées basées sur des informations fiables.

Stratégies pour repérer les contenus générés par l'IA

Guide étape par étape pour la vérification visuelle

Avec des contenus générés par l'IA de plus en plus sophistiqués, il est important d'être vigilant et d'utiliser des méthodes spécifiques pour vérifier l'authenticité de ce que nous voyons. Voici un guide étape par étape pour vous aider :

- Examinez les détails de l'image : Regardez de près l'image pour repérer tout ce qui semble anormal. Les images générées par l'IA présentent souvent des défauts ou des incohérences subtiles. Cherchez :

- Textures non naturelles : Textures qui semblent trop lisses ou manquent de détails attendus.

- Anomalies d'éclairage : Éclairage qui ne correspond pas à la scène ou présente des ombres incohérentes.

- Distorsions de l'arrière-plan : Éléments d'arrière-plan flous ou qui n'ont pas de sens.

- Recherche d'image inversée : Utilisez des moteurs de recherche comme Google Images, TinEye ou Yandex Images pour effectuer une recherche d'image inversée. Cela peut vous aider à voir si l'image a été utilisée ailleurs ou correspond à des motifs connus générés par l'IA.

- Vérifiez la source : Assurez-vous que la source qui a publié l'image est crédible. Recherchez des médias réputés, des sites web officiels ou des organisations de confiance. Méfiez-vous des sources anonymes ou des sites connus pour propager de la désinformation.

- Recoupez les informations : Comparez l'image et les informations qui l'accompagnent avec d'autres sources pour confirmer leur exactitude. Vérifiez auprès de plusieurs médias, sites de vérification des faits et experts pour vous assurer que tout correspond.

- Utilisez des outils de détection d'IA : Utilisez des outils de détection d'IA qui peuvent analyser les images et repérer les contenus potentiellement générés par l'IA. Ces outils s'améliorent pour fournir des informations sur la possible manipulation d'une image.

- Consultez des experts : Si vous avez encore des doutes, consultez des experts en analyse numérique ou en analyse des médias. Ils disposent des connaissances et des outils spécialisés pour repérer les signes subtils de manipulation.

En suivant ces étapes, vous pouvez améliorer votre capacité à repérer les contenus générés par l'IA et vous protéger contre la désinformation. Rester informé et un peu sceptique est essentiel dans le monde numérique d'aujourd'hui, où les images trompeuses peuvent se propager rapidement et influencer l'opinion publique. Un public sceptique et informé est crucial pour maintenir la confiance et la crédibilité à l'ère de l'IA.

Évaluation des images générées par l'IA : avantages et inconvénients

Avantages

- Créativité accrue : L'IA peut stimuler la créativité en générant de nouvelles combinaisons et styles d'images.

- Efficacité de la création de contenu : L'IA rend la création de contenu plus rapide et efficace, économisant temps et ressources.

- Accessibilité : L'IA rend la génération d'images accessible à tous, pas seulement aux professionnels.

- Personnalisation : L'IA permet une génération d'images hautement personnalisée pour répondre à des besoins spécifiques.

Inconvénients

- Risque de désinformation : L'IA facilite la création et la propagation d'images trompeuses.

- Problèmes d'authenticité : L'IA brouille la frontière entre le vrai et le faux, rendant difficile la confiance en ce que nous voyons.

- Questions éthiques : L'IA soulève des questions éthiques sur la manipulation, la transparence et la responsabilité.

- Perte d'emplois : L'IA pourrait remplacer les artistes et créateurs de contenu humains à mesure que l'automatisation augmente.

Questions fréquemment posées

Comment puis-je identifier efficacement les images générées par l'IA ?

Pour repérer les images générées par l'IA, il faut examiner attentivement les détails et utiliser les outils à votre disposition. Vérifiez les incohérences dans l'éclairage, les textures et les éléments d'arrière-plan. Utilisez des recherches d'images inversées pour voir si l'image a été utilisée ailleurs. Les outils de détection d'IA peuvent fournir des informations sur une possible manipulation de l'image. Recouper les informations avec plusieurs sources et consulter des experts peut confirmer davantage l'authenticité de l'image.

Quelles sont les solutions potentielles pour lutter contre la propagation de la désinformation générée par l'IA ?

Lutter contre la désinformation générée par l'IA nécessite une approche multidimensionnelle. Nous avons besoin de solutions technologiques, d'une éducation à la culture médiatique et de changements politiques. Les plateformes de réseaux sociaux devraient investir dans des outils de détection d'IA, tandis que les écoles devraient enseigner la culture médiatique. Les décideurs politiques devraient envisager des réglementations qui favorisent la transparence et la responsabilité dans l'utilisation des contenus générés par l'IA.

Comment les images générées par l'IA affectent-elles l'intégrité des élections ?

Les images générées par l'IA peuvent compromettre l'intégrité des élections en propageant de la désinformation et en manipulant l'opinion publique. Les faux soutiens, les représentations négatives des candidats et autres contenus trompeurs peuvent influencer le sentiment des électeurs et affecter les résultats des élections. Mélanger contenu réel et faux érode la confiance et introduit de l'incertitude dans les discussions publiques.

Pourquoi est-il important d'étiqueter les contenus générés par l'IA ?

Étiqueter les contenus générés par l'IA est crucial pour la transparence et la responsabilité. Sans étiquettes claires, les gens pourraient consommer des médias manipulés sans le savoir, ce qui conduit à des décisions mal informées. L'étiquetage aide les spectateurs à évaluer de manière critique le contenu et à faire des jugements éclairés sur son exactitude et sa validité.

Questions connexes

Quel rôle jouent les plateformes de réseaux sociaux dans la lutte contre la désinformation générée par l'IA ?

Les plateformes de réseaux sociaux ont un rôle important à jouer pour lutter contre la désinformation générée par l'IA. Elles doivent investir dans des outils de détection d'IA, mettre en place des politiques d'étiquetage claires et promouvoir la culture médiatique parmi leurs utilisateurs. En prenant des mesures proactives pour combattre les contenus trompeurs, les plateformes de réseaux sociaux peuvent aider à protéger l'intégrité des élections et maintenir la confiance du public.

Comment les institutions éducatives peuvent-elles promouvoir la culture médiatique et les compétences de pensée critique ?

Les institutions éducatives peuvent promouvoir la culture médiatique et la pensée critique en les intégrant dans leurs programmes. Les élèves devraient apprendre à évaluer les sources d'information, à repérer les techniques de manipulation et à recouper les informations avec plusieurs sources. En favorisant la pensée critique, les écoles peuvent former des citoyens informés et engagés, moins susceptibles de tomber dans le piège de la désinformation.

Quelles réglementations ou politiques pourraient aider à lutter contre la désinformation générée par l'IA sans porter atteinte à la liberté d'expression ?

Lutter contre la désinformation générée par l'IA tout en protégeant la liberté d'expression nécessite une élaboration minutieuse des politiques. Les exigences de transparence, comme l'étiquetage obligatoire des contenus générés par l'IA, peuvent informer le public sans restreindre la parole. Des mesures de responsabilité, comme tenir les gens responsables de la propagation de désinformation connue, peuvent dissuader les mauvais acteurs. Trouver le bon équilibre entre réglementation et liberté d'expression est essentiel pour maintenir un discours public sain et démocratique.

Claude a été utilisé pour créer des paquets npm malveillants : plus de 670 paquets compromis menacent l'open source

Un incident de cybersécurité récent met en lumière la manière dont les grands modèles linguistiques (LLM) sont détournés pour développer des logiciels malveillants. Le chercheur en sécurité Sibi Moosa

Claude a été utilisé pour créer des paquets npm malveillants : plus de 670 paquets compromis menacent l'open source

Un incident de cybersécurité récent met en lumière la manière dont les grands modèles linguistiques (LLM) sont détournés pour développer des logiciels malveillants. Le chercheur en sécurité Sibi Moosa

Reliance dévoile un plan d'investissement de 110 milliards de dollars dans l'IA alors que l'Inde accélère sa transition technologique

Mukesh Ambani, le président milliardaire du conglomérat indien Reliance, a annoncé jeudi un plan de 10 000 milliards de roupies (environ 110 milliards de dollars) visant à mettre en place une infrastr

Reliance dévoile un plan d'investissement de 110 milliards de dollars dans l'IA alors que l'Inde accélère sa transition technologique

Mukesh Ambani, le président milliardaire du conglomérat indien Reliance, a annoncé jeudi un plan de 10 000 milliards de roupies (environ 110 milliards de dollars) visant à mettre en place une infrastr

Zhiyuan WITA met fin à son projet d'interaction avec des robots « nus » en déposant sa première demande d'agrément

Le secteur de l'intelligence incarnée a franchi une étape importante. Selon la dernière annonce de l'Administration du cyberespace de Shanghai, le grand modèle WITA développé par Zhiyuan a mené à bien

Zhiyuan WITA met fin à son projet d'interaction avec des robots « nus » en déposant sa première demande d'agrément

Le secteur de l'intelligence incarnée a franchi une étape importante. Selon la dernière annonce de l'Administration du cyberespace de Shanghai, le grand modèle WITA développé par Zhiyuan a mené à bien

Maison

Maison