Imágenes Generadas por IA Provocan Controversia sobre la Integridad Electoral

La llegada de la inteligencia artificial ha inaugurado una ola de avances tecnológicos, pero también ha puesto un obstáculo en nuestra capacidad para distinguir entre hechos y ficción. Últimamente, las imágenes generadas por IA que circulan en las redes sociales han generado preocupaciones sobre su potencial para distorsionar las conversaciones políticas y amenazar la integridad de las elecciones. Es vital que comprendamos el alcance completo de estas tecnologías para mantener nuestras discusiones públicas informadas y preservar la confianza en lo que vemos.

La controversia de las imágenes políticas generadas por IA

El auge del contenido generado por IA

La inteligencia artificial ha alcanzado un punto en el que puede crear imágenes, videos y audios que parecen y suenan increíblemente reales. Es un logro impresionante, sin duda, pero también un poco aterrador, especialmente cuando se trata de política y elecciones. El poder de crear contenido convincente pero completamente inventado puede desorientar al público y socavar nuestra fe en las noticias que consumimos. La capacidad de las redes sociales para difundir este contenido como un incendio solo empeora las cosas, convirtiéndolo en un verdadero dolor de cabeza para mantener la narrativa clara y detener la desinformación en seco.

A medida que las herramientas de IA se vuelven más fáciles de usar, es más sencillo que nunca para cualquiera con una mala intención manipular la opinión pública. Estas creaciones de IA, a menudo llamadas medios sintéticos o deepfakes, desafían nuestra capacidad para pensar críticamente y mantenernos informados sobre los medios. El potencial para distorsionar la percepción pública y erosionar la confianza en nuestras instituciones es un gran problema, lo que nos impulsa a tomar medidas proactivas y establecer límites éticos para controlar los riesgos.

Las campañas políticas pueden usar esta tecnología para falsificar apoyos o difamar a oponentes, influenciando cómo votan las personas. Sin señales claras o herramientas para detectar estos falsos, la gente común podría tener dificultades para distinguir lo real de lo que no lo es, lo que lleva a decisiones basadas en información falsa. Este tipo de engaño generalizado podría sacudir los cimientos mismos de la democracia, haciendo urgente que encontremos soluciones tecnológicas y políticas para abordarlo.

Entonces, ¿cómo nos protegemos del mal uso de la IA en las campañas políticas y aseguramos que los votantes reciban información auténtica? Va a requerir una combinación de avances tecnológicos, enseñar a las personas a ser mediáticamente inteligentes y marcos políticos sólidos. El uso de contenido generado por IA plantea grandes preguntas sobre la honestidad, la transparencia y la responsabilidad, destacando la necesidad de que todos asumamos la responsabilidad de defender los valores democráticos en la era de la IA.

El uso de imágenes generadas por IA por parte de Trump

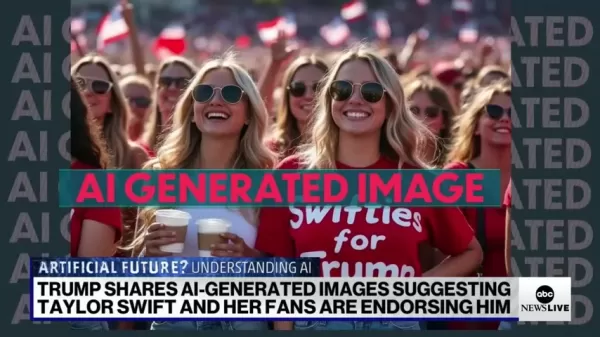

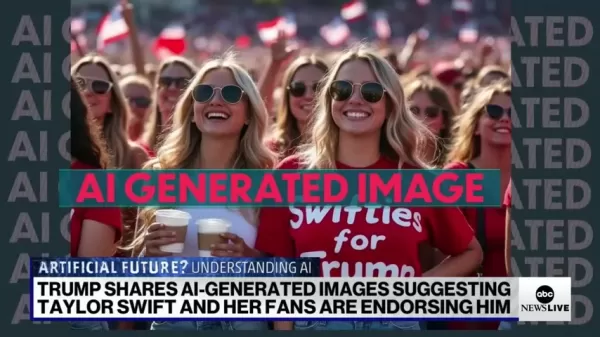

El expresidente Trump desató una tormenta cuando publicó imágenes generadas por IA en las redes sociales, desencadenando un acalorado debate sobre la ética y las consecuencias de usar dicho contenido en política.

Al compartir imágenes que hacían parecer que Taylor Swift y sus fans lo apoyaban, Trump levantó sospechas sobre la manipulación de cómo las personas lo perciben. Algunas de estas imágenes eran reales, mientras que otras fueron creadas por IA, causando confusión y planteando preguntas sobre cuán transparente debería ser la mensajería política.

Las imágenes mostraban mujeres con camisetas de 'Swifties for Trump', sugiriendo apoyo de un grupo que quizás no esté realmente alineado con sus políticas. Este movimiento plantea preguntas éticas sobre si es correcto usar IA para fingir apoyos o distorsionar el sentimiento público. No marcar claramente algunas imágenes como generadas por IA solo enturbia las aguas, potencialmente engañando a las personas que no saben que están mirando algo artificial.

Aunque algunas imágenes eran realmente generadas por IA, otras eran fotos auténticas de partidarios de Trump. Mezclar lo real y lo falso de esta manera puede dificultar que los espectadores descubran qué es verdad, difuminando las líneas entre la mensajería honesta y engañosa. Esta confusión puede erosionar la confianza y sembrar dudas en las discusiones públicas, ya que las personas pierden confianza en su capacidad para distinguir lo real de lo falso.

Compartir estas imágenes también podría verse como un movimiento estratégico para ganar a ciertos grupos de votantes, como los fans de Taylor Swift, independientemente de si realmente lo apoyan o no. Al crear la ilusión de un apoyo generalizado, incluso si es generado artificialmente, las campañas políticas podrían influir en votantes indecisos o entusiasmar a su base. Esto muestra cómo la IA puede ser una herramienta poderosa para la persuasión, capaz de moldear la opinión pública e influir en los resultados electorales.

Cuando figuras políticas importantes usan contenido generado por IA, es una llamada de atención para que el público sea más vigilante y mediáticamente inteligente. A medida que la tecnología de IA sigue avanzando, es crucial que las personas piensen críticamente sobre el contenido que ven en línea y busquen fuentes confiables. Los medios de comunicación, las escuelas y las agencias gubernamentales tienen un papel que desempeñar en fomentar el pensamiento crítico y aumentar la conciencia sobre los peligros de los medios manipulados.

Confusión y desinformación

Compartir imágenes generadas por IA y otros contenidos manipulados en línea está alimentando un problema creciente de confusión y desinformación.

Cuando las personas se enfrentan a una mezcla de información real y falsa, es difícil determinar qué es verdad. Este desorden puede erosionar la confianza en los medios, las instituciones e incluso las relaciones personales, dificultando alcanzar un consenso sobre temas importantes.

Uno de los mayores obstáculos para combatir la desinformación es la rapidez con la que se propaga en las redes sociales. El contenido falso o engañoso puede volverse viral en un instante, alcanzando a millones antes de que los verificadores de hechos puedan reaccionar. Esta rápida difusión dificulta detener el daño causado por la desinformación, ya que puede arraigarse en la mente de las personas e influir en sus opiniones.

Otro desafío es lo sofisticadas que se han vuelto las técnicas de manipulación modernas. El contenido generado por IA, los deepfakes y otros medios sintéticos son tan buenos que incluso los expertos tienen dificultades para detectarlos. Esto significa que la verificación de hechos tradicional y el análisis de medios ya no son suficientes, lo que nos impulsa a desarrollar nuevas herramientas y métodos para contraatacar.

Para empeorar las cosas están las cámaras de eco y las burbujas de filtro en línea. Los algoritmos de las redes sociales a menudo nos muestran contenido que coincide con nuestras opiniones existentes, creando cámaras de eco donde estamos mayormente expuestos a perspectivas similares. Esto puede reforzar nuestros sesgos y dificultar la interacción con puntos de vista diferentes, lo que lleva a más polarización y división.

Para abordar la confusión y la desinformación, necesitamos un enfoque multifacético que incluya soluciones tecnológicas, educación en alfabetización mediática y cambios en las políticas. Las plataformas de redes sociales deberían invertir en herramientas impulsadas por IA para detectar y marcar contenido manipulado. Las escuelas deberían enseñar alfabetización mediática, mostrando a los estudiantes cómo evaluar críticamente las fuentes y detectar técnicas de manipulación. Los responsables de formular políticas deberían considerar regulaciones que responsabilicen a las personas por difundir desinformación mientras protegen la libertad de expresión. Solo trabajando juntos podemos esperar frenar la propagación de la desinformación y fomentar un público más informado y comprometido.

Examinando imágenes reales versus generadas por IA

El desafío de distinguir la autenticidad

Diferenciar imágenes reales de las generadas por IA es cada día más complicado, gracias a la sofisticación de la inteligencia artificial. La IA ahora puede crear imágenes que parecen tan reales que es difícil para la persona promedio distinguirlas de fotos auténticas. Esta capacidad tiene grandes implicaciones para cuánto podemos confiar en lo que vemos, especialmente en áreas sensibles como las noticias y las comunicaciones políticas.

Una razón por la que es tan difícil detectar la diferencia es lo rápido que están mejorando los algoritmos de IA. Estos algoritmos son cada vez mejores en copiar las texturas, la iluminación y los detalles de escenas reales, creando imágenes que son casi imposibles de distinguir de lo real. Además, la IA puede crear imágenes de personas, objetos y eventos que nunca existieron, elaborando realidades convincentes pero completamente inventadas.

Otro factor es que muchas personas no saben mucho sobre las técnicas de manipulación de IA. Sin un entendimiento básico de lo que la IA puede hacer, es más fácil que las personas sean engañadas. Si no sabes cómo funciona la IA, es difícil evaluar críticamente las imágenes que ves en línea.

La falta de etiquetado claro y transparencia complica aún más las cosas. Las redes sociales y los medios de comunicación a menudo no marcan las imágenes generadas por IA, dejando que los espectadores descubran qué es real. Esta falta de transparencia facilita la propagación de contenido engañoso, ya que las personas podrían asumir que las imágenes sin etiquetar son auténticas.

Para abordar estos desafíos, necesitamos un enfoque múltiple que incluya soluciones tecnológicas, educación en alfabetización mediática y cambios en las políticas. Las soluciones tecnológicas, como herramientas de detección impulsadas por IA, pueden ayudar a identificar y marcar imágenes manipuladas. La educación en alfabetización mediática puede enseñar a las personas cómo evaluar críticamente las fuentes y detectar técnicas de manipulación. Los cambios en las políticas pueden promover más transparencia y responsabilidad en el uso de contenido generado por IA.

Al combinar estos esfuerzos, podemos protegernos mejor del uso engañoso de la IA en los medios visuales y construir más confianza en las imágenes que dan forma a nuestras discusiones públicas. Desarrollar y adoptar ampliamente estas herramientas es crucial para mantener la honestidad en los medios visuales y garantizar que las personas puedan tomar decisiones informadas basadas en información confiable.

Estrategias para discernir contenido generado por IA

Guía paso a paso para la verificación visual

Con el contenido generado por IA volviéndose más sofisticado, es importante que estemos alerta y usemos métodos específicos para verificar la autenticidad de lo que vemos. Aquí tienes una guía paso a paso para ayudarte:

- Examina los detalles de la imagen: Observa de cerca la imagen en busca de cualquier cosa que parezca fuera de lugar. Las imágenes generadas por IA a menudo tienen defectos o inconsistencias sutiles. Busca:

- Texturas no naturales: Texturas que parecen demasiado lisas o carecen del detalle que esperarías.

- Anomalías en la iluminación: Iluminación que no encaja con la escena o tiene sombras inconsistentes.

- Distorsiones de fondo: Elementos de fondo que parecen borrosos o no tienen sentido.

- Búsqueda inversa de imágenes: Usa motores de búsqueda como Google Images, TinEye o Yandex Images para hacer una búsqueda inversa de imágenes. Esto puede ayudarte a ver si la imagen ha sido utilizada en otro lugar o coincide con patrones conocidos generados por IA.

- Verifica la fuente: Asegúrate de que la fuente que publicó la imagen sea creíble. Busca medios de comunicación de renombre, sitios web oficiales o organizaciones confiables. Ten cuidado con fuentes anónimas o sitios conocidos por difundir desinformación.

- Cruzar información: Compara la imagen y cualquier información adjunta con otras fuentes para confirmar su precisión. Consulta múltiples medios de comunicación, sitios web de verificación de hechos y expertos para asegurarte de que todo coincida.

- Usa herramientas de detección de IA: Utiliza herramientas de detección de IA que puedan analizar imágenes y detectar contenido potencialmente generado por IA. Estas herramientas están mejorando en ofrecer información sobre si una imagen podría estar manipulada.

- Consulta a expertos: Si aún no estás seguro, habla con expertos en forense digital o análisis de medios. Ellos tienen el conocimiento especializado y las herramientas para detectar signos sutiles de manipulación.

Al seguir estos pasos, puedes mejorar en la detección de contenido generado por IA y protegerte de la desinformación. Mantenerse informado y un poco escéptico es clave en el mundo digital de hoy, donde las imágenes engañosas pueden propagarse rápidamente e influir en la opinión pública. Un público escéptico e informado es crucial para mantener la confianza y la credibilidad en la era de la IA.

Evaluando imágenes generadas por IA: Pros y contras

Pros

- Creatividad mejorada: La IA puede estimular la creatividad al generar nuevas combinaciones y estilos de imágenes.

- Eficiencia en la creación de contenido: La IA hace que la creación de contenido sea más rápida y eficiente, ahorrando tiempo y recursos.

- Accesibilidad: La IA hace que la generación de imágenes sea accesible para todos, no solo para profesionales.

- Personalización: La IA permite una generación de imágenes altamente personalizada para satisfacer necesidades específicas.

Contras

- Riesgo de desinformación: La IA puede facilitar la creación y difusión de imágenes engañosas.

- Preocupaciones sobre autenticidad: La IA difumina la línea entre lo real y lo falso, dificultando confiar en lo que vemos.

- Problemas éticos: La IA plantea preguntas éticas sobre manipulación, transparencia y responsabilidad.

- Desplazamiento laboral: La IA podría quitar empleos a artistas y creadores de contenido humanos a medida que aumenta la automatización.

Preguntas frecuentes

¿Cómo puedo identificar imágenes generadas por IA de manera efectiva?

Para detectar imágenes generadas por IA, necesitas observar de cerca los detalles y usar las herramientas a tu disposición. Busca inconsistencias en la iluminación, texturas y elementos de fondo. Usa búsquedas inversas de imágenes para ver si la imagen ha sido utilizada en otro lugar. Las herramientas de detección de IA pueden ofrecer información sobre si una imagen podría estar manipulada. Cruzar información con múltiples fuentes y consultar con expertos puede confirmar aún más la autenticidad de la imagen.

¿Cuáles son las posibles soluciones para combatir la propagación de la desinformación generada por IA?

Combatir la desinformación generada por IA requiere un enfoque multifacético. Necesitamos soluciones tecnológicas, educación en alfabetización mediática y cambios en las políticas. Las plataformas de redes sociales deberían invertir en herramientas de detección de IA, mientras que las escuelas deberían enseñar alfabetización mediática. Los responsables de formular políticas deberían considerar regulaciones que promuevan la transparencia y la responsabilidad en el uso de contenido generado por IA.

¿Cómo afectan las imágenes generadas por IA a la integridad de las elecciones?

Las imágenes generadas por IA pueden socavar la integridad de las elecciones al difundir desinformación y manipular la opinión pública. Apoyos falsos, representaciones negativas de candidatos y otro contenido engañoso pueden influir en el sentimiento de los votantes y afectar los resultados electorales. Mezclar contenido real y falso erosiona la confianza e introduce incertidumbre en las discusiones públicas.

¿Por qué es importante etiquetar el contenido generado por IA?

Etiquetar el contenido generado por IA es crucial para la transparencia y la responsabilidad. Sin etiquetas claras, las personas podrían consumir medios manipulados sin saberlo, lo que lleva a decisiones desinformadas. El etiquetado ayuda a los espectadores a evaluar críticamente el contenido y hacer juicios informados sobre su precisión y validez.

Preguntas relacionadas

¿Qué papel juegan las plataformas de redes sociales en abordar la desinformación generada por IA?

Las plataformas de redes sociales tienen un gran papel en abordar la desinformación generada por IA. Necesitan invertir en herramientas de detección de IA, implementar políticas de etiquetado claras y promover la alfabetización mediática entre sus usuarios. Al tomar medidas proactivas para combatir el contenido engañoso, las plataformas de redes sociales pueden ayudar a proteger la integridad de las elecciones y mantener la confianza pública.

¿Cómo pueden las instituciones educativas promover la alfabetización mediática y las habilidades de pensamiento crítico?

Las instituciones educativas pueden promover la alfabetización mediática y el pensamiento crítico incluyéndolos en sus planes de estudio. Los estudiantes deberían aprender a evaluar fuentes de información, detectar técnicas de manipulación y cruzar información con múltiples fuentes. Al fomentar el pensamiento crítico, las escuelas pueden empoderar a los estudiantes para que se conviertan en ciudadanos informados y comprometidos que son menos propensos a caer en la desinformación.

¿Qué regulaciones o políticas podrían ayudar a combatir la desinformación generada por IA sin infringir la libertad de expresión?

Combatir la desinformación generada por IA mientras se protege la libertad de expresión requiere una formulación de políticas cuidadosa. Los requisitos de transparencia, como el etiquetado obligatorio del contenido generado por IA, pueden informar al público sin restringir el discurso. Las medidas de responsabilidad, como responsabilizar a las personas por difundir desinformación conocida, pueden disuadir a los actores maliciosos. Encontrar el equilibrio adecuado entre regulación y libertad de expresión es clave para mantener un discurso público saludable y democrático.

Artículo relacionado

Reliance da a conocer un plan de inversión en inteligencia artificial de 110 000 millones de dólares, mientras la India acelera su impulso tecnológico

Mukesh Ambani, el multimillonario presidente del conglomerado indio Reliance, anunció el jueves un plan de 10 billones de rupias (aproximadamente 110 000 millones de dólares) para construir infraestru

Reliance da a conocer un plan de inversión en inteligencia artificial de 110 000 millones de dólares, mientras la India acelera su impulso tecnológico

Mukesh Ambani, el multimillonario presidente del conglomerado indio Reliance, anunció el jueves un plan de 10 billones de rupias (aproximadamente 110 000 millones de dólares) para construir infraestru

Zhiyuan WITA pone fin a la interacción «desnuda» con robots con la presentación de su primera declaración de cumplimiento

El sector de la inteligencia incorporada ha alcanzado un hito significativo. Según el último comunicado de la Administración del Ciberespacio de Shanghái, el modelo a gran escala WITA, desarrollado po

Zhiyuan WITA pone fin a la interacción «desnuda» con robots con la presentación de su primera declaración de cumplimiento

El sector de la inteligencia incorporada ha alcanzado un hito significativo. Según el último comunicado de la Administración del Ciberespacio de Shanghái, el modelo a gran escala WITA, desarrollado po

Un estudio antropológico relaciona el contenido generado por IA con una disminución del pensamiento humano

Cuando ves que la IA genera al instante un código o un documento bien estructurado y lógicamente claro, ¿te sientes tentado a confiar en él sin pensarlo dos veces? Según AIbase, la empresa líder en IA

Recomendaciones de temas especiales relacionados

comentario (2)

0/500

Un estudio antropológico relaciona el contenido generado por IA con una disminución del pensamiento humano

Cuando ves que la IA genera al instante un código o un documento bien estructurado y lógicamente claro, ¿te sientes tentado a confiar en él sin pensarlo dos veces? Según AIbase, la empresa líder en IA

Recomendaciones de temas especiales relacionados

comentario (2)

0/500

La llegada de la inteligencia artificial ha inaugurado una ola de avances tecnológicos, pero también ha puesto un obstáculo en nuestra capacidad para distinguir entre hechos y ficción. Últimamente, las imágenes generadas por IA que circulan en las redes sociales han generado preocupaciones sobre su potencial para distorsionar las conversaciones políticas y amenazar la integridad de las elecciones. Es vital que comprendamos el alcance completo de estas tecnologías para mantener nuestras discusiones públicas informadas y preservar la confianza en lo que vemos.

La controversia de las imágenes políticas generadas por IA

El auge del contenido generado por IA

La inteligencia artificial ha alcanzado un punto en el que puede crear imágenes, videos y audios que parecen y suenan increíblemente reales. Es un logro impresionante, sin duda, pero también un poco aterrador, especialmente cuando se trata de política y elecciones. El poder de crear contenido convincente pero completamente inventado puede desorientar al público y socavar nuestra fe en las noticias que consumimos. La capacidad de las redes sociales para difundir este contenido como un incendio solo empeora las cosas, convirtiéndolo en un verdadero dolor de cabeza para mantener la narrativa clara y detener la desinformación en seco.

A medida que las herramientas de IA se vuelven más fáciles de usar, es más sencillo que nunca para cualquiera con una mala intención manipular la opinión pública. Estas creaciones de IA, a menudo llamadas medios sintéticos o deepfakes, desafían nuestra capacidad para pensar críticamente y mantenernos informados sobre los medios. El potencial para distorsionar la percepción pública y erosionar la confianza en nuestras instituciones es un gran problema, lo que nos impulsa a tomar medidas proactivas y establecer límites éticos para controlar los riesgos.

Las campañas políticas pueden usar esta tecnología para falsificar apoyos o difamar a oponentes, influenciando cómo votan las personas. Sin señales claras o herramientas para detectar estos falsos, la gente común podría tener dificultades para distinguir lo real de lo que no lo es, lo que lleva a decisiones basadas en información falsa. Este tipo de engaño generalizado podría sacudir los cimientos mismos de la democracia, haciendo urgente que encontremos soluciones tecnológicas y políticas para abordarlo.

Entonces, ¿cómo nos protegemos del mal uso de la IA en las campañas políticas y aseguramos que los votantes reciban información auténtica? Va a requerir una combinación de avances tecnológicos, enseñar a las personas a ser mediáticamente inteligentes y marcos políticos sólidos. El uso de contenido generado por IA plantea grandes preguntas sobre la honestidad, la transparencia y la responsabilidad, destacando la necesidad de que todos asumamos la responsabilidad de defender los valores democráticos en la era de la IA.

El uso de imágenes generadas por IA por parte de Trump

El expresidente Trump desató una tormenta cuando publicó imágenes generadas por IA en las redes sociales, desencadenando un acalorado debate sobre la ética y las consecuencias de usar dicho contenido en política.

Al compartir imágenes que hacían parecer que Taylor Swift y sus fans lo apoyaban, Trump levantó sospechas sobre la manipulación de cómo las personas lo perciben. Algunas de estas imágenes eran reales, mientras que otras fueron creadas por IA, causando confusión y planteando preguntas sobre cuán transparente debería ser la mensajería política.

Las imágenes mostraban mujeres con camisetas de 'Swifties for Trump', sugiriendo apoyo de un grupo que quizás no esté realmente alineado con sus políticas. Este movimiento plantea preguntas éticas sobre si es correcto usar IA para fingir apoyos o distorsionar el sentimiento público. No marcar claramente algunas imágenes como generadas por IA solo enturbia las aguas, potencialmente engañando a las personas que no saben que están mirando algo artificial.

Aunque algunas imágenes eran realmente generadas por IA, otras eran fotos auténticas de partidarios de Trump. Mezclar lo real y lo falso de esta manera puede dificultar que los espectadores descubran qué es verdad, difuminando las líneas entre la mensajería honesta y engañosa. Esta confusión puede erosionar la confianza y sembrar dudas en las discusiones públicas, ya que las personas pierden confianza en su capacidad para distinguir lo real de lo falso.

Compartir estas imágenes también podría verse como un movimiento estratégico para ganar a ciertos grupos de votantes, como los fans de Taylor Swift, independientemente de si realmente lo apoyan o no. Al crear la ilusión de un apoyo generalizado, incluso si es generado artificialmente, las campañas políticas podrían influir en votantes indecisos o entusiasmar a su base. Esto muestra cómo la IA puede ser una herramienta poderosa para la persuasión, capaz de moldear la opinión pública e influir en los resultados electorales.

Cuando figuras políticas importantes usan contenido generado por IA, es una llamada de atención para que el público sea más vigilante y mediáticamente inteligente. A medida que la tecnología de IA sigue avanzando, es crucial que las personas piensen críticamente sobre el contenido que ven en línea y busquen fuentes confiables. Los medios de comunicación, las escuelas y las agencias gubernamentales tienen un papel que desempeñar en fomentar el pensamiento crítico y aumentar la conciencia sobre los peligros de los medios manipulados.

Confusión y desinformación

Compartir imágenes generadas por IA y otros contenidos manipulados en línea está alimentando un problema creciente de confusión y desinformación.

Cuando las personas se enfrentan a una mezcla de información real y falsa, es difícil determinar qué es verdad. Este desorden puede erosionar la confianza en los medios, las instituciones e incluso las relaciones personales, dificultando alcanzar un consenso sobre temas importantes.

Uno de los mayores obstáculos para combatir la desinformación es la rapidez con la que se propaga en las redes sociales. El contenido falso o engañoso puede volverse viral en un instante, alcanzando a millones antes de que los verificadores de hechos puedan reaccionar. Esta rápida difusión dificulta detener el daño causado por la desinformación, ya que puede arraigarse en la mente de las personas e influir en sus opiniones.

Otro desafío es lo sofisticadas que se han vuelto las técnicas de manipulación modernas. El contenido generado por IA, los deepfakes y otros medios sintéticos son tan buenos que incluso los expertos tienen dificultades para detectarlos. Esto significa que la verificación de hechos tradicional y el análisis de medios ya no son suficientes, lo que nos impulsa a desarrollar nuevas herramientas y métodos para contraatacar.

Para empeorar las cosas están las cámaras de eco y las burbujas de filtro en línea. Los algoritmos de las redes sociales a menudo nos muestran contenido que coincide con nuestras opiniones existentes, creando cámaras de eco donde estamos mayormente expuestos a perspectivas similares. Esto puede reforzar nuestros sesgos y dificultar la interacción con puntos de vista diferentes, lo que lleva a más polarización y división.

Para abordar la confusión y la desinformación, necesitamos un enfoque multifacético que incluya soluciones tecnológicas, educación en alfabetización mediática y cambios en las políticas. Las plataformas de redes sociales deberían invertir en herramientas impulsadas por IA para detectar y marcar contenido manipulado. Las escuelas deberían enseñar alfabetización mediática, mostrando a los estudiantes cómo evaluar críticamente las fuentes y detectar técnicas de manipulación. Los responsables de formular políticas deberían considerar regulaciones que responsabilicen a las personas por difundir desinformación mientras protegen la libertad de expresión. Solo trabajando juntos podemos esperar frenar la propagación de la desinformación y fomentar un público más informado y comprometido.

Examinando imágenes reales versus generadas por IA

El desafío de distinguir la autenticidad

Diferenciar imágenes reales de las generadas por IA es cada día más complicado, gracias a la sofisticación de la inteligencia artificial. La IA ahora puede crear imágenes que parecen tan reales que es difícil para la persona promedio distinguirlas de fotos auténticas. Esta capacidad tiene grandes implicaciones para cuánto podemos confiar en lo que vemos, especialmente en áreas sensibles como las noticias y las comunicaciones políticas.

Una razón por la que es tan difícil detectar la diferencia es lo rápido que están mejorando los algoritmos de IA. Estos algoritmos son cada vez mejores en copiar las texturas, la iluminación y los detalles de escenas reales, creando imágenes que son casi imposibles de distinguir de lo real. Además, la IA puede crear imágenes de personas, objetos y eventos que nunca existieron, elaborando realidades convincentes pero completamente inventadas.

Otro factor es que muchas personas no saben mucho sobre las técnicas de manipulación de IA. Sin un entendimiento básico de lo que la IA puede hacer, es más fácil que las personas sean engañadas. Si no sabes cómo funciona la IA, es difícil evaluar críticamente las imágenes que ves en línea.

La falta de etiquetado claro y transparencia complica aún más las cosas. Las redes sociales y los medios de comunicación a menudo no marcan las imágenes generadas por IA, dejando que los espectadores descubran qué es real. Esta falta de transparencia facilita la propagación de contenido engañoso, ya que las personas podrían asumir que las imágenes sin etiquetar son auténticas.

Para abordar estos desafíos, necesitamos un enfoque múltiple que incluya soluciones tecnológicas, educación en alfabetización mediática y cambios en las políticas. Las soluciones tecnológicas, como herramientas de detección impulsadas por IA, pueden ayudar a identificar y marcar imágenes manipuladas. La educación en alfabetización mediática puede enseñar a las personas cómo evaluar críticamente las fuentes y detectar técnicas de manipulación. Los cambios en las políticas pueden promover más transparencia y responsabilidad en el uso de contenido generado por IA.

Al combinar estos esfuerzos, podemos protegernos mejor del uso engañoso de la IA en los medios visuales y construir más confianza en las imágenes que dan forma a nuestras discusiones públicas. Desarrollar y adoptar ampliamente estas herramientas es crucial para mantener la honestidad en los medios visuales y garantizar que las personas puedan tomar decisiones informadas basadas en información confiable.

Estrategias para discernir contenido generado por IA

Guía paso a paso para la verificación visual

Con el contenido generado por IA volviéndose más sofisticado, es importante que estemos alerta y usemos métodos específicos para verificar la autenticidad de lo que vemos. Aquí tienes una guía paso a paso para ayudarte:

- Examina los detalles de la imagen: Observa de cerca la imagen en busca de cualquier cosa que parezca fuera de lugar. Las imágenes generadas por IA a menudo tienen defectos o inconsistencias sutiles. Busca:

- Texturas no naturales: Texturas que parecen demasiado lisas o carecen del detalle que esperarías.

- Anomalías en la iluminación: Iluminación que no encaja con la escena o tiene sombras inconsistentes.

- Distorsiones de fondo: Elementos de fondo que parecen borrosos o no tienen sentido.

- Búsqueda inversa de imágenes: Usa motores de búsqueda como Google Images, TinEye o Yandex Images para hacer una búsqueda inversa de imágenes. Esto puede ayudarte a ver si la imagen ha sido utilizada en otro lugar o coincide con patrones conocidos generados por IA.

- Verifica la fuente: Asegúrate de que la fuente que publicó la imagen sea creíble. Busca medios de comunicación de renombre, sitios web oficiales o organizaciones confiables. Ten cuidado con fuentes anónimas o sitios conocidos por difundir desinformación.

- Cruzar información: Compara la imagen y cualquier información adjunta con otras fuentes para confirmar su precisión. Consulta múltiples medios de comunicación, sitios web de verificación de hechos y expertos para asegurarte de que todo coincida.

- Usa herramientas de detección de IA: Utiliza herramientas de detección de IA que puedan analizar imágenes y detectar contenido potencialmente generado por IA. Estas herramientas están mejorando en ofrecer información sobre si una imagen podría estar manipulada.

- Consulta a expertos: Si aún no estás seguro, habla con expertos en forense digital o análisis de medios. Ellos tienen el conocimiento especializado y las herramientas para detectar signos sutiles de manipulación.

Al seguir estos pasos, puedes mejorar en la detección de contenido generado por IA y protegerte de la desinformación. Mantenerse informado y un poco escéptico es clave en el mundo digital de hoy, donde las imágenes engañosas pueden propagarse rápidamente e influir en la opinión pública. Un público escéptico e informado es crucial para mantener la confianza y la credibilidad en la era de la IA.

Evaluando imágenes generadas por IA: Pros y contras

Pros

- Creatividad mejorada: La IA puede estimular la creatividad al generar nuevas combinaciones y estilos de imágenes.

- Eficiencia en la creación de contenido: La IA hace que la creación de contenido sea más rápida y eficiente, ahorrando tiempo y recursos.

- Accesibilidad: La IA hace que la generación de imágenes sea accesible para todos, no solo para profesionales.

- Personalización: La IA permite una generación de imágenes altamente personalizada para satisfacer necesidades específicas.

Contras

- Riesgo de desinformación: La IA puede facilitar la creación y difusión de imágenes engañosas.

- Preocupaciones sobre autenticidad: La IA difumina la línea entre lo real y lo falso, dificultando confiar en lo que vemos.

- Problemas éticos: La IA plantea preguntas éticas sobre manipulación, transparencia y responsabilidad.

- Desplazamiento laboral: La IA podría quitar empleos a artistas y creadores de contenido humanos a medida que aumenta la automatización.

Preguntas frecuentes

¿Cómo puedo identificar imágenes generadas por IA de manera efectiva?

Para detectar imágenes generadas por IA, necesitas observar de cerca los detalles y usar las herramientas a tu disposición. Busca inconsistencias en la iluminación, texturas y elementos de fondo. Usa búsquedas inversas de imágenes para ver si la imagen ha sido utilizada en otro lugar. Las herramientas de detección de IA pueden ofrecer información sobre si una imagen podría estar manipulada. Cruzar información con múltiples fuentes y consultar con expertos puede confirmar aún más la autenticidad de la imagen.

¿Cuáles son las posibles soluciones para combatir la propagación de la desinformación generada por IA?

Combatir la desinformación generada por IA requiere un enfoque multifacético. Necesitamos soluciones tecnológicas, educación en alfabetización mediática y cambios en las políticas. Las plataformas de redes sociales deberían invertir en herramientas de detección de IA, mientras que las escuelas deberían enseñar alfabetización mediática. Los responsables de formular políticas deberían considerar regulaciones que promuevan la transparencia y la responsabilidad en el uso de contenido generado por IA.

¿Cómo afectan las imágenes generadas por IA a la integridad de las elecciones?

Las imágenes generadas por IA pueden socavar la integridad de las elecciones al difundir desinformación y manipular la opinión pública. Apoyos falsos, representaciones negativas de candidatos y otro contenido engañoso pueden influir en el sentimiento de los votantes y afectar los resultados electorales. Mezclar contenido real y falso erosiona la confianza e introduce incertidumbre en las discusiones públicas.

¿Por qué es importante etiquetar el contenido generado por IA?

Etiquetar el contenido generado por IA es crucial para la transparencia y la responsabilidad. Sin etiquetas claras, las personas podrían consumir medios manipulados sin saberlo, lo que lleva a decisiones desinformadas. El etiquetado ayuda a los espectadores a evaluar críticamente el contenido y hacer juicios informados sobre su precisión y validez.

Preguntas relacionadas

¿Qué papel juegan las plataformas de redes sociales en abordar la desinformación generada por IA?

Las plataformas de redes sociales tienen un gran papel en abordar la desinformación generada por IA. Necesitan invertir en herramientas de detección de IA, implementar políticas de etiquetado claras y promover la alfabetización mediática entre sus usuarios. Al tomar medidas proactivas para combatir el contenido engañoso, las plataformas de redes sociales pueden ayudar a proteger la integridad de las elecciones y mantener la confianza pública.

¿Cómo pueden las instituciones educativas promover la alfabetización mediática y las habilidades de pensamiento crítico?

Las instituciones educativas pueden promover la alfabetización mediática y el pensamiento crítico incluyéndolos en sus planes de estudio. Los estudiantes deberían aprender a evaluar fuentes de información, detectar técnicas de manipulación y cruzar información con múltiples fuentes. Al fomentar el pensamiento crítico, las escuelas pueden empoderar a los estudiantes para que se conviertan en ciudadanos informados y comprometidos que son menos propensos a caer en la desinformación.

¿Qué regulaciones o políticas podrían ayudar a combatir la desinformación generada por IA sin infringir la libertad de expresión?

Combatir la desinformación generada por IA mientras se protege la libertad de expresión requiere una formulación de políticas cuidadosa. Los requisitos de transparencia, como el etiquetado obligatorio del contenido generado por IA, pueden informar al público sin restringir el discurso. Las medidas de responsabilidad, como responsabilizar a las personas por difundir desinformación conocida, pueden disuadir a los actores maliciosos. Encontrar el equilibrio adecuado entre regulación y libertad de expresión es clave para mantener un discurso público saludable y democrático.

Reliance da a conocer un plan de inversión en inteligencia artificial de 110 000 millones de dólares, mientras la India acelera su impulso tecnológico

Mukesh Ambani, el multimillonario presidente del conglomerado indio Reliance, anunció el jueves un plan de 10 billones de rupias (aproximadamente 110 000 millones de dólares) para construir infraestru

Reliance da a conocer un plan de inversión en inteligencia artificial de 110 000 millones de dólares, mientras la India acelera su impulso tecnológico

Mukesh Ambani, el multimillonario presidente del conglomerado indio Reliance, anunció el jueves un plan de 10 billones de rupias (aproximadamente 110 000 millones de dólares) para construir infraestru

Zhiyuan WITA pone fin a la interacción «desnuda» con robots con la presentación de su primera declaración de cumplimiento

El sector de la inteligencia incorporada ha alcanzado un hito significativo. Según el último comunicado de la Administración del Ciberespacio de Shanghái, el modelo a gran escala WITA, desarrollado po

Zhiyuan WITA pone fin a la interacción «desnuda» con robots con la presentación de su primera declaración de cumplimiento

El sector de la inteligencia incorporada ha alcanzado un hito significativo. Según el último comunicado de la Administración del Ciberespacio de Shanghái, el modelo a gran escala WITA, desarrollado po

Un estudio antropológico relaciona el contenido generado por IA con una disminución del pensamiento humano

Cuando ves que la IA genera al instante un código o un documento bien estructurado y lógicamente claro, ¿te sientes tentado a confiar en él sin pensarlo dos veces? Según AIbase, la empresa líder en IA

Un estudio antropológico relaciona el contenido generado por IA con una disminución del pensamiento humano

Cuando ves que la IA genera al instante un código o un documento bien estructurado y lógicamente claro, ¿te sientes tentado a confiar en él sin pensarlo dos veces? Según AIbase, la empresa líder en IA

Hogar

Hogar