AI生成图像引发选举诚信争议

人工智能的出现带来了一波技术进步,但也对我们区分事实与虚构的能力造成了干扰。最近,社交媒体上流传的AI生成图像引发了人们对其可能扭曲政治对话和威胁选举完整性的担忧。了解这些技术的全部影响对于保持公共讨论的知情性和维持我们对所见内容的信任至关重要。

AI生成政治图像的争议

AI生成内容的兴起

人工智能已经发展到可以生成看起来和听起来极为真实的图像、视频和音频。这无疑是一项很酷的成就,但也有些可怕,尤其是在涉及政治和选举时。制作令人信服但完全虚构的内容的能力可能误导公众,动摇我们对所消费新闻的信心。社交媒体像野火一样传播这些内容的能力只会让事情变得更糟,使得保持叙事准确并阻止虚假信息传播成为真正的难题。

随着AI工具变得更加用户友好,任何怀有不良动机的人都可以轻松地干扰公众舆论。这些AI创作,通常被称为合成媒体或深度伪造,挑战我们的批判性思维和媒体素养能力。扭曲公众认知和侵蚀对我们机构的信任是一个重大问题,促使我们采取积极措施并设定道德界限以控制风险。

政治竞选可以使用这项技术伪造支持或诽谤对手,影响人们的投票选择。如果没有明确的标识或工具来识别这些伪造内容,普通人可能难以分辨真假,导致基于虚假信息的决策。这种广泛的欺骗可能动摇民主的基础,使我们迫切需要找到技术和政策解决方案来应对这一问题。

那么,我们如何保护自己免受AI在政治竞选中被滥用的影响,并确保选民获得真实信息?这需要技术进步、媒体素养教育和坚实的政策框架相结合。使用AI生成内容引发了关于诚实、公开和责任的重大问题,凸显了每个人都需要站出来捍卫AI时代民主价值观的需要。

特朗普使用AI生成图像

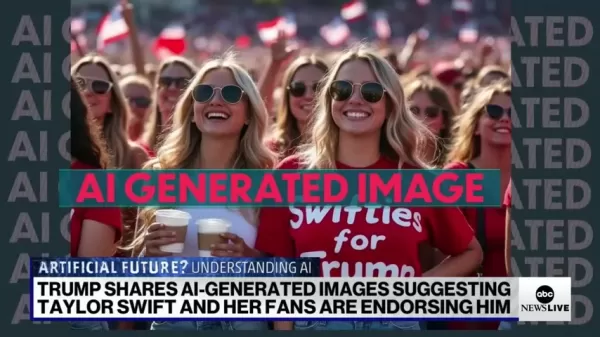

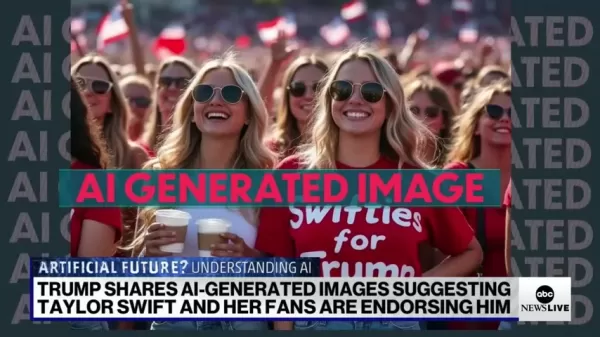

前总统特朗普在社交媒体上发布AI生成图像引发了一场风暴,激起了关于在政治中使用此类内容伦理和后果的激烈争论。

通过分享使泰勒·斯威夫特及其粉丝看起来支持他的图像,特朗普引发了关于操纵公众对其看法的问题。其中一些图像是真实的,而其他则是AI生成的,造成了混乱并引发了关于政治信息透明度的问题。

这些图像显示穿着“Swifties for Trump”衬衫的女性,暗示了一个可能并不真正支持他的群体的支持。这一举动引发了关于使用AI伪造支持或扭曲公众情绪是否合乎道德的问题。没有明确标记一些图像为AI生成只会让情况更加混乱,可能欺骗那些不知道自己在看人工合成内容的人。

虽然一些图像确实是AI生成的,但其他则是特朗普支持者的真实照片。如此混杂真实与虚假的内容可能使观众难以分辨真相,模糊了诚实与欺骗性信息之间的界限。这种混淆可能侵蚀信任并在公共讨论中播下怀疑种子,使人们对自己分辨真假的能力失去信心。

分享这些图像也可以被视为一种战略举措,旨在赢得特定选民群体(如泰勒·斯威夫特的粉丝)的支持,无论他们是否真正支持他。通过制造广泛支持的假象,即使是人工智能生成的,政治竞选可能影响摇摆选民或激励其基本盘。这显示了AI作为一种说服工具的强大能力,能够塑造公众舆论并影响选举结果。

当重要政治人物使用AI生成内容时,这对公众来说是一个警钟,需要更加警惕和具备媒体素养。随着AI技术不断进步,人们必须批判性地思考他们在网上看到的内容并寻找可信的来源。媒体、学校和政府机构都在提高批判性思维和增加对操纵媒体危险的认识方面发挥作用。

混乱与虚假信息

在网上分享AI生成图像和其他被操纵内容正在加剧混乱和虚假信息的问题。

当人们面对真实与虚假信息的混合时,很难分辨真相。这种混乱可能侵蚀对媒体、机构甚至个人关系的信任,使就重要问题达成共识变得困难。

对抗虚假信息的一个最大障碍是它在社交媒体上的传播速度。虚假或误导性内容可能瞬间传播,达到数百万人,而事实核查者甚至还没来得及反应。这种快速传播使得阻止虚假信息造成的损害变得困难,因为它可能在人们心中扎根并影响他们的观点。

另一个挑战是现代操纵技术的复杂程度。AI生成内容、深度伪造和其他合成媒体变得如此精妙,以至于即使是专家也难以辨别。这意味着传统的事实核查和媒体分析已不足以应对,促使我们开发新的工具和方法来对抗。

更糟糕的是网络上的回音室和过滤气泡。社交媒体算法通常向我们展示与我们现有观点相符的内容,创造出回音室,我们主要接触到相似的观点。这可能强化我们的偏见,使我们更难接受不同的观点,导致更多的两极分化和分裂。

为了应对混乱和虚假信息,我们需要多方面的策略,包括技术解决方案、媒体素养教育和政策变革。社交媒体平台应投资于AI驱动的工具来识别和标记被操纵内容。学校应教授媒体素养,教导学生如何批判性评估来源和识别操纵技术。政策制定者应考虑制定法规,追究传播虚假信息者的责任,同时保护言论自由。只有通过合作,我们才能希望遏制虚假信息的传播,培养一个更加知情和参与的公众。

检验真实与AI生成图像

区分真实性的挑战

随着人工智能的复杂性日益增加,区分真实图像与AI生成图像变得越来越困难。AI现在可以生成看起来如此真实的图像,普通人很难将它们与真实照片区分开来。这种能力对我们信任所见内容的能力有重大影响,特别是在新闻和政治沟通等敏感领域。

难以区分的一个原因是AI算法的快速改进。这些算法越来越擅长复制真实场景的纹理、光线和细节,生成几乎无法与真实事物区分的图像。此外,AI可以生成从未存在过的人物、物体和事件的图像,创造出令人信服但完全虚构的现实。

另一个因素是许多人对AI操纵技术了解甚少。如果没有对AI能力的基本了解,人们更容易被欺骗。如果你不知道AI是如何工作的,就很难批判性地评估你在网上看到的图像。

缺乏明确的标签和透明度使情况更加复杂。社交媒体和媒体机构通常不标记AI生成图像,留给观众自己判断真假。这种缺乏公开性使得欺骗性内容更容易传播,因为人们可能假设未标记的图像是真实的。

为了应对这些挑战,我们需要多管齐下的方法,包括技术解决方案、媒体素养教育和政策变革。像AI驱动的检测工具这样的技术解决方案可以帮助识别和标记被操纵的图像。媒体素养教育可以教人们如何批判性评估来源和识别操纵技术。政策变革可以促进使用AI生成内容的透明度和责任感。

通过结合这些努力,我们可以更好地保护自己免受AI在视觉媒体中被欺骗性使用的侵害,并建立对塑造我们公共讨论的图像的更多信任。开发和广泛采用这些工具对于保持视觉媒体的诚信至关重要,确保人们能够基于可靠信息做出明智决策。

识别AI生成内容的策略

视觉验证的分步指南

随着AI生成内容变得越来越复杂,我们必须保持警惕并使用具体方法来检查所见内容的真实性。以下是帮助你的分步指南:

- 检查图像细节:仔细观察图像是否有任何异常。AI生成图像通常有细微的缺陷或不一致。注意:

- 不自然的纹理:纹理看起来过于平滑或缺乏应有的细节。

- 光线异常:光线与场景不符或有不一致的阴影。

- 背景扭曲:背景元素显得模糊或不合理。

- 反向图像搜索:使用Google Images、TinEye或Yandex Images等搜索引擎进行反向图像搜索。这可以帮助你查看图像是否在其他地方使用过或是否符合已知的AI生成模式。

- 检查来源:确保发布图像的来源可信。寻找知名新闻机构、官方网站或可信组织。谨慎对待匿名来源或已知传播虚假信息的网站。

- 交叉参考信息:将图像及任何相关信息与其他来源进行比较以确认其准确性。检查多家新闻机构、事实核查网站和专家,确保一切吻合。

- 使用AI检测工具:使用可以分析图像并识别潜在AI生成内容的AI检测工具。这些工具越来越擅长提供关于图像是否可能被操纵的见解。

- 咨询专家:如果你仍不确定,与数字取证或媒体分析专家交流。他们拥有专业知识和工具,可以发现细微的操纵迹象。

通过遵循这些步骤,你可以更好地识别AI生成内容并保护自己免受虚假信息的侵害。在当今数字世界中,保持知情和适度的怀疑至关重要,因为欺骗性图像可能迅速传播并影响公众舆论。一个怀疑且知情的公众对于在AI时代保持信任和可信度至关重要。

评估AI生成图像:优点与缺点

优点

- 增强创造力:AI可以通过生成新的图像组合和风格激发创造力。

- 内容创作效率:AI使内容创作更快、更高效,节省时间和资源。

- 可访问性:AI使图像生成对所有人开放,而不仅仅是专业人士。

- 定制化:AI允许高度定制化的图像生成以满足特定需求。

缺点

- 虚假信息风险:AI使创建和传播误导性图像变得更容易。

- 真实性问题:AI模糊了真实与虚假的界限,使人们更难信任所见内容。

- 伦理问题:AI引发了关于操纵、透明度和责任的伦理问题。

- 就业替代:随着自动化增加,AI可能取代人类艺术家和内容创作者的工作。

常见问题

如何有效识别AI生成图像?

要识别AI生成图像,你需要仔细检查细节并使用可用的工具。检查光线、纹理和背景元素的不一致。使用反向图像搜索查看图像是否在其他地方使用过。AI检测工具可以提供关于图像是否可能被操纵的见解。与多个来源交叉参考信息并咨询专家可以进一步确认图像的真实性。

对抗AI生成虚假信息的潜在解决方案是什么?

对抗AI生成虚假信息需要多方面的策略。我们需要技术解决方案、媒体素养教育和政策变革。社交媒体平台应投资于AI检测工具,学校应教授媒体素养。政策制定者应考虑促进使用AI生成内容透明度和责任感的法规。

AI生成图像如何影响选举完整性?

AI生成图像可能通过传播虚假信息和操纵公众舆论来破坏选举完整性。虚假支持、候选人的负面描绘和其他欺骗性内容可能影响选民情绪并影响选举结果。混合真实与虚假内容会侵蚀信任并在公共讨论中引入不确定性。

为什么标记AI生成内容很重要?

标记AI生成内容对于透明度和责任感至关重要。如果没有明确的标签,人们可能在不知情的情况下消费被操纵的媒体,导致错误的决策。标签帮助观众批判性地评估内容,并对其准确性和有效性作出明智判断。

相关问题

社交媒体平台在应对AI生成虚假信息方面扮演什么角色?

社交媒体平台在应对AI生成虚假信息方面扮演重要角色。他们需要投资于AI检测工具,实施明确的标签政策,并在其用户中推广媒体素养。通过采取积极措施对抗欺骗性内容,社交媒体平台可以帮助保护选举完整性并维持公众信任。

教育机构如何促进媒体素养和批判性思维技能?

教育机构可以通过将媒体素养和批判性思维纳入课程来推广这些技能。学生应学习如何评估信息来源、识别操纵技术并与多个来源交叉参考信息。通过培养批判性思维,学校可以赋予学生成为知情且参与的公民,减少被虚假信息欺骗的可能性。

有哪些法规或政策可以在不侵犯言论自由的情况下对抗AI生成虚假信息?

在保护言论自由的同时对抗AI生成虚假信息需要谨慎的政策制定。透明度要求,如强制标记AI生成内容,可以在不限制言论的情况下告知公众。责任措施,如追究传播已知虚假信息者的责任,可以威慑不良行为者。在监管与自由表达之间找到平衡对于维持健康的民主公共话语至关重要。

相关文章

百度健康近期内部测试了AI医生助手“DoctorClaw”,用于学术文献检索和日常办公辅助

据报道,百度健康已开始对一款专为医生设计的专业AI智能助手进行内部测试。该产品内部代号为“DoctorClaw”(龙虾医生版),标志着百度在医疗领域部署大型语言模型方面迈出了重要一步。知情人士透露,该项目仍处于封闭开发阶段,目前已进入内部测试。虽然具体的产品形态尚未完全披露,但已接近上线。 在功能方面,DoctorClaw初期将侧重于学术文献检索和常规诊疗辅助。但其长期战略旨在深度融入临床诊断、医

百度健康近期内部测试了AI医生助手“DoctorClaw”,用于学术文献检索和日常办公辅助

据报道,百度健康已开始对一款专为医生设计的专业AI智能助手进行内部测试。该产品内部代号为“DoctorClaw”(龙虾医生版),标志着百度在医疗领域部署大型语言模型方面迈出了重要一步。知情人士透露,该项目仍处于封闭开发阶段,目前已进入内部测试。虽然具体的产品形态尚未完全披露,但已接近上线。 在功能方面,DoctorClaw初期将侧重于学术文献检索和常规诊疗辅助。但其长期战略旨在深度融入临床诊断、医

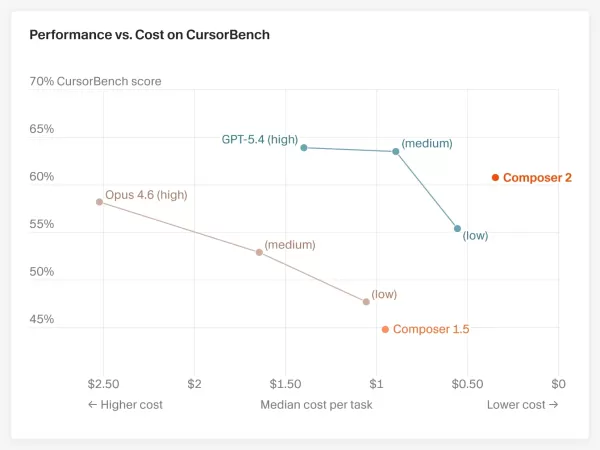

Cursor Composer 2 与 Claude Opus 4.6:基准测试引发新一轮人工智能编程争论

3月19日,Cursor正式发布了其自主研发的编程模型Composer 2。 这一消息在开发者社区中立即引发热议——据 Cursor 称,Composer 2 在 Terminal-Bench 2.0 测试中获得了 61.7% 的得分,在相同的测试条件下,这一成绩显著超过了 Claude Opus 4.6 的 58.0%。Anthropic的旗舰模型竟被自家IDE内置的模型超越?随着消息传开,相关

Cursor Composer 2 与 Claude Opus 4.6:基准测试引发新一轮人工智能编程争论

3月19日,Cursor正式发布了其自主研发的编程模型Composer 2。 这一消息在开发者社区中立即引发热议——据 Cursor 称,Composer 2 在 Terminal-Bench 2.0 测试中获得了 61.7% 的得分,在相同的测试条件下,这一成绩显著超过了 Claude Opus 4.6 的 58.0%。Anthropic的旗舰模型竟被自家IDE内置的模型超越?随着消息传开,相关

StrictlyVC旧金山站将汇聚TDK Ventures、Replit等企业的领军人物

今年首场StrictlyVC活动即将登陆旧金山,时间比你想象的要早。 4月30日,我们在菲律宾文化中心(Sentro Filipino Cultural Center)举办的聚会门票仍在热售中,届时将有阵容强大的演讲嘉宾阵容。除了StrictlyVC一贯以人脉拓展和社区互动著称外,本次旧金山活动对于寻求最新融资洞见的AI创新者和创始人而言,将具有特别重要的价值。谁将登台门票现已开售,但如果您此前未

相关专题推荐

评论 (2)

0/500

StrictlyVC旧金山站将汇聚TDK Ventures、Replit等企业的领军人物

今年首场StrictlyVC活动即将登陆旧金山,时间比你想象的要早。 4月30日,我们在菲律宾文化中心(Sentro Filipino Cultural Center)举办的聚会门票仍在热售中,届时将有阵容强大的演讲嘉宾阵容。除了StrictlyVC一贯以人脉拓展和社区互动著称外,本次旧金山活动对于寻求最新融资洞见的AI创新者和创始人而言,将具有特别重要的价值。谁将登台门票现已开售,但如果您此前未

相关专题推荐

评论 (2)

0/500

人工智能的出现带来了一波技术进步,但也对我们区分事实与虚构的能力造成了干扰。最近,社交媒体上流传的AI生成图像引发了人们对其可能扭曲政治对话和威胁选举完整性的担忧。了解这些技术的全部影响对于保持公共讨论的知情性和维持我们对所见内容的信任至关重要。

AI生成政治图像的争议

AI生成内容的兴起

人工智能已经发展到可以生成看起来和听起来极为真实的图像、视频和音频。这无疑是一项很酷的成就,但也有些可怕,尤其是在涉及政治和选举时。制作令人信服但完全虚构的内容的能力可能误导公众,动摇我们对所消费新闻的信心。社交媒体像野火一样传播这些内容的能力只会让事情变得更糟,使得保持叙事准确并阻止虚假信息传播成为真正的难题。

随着AI工具变得更加用户友好,任何怀有不良动机的人都可以轻松地干扰公众舆论。这些AI创作,通常被称为合成媒体或深度伪造,挑战我们的批判性思维和媒体素养能力。扭曲公众认知和侵蚀对我们机构的信任是一个重大问题,促使我们采取积极措施并设定道德界限以控制风险。

政治竞选可以使用这项技术伪造支持或诽谤对手,影响人们的投票选择。如果没有明确的标识或工具来识别这些伪造内容,普通人可能难以分辨真假,导致基于虚假信息的决策。这种广泛的欺骗可能动摇民主的基础,使我们迫切需要找到技术和政策解决方案来应对这一问题。

那么,我们如何保护自己免受AI在政治竞选中被滥用的影响,并确保选民获得真实信息?这需要技术进步、媒体素养教育和坚实的政策框架相结合。使用AI生成内容引发了关于诚实、公开和责任的重大问题,凸显了每个人都需要站出来捍卫AI时代民主价值观的需要。

特朗普使用AI生成图像

前总统特朗普在社交媒体上发布AI生成图像引发了一场风暴,激起了关于在政治中使用此类内容伦理和后果的激烈争论。

通过分享使泰勒·斯威夫特及其粉丝看起来支持他的图像,特朗普引发了关于操纵公众对其看法的问题。其中一些图像是真实的,而其他则是AI生成的,造成了混乱并引发了关于政治信息透明度的问题。

这些图像显示穿着“Swifties for Trump”衬衫的女性,暗示了一个可能并不真正支持他的群体的支持。这一举动引发了关于使用AI伪造支持或扭曲公众情绪是否合乎道德的问题。没有明确标记一些图像为AI生成只会让情况更加混乱,可能欺骗那些不知道自己在看人工合成内容的人。

虽然一些图像确实是AI生成的,但其他则是特朗普支持者的真实照片。如此混杂真实与虚假的内容可能使观众难以分辨真相,模糊了诚实与欺骗性信息之间的界限。这种混淆可能侵蚀信任并在公共讨论中播下怀疑种子,使人们对自己分辨真假的能力失去信心。

分享这些图像也可以被视为一种战略举措,旨在赢得特定选民群体(如泰勒·斯威夫特的粉丝)的支持,无论他们是否真正支持他。通过制造广泛支持的假象,即使是人工智能生成的,政治竞选可能影响摇摆选民或激励其基本盘。这显示了AI作为一种说服工具的强大能力,能够塑造公众舆论并影响选举结果。

当重要政治人物使用AI生成内容时,这对公众来说是一个警钟,需要更加警惕和具备媒体素养。随着AI技术不断进步,人们必须批判性地思考他们在网上看到的内容并寻找可信的来源。媒体、学校和政府机构都在提高批判性思维和增加对操纵媒体危险的认识方面发挥作用。

混乱与虚假信息

在网上分享AI生成图像和其他被操纵内容正在加剧混乱和虚假信息的问题。

当人们面对真实与虚假信息的混合时,很难分辨真相。这种混乱可能侵蚀对媒体、机构甚至个人关系的信任,使就重要问题达成共识变得困难。

对抗虚假信息的一个最大障碍是它在社交媒体上的传播速度。虚假或误导性内容可能瞬间传播,达到数百万人,而事实核查者甚至还没来得及反应。这种快速传播使得阻止虚假信息造成的损害变得困难,因为它可能在人们心中扎根并影响他们的观点。

另一个挑战是现代操纵技术的复杂程度。AI生成内容、深度伪造和其他合成媒体变得如此精妙,以至于即使是专家也难以辨别。这意味着传统的事实核查和媒体分析已不足以应对,促使我们开发新的工具和方法来对抗。

更糟糕的是网络上的回音室和过滤气泡。社交媒体算法通常向我们展示与我们现有观点相符的内容,创造出回音室,我们主要接触到相似的观点。这可能强化我们的偏见,使我们更难接受不同的观点,导致更多的两极分化和分裂。

为了应对混乱和虚假信息,我们需要多方面的策略,包括技术解决方案、媒体素养教育和政策变革。社交媒体平台应投资于AI驱动的工具来识别和标记被操纵内容。学校应教授媒体素养,教导学生如何批判性评估来源和识别操纵技术。政策制定者应考虑制定法规,追究传播虚假信息者的责任,同时保护言论自由。只有通过合作,我们才能希望遏制虚假信息的传播,培养一个更加知情和参与的公众。

检验真实与AI生成图像

区分真实性的挑战

随着人工智能的复杂性日益增加,区分真实图像与AI生成图像变得越来越困难。AI现在可以生成看起来如此真实的图像,普通人很难将它们与真实照片区分开来。这种能力对我们信任所见内容的能力有重大影响,特别是在新闻和政治沟通等敏感领域。

难以区分的一个原因是AI算法的快速改进。这些算法越来越擅长复制真实场景的纹理、光线和细节,生成几乎无法与真实事物区分的图像。此外,AI可以生成从未存在过的人物、物体和事件的图像,创造出令人信服但完全虚构的现实。

另一个因素是许多人对AI操纵技术了解甚少。如果没有对AI能力的基本了解,人们更容易被欺骗。如果你不知道AI是如何工作的,就很难批判性地评估你在网上看到的图像。

缺乏明确的标签和透明度使情况更加复杂。社交媒体和媒体机构通常不标记AI生成图像,留给观众自己判断真假。这种缺乏公开性使得欺骗性内容更容易传播,因为人们可能假设未标记的图像是真实的。

为了应对这些挑战,我们需要多管齐下的方法,包括技术解决方案、媒体素养教育和政策变革。像AI驱动的检测工具这样的技术解决方案可以帮助识别和标记被操纵的图像。媒体素养教育可以教人们如何批判性评估来源和识别操纵技术。政策变革可以促进使用AI生成内容的透明度和责任感。

通过结合这些努力,我们可以更好地保护自己免受AI在视觉媒体中被欺骗性使用的侵害,并建立对塑造我们公共讨论的图像的更多信任。开发和广泛采用这些工具对于保持视觉媒体的诚信至关重要,确保人们能够基于可靠信息做出明智决策。

识别AI生成内容的策略

视觉验证的分步指南

随着AI生成内容变得越来越复杂,我们必须保持警惕并使用具体方法来检查所见内容的真实性。以下是帮助你的分步指南:

- 检查图像细节:仔细观察图像是否有任何异常。AI生成图像通常有细微的缺陷或不一致。注意:

- 不自然的纹理:纹理看起来过于平滑或缺乏应有的细节。

- 光线异常:光线与场景不符或有不一致的阴影。

- 背景扭曲:背景元素显得模糊或不合理。

- 反向图像搜索:使用Google Images、TinEye或Yandex Images等搜索引擎进行反向图像搜索。这可以帮助你查看图像是否在其他地方使用过或是否符合已知的AI生成模式。

- 检查来源:确保发布图像的来源可信。寻找知名新闻机构、官方网站或可信组织。谨慎对待匿名来源或已知传播虚假信息的网站。

- 交叉参考信息:将图像及任何相关信息与其他来源进行比较以确认其准确性。检查多家新闻机构、事实核查网站和专家,确保一切吻合。

- 使用AI检测工具:使用可以分析图像并识别潜在AI生成内容的AI检测工具。这些工具越来越擅长提供关于图像是否可能被操纵的见解。

- 咨询专家:如果你仍不确定,与数字取证或媒体分析专家交流。他们拥有专业知识和工具,可以发现细微的操纵迹象。

通过遵循这些步骤,你可以更好地识别AI生成内容并保护自己免受虚假信息的侵害。在当今数字世界中,保持知情和适度的怀疑至关重要,因为欺骗性图像可能迅速传播并影响公众舆论。一个怀疑且知情的公众对于在AI时代保持信任和可信度至关重要。

评估AI生成图像:优点与缺点

优点

- 增强创造力:AI可以通过生成新的图像组合和风格激发创造力。

- 内容创作效率:AI使内容创作更快、更高效,节省时间和资源。

- 可访问性:AI使图像生成对所有人开放,而不仅仅是专业人士。

- 定制化:AI允许高度定制化的图像生成以满足特定需求。

缺点

- 虚假信息风险:AI使创建和传播误导性图像变得更容易。

- 真实性问题:AI模糊了真实与虚假的界限,使人们更难信任所见内容。

- 伦理问题:AI引发了关于操纵、透明度和责任的伦理问题。

- 就业替代:随着自动化增加,AI可能取代人类艺术家和内容创作者的工作。

常见问题

如何有效识别AI生成图像?

要识别AI生成图像,你需要仔细检查细节并使用可用的工具。检查光线、纹理和背景元素的不一致。使用反向图像搜索查看图像是否在其他地方使用过。AI检测工具可以提供关于图像是否可能被操纵的见解。与多个来源交叉参考信息并咨询专家可以进一步确认图像的真实性。

对抗AI生成虚假信息的潜在解决方案是什么?

对抗AI生成虚假信息需要多方面的策略。我们需要技术解决方案、媒体素养教育和政策变革。社交媒体平台应投资于AI检测工具,学校应教授媒体素养。政策制定者应考虑促进使用AI生成内容透明度和责任感的法规。

AI生成图像如何影响选举完整性?

AI生成图像可能通过传播虚假信息和操纵公众舆论来破坏选举完整性。虚假支持、候选人的负面描绘和其他欺骗性内容可能影响选民情绪并影响选举结果。混合真实与虚假内容会侵蚀信任并在公共讨论中引入不确定性。

为什么标记AI生成内容很重要?

标记AI生成内容对于透明度和责任感至关重要。如果没有明确的标签,人们可能在不知情的情况下消费被操纵的媒体,导致错误的决策。标签帮助观众批判性地评估内容,并对其准确性和有效性作出明智判断。

相关问题

社交媒体平台在应对AI生成虚假信息方面扮演什么角色?

社交媒体平台在应对AI生成虚假信息方面扮演重要角色。他们需要投资于AI检测工具,实施明确的标签政策,并在其用户中推广媒体素养。通过采取积极措施对抗欺骗性内容,社交媒体平台可以帮助保护选举完整性并维持公众信任。

教育机构如何促进媒体素养和批判性思维技能?

教育机构可以通过将媒体素养和批判性思维纳入课程来推广这些技能。学生应学习如何评估信息来源、识别操纵技术并与多个来源交叉参考信息。通过培养批判性思维,学校可以赋予学生成为知情且参与的公民,减少被虚假信息欺骗的可能性。

有哪些法规或政策可以在不侵犯言论自由的情况下对抗AI生成虚假信息?

在保护言论自由的同时对抗AI生成虚假信息需要谨慎的政策制定。透明度要求,如强制标记AI生成内容,可以在不限制言论的情况下告知公众。责任措施,如追究传播已知虚假信息者的责任,可以威慑不良行为者。在监管与自由表达之间找到平衡对于维持健康的民主公共话语至关重要。

百度健康近期内部测试了AI医生助手“DoctorClaw”,用于学术文献检索和日常办公辅助

据报道,百度健康已开始对一款专为医生设计的专业AI智能助手进行内部测试。该产品内部代号为“DoctorClaw”(龙虾医生版),标志着百度在医疗领域部署大型语言模型方面迈出了重要一步。知情人士透露,该项目仍处于封闭开发阶段,目前已进入内部测试。虽然具体的产品形态尚未完全披露,但已接近上线。 在功能方面,DoctorClaw初期将侧重于学术文献检索和常规诊疗辅助。但其长期战略旨在深度融入临床诊断、医

百度健康近期内部测试了AI医生助手“DoctorClaw”,用于学术文献检索和日常办公辅助

据报道,百度健康已开始对一款专为医生设计的专业AI智能助手进行内部测试。该产品内部代号为“DoctorClaw”(龙虾医生版),标志着百度在医疗领域部署大型语言模型方面迈出了重要一步。知情人士透露,该项目仍处于封闭开发阶段,目前已进入内部测试。虽然具体的产品形态尚未完全披露,但已接近上线。 在功能方面,DoctorClaw初期将侧重于学术文献检索和常规诊疗辅助。但其长期战略旨在深度融入临床诊断、医

Cursor Composer 2 与 Claude Opus 4.6:基准测试引发新一轮人工智能编程争论

3月19日,Cursor正式发布了其自主研发的编程模型Composer 2。 这一消息在开发者社区中立即引发热议——据 Cursor 称,Composer 2 在 Terminal-Bench 2.0 测试中获得了 61.7% 的得分,在相同的测试条件下,这一成绩显著超过了 Claude Opus 4.6 的 58.0%。Anthropic的旗舰模型竟被自家IDE内置的模型超越?随着消息传开,相关

Cursor Composer 2 与 Claude Opus 4.6:基准测试引发新一轮人工智能编程争论

3月19日,Cursor正式发布了其自主研发的编程模型Composer 2。 这一消息在开发者社区中立即引发热议——据 Cursor 称,Composer 2 在 Terminal-Bench 2.0 测试中获得了 61.7% 的得分,在相同的测试条件下,这一成绩显著超过了 Claude Opus 4.6 的 58.0%。Anthropic的旗舰模型竟被自家IDE内置的模型超越?随着消息传开,相关

StrictlyVC旧金山站将汇聚TDK Ventures、Replit等企业的领军人物

今年首场StrictlyVC活动即将登陆旧金山,时间比你想象的要早。 4月30日,我们在菲律宾文化中心(Sentro Filipino Cultural Center)举办的聚会门票仍在热售中,届时将有阵容强大的演讲嘉宾阵容。除了StrictlyVC一贯以人脉拓展和社区互动著称外,本次旧金山活动对于寻求最新融资洞见的AI创新者和创始人而言,将具有特别重要的价值。谁将登台门票现已开售,但如果您此前未

StrictlyVC旧金山站将汇聚TDK Ventures、Replit等企业的领军人物

今年首场StrictlyVC活动即将登陆旧金山,时间比你想象的要早。 4月30日,我们在菲律宾文化中心(Sentro Filipino Cultural Center)举办的聚会门票仍在热售中,届时将有阵容强大的演讲嘉宾阵容。除了StrictlyVC一贯以人脉拓展和社区互动著称外,本次旧金山活动对于寻求最新融资洞见的AI创新者和创始人而言,将具有特别重要的价值。谁将登台门票现已开售,但如果您此前未

首页

首页