AI生成画像が選挙の公正性を巡って論争を引き起こす

人工知能の登場は技術の進歩の波をもたらしたが、事実と虚構を見分ける能力に混乱を投げかけている。最近、ソーシャルメディアで拡散しているAI生成画像は、政治的対話を歪め、選挙の公正性を脅かす可能性があるとして懸念を引き起こしている。これらの技術の全貌を理解し、公開討論を情報に基づいたものに保ち、目にするものへの信頼を維持することが不可欠である。

AI生成政治画像の論争

AI生成コンテンツの台頭

人工知能は、驚くほどリアルに見え、聞こえる画像、動画、音声を生成できる段階に達している。これは間違いなく素晴らしい成果だが、特に政治や選挙に関しては少し怖い面もある。説得力のある完全に作り上げられたコンテンツを作成する力は、世論を混乱させ、消費するニュースへの信頼を揺さぶる可能性がある。ソーシャルメディアがこのコンテンツを野火のように拡散させる能力は、状況を悪化させ、物語を正確に保ち、誤情報を阻止することを本当に頭の痛い問題にしている。

AIツールが使いやすくなるにつれ、悪意を持った誰かが世論を操作することがこれまで以上に簡単になっている。これらのAI創作物、しばしば合成メディアやディープフェイクと呼ばれるものは、批判的思考やメディアリテラシーを維持する能力に挑戦している。世論を歪め、制度への信頼を侵食する可能性は大きな問題であり、リスクを抑えるために積極的な対策と倫理的境界を設定する必要がある。

政治キャンペーンは、この技術を使って偽の支持を捏造したり、対立候補を中傷したりして、投票行動に影響を与える可能性がある。偽物を見分ける明確な兆候やツールがなければ、普通の人は本物と偽物を見分けるのに苦労し、誤った情報に基づく選択をするかもしれない。このような広範な欺瞞は、民主主義の基盤を揺さぶる可能性があり、技術的および政策的解決策を急いで見つける必要がある。

では、AIが政治キャンペーンで誤用されるのを防ぎ、有権者が本物の情報を得るにはどうすればよいか? 技術の進歩、メディアリテラシーの教育、強固な政策枠組みの組み合わせが必要だ。AI生成コンテンツの使用は、誠実さ、透明性、責任に関する大きな疑問を投げかけ、AI時代において民主的価値を守るために全員が立ち上がる必要性を強調している。

トランプのAI生成画像の使用

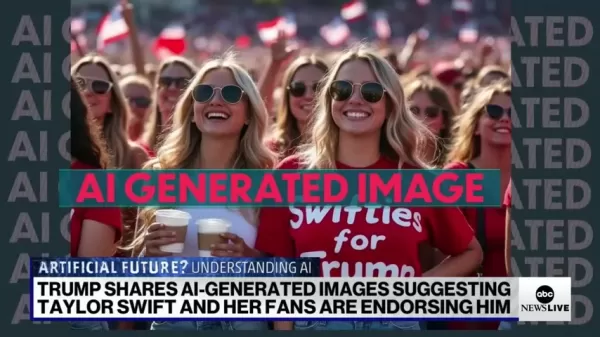

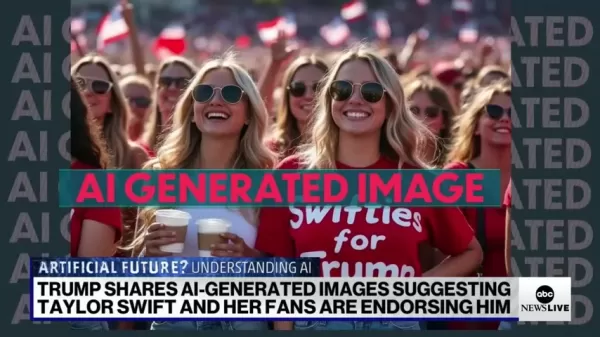

トランプ元大統領がソーシャルメディアにAI生成画像を投稿したことで、大きな議論が巻き起こり、政治におけるこのようなコンテンツの使用の倫理と影響についての激しい議論が引き起こされた。

テイラー・スウィフトや彼女のファンが彼を支持しているように見える画像を共有することで、トランプは人々が彼をどう見るかを操作しているのではないかという疑問を投げかけた。これらの画像の一部は本物で、一部はAI生成のものであり、混乱を引き起こし、政治的メッセージの透明性についての疑問を提起した。

画像には「Swifties for Trump」のシャツを着た女性が登場し、彼の政治に実際には賛同していないかもしれないグループの支持をほのめかしていた。この動きは、AIを使って偽の支持を捏造したり、世論を歪めたりすることが倫理的に正しいのかという疑問を投げかける。一部の画像がAI生成であると明確に示されていないことは、人工的なものを見ていると知らない人々を騙す可能性があり、事態をさらに混乱させる。

一部の画像は確かにAI生成だったが、他のものはトランプ支持者の本物の写真だった。こうした本物と偽物の混在は、視聴者が何が本当かを判断するのを難しくし、誠実なメッセージと欺瞞的なメッセージの境界を曖昧にする。この混同は信頼を侵食し、公開討論に疑念を植え付け、人々が本物と偽物を見分ける能力に自信を失う原因となる。

これらの画像の共有は、テイラー・スウィフトのファンのような特定の有権者グループを、実際に支持しているかどうかにかかわらず取り込む戦略的な動きとも見なせる。広範な支持の幻想を、たとえそれが人工的に生成されたものであっても作り出すことで、政治キャンペーンは未定の有権者を動かしたり、支持基盤を鼓舞したりするかもしれない。これは、AIが世論を形成し、選挙結果に影響を与える強力なツールであることを示している。

大きな政治的影響力を持つ人物がAI生成コンテンツを使用することは、国民がより警戒し、メディアリテラシーを高める必要があるという警鐘である。AI技術が進化し続ける中、オンラインで見るコンテンツについて批判的に考え、信頼できる情報源を求めることが重要だ。メディア、学校、政府機関は、批判的思考を高め、操作されたメディアの危険性について認識を高める役割を担っている。

混乱と誤情報

AI生成画像やその他の操作されたコンテンツをオンラインで共有することは、混乱と誤情報の増大する問題を助長している。

本物と偽物の情報が混在すると、何が本当かを見極めるのが難しい。この混乱は、メディア、制度、さらには個人的な関係への信頼を侵食し、重要な問題について合意に達するのを難しくする。

誤情報と戦う最大の課題の一つは、ソーシャルメディアでの拡散の速さである。偽または誤解を招くコンテンツは、瞬く間にバイラルになり、ファクトチェッカーが反応する前に何百万人に届く。この急速な拡散は、誤情報によるダメージを阻止するのを難しくし、人々の心に根付き、意見に影響を与える可能性がある。

もう一つの課題は、現代の操作技術の高度化である。AI生成コンテンツ、ディープフェイク、その他の合成メディアは非常に優れており、専門家でさえ見分けるのに苦労する。これにより、従来のファクトチェックやメディア分析では不十分になり、新しいツールや方法を開発する必要がある。

さらに悪化させるのは、オンラインのエコーチェンバーやフィルターバブルだ。ソーシャルメディアのアルゴリズムは、既存の視点に合ったコンテンツを表示する傾向があり、似たような視点に主にさらされるエコーチェンバーを作り出す。これにより、偏見が強化され、異なる視点と関わることが難しくなり、さらなる分極化と分裂を引き起こす。

混乱と誤情報を解決するには、技術的解決策、メディアリテラシー教育、政策変更を含む多面的なアプローチが必要だ。ソーシャルメディアプラットフォームは、操作されたコンテンツを検出してフラグ付けするAI駆動のツールに投資すべきだ。学校はメディアリテラシーを教え、生徒に情報源を批判的に評価し、操作技術を見つける方法を教えるべきだ。政策立案者は、言論の自由を保護しながら、誤情報を拡散する責任を負う人々を追及する規制を考えるべきだ。協力して初めて、誤情報の拡散を抑え、より情報に基づいた関与する公衆を育むことができる。

本物とAI生成画像の検証

本物を見分ける難しさ

人工知能の高度化により、本物の画像とAI生成画像を見分けることが日々難しくなっている。AIは今、非常にリアルに見える画像を作成でき、平均的な人が本物の写真と見分けるのは難しい。この能力は、特にニュースや政治的コミュニケーションといった敏感な領域で、目にするものへの信頼に大きな影響を与える。

見分けるのが難しい理由の一つは、AIアルゴリズムが急速に改善していることだ。これらのアルゴリズムは、実際のシーンのテクスチャ、照明、詳細を模倣するのに非常に優れており、ほぼ本物と見分けがつかない画像を作り出す。さらに、AIは存在しない人物、物体、イベントの画像を作成でき、完全に作り上げられた説得力のある現実を構築する。

もう一つの要因は、AI操作技術について一般の人があまり知識を持っていないことだ。AIが何をできるかについての基本的な理解がなければ、騙されやすくなる。AIの仕組みを知らなければ、オンラインで見る画像を批判的に評価するのは難しい。

明確なラベル付けや透明性の欠如は、事態をさらに複雑にする。ソーシャルメディアやメディアは、AI生成画像にしばしばマークを付けず、視聴者が本物かどうかを判断する責任を負わせる。この透明性の欠如は、欺瞞的なコンテンツが拡散しやすくし、未ラベルの画像を本物とみなしてしまう可能性がある。

これらの課題に対処するには、技術的解決策、メディアリテラシー教育、政策変更を組み合わせた多角的なアプローチが必要だ。AI駆動の検出ツールのような技術的解決策は、操作された画像を検出してフラグ付けするのに役立つ。メディアリテラシー教育は、情報源を批判的に評価し、操作技術を見つける方法を教えることができる。政策変更は、AI生成コンテンツの使用における透明性と責任を促進できる。

これらの努力を組み合わせることで、視覚メディアにおけるAIの欺瞞的な使用から身を守り、公開討論を形成する画像への信頼を築くことができる。これらのツールの開発と普及は、視覚メディアの誠実さを保ち、信頼できる情報に基づいて人々が情報に基づいた意思決定を行えるようにするために不可欠である。

AI生成コンテンツを見分ける戦略

ビジュアル検証のためのステップごとのガイド

AI生成コンテンツがますます高度になる中、注意を払い、特定の方法を使って見るものの本物性を確認することが重要だ。以下は役立つステップごとのガイドだ:

- 画像の詳細を調べる: 画像を注意深く見て、何かおかしいところがないか確認する。AI生成画像には、微妙な欠陥や不整合があることが多い。以下を探す:

- 不自然なテクスチャ:期待される詳細が欠けている、または滑らかすぎるテクスチャ。

- 照明の異常:シーンに合わない照明や、一貫性のない影。

- 背景の歪み:背景の要素がぼやけていたり、意味をなさないもの。

- 逆画像検索: Google画像、TinEye、Yandex画像などの検索エンジンを使って逆画像検索を行う。これにより、画像が他で使用されているか、既知のAI生成パターンに一致するかが分かる。

- ソースを確認する: 画像を公開したソースが信頼できるか確認する。評判の良いニュース媒体、公式ウェブサイト、信頼できる組織を探す。匿名ソースや誤情報を広めることで知られているサイトには注意する。

- 情報をクロスチェックする: 画像と付随する情報を他の情報源と比較して正確性を確認する。複数のニュース媒体、ファクトチェックウェブサイト、専門家を確認して、すべてが一致しているか確かめる。

- AI検出ツールを使用する: 画像を分析し、AI生成コンテンツの可能性を特定できるAI検出ツールを使用する。これらのツールは、画像が操作されている可能性についての洞察を提供するのにますます優れている。

- 専門家に相談する: まだ確信が持てない場合、デジタルフォレンジックやメディア分析の専門家に相談する。彼らは微妙な操作の兆候を見つける専門知識とツールを持っている。

これらのステップに従うことで、AI生成コンテンツを見分ける能力を高め、誤情報から身を守ることができる。情報に通じ、多少の懐疑心を持つことは、欺瞞的な画像が急速に拡散し、世論に影響を与える今日のデジタル世界で重要だ。懐疑的で情報に基づいた公衆は、AI時代における信頼と信用を維持するために不可欠である。

AI生成画像の評価:利点と欠点

利点

- 創造性の向上: AIは新しい画像の組み合わせやスタイルを生み出し、創造性を刺激する。

- コンテンツ作成の効率性: AIはコンテンツ作成を迅速かつ効率的にし、時間とリソースを節約する。

- アクセシビリティ: AIは画像生成をプロだけでなく誰でも利用できるものにする。

- カスタマイズ: AIは特定のニーズに合わせた高度にカスタマイズされた画像生成を可能にする。

欠点

- 誤情報のリスク: AIは誤解を招く画像を作成・拡散しやすくする。

- 本物性の懸念: AIは本物と偽物の境界を曖昧にし、目にするものを信頼するのを難しくする。

- 倫理的問題: AIは操作、透明性、責任に関する倫理的疑問を投げかける。

- 雇用の喪失: 自動化が増えることで、AIは人間のアーティストやコンテンツクリエイターの仕事を奪う可能性がある。

よくある質問

AI生成画像を効果的に見分けるにはどうすればよいか?

AI生成画像を見分けるには、詳細を注意深く調べ、利用可能なツールを使う必要がある。照明、テクスチャ、背景要素の不整合を確認する。逆画像検索を使用して、画像が他で使用されているか確認する。AI検出ツールは、画像が操作されている可能性についての洞察を提供できる。複数の情報源で情報をクロスチェックし、専門家に相談することで、画像の本物性をさらに確認できる。

AI生成誤情報の拡散に対抗する潜在的な解決策は何ですか?

AI生成誤情報と戦うには、技術的解決策、メディアリテラシー教育、政策変更の多面的なアプローチが必要だ。ソーシャルメディアプラットフォームはAI検出ツールに投資すべきだし、学校はメディアリテラシーを教えるべきだ。政策立案者は、AI生成コンテンツの使用における透明性と責任を促進する規制を検討すべきだ。

AI生成画像は選挙の公正性にどのような影響を与えるか?

AI生成画像は、誤情報を拡散し、世論を操作することで選挙の公正性を損なう可能性がある。偽の支持、候補者の否定的な描写、その他の欺瞞的コンテンツは、有権者の感情を揺さぶり、選挙結果に影響を与える。本物と偽物のコンテンツの混在は、信頼を侵食し、公開討論に不確実性を導入する。

AI生成コンテンツにラベルを付けることが重要なのはなぜか?

AI生成コンテンツにラベルを付けることは、透明性と責任のために不可欠である。明確なラベルがなければ、人々は知らずに操作されたメディアを消費し、誤った判断を下す可能性がある。ラベル付けは、視聴者がコンテンツを批判的に評価し、その正確性と有効性について情報に基づいた判断を下すのに役立つ。

関連する質問

ソーシャルメディアプラットフォームはAI生成誤情報に対処する上でどのような役割を果たすか?

ソーシャルメディアプラットフォームは、AI生成誤情報への対処に大きな役割を果たす。AI検出ツールに投資し、明確なラベル付けポリシーを導入し、ユーザー間でメディアリテラシーを促進する必要がある。欺瞞的なコンテンツと戦うための積極的な措置を講じることで、ソーシャルメディアプラットフォームは選挙の公正性を保護し、公共の信頼を維持するのに役立つ。

教育機関はメディアリテラシーと批判的思考スキルをどのように促進できるか?

教育機関は、カリキュラムにメディアリテラシーと批判的思考を含めることでこれを促進できる。生徒は情報源の評価方法、操作技術の見分け方、複数の情報源で情報をクロスチェックする方法を学ぶべきだ。批判的思考を養うことで、学校は情報に基づき、関与する市民を育て、誤情報に騙されにくいようにできる。

言論の自由を侵害せずにAI生成誤情報を抑制するための規制や政策は何か?

言論の自由を保護しながらAI生成誤情報を抑制するには、慎重な政策立案が必要だ。AI生成コンテンツの必須ラベル付けのような透明性要件は、言論を制限せずに公衆に情報を提供できる。既知の誤情報を拡散する責任を負う人々に責任を負わせる責任措置は、悪意ある行為者を抑止できる。規制と自由な表現の適切なバランスを見つけることは、健全で民主的な公開討論を維持するために重要である。

関連記事

インドが技術開発を加速させる中、リライアンスが1,100億ドルのAI投資計画を発表

インドの複合企業リライアンスの会長で億万長者のムケシュ・アンバニ氏は木曜日、今後7年間にわたりインド全土にAIコンピューティングインフラを構築するための10兆ルピー(約1,100億ドル)規模の計画を発表しました。木曜日にニューデリーで開催された「インドAIインパクト・サミット」で講演したアンバニ氏は、この投資により、ギガワット規模のデータセンター、全国規模のエッジコンピューティング・ネットワーク、

インドが技術開発を加速させる中、リライアンスが1,100億ドルのAI投資計画を発表

インドの複合企業リライアンスの会長で億万長者のムケシュ・アンバニ氏は木曜日、今後7年間にわたりインド全土にAIコンピューティングインフラを構築するための10兆ルピー(約1,100億ドル)規模の計画を発表しました。木曜日にニューデリーで開催された「インドAIインパクト・サミット」で講演したアンバニ氏は、この投資により、ギガワット規模のデータセンター、全国規模のエッジコンピューティング・ネットワーク、

Zhiyuan WITA、初のコンプライアンス報告書の提出により「裸の」ロボットとの対話を終了

具現化知能分野において、重要な節目を迎えました。上海サイバー空間管理局の最新の発表によると、智源(Zhiyuan)が開発したWITA大規模モデルは届出手続きを無事に完了し、国内で初めて法規制に準拠して展開された具現化知能対話用大規模モデルとなりました。この成果は、単にライセンスを取得しただけにとどまらない。WITAの核心的な目的は、ヒューマノイドロボットが真の意味で会話し、感情を認識し、独自の個性

Zhiyuan WITA、初のコンプライアンス報告書の提出により「裸の」ロボットとの対話を終了

具現化知能分野において、重要な節目を迎えました。上海サイバー空間管理局の最新の発表によると、智源(Zhiyuan)が開発したWITA大規模モデルは届出手続きを無事に完了し、国内で初めて法規制に準拠して展開された具現化知能対話用大規模モデルとなりました。この成果は、単にライセンスを取得しただけにとどまらない。WITAの核心的な目的は、ヒューマノイドロボットが真の意味で会話し、感情を認識し、独自の個性

ある人類学的研究によると、洗練されたAIコンテンツは人間の思考力の低下と関連しているという

AIが、構成が整い、論理的に明快なコードや文書を瞬時に生成するのを見ると、何も疑うことなくそれを信用したくなってしまいませんか?AI分野のリーディングカンパニーであるAnthropicは、AIbaseによると、最近「AI流暢性指数(AI Fluency Index)」と題した調査報告書を発表しました。 約1万件の匿名化されたClaudeの会話サンプルを分析した結果、この調査では懸念すべき傾向が明ら

関連特集おすすめ

コメント (2)

0/500

ある人類学的研究によると、洗練されたAIコンテンツは人間の思考力の低下と関連しているという

AIが、構成が整い、論理的に明快なコードや文書を瞬時に生成するのを見ると、何も疑うことなくそれを信用したくなってしまいませんか?AI分野のリーディングカンパニーであるAnthropicは、AIbaseによると、最近「AI流暢性指数(AI Fluency Index)」と題した調査報告書を発表しました。 約1万件の匿名化されたClaudeの会話サンプルを分析した結果、この調査では懸念すべき傾向が明ら

関連特集おすすめ

コメント (2)

0/500

人工知能の登場は技術の進歩の波をもたらしたが、事実と虚構を見分ける能力に混乱を投げかけている。最近、ソーシャルメディアで拡散しているAI生成画像は、政治的対話を歪め、選挙の公正性を脅かす可能性があるとして懸念を引き起こしている。これらの技術の全貌を理解し、公開討論を情報に基づいたものに保ち、目にするものへの信頼を維持することが不可欠である。

AI生成政治画像の論争

AI生成コンテンツの台頭

人工知能は、驚くほどリアルに見え、聞こえる画像、動画、音声を生成できる段階に達している。これは間違いなく素晴らしい成果だが、特に政治や選挙に関しては少し怖い面もある。説得力のある完全に作り上げられたコンテンツを作成する力は、世論を混乱させ、消費するニュースへの信頼を揺さぶる可能性がある。ソーシャルメディアがこのコンテンツを野火のように拡散させる能力は、状況を悪化させ、物語を正確に保ち、誤情報を阻止することを本当に頭の痛い問題にしている。

AIツールが使いやすくなるにつれ、悪意を持った誰かが世論を操作することがこれまで以上に簡単になっている。これらのAI創作物、しばしば合成メディアやディープフェイクと呼ばれるものは、批判的思考やメディアリテラシーを維持する能力に挑戦している。世論を歪め、制度への信頼を侵食する可能性は大きな問題であり、リスクを抑えるために積極的な対策と倫理的境界を設定する必要がある。

政治キャンペーンは、この技術を使って偽の支持を捏造したり、対立候補を中傷したりして、投票行動に影響を与える可能性がある。偽物を見分ける明確な兆候やツールがなければ、普通の人は本物と偽物を見分けるのに苦労し、誤った情報に基づく選択をするかもしれない。このような広範な欺瞞は、民主主義の基盤を揺さぶる可能性があり、技術的および政策的解決策を急いで見つける必要がある。

では、AIが政治キャンペーンで誤用されるのを防ぎ、有権者が本物の情報を得るにはどうすればよいか? 技術の進歩、メディアリテラシーの教育、強固な政策枠組みの組み合わせが必要だ。AI生成コンテンツの使用は、誠実さ、透明性、責任に関する大きな疑問を投げかけ、AI時代において民主的価値を守るために全員が立ち上がる必要性を強調している。

トランプのAI生成画像の使用

トランプ元大統領がソーシャルメディアにAI生成画像を投稿したことで、大きな議論が巻き起こり、政治におけるこのようなコンテンツの使用の倫理と影響についての激しい議論が引き起こされた。

テイラー・スウィフトや彼女のファンが彼を支持しているように見える画像を共有することで、トランプは人々が彼をどう見るかを操作しているのではないかという疑問を投げかけた。これらの画像の一部は本物で、一部はAI生成のものであり、混乱を引き起こし、政治的メッセージの透明性についての疑問を提起した。

画像には「Swifties for Trump」のシャツを着た女性が登場し、彼の政治に実際には賛同していないかもしれないグループの支持をほのめかしていた。この動きは、AIを使って偽の支持を捏造したり、世論を歪めたりすることが倫理的に正しいのかという疑問を投げかける。一部の画像がAI生成であると明確に示されていないことは、人工的なものを見ていると知らない人々を騙す可能性があり、事態をさらに混乱させる。

一部の画像は確かにAI生成だったが、他のものはトランプ支持者の本物の写真だった。こうした本物と偽物の混在は、視聴者が何が本当かを判断するのを難しくし、誠実なメッセージと欺瞞的なメッセージの境界を曖昧にする。この混同は信頼を侵食し、公開討論に疑念を植え付け、人々が本物と偽物を見分ける能力に自信を失う原因となる。

これらの画像の共有は、テイラー・スウィフトのファンのような特定の有権者グループを、実際に支持しているかどうかにかかわらず取り込む戦略的な動きとも見なせる。広範な支持の幻想を、たとえそれが人工的に生成されたものであっても作り出すことで、政治キャンペーンは未定の有権者を動かしたり、支持基盤を鼓舞したりするかもしれない。これは、AIが世論を形成し、選挙結果に影響を与える強力なツールであることを示している。

大きな政治的影響力を持つ人物がAI生成コンテンツを使用することは、国民がより警戒し、メディアリテラシーを高める必要があるという警鐘である。AI技術が進化し続ける中、オンラインで見るコンテンツについて批判的に考え、信頼できる情報源を求めることが重要だ。メディア、学校、政府機関は、批判的思考を高め、操作されたメディアの危険性について認識を高める役割を担っている。

混乱と誤情報

AI生成画像やその他の操作されたコンテンツをオンラインで共有することは、混乱と誤情報の増大する問題を助長している。

本物と偽物の情報が混在すると、何が本当かを見極めるのが難しい。この混乱は、メディア、制度、さらには個人的な関係への信頼を侵食し、重要な問題について合意に達するのを難しくする。

誤情報と戦う最大の課題の一つは、ソーシャルメディアでの拡散の速さである。偽または誤解を招くコンテンツは、瞬く間にバイラルになり、ファクトチェッカーが反応する前に何百万人に届く。この急速な拡散は、誤情報によるダメージを阻止するのを難しくし、人々の心に根付き、意見に影響を与える可能性がある。

もう一つの課題は、現代の操作技術の高度化である。AI生成コンテンツ、ディープフェイク、その他の合成メディアは非常に優れており、専門家でさえ見分けるのに苦労する。これにより、従来のファクトチェックやメディア分析では不十分になり、新しいツールや方法を開発する必要がある。

さらに悪化させるのは、オンラインのエコーチェンバーやフィルターバブルだ。ソーシャルメディアのアルゴリズムは、既存の視点に合ったコンテンツを表示する傾向があり、似たような視点に主にさらされるエコーチェンバーを作り出す。これにより、偏見が強化され、異なる視点と関わることが難しくなり、さらなる分極化と分裂を引き起こす。

混乱と誤情報を解決するには、技術的解決策、メディアリテラシー教育、政策変更を含む多面的なアプローチが必要だ。ソーシャルメディアプラットフォームは、操作されたコンテンツを検出してフラグ付けするAI駆動のツールに投資すべきだ。学校はメディアリテラシーを教え、生徒に情報源を批判的に評価し、操作技術を見つける方法を教えるべきだ。政策立案者は、言論の自由を保護しながら、誤情報を拡散する責任を負う人々を追及する規制を考えるべきだ。協力して初めて、誤情報の拡散を抑え、より情報に基づいた関与する公衆を育むことができる。

本物とAI生成画像の検証

本物を見分ける難しさ

人工知能の高度化により、本物の画像とAI生成画像を見分けることが日々難しくなっている。AIは今、非常にリアルに見える画像を作成でき、平均的な人が本物の写真と見分けるのは難しい。この能力は、特にニュースや政治的コミュニケーションといった敏感な領域で、目にするものへの信頼に大きな影響を与える。

見分けるのが難しい理由の一つは、AIアルゴリズムが急速に改善していることだ。これらのアルゴリズムは、実際のシーンのテクスチャ、照明、詳細を模倣するのに非常に優れており、ほぼ本物と見分けがつかない画像を作り出す。さらに、AIは存在しない人物、物体、イベントの画像を作成でき、完全に作り上げられた説得力のある現実を構築する。

もう一つの要因は、AI操作技術について一般の人があまり知識を持っていないことだ。AIが何をできるかについての基本的な理解がなければ、騙されやすくなる。AIの仕組みを知らなければ、オンラインで見る画像を批判的に評価するのは難しい。

明確なラベル付けや透明性の欠如は、事態をさらに複雑にする。ソーシャルメディアやメディアは、AI生成画像にしばしばマークを付けず、視聴者が本物かどうかを判断する責任を負わせる。この透明性の欠如は、欺瞞的なコンテンツが拡散しやすくし、未ラベルの画像を本物とみなしてしまう可能性がある。

これらの課題に対処するには、技術的解決策、メディアリテラシー教育、政策変更を組み合わせた多角的なアプローチが必要だ。AI駆動の検出ツールのような技術的解決策は、操作された画像を検出してフラグ付けするのに役立つ。メディアリテラシー教育は、情報源を批判的に評価し、操作技術を見つける方法を教えることができる。政策変更は、AI生成コンテンツの使用における透明性と責任を促進できる。

これらの努力を組み合わせることで、視覚メディアにおけるAIの欺瞞的な使用から身を守り、公開討論を形成する画像への信頼を築くことができる。これらのツールの開発と普及は、視覚メディアの誠実さを保ち、信頼できる情報に基づいて人々が情報に基づいた意思決定を行えるようにするために不可欠である。

AI生成コンテンツを見分ける戦略

ビジュアル検証のためのステップごとのガイド

AI生成コンテンツがますます高度になる中、注意を払い、特定の方法を使って見るものの本物性を確認することが重要だ。以下は役立つステップごとのガイドだ:

- 画像の詳細を調べる: 画像を注意深く見て、何かおかしいところがないか確認する。AI生成画像には、微妙な欠陥や不整合があることが多い。以下を探す:

- 不自然なテクスチャ:期待される詳細が欠けている、または滑らかすぎるテクスチャ。

- 照明の異常:シーンに合わない照明や、一貫性のない影。

- 背景の歪み:背景の要素がぼやけていたり、意味をなさないもの。

- 逆画像検索: Google画像、TinEye、Yandex画像などの検索エンジンを使って逆画像検索を行う。これにより、画像が他で使用されているか、既知のAI生成パターンに一致するかが分かる。

- ソースを確認する: 画像を公開したソースが信頼できるか確認する。評判の良いニュース媒体、公式ウェブサイト、信頼できる組織を探す。匿名ソースや誤情報を広めることで知られているサイトには注意する。

- 情報をクロスチェックする: 画像と付随する情報を他の情報源と比較して正確性を確認する。複数のニュース媒体、ファクトチェックウェブサイト、専門家を確認して、すべてが一致しているか確かめる。

- AI検出ツールを使用する: 画像を分析し、AI生成コンテンツの可能性を特定できるAI検出ツールを使用する。これらのツールは、画像が操作されている可能性についての洞察を提供するのにますます優れている。

- 専門家に相談する: まだ確信が持てない場合、デジタルフォレンジックやメディア分析の専門家に相談する。彼らは微妙な操作の兆候を見つける専門知識とツールを持っている。

これらのステップに従うことで、AI生成コンテンツを見分ける能力を高め、誤情報から身を守ることができる。情報に通じ、多少の懐疑心を持つことは、欺瞞的な画像が急速に拡散し、世論に影響を与える今日のデジタル世界で重要だ。懐疑的で情報に基づいた公衆は、AI時代における信頼と信用を維持するために不可欠である。

AI生成画像の評価:利点と欠点

利点

- 創造性の向上: AIは新しい画像の組み合わせやスタイルを生み出し、創造性を刺激する。

- コンテンツ作成の効率性: AIはコンテンツ作成を迅速かつ効率的にし、時間とリソースを節約する。

- アクセシビリティ: AIは画像生成をプロだけでなく誰でも利用できるものにする。

- カスタマイズ: AIは特定のニーズに合わせた高度にカスタマイズされた画像生成を可能にする。

欠点

- 誤情報のリスク: AIは誤解を招く画像を作成・拡散しやすくする。

- 本物性の懸念: AIは本物と偽物の境界を曖昧にし、目にするものを信頼するのを難しくする。

- 倫理的問題: AIは操作、透明性、責任に関する倫理的疑問を投げかける。

- 雇用の喪失: 自動化が増えることで、AIは人間のアーティストやコンテンツクリエイターの仕事を奪う可能性がある。

よくある質問

AI生成画像を効果的に見分けるにはどうすればよいか?

AI生成画像を見分けるには、詳細を注意深く調べ、利用可能なツールを使う必要がある。照明、テクスチャ、背景要素の不整合を確認する。逆画像検索を使用して、画像が他で使用されているか確認する。AI検出ツールは、画像が操作されている可能性についての洞察を提供できる。複数の情報源で情報をクロスチェックし、専門家に相談することで、画像の本物性をさらに確認できる。

AI生成誤情報の拡散に対抗する潜在的な解決策は何ですか?

AI生成誤情報と戦うには、技術的解決策、メディアリテラシー教育、政策変更の多面的なアプローチが必要だ。ソーシャルメディアプラットフォームはAI検出ツールに投資すべきだし、学校はメディアリテラシーを教えるべきだ。政策立案者は、AI生成コンテンツの使用における透明性と責任を促進する規制を検討すべきだ。

AI生成画像は選挙の公正性にどのような影響を与えるか?

AI生成画像は、誤情報を拡散し、世論を操作することで選挙の公正性を損なう可能性がある。偽の支持、候補者の否定的な描写、その他の欺瞞的コンテンツは、有権者の感情を揺さぶり、選挙結果に影響を与える。本物と偽物のコンテンツの混在は、信頼を侵食し、公開討論に不確実性を導入する。

AI生成コンテンツにラベルを付けることが重要なのはなぜか?

AI生成コンテンツにラベルを付けることは、透明性と責任のために不可欠である。明確なラベルがなければ、人々は知らずに操作されたメディアを消費し、誤った判断を下す可能性がある。ラベル付けは、視聴者がコンテンツを批判的に評価し、その正確性と有効性について情報に基づいた判断を下すのに役立つ。

関連する質問

ソーシャルメディアプラットフォームはAI生成誤情報に対処する上でどのような役割を果たすか?

ソーシャルメディアプラットフォームは、AI生成誤情報への対処に大きな役割を果たす。AI検出ツールに投資し、明確なラベル付けポリシーを導入し、ユーザー間でメディアリテラシーを促進する必要がある。欺瞞的なコンテンツと戦うための積極的な措置を講じることで、ソーシャルメディアプラットフォームは選挙の公正性を保護し、公共の信頼を維持するのに役立つ。

教育機関はメディアリテラシーと批判的思考スキルをどのように促進できるか?

教育機関は、カリキュラムにメディアリテラシーと批判的思考を含めることでこれを促進できる。生徒は情報源の評価方法、操作技術の見分け方、複数の情報源で情報をクロスチェックする方法を学ぶべきだ。批判的思考を養うことで、学校は情報に基づき、関与する市民を育て、誤情報に騙されにくいようにできる。

言論の自由を侵害せずにAI生成誤情報を抑制するための規制や政策は何か?

言論の自由を保護しながらAI生成誤情報を抑制するには、慎重な政策立案が必要だ。AI生成コンテンツの必須ラベル付けのような透明性要件は、言論を制限せずに公衆に情報を提供できる。既知の誤情報を拡散する責任を負う人々に責任を負わせる責任措置は、悪意ある行為者を抑止できる。規制と自由な表現の適切なバランスを見つけることは、健全で民主的な公開討論を維持するために重要である。

インドが技術開発を加速させる中、リライアンスが1,100億ドルのAI投資計画を発表

インドの複合企業リライアンスの会長で億万長者のムケシュ・アンバニ氏は木曜日、今後7年間にわたりインド全土にAIコンピューティングインフラを構築するための10兆ルピー(約1,100億ドル)規模の計画を発表しました。木曜日にニューデリーで開催された「インドAIインパクト・サミット」で講演したアンバニ氏は、この投資により、ギガワット規模のデータセンター、全国規模のエッジコンピューティング・ネットワーク、

インドが技術開発を加速させる中、リライアンスが1,100億ドルのAI投資計画を発表

インドの複合企業リライアンスの会長で億万長者のムケシュ・アンバニ氏は木曜日、今後7年間にわたりインド全土にAIコンピューティングインフラを構築するための10兆ルピー(約1,100億ドル)規模の計画を発表しました。木曜日にニューデリーで開催された「インドAIインパクト・サミット」で講演したアンバニ氏は、この投資により、ギガワット規模のデータセンター、全国規模のエッジコンピューティング・ネットワーク、

Zhiyuan WITA、初のコンプライアンス報告書の提出により「裸の」ロボットとの対話を終了

具現化知能分野において、重要な節目を迎えました。上海サイバー空間管理局の最新の発表によると、智源(Zhiyuan)が開発したWITA大規模モデルは届出手続きを無事に完了し、国内で初めて法規制に準拠して展開された具現化知能対話用大規模モデルとなりました。この成果は、単にライセンスを取得しただけにとどまらない。WITAの核心的な目的は、ヒューマノイドロボットが真の意味で会話し、感情を認識し、独自の個性

Zhiyuan WITA、初のコンプライアンス報告書の提出により「裸の」ロボットとの対話を終了

具現化知能分野において、重要な節目を迎えました。上海サイバー空間管理局の最新の発表によると、智源(Zhiyuan)が開発したWITA大規模モデルは届出手続きを無事に完了し、国内で初めて法規制に準拠して展開された具現化知能対話用大規模モデルとなりました。この成果は、単にライセンスを取得しただけにとどまらない。WITAの核心的な目的は、ヒューマノイドロボットが真の意味で会話し、感情を認識し、独自の個性

ある人類学的研究によると、洗練されたAIコンテンツは人間の思考力の低下と関連しているという

AIが、構成が整い、論理的に明快なコードや文書を瞬時に生成するのを見ると、何も疑うことなくそれを信用したくなってしまいませんか?AI分野のリーディングカンパニーであるAnthropicは、AIbaseによると、最近「AI流暢性指数(AI Fluency Index)」と題した調査報告書を発表しました。 約1万件の匿名化されたClaudeの会話サンプルを分析した結果、この調査では懸念すべき傾向が明ら

ある人類学的研究によると、洗練されたAIコンテンツは人間の思考力の低下と関連しているという

AIが、構成が整い、論理的に明快なコードや文書を瞬時に生成するのを見ると、何も疑うことなくそれを信用したくなってしまいませんか?AI分野のリーディングカンパニーであるAnthropicは、AIbaseによると、最近「AI流暢性指数(AI Fluency Index)」と題した調査報告書を発表しました。 約1万件の匿名化されたClaudeの会話サンプルを分析した結果、この調査では懸念すべき傾向が明ら

家

家