KI-generierte Bilder lösen Kontroversen über Wahl-Integrität aus

Das Aufkommen künstlicher Intelligenz hat eine Welle technologischer Fortschritte eingeleitet, aber es hat auch unsere Fähigkeit, Fakten von Fiktion zu unterscheiden, erheblich beeinträchtigt. In letzter Zeit haben auf sozialen Medien kursierende KI-generierte Bilder Besorgnis erregt, da sie das Potenzial haben, politische Gespräche zu verzerren und die Integrität von Wahlen zu gefährden. Es ist entscheidend, dass wir das volle Ausmaß dieser Technologien verstehen, um unsere öffentlichen Diskussionen informiert zu halten und das Vertrauen in das, was wir sehen, aufrechtzuerhalten.

Die Kontroverse um KI-generierte politische Bilder

Der Aufstieg von KI-generierten Inhalten

Künstliche Intelligenz hat einen Punkt erreicht, an dem sie Bilder, Videos und Audios erstellen kann, die unglaublich echt wirken. Das ist zweifellos eine beeindruckende Leistung, aber auch ein wenig beängstigend, besonders wenn es um Politik und Wahlen geht. Die Fähigkeit, überzeugende, aber völlig erfundene Inhalte zu erstellen, kann die Öffentlichkeit verwirren und unser Vertrauen in die Nachrichten, die wir konsumieren, erschüttern. Die Fähigkeit sozialer Medien, solche Inhalte wie ein Lauffeuer zu verbreiten, verschlimmert die Sache nur und macht es zu einer echten Herausforderung, die Narrative klar zu halten und Desinformation zu stoppen.

Da KI-Tools immer benutzerfreundlicher werden, ist es einfacher denn je für jeden mit bösen Absichten, die öffentliche Meinung zu manipulieren. Diese KI-Kreationen, oft als synthetische Medien oder Deepfakes bezeichnet, fordern unsere Fähigkeit heraus, kritisch zu denken und medienkompetent zu bleiben. Das Potenzial, die öffentliche Wahrnehmung zu verdrehen und das Vertrauen in unsere Institutionen zu untergraben, ist ein großes Problem, das uns dazu drängt, proaktive Maßnahmen zu ergreifen und ethische Grenzen zu setzen, um die Risiken im Zaum zu halten.

Politische Kampagnen können diese Technologie nutzen, um gefälschte Unterstützungsbekundungen oder Diffamierungen von Gegnern zu erstellen und so die Wähler zu beeinflussen. Ohne klare Hinweise oder Tools, um diese Fälschungen zu erkennen, könnten normale Menschen Schwierigkeiten haben, zwischen echt und gefälscht zu unterscheiden, was zu Entscheidungen auf Basis falscher Informationen führt. Diese Art von weitverbreiteter Täuschung könnte die Grundlagen der Demokratie erschüttern, was es dringend macht, sowohl technologische als auch politische Lösungen zu finden, um dies zu bekämpfen.

Wie können wir uns also davor schützen, dass KI in politischen Kampagnen missbraucht wird und sicherstellen, dass Wähler die Wahrheit erfahren? Es wird eine Kombination aus technologischen Fortschritten, Medienkompetenzbildung und soliden politischen Rahmenbedingungen erfordern. Die Nutzung von KI-generierten Inhalten wirft große Fragen zu Ehrlichkeit, Offenheit und Verantwortung auf und unterstreicht die Notwendigkeit, dass alle Verantwortung übernehmen und demokratische Werte im KI-Zeitalter verteidigen.

Trumps Nutzung von KI-generierten Bildern

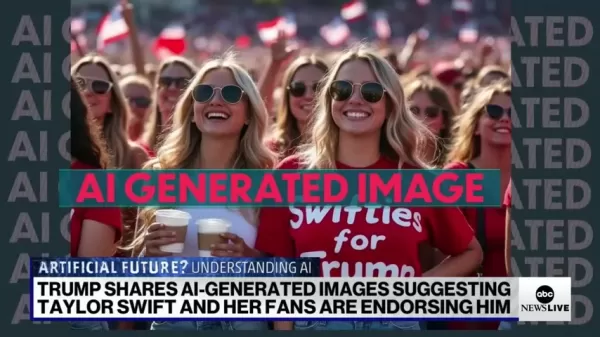

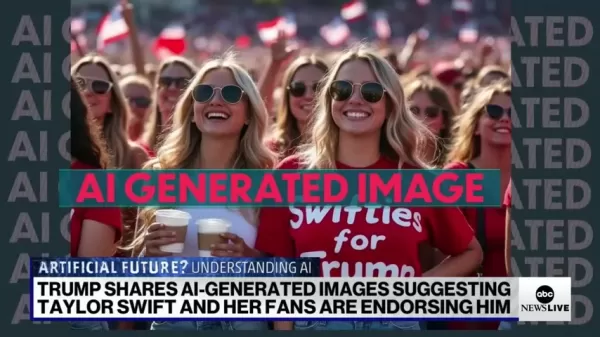

Der ehemalige Präsident Trump sorgte für Aufsehen, als er auf sozialen Medien KI-generierte Bilder veröffentlichte, was eine hitzige Debatte über die Ethik und die Auswirkungen solcher Inhalte in der Politik auslöste.

Indem er Bilder teilte, die den Eindruck erweckten, dass Taylor Swift und ihre Fans ihn unterstützen, sorgte Trump für Verwirrung über die Manipulation seiner öffentlichen Wahrnehmung. Einige dieser Bilder waren echt, andere jedoch KI-generiert, was zu Verwirrung führte und Fragen zur Transparenz politischer Botschaften aufwarf.

Die Bilder zeigten Frauen in „Swifties for Trump“-Shirts, was Unterstützung von einer Gruppe suggerierte, die möglicherweise gar nicht mit seiner Politik übereinstimmt. Dieser Schritt wirft ethische Fragen auf, ob es richtig ist, KI zu nutzen, um gefälschte Unterstützungsbekundungen oder manipulierte öffentliche Stimmungen zu erzeugen. Das Fehlen klarer Kennzeichnungen einiger Bilder als KI-generiert verwirrt nur noch mehr und könnte Menschen täuschen, die nicht wissen, dass sie etwas Künstliches betrachten.

Während einige Bilder tatsächlich KI-generiert waren, waren andere echte Fotos von Trump-Anhängern. Diese Mischung aus echt und gefälscht kann es für Betrachter schwierig machen, herauszufinden, was wahr ist, und verwischt die Grenze zwischen ehrlicher und täuschender Kommunikation. Diese Verwirrung kann das Vertrauen untergraben und Zweifel in öffentlichen Diskussionen säen, da die Menschen das Vertrauen in ihre Fähigkeit verlieren, Echtes von Gefälschtem zu unterscheiden.

Das Teilen dieser Bilder könnte auch als strategischer Schachzug gesehen werden, um bestimmte Wählergruppen, wie Taylor Swift-Fans, zu gewinnen, unabhängig davon, ob sie ihn tatsächlich unterstützen. Durch die Illusion weitverbreiteter Unterstützung, selbst wenn sie künstlich erzeugt ist, könnten politische Kampagnen unentschlossene Wähler beeinflussen oder ihre Basis mobilisieren. Dies zeigt, wie KI ein mächtiges Werkzeug zur Überzeugung sein kann, das die öffentliche Meinung formen und Wahlergebnisse beeinflussen kann.

Wenn große politische Figuren KI-generierte Inhalte nutzen, ist das ein Weckruf für die Öffentlichkeit, wachsam und medienkompetent zu sein. Da die KI-Technologie weiter voranschreitet, ist es entscheidend, dass Menschen kritisch über die Inhalte nachdenken, die sie online sehen, und vertrauenswürdige Quellen suchen. Medien, Schulen und Regierungsbehörden haben alle eine Rolle dabei, kritisches Denken zu fördern und das Bewusstsein für die Gefahren manipulierter Medien zu schärfen.

Verwirrung und Desinformation

Das Teilen von KI-generierten Bildern und anderen manipulierten Inhalten online befeuert ein wachsendes Problem von Verwirrung und Desinformation.

Wenn Menschen mit einer Mischung aus echten und gefälschten Informationen konfrontiert werden, ist es schwer herauszufinden, was wahr ist. Dieses Durcheinander kann das Vertrauen in Medien, Institutionen und sogar persönliche Beziehungen untergraben und es schwierig machen, Konsens über wichtige Themen zu finden.

Eine der größten Hürden im Kampf gegen Desinformation ist, wie schnell sie sich in sozialen Medien verbreitet. Falsche oder irreführende Inhalte können im Handumdrehen viral gehen und Millionen erreichen, bevor Faktenchecker reagieren können. Diese schnelle Verbreitung macht es schwer, den Schaden durch Desinformation zu stoppen, da sie sich in den Köpfen der Menschen festsetzen und ihre Meinungen beeinflussen kann.

Eine weitere Herausforderung ist die Raffinesse moderner Manipulationstechniken. KI-generierte Inhalte, Deepfakes und andere synthetische Medien werden so gut, dass selbst Experten Schwierigkeiten haben, sie zu erkennen. Das bedeutet, dass traditionelle Faktenchecks und Medienanalysen nicht mehr ausreichen, was uns dazu zwingt, neue Tools und Methoden zu entwickeln, um dagegen anzukämpfen.

Verschärft wird das Problem durch Echokammern und Filterblasen online. Algorithmen sozialer Medien zeigen uns oft Inhalte, die unseren bestehenden Ansichten entsprechen, und schaffen so Echokammern, in denen wir hauptsächlich ähnlichen Perspektiven ausgesetzt sind. Dies kann unsere Vorurteile verstärken und es schwieriger machen, sich mit unterschiedlichen Standpunkten auseinanderzusetzen, was zu mehr Polarisation und Spaltung führt.

Um Verwirrung und Desinformation zu bekämpfen, brauchen wir einen vielschichtigen Ansatz, der technologische Lösungen, Medienkompetenzbildung und politische Änderungen umfasst. Soziale Medienplattformen sollten in KI-gestützte Tools investieren, um manipulierte Inhalte zu erkennen und zu kennzeichnen. Schulen sollten Medienkompetenz unterrichten und Schülern beibringen, wie sie Quellen kritisch bewerten und Manipulationstechniken erkennen können. Politiker sollten Regelungen in Betracht ziehen, die Menschen für die Verbreitung von Desinformation zur Rechenschaft ziehen, während sie die Meinungsfreiheit schützen. Nur durch Zusammenarbeit können wir hoffen, die Verbreitung von Desinformation einzudämmen und eine informiertere und engagiertere Öffentlichkeit zu fördern.

Untersuchung von echten versus KI-generierten Bildern

Die Herausforderung, Authentizität zu unterscheiden

Das Unterscheiden von echten Bildern von KI-generierten wird täglich schwieriger, dank der Raffinesse künstlicher Intelligenz. KI kann inzwischen Bilder erstellen, die so echt aussehen, dass es für den Durchschnittsmenschen schwer ist, sie von echten Fotos zu unterscheiden. Diese Fähigkeit hat große Auswirkungen darauf, wie sehr wir dem vertrauen können, was wir sehen, besonders in sensiblen Bereichen wie Nachrichten und politischer Kommunikation.

Ein Grund, warum es so schwer ist, den Unterschied zu erkennen, ist, wie schnell sich KI-Algorithmen verbessern. Diese Algorithmen werden immer besser darin, Texturen, Beleuchtung und Details realer Szenen nachzuahmen, und erzeugen Bilder, die fast unmöglich vom Original zu unterscheiden sind. Zudem kann KI Bilder von Personen, Objekten und Ereignissen erstellen, die nie existiert haben, und so überzeugende, aber völlig erfundene Realitäten schaffen.

Ein weiterer Faktor ist, dass viele Menschen wenig über KI-Manipulationstechniken wissen. Ohne grundlegendes Verständnis dessen, was KI leisten kann, ist es einfacher, getäuscht zu werden. Wer nicht weiß, wie KI funktioniert, hat es schwer, die Bilder, die er online sieht, kritisch zu bewerten.

Das Fehlen klarer Kennzeichnungen und Transparenz macht die Sache noch komplizierter. Soziale Medien und Medienhäuser kennzeichnen KI-generierte Bilder oft nicht, was es den Betrachtern überlässt, herauszufinden, was echt ist. Dieser Mangel an Offenheit erleichtert die Verbreitung täuschender Inhalte, da Menschen annehmen könnten, dass unmarkierte Bilder echt sind.

Um diese Herausforderungen zu bewältigen, brauchen wir einen vielschichtigen Ansatz, der technologische Lösungen, Medienkompetenzbildung und politische Änderungen umfasst. Technologische Lösungen wie KI-gestützte Erkennungstools können helfen, manipulierte Bilder zu identifizieren und zu kennzeichnen. Medienkompetenzbildung kann Menschen beibringen, wie sie Quellen kritisch bewerten und Manipulationstechniken erkennen. Politische Änderungen können mehr Transparenz und Verantwortlichkeit bei der Nutzung von KI-generierten Inhalten fördern.

Durch die Kombination dieser Bemühungen können wir uns besser vor dem täuschenden Einsatz von KI in visuellen Medien schützen und mehr Vertrauen in die Bilder aufbauen, die unsere öffentlichen Diskussionen prägen. Die Entwicklung und weitreichende Einführung dieser Tools ist entscheidend, um die Ehrlichkeit visueller Medien zu bewahren und sicherzustellen, dass Menschen fundierte Entscheidungen auf Basis verlässlicher Informationen treffen können.

Strategien zur Erkennung von KI-generierten Inhalten

Schritt-für-Schritt-Anleitung zur visuellen Verifikation

Da KI-generierte Inhalte immer raffinierter werden, ist es wichtig, wachsam zu sein und spezifische Methoden anzuwenden, um die Authentizität dessen zu überprüfen, was wir sehen. Hier ist eine Schritt-für-Schritt-Anleitung, die Ihnen hilft:

- Bilddetails untersuchen: Schauen Sie sich das Bild genau an, um nach Unstimmigkeiten zu suchen. KI-generierte Bilder weisen oft subtile Fehler oder Inkonsistenzen auf. Achten Sie auf:

- Unnatürliche Texturen: Texturen, die zu glatt wirken oder die erwarteten Details fehlen.

- Beleuchtungsanomalien: Beleuchtung, die nicht zur Szene passt oder inkonsistente Schatten aufweist.

- Hintergrundverzerrungen: Hintergrundelemente, die verschwommen wirken oder keinen Sinn ergeben.

- Rückwärtssuche von Bildern: Verwenden Sie Suchmaschinen wie Google Images, TinEye oder Yandex Images, um eine Rückwärtssuche durchzuführen. Dies kann helfen, festzustellen, ob das Bild anderswo verwendet wurde oder bekannten KI-generierten Mustern entspricht.

- Quelle überprüfen: Stellen Sie sicher, dass die Quelle, die das Bild veröffentlicht hat, glaubwürdig ist. Suchen Sie nach seriösen Nachrichtenagenturen, offiziellen Webseiten oder vertrauenswürdigen Organisationen. Seien Sie vorsichtig bei anonymen Quellen oder Seiten, die für die Verbreitung von Desinformation bekannt sind.

- Informationen abgleichen: Vergleichen Sie das Bild und begleitende Informationen mit anderen Quellen, um deren Richtigkeit zu bestätigen. Überprüfen Sie mehrere Nachrichtenagenturen, Faktencheck-Webseiten und Experten, um sicherzustellen, dass alles übereinstimmt.

- KI-Erkennungstools nutzen: Verwenden Sie KI-Erkennungstools, die Bilder analysieren und Hinweise darauf geben können, ob ein Bild möglicherweise manipuliert wurde. Diese Tools werden immer besser darin, Einsichten zu liefern, ob ein Bild manipuliert sein könnte.

- Experten konsultieren: Wenn Sie sich immer noch unsicher sind, sprechen Sie mit Experten für digitale Forensik oder Medienanalyse. Sie verfügen über das spezialisierte Wissen und die Tools, um subtile Anzeichen von Manipulation zu erkennen.

Durch das Befolgen dieser Schritte können Sie besser darin werden, KI-generierte Inhalte zu erkennen und sich vor Desinformation zu schützen. Informiert und etwas skeptisch zu bleiben ist der Schlüssel in der heutigen digitalen Welt, in der täuschende Bilder sich schnell verbreiten und die öffentliche Meinung beeinflussen können. Eine skeptische und informierte Öffentlichkeit ist entscheidend, um Vertrauen und Glaubwürdigkeit im Zeitalter der KI zu bewahren.

Bewertung von KI-generierten Bildern: Vor- und Nachteile

Vorteile

- Erhöhte Kreativität: KI kann Kreativität anregen, indem sie neue Bildkombinationen und Stile erzeugt.

- Effizienz bei der Inhaltserstellung: KI macht die Inhaltserstellung schneller und effizienter, was Zeit und Ressourcen spart.

- Zugänglichkeit: KI macht die Bilderzeugung für jeden zugänglich, nicht nur für Profis.

- Anpassungsfähigkeit: KI ermöglicht hochgradig angepasste Bilderzeugung, um spezifische Bedürfnisse zu erfüllen.

Nachteile

- Risiko von Desinformation: KI erleichtert die Erstellung und Verbreitung irreführender Bilder.

- Bedenken zur Authentizität: KI verwischt die Grenze zwischen echt und gefälscht, was es schwerer macht, dem Gesehenen zu vertrauen.

- Ethische Fragen: KI wirft ethische Fragen zu Manipulation, Transparenz und Verantwortlichkeit auf.

- Arbeitsplatzverlust: KI könnte Arbeitsplätze von menschlichen Künstlern und Inhaltserstellern verdrängen, da die Automatisierung zunimmt.

Häufig gestellte Fragen

Wie kann ich KI-generierte Bilder effektiv identifizieren?

Um KI-generierte Bilder zu erkennen, müssen Sie die Details genau betrachten und die verfügbaren Tools nutzen. Achten Sie auf Unstimmigkeiten in Beleuchtung, Texturen und Hintergrundelementen. Verwenden Sie Rückwärtssuchen, um zu sehen, ob das Bild anderswo verwendet wurde. KI-Erkennungstools können Einblicke geben, ob ein Bild manipuliert sein könnte. Das Abgleichen von Informationen mit mehreren Quellen und die Konsultation von Experten können die Authentizität des Bildes weiter bestätigen.

Welche potenziellen Lösungen gibt es, um die Verbreitung von KI-generierter Desinformation zu bekämpfen?

Die Bekämpfung von KI-generierter Desinformation erfordert einen vielschichtigen Ansatz. Wir brauchen technologische Lösungen, Medienkompetenzbildung und politische Änderungen. Soziale Medienplattformen sollten in KI-Erkennungstools investieren, während Schulen Medienkompetenz unterrichten sollten. Politiker sollten Regelungen in Betracht ziehen, die Transparenz und Verantwortlichkeit bei der Nutzung von KI-generierten Inhalten fördern.

Wie wirken sich KI-generierte Bilder auf die Integrität von Wahlen aus?

KI-generierte Bilder können die Integrität von Wahlen untergraben, indem sie Desinformation verbreiten und die öffentliche Meinung manipulieren. Gefälschte Unterstützungsbekundungen, negative Darstellungen von Kandidaten und andere täuschende Inhalte können die Wählerstimmung beeinflussen und Wahlergebnisse verändern. Das Mischen von echten und gefälschten Inhalten untergräbt das Vertrauen und führt zu Unsicherheit in öffentlichen Diskussionen.

Warum ist die Kennzeichnung von KI-generierten Inhalten wichtig?

Die Kennzeichnung von KI-generierten Inhalten ist entscheidend für Transparenz und Verantwortlichkeit. Ohne klare Kennzeichnungen könnten Menschen unwissentlich manipulierte Medien konsumieren, was zu Fehlinformationen führt. Die Kennzeichnung hilft Betrachtern, Inhalte kritisch zu bewerten und fundierte Urteile über deren Richtigkeit und Gültigkeit zu fällen.

Verwandte Fragen

Welche Rolle spielen soziale Medienplattformen bei der Bekämpfung von KI-generierter Desinformation?

Soziale Medienplattformen spielen eine große Rolle bei der Bekämpfung von KI-generierter Desinformation. Sie müssen in KI-Erkennungstools investieren, klare Kennzeichnungsrichtlinien einführen und Medienkompetenz bei ihren Nutzern fördern. Durch proaktive Maßnahmen zur Bekämpfung täuschender Inhalte können soziale Medienplattformen dazu beitragen, die Integrität von Wahlen zu schützen und das öffentliche Vertrauen zu erhalten.

Wie können Bildungseinrichtungen Medienkompetenz und kritisches Denken fördern?

Bildungseinrichtungen können Medienkompetenz und kritisches Denken fördern, indem sie diese in ihre Lehrpläne integrieren. Schüler sollten lernen, wie sie Informationsquellen bewerten, Manipulationstechniken erkennen und Informationen mit mehreren Quellen abgleichen. Durch die Förderung kritischen Denkens können Schulen Schüler befähigen, informierte und engagierte Bürger zu werden, die weniger anfällig für Desinformation sind.

Welche Regelungen oder Richtlinien könnten helfen, KI-generierte Desinformation zu bekämpfen, ohne die Meinungsfreiheit zu verletzen?

Die Bekämpfung von KI-generierter Desinformation bei gleichzeitiger Wahrung der Meinungsfreiheit erfordert sorgfältige politische Maßnahmen. Transparenzanforderungen, wie die verpflichtende Kennzeichnung von KI-generierten Inhalten, können die Öffentlichkeit informieren, ohne die Meinungsfreiheit einzuschränken. Verantwortlichkeitsmaßnahmen, wie die Verantwortung für die Verbreitung bekannter Desinformation, können schlechte Akteure abschrecken. Das Finden des richtigen Gleichgewichts zwischen Regulierung und Meinungsfreiheit ist entscheidend, um einen gesunden und demokratischen öffentlichen Diskurs zu erhalten.

Verwandter Artikel

DeepL, bekannt für seine Textübersetzungen, widmet sich nun der Sprachübersetzung

DeepL, ein Übersetzungsunternehmen, das vor allem für seine textbasierten Tools bekannt ist, hat heute eine Suite für Sprach-zu-Sprach-Übersetzungen auf den Markt gebracht, die über maßgeschneiderte A

DeepL, bekannt für seine Textübersetzungen, widmet sich nun der Sprachübersetzung

DeepL, ein Übersetzungsunternehmen, das vor allem für seine textbasierten Tools bekannt ist, hat heute eine Suite für Sprach-zu-Sprach-Übersetzungen auf den Markt gebracht, die über maßgeschneiderte A

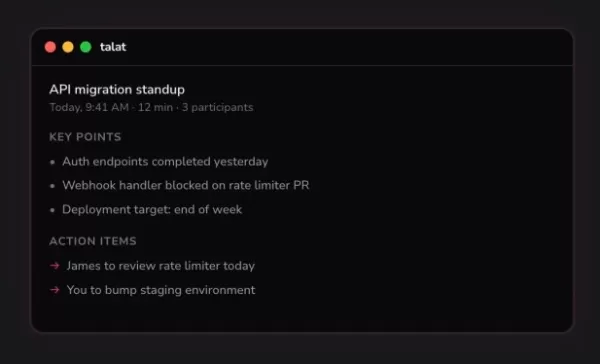

Talats KI-Besprechungsnotizen werden auf Ihrem Gerät gespeichert, nicht in der Cloud

Granola, die KI-gestützte Notiz-App mit einem Unternehmenswert von 250 Millionen Dollar, hat bei Tech-Gründern und Risikokapitalgebern an Beliebtheit gewonnen. Ein Entwickler sieht jedoch Bedarf an ei

Talats KI-Besprechungsnotizen werden auf Ihrem Gerät gespeichert, nicht in der Cloud

Granola, die KI-gestützte Notiz-App mit einem Unternehmenswert von 250 Millionen Dollar, hat bei Tech-Gründern und Risikokapitalgebern an Beliebtheit gewonnen. Ein Entwickler sieht jedoch Bedarf an ei

Der neue Roewe i6 kommt für 659.000 Yuan auf den Markt – mit Snapdragon 8155 und dem „Doubao“-Großmodell

SAIC Roewe hat heute den neuen Roewe i6 vorgestellt, eine Kompaktlimousine, die die Designsprache des Roewe D7 vollständig aufgreift. Der markante, große, senkrechte Kühlergrill und die horizontale Li

Empfehlungen zu verwandten Spezialthemen

Kommentare (2)

Der neue Roewe i6 kommt für 659.000 Yuan auf den Markt – mit Snapdragon 8155 und dem „Doubao“-Großmodell

SAIC Roewe hat heute den neuen Roewe i6 vorgestellt, eine Kompaktlimousine, die die Designsprache des Roewe D7 vollständig aufgreift. Der markante, große, senkrechte Kühlergrill und die horizontale Li

Empfehlungen zu verwandten Spezialthemen

Kommentare (2)

Das Aufkommen künstlicher Intelligenz hat eine Welle technologischer Fortschritte eingeleitet, aber es hat auch unsere Fähigkeit, Fakten von Fiktion zu unterscheiden, erheblich beeinträchtigt. In letzter Zeit haben auf sozialen Medien kursierende KI-generierte Bilder Besorgnis erregt, da sie das Potenzial haben, politische Gespräche zu verzerren und die Integrität von Wahlen zu gefährden. Es ist entscheidend, dass wir das volle Ausmaß dieser Technologien verstehen, um unsere öffentlichen Diskussionen informiert zu halten und das Vertrauen in das, was wir sehen, aufrechtzuerhalten.

Die Kontroverse um KI-generierte politische Bilder

Der Aufstieg von KI-generierten Inhalten

Künstliche Intelligenz hat einen Punkt erreicht, an dem sie Bilder, Videos und Audios erstellen kann, die unglaublich echt wirken. Das ist zweifellos eine beeindruckende Leistung, aber auch ein wenig beängstigend, besonders wenn es um Politik und Wahlen geht. Die Fähigkeit, überzeugende, aber völlig erfundene Inhalte zu erstellen, kann die Öffentlichkeit verwirren und unser Vertrauen in die Nachrichten, die wir konsumieren, erschüttern. Die Fähigkeit sozialer Medien, solche Inhalte wie ein Lauffeuer zu verbreiten, verschlimmert die Sache nur und macht es zu einer echten Herausforderung, die Narrative klar zu halten und Desinformation zu stoppen.

Da KI-Tools immer benutzerfreundlicher werden, ist es einfacher denn je für jeden mit bösen Absichten, die öffentliche Meinung zu manipulieren. Diese KI-Kreationen, oft als synthetische Medien oder Deepfakes bezeichnet, fordern unsere Fähigkeit heraus, kritisch zu denken und medienkompetent zu bleiben. Das Potenzial, die öffentliche Wahrnehmung zu verdrehen und das Vertrauen in unsere Institutionen zu untergraben, ist ein großes Problem, das uns dazu drängt, proaktive Maßnahmen zu ergreifen und ethische Grenzen zu setzen, um die Risiken im Zaum zu halten.

Politische Kampagnen können diese Technologie nutzen, um gefälschte Unterstützungsbekundungen oder Diffamierungen von Gegnern zu erstellen und so die Wähler zu beeinflussen. Ohne klare Hinweise oder Tools, um diese Fälschungen zu erkennen, könnten normale Menschen Schwierigkeiten haben, zwischen echt und gefälscht zu unterscheiden, was zu Entscheidungen auf Basis falscher Informationen führt. Diese Art von weitverbreiteter Täuschung könnte die Grundlagen der Demokratie erschüttern, was es dringend macht, sowohl technologische als auch politische Lösungen zu finden, um dies zu bekämpfen.

Wie können wir uns also davor schützen, dass KI in politischen Kampagnen missbraucht wird und sicherstellen, dass Wähler die Wahrheit erfahren? Es wird eine Kombination aus technologischen Fortschritten, Medienkompetenzbildung und soliden politischen Rahmenbedingungen erfordern. Die Nutzung von KI-generierten Inhalten wirft große Fragen zu Ehrlichkeit, Offenheit und Verantwortung auf und unterstreicht die Notwendigkeit, dass alle Verantwortung übernehmen und demokratische Werte im KI-Zeitalter verteidigen.

Trumps Nutzung von KI-generierten Bildern

Der ehemalige Präsident Trump sorgte für Aufsehen, als er auf sozialen Medien KI-generierte Bilder veröffentlichte, was eine hitzige Debatte über die Ethik und die Auswirkungen solcher Inhalte in der Politik auslöste.

Indem er Bilder teilte, die den Eindruck erweckten, dass Taylor Swift und ihre Fans ihn unterstützen, sorgte Trump für Verwirrung über die Manipulation seiner öffentlichen Wahrnehmung. Einige dieser Bilder waren echt, andere jedoch KI-generiert, was zu Verwirrung führte und Fragen zur Transparenz politischer Botschaften aufwarf.

Die Bilder zeigten Frauen in „Swifties for Trump“-Shirts, was Unterstützung von einer Gruppe suggerierte, die möglicherweise gar nicht mit seiner Politik übereinstimmt. Dieser Schritt wirft ethische Fragen auf, ob es richtig ist, KI zu nutzen, um gefälschte Unterstützungsbekundungen oder manipulierte öffentliche Stimmungen zu erzeugen. Das Fehlen klarer Kennzeichnungen einiger Bilder als KI-generiert verwirrt nur noch mehr und könnte Menschen täuschen, die nicht wissen, dass sie etwas Künstliches betrachten.

Während einige Bilder tatsächlich KI-generiert waren, waren andere echte Fotos von Trump-Anhängern. Diese Mischung aus echt und gefälscht kann es für Betrachter schwierig machen, herauszufinden, was wahr ist, und verwischt die Grenze zwischen ehrlicher und täuschender Kommunikation. Diese Verwirrung kann das Vertrauen untergraben und Zweifel in öffentlichen Diskussionen säen, da die Menschen das Vertrauen in ihre Fähigkeit verlieren, Echtes von Gefälschtem zu unterscheiden.

Das Teilen dieser Bilder könnte auch als strategischer Schachzug gesehen werden, um bestimmte Wählergruppen, wie Taylor Swift-Fans, zu gewinnen, unabhängig davon, ob sie ihn tatsächlich unterstützen. Durch die Illusion weitverbreiteter Unterstützung, selbst wenn sie künstlich erzeugt ist, könnten politische Kampagnen unentschlossene Wähler beeinflussen oder ihre Basis mobilisieren. Dies zeigt, wie KI ein mächtiges Werkzeug zur Überzeugung sein kann, das die öffentliche Meinung formen und Wahlergebnisse beeinflussen kann.

Wenn große politische Figuren KI-generierte Inhalte nutzen, ist das ein Weckruf für die Öffentlichkeit, wachsam und medienkompetent zu sein. Da die KI-Technologie weiter voranschreitet, ist es entscheidend, dass Menschen kritisch über die Inhalte nachdenken, die sie online sehen, und vertrauenswürdige Quellen suchen. Medien, Schulen und Regierungsbehörden haben alle eine Rolle dabei, kritisches Denken zu fördern und das Bewusstsein für die Gefahren manipulierter Medien zu schärfen.

Verwirrung und Desinformation

Das Teilen von KI-generierten Bildern und anderen manipulierten Inhalten online befeuert ein wachsendes Problem von Verwirrung und Desinformation.

Wenn Menschen mit einer Mischung aus echten und gefälschten Informationen konfrontiert werden, ist es schwer herauszufinden, was wahr ist. Dieses Durcheinander kann das Vertrauen in Medien, Institutionen und sogar persönliche Beziehungen untergraben und es schwierig machen, Konsens über wichtige Themen zu finden.

Eine der größten Hürden im Kampf gegen Desinformation ist, wie schnell sie sich in sozialen Medien verbreitet. Falsche oder irreführende Inhalte können im Handumdrehen viral gehen und Millionen erreichen, bevor Faktenchecker reagieren können. Diese schnelle Verbreitung macht es schwer, den Schaden durch Desinformation zu stoppen, da sie sich in den Köpfen der Menschen festsetzen und ihre Meinungen beeinflussen kann.

Eine weitere Herausforderung ist die Raffinesse moderner Manipulationstechniken. KI-generierte Inhalte, Deepfakes und andere synthetische Medien werden so gut, dass selbst Experten Schwierigkeiten haben, sie zu erkennen. Das bedeutet, dass traditionelle Faktenchecks und Medienanalysen nicht mehr ausreichen, was uns dazu zwingt, neue Tools und Methoden zu entwickeln, um dagegen anzukämpfen.

Verschärft wird das Problem durch Echokammern und Filterblasen online. Algorithmen sozialer Medien zeigen uns oft Inhalte, die unseren bestehenden Ansichten entsprechen, und schaffen so Echokammern, in denen wir hauptsächlich ähnlichen Perspektiven ausgesetzt sind. Dies kann unsere Vorurteile verstärken und es schwieriger machen, sich mit unterschiedlichen Standpunkten auseinanderzusetzen, was zu mehr Polarisation und Spaltung führt.

Um Verwirrung und Desinformation zu bekämpfen, brauchen wir einen vielschichtigen Ansatz, der technologische Lösungen, Medienkompetenzbildung und politische Änderungen umfasst. Soziale Medienplattformen sollten in KI-gestützte Tools investieren, um manipulierte Inhalte zu erkennen und zu kennzeichnen. Schulen sollten Medienkompetenz unterrichten und Schülern beibringen, wie sie Quellen kritisch bewerten und Manipulationstechniken erkennen können. Politiker sollten Regelungen in Betracht ziehen, die Menschen für die Verbreitung von Desinformation zur Rechenschaft ziehen, während sie die Meinungsfreiheit schützen. Nur durch Zusammenarbeit können wir hoffen, die Verbreitung von Desinformation einzudämmen und eine informiertere und engagiertere Öffentlichkeit zu fördern.

Untersuchung von echten versus KI-generierten Bildern

Die Herausforderung, Authentizität zu unterscheiden

Das Unterscheiden von echten Bildern von KI-generierten wird täglich schwieriger, dank der Raffinesse künstlicher Intelligenz. KI kann inzwischen Bilder erstellen, die so echt aussehen, dass es für den Durchschnittsmenschen schwer ist, sie von echten Fotos zu unterscheiden. Diese Fähigkeit hat große Auswirkungen darauf, wie sehr wir dem vertrauen können, was wir sehen, besonders in sensiblen Bereichen wie Nachrichten und politischer Kommunikation.

Ein Grund, warum es so schwer ist, den Unterschied zu erkennen, ist, wie schnell sich KI-Algorithmen verbessern. Diese Algorithmen werden immer besser darin, Texturen, Beleuchtung und Details realer Szenen nachzuahmen, und erzeugen Bilder, die fast unmöglich vom Original zu unterscheiden sind. Zudem kann KI Bilder von Personen, Objekten und Ereignissen erstellen, die nie existiert haben, und so überzeugende, aber völlig erfundene Realitäten schaffen.

Ein weiterer Faktor ist, dass viele Menschen wenig über KI-Manipulationstechniken wissen. Ohne grundlegendes Verständnis dessen, was KI leisten kann, ist es einfacher, getäuscht zu werden. Wer nicht weiß, wie KI funktioniert, hat es schwer, die Bilder, die er online sieht, kritisch zu bewerten.

Das Fehlen klarer Kennzeichnungen und Transparenz macht die Sache noch komplizierter. Soziale Medien und Medienhäuser kennzeichnen KI-generierte Bilder oft nicht, was es den Betrachtern überlässt, herauszufinden, was echt ist. Dieser Mangel an Offenheit erleichtert die Verbreitung täuschender Inhalte, da Menschen annehmen könnten, dass unmarkierte Bilder echt sind.

Um diese Herausforderungen zu bewältigen, brauchen wir einen vielschichtigen Ansatz, der technologische Lösungen, Medienkompetenzbildung und politische Änderungen umfasst. Technologische Lösungen wie KI-gestützte Erkennungstools können helfen, manipulierte Bilder zu identifizieren und zu kennzeichnen. Medienkompetenzbildung kann Menschen beibringen, wie sie Quellen kritisch bewerten und Manipulationstechniken erkennen. Politische Änderungen können mehr Transparenz und Verantwortlichkeit bei der Nutzung von KI-generierten Inhalten fördern.

Durch die Kombination dieser Bemühungen können wir uns besser vor dem täuschenden Einsatz von KI in visuellen Medien schützen und mehr Vertrauen in die Bilder aufbauen, die unsere öffentlichen Diskussionen prägen. Die Entwicklung und weitreichende Einführung dieser Tools ist entscheidend, um die Ehrlichkeit visueller Medien zu bewahren und sicherzustellen, dass Menschen fundierte Entscheidungen auf Basis verlässlicher Informationen treffen können.

Strategien zur Erkennung von KI-generierten Inhalten

Schritt-für-Schritt-Anleitung zur visuellen Verifikation

Da KI-generierte Inhalte immer raffinierter werden, ist es wichtig, wachsam zu sein und spezifische Methoden anzuwenden, um die Authentizität dessen zu überprüfen, was wir sehen. Hier ist eine Schritt-für-Schritt-Anleitung, die Ihnen hilft:

- Bilddetails untersuchen: Schauen Sie sich das Bild genau an, um nach Unstimmigkeiten zu suchen. KI-generierte Bilder weisen oft subtile Fehler oder Inkonsistenzen auf. Achten Sie auf:

- Unnatürliche Texturen: Texturen, die zu glatt wirken oder die erwarteten Details fehlen.

- Beleuchtungsanomalien: Beleuchtung, die nicht zur Szene passt oder inkonsistente Schatten aufweist.

- Hintergrundverzerrungen: Hintergrundelemente, die verschwommen wirken oder keinen Sinn ergeben.

- Rückwärtssuche von Bildern: Verwenden Sie Suchmaschinen wie Google Images, TinEye oder Yandex Images, um eine Rückwärtssuche durchzuführen. Dies kann helfen, festzustellen, ob das Bild anderswo verwendet wurde oder bekannten KI-generierten Mustern entspricht.

- Quelle überprüfen: Stellen Sie sicher, dass die Quelle, die das Bild veröffentlicht hat, glaubwürdig ist. Suchen Sie nach seriösen Nachrichtenagenturen, offiziellen Webseiten oder vertrauenswürdigen Organisationen. Seien Sie vorsichtig bei anonymen Quellen oder Seiten, die für die Verbreitung von Desinformation bekannt sind.

- Informationen abgleichen: Vergleichen Sie das Bild und begleitende Informationen mit anderen Quellen, um deren Richtigkeit zu bestätigen. Überprüfen Sie mehrere Nachrichtenagenturen, Faktencheck-Webseiten und Experten, um sicherzustellen, dass alles übereinstimmt.

- KI-Erkennungstools nutzen: Verwenden Sie KI-Erkennungstools, die Bilder analysieren und Hinweise darauf geben können, ob ein Bild möglicherweise manipuliert wurde. Diese Tools werden immer besser darin, Einsichten zu liefern, ob ein Bild manipuliert sein könnte.

- Experten konsultieren: Wenn Sie sich immer noch unsicher sind, sprechen Sie mit Experten für digitale Forensik oder Medienanalyse. Sie verfügen über das spezialisierte Wissen und die Tools, um subtile Anzeichen von Manipulation zu erkennen.

Durch das Befolgen dieser Schritte können Sie besser darin werden, KI-generierte Inhalte zu erkennen und sich vor Desinformation zu schützen. Informiert und etwas skeptisch zu bleiben ist der Schlüssel in der heutigen digitalen Welt, in der täuschende Bilder sich schnell verbreiten und die öffentliche Meinung beeinflussen können. Eine skeptische und informierte Öffentlichkeit ist entscheidend, um Vertrauen und Glaubwürdigkeit im Zeitalter der KI zu bewahren.

Bewertung von KI-generierten Bildern: Vor- und Nachteile

Vorteile

- Erhöhte Kreativität: KI kann Kreativität anregen, indem sie neue Bildkombinationen und Stile erzeugt.

- Effizienz bei der Inhaltserstellung: KI macht die Inhaltserstellung schneller und effizienter, was Zeit und Ressourcen spart.

- Zugänglichkeit: KI macht die Bilderzeugung für jeden zugänglich, nicht nur für Profis.

- Anpassungsfähigkeit: KI ermöglicht hochgradig angepasste Bilderzeugung, um spezifische Bedürfnisse zu erfüllen.

Nachteile

- Risiko von Desinformation: KI erleichtert die Erstellung und Verbreitung irreführender Bilder.

- Bedenken zur Authentizität: KI verwischt die Grenze zwischen echt und gefälscht, was es schwerer macht, dem Gesehenen zu vertrauen.

- Ethische Fragen: KI wirft ethische Fragen zu Manipulation, Transparenz und Verantwortlichkeit auf.

- Arbeitsplatzverlust: KI könnte Arbeitsplätze von menschlichen Künstlern und Inhaltserstellern verdrängen, da die Automatisierung zunimmt.

Häufig gestellte Fragen

Wie kann ich KI-generierte Bilder effektiv identifizieren?

Um KI-generierte Bilder zu erkennen, müssen Sie die Details genau betrachten und die verfügbaren Tools nutzen. Achten Sie auf Unstimmigkeiten in Beleuchtung, Texturen und Hintergrundelementen. Verwenden Sie Rückwärtssuchen, um zu sehen, ob das Bild anderswo verwendet wurde. KI-Erkennungstools können Einblicke geben, ob ein Bild manipuliert sein könnte. Das Abgleichen von Informationen mit mehreren Quellen und die Konsultation von Experten können die Authentizität des Bildes weiter bestätigen.

Welche potenziellen Lösungen gibt es, um die Verbreitung von KI-generierter Desinformation zu bekämpfen?

Die Bekämpfung von KI-generierter Desinformation erfordert einen vielschichtigen Ansatz. Wir brauchen technologische Lösungen, Medienkompetenzbildung und politische Änderungen. Soziale Medienplattformen sollten in KI-Erkennungstools investieren, während Schulen Medienkompetenz unterrichten sollten. Politiker sollten Regelungen in Betracht ziehen, die Transparenz und Verantwortlichkeit bei der Nutzung von KI-generierten Inhalten fördern.

Wie wirken sich KI-generierte Bilder auf die Integrität von Wahlen aus?

KI-generierte Bilder können die Integrität von Wahlen untergraben, indem sie Desinformation verbreiten und die öffentliche Meinung manipulieren. Gefälschte Unterstützungsbekundungen, negative Darstellungen von Kandidaten und andere täuschende Inhalte können die Wählerstimmung beeinflussen und Wahlergebnisse verändern. Das Mischen von echten und gefälschten Inhalten untergräbt das Vertrauen und führt zu Unsicherheit in öffentlichen Diskussionen.

Warum ist die Kennzeichnung von KI-generierten Inhalten wichtig?

Die Kennzeichnung von KI-generierten Inhalten ist entscheidend für Transparenz und Verantwortlichkeit. Ohne klare Kennzeichnungen könnten Menschen unwissentlich manipulierte Medien konsumieren, was zu Fehlinformationen führt. Die Kennzeichnung hilft Betrachtern, Inhalte kritisch zu bewerten und fundierte Urteile über deren Richtigkeit und Gültigkeit zu fällen.

Verwandte Fragen

Welche Rolle spielen soziale Medienplattformen bei der Bekämpfung von KI-generierter Desinformation?

Soziale Medienplattformen spielen eine große Rolle bei der Bekämpfung von KI-generierter Desinformation. Sie müssen in KI-Erkennungstools investieren, klare Kennzeichnungsrichtlinien einführen und Medienkompetenz bei ihren Nutzern fördern. Durch proaktive Maßnahmen zur Bekämpfung täuschender Inhalte können soziale Medienplattformen dazu beitragen, die Integrität von Wahlen zu schützen und das öffentliche Vertrauen zu erhalten.

Wie können Bildungseinrichtungen Medienkompetenz und kritisches Denken fördern?

Bildungseinrichtungen können Medienkompetenz und kritisches Denken fördern, indem sie diese in ihre Lehrpläne integrieren. Schüler sollten lernen, wie sie Informationsquellen bewerten, Manipulationstechniken erkennen und Informationen mit mehreren Quellen abgleichen. Durch die Förderung kritischen Denkens können Schulen Schüler befähigen, informierte und engagierte Bürger zu werden, die weniger anfällig für Desinformation sind.

Welche Regelungen oder Richtlinien könnten helfen, KI-generierte Desinformation zu bekämpfen, ohne die Meinungsfreiheit zu verletzen?

Die Bekämpfung von KI-generierter Desinformation bei gleichzeitiger Wahrung der Meinungsfreiheit erfordert sorgfältige politische Maßnahmen. Transparenzanforderungen, wie die verpflichtende Kennzeichnung von KI-generierten Inhalten, können die Öffentlichkeit informieren, ohne die Meinungsfreiheit einzuschränken. Verantwortlichkeitsmaßnahmen, wie die Verantwortung für die Verbreitung bekannter Desinformation, können schlechte Akteure abschrecken. Das Finden des richtigen Gleichgewichts zwischen Regulierung und Meinungsfreiheit ist entscheidend, um einen gesunden und demokratischen öffentlichen Diskurs zu erhalten.

DeepL, bekannt für seine Textübersetzungen, widmet sich nun der Sprachübersetzung

DeepL, ein Übersetzungsunternehmen, das vor allem für seine textbasierten Tools bekannt ist, hat heute eine Suite für Sprach-zu-Sprach-Übersetzungen auf den Markt gebracht, die über maßgeschneiderte A

DeepL, bekannt für seine Textübersetzungen, widmet sich nun der Sprachübersetzung

DeepL, ein Übersetzungsunternehmen, das vor allem für seine textbasierten Tools bekannt ist, hat heute eine Suite für Sprach-zu-Sprach-Übersetzungen auf den Markt gebracht, die über maßgeschneiderte A

Talats KI-Besprechungsnotizen werden auf Ihrem Gerät gespeichert, nicht in der Cloud

Granola, die KI-gestützte Notiz-App mit einem Unternehmenswert von 250 Millionen Dollar, hat bei Tech-Gründern und Risikokapitalgebern an Beliebtheit gewonnen. Ein Entwickler sieht jedoch Bedarf an ei

Talats KI-Besprechungsnotizen werden auf Ihrem Gerät gespeichert, nicht in der Cloud

Granola, die KI-gestützte Notiz-App mit einem Unternehmenswert von 250 Millionen Dollar, hat bei Tech-Gründern und Risikokapitalgebern an Beliebtheit gewonnen. Ein Entwickler sieht jedoch Bedarf an ei

Der neue Roewe i6 kommt für 659.000 Yuan auf den Markt – mit Snapdragon 8155 und dem „Doubao“-Großmodell

SAIC Roewe hat heute den neuen Roewe i6 vorgestellt, eine Kompaktlimousine, die die Designsprache des Roewe D7 vollständig aufgreift. Der markante, große, senkrechte Kühlergrill und die horizontale Li

Der neue Roewe i6 kommt für 659.000 Yuan auf den Markt – mit Snapdragon 8155 und dem „Doubao“-Großmodell

SAIC Roewe hat heute den neuen Roewe i6 vorgestellt, eine Kompaktlimousine, die die Designsprache des Roewe D7 vollständig aufgreift. Der markante, große, senkrechte Kühlergrill und die horizontale Li

Heim

Heim