Изображения, созданные ИИ, вызывают споры о честности выборов

Появление искусственного интеллекта вызвало волну технологических достижений, но также создало препятствия для нашей способности различать факты и вымысел. В последнее время изображения, созданные ИИ и распространяемые в социальных сетях, вызвали опасения относительно их потенциала искажать политические дискуссии и угрожать целостности выборов. Крайне важно, чтобы мы полностью осознавали масштаб этих технологий, чтобы поддерживать информированные общественные обсуждения и сохранять доверие к тому, что мы видим.

Споры вокруг изображений, созданных ИИ, в политике

Рост контента, созданного ИИ

Искусственный интеллект достиг уровня, на котором он может создавать изображения, видео и аудио, которые выглядят и звучат невероятно реалистично. Это, безусловно, впечатляющее достижение, но оно также немного пугает, особенно в контексте политики и выборов. Способность создавать убедительный, но полностью вымышленный контент может сбить общественность с толку и подорвать доверие к новостям, которые мы потребляем. Способность социальных сетей распространять этот контент подобно лесному пожару только усугубляет ситуацию, превращая это в настоящую проблему для поддержания правильного нарратива и предотвращения дезинформации.

По мере того как инструменты ИИ становятся более удобными для пользователей, любому человеку с недобрыми намерениями становится проще манипулировать общественным мнением. Эти творения ИИ, часто называемые синтетическими медиа или дипфейками, бросают вызов нашей способности критически мыслить и оставаться медиаграмотными. Потенциал искажения общественного восприятия и подрыва доверия к институтам — это серьезная проблема, которая побуждает нас принимать проактивные меры и устанавливать этические границы для сдерживания рисков.

Политические кампании могут использовать эту технологию для создания фальшивых поддержек или очернения оппонентов, влияя на то, как люди голосуют. Без четких признаков или инструментов для выявления этих подделок обычным людям может быть сложно отличить реальное от вымышленного, что приводит к решениям, основанным на ложной информации. Этот вид массового обмана может поколебать основы демократии, что делает срочной задачу поиска технологических и политических решений для его устранения.

Итак, как нам защититься от злоупотребления ИИ в политических кампаниях и убедиться, что избиратели получают достоверную информацию? Потребуется сочетание технологических достижений, обучения медиаграмотности и надежных политических рамок. Использование контента, созданного ИИ, поднимает важные вопросы о честности, открытости и ответственности, подчеркивая необходимость для всех нас активизироваться и защищать демократические ценности в эпоху ИИ.

Использование изображений, созданных ИИ, Трампом

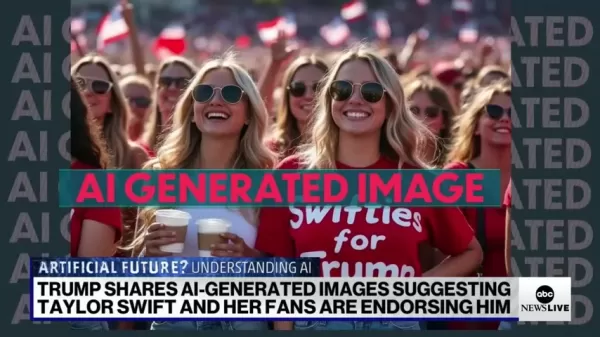

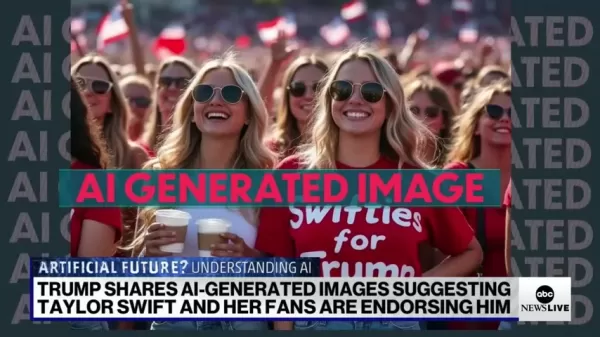

Бывший президент Трамп вызвал бурю обсуждений, разместив изображения, созданные ИИ, в социальных сетях, что спровоцировало жаркие дебаты об этике и последствиях использования такого контента в политике.

Размещая изображения, которые создавали впечатление, что Тейлор Свифт и ее фанаты поддерживают его, Трамп вызвал вопросы о манипуляции восприятием общественности. Некоторые из этих изображений были настоящими, а другие — созданными ИИ, что вызвало путаницу и вопросы о том, насколько открытым должно быть политическое послание.

Изображения показывали женщин в футболках с надписью «Swifties for Trump», что наводило на мысль о поддержке со стороны группы, которая, возможно, на самом деле не разделяет его политические взгляды. Этот шаг поднимает этические вопросы о том, правильно ли использовать ИИ для создания фальшивых поддержек или искажения общественного мнения. Отсутствие четкой маркировки некоторых изображений как созданных ИИ только усугубляет путаницу, потенциально обманывая тех, кто не знает, что смотрит на искусственный контент.

Хотя некоторые изображения действительно были созданы ИИ, другие были подлинными фотографиями сторонников Трампа. Смешение реального и фальшивого затрудняет для зрителей определение того, что является правдой, размывая границы между честным и обманчивым посланием. Эта путаница может подорвать доверие и посеять сомнения в общественных дискуссиях, поскольку люди теряют уверенность в своей способности отличать реальное от поддельного.

Распространение этих изображений также можно рассматривать как стратегический шаг для привлечения определенных групп избирателей, таких как фанаты Тейлор Свифт, независимо от того, поддерживают они его или нет. Создавая иллюзию широкой поддержки, даже если она создана искусственно, политические кампании могут повлиять на неопределившихся избирателей или воодушевить свою базу. Это показывает, как ИИ может быть мощным инструментом убеждения, способным формировать общественное мнение и влиять на результаты выборов.

Когда крупные политические фигуры используют контент, созданный ИИ, это служит сигналом для общественности быть более бдительными и медиаграмотными. По мере развития технологий ИИ людям крайне важно критически относиться к контенту, который они видят в Интернете, и искать надежные источники. СМИ, школы и государственные учреждения должны сыграть свою роль в повышении критического мышления и осведомленности об опасностях манипулируемых медиа.

Путаница и дезинформация

Распространение изображений, созданных ИИ, и другого манипулированного контента в Интернете подпитывает нарастающую проблему путаницы и дезинформации.

Когда люди сталкиваются со смесью реальной и фальшивой информации, им сложно определить, что является правдой. Эта неразбериха может подорвать доверие к СМИ, институтам и даже личным отношениям, затрудняя достижение консенсуса по важным вопросам.

Одной из самых больших проблем в борьбе с дезинформацией является то, как быстро она распространяется в социальных сетях. Ложный или вводящий в заблуждение контент может стать вирусным в одно мгновение, достигая миллионов, прежде чем проверяющие факты успеют среагировать. Это быстрое распространение затрудняет устранение ущерба, вызванного дезинформацией, поскольку она может укорениться в сознании людей и повлиять на их мнения.

Еще одна проблема — это то, насколько изощренными стали современные методы манипуляции. Контент, созданный ИИ, дипфейки и другие синтетические медиа становятся настолько качественными, что даже эксперты с трудом их распознают. Это означает, что традиционные методы проверки фактов и анализа СМИ уже недостаточны, что побуждает нас разрабатывать новые инструменты и методы для противодействия.

Усугубляют ситуацию эхо-камеры и фильтрующие пузыри в Интернете. Алгоритмы социальных сетей часто показывают нам контент, соответствующий нашим существующим взглядам, создавая эхо-камеры, где мы в основном сталкиваемся с похожими точками зрения. Это может укреплять наши предубеждения и затруднять взаимодействие с другими взглядами, что приводит к большей поляризации и разделению.

Для борьбы с путаницей и дезинформацией необходим многосторонний подход, включающий технологические решения, обучение медиаграмотности и изменения в политике. Социальные сети должны инвестировать в инструменты на базе ИИ для обнаружения и маркировки манипулированного контента. Школы должны обучать медиаграмотности, показывая ученикам, как критически оценивать источники и выявлять методы манипуляции. Политики должны рассмотреть регулирование, которое делает людей ответственными за распространение дезинформации, при этом защищая свободу слова. Только совместными усилиями мы можем надеяться ограничить распространение дезинформации и способствовать формированию более информированной и вовлеченной общественности.

Анализ реальных и созданных ИИ изображений

Сложность определения подлинности

Отличить реальные изображения от созданных ИИ становится все сложнее с каждым днем благодаря совершенству искусственного интеллекта. ИИ теперь может создавать изображения, которые выглядят настолько реалистично, что среднему человеку трудно отличить их от настоящих фотографий. Эта способность имеет серьезные последствия для того, насколько мы можем доверять тому, что видим, особенно в таких чувствительных областях, как новости и политические коммуникации.

Одна из причин, почему так сложно заметить разницу, — это то, как быстро совершенствуются алгоритмы ИИ. Эти алгоритмы становятся очень хороши в копировании текстур, освещения и деталей реальных сцен, создавая изображения, которые практически невозможно отличить от настоящих. Кроме того, ИИ может создавать изображения людей, объектов и событий, которые никогда не существовали, создавая убедительные, но полностью вымышленные реальности.

Еще одним фактором является то, что многие люди мало знают о методах манипуляции ИИ. Без базового понимания того, что может делать ИИ, людям легче быть обманутыми. Если вы не знаете, как работает ИИ, трудно критически оценивать изображения, которые вы видите в Интернете.

Отсутствие четкой маркировки и прозрачности делает ситуацию еще более сложной. Социальные сети и СМИ часто не помечают изображения, созданные ИИ, оставляя зрителям самим разбираться, что реально. Этот недостаток открытости облегчает распространение обманчивого контента, поскольку люди могут предположить, что немаркированные изображения подлинны.

Для решения этих проблем необходим многоплановый подход, включающий технологические решения, обучение медиаграмотности и изменения в политике. Технологические решения, такие как инструменты обнаружения на базе ИИ, могут помочь выявлять и маркировать манипулированные изображения. Обучение медиаграмотности может научить людей критически оценивать источники и выявлять методы манипуляции. Изменения в политике могут способствовать большей прозрачности и ответственности при использовании контента, созданного ИИ.

Объединяя эти усилия, мы можем лучше защититься от обманчивого использования ИИ в визуальных медиа и укрепить доверие к изображениям, которые формируют наши общественные дискуссии. Разработка и широкое внедрение этих инструментов имеют решающее значение для сохранения честности визуальных медиа и обеспечения того, чтобы люди могли принимать информированные решения на основе надежной информации.

Стратегии распознавания контента, созданного ИИ

Пошаговое руководство по визуальной проверке

С учетом того, что контент, созданный ИИ, становится все более изощренным, важно быть начеку и использовать конкретные методы для проверки подлинности того, что мы видим. Вот пошаговое руководство, которое поможет вам:

- Изучите детали изображения: Внимательно рассмотрите изображение на предмет любых несоответствий. Изображения, созданные ИИ, часто имеют тонкие дефекты или несоответствия. Обратите внимание на:

- Неестественные текстуры: Текстуры, которые выглядят слишком гладкими или лишены ожидаемых деталей.

- Аномалии освещения: Освещение, которое не соответствует сцене или имеет непоследовательные тени.

- Искажения фона: Элементы фона, которые кажутся размытыми или не имеют смысла.

- Обратный поиск изображения: Используйте поисковые системы, такие как Google Images, TinEye или Yandex Images, для выполнения обратного поиска изображения. Это может помочь узнать, использовалось ли изображение где-либо еще или соответствует известным шаблонам, созданным ИИ.

- Проверьте источник: Убедитесь, что источник, опубликовавший изображение, заслуживает доверия. Ищите уважаемые новостные издания, официальные веб-сайты или надежные организации. Будьте осторожны с анонимными источниками или сайтами, известными распространением дезинформации.

- Сверьте информацию: Сравните изображение и любую сопутствующую информацию с другими источниками, чтобы подтвердить их точность. Проверьте несколько новостных изданий, сайты проверки фактов и экспертов, чтобы убедиться, что все сходится.

- Используйте инструменты обнаружения ИИ: Применяйте инструменты обнаружения ИИ, которые могут анализировать изображения и выявлять потенциальный контент, созданный ИИ. Эти инструменты становятся все лучше в предоставлении информации о том, может ли изображение быть манипулированным.

- Проконсультируйтесь с экспертами: Если вы все еще не уверены, обратитесь к экспертам в области цифровой криминалистики или анализа медиа. У них есть специализированные знания и инструменты для выявления тонких признаков манипуляции.

Следуя этим шагам, вы сможете лучше распознавать контент, созданный ИИ, и защитить себя от дезинформации. Быть информированным и немного скептичным — ключ к успеху в современном цифровом мире, где обманчивые изображения могут быстро распространяться и влиять на общественное мнение. Скептически настроенная и информированная общественность имеет решающее значение для сохранения доверия и достоверности в эпоху ИИ.

Оценка изображений, созданных ИИ: плюсы и минусы

Плюсы

- Повышенная креативность: ИИ может стимулировать креативность, создавая новые комбинации изображений и стили.

- Эффективность создания контента: ИИ ускоряет и упрощает создание контента, экономя время и ресурсы.

- Доступность: ИИ делает генерацию изображений доступной для всех, а не только для профессионалов.

- Персонализация: ИИ позволяет создавать изображения, точно соответствующие конкретным потребностям.

Минусы

- Риск дезинформации: ИИ упрощает создание и распространение вводящих в заблуждение изображений.

- Проблемы подлинности: ИИ размывает грань между реальным и поддельным, затрудняя доверие к тому, что мы видим.

- Этические вопросы: ИИ поднимает этические вопросы о манипуляции, прозрачности и ответственности.

- Вытеснение рабочих мест: ИИ может отнимать рабочие места у художников и создателей контента по мере роста автоматизации.

Часто задаваемые вопросы

Как эффективно распознать изображения, созданные ИИ?

Чтобы выявить изображения, созданные ИИ, необходимо внимательно изучать детали и использовать доступные инструменты. Проверьте наличие несоответствий в освещении, текстурах и элементах фона. Используйте обратный поиск изображений, чтобы узнать, использовалось ли изображение где-либо еще. Инструменты обнаружения ИИ могут дать представление о том, может ли изображение быть манипулированным. Сверка информации с несколькими источниками и консультации с экспертами могут дополнительно подтвердить подлинность изображения.

Какие существуют потенциальные решения для борьбы с распространением дезинформации, созданной ИИ?

Борьба с дезинформацией, созданной ИИ, требует многостороннего подхода. Необходимы технологические решения, обучение медиаграмотности и изменения в политике. Социальные сети должны инвестировать в инструменты обнаружения ИИ, а школы должны обучать медиаграмотности. Политики должны рассмотреть регулирование, которое способствует прозрачности и ответственности при использовании контента, созданного ИИ.

Как изображения, созданные ИИ, влияют на целостность выборов?

Изображения, созданные ИИ, могут подрывать целостность выборов, распространяя дезинформацию и манипулируя общественным мнением. Фальшивые поддержки, негативные изображения кандидатов и другой обманчивый контент могут повлиять на настроения избирателей и результаты выборов. Смешение реального и фальшивого контента подрывает доверие и вносит неопределенность в общественные дискуссии.

Почему важно маркировать контент, созданный ИИ?

Маркировка контента, созданного ИИ, имеет решающее значение для прозрачности и ответственности. Без четких меток люди могут неосознанно потреблять манипулированный контент, что приводит к неверным решениям. Маркировка помогает зрителям критически оценивать контент и делать обоснованные суждения о его точности и достоверности.

Связанные вопросы

Какую роль играют социальные сети в борьбе с дезинформацией, созданной ИИ?

Социальные сети играют важную роль в борьбе с дезинформацией, созданной ИИ. Им необходимо инвестировать в инструменты обнаружения ИИ, внедрять четкие политики маркировки и продвигать медиаграмотность среди пользователей. Принимая проактивные меры для борьбы с обманчивым контентом, социальные сети могут помочь защитить целостность выборов и сохранить общественное доверие.

Как образовательные учреждения могут продвигать медиаграмотность и навыки критического мышления?

Образовательные учреждения могут продвигать медиаграмотность и критическое мышление, включая их в учебные программы. Студенты должны научиться оценивать источники информации, выявлять методы манипуляции и сверять информацию с несколькими источниками. Развивая критическое мышление, школы могут дать студентам возможность стать информированными и вовлеченными гражданами, менее подверженными дезинформации.

Какие регулирования или политики могли бы помочь бороться с дезинформацией, созданной ИИ, без нарушения свободы слова?

Борьба с дезинформацией, созданной ИИ, при сохранении свободы слова требует осторожного нормотворчества. Требования прозрачности, такие как обязательная маркировка контента, созданного ИИ, могут информировать общественность, не ограничивая свободу слова. Меры ответственности, такие как привлечение к ответственности за распространение известной дезинформации, могут удерживать злоумышленников. Нахождение правильного баланса между регулированием и свободой слова имеет ключевое значение для поддержания здорового и демократического общественного дискурса.

Связанная статья

Claude использовался для создания вредоносных пакетов npm: более 670 скомпрометированных пакетов ставят под угрозу открытый исходный код

Недавний инцидент в сфере кибербезопасности продемонстрировал, как крупные языковые модели (LLM) используются в качестве инструмента для разработки вредоносного ПО. Исследователь в области безопасност

Claude использовался для создания вредоносных пакетов npm: более 670 скомпрометированных пакетов ставят под угрозу открытый исходный код

Недавний инцидент в сфере кибербезопасности продемонстрировал, как крупные языковые модели (LLM) используются в качестве инструмента для разработки вредоносного ПО. Исследователь в области безопасност

Компания Reliance обнародовала план инвестиций в искусственный интеллект на сумму 110 млрд долларов на фоне ускорения технологического развития в Индии

Мукеш Амбани, миллиардер и председатель правления индийского конгломерата Reliance, объявил в четверг о плане стоимостью 10 трлн рупий (около 110 млрд долларов) по созданию инфраструктуры для искусств

Компания Reliance обнародовала план инвестиций в искусственный интеллект на сумму 110 млрд долларов на фоне ускорения технологического развития в Индии

Мукеш Амбани, миллиардер и председатель правления индийского конгломерата Reliance, объявил в четверг о плане стоимостью 10 трлн рупий (около 110 млрд долларов) по созданию инфраструктуры для искусств

Компания Zhiyuan WITA завершила проект «Naked» по взаимодействию с роботами, подав первую отчетную документацию

Сектор интеллектуальных роботов достиг важной вехи. Согласно последнему заявлению Управления киберпространства Шанхая, разработанная компанией Zhiyuan большая модель WITA успешно прошла процедуру реги

Рекомендации по связанным специальным темам

Комментарии (2)

Компания Zhiyuan WITA завершила проект «Naked» по взаимодействию с роботами, подав первую отчетную документацию

Сектор интеллектуальных роботов достиг важной вехи. Согласно последнему заявлению Управления киберпространства Шанхая, разработанная компанией Zhiyuan большая модель WITA успешно прошла процедуру реги

Рекомендации по связанным специальным темам

Комментарии (2)

Появление искусственного интеллекта вызвало волну технологических достижений, но также создало препятствия для нашей способности различать факты и вымысел. В последнее время изображения, созданные ИИ и распространяемые в социальных сетях, вызвали опасения относительно их потенциала искажать политические дискуссии и угрожать целостности выборов. Крайне важно, чтобы мы полностью осознавали масштаб этих технологий, чтобы поддерживать информированные общественные обсуждения и сохранять доверие к тому, что мы видим.

Споры вокруг изображений, созданных ИИ, в политике

Рост контента, созданного ИИ

Искусственный интеллект достиг уровня, на котором он может создавать изображения, видео и аудио, которые выглядят и звучат невероятно реалистично. Это, безусловно, впечатляющее достижение, но оно также немного пугает, особенно в контексте политики и выборов. Способность создавать убедительный, но полностью вымышленный контент может сбить общественность с толку и подорвать доверие к новостям, которые мы потребляем. Способность социальных сетей распространять этот контент подобно лесному пожару только усугубляет ситуацию, превращая это в настоящую проблему для поддержания правильного нарратива и предотвращения дезинформации.

По мере того как инструменты ИИ становятся более удобными для пользователей, любому человеку с недобрыми намерениями становится проще манипулировать общественным мнением. Эти творения ИИ, часто называемые синтетическими медиа или дипфейками, бросают вызов нашей способности критически мыслить и оставаться медиаграмотными. Потенциал искажения общественного восприятия и подрыва доверия к институтам — это серьезная проблема, которая побуждает нас принимать проактивные меры и устанавливать этические границы для сдерживания рисков.

Политические кампании могут использовать эту технологию для создания фальшивых поддержек или очернения оппонентов, влияя на то, как люди голосуют. Без четких признаков или инструментов для выявления этих подделок обычным людям может быть сложно отличить реальное от вымышленного, что приводит к решениям, основанным на ложной информации. Этот вид массового обмана может поколебать основы демократии, что делает срочной задачу поиска технологических и политических решений для его устранения.

Итак, как нам защититься от злоупотребления ИИ в политических кампаниях и убедиться, что избиратели получают достоверную информацию? Потребуется сочетание технологических достижений, обучения медиаграмотности и надежных политических рамок. Использование контента, созданного ИИ, поднимает важные вопросы о честности, открытости и ответственности, подчеркивая необходимость для всех нас активизироваться и защищать демократические ценности в эпоху ИИ.

Использование изображений, созданных ИИ, Трампом

Бывший президент Трамп вызвал бурю обсуждений, разместив изображения, созданные ИИ, в социальных сетях, что спровоцировало жаркие дебаты об этике и последствиях использования такого контента в политике.

Размещая изображения, которые создавали впечатление, что Тейлор Свифт и ее фанаты поддерживают его, Трамп вызвал вопросы о манипуляции восприятием общественности. Некоторые из этих изображений были настоящими, а другие — созданными ИИ, что вызвало путаницу и вопросы о том, насколько открытым должно быть политическое послание.

Изображения показывали женщин в футболках с надписью «Swifties for Trump», что наводило на мысль о поддержке со стороны группы, которая, возможно, на самом деле не разделяет его политические взгляды. Этот шаг поднимает этические вопросы о том, правильно ли использовать ИИ для создания фальшивых поддержек или искажения общественного мнения. Отсутствие четкой маркировки некоторых изображений как созданных ИИ только усугубляет путаницу, потенциально обманывая тех, кто не знает, что смотрит на искусственный контент.

Хотя некоторые изображения действительно были созданы ИИ, другие были подлинными фотографиями сторонников Трампа. Смешение реального и фальшивого затрудняет для зрителей определение того, что является правдой, размывая границы между честным и обманчивым посланием. Эта путаница может подорвать доверие и посеять сомнения в общественных дискуссиях, поскольку люди теряют уверенность в своей способности отличать реальное от поддельного.

Распространение этих изображений также можно рассматривать как стратегический шаг для привлечения определенных групп избирателей, таких как фанаты Тейлор Свифт, независимо от того, поддерживают они его или нет. Создавая иллюзию широкой поддержки, даже если она создана искусственно, политические кампании могут повлиять на неопределившихся избирателей или воодушевить свою базу. Это показывает, как ИИ может быть мощным инструментом убеждения, способным формировать общественное мнение и влиять на результаты выборов.

Когда крупные политические фигуры используют контент, созданный ИИ, это служит сигналом для общественности быть более бдительными и медиаграмотными. По мере развития технологий ИИ людям крайне важно критически относиться к контенту, который они видят в Интернете, и искать надежные источники. СМИ, школы и государственные учреждения должны сыграть свою роль в повышении критического мышления и осведомленности об опасностях манипулируемых медиа.

Путаница и дезинформация

Распространение изображений, созданных ИИ, и другого манипулированного контента в Интернете подпитывает нарастающую проблему путаницы и дезинформации.

Когда люди сталкиваются со смесью реальной и фальшивой информации, им сложно определить, что является правдой. Эта неразбериха может подорвать доверие к СМИ, институтам и даже личным отношениям, затрудняя достижение консенсуса по важным вопросам.

Одной из самых больших проблем в борьбе с дезинформацией является то, как быстро она распространяется в социальных сетях. Ложный или вводящий в заблуждение контент может стать вирусным в одно мгновение, достигая миллионов, прежде чем проверяющие факты успеют среагировать. Это быстрое распространение затрудняет устранение ущерба, вызванного дезинформацией, поскольку она может укорениться в сознании людей и повлиять на их мнения.

Еще одна проблема — это то, насколько изощренными стали современные методы манипуляции. Контент, созданный ИИ, дипфейки и другие синтетические медиа становятся настолько качественными, что даже эксперты с трудом их распознают. Это означает, что традиционные методы проверки фактов и анализа СМИ уже недостаточны, что побуждает нас разрабатывать новые инструменты и методы для противодействия.

Усугубляют ситуацию эхо-камеры и фильтрующие пузыри в Интернете. Алгоритмы социальных сетей часто показывают нам контент, соответствующий нашим существующим взглядам, создавая эхо-камеры, где мы в основном сталкиваемся с похожими точками зрения. Это может укреплять наши предубеждения и затруднять взаимодействие с другими взглядами, что приводит к большей поляризации и разделению.

Для борьбы с путаницей и дезинформацией необходим многосторонний подход, включающий технологические решения, обучение медиаграмотности и изменения в политике. Социальные сети должны инвестировать в инструменты на базе ИИ для обнаружения и маркировки манипулированного контента. Школы должны обучать медиаграмотности, показывая ученикам, как критически оценивать источники и выявлять методы манипуляции. Политики должны рассмотреть регулирование, которое делает людей ответственными за распространение дезинформации, при этом защищая свободу слова. Только совместными усилиями мы можем надеяться ограничить распространение дезинформации и способствовать формированию более информированной и вовлеченной общественности.

Анализ реальных и созданных ИИ изображений

Сложность определения подлинности

Отличить реальные изображения от созданных ИИ становится все сложнее с каждым днем благодаря совершенству искусственного интеллекта. ИИ теперь может создавать изображения, которые выглядят настолько реалистично, что среднему человеку трудно отличить их от настоящих фотографий. Эта способность имеет серьезные последствия для того, насколько мы можем доверять тому, что видим, особенно в таких чувствительных областях, как новости и политические коммуникации.

Одна из причин, почему так сложно заметить разницу, — это то, как быстро совершенствуются алгоритмы ИИ. Эти алгоритмы становятся очень хороши в копировании текстур, освещения и деталей реальных сцен, создавая изображения, которые практически невозможно отличить от настоящих. Кроме того, ИИ может создавать изображения людей, объектов и событий, которые никогда не существовали, создавая убедительные, но полностью вымышленные реальности.

Еще одним фактором является то, что многие люди мало знают о методах манипуляции ИИ. Без базового понимания того, что может делать ИИ, людям легче быть обманутыми. Если вы не знаете, как работает ИИ, трудно критически оценивать изображения, которые вы видите в Интернете.

Отсутствие четкой маркировки и прозрачности делает ситуацию еще более сложной. Социальные сети и СМИ часто не помечают изображения, созданные ИИ, оставляя зрителям самим разбираться, что реально. Этот недостаток открытости облегчает распространение обманчивого контента, поскольку люди могут предположить, что немаркированные изображения подлинны.

Для решения этих проблем необходим многоплановый подход, включающий технологические решения, обучение медиаграмотности и изменения в политике. Технологические решения, такие как инструменты обнаружения на базе ИИ, могут помочь выявлять и маркировать манипулированные изображения. Обучение медиаграмотности может научить людей критически оценивать источники и выявлять методы манипуляции. Изменения в политике могут способствовать большей прозрачности и ответственности при использовании контента, созданного ИИ.

Объединяя эти усилия, мы можем лучше защититься от обманчивого использования ИИ в визуальных медиа и укрепить доверие к изображениям, которые формируют наши общественные дискуссии. Разработка и широкое внедрение этих инструментов имеют решающее значение для сохранения честности визуальных медиа и обеспечения того, чтобы люди могли принимать информированные решения на основе надежной информации.

Стратегии распознавания контента, созданного ИИ

Пошаговое руководство по визуальной проверке

С учетом того, что контент, созданный ИИ, становится все более изощренным, важно быть начеку и использовать конкретные методы для проверки подлинности того, что мы видим. Вот пошаговое руководство, которое поможет вам:

- Изучите детали изображения: Внимательно рассмотрите изображение на предмет любых несоответствий. Изображения, созданные ИИ, часто имеют тонкие дефекты или несоответствия. Обратите внимание на:

- Неестественные текстуры: Текстуры, которые выглядят слишком гладкими или лишены ожидаемых деталей.

- Аномалии освещения: Освещение, которое не соответствует сцене или имеет непоследовательные тени.

- Искажения фона: Элементы фона, которые кажутся размытыми или не имеют смысла.

- Обратный поиск изображения: Используйте поисковые системы, такие как Google Images, TinEye или Yandex Images, для выполнения обратного поиска изображения. Это может помочь узнать, использовалось ли изображение где-либо еще или соответствует известным шаблонам, созданным ИИ.

- Проверьте источник: Убедитесь, что источник, опубликовавший изображение, заслуживает доверия. Ищите уважаемые новостные издания, официальные веб-сайты или надежные организации. Будьте осторожны с анонимными источниками или сайтами, известными распространением дезинформации.

- Сверьте информацию: Сравните изображение и любую сопутствующую информацию с другими источниками, чтобы подтвердить их точность. Проверьте несколько новостных изданий, сайты проверки фактов и экспертов, чтобы убедиться, что все сходится.

- Используйте инструменты обнаружения ИИ: Применяйте инструменты обнаружения ИИ, которые могут анализировать изображения и выявлять потенциальный контент, созданный ИИ. Эти инструменты становятся все лучше в предоставлении информации о том, может ли изображение быть манипулированным.

- Проконсультируйтесь с экспертами: Если вы все еще не уверены, обратитесь к экспертам в области цифровой криминалистики или анализа медиа. У них есть специализированные знания и инструменты для выявления тонких признаков манипуляции.

Следуя этим шагам, вы сможете лучше распознавать контент, созданный ИИ, и защитить себя от дезинформации. Быть информированным и немного скептичным — ключ к успеху в современном цифровом мире, где обманчивые изображения могут быстро распространяться и влиять на общественное мнение. Скептически настроенная и информированная общественность имеет решающее значение для сохранения доверия и достоверности в эпоху ИИ.

Оценка изображений, созданных ИИ: плюсы и минусы

Плюсы

- Повышенная креативность: ИИ может стимулировать креативность, создавая новые комбинации изображений и стили.

- Эффективность создания контента: ИИ ускоряет и упрощает создание контента, экономя время и ресурсы.

- Доступность: ИИ делает генерацию изображений доступной для всех, а не только для профессионалов.

- Персонализация: ИИ позволяет создавать изображения, точно соответствующие конкретным потребностям.

Минусы

- Риск дезинформации: ИИ упрощает создание и распространение вводящих в заблуждение изображений.

- Проблемы подлинности: ИИ размывает грань между реальным и поддельным, затрудняя доверие к тому, что мы видим.

- Этические вопросы: ИИ поднимает этические вопросы о манипуляции, прозрачности и ответственности.

- Вытеснение рабочих мест: ИИ может отнимать рабочие места у художников и создателей контента по мере роста автоматизации.

Часто задаваемые вопросы

Как эффективно распознать изображения, созданные ИИ?

Чтобы выявить изображения, созданные ИИ, необходимо внимательно изучать детали и использовать доступные инструменты. Проверьте наличие несоответствий в освещении, текстурах и элементах фона. Используйте обратный поиск изображений, чтобы узнать, использовалось ли изображение где-либо еще. Инструменты обнаружения ИИ могут дать представление о том, может ли изображение быть манипулированным. Сверка информации с несколькими источниками и консультации с экспертами могут дополнительно подтвердить подлинность изображения.

Какие существуют потенциальные решения для борьбы с распространением дезинформации, созданной ИИ?

Борьба с дезинформацией, созданной ИИ, требует многостороннего подхода. Необходимы технологические решения, обучение медиаграмотности и изменения в политике. Социальные сети должны инвестировать в инструменты обнаружения ИИ, а школы должны обучать медиаграмотности. Политики должны рассмотреть регулирование, которое способствует прозрачности и ответственности при использовании контента, созданного ИИ.

Как изображения, созданные ИИ, влияют на целостность выборов?

Изображения, созданные ИИ, могут подрывать целостность выборов, распространяя дезинформацию и манипулируя общественным мнением. Фальшивые поддержки, негативные изображения кандидатов и другой обманчивый контент могут повлиять на настроения избирателей и результаты выборов. Смешение реального и фальшивого контента подрывает доверие и вносит неопределенность в общественные дискуссии.

Почему важно маркировать контент, созданный ИИ?

Маркировка контента, созданного ИИ, имеет решающее значение для прозрачности и ответственности. Без четких меток люди могут неосознанно потреблять манипулированный контент, что приводит к неверным решениям. Маркировка помогает зрителям критически оценивать контент и делать обоснованные суждения о его точности и достоверности.

Связанные вопросы

Какую роль играют социальные сети в борьбе с дезинформацией, созданной ИИ?

Социальные сети играют важную роль в борьбе с дезинформацией, созданной ИИ. Им необходимо инвестировать в инструменты обнаружения ИИ, внедрять четкие политики маркировки и продвигать медиаграмотность среди пользователей. Принимая проактивные меры для борьбы с обманчивым контентом, социальные сети могут помочь защитить целостность выборов и сохранить общественное доверие.

Как образовательные учреждения могут продвигать медиаграмотность и навыки критического мышления?

Образовательные учреждения могут продвигать медиаграмотность и критическое мышление, включая их в учебные программы. Студенты должны научиться оценивать источники информации, выявлять методы манипуляции и сверять информацию с несколькими источниками. Развивая критическое мышление, школы могут дать студентам возможность стать информированными и вовлеченными гражданами, менее подверженными дезинформации.

Какие регулирования или политики могли бы помочь бороться с дезинформацией, созданной ИИ, без нарушения свободы слова?

Борьба с дезинформацией, созданной ИИ, при сохранении свободы слова требует осторожного нормотворчества. Требования прозрачности, такие как обязательная маркировка контента, созданного ИИ, могут информировать общественность, не ограничивая свободу слова. Меры ответственности, такие как привлечение к ответственности за распространение известной дезинформации, могут удерживать злоумышленников. Нахождение правильного баланса между регулированием и свободой слова имеет ключевое значение для поддержания здорового и демократического общественного дискурса.

Claude использовался для создания вредоносных пакетов npm: более 670 скомпрометированных пакетов ставят под угрозу открытый исходный код

Недавний инцидент в сфере кибербезопасности продемонстрировал, как крупные языковые модели (LLM) используются в качестве инструмента для разработки вредоносного ПО. Исследователь в области безопасност

Claude использовался для создания вредоносных пакетов npm: более 670 скомпрометированных пакетов ставят под угрозу открытый исходный код

Недавний инцидент в сфере кибербезопасности продемонстрировал, как крупные языковые модели (LLM) используются в качестве инструмента для разработки вредоносного ПО. Исследователь в области безопасност

Компания Reliance обнародовала план инвестиций в искусственный интеллект на сумму 110 млрд долларов на фоне ускорения технологического развития в Индии

Мукеш Амбани, миллиардер и председатель правления индийского конгломерата Reliance, объявил в четверг о плане стоимостью 10 трлн рупий (около 110 млрд долларов) по созданию инфраструктуры для искусств

Компания Reliance обнародовала план инвестиций в искусственный интеллект на сумму 110 млрд долларов на фоне ускорения технологического развития в Индии

Мукеш Амбани, миллиардер и председатель правления индийского конгломерата Reliance, объявил в четверг о плане стоимостью 10 трлн рупий (около 110 млрд долларов) по созданию инфраструктуры для искусств

Компания Zhiyuan WITA завершила проект «Naked» по взаимодействию с роботами, подав первую отчетную документацию

Сектор интеллектуальных роботов достиг важной вехи. Согласно последнему заявлению Управления киберпространства Шанхая, разработанная компанией Zhiyuan большая модель WITA успешно прошла процедуру реги

Компания Zhiyuan WITA завершила проект «Naked» по взаимодействию с роботами, подав первую отчетную документацию

Сектор интеллектуальных роботов достиг важной вехи. Согласно последнему заявлению Управления киберпространства Шанхая, разработанная компанией Zhiyuan большая модель WITA успешно прошла процедуру реги

Дом

Дом