Web3 Tech ayuda a inculcar la confianza y la confianza en la IA

El potencial y los peligros de la IA

El atractivo de la inteligencia artificial (IA) radica en su capacidad para simplificar nuestras vidas, aportando no solo conveniencia, sino también importantes beneficios económicos. Las Naciones Unidas predicen que para 2033, la IA podría convertirse en un mercado global valorado en 4.8 billones de dólares, una cifra comparable al tamaño de la economía alemana. Pero no hay que esperar hasta 2033 para ver la IA en acción; ya está transformando industrias, desde las finanzas hasta la atención médica, la agricultura y el comercio electrónico. Ya sea que la IA gestione tus inversiones o ayude en la detección temprana de enfermedades, su impacto en nuestra vida diaria es innegable.

Sin embargo, hay un creciente escepticismo sobre la IA, alimentado por películas como *Terminator 2* que pintan un panorama distópico. Esto plantea una pregunta crítica: ¿Cómo podemos construir confianza a medida que la IA se integra más en nuestras vidas?

Abordando la brecha de confianza en la IA

Las apuestas por la confianza en la IA son altas. Según un reciente informe de Camunda, un sorprendente 84% de las organizaciones vinculan sus problemas de cumplimiento normativo a la falta de transparencia en las aplicaciones de IA. Cuando los algoritmos son opacos o potencialmente ocultan información, los usuarios quedan a oscuras. Combina esto con sesgos sistémicos, sistemas no probados y regulaciones inconsistentes, y tienes una tormenta perfecta para una desconfianza generalizada.

Transparencia: Iluminando la IA

Los algoritmos de IA, a pesar de su poder, a menudo permanecen como una caja negra, dejando a los usuarios sin idea de cómo se toman las decisiones. ¿Se rechaza tu solicitud de préstamo debido a tu puntaje crediticio o por un sesgo subyacente? Sin transparencia, la IA puede operar para servir a los intereses de su propietario mientras los usuarios permanecen inconscientes, creyendo que la IA actúa en su mejor interés.

Una posible solución radica en aprovechar la tecnología blockchain para hacer que los algoritmos sean verificables y auditables. Aquí es donde entra en juego la tecnología Web3. Startups como Space and Time (SxT), respaldadas por Microsoft, están liderando este enfoque. SxT proporciona feeds de datos a prueba de manipulaciones con una capa de cómputo verificable, asegurando que los datos en los que confía la IA sean genuinos, precisos y libres de manipulación por parte de cualquier entidad única. Su innovador probador Proof of SQL asegura que las consultas se calculen con precisión contra datos no manipulados, ofreciendo una verificación más rápida que las tecnologías actuales de vanguardia.

Construyendo y manteniendo la confianza en la IA

La confianza en la IA no es algo que se pueda establecer una vez y olvidar; debe ganarse continuamente, como un restaurante que se esfuerza por mantener su estrella Michelin. En campos de alto riesgo como la atención médica o la conducción autónoma, los sistemas de IA necesitan una evaluación continua de su rendimiento y seguridad. Una IA que funcione mal recetando medicamentos incorrectos o causando un accidente no es solo un fallo: es un desastre.

Modelos de código abierto y verificación en cadena utilizando registros inmutables, mejorados por técnicas criptográficas como las pruebas de conocimiento cero (ZKPs), ofrecen una forma de construir esta confianza. Sin embargo, también es crucial que los usuarios comprendan las capacidades y limitaciones de la IA para establecer expectativas realistas. Si los usuarios creen que la IA es infalible, es más probable que confíen en resultados defectuosos.

Aunque la narrativa sobre la IA a menudo se ha centrado en sus peligros, es hora de cambiar la conversación hacia educar a los usuarios sobre lo que la IA puede y no puede hacer, empoderándolos en lugar de dejarlos vulnerables a la explotación.

Garantizando el cumplimiento y la responsabilidad

Al igual que las criptomonedas, la IA debe adherirse a estándares legales y regulatorios. La pregunta de cómo responsabilizar a un algoritmo sin rostro es apremiante. Una respuesta podría encontrarse en el protocolo modular de blockchain Cartesi, que permite que la inferencia de IA ocurra en cadena. La máquina virtual de Cartesi permite a los desarrolladores ejecutar bibliotecas estándar de IA en un entorno descentralizado, fusionando la transparencia de blockchain con el cómputo de IA.

La descentralización como camino hacia la confianza

El Informe de Tecnología e Innovación de las Naciones Unidas destaca que, aunque la IA promete prosperidad e innovación, también corre el riesgo de exacerbar las divisiones globales. La descentralización podría ser la clave para escalar la IA mientras se fomenta la confianza en sus mecanismos subyacentes. Al descentralizar la IA, podemos asegurar que beneficie a todos, no solo a unos pocos, y mantener la transparencia y la responsabilidad en su núcleo.

Artículo relacionado

"Dot AI Companion App anuncia su cierre y suspende el servicio personalizado"

Dot, una aplicación de inteligencia artificial diseñada para funcionar como amigo personal y confidente, dejará de funcionar, según anunciaron el viernes sus desarrolladores. New Computer, la empresa

"Dot AI Companion App anuncia su cierre y suspende el servicio personalizado"

Dot, una aplicación de inteligencia artificial diseñada para funcionar como amigo personal y confidente, dejará de funcionar, según anunciaron el viernes sus desarrolladores. New Computer, la empresa

Anthropic resuelve un caso de piratería de libros generados por inteligencia artificial

Anthropic ha llegado a una resolución en un importante litigio sobre derechos de autor con autores estadounidenses, aceptando una propuesta de acuerdo de demanda colectiva que evita un juicio potencia

Anthropic resuelve un caso de piratería de libros generados por inteligencia artificial

Anthropic ha llegado a una resolución en un importante litigio sobre derechos de autor con autores estadounidenses, aceptando una propuesta de acuerdo de demanda colectiva que evita un juicio potencia

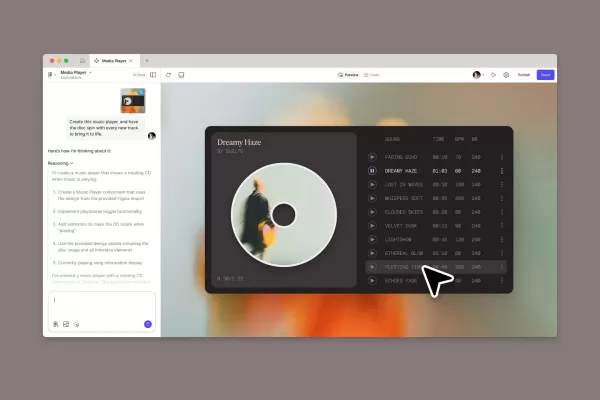

Figma pone a disposición de todos los usuarios su herramienta de creación de aplicaciones basada en inteligencia artificial

Figma Make, la innovadora plataforma de desarrollo "prompt-to-app" presentada a principios de este año, ha salido oficialmente de la fase beta y se ha puesto a disposición de todos los usuarios. Esta

comentario (14)

0/200

Figma pone a disposición de todos los usuarios su herramienta de creación de aplicaciones basada en inteligencia artificial

Figma Make, la innovadora plataforma de desarrollo "prompt-to-app" presentada a principios de este año, ha salido oficialmente de la fase beta y se ha puesto a disposición de todos los usuarios. Esta

comentario (14)

0/200

![JustinLewis]() JustinLewis

JustinLewis

22 de septiembre de 2025 08:30:37 GMT+02:00

22 de septiembre de 2025 08:30:37 GMT+02:00

Honestly I'm still skeptical about web3 fixing AI trust issues. Remember how everyone said blockchain would revolutionize everything? Feels like we're just slapping buzzwords together now 🤷♂️

0

0

![RobertSanchez]() RobertSanchez

RobertSanchez

26 de agosto de 2025 07:59:22 GMT+02:00

26 de agosto de 2025 07:59:22 GMT+02:00

AI's potential is huge, but Web3 giving it a trust boost? That's a game-changer! Excited to see how this plays out in markets. 🤖🚀

0

0

![PaulWilson]() PaulWilson

PaulWilson

15 de agosto de 2025 15:00:59 GMT+02:00

15 de agosto de 2025 15:00:59 GMT+02:00

AI and Web3 together sound like a sci-fi dream! 😎 But I wonder if this trust-building tech can really keep up with AI's wild growth. $4.8T by 2033? That's insane! Hope it doesn't outsmart us too fast.

0

0

![DanielLewis]() DanielLewis

DanielLewis

8 de agosto de 2025 19:01:00 GMT+02:00

8 de agosto de 2025 19:01:00 GMT+02:00

AI and Web3 together sound like a sci-fi dream! Exciting potential, but I wonder how we balance trust with all the ethical minefields. 🤔

0

0

![HenryTurner]() HenryTurner

HenryTurner

25 de abril de 2025 10:29:31 GMT+02:00

25 de abril de 2025 10:29:31 GMT+02:00

Tecnologia Web3 em AI? Parece legal, mas não tenho certeza se realmente aumenta a confiança. Quer dizer, AI é AI, certo? É interessante ver o potencial, mas sou cético quanto ao impacto real. Talvez seja só hype? 🤔 Vale a pena ficar de olho, no entanto!

0

0

![JoeLee]() JoeLee

JoeLee

25 de abril de 2025 10:13:40 GMT+02:00

25 de abril de 2025 10:13:40 GMT+02:00

¿Tecnología Web3 en IA? Suena genial, pero no estoy seguro de que realmente aumente la confianza. Quiero decir, la IA sigue siendo IA, ¿verdad? Es interesante ver el potencial, pero soy escéptico sobre el impacto real. ¿Quizás solo es hype? 🤔 ¡Vale la pena seguirle la pista, de todos modos!

0

0

El potencial y los peligros de la IA

El atractivo de la inteligencia artificial (IA) radica en su capacidad para simplificar nuestras vidas, aportando no solo conveniencia, sino también importantes beneficios económicos. Las Naciones Unidas predicen que para 2033, la IA podría convertirse en un mercado global valorado en 4.8 billones de dólares, una cifra comparable al tamaño de la economía alemana. Pero no hay que esperar hasta 2033 para ver la IA en acción; ya está transformando industrias, desde las finanzas hasta la atención médica, la agricultura y el comercio electrónico. Ya sea que la IA gestione tus inversiones o ayude en la detección temprana de enfermedades, su impacto en nuestra vida diaria es innegable.

Sin embargo, hay un creciente escepticismo sobre la IA, alimentado por películas como *Terminator 2* que pintan un panorama distópico. Esto plantea una pregunta crítica: ¿Cómo podemos construir confianza a medida que la IA se integra más en nuestras vidas?

Abordando la brecha de confianza en la IA

Las apuestas por la confianza en la IA son altas. Según un reciente informe de Camunda, un sorprendente 84% de las organizaciones vinculan sus problemas de cumplimiento normativo a la falta de transparencia en las aplicaciones de IA. Cuando los algoritmos son opacos o potencialmente ocultan información, los usuarios quedan a oscuras. Combina esto con sesgos sistémicos, sistemas no probados y regulaciones inconsistentes, y tienes una tormenta perfecta para una desconfianza generalizada.

Transparencia: Iluminando la IA

Los algoritmos de IA, a pesar de su poder, a menudo permanecen como una caja negra, dejando a los usuarios sin idea de cómo se toman las decisiones. ¿Se rechaza tu solicitud de préstamo debido a tu puntaje crediticio o por un sesgo subyacente? Sin transparencia, la IA puede operar para servir a los intereses de su propietario mientras los usuarios permanecen inconscientes, creyendo que la IA actúa en su mejor interés.

Una posible solución radica en aprovechar la tecnología blockchain para hacer que los algoritmos sean verificables y auditables. Aquí es donde entra en juego la tecnología Web3. Startups como Space and Time (SxT), respaldadas por Microsoft, están liderando este enfoque. SxT proporciona feeds de datos a prueba de manipulaciones con una capa de cómputo verificable, asegurando que los datos en los que confía la IA sean genuinos, precisos y libres de manipulación por parte de cualquier entidad única. Su innovador probador Proof of SQL asegura que las consultas se calculen con precisión contra datos no manipulados, ofreciendo una verificación más rápida que las tecnologías actuales de vanguardia.

Construyendo y manteniendo la confianza en la IA

La confianza en la IA no es algo que se pueda establecer una vez y olvidar; debe ganarse continuamente, como un restaurante que se esfuerza por mantener su estrella Michelin. En campos de alto riesgo como la atención médica o la conducción autónoma, los sistemas de IA necesitan una evaluación continua de su rendimiento y seguridad. Una IA que funcione mal recetando medicamentos incorrectos o causando un accidente no es solo un fallo: es un desastre.

Modelos de código abierto y verificación en cadena utilizando registros inmutables, mejorados por técnicas criptográficas como las pruebas de conocimiento cero (ZKPs), ofrecen una forma de construir esta confianza. Sin embargo, también es crucial que los usuarios comprendan las capacidades y limitaciones de la IA para establecer expectativas realistas. Si los usuarios creen que la IA es infalible, es más probable que confíen en resultados defectuosos.

Aunque la narrativa sobre la IA a menudo se ha centrado en sus peligros, es hora de cambiar la conversación hacia educar a los usuarios sobre lo que la IA puede y no puede hacer, empoderándolos en lugar de dejarlos vulnerables a la explotación.

Garantizando el cumplimiento y la responsabilidad

Al igual que las criptomonedas, la IA debe adherirse a estándares legales y regulatorios. La pregunta de cómo responsabilizar a un algoritmo sin rostro es apremiante. Una respuesta podría encontrarse en el protocolo modular de blockchain Cartesi, que permite que la inferencia de IA ocurra en cadena. La máquina virtual de Cartesi permite a los desarrolladores ejecutar bibliotecas estándar de IA en un entorno descentralizado, fusionando la transparencia de blockchain con el cómputo de IA.

La descentralización como camino hacia la confianza

El Informe de Tecnología e Innovación de las Naciones Unidas destaca que, aunque la IA promete prosperidad e innovación, también corre el riesgo de exacerbar las divisiones globales. La descentralización podría ser la clave para escalar la IA mientras se fomenta la confianza en sus mecanismos subyacentes. Al descentralizar la IA, podemos asegurar que beneficie a todos, no solo a unos pocos, y mantener la transparencia y la responsabilidad en su núcleo.

Anthropic resuelve un caso de piratería de libros generados por inteligencia artificial

Anthropic ha llegado a una resolución en un importante litigio sobre derechos de autor con autores estadounidenses, aceptando una propuesta de acuerdo de demanda colectiva que evita un juicio potencia

Anthropic resuelve un caso de piratería de libros generados por inteligencia artificial

Anthropic ha llegado a una resolución en un importante litigio sobre derechos de autor con autores estadounidenses, aceptando una propuesta de acuerdo de demanda colectiva que evita un juicio potencia

Figma pone a disposición de todos los usuarios su herramienta de creación de aplicaciones basada en inteligencia artificial

Figma Make, la innovadora plataforma de desarrollo "prompt-to-app" presentada a principios de este año, ha salido oficialmente de la fase beta y se ha puesto a disposición de todos los usuarios. Esta

Figma pone a disposición de todos los usuarios su herramienta de creación de aplicaciones basada en inteligencia artificial

Figma Make, la innovadora plataforma de desarrollo "prompt-to-app" presentada a principios de este año, ha salido oficialmente de la fase beta y se ha puesto a disposición de todos los usuarios. Esta

22 de septiembre de 2025 08:30:37 GMT+02:00

22 de septiembre de 2025 08:30:37 GMT+02:00

Honestly I'm still skeptical about web3 fixing AI trust issues. Remember how everyone said blockchain would revolutionize everything? Feels like we're just slapping buzzwords together now 🤷♂️

0

0

26 de agosto de 2025 07:59:22 GMT+02:00

26 de agosto de 2025 07:59:22 GMT+02:00

AI's potential is huge, but Web3 giving it a trust boost? That's a game-changer! Excited to see how this plays out in markets. 🤖🚀

0

0

15 de agosto de 2025 15:00:59 GMT+02:00

15 de agosto de 2025 15:00:59 GMT+02:00

AI and Web3 together sound like a sci-fi dream! 😎 But I wonder if this trust-building tech can really keep up with AI's wild growth. $4.8T by 2033? That's insane! Hope it doesn't outsmart us too fast.

0

0

8 de agosto de 2025 19:01:00 GMT+02:00

8 de agosto de 2025 19:01:00 GMT+02:00

AI and Web3 together sound like a sci-fi dream! Exciting potential, but I wonder how we balance trust with all the ethical minefields. 🤔

0

0

25 de abril de 2025 10:29:31 GMT+02:00

25 de abril de 2025 10:29:31 GMT+02:00

Tecnologia Web3 em AI? Parece legal, mas não tenho certeza se realmente aumenta a confiança. Quer dizer, AI é AI, certo? É interessante ver o potencial, mas sou cético quanto ao impacto real. Talvez seja só hype? 🤔 Vale a pena ficar de olho, no entanto!

0

0

25 de abril de 2025 10:13:40 GMT+02:00

25 de abril de 2025 10:13:40 GMT+02:00

¿Tecnología Web3 en IA? Suena genial, pero no estoy seguro de que realmente aumente la confianza. Quiero decir, la IA sigue siendo IA, ¿verdad? Es interesante ver el potencial, pero soy escéptico sobre el impacto real. ¿Quizás solo es hype? 🤔 ¡Vale la pena seguirle la pista, de todos modos!

0

0