Web3 Techは、AIへの自信と信頼を促進するのに役立ちます

AIの可能性と危険性

人工知能(AI)の魅力は、私たちの生活を簡素化する可能性にあり、利便性だけでなく、大きな経済的利益ももたらします。国連は、2033年までにAIが世界市場で4.8兆ドルの価値を持つと予測しており、これはドイツ経済の規模に匹敵する数字です。しかし、2033年まで待つ必要はありません。AIはすでに金融から医療、農業から電子商取引まで、さまざまな産業を変革しています。AIがあなたの投資を管理したり、早期疾患検出を支援したりするなど、AIが私たちの日常生活に与える影響は否定できません。

それでも、*ターミネーター2*のような映画によって描かれるディストピア的なイメージが、AIに対する懐疑的な見方を助長しています。これにより、重要な疑問が生じます。AIが私たちの生活にさらに深く統合される中で、どのように信頼を築けばよいのでしょうか?

AIにおける信頼のギャップへの対応

AIに対する信頼の重要性は非常に高いものです。Camundaの最近のレポートによると、驚くべきことに84%の組織が、AIアプリケーションの透明性の欠如が規制遵守の問題につながっていると指摘しています。アルゴリズムが不透明であったり、情報を隠している可能性がある場合、ユーザーは暗闇に取り残されます。システム的な偏見、未検証のシステム、一貫性のない規制が重なると、広範な不信感を引き起こす完璧な嵐が形成されます。

透明性:AIに光を当てる

AIアルゴリズムは、その力にもかかわらず、しばしばブラックボックスであり、ユーザーはどのように決定が下されているのか全く分からないままです。あなたのローンの申請が拒否されたのは、信用スコアのせいなのか、それとも隠れた偏見によるものなのか?透明性がなければ、AIはユーザーが気づかないうちに所有者の利益を優先して動作し、ユーザーはAIが自分の最善の利益のために動いていると信じてしまいます。

解決策の一つは、ブロックチェーン技術を活用してアルゴリズムを検証可能かつ監査可能にすることです。ここでWeb3技術が登場します。Microsoftが支援するSpace and Time(SxT)のようなスタートアップがこのアプローチを先導しています。SxTは、改ざん防止のデータフィードと検証可能な計算レイヤーを提供し、AIが依存するデータが本物で正確であり、単一の主体による操作がないことを保証します。彼らの革新的なProof of SQLプローバーは、改ざんされていないデータに対してクエリが正確に計算されることを保証し、現在の最先端技術よりも高速な検証を提供します。

AIにおける信頼の構築と維持

AIに対する信頼は、一度確立すれば終わりというものではなく、ミシュランの星を維持しようとするレストランのように、継続的に獲得し続ける必要があります。医療や自動運転のような高リスクの分野では、AIシステムのパフォーマンスと安全性について継続的な評価が必要です。誤った薬を処方するAIや事故を引き起こすAIは、単なる不具合ではなく、災害です。

オープンソースモデルや、ゼロ知識証明(ZKPs)などの暗号技術を活用した不変の台帳を使用したオンチェーン検証は、この信頼を築く方法を提供します。しかし、ユーザーがAIの能力と限界を理解し、現実的な期待を設定することも重要です。ユーザーがAIを絶対に正しいと信じると、誤った出力に信頼を置く可能性が高くなります。

AIに関する議論はこれまでその危険性に焦点を当てがちでしたが、AIが何ができ、何ができないかをユーザーに教育し、搾取されやすい状態に置くのではなく、力を与える方向へと会話をシフトする時期が来ています。

コンプライアンスと説明責任の確保

暗号通貨と同様に、AIも法的および規制基準を遵守する必要があります。顔の見えないアルゴリズムにどのように責任を負わせるかという問題は急務です。一つの答えは、モジュラーブロックチェーンプロトコルであるCartesiに見られるかもしれません。Cartesiは、AI推論をオンチェーンで実行できるようにします。Cartesiの仮想マシンは、開発者が標準的なAIライブラリを分散環境で実行できるようにし、ブロックチェーンの透明性とAI計算を融合させます。

信頼への道としての分散化

国連の技術・イノベーション報告書は、AIが繁栄とイノベーションの約束を持つ一方で、グローバルな格差を悪化させるリスクも指摘しています。分散化は、AIをスケールアップしながらその基盤となるメカニズムに対する信頼を育む鍵となる可能性があります。AIを分散化することで、少数の選ばれた者だけでなく、すべての人に利益をもたらし、透明性と説明責任をその中心に保つことができます。

関連記事

"ドットAIコンパニオンアプリが閉鎖を発表、パーソナライズドサービスを中止"

個人的な友人や親友として機能するように設計されたAIコンパニオン・アプリケーションであるDotが、金曜日の開発者からの発表によると、運営を終了する。Dotを開発したスタートアップのNew Computer社は、10月5日までサービスを提供し、ユーザーが個人データをエクスポートできるようにするとウェブサイトで述べている。このアプリは、共同設立者であるサム・ホイットモアと元アップルのデザイン・スペシャ

"ドットAIコンパニオンアプリが閉鎖を発表、パーソナライズドサービスを中止"

個人的な友人や親友として機能するように設計されたAIコンパニオン・アプリケーションであるDotが、金曜日の開発者からの発表によると、運営を終了する。Dotを開発したスタートアップのNew Computer社は、10月5日までサービスを提供し、ユーザーが個人データをエクスポートできるようにするとウェブサイトで述べている。このアプリは、共同設立者であるサム・ホイットモアと元アップルのデザイン・スペシャ

Anthropic、AIが作成した書籍の著作権侵害をめぐる訴訟を解決

Anthropic社は、米国の著作者との重要な著作権紛争で解決に達し、高額になる可能性のある裁判を回避する集団訴訟の和解案に合意した。今週火曜日に裁判所文書に提出されたこの合意は、AI企業が海賊版の文学作品を使ってクロードモデルを訓練したという申し立てに起因する。和解の詳細は非公開だが、この訴訟は作家のアンドレア・バーツ、チャールズ・グレイバー、カーク・ウォレス・ジョンソンの主張に端を発している。

Anthropic、AIが作成した書籍の著作権侵害をめぐる訴訟を解決

Anthropic社は、米国の著作者との重要な著作権紛争で解決に達し、高額になる可能性のある裁判を回避する集団訴訟の和解案に合意した。今週火曜日に裁判所文書に提出されたこの合意は、AI企業が海賊版の文学作品を使ってクロードモデルを訓練したという申し立てに起因する。和解の詳細は非公開だが、この訴訟は作家のアンドレア・バーツ、チャールズ・グレイバー、カーク・ウォレス・ジョンソンの主張に端を発している。

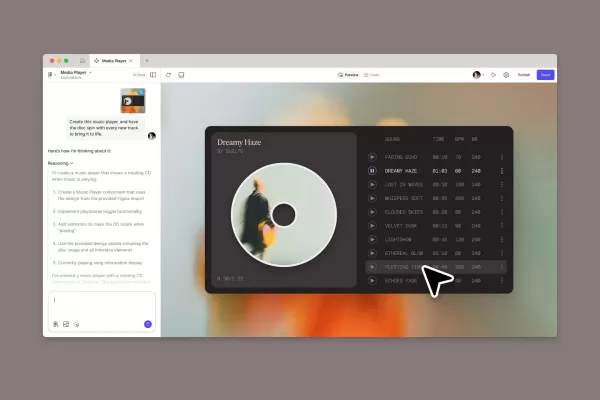

Figma、AIを搭載したアプリビルダー・ツールを全ユーザーに公開

今年初めに発表された革新的なプロンプト・トゥ・アプリ開発プラットフォームであるFigma Makeが、正式にベータ版を終了し、全ユーザーにロールアウトしました。この画期的なツールは、グーグルのジェミニ・コード・アシストやマイクロソフトのギットハブ・コパイロットのようなAIを搭載したコーディング・アシスタントの仲間入りをし、クリエイターが従来のプログラミングの専門知識がなくても、自然言語の記述を機能

コメント (14)

0/200

Figma、AIを搭載したアプリビルダー・ツールを全ユーザーに公開

今年初めに発表された革新的なプロンプト・トゥ・アプリ開発プラットフォームであるFigma Makeが、正式にベータ版を終了し、全ユーザーにロールアウトしました。この画期的なツールは、グーグルのジェミニ・コード・アシストやマイクロソフトのギットハブ・コパイロットのようなAIを搭載したコーディング・アシスタントの仲間入りをし、クリエイターが従来のプログラミングの専門知識がなくても、自然言語の記述を機能

コメント (14)

0/200

![JustinLewis]() JustinLewis

JustinLewis

2025年9月22日 15:30:37 JST

2025年9月22日 15:30:37 JST

Honestly I'm still skeptical about web3 fixing AI trust issues. Remember how everyone said blockchain would revolutionize everything? Feels like we're just slapping buzzwords together now 🤷♂️

0

0

![RobertSanchez]() RobertSanchez

RobertSanchez

2025年8月26日 14:59:22 JST

2025年8月26日 14:59:22 JST

AI's potential is huge, but Web3 giving it a trust boost? That's a game-changer! Excited to see how this plays out in markets. 🤖🚀

0

0

![PaulWilson]() PaulWilson

PaulWilson

2025年8月15日 22:00:59 JST

2025年8月15日 22:00:59 JST

AI and Web3 together sound like a sci-fi dream! 😎 But I wonder if this trust-building tech can really keep up with AI's wild growth. $4.8T by 2033? That's insane! Hope it doesn't outsmart us too fast.

0

0

![DanielLewis]() DanielLewis

DanielLewis

2025年8月9日 2:01:00 JST

2025年8月9日 2:01:00 JST

AI and Web3 together sound like a sci-fi dream! Exciting potential, but I wonder how we balance trust with all the ethical minefields. 🤔

0

0

![HenryTurner]() HenryTurner

HenryTurner

2025年4月25日 17:29:31 JST

2025年4月25日 17:29:31 JST

Tecnologia Web3 em AI? Parece legal, mas não tenho certeza se realmente aumenta a confiança. Quer dizer, AI é AI, certo? É interessante ver o potencial, mas sou cético quanto ao impacto real. Talvez seja só hype? 🤔 Vale a pena ficar de olho, no entanto!

0

0

![JoeLee]() JoeLee

JoeLee

2025年4月25日 17:13:40 JST

2025年4月25日 17:13:40 JST

¿Tecnología Web3 en IA? Suena genial, pero no estoy seguro de que realmente aumente la confianza. Quiero decir, la IA sigue siendo IA, ¿verdad? Es interesante ver el potencial, pero soy escéptico sobre el impacto real. ¿Quizás solo es hype? 🤔 ¡Vale la pena seguirle la pista, de todos modos!

0

0

AIの可能性と危険性

人工知能(AI)の魅力は、私たちの生活を簡素化する可能性にあり、利便性だけでなく、大きな経済的利益ももたらします。国連は、2033年までにAIが世界市場で4.8兆ドルの価値を持つと予測しており、これはドイツ経済の規模に匹敵する数字です。しかし、2033年まで待つ必要はありません。AIはすでに金融から医療、農業から電子商取引まで、さまざまな産業を変革しています。AIがあなたの投資を管理したり、早期疾患検出を支援したりするなど、AIが私たちの日常生活に与える影響は否定できません。

それでも、*ターミネーター2*のような映画によって描かれるディストピア的なイメージが、AIに対する懐疑的な見方を助長しています。これにより、重要な疑問が生じます。AIが私たちの生活にさらに深く統合される中で、どのように信頼を築けばよいのでしょうか?

AIにおける信頼のギャップへの対応

AIに対する信頼の重要性は非常に高いものです。Camundaの最近のレポートによると、驚くべきことに84%の組織が、AIアプリケーションの透明性の欠如が規制遵守の問題につながっていると指摘しています。アルゴリズムが不透明であったり、情報を隠している可能性がある場合、ユーザーは暗闇に取り残されます。システム的な偏見、未検証のシステム、一貫性のない規制が重なると、広範な不信感を引き起こす完璧な嵐が形成されます。

透明性:AIに光を当てる

AIアルゴリズムは、その力にもかかわらず、しばしばブラックボックスであり、ユーザーはどのように決定が下されているのか全く分からないままです。あなたのローンの申請が拒否されたのは、信用スコアのせいなのか、それとも隠れた偏見によるものなのか?透明性がなければ、AIはユーザーが気づかないうちに所有者の利益を優先して動作し、ユーザーはAIが自分の最善の利益のために動いていると信じてしまいます。

解決策の一つは、ブロックチェーン技術を活用してアルゴリズムを検証可能かつ監査可能にすることです。ここでWeb3技術が登場します。Microsoftが支援するSpace and Time(SxT)のようなスタートアップがこのアプローチを先導しています。SxTは、改ざん防止のデータフィードと検証可能な計算レイヤーを提供し、AIが依存するデータが本物で正確であり、単一の主体による操作がないことを保証します。彼らの革新的なProof of SQLプローバーは、改ざんされていないデータに対してクエリが正確に計算されることを保証し、現在の最先端技術よりも高速な検証を提供します。

AIにおける信頼の構築と維持

AIに対する信頼は、一度確立すれば終わりというものではなく、ミシュランの星を維持しようとするレストランのように、継続的に獲得し続ける必要があります。医療や自動運転のような高リスクの分野では、AIシステムのパフォーマンスと安全性について継続的な評価が必要です。誤った薬を処方するAIや事故を引き起こすAIは、単なる不具合ではなく、災害です。

オープンソースモデルや、ゼロ知識証明(ZKPs)などの暗号技術を活用した不変の台帳を使用したオンチェーン検証は、この信頼を築く方法を提供します。しかし、ユーザーがAIの能力と限界を理解し、現実的な期待を設定することも重要です。ユーザーがAIを絶対に正しいと信じると、誤った出力に信頼を置く可能性が高くなります。

AIに関する議論はこれまでその危険性に焦点を当てがちでしたが、AIが何ができ、何ができないかをユーザーに教育し、搾取されやすい状態に置くのではなく、力を与える方向へと会話をシフトする時期が来ています。

コンプライアンスと説明責任の確保

暗号通貨と同様に、AIも法的および規制基準を遵守する必要があります。顔の見えないアルゴリズムにどのように責任を負わせるかという問題は急務です。一つの答えは、モジュラーブロックチェーンプロトコルであるCartesiに見られるかもしれません。Cartesiは、AI推論をオンチェーンで実行できるようにします。Cartesiの仮想マシンは、開発者が標準的なAIライブラリを分散環境で実行できるようにし、ブロックチェーンの透明性とAI計算を融合させます。

信頼への道としての分散化

国連の技術・イノベーション報告書は、AIが繁栄とイノベーションの約束を持つ一方で、グローバルな格差を悪化させるリスクも指摘しています。分散化は、AIをスケールアップしながらその基盤となるメカニズムに対する信頼を育む鍵となる可能性があります。AIを分散化することで、少数の選ばれた者だけでなく、すべての人に利益をもたらし、透明性と説明責任をその中心に保つことができます。

Anthropic、AIが作成した書籍の著作権侵害をめぐる訴訟を解決

Anthropic社は、米国の著作者との重要な著作権紛争で解決に達し、高額になる可能性のある裁判を回避する集団訴訟の和解案に合意した。今週火曜日に裁判所文書に提出されたこの合意は、AI企業が海賊版の文学作品を使ってクロードモデルを訓練したという申し立てに起因する。和解の詳細は非公開だが、この訴訟は作家のアンドレア・バーツ、チャールズ・グレイバー、カーク・ウォレス・ジョンソンの主張に端を発している。

Anthropic、AIが作成した書籍の著作権侵害をめぐる訴訟を解決

Anthropic社は、米国の著作者との重要な著作権紛争で解決に達し、高額になる可能性のある裁判を回避する集団訴訟の和解案に合意した。今週火曜日に裁判所文書に提出されたこの合意は、AI企業が海賊版の文学作品を使ってクロードモデルを訓練したという申し立てに起因する。和解の詳細は非公開だが、この訴訟は作家のアンドレア・バーツ、チャールズ・グレイバー、カーク・ウォレス・ジョンソンの主張に端を発している。

Figma、AIを搭載したアプリビルダー・ツールを全ユーザーに公開

今年初めに発表された革新的なプロンプト・トゥ・アプリ開発プラットフォームであるFigma Makeが、正式にベータ版を終了し、全ユーザーにロールアウトしました。この画期的なツールは、グーグルのジェミニ・コード・アシストやマイクロソフトのギットハブ・コパイロットのようなAIを搭載したコーディング・アシスタントの仲間入りをし、クリエイターが従来のプログラミングの専門知識がなくても、自然言語の記述を機能

Figma、AIを搭載したアプリビルダー・ツールを全ユーザーに公開

今年初めに発表された革新的なプロンプト・トゥ・アプリ開発プラットフォームであるFigma Makeが、正式にベータ版を終了し、全ユーザーにロールアウトしました。この画期的なツールは、グーグルのジェミニ・コード・アシストやマイクロソフトのギットハブ・コパイロットのようなAIを搭載したコーディング・アシスタントの仲間入りをし、クリエイターが従来のプログラミングの専門知識がなくても、自然言語の記述を機能

2025年9月22日 15:30:37 JST

2025年9月22日 15:30:37 JST

Honestly I'm still skeptical about web3 fixing AI trust issues. Remember how everyone said blockchain would revolutionize everything? Feels like we're just slapping buzzwords together now 🤷♂️

0

0

2025年8月26日 14:59:22 JST

2025年8月26日 14:59:22 JST

AI's potential is huge, but Web3 giving it a trust boost? That's a game-changer! Excited to see how this plays out in markets. 🤖🚀

0

0

2025年8月15日 22:00:59 JST

2025年8月15日 22:00:59 JST

AI and Web3 together sound like a sci-fi dream! 😎 But I wonder if this trust-building tech can really keep up with AI's wild growth. $4.8T by 2033? That's insane! Hope it doesn't outsmart us too fast.

0

0

2025年8月9日 2:01:00 JST

2025年8月9日 2:01:00 JST

AI and Web3 together sound like a sci-fi dream! Exciting potential, but I wonder how we balance trust with all the ethical minefields. 🤔

0

0

2025年4月25日 17:29:31 JST

2025年4月25日 17:29:31 JST

Tecnologia Web3 em AI? Parece legal, mas não tenho certeza se realmente aumenta a confiança. Quer dizer, AI é AI, certo? É interessante ver o potencial, mas sou cético quanto ao impacto real. Talvez seja só hype? 🤔 Vale a pena ficar de olho, no entanto!

0

0

2025年4月25日 17:13:40 JST

2025年4月25日 17:13:40 JST

¿Tecnología Web3 en IA? Suena genial, pero no estoy seguro de que realmente aumente la confianza. Quiero decir, la IA sigue siendo IA, ¿verdad? Es interesante ver el potencial, pero soy escéptico sobre el impacto real. ¿Quizás solo es hype? 🤔 ¡Vale la pena seguirle la pista, de todos modos!

0

0