Web3 Tech hilft Vertrauen und Vertrauen in die KI

Das Potenzial und die Gefahren von KI

Der Reiz der künstlichen Intelligenz (KI) liegt in ihrem Potenzial, unser Leben zu vereinfachen und nicht nur Bequemlichkeit, sondern auch erhebliche wirtschaftliche Vorteile zu bringen. Die Vereinten Nationen prognostizieren, dass KI bis 2033 einen globalen Markt von 4,8 Billionen US-Dollar erreichen könnte, eine Zahl, die mit der Größe der deutschen Wirtschaft vergleichbar ist. Aber man muss nicht bis 2033 warten, um KI in Aktion zu sehen; sie verändert bereits Industrien von Finanzen über Gesundheitswesen bis hin zu Landwirtschaft und E-Commerce. Ob KI Ihre Investitionen verwaltet oder bei der Früherkennung von Krankheiten hilft, der Einfluss von KI auf unser tägliches Leben ist unbestreitbar.

Dennoch wächst die Skepsis gegenüber KI, angefacht durch Filme wie *Terminator 2*, die ein dystopisches Bild zeichnen. Dies wirft eine entscheidende Frage auf: Wie können wir Vertrauen aufbauen, während KI immer stärker in unser Leben integriert wird?

Den Vertrauensunterschied in KI überbrücken

Die Anforderungen an das Vertrauen in KI sind hoch. Laut einem aktuellen Bericht von Camunda führen beeindruckende 84 % der Organisationen ihre Probleme mit der Einhaltung von Vorschriften auf einen Mangel an Transparenz in KI-Anwendungen zurück. Wenn Algorithmen undurchsichtig sind oder möglicherweise Informationen verbergen, bleiben die Nutzer im Dunkeln. Kombiniert man dies mit systemischen Vorurteilen, ungetesteten Systemen und uneinheitlichen Vorschriften, entsteht ein perfekter Sturm für weitverbreitetes Misstrauen.

Transparenz: Licht ins KI-Dunkel bringen

KI-Algorithmen bleiben trotz ihrer Leistungsfähigkeit oft eine Blackbox, sodass Nutzer keine Ahnung haben, wie Entscheidungen getroffen werden. Wird Ihr Kreditantrag aufgrund Ihrer Bonität abgelehnt oder aufgrund einer zugrunde liegenden Voreingenommenheit? Ohne Transparenz kann KI im Interesse ihres Eigentümers agieren, während die Nutzer unwissend bleiben und glauben, die KI handle in ihrem besten Interesse.

Eine mögliche Lösung liegt in der Nutzung von Blockchain-Technologie, um Algorithmen überprüfbar und auditierbar zu machen. Hier kommt die Web3-Technologie ins Spiel. Startups wie Space and Time (SxT), unterstützt von Microsoft, gehen diesen Weg. SxT bietet manipulationssichere Datenfeeds mit einer überprüfbaren Rechenschicht, die sicherstellt, dass die von KI genutzten Daten echt, genau und frei von Manipulationen durch eine einzelne Entität sind. Ihr innovativer Proof of SQL-Prover stellt sicher, dass Abfragen präzise gegen unverfälschte Daten berechnet werden und bietet eine schnellere Verifikation als aktuelle Spitzentechnologien.

Vertrauen in KI aufbauen und erhalten

Vertrauen in KI kann nicht einmalig hergestellt und dann vergessen werden; es muss kontinuierlich verdient werden, ähnlich wie ein Restaurant, das seinen Michelin-Stern behalten möchte. In hochsensiblen Bereichen wie Gesundheitswesen oder autonomem Fahren benötigen KI-Systeme eine fortlaufende Bewertung hinsichtlich Leistung und Sicherheit. Eine fehlerhafte KI, die falsche Medikamente verschreibt oder einen Unfall verursacht, ist nicht nur ein Fehler – es ist eine Katastrophe.

Open-Source-Modelle und On-Chain-Verifikation mit unveränderlichen Ledgern, unterstützt durch kryptografische Techniken wie Zero-Knowledge Proofs (ZKPs), bieten eine Möglichkeit, dieses Vertrauen aufzubauen. Es ist jedoch auch entscheidend, dass Nutzer die Fähigkeiten und Grenzen von KI verstehen, um realistische Erwartungen zu setzen. Wenn Nutzer glauben, KI sei unfehlbar, vertrauen sie eher fehlerhaften Ergebnissen.

Während die Narrative um KI oft ihre Gefahren betont hat, ist es an der Zeit, die Diskussion darauf zu verlagern, Nutzer über das zu informieren, was KI kann und nicht kann, um sie zu stärken, anstatt sie der Ausbeutung auszusetzen.

Einhaltung und Verantwortlichkeit sicherstellen

Genau wie Kryptowährungen muss KI gesetzlichen und regulatorischen Standards entsprechen. Die Frage, wie man einen gesichtslosen Algorithmus zur Verantwortung ziehen kann, ist dringlich. Eine Antwort könnte im modularen Blockchain-Protokoll Cartesi liegen, das KI-Inferenz On-Chain ermöglicht. Cartesis virtuelle Maschine erlaubt Entwicklern, standardisierte KI-Bibliotheken in einer dezentralisierten Umgebung auszuführen und verbindet Blockchain-Transparenz mit KI-Berechnung.

Dezentralisierung als Weg zum Vertrauen

Der Technologie- und Innovationsbericht der Vereinten Nationen hebt hervor, dass KI zwar das Versprechen von Wohlstand und Innovation birgt, aber auch das Risiko birgt, globale Unterschiede zu verschärfen. Dezentralisierung könnte der Schlüssel sein, um KI zu skalieren und gleichzeitig Vertrauen in ihre zugrunde liegenden Mechanismen zu fördern. Durch die Dezentralisierung von KI können wir sicherstellen, dass sie allen zugutekommt, nicht nur wenigen Auserwählten, und Transparenz sowie Verantwortlichkeit im Kern bewahrt.

Verwandter Artikel

"Dot AI Companion App kündigt Schließung an, stellt personalisierten Service ein"

Dot, eine KI-Begleitanwendung, die als persönlicher Freund und Vertrauter fungieren soll, wird laut einer Ankündigung seiner Entwickler vom Freitag seinen Betrieb einstellen. New Computer, das Startup

"Dot AI Companion App kündigt Schließung an, stellt personalisierten Service ein"

Dot, eine KI-Begleitanwendung, die als persönlicher Freund und Vertrauter fungieren soll, wird laut einer Ankündigung seiner Entwickler vom Freitag seinen Betrieb einstellen. New Computer, das Startup

Anthropic löst Rechtsstreit über AI-generierte Buchpiraterie

Anthropic hat einen bedeutenden Urheberrechtsstreit mit US-Autoren beigelegt. Das Unternehmen hat einer vorgeschlagenen Sammelklage zugestimmt, mit der ein potenziell kostspieliger Prozess vermieden w

Anthropic löst Rechtsstreit über AI-generierte Buchpiraterie

Anthropic hat einen bedeutenden Urheberrechtsstreit mit US-Autoren beigelegt. Das Unternehmen hat einer vorgeschlagenen Sammelklage zugestimmt, mit der ein potenziell kostspieliger Prozess vermieden w

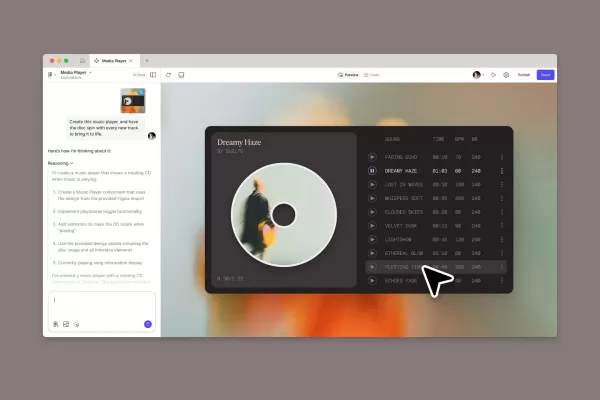

Figma veröffentlicht AI-gestütztes App Builder Tool für alle Benutzer

Figma Make, die innovative Prompt-to-App-Entwicklungsplattform, die Anfang des Jahres vorgestellt wurde, hat offiziell die Beta-Phase verlassen und ist für alle Nutzer verfügbar. Dieses bahnbrechende

Kommentare (14)

0/200

Figma veröffentlicht AI-gestütztes App Builder Tool für alle Benutzer

Figma Make, die innovative Prompt-to-App-Entwicklungsplattform, die Anfang des Jahres vorgestellt wurde, hat offiziell die Beta-Phase verlassen und ist für alle Nutzer verfügbar. Dieses bahnbrechende

Kommentare (14)

0/200

![JustinLewis]() JustinLewis

JustinLewis

22. September 2025 08:30:37 MESZ

22. September 2025 08:30:37 MESZ

Honestly I'm still skeptical about web3 fixing AI trust issues. Remember how everyone said blockchain would revolutionize everything? Feels like we're just slapping buzzwords together now 🤷♂️

0

0

![RobertSanchez]() RobertSanchez

RobertSanchez

26. August 2025 07:59:22 MESZ

26. August 2025 07:59:22 MESZ

AI's potential is huge, but Web3 giving it a trust boost? That's a game-changer! Excited to see how this plays out in markets. 🤖🚀

0

0

![PaulWilson]() PaulWilson

PaulWilson

15. August 2025 15:00:59 MESZ

15. August 2025 15:00:59 MESZ

AI and Web3 together sound like a sci-fi dream! 😎 But I wonder if this trust-building tech can really keep up with AI's wild growth. $4.8T by 2033? That's insane! Hope it doesn't outsmart us too fast.

0

0

![DanielLewis]() DanielLewis

DanielLewis

8. August 2025 19:01:00 MESZ

8. August 2025 19:01:00 MESZ

AI and Web3 together sound like a sci-fi dream! Exciting potential, but I wonder how we balance trust with all the ethical minefields. 🤔

0

0

![HenryTurner]() HenryTurner

HenryTurner

25. April 2025 10:29:31 MESZ

25. April 2025 10:29:31 MESZ

Tecnologia Web3 em AI? Parece legal, mas não tenho certeza se realmente aumenta a confiança. Quer dizer, AI é AI, certo? É interessante ver o potencial, mas sou cético quanto ao impacto real. Talvez seja só hype? 🤔 Vale a pena ficar de olho, no entanto!

0

0

![JoeLee]() JoeLee

JoeLee

25. April 2025 10:13:40 MESZ

25. April 2025 10:13:40 MESZ

¿Tecnología Web3 en IA? Suena genial, pero no estoy seguro de que realmente aumente la confianza. Quiero decir, la IA sigue siendo IA, ¿verdad? Es interesante ver el potencial, pero soy escéptico sobre el impacto real. ¿Quizás solo es hype? 🤔 ¡Vale la pena seguirle la pista, de todos modos!

0

0

Das Potenzial und die Gefahren von KI

Der Reiz der künstlichen Intelligenz (KI) liegt in ihrem Potenzial, unser Leben zu vereinfachen und nicht nur Bequemlichkeit, sondern auch erhebliche wirtschaftliche Vorteile zu bringen. Die Vereinten Nationen prognostizieren, dass KI bis 2033 einen globalen Markt von 4,8 Billionen US-Dollar erreichen könnte, eine Zahl, die mit der Größe der deutschen Wirtschaft vergleichbar ist. Aber man muss nicht bis 2033 warten, um KI in Aktion zu sehen; sie verändert bereits Industrien von Finanzen über Gesundheitswesen bis hin zu Landwirtschaft und E-Commerce. Ob KI Ihre Investitionen verwaltet oder bei der Früherkennung von Krankheiten hilft, der Einfluss von KI auf unser tägliches Leben ist unbestreitbar.

Dennoch wächst die Skepsis gegenüber KI, angefacht durch Filme wie *Terminator 2*, die ein dystopisches Bild zeichnen. Dies wirft eine entscheidende Frage auf: Wie können wir Vertrauen aufbauen, während KI immer stärker in unser Leben integriert wird?

Den Vertrauensunterschied in KI überbrücken

Die Anforderungen an das Vertrauen in KI sind hoch. Laut einem aktuellen Bericht von Camunda führen beeindruckende 84 % der Organisationen ihre Probleme mit der Einhaltung von Vorschriften auf einen Mangel an Transparenz in KI-Anwendungen zurück. Wenn Algorithmen undurchsichtig sind oder möglicherweise Informationen verbergen, bleiben die Nutzer im Dunkeln. Kombiniert man dies mit systemischen Vorurteilen, ungetesteten Systemen und uneinheitlichen Vorschriften, entsteht ein perfekter Sturm für weitverbreitetes Misstrauen.

Transparenz: Licht ins KI-Dunkel bringen

KI-Algorithmen bleiben trotz ihrer Leistungsfähigkeit oft eine Blackbox, sodass Nutzer keine Ahnung haben, wie Entscheidungen getroffen werden. Wird Ihr Kreditantrag aufgrund Ihrer Bonität abgelehnt oder aufgrund einer zugrunde liegenden Voreingenommenheit? Ohne Transparenz kann KI im Interesse ihres Eigentümers agieren, während die Nutzer unwissend bleiben und glauben, die KI handle in ihrem besten Interesse.

Eine mögliche Lösung liegt in der Nutzung von Blockchain-Technologie, um Algorithmen überprüfbar und auditierbar zu machen. Hier kommt die Web3-Technologie ins Spiel. Startups wie Space and Time (SxT), unterstützt von Microsoft, gehen diesen Weg. SxT bietet manipulationssichere Datenfeeds mit einer überprüfbaren Rechenschicht, die sicherstellt, dass die von KI genutzten Daten echt, genau und frei von Manipulationen durch eine einzelne Entität sind. Ihr innovativer Proof of SQL-Prover stellt sicher, dass Abfragen präzise gegen unverfälschte Daten berechnet werden und bietet eine schnellere Verifikation als aktuelle Spitzentechnologien.

Vertrauen in KI aufbauen und erhalten

Vertrauen in KI kann nicht einmalig hergestellt und dann vergessen werden; es muss kontinuierlich verdient werden, ähnlich wie ein Restaurant, das seinen Michelin-Stern behalten möchte. In hochsensiblen Bereichen wie Gesundheitswesen oder autonomem Fahren benötigen KI-Systeme eine fortlaufende Bewertung hinsichtlich Leistung und Sicherheit. Eine fehlerhafte KI, die falsche Medikamente verschreibt oder einen Unfall verursacht, ist nicht nur ein Fehler – es ist eine Katastrophe.

Open-Source-Modelle und On-Chain-Verifikation mit unveränderlichen Ledgern, unterstützt durch kryptografische Techniken wie Zero-Knowledge Proofs (ZKPs), bieten eine Möglichkeit, dieses Vertrauen aufzubauen. Es ist jedoch auch entscheidend, dass Nutzer die Fähigkeiten und Grenzen von KI verstehen, um realistische Erwartungen zu setzen. Wenn Nutzer glauben, KI sei unfehlbar, vertrauen sie eher fehlerhaften Ergebnissen.

Während die Narrative um KI oft ihre Gefahren betont hat, ist es an der Zeit, die Diskussion darauf zu verlagern, Nutzer über das zu informieren, was KI kann und nicht kann, um sie zu stärken, anstatt sie der Ausbeutung auszusetzen.

Einhaltung und Verantwortlichkeit sicherstellen

Genau wie Kryptowährungen muss KI gesetzlichen und regulatorischen Standards entsprechen. Die Frage, wie man einen gesichtslosen Algorithmus zur Verantwortung ziehen kann, ist dringlich. Eine Antwort könnte im modularen Blockchain-Protokoll Cartesi liegen, das KI-Inferenz On-Chain ermöglicht. Cartesis virtuelle Maschine erlaubt Entwicklern, standardisierte KI-Bibliotheken in einer dezentralisierten Umgebung auszuführen und verbindet Blockchain-Transparenz mit KI-Berechnung.

Dezentralisierung als Weg zum Vertrauen

Der Technologie- und Innovationsbericht der Vereinten Nationen hebt hervor, dass KI zwar das Versprechen von Wohlstand und Innovation birgt, aber auch das Risiko birgt, globale Unterschiede zu verschärfen. Dezentralisierung könnte der Schlüssel sein, um KI zu skalieren und gleichzeitig Vertrauen in ihre zugrunde liegenden Mechanismen zu fördern. Durch die Dezentralisierung von KI können wir sicherstellen, dass sie allen zugutekommt, nicht nur wenigen Auserwählten, und Transparenz sowie Verantwortlichkeit im Kern bewahrt.

Anthropic löst Rechtsstreit über AI-generierte Buchpiraterie

Anthropic hat einen bedeutenden Urheberrechtsstreit mit US-Autoren beigelegt. Das Unternehmen hat einer vorgeschlagenen Sammelklage zugestimmt, mit der ein potenziell kostspieliger Prozess vermieden w

Anthropic löst Rechtsstreit über AI-generierte Buchpiraterie

Anthropic hat einen bedeutenden Urheberrechtsstreit mit US-Autoren beigelegt. Das Unternehmen hat einer vorgeschlagenen Sammelklage zugestimmt, mit der ein potenziell kostspieliger Prozess vermieden w

Figma veröffentlicht AI-gestütztes App Builder Tool für alle Benutzer

Figma Make, die innovative Prompt-to-App-Entwicklungsplattform, die Anfang des Jahres vorgestellt wurde, hat offiziell die Beta-Phase verlassen und ist für alle Nutzer verfügbar. Dieses bahnbrechende

Figma veröffentlicht AI-gestütztes App Builder Tool für alle Benutzer

Figma Make, die innovative Prompt-to-App-Entwicklungsplattform, die Anfang des Jahres vorgestellt wurde, hat offiziell die Beta-Phase verlassen und ist für alle Nutzer verfügbar. Dieses bahnbrechende

22. September 2025 08:30:37 MESZ

22. September 2025 08:30:37 MESZ

Honestly I'm still skeptical about web3 fixing AI trust issues. Remember how everyone said blockchain would revolutionize everything? Feels like we're just slapping buzzwords together now 🤷♂️

0

0

26. August 2025 07:59:22 MESZ

26. August 2025 07:59:22 MESZ

AI's potential is huge, but Web3 giving it a trust boost? That's a game-changer! Excited to see how this plays out in markets. 🤖🚀

0

0

15. August 2025 15:00:59 MESZ

15. August 2025 15:00:59 MESZ

AI and Web3 together sound like a sci-fi dream! 😎 But I wonder if this trust-building tech can really keep up with AI's wild growth. $4.8T by 2033? That's insane! Hope it doesn't outsmart us too fast.

0

0

8. August 2025 19:01:00 MESZ

8. August 2025 19:01:00 MESZ

AI and Web3 together sound like a sci-fi dream! Exciting potential, but I wonder how we balance trust with all the ethical minefields. 🤔

0

0

25. April 2025 10:29:31 MESZ

25. April 2025 10:29:31 MESZ

Tecnologia Web3 em AI? Parece legal, mas não tenho certeza se realmente aumenta a confiança. Quer dizer, AI é AI, certo? É interessante ver o potencial, mas sou cético quanto ao impacto real. Talvez seja só hype? 🤔 Vale a pena ficar de olho, no entanto!

0

0

25. April 2025 10:13:40 MESZ

25. April 2025 10:13:40 MESZ

¿Tecnología Web3 en IA? Suena genial, pero no estoy seguro de que realmente aumente la confianza. Quiero decir, la IA sigue siendo IA, ¿verdad? Es interesante ver el potencial, pero soy escéptico sobre el impacto real. ¿Quizás solo es hype? 🤔 ¡Vale la pena seguirle la pista, de todos modos!

0

0