Các nhà xuất bản lớn kêu gọi Chính phủ Hoa Kỳ ngăn chặn hành vi đánh cắp nội dung AI

Các nhà xuất bản lớn khởi động chiến dịch yêu cầu trách nhiệm giải trình của AI

Hàng trăm tổ chức tin tức—bao gồm The New York Times, The Washington Post, The Guardian, và công ty mẹ của The Verge, Vox Media—đang cùng nhau hợp sức trong tuần này trong một chiến dịch quảng cáo táo bạo nhằm thúc đẩy các nhà lập pháp điều chỉnh việc sử dụng nội dung có bản quyền của AI.

Được gọi là "Hỗ trợ AI có trách nhiệm," sáng kiến này, do Liên minh Tin tức/Truyền thông dẫn đầu, có các quảng cáo in ấn và kỹ thuật số ấn tượng với các khẩu hiệu như:

- "Giám sát AI"

- "Ngăn chặn hành vi đánh cắp của AI"

- "AI cũng đánh cắp từ bạn"

Ở phần cuối, một lời kêu gọi hành động rõ ràng: "Đánh cắp là không phải phong cách Mỹ. Hãy yêu cầu Washington buộc Big Tech trả tiền cho nội dung họ lấy."

Thời điểm này không phải ngẫu nhiên. Chỉ vài tuần trước, OpenAI và Google đã gửi thư đến chính phủ lập luận rằng các mô hình AI nên được phép đào tạo trên tài liệu có bản quyền. Giờ đây, các nhà xuất bản đang phản pháo—yêu cầu bồi thường công bằng và bảo vệ pháp lý.

Một số quảng cáo trong chiến dịch Hỗ trợ AI có trách nhiệm. Hình ảnh: Liên minh Tin tức/Truyền thôngĐiều gì đang bị đe dọa?

Mỗi quảng cáo hướng người đọc đến trang web Hỗ trợ AI có trách nhiệm, nơi họ được khuyến khích liên hệ với các đại diện của mình. Các yêu cầu chính của chiến dịch bao gồm:

- Bồi thường cho người sáng tạo – Đảm bảo Big Tech trả tiền cho các nhà báo, nhà văn và nghệ sĩ vì công việc của họ.

- Ghi nhận nguồn trong nội dung do AI tạo ra – Yêu cầu các công ty AI ghi nhận nguồn gốc ban đầu.

Danielle Coffey, Chủ tịch và CEO của Liên minh Tin tức/Truyền thông, nói thẳng thắn:

"Big Tech và các công ty AI đang sử dụng nội dung của các nhà xuất bản để chống lại chính họ—lấy nội dung mà không có sự cho phép hoặc thanh toán để cung cấp năng lượng cho các sản phẩm AI, làm giảm doanh thu quảng cáo và đăng ký từ những người sáng tạo gốc. Chúng tôi không chống lại AI; nhiều người trong chúng tôi sử dụng các công cụ này. Nhưng chúng tôi cần một hệ thống công bằng nơi AI được phát triển một cách có trách nhiệm."

Một phong trào ngày càng lớn

Đây không phải lần đầu tiên các nhà xuất bản phản kháng. Vào tháng Hai, các tờ báo Anh đã khởi động một chiến dịch tương tự, đăng tải trên trang nhất với khẩu hiệu "HÃY CÔNG BẰNG" để phản đối việc AI sử dụng nội dung có bản quyền một cách không kiểm soát.

Các bên tham gia lớn khác trong nỗ lực Hỗ trợ AI có trách nhiệm bao gồm:

- The Atlantic

- Seattle Times

- Tampa Bay Times

- Wired (Condé Nast)

- Politico (Axel Springer)

Khi AI tiếp tục định hình lại ngành truyền thông, cuộc chiến về quyền sở hữu—và lợi nhuận từ—nội dung đang ngày càng nóng lên. Liệu các nhà lập pháp có lắng nghe? Các nhà xuất bản đang đặt cược lớn rằng áp lực từ công chúng sẽ buộc phải thay đổi.

Bạn nghĩ gì—liệu các công ty AI có nên trả tiền cho nội dung họ sử dụng để đào tạo? Hãy cho chúng tôi biết trong phần bình luận.

Bài viết liên quan

2025년 4월 최고의 AI 채용 도구 9개

2024년 채용을 혁신하는 최고의 AI 채용 도구 10개인공지능은 채용 방식을 뒤바꾸고 있습니다—그럴 만한 이유가 있죠. 이력서 더미와 끝없는 인터뷰 일정에 허덕이는 기업들은 채용 시간을 단축하고, 편견을 없애며, 최고의 후보자를 발굴하는 AI 기반 솔루션으로 눈을 돌리고 있습니다. 자동화된 스크리닝부터 스마트 인터뷰 어시스턴트까지, 이 도구들은 인재 채용

2025년 4월 최고의 AI 채용 도구 9개

2024년 채용을 혁신하는 최고의 AI 채용 도구 10개인공지능은 채용 방식을 뒤바꾸고 있습니다—그럴 만한 이유가 있죠. 이력서 더미와 끝없는 인터뷰 일정에 허덕이는 기업들은 채용 시간을 단축하고, 편견을 없애며, 최고의 후보자를 발굴하는 AI 기반 솔루션으로 눈을 돌리고 있습니다. 자동화된 스크리닝부터 스마트 인터뷰 어시스턴트까지, 이 도구들은 인재 채용

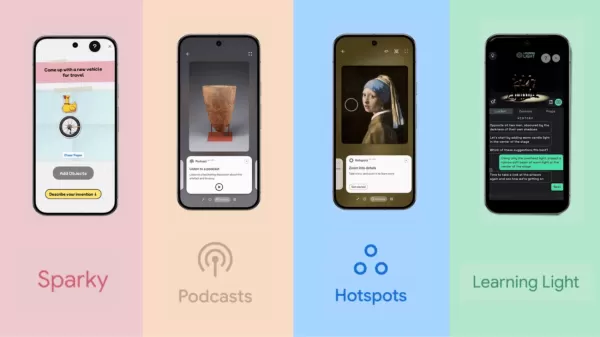

Google Arts & Culture의 새로운 AI 기반 실험

Google Arts & Culture의 AI 실험으로 새로운 방식으로 문화를 탐험하세요Google Arts & Culture에서는 엔지니어와 상주 예술가들이 협력하여 문화를 더 인터랙티브하고 교육적이며 즐겁게 만드는 AI 기반 경험을 창조합니다. 예술 애호가, 역사 매니아, 혹은 단순히 호기심이 많은 사람이라면, 이 최첨단 실험들은 신선하고 예상치 못한

Google Arts & Culture의 새로운 AI 기반 실험

Google Arts & Culture의 AI 실험으로 새로운 방식으로 문화를 탐험하세요Google Arts & Culture에서는 엔지니어와 상주 예술가들이 협력하여 문화를 더 인터랙티브하고 교육적이며 즐겁게 만드는 AI 기반 경험을 창조합니다. 예술 애호가, 역사 매니아, 혹은 단순히 호기심이 많은 사람이라면, 이 최첨단 실험들은 신선하고 예상치 못한

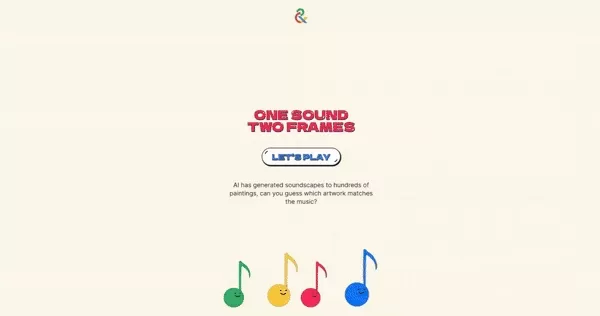

Google Arts & Culture 여름 영감을 위한 4가지 새로운 인터랙티브 게임 출시

이번 여름, 놀이로 예술과 문화를 새롭게 발견하세요이번 여름, 기술, 게임, 예술이 어우러진 네 가지 흥미로운 디지털 실험을 통해 문화를 더 쉽게 접하고 훨씬 더 재미있게 즐길 수 있습니다. Google Arts & Culture Lab의 상주 예술가들이 개발하고 Cleveland Museum of Art와 협력하여 만든 이 인터랙티브 경험은 예술을 새롭고

Nhận xét (0)

0/200

Google Arts & Culture 여름 영감을 위한 4가지 새로운 인터랙티브 게임 출시

이번 여름, 놀이로 예술과 문화를 새롭게 발견하세요이번 여름, 기술, 게임, 예술이 어우러진 네 가지 흥미로운 디지털 실험을 통해 문화를 더 쉽게 접하고 훨씬 더 재미있게 즐길 수 있습니다. Google Arts & Culture Lab의 상주 예술가들이 개발하고 Cleveland Museum of Art와 협력하여 만든 이 인터랙티브 경험은 예술을 새롭고

Nhận xét (0)

0/200

Các nhà xuất bản lớn khởi động chiến dịch yêu cầu trách nhiệm giải trình của AI

Hàng trăm tổ chức tin tức—bao gồm The New York Times, The Washington Post, The Guardian, và công ty mẹ của The Verge, Vox Media—đang cùng nhau hợp sức trong tuần này trong một chiến dịch quảng cáo táo bạo nhằm thúc đẩy các nhà lập pháp điều chỉnh việc sử dụng nội dung có bản quyền của AI.

Được gọi là "Hỗ trợ AI có trách nhiệm," sáng kiến này, do Liên minh Tin tức/Truyền thông dẫn đầu, có các quảng cáo in ấn và kỹ thuật số ấn tượng với các khẩu hiệu như:

- "Giám sát AI"

- "Ngăn chặn hành vi đánh cắp của AI"

- "AI cũng đánh cắp từ bạn"

Ở phần cuối, một lời kêu gọi hành động rõ ràng: "Đánh cắp là không phải phong cách Mỹ. Hãy yêu cầu Washington buộc Big Tech trả tiền cho nội dung họ lấy."

Thời điểm này không phải ngẫu nhiên. Chỉ vài tuần trước, OpenAI và Google đã gửi thư đến chính phủ lập luận rằng các mô hình AI nên được phép đào tạo trên tài liệu có bản quyền. Giờ đây, các nhà xuất bản đang phản pháo—yêu cầu bồi thường công bằng và bảo vệ pháp lý.

Điều gì đang bị đe dọa?

Mỗi quảng cáo hướng người đọc đến trang web Hỗ trợ AI có trách nhiệm, nơi họ được khuyến khích liên hệ với các đại diện của mình. Các yêu cầu chính của chiến dịch bao gồm:

- Bồi thường cho người sáng tạo – Đảm bảo Big Tech trả tiền cho các nhà báo, nhà văn và nghệ sĩ vì công việc của họ.

- Ghi nhận nguồn trong nội dung do AI tạo ra – Yêu cầu các công ty AI ghi nhận nguồn gốc ban đầu.

Danielle Coffey, Chủ tịch và CEO của Liên minh Tin tức/Truyền thông, nói thẳng thắn:

"Big Tech và các công ty AI đang sử dụng nội dung của các nhà xuất bản để chống lại chính họ—lấy nội dung mà không có sự cho phép hoặc thanh toán để cung cấp năng lượng cho các sản phẩm AI, làm giảm doanh thu quảng cáo và đăng ký từ những người sáng tạo gốc. Chúng tôi không chống lại AI; nhiều người trong chúng tôi sử dụng các công cụ này. Nhưng chúng tôi cần một hệ thống công bằng nơi AI được phát triển một cách có trách nhiệm."

Một phong trào ngày càng lớn

Đây không phải lần đầu tiên các nhà xuất bản phản kháng. Vào tháng Hai, các tờ báo Anh đã khởi động một chiến dịch tương tự, đăng tải trên trang nhất với khẩu hiệu "HÃY CÔNG BẰNG" để phản đối việc AI sử dụng nội dung có bản quyền một cách không kiểm soát.

Các bên tham gia lớn khác trong nỗ lực Hỗ trợ AI có trách nhiệm bao gồm:

- The Atlantic

- Seattle Times

- Tampa Bay Times

- Wired (Condé Nast)

- Politico (Axel Springer)

Khi AI tiếp tục định hình lại ngành truyền thông, cuộc chiến về quyền sở hữu—và lợi nhuận từ—nội dung đang ngày càng nóng lên. Liệu các nhà lập pháp có lắng nghe? Các nhà xuất bản đang đặt cược lớn rằng áp lực từ công chúng sẽ buộc phải thay đổi.

Bạn nghĩ gì—liệu các công ty AI có nên trả tiền cho nội dung họ sử dụng để đào tạo? Hãy cho chúng tôi biết trong phần bình luận.

2025년 4월 최고의 AI 채용 도구 9개

2024년 채용을 혁신하는 최고의 AI 채용 도구 10개인공지능은 채용 방식을 뒤바꾸고 있습니다—그럴 만한 이유가 있죠. 이력서 더미와 끝없는 인터뷰 일정에 허덕이는 기업들은 채용 시간을 단축하고, 편견을 없애며, 최고의 후보자를 발굴하는 AI 기반 솔루션으로 눈을 돌리고 있습니다. 자동화된 스크리닝부터 스마트 인터뷰 어시스턴트까지, 이 도구들은 인재 채용

2025년 4월 최고의 AI 채용 도구 9개

2024년 채용을 혁신하는 최고의 AI 채용 도구 10개인공지능은 채용 방식을 뒤바꾸고 있습니다—그럴 만한 이유가 있죠. 이력서 더미와 끝없는 인터뷰 일정에 허덕이는 기업들은 채용 시간을 단축하고, 편견을 없애며, 최고의 후보자를 발굴하는 AI 기반 솔루션으로 눈을 돌리고 있습니다. 자동화된 스크리닝부터 스마트 인터뷰 어시스턴트까지, 이 도구들은 인재 채용

Google Arts & Culture의 새로운 AI 기반 실험

Google Arts & Culture의 AI 실험으로 새로운 방식으로 문화를 탐험하세요Google Arts & Culture에서는 엔지니어와 상주 예술가들이 협력하여 문화를 더 인터랙티브하고 교육적이며 즐겁게 만드는 AI 기반 경험을 창조합니다. 예술 애호가, 역사 매니아, 혹은 단순히 호기심이 많은 사람이라면, 이 최첨단 실험들은 신선하고 예상치 못한

Google Arts & Culture의 새로운 AI 기반 실험

Google Arts & Culture의 AI 실험으로 새로운 방식으로 문화를 탐험하세요Google Arts & Culture에서는 엔지니어와 상주 예술가들이 협력하여 문화를 더 인터랙티브하고 교육적이며 즐겁게 만드는 AI 기반 경험을 창조합니다. 예술 애호가, 역사 매니아, 혹은 단순히 호기심이 많은 사람이라면, 이 최첨단 실험들은 신선하고 예상치 못한

Google Arts & Culture 여름 영감을 위한 4가지 새로운 인터랙티브 게임 출시

이번 여름, 놀이로 예술과 문화를 새롭게 발견하세요이번 여름, 기술, 게임, 예술이 어우러진 네 가지 흥미로운 디지털 실험을 통해 문화를 더 쉽게 접하고 훨씬 더 재미있게 즐길 수 있습니다. Google Arts & Culture Lab의 상주 예술가들이 개발하고 Cleveland Museum of Art와 협력하여 만든 이 인터랙티브 경험은 예술을 새롭고

Google Arts & Culture 여름 영감을 위한 4가지 새로운 인터랙티브 게임 출시

이번 여름, 놀이로 예술과 문화를 새롭게 발견하세요이번 여름, 기술, 게임, 예술이 어우러진 네 가지 흥미로운 디지털 실험을 통해 문화를 더 쉽게 접하고 훨씬 더 재미있게 즐길 수 있습니다. Google Arts & Culture Lab의 상주 예술가들이 개발하고 Cleveland Museum of Art와 협력하여 만든 이 인터랙티브 경험은 예술을 새롭고