OpenAI는 전사 및 음성 생성 AI 모델을 업그레이드합니다

OpenAI는 API를 통해 전사 및 음성 생성을 위한 새로운 AI 모델을 출시하고 있으며, 이전 버전에 비해 상당한 개선을 약속하고 있습니다. 이러한 업데이트는 사용자를 위해 독립적으로 작업을 수행할 수 있는 자율 시스템을 만드는 데 초점을 맞춘 OpenAI의 더 큰 "agentic" 비전의 일부입니다. "agent"라는 용어는 논쟁의 여지가 있을 수 있지만, OpenAI의 제품 책임자인 Olivier Godement는 이를 비즈니스 고객과 상호작용할 수 있는 챗봇으로 보고 있습니다.

"앞으로 몇 달 안에 점점 더 많은 에이전트가 등장할 것입니다,"라고 Godement는 TechCrunch와의 브리핑에서 공유했습니다. "전반적인 목표는 고객과 개발자가 유용하고 접근 가능하며 정확한 에이전트를 활용할 수 있도록 지원하는 것입니다."

OpenAI의 최신 텍스트-음성 변환 모델인 "gpt-4o-mini-tts"는 더 생생하고 미묘한 음성을 생성할 뿐만 아니라 이전 모델보다 더 적응력이 뛰어납니다. 이제 개발자는 "미친 과학자처럼 말해" 또는 "마음 챙김 교사처럼 차분한 목소리를 사용해"와 같은 자연어 명령을 통해 모델을 안내할 수 있습니다. 이러한 제어 수준은 더 개인화된 음성 경험을 가능하게 합니다.

다음은 "진범죄 스타일"의 거친 목소리 샘플입니다:

그리고 다음은 여성 "전문가" 목소리의 예입니다:

OpenAI의 제품 팀원인 Jeff Harris는 TechCrunch에 개발자가 음성 "경험"과 "맥락"을 모두 사용자 정의할 수 있도록 하는 것이 목표라고 강조했습니다. "다양한 시나리오에서 단조로운 목소리를 원하지 않습니다,"라고 Harris는 설명했습니다. "예를 들어, 고객 지원 환경에서 실수에 대해 사과하는 목소리가 필요할 때, 그 감정을 목소리에 주입할 수 있습니다. 우리는 개발자와 사용자가 콘텐츠뿐만 아니라 말하는 방식도 제어하고 싶어한다고 강하게 믿습니다."

OpenAI의 새로운 음성-텍스트 변환 제공물인 "gpt-4o-transcribe"와 "gpt-4o-mini-transcribe"는 구형 Whisper 전사 모델을 대체할 예정입니다. 다양한 고품질 오디오 데이터로 훈련된 이 모델들은 억양이 있거나 다양한 음성을 더 잘 처리하며, 소음이 많은 환경에서도 더 나은 성능을 보입니다. 또한, 이 모델들은 Whisper가 때때로 단어나 전체 구절을 만들어내어 인종적 논평이나 가상의 의료 치료와 같은 부정확성을 전사에 추가하는 "환각" 문제에 덜 취약합니다.

"이 모델들은 이 점에서 Whisper에 비해 상당한 개선을 보입니다,"라고 Harris는 언급했습니다. "모델의 정확성을 보장하는 것은 신뢰할 수 있는 음성 경험에 매우 중요하며, 정확성이란 모델이 말하지 않은 콘텐츠를 추가하지 않고 발화된 단어를 정확히 포착하는 것을 의미합니다."

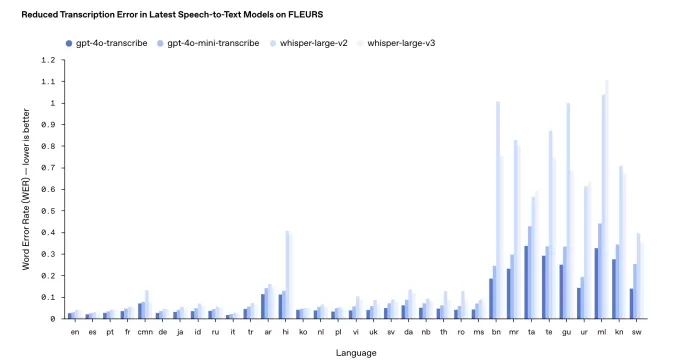

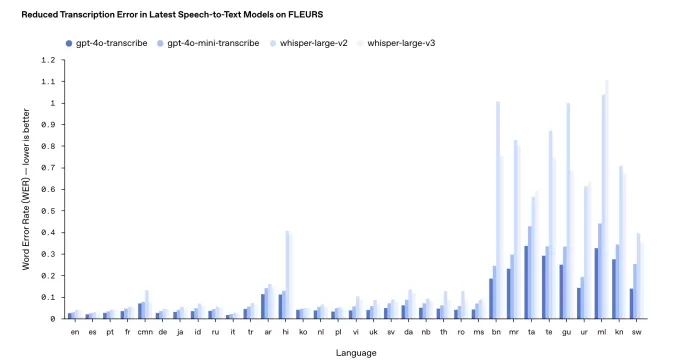

그러나 언어별로 성능이 다를 수 있습니다. OpenAI의 내부 벤치마크에 따르면, 두 모델 중 더 정확한 gpt-4o-transcribe는 타밀어, 텔루구어, 말라얄람어, 칸나다어와 같은 인도 및 드라비다 언어에 대해 "단어 오류율"이 약 30%에 달합니다. 이는 이 언어들에서 10개의 단어 중 약 3개가 인간 전사와 다를 수 있음을 나타냅니다.

OpenAI 전사 벤치마킹 결과. 이미지 제공: OpenAI OpenAI는 평소와 달리 이 새로운 전사 모델들을 무료로 제공하지 않을 것입니다. 과거에는 새로운 Whisper 버전을 상업적 사용을 위해 MIT 라이선스 하에 공개했습니다. Harris는 gpt-4o-transcribe와 gpt-4o-mini-transcribe가 Whisper보다 훨씬 크기 때문에 공개 배포에 적합하지 않다고 지적했습니다.

"이 모델들은 Whisper처럼 일반 노트북에서 실행하기에는 너무 큽니다,"라고 Harris는 덧붙였습니다. "우리가 모델을 공개적으로 배포할 때는 특정 요구에 맞게 조정되었는지 신중히 고려하고 싶습니다. 우리는 최종 사용자 장치를 오픈소스 모델의 주요 영역으로 보고 있습니다."

2025년 3월 20일 오전 11:54 PT에 단어 오류율에 대한 언어를 명확히 하고 벤치마크 결과 차트를 더 최신 버전으로 업데이트했습니다.

관련 기사

사티야 나델라, 새로운 오픈AI 협력을 활용할 준비가 되었다

수요일에 월스트리트의 한 애널리스트가 마이크로소프트의 사티야 나델라 CEO에게 개정된 오픈AI와의 파트너십이 회사의 재무 상황에 어떤 영향을 미칠지 직접 물었습니다.나델라는 이 새로운 협약이 모든 당사자에게 이익이 된다고 설명했습니다. “오픈AI와의 파트너십에 대해 우리는 만족하고 있습니다. 저는 언제나 모든 파트너십에서 상호 이익이 되도록 하는 데 집중합니다. 그렇게 해야만 좋은 파트너로 남을 수 있기 때문입니다.”그는 마이크로소프트가 여

사티야 나델라, 새로운 오픈AI 협력을 활용할 준비가 되었다

수요일에 월스트리트의 한 애널리스트가 마이크로소프트의 사티야 나델라 CEO에게 개정된 오픈AI와의 파트너십이 회사의 재무 상황에 어떤 영향을 미칠지 직접 물었습니다.나델라는 이 새로운 협약이 모든 당사자에게 이익이 된다고 설명했습니다. “오픈AI와의 파트너십에 대해 우리는 만족하고 있습니다. 저는 언제나 모든 파트너십에서 상호 이익이 되도록 하는 데 집중합니다. 그렇게 해야만 좋은 파트너로 남을 수 있기 때문입니다.”그는 마이크로소프트가 여

오픈AI, 공공 부유 기금, 로봇세, 주 4일 근무제를 통해 AI 경제 구상 제시

각국 정부가 초지능 기계가 초래할 경제적 영향을 관리하기 위해 고심하는 가운데, 오픈AI는 ‘지능 시대’에 부와 일자리가 어떻게 재편될 수 있을지 제시하는 일련의 정책 제안을 발표했다. 이 제안들은 공공 부유 기금이나 사회 안전망 확충과 같은 전통적인 진보적 방안들을 근본적으로 자본주의적이고 시장 주도적인 경제 체계와 결합하고 있다.오픈AI의 제안은 본질적

오픈AI, 공공 부유 기금, 로봇세, 주 4일 근무제를 통해 AI 경제 구상 제시

각국 정부가 초지능 기계가 초래할 경제적 영향을 관리하기 위해 고심하는 가운데, 오픈AI는 ‘지능 시대’에 부와 일자리가 어떻게 재편될 수 있을지 제시하는 일련의 정책 제안을 발표했다. 이 제안들은 공공 부유 기금이나 사회 안전망 확충과 같은 전통적인 진보적 방안들을 근본적으로 자본주의적이고 시장 주도적인 경제 체계와 결합하고 있다.오픈AI의 제안은 본질적

그렉 브록맨이 일론 머스크가 오픈AI를 떠난 경위를 밝힌다

2017년 8월 말, 당시 소규모 비영리 연구소였던 OpenAI의 주요 인사들은 기술을 상용화하고 AGI 달성에 필요한 자금을 조달하기 위해 영리 법인을 설립하는 방안을 논의하기 위해 모였다.일론 머스크는 회사에 대한 전적인 통제권을 요구하고 있었으며, 막 공동 창업자 각자에게 테슬라 모델 3를 선물한 참이었다. 그렉 브록맨 최고기술책임자(CTO)는 머스크

관련 특별 주제 추천

의견 (33)

0/500

그렉 브록맨이 일론 머스크가 오픈AI를 떠난 경위를 밝힌다

2017년 8월 말, 당시 소규모 비영리 연구소였던 OpenAI의 주요 인사들은 기술을 상용화하고 AGI 달성에 필요한 자금을 조달하기 위해 영리 법인을 설립하는 방안을 논의하기 위해 모였다.일론 머스크는 회사에 대한 전적인 통제권을 요구하고 있었으며, 막 공동 창업자 각자에게 테슬라 모델 3를 선물한 참이었다. 그렉 브록맨 최고기술책임자(CTO)는 머스크

관련 특별 주제 추천

의견 (33)

0/500

![FrankMartínez]()

The new OpenAI models sound like a game-changer for voice tech! Can't wait to see how devs use this to make apps talk smoother than ever. 😎

![BenHernández]()

Wow, OpenAI's new transcription and voice models sound like a game-changer! I'm curious how these 'agentic' systems will stack up against real-world tasks. Could they finally nail natural-sounding convos? 🤔

![GeorgeTaylor]()

Os novos modelos de transcrição e geração de voz da OpenAI são um divisor de águas! Estou usando no meu podcast e as melhorias são impressionantes. O único ponto negativo? São um pouco caros, mas se você puder pagar, vale cada centavo! 🎙️💸

![GregoryAllen]()

OpenAI's new transcription and voice models are a game changer! I've been using them for my podcast and the improvements are night and day. The only downside? They're a bit pricey, but if you can swing it, they're worth every penny! 🎙️💸

OpenAI는 API를 통해 전사 및 음성 생성을 위한 새로운 AI 모델을 출시하고 있으며, 이전 버전에 비해 상당한 개선을 약속하고 있습니다. 이러한 업데이트는 사용자를 위해 독립적으로 작업을 수행할 수 있는 자율 시스템을 만드는 데 초점을 맞춘 OpenAI의 더 큰 "agentic" 비전의 일부입니다. "agent"라는 용어는 논쟁의 여지가 있을 수 있지만, OpenAI의 제품 책임자인 Olivier Godement는 이를 비즈니스 고객과 상호작용할 수 있는 챗봇으로 보고 있습니다.

"앞으로 몇 달 안에 점점 더 많은 에이전트가 등장할 것입니다,"라고 Godement는 TechCrunch와의 브리핑에서 공유했습니다. "전반적인 목표는 고객과 개발자가 유용하고 접근 가능하며 정확한 에이전트를 활용할 수 있도록 지원하는 것입니다."

OpenAI의 최신 텍스트-음성 변환 모델인 "gpt-4o-mini-tts"는 더 생생하고 미묘한 음성을 생성할 뿐만 아니라 이전 모델보다 더 적응력이 뛰어납니다. 이제 개발자는 "미친 과학자처럼 말해" 또는 "마음 챙김 교사처럼 차분한 목소리를 사용해"와 같은 자연어 명령을 통해 모델을 안내할 수 있습니다. 이러한 제어 수준은 더 개인화된 음성 경험을 가능하게 합니다.

다음은 "진범죄 스타일"의 거친 목소리 샘플입니다:

그리고 다음은 여성 "전문가" 목소리의 예입니다:

OpenAI의 제품 팀원인 Jeff Harris는 TechCrunch에 개발자가 음성 "경험"과 "맥락"을 모두 사용자 정의할 수 있도록 하는 것이 목표라고 강조했습니다. "다양한 시나리오에서 단조로운 목소리를 원하지 않습니다,"라고 Harris는 설명했습니다. "예를 들어, 고객 지원 환경에서 실수에 대해 사과하는 목소리가 필요할 때, 그 감정을 목소리에 주입할 수 있습니다. 우리는 개발자와 사용자가 콘텐츠뿐만 아니라 말하는 방식도 제어하고 싶어한다고 강하게 믿습니다."

OpenAI의 새로운 음성-텍스트 변환 제공물인 "gpt-4o-transcribe"와 "gpt-4o-mini-transcribe"는 구형 Whisper 전사 모델을 대체할 예정입니다. 다양한 고품질 오디오 데이터로 훈련된 이 모델들은 억양이 있거나 다양한 음성을 더 잘 처리하며, 소음이 많은 환경에서도 더 나은 성능을 보입니다. 또한, 이 모델들은 Whisper가 때때로 단어나 전체 구절을 만들어내어 인종적 논평이나 가상의 의료 치료와 같은 부정확성을 전사에 추가하는 "환각" 문제에 덜 취약합니다.

"이 모델들은 이 점에서 Whisper에 비해 상당한 개선을 보입니다,"라고 Harris는 언급했습니다. "모델의 정확성을 보장하는 것은 신뢰할 수 있는 음성 경험에 매우 중요하며, 정확성이란 모델이 말하지 않은 콘텐츠를 추가하지 않고 발화된 단어를 정확히 포착하는 것을 의미합니다."

그러나 언어별로 성능이 다를 수 있습니다. OpenAI의 내부 벤치마크에 따르면, 두 모델 중 더 정확한 gpt-4o-transcribe는 타밀어, 텔루구어, 말라얄람어, 칸나다어와 같은 인도 및 드라비다 언어에 대해 "단어 오류율"이 약 30%에 달합니다. 이는 이 언어들에서 10개의 단어 중 약 3개가 인간 전사와 다를 수 있음을 나타냅니다.

OpenAI는 평소와 달리 이 새로운 전사 모델들을 무료로 제공하지 않을 것입니다. 과거에는 새로운 Whisper 버전을 상업적 사용을 위해 MIT 라이선스 하에 공개했습니다. Harris는 gpt-4o-transcribe와 gpt-4o-mini-transcribe가 Whisper보다 훨씬 크기 때문에 공개 배포에 적합하지 않다고 지적했습니다.

"이 모델들은 Whisper처럼 일반 노트북에서 실행하기에는 너무 큽니다,"라고 Harris는 덧붙였습니다. "우리가 모델을 공개적으로 배포할 때는 특정 요구에 맞게 조정되었는지 신중히 고려하고 싶습니다. 우리는 최종 사용자 장치를 오픈소스 모델의 주요 영역으로 보고 있습니다."

2025년 3월 20일 오전 11:54 PT에 단어 오류율에 대한 언어를 명확히 하고 벤치마크 결과 차트를 더 최신 버전으로 업데이트했습니다.

사티야 나델라, 새로운 오픈AI 협력을 활용할 준비가 되었다

수요일에 월스트리트의 한 애널리스트가 마이크로소프트의 사티야 나델라 CEO에게 개정된 오픈AI와의 파트너십이 회사의 재무 상황에 어떤 영향을 미칠지 직접 물었습니다.나델라는 이 새로운 협약이 모든 당사자에게 이익이 된다고 설명했습니다. “오픈AI와의 파트너십에 대해 우리는 만족하고 있습니다. 저는 언제나 모든 파트너십에서 상호 이익이 되도록 하는 데 집중합니다. 그렇게 해야만 좋은 파트너로 남을 수 있기 때문입니다.”그는 마이크로소프트가 여

사티야 나델라, 새로운 오픈AI 협력을 활용할 준비가 되었다

수요일에 월스트리트의 한 애널리스트가 마이크로소프트의 사티야 나델라 CEO에게 개정된 오픈AI와의 파트너십이 회사의 재무 상황에 어떤 영향을 미칠지 직접 물었습니다.나델라는 이 새로운 협약이 모든 당사자에게 이익이 된다고 설명했습니다. “오픈AI와의 파트너십에 대해 우리는 만족하고 있습니다. 저는 언제나 모든 파트너십에서 상호 이익이 되도록 하는 데 집중합니다. 그렇게 해야만 좋은 파트너로 남을 수 있기 때문입니다.”그는 마이크로소프트가 여

오픈AI, 공공 부유 기금, 로봇세, 주 4일 근무제를 통해 AI 경제 구상 제시

각국 정부가 초지능 기계가 초래할 경제적 영향을 관리하기 위해 고심하는 가운데, 오픈AI는 ‘지능 시대’에 부와 일자리가 어떻게 재편될 수 있을지 제시하는 일련의 정책 제안을 발표했다. 이 제안들은 공공 부유 기금이나 사회 안전망 확충과 같은 전통적인 진보적 방안들을 근본적으로 자본주의적이고 시장 주도적인 경제 체계와 결합하고 있다.오픈AI의 제안은 본질적

오픈AI, 공공 부유 기금, 로봇세, 주 4일 근무제를 통해 AI 경제 구상 제시

각국 정부가 초지능 기계가 초래할 경제적 영향을 관리하기 위해 고심하는 가운데, 오픈AI는 ‘지능 시대’에 부와 일자리가 어떻게 재편될 수 있을지 제시하는 일련의 정책 제안을 발표했다. 이 제안들은 공공 부유 기금이나 사회 안전망 확충과 같은 전통적인 진보적 방안들을 근본적으로 자본주의적이고 시장 주도적인 경제 체계와 결합하고 있다.오픈AI의 제안은 본질적

그렉 브록맨이 일론 머스크가 오픈AI를 떠난 경위를 밝힌다

2017년 8월 말, 당시 소규모 비영리 연구소였던 OpenAI의 주요 인사들은 기술을 상용화하고 AGI 달성에 필요한 자금을 조달하기 위해 영리 법인을 설립하는 방안을 논의하기 위해 모였다.일론 머스크는 회사에 대한 전적인 통제권을 요구하고 있었으며, 막 공동 창업자 각자에게 테슬라 모델 3를 선물한 참이었다. 그렉 브록맨 최고기술책임자(CTO)는 머스크

그렉 브록맨이 일론 머스크가 오픈AI를 떠난 경위를 밝힌다

2017년 8월 말, 당시 소규모 비영리 연구소였던 OpenAI의 주요 인사들은 기술을 상용화하고 AGI 달성에 필요한 자금을 조달하기 위해 영리 법인을 설립하는 방안을 논의하기 위해 모였다.일론 머스크는 회사에 대한 전적인 통제권을 요구하고 있었으며, 막 공동 창업자 각자에게 테슬라 모델 3를 선물한 참이었다. 그렉 브록맨 최고기술책임자(CTO)는 머스크

The new OpenAI models sound like a game-changer for voice tech! Can't wait to see how devs use this to make apps talk smoother than ever. 😎

Wow, OpenAI's new transcription and voice models sound like a game-changer! I'm curious how these 'agentic' systems will stack up against real-world tasks. Could they finally nail natural-sounding convos? 🤔

Os novos modelos de transcrição e geração de voz da OpenAI são um divisor de águas! Estou usando no meu podcast e as melhorias são impressionantes. O único ponto negativo? São um pouco caros, mas se você puder pagar, vale cada centavo! 🎙️💸

OpenAI's new transcription and voice models are a game changer! I've been using them for my podcast and the improvements are night and day. The only downside? They're a bit pricey, but if you can swing it, they're worth every penny! 🎙️💸

집

집