GoogleはエンタープライズAIでステルスを上回る:「追いつく」から「Catch Us」まで

わずか1年前、GoogleとエンタープライズAIをめぐる話題は停滞しているように見えました。トランスフォーマーのような先駆的技術を生み出したにもかかわらず、このテック大手は、OpenAIのバイラルな成功、Anthropicのコーディング能力、Microsoftのエンタープライズ市場への積極的な進出によって影が薄れ、遅れをとっているように見えました。

しかし、2025年のGoogle Cloud Nextがラスベガスで開催された先週、状況は大きく変わっていました。自信に満ちたGoogleは、トップクラスのモデル、堅牢なインフラ、明確なエンタープライズ戦略を武器に、劇的な巻き返しを発表しました。Googleの幹部との非公開アナリスト会議で、あるアナリストがその場の雰囲気をこう表現しました:「これはGoogleが『追いつく』から『追いついてみろ』に変わった瞬間のように感じる。」

Googleの飛躍

GoogleがエンタープライズAIレースでOpenAIやMicrosoftに追いついただけでなく、追い越したというこの感情は、イベント全体を通じて明らかでした。そしてそれは単なるマーケティングの誇張ではありません。過去1年間、Googleは実行に徹底的に注力し、技術力を高性能で統合されたプラットフォームに変え、エンタープライズの意思決定者を急速に惹きつけています。世界最強のAIモデルが非常に効率的なカスタムシリコンで動作することから、現実のビジネス課題に合わせたAIエージェントの急成長するエコシステムまで、Googleは決して本当に迷っていたわけではなく、深い基盤的開発の期間を経ていただけだと力強く主張しています。

統合されたスタックが今フル稼働し、GoogleはエンタープライズAI革命の次のフェーズをリードする準備ができているように見えます。NextでのGoogle幹部とのインタビューで、彼らはGoogleのインフラとモデル統合における独自の優位性を強調しました。これはOpenAI、Microsoft、AWSのような競合他社が再現するのが難しい優位性です。

疑念の影:最近の過去を認める

Googleの現在の勢いを十分に理解するには、最近の過去を認めることが不可欠です。Googleはトランスフォーマーアーキテクチャを発明し、大規模言語モデル(LLM)の現代革命を起こし、10年前から専用AIハードウェア(TPU)に投資を開始し、今では業界をリードする効率を推進しています。それなのに、わずか2年半前、Googleは守勢に立っていました。

OpenAIのChatGPTは驚異的な速さで一般の注目とエンタープライズの関心を捉え、史上最も急速に成長したアプリとなりました。Anthropicのような競合他社はコーディングなどのニッチな領域を切り開きました。一方、Googleの公開の動きはしばしば慎重すぎるか、欠陥があるように見えました。2023年のBardデモの失敗や、画像生成器が歴史的に不正確な描写を生み出した論争は、内部の官僚主義やアライメントの過剰修正によって妨げられている可能性がある企業という物語を助長しました。Googleはクラウド競争の初期の遅れを反映して、市場シェアでAmazonやMicrosoftに大きく遅れた3位にとどまっているように見えました。

転換:リーダーシップを取り戻す意識的な決定

しかし、裏では、最高レベルでのリーダーシップを取り戻すための意図的な決定によって、大きな変化が起こっていました。Google DeepMindのAI開発者プラットフォームの製品担当副社長であるMat Vellosoは、2024年2月にMicrosoftを退社してGoogleに入社した際、この決定的な瞬間を感じました。「Googleに入社したとき、Sundar [Pichai]や複数のリーダーと話しましたが、彼らが『生成AIは業界が明らかに重視しているものだ。それを実現しよう』と決断した瞬間だと感じました」とVellosoは先週のNextでのインタビューで語りました。

この新たな推進力は、一部の外部者が恐れていた「頭脳流出」によって妨げられることはありませんでした。代わりに、Googleは2024年初頭に実行に倍増し、積極的な採用、内部の統一、顧客の獲得を特徴としました。競合他社が派手な採用を行った一方で、GoogleはDeepMindのCEOであるDemis HassabisやGoogle CloudのCEOであるThomas Kurianを含む中核AIリーダーシップを維持し、安定性と深い専門知識を提供しました。

さらに、才能はGoogleの焦点を絞ったミッションに流れ始めました。例えば、Logan KilpatrickはOpenAIからGoogleに戻り、基盤的AIを構築する機会に惹かれました。彼はVellosoと「ゼロから始める体験」に参加し、Geminiの開発者獲得をゼロから構築する任務を負いました。「初日は私一人だった…このプラットフォームにはユーザーがおらず、収益もありません。Geminiに誰も興味を持っていませんでした」とKilpatrickはスタート地点を振り返りました。AI Studioを立ち上げ、現在はGeminiアプリとLabsを率いるJosh Woodwardや、「Attention Is All You Need」のトランスフォーマー論文の主要共著者であるNoam Shazeerも、2024年後半に重要なGeminiプロジェクトの技術共同リーダーとして会社に戻りました。

柱1:Gemini 2.5と考えるモデルの時代

エンタープライズのマントラが「モデルだけではない」にシフトした一方で、最高のパフォーマンスを発揮するLLMを持つことは大きな成果であり、優れた研究と効率的な技術アーキテクチャの強力な証明です。Next '25の数週間前にリリースされたGemini 2.5 Proで、Googleはこの地位を決定的に獲得しました。独立したChatbot Arenaリーダーボードでトップに立ち、OpenAIの最新GPT-4oバリアントを大きく上回り、Humanity’s Last Examのような非常に難しい推論ベンチマークで優れていました。Pichaiは基調講演で「これは我々の最も知的なAIモデルであり、世界最高のモデルです」と述べ、別途ツイートでGeminiの使用量が1か月で80%増加したと報告しました。

初めて、Geminiへの需要が急増しました。Gemini 2.5 Proの生の知能以外で私を驚かせたのは、その実証された推論能力でした。Googleは「考える」機能を設計し、モデルが多段階の推論、計画、自己反省を最終応答前に実行できるようにしました。番号付きのステップとサブブレットを使用した構造化された一貫した思考の連鎖(CoT)は、DeepSeekやOpenAIの他のモデルからの冗長または不透明な出力とは異なります。重要なタスクの出力を評価する技術チームにとって、この透明性は前例のない自信を持って検証、修正、リダイレクトを可能にします。

しかし、エンタープライズユーザーにとってより重要なのは、Gemini 2.5 Proが生成AIの最大の応用分野の1つであるコーディングのギャップを劇的に縮めたことです。VentureBeatとのインタビューで、大手小売業者WayfairのCTOであるFiona Tanは、初期テスト後、モデルが「かなり向上した」と述べ、以前は多くの開発者が好んだAnthropicのClaude 3.7 Sonnetと「かなり匹敵する」と述べました。

Googleはまた、モデルに100万トークンの巨大なコンテキストウィンドウを追加し、コードベース全体や長いドキュメントにわたる推論を可能にし、OpenAIやAnthropicのモデルの能力を大きく超えました。(OpenAIは今週、同様に大きなコンテキストウィンドウを持つモデルで対応しましたが、ベンチマークではGemini 2.5 Proが全体的な推論で優位性を維持していることが示唆されています。)この利点は、複雑なマルチファイルソフトウェアエンジニアリングタスクを可能にします。

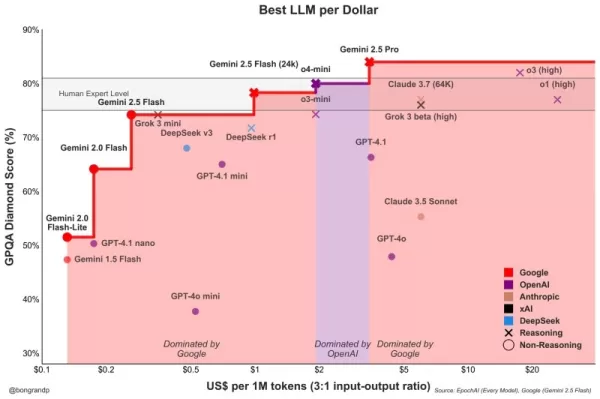

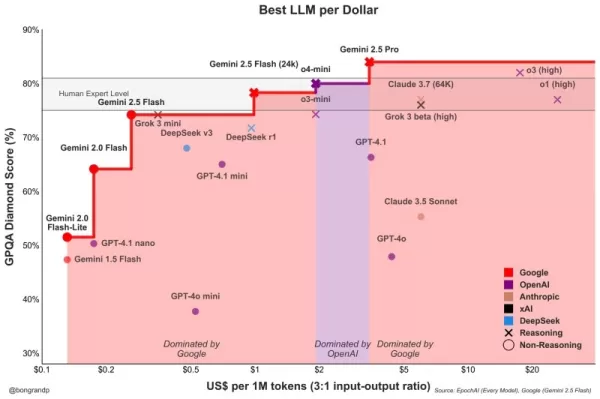

Proを補完するのは、Next '25で発表され、昨日リリースされたGemini 2.5 Flashです。「考える」モデルでもあるFlashは、低遅延とコスト効率のために最適化されています。モデルの推論量を制御し、予算とパフォーマンスをバランスさせることができます。この階層的なアプローチは、Google幹部が推奨する「ドルあたりの知能」戦略をさらに反映しています。

Vellosoは、知能のスペクトル全体でGoogleモデルが最高の価値を提供していることを示すチャートを見せました。「1年前にこの会話をしていたら…何も見せるものはなかった」とVellosoは認め、急速な巻き返しを強調しました。「今では、どのモデル、どのサイズであっても、Googleでなければお金を無駄にしている。」OpenAIの最新モデルリリースを考慮して更新された同様のチャートも同じことを示しています:Googleのモデルはドルあたりの最高の知能を提供します。以下を参照してください:

WayfairのTanは、2.5 Proの遅延の改善も有望だと観察しました:「Gemini 2.5はより速く戻ってきた」と彼女は言い、これまで他のモデルではそうではなかった「より顧客向けの機能」に使えると述べました。GeminiはWayfairが顧客との対話に使用する最初のモデルになる可能性があると彼女は言いました。

Geminiファミリーの機能はマルチモーダルにも及び、Googleの他の主要モデル(画像生成のImagen 3、ビデオ生成のVeo 2、オーディオのChirp 3、新たに発表されたテキストから音楽へのLyriaなど)とシームレスに統合され、すべてGoogleのエンタープライズユーザー向けプラットフォームVertexを通じてアクセス可能です。Googleは、すべてのモーダルで自社の生成メディアモデルを提供する唯一の企業です。Microsoft、AWS、OpenAIはこれを行うために他の企業と提携する必要があります。

柱2:インフラの卓越性 – エンジンの下

これらの強力なモデルを迅速に反復し効率的に提供する能力は、Googleが数十年にわたって地球規模のサービスを運営してきた、比類なきインフラに由来します。その中心にあるのはテンソル処理ユニット(TPU)です。

Next '25で、Googleは推論と「考えるモデル」の需要に特化して設計された7世代目のTPU、Ironwoodを発表しました。その規模は膨大で、要求の厳しいAIワークロード向けに調整されています:Ironwoodポッドは9,000以上の液体冷却チップを搭載し、425エクサフロップスの計算能力を提供すると主張しています。GoogleのMLシステム副社長Amin Vahdatは、Nextのステージでこれが「現在の世界No.1スーパーコンピュータの24倍以上の計算能力」と述べました。

Googleは、Ironwoodが前世代のTPUであるTrilliumと比較して2倍の性能/ワットを提供すると述べました。これは、エンタープライズ顧客が大規模AI展開のエネルギーコストと可用性が制約になるとますます言う中で重要です。

Google CloudのCTOであるWill Grannisは、この進歩の一貫性を強調しました。年々、Googleはプロセッサで10倍、8倍、9倍、10倍の改善を行っており、彼はこれをAIアクセラレータの「ハイパー・ムーアの法則」と呼びました。彼はVentureBeatとのインタビューで、顧客はGoogleの技術だけでなくロードマップを購入していると述べました。

Googleのポジションは、この持続的なTPU投資を推進しました。20億人以上のユーザー向けにSearch、YouTube、Gmailなどの巨大なサービスを効率的に運用する必要があり、現在の生成AIブームのずっと前からカスタムで最適化されたハードウェアの開発が必要でした。Metaは同様の消費者規模で運営していますが、他の競合他社はこの特定の内部ドライバーを持たず、10年にわたる垂直統合されたAIハードウェア開発を行ってきませんでした。

今、これらのTPU投資は、Google自身のアプリの効率を高めるだけでなく、Geminiを他のユーザーにすべてが等しい条件下でより高いドルあたりの知能で提供することで報われています。

Googleの競合他社がNvidiaから効率的なプロセッサを購入できない理由は何ですか?確かに、NvidiaのGPUプロセッサはLLMの事前トレーニングを支配しています。しかし、市場の需要がこれらのGPUの価格を押し上げ、Nvidiaは自社の利益として大きなシェアを取っています。これにより、チップのユーザーに大きなコストが転嫁されます。また、これまでAIチップの使用は事前トレーニングが主でしたが、企業が実際にこれらのアプリケーションを展開するにつれて状況が変わっています。ここで「推論」が登場し、TPUは大規模なワークロードでGPUよりも効率的だと考えられています。

Googleの幹部にAIの主要な技術的優位性がどこから来るかと尋ねると、彼らは通常TPUを最も重要だと挙げます。Googleのコンピューティングインフラを担当する副社長Mark Lohmeyerは明確でした:TPUは「我々がしていることの非常に差別化された部分…OpenAIにはそのような能力はありません」と。

重要なのは、GoogleがTPUを単独で提示するのではなく、より複雑なエンタープライズAIアーキテクチャの一部として提示することです。技術インサイダーにとって、トップティアのパフォーマンスはますます専門化された技術的ブレークスルーの統合にかかっていることが理解されています。Nextで多くの更新が詳細に説明されました。Vahdatはこれを「スーパーコンピューティングシステム」と表現し、TPU、最新のNvidia GPU(Blackwellや近日中のVera Rubinなど)、Hyperdisk Exapools、Anywhere Cache、Rapid Storageなどの高度なストレージを統合したハードウェアと、アクセラレータを管理するCluster Director、Geminiの分散ランタイムであるPathways(現在顧客に提供)、Nvidia/PyTorchスタックから移行するワークロードを容易にするvLLMの最適化をTPUに適用する統一ソフトウェアスタックを統合しています。この統合システムが、Vahdatが主張する、GPT-4oと比較してGemini 2.0 Flashが24倍高いドルあたりの知能を達成する理由です。

Googleはまた、物理的インフラの範囲を拡大しています。Cloud WANは、Googleの200万マイルの低遅延プライベートファイバーネットワークを企業に提供し、顧客が管理するネットワークと比較して最大40%高速なパフォーマンスと40%低い総所有コスト(TCO)を約束します。

さらに、Google Distributed Cloud(GDC)は、GeminiとNvidiaハードウェア(Dellとのパートナーシップを通じて)を主権、オンサイト、またはエアギャップ環境で実行できるようにし、規制産業や国に最先端のAIをもたらす「非常に巨大な」能力としてNvidiaのCEO Jensen Huangが称賛しました。Nextで、HuangはGoogleのインフラを世界最高と呼びました:「コンピューティングのすべての層でGoogleおよびGoogle Cloud以上に優れた企業はありません」と彼は言いました。

柱3:統合されたフルスタック – 点をつなぐ

Googleの戦略的優位性は、これらのモデルとインフラコンポーネントがどのようにして一貫したプラットフォームに織り込まれているかを考えるとさらに高まります。ギャップを埋めるためにパートナーシップに依存する競合他社とは異なり、Googleはほぼすべての層を制御し、より緊密な統合とより速いイノベーションサイクルを可能にします。

では、Microsoftのような競合他社がOpenAIと提携してインフラの幅とLLMモデルの能力を一致させることができるなら、なぜこの統合が重要なのでしょうか?話したGooglerたちはそれが大きな違いを生むと言い、それを裏付けるエピソードを挙げました。

GoogleのエンタープライズデータベースBigQueryの大幅な改善を例に取ります。このデータベースは現在、LLMがデータをはるかに効率的に検索できるナレッジグラフを提供し、SnowflakeやDatabricksのような競合他社よりも5倍以上の顧客を誇っています。Google Cloudのデータアナリティクス製品責任者Yasmeen Ahmadは、GoogleのデータチームがDeepMindチームと緊密に協力したからこそ、大きな改善が可能だったと述べました。彼らは解決が難しいユースケースに取り組み、Googleの内部テストによると、一般的なクエリに基づいて50%高い精度で正しいデータに到達したと、AhmadはVentureBeatとのインタビューで語りました。Ahmadはこの種のスタック全体での深い統合がGoogleが業界を「飛び越えた」方法だと述べました。

この内部の結束は、Microsoftの「友敵」ダイナミクスと鋭く対照的です。MicrosoftはOpenAIと提携してAzureクラウドでモデルを配布していますが、Microsoftも独自のモデルを構築しています。AI開発者プログラムを現在率いるGoogleの幹部Mat Vellosoは、Windows Copilotの計画をOpenAIのモデル提供と調整することに苛立ち、Microsoftを去りました。「競合する別の会社と製品計画をどうやって共有するのか…それは矛盾している」と彼は振り返りました。「ここではモデルを構築している人々と肩を並べて座っています。」

この統合は、Googleのリーダーたちが彼らの核心的優位性と見なすものを示しています:基礎研究とモデル構築から「惑星規模」のアプリケーション展開とインフラ設計まで、スペクトル全体にわたる深い専門知識をつなぐ独自の能力です。

Vertex AIは、GoogleのエンタープライズAI努力の中心神経系として機能します。そして統合はGoogle自身の提供を超えています。VertexのModel Gardenは、Googleのモデル、MetaのLlama 4、多くのオープンソースオプションを含む200以上の厳選されたモデルを提供します。Vertexはチューニング、評価(Grannisがキーアクセラレータとして強調したAI駆動のEvalsを含む)、展開、モニタリングのツールを提供します。そのグラウンディング機能は、内部のAI対応データベースを活用し、外部ベクトルデータベースとの互換性も備えています。さらに、Google Search、世界最高の検索エンジンでモデルをグラウンドする新しい提供が加わります。

統合はGoogle Workspaceにも及びます。Next '25で発表された新機能、Sheetsの「Help Me Analyze」(はい、Sheetsには今「=AI」式があります)、DocsやWorkspace Flowsのオーディオ概要は、Geminiの機能を日常のワークフローにさらに組み込み、Googleが経験を改善するために使用する強力なフィードバックループを生み出します。

統合されたスタックを推進する一方で、Googleはエコシステムに役立つオープン性も推進しています。Kubernetesの採用を推進した後、現在はAIフレームワークのJAXやエージェント通信のオープンなプロトコル(A2A)、既存の標準(MCP)のサポートを推進しています。Googleはまた、従業員がエージェントを見つけて使用するためのGoogleの新しい統一インターフェースであるAgentspace内で、外部プラットフォームへの数百のコネクタを提供しています。このハブの概念は魅力的です。Agentspaceの基調講演デモ(51:40から開始)はこれを示しています。Googleはユーザーに事前構築されたエージェントを提供するか、従業員や開発者がノーコードAI機能を使用して独自に構築するか、A2Aコネクタを介して外部からエージェントを取り込むことができます。これはChromeブラウザにシームレスに統合されています。

柱4:エンタープライズ価値とエージェントエコシステムへの焦点

おそらく最も重要な変化は、GoogleがAIエージェントを通じて具体的なエンタープライズ問題の解決に鋭く焦点を当てたことです。Google CloudのCEOであるThomas Kurianは、顧客がGoogleを選ぶ3つの理由を挙げました:AI最適化プラットフォーム、既存のITに接続するオープンなマルチクラウドアプローチ、セキュリティ、主権、コンプライアンスに焦点を当てたエンタープライズ対応のアプローチです。

エージェントはこの戦略の鍵です。AgentSpace以外にも、以下が含まれます:

- ビルディングブロック: Nextで発表されたオープンソースのAgent Development Kit(ADK)は、すでに開発者から大きな関心を集めています。ADKはマルチエージェントシステムの作成を簡素化し、提案されたAgent2Agent(A2A)プロトコルは、異なるツール(Gemini ADK、LangGraph、CrewAIなど)で構築されたエージェントが連携できるようにする相互運用性を目指しています。GoogleのGrannisは、A2Aが将来の潜在的に数十万の相互作用するエージェントのスケールとセキュリティの課題を予測していると述べました。

- 目的別エージェント: Googleは、Agentspaceに統合された専門エージェント(NotebookLM、アイデア生成、深層リサーチなど)を展示し、牽引力を得ている5つの主要カテゴリを強調しました:顧客エージェント(Reddit Answers、Verizonのサポートアシスタント、Wendy’sドライブスルーなどのツールを強化)、クリエイティブエージェント(WPP、Brandtech、Sphereで使用)、データエージェント(Mattel、Spotify、Bayerでの洞察を推進)、コーディングエージェント(Gemini Code Assist)、セキュリティエージェント(新しいGoogle Unified Securityプラットフォームに統合)。

この包括的なエージェント戦略は共鳴しているようです。先週、競争上の敏感さから匿名で話した他の3つの大企業の幹部との会話でも、Googleのエージェント戦略に対するこの熱意が反映されました。Google CloudのCOOであるFrancis DeSouzaはインタビューで確認しました:「すべての会話にAIが含まれます。特に、すべての会話にエージェントが含まれます。」

GoogleのAI製品を大いに活用し、他の企業に配布するDeloitteの幹部Kevin Laughridgeは、エージェント市場を「土地の奪い合い」と表現し、Googleのプロトコルと統合プラットフォームによる早期の動きが大きな優位性を提供すると述べました。「最初に進出し、実際に価値を提供するエージェントを最も多く獲得する者がこのレースで勝つ」とLaughridgeはインタビューで述べました。彼はGoogleの進歩が「驚くべきもの」と述べ、1年前にDeloitteが構築したカスタムエージェントが今ではAgentspaceを使って「すぐに」再現可能だと指摘しました。Deloitte自体は、財務、リスク、エンジニアリングなどのミドルオフィス機能向けにプラットフォーム上で100のエージェントを構築していると彼は言いました。

顧客の証明ポイントが増えています。Nextで、Googleは生成AIで「500以上の顧客が本番環境にいる」と引用し、1年前の「数十のプロトタイプ」から増加しました。1年前にMicrosoftが大きくリードしていると見られていたとしても、それはもはや明らかではありません。すべての側からのPR戦争を考えると、誰が本当に勝っているかを決定的に言うのは難しいです。指標は異なります。Googleの500という数字は、Microsoftが宣伝する400のケーススタディと直接比較できません(Microsoftは、報道時点でVentureBeatに対し、この公開数を近日中に600に更新する予定だと述べ、激しいマーケティングを強調しています)。Googleのアプリを通じたAIの配布が重要である一方、Microsoftの365を通じたCopilotの配布も同様に印象的です。両者は現在、APIを通じて数百万の開発者に到達しています。

しかし、Googleの牽引力の例は豊富です:

- Wendy’s: わずか1年でAIドライブスルーシステムを数千の店舗に展開し、従業員体験と注文精度を改善しました。Google CloudのCTOであるWill Grannisは、AIシステムがスラングを理解し、背景ノイズをフィルタリングする能力があり、ライブの顧客対話のストレスを大幅に軽減すると指摘しました。これにより、スタッフは食品準備と品質に集中でき、Grannisはこれを「AIが現実の運用を効率化する素晴らしい例」と呼びました。

- Salesforce: Google Cloudでプラットフォームを初めて実行する(AWSを超えて)大幅な拡張を発表し、Googleの「イノベーションと最適化を支援する能力」を引用しました。

- Honeywell & Intuit: 以前はMicrosoftやAWSと強く関連していた企業が、現在Google CloudとAIイニシアチブで提携しています。

- 主要銀行(Deutsche Bank、Wells Fargo): エージェントとGeminiを活用して、研究、分析、顧客サービスの近代化を行っています。

- 小売業者(Walmart、Mercado Libre、Lowe’s): 検索、エージェント、データプラットフォームを使用しています。

このエンタープライズの牽引力は、Google Cloudの全体的な成長を推進し、過去3四半期でAWSとAzureを上回りました。Google Cloudは2018年の50億ドルから、2024年には440億ドルの年換算収益に達しました。

競争の海を航海する

Googleの上昇は、競合他社が立ち止まっているわけではありません。OpenAIは今週、GPT-4.1(コーディングと長コンテキストに焦点)とoシリーズ(マルチモーダル推論、ツール使用)の迅速なリリースで、継続的なイノベーションを示しました。さらに、OpenAIのGPT-4oの新しい画像生成機能のアップデートは、過去1か月で大きな成長を促進し、ChatGPTが8億ユーザーに到達するのを助けました。Microsoftは広大なエンタープライズの足跡とOpenAIとのパートナーシップを活用し続け、Anthropicは特にコーディングと安全を意識したアプリケーションで強力な競争者です。

しかし、Googleの物語が驚くほど改善したことは議論の余地がありません。わずか1年前、Googleは鈍重で、ためらいがちで、失敗を繰り返す競争者と見られ、AIをリードするチャンスを逃すかもしれないと思われていました。しかし、その独自の統合スタックと企業の堅固さは別のことを明らかにしました:Googleは、チップ設計(TPU)やグローバルインフラから基礎モデル研究(DeepMind)、アプリケーション開発(Workspace、Search、YouTube)、エンタープライズクラウドサービス(Vertex AI、BigQuery、Agentspace)まで、スペクトル全体で世界クラスの能力を持っています。「我々は基礎モデル会話に参加する唯一のハイパースケーラーだ」とdeSouzaは断言しました。このエンドツーエンドの所有権は、「ドルあたりの知能」のような最適化と、パートナーシップに依存するモデルが匹敵するのが難しい統合の深さを可能にします。競合他社はしばしば異なるピースをつなぎ合わせる必要があり、摩擦を生み出したり、イノベーションの速度を制限する可能性があります。

Googleの瞬間は今

AIレースは依然としてダイナミックですが、Googleは市場が求める正確な瞬間にこれらのピースを揃えました。DeloitteのLaughridgeが言ったように、Googleは「市場が求めたところ」でその能力が完全に一致するポイントに達しました。GoogleがエンタープライズAIでその実力を証明するのを待っていたなら、その瞬間を見逃したかもしれません — すでに証明されています。この革命を推進する多くの核心技術を発明した企業は、ついに追いつき、それ以上に、競合他社が追いつく必要があるペースを設定しています。

以下のビデオでは、Next直後に録画され、AI専門家のSam Witteveenと私が現在の風景と新たなトレンド、そしてGoogleのAIエコシステムがなぜこれほど強力に感じられるかを分析しています:

関連記事

サティヤ・ナデラ、新たなOpenAIとの契約を活用する準備ができている

水曜日に、ウォール・ストリートのアナリストがマイクロソフトのCEOであるサティヤ・ナデラ氏に直接尋ねました。改正されたOpenAIとの提携関係が同社の財務状況にどのような影響を与えるのかと。ナデラ氏はこの新しい協定を「皆にとっての勝利」と表現しました。「OpenAIとの提携については満足しています。私は常にどんな提携でもウィンウィンの関係を築くことに重点を置いています。そうすることで、長期的に良いパートナーシップを維持できるからです。」彼は、マイクロソフトが依然としてOpenAIの知的財産、

サティヤ・ナデラ、新たなOpenAIとの契約を活用する準備ができている

水曜日に、ウォール・ストリートのアナリストがマイクロソフトのCEOであるサティヤ・ナデラ氏に直接尋ねました。改正されたOpenAIとの提携関係が同社の財務状況にどのような影響を与えるのかと。ナデラ氏はこの新しい協定を「皆にとっての勝利」と表現しました。「OpenAIとの提携については満足しています。私は常にどんな提携でもウィンウィンの関係を築くことに重点を置いています。そうすることで、長期的に良いパートナーシップを維持できるからです。」彼は、マイクロソフトが依然としてOpenAIの知的財産、

OpenAIは、公的基金、ロボット税、週4日勤務制を柱とするAI経済の構想を提示した

各国政府が超知能機械による経済的影響への対応に苦慮する中、OpenAIは「知能の時代」において富と労働がどのように再構築されるべきかを概説した一連の政策提言を発表した。その構想は、公的資産基金や社会安全網の拡充といった伝統的な左派的な仕組みと、根本的に資本主義的で市場主導型の経済枠組みとを融合させたものである。OpenAIの提案は本質的に「要望リスト」に相当し、人工知能が労働と経済を変革する中で、

OpenAIは、公的基金、ロボット税、週4日勤務制を柱とするAI経済の構想を提示した

各国政府が超知能機械による経済的影響への対応に苦慮する中、OpenAIは「知能の時代」において富と労働がどのように再構築されるべきかを概説した一連の政策提言を発表した。その構想は、公的資産基金や社会安全網の拡充といった伝統的な左派的な仕組みと、根本的に資本主義的で市場主導型の経済枠組みとを融合させたものである。OpenAIの提案は本質的に「要望リスト」に相当し、人工知能が労働と経済を変革する中で、

Google、インドでChrome向け「Gemini」の提供を開始

水曜日、GoogleはChrome向けGeminiの統合機能を、インド、カナダ、ニュージーランドを含む新たな地域へ拡大すると発表した。この展開により、デスクトップユーザーはサイドバーからGeminiにアクセスできるようになり、画面上のコンテンツについてGoogleのAIチャットボットに質問したり、Gmail、Keep、Drive、YouTubeから情報を取得したり、タブの内容を比較したりすることが

関連特集おすすめ

コメント (14)

0/500

Google、インドでChrome向け「Gemini」の提供を開始

水曜日、GoogleはChrome向けGeminiの統合機能を、インド、カナダ、ニュージーランドを含む新たな地域へ拡大すると発表した。この展開により、デスクトップユーザーはサイドバーからGeminiにアクセスできるようになり、画面上のコンテンツについてGoogleのAIチャットボットに質問したり、Gmail、Keep、Drive、YouTubeから情報を取得したり、タブの内容を比較したりすることが

関連特集おすすめ

コメント (14)

0/500

![HarrySmith]()

Interesting read! It's wild how Google went from playing catch-up to leading the pack in enterprise AI so quickly. The Transformer foundation was huge, but maybe the real shift was focusing on enterprise needs instead of just chasing consumer hype? 🤔 Still, with Microsoft and OpenAI pushing hard, I wonder if this lead will last.

![HarryPerez]()

Очень странно читать это. Все говорят о лидерстве OpenAI, а Google уже делает реальные продукты для бизнеса. Может, они научились действовать скрытно? 🤔 Это напоминает гонку вооружений в IT... Интересно, какие последствия будут для конкуренции?

![EdwardRamirez]()

Google's AI comeback is wild! 😎 I thought they were out of the game, but their enterprise push is sneaky strong. Wonder if they’ll dominate the market soon?

![ThomasBaker]()

Google's quiet climb in enterprise AI is wild! 😎 I thought they were out of the game, but this Transformer legacy is no joke. Curious if they’ll outpace Microsoft soon?

![RalphGarcia]()

GoogleのエンタープライズAIへの進出は感動的だね。追いつくことから先頭に立つまで、彼らは本当にゲームを上げた。でもインターフェースはもう少し改善が必要だね;ちょっとぎこちない。でも、これからどこに向かうのか楽しみだよ!🚀

わずか1年前、GoogleとエンタープライズAIをめぐる話題は停滞しているように見えました。トランスフォーマーのような先駆的技術を生み出したにもかかわらず、このテック大手は、OpenAIのバイラルな成功、Anthropicのコーディング能力、Microsoftのエンタープライズ市場への積極的な進出によって影が薄れ、遅れをとっているように見えました。

しかし、2025年のGoogle Cloud Nextがラスベガスで開催された先週、状況は大きく変わっていました。自信に満ちたGoogleは、トップクラスのモデル、堅牢なインフラ、明確なエンタープライズ戦略を武器に、劇的な巻き返しを発表しました。Googleの幹部との非公開アナリスト会議で、あるアナリストがその場の雰囲気をこう表現しました:「これはGoogleが『追いつく』から『追いついてみろ』に変わった瞬間のように感じる。」

Googleの飛躍

GoogleがエンタープライズAIレースでOpenAIやMicrosoftに追いついただけでなく、追い越したというこの感情は、イベント全体を通じて明らかでした。そしてそれは単なるマーケティングの誇張ではありません。過去1年間、Googleは実行に徹底的に注力し、技術力を高性能で統合されたプラットフォームに変え、エンタープライズの意思決定者を急速に惹きつけています。世界最強のAIモデルが非常に効率的なカスタムシリコンで動作することから、現実のビジネス課題に合わせたAIエージェントの急成長するエコシステムまで、Googleは決して本当に迷っていたわけではなく、深い基盤的開発の期間を経ていただけだと力強く主張しています。

統合されたスタックが今フル稼働し、GoogleはエンタープライズAI革命の次のフェーズをリードする準備ができているように見えます。NextでのGoogle幹部とのインタビューで、彼らはGoogleのインフラとモデル統合における独自の優位性を強調しました。これはOpenAI、Microsoft、AWSのような競合他社が再現するのが難しい優位性です。

疑念の影:最近の過去を認める

Googleの現在の勢いを十分に理解するには、最近の過去を認めることが不可欠です。Googleはトランスフォーマーアーキテクチャを発明し、大規模言語モデル(LLM)の現代革命を起こし、10年前から専用AIハードウェア(TPU)に投資を開始し、今では業界をリードする効率を推進しています。それなのに、わずか2年半前、Googleは守勢に立っていました。

OpenAIのChatGPTは驚異的な速さで一般の注目とエンタープライズの関心を捉え、史上最も急速に成長したアプリとなりました。Anthropicのような競合他社はコーディングなどのニッチな領域を切り開きました。一方、Googleの公開の動きはしばしば慎重すぎるか、欠陥があるように見えました。2023年のBardデモの失敗や、画像生成器が歴史的に不正確な描写を生み出した論争は、内部の官僚主義やアライメントの過剰修正によって妨げられている可能性がある企業という物語を助長しました。Googleはクラウド競争の初期の遅れを反映して、市場シェアでAmazonやMicrosoftに大きく遅れた3位にとどまっているように見えました。

転換:リーダーシップを取り戻す意識的な決定

しかし、裏では、最高レベルでのリーダーシップを取り戻すための意図的な決定によって、大きな変化が起こっていました。Google DeepMindのAI開発者プラットフォームの製品担当副社長であるMat Vellosoは、2024年2月にMicrosoftを退社してGoogleに入社した際、この決定的な瞬間を感じました。「Googleに入社したとき、Sundar [Pichai]や複数のリーダーと話しましたが、彼らが『生成AIは業界が明らかに重視しているものだ。それを実現しよう』と決断した瞬間だと感じました」とVellosoは先週のNextでのインタビューで語りました。

この新たな推進力は、一部の外部者が恐れていた「頭脳流出」によって妨げられることはありませんでした。代わりに、Googleは2024年初頭に実行に倍増し、積極的な採用、内部の統一、顧客の獲得を特徴としました。競合他社が派手な採用を行った一方で、GoogleはDeepMindのCEOであるDemis HassabisやGoogle CloudのCEOであるThomas Kurianを含む中核AIリーダーシップを維持し、安定性と深い専門知識を提供しました。

さらに、才能はGoogleの焦点を絞ったミッションに流れ始めました。例えば、Logan KilpatrickはOpenAIからGoogleに戻り、基盤的AIを構築する機会に惹かれました。彼はVellosoと「ゼロから始める体験」に参加し、Geminiの開発者獲得をゼロから構築する任務を負いました。「初日は私一人だった…このプラットフォームにはユーザーがおらず、収益もありません。Geminiに誰も興味を持っていませんでした」とKilpatrickはスタート地点を振り返りました。AI Studioを立ち上げ、現在はGeminiアプリとLabsを率いるJosh Woodwardや、「Attention Is All You Need」のトランスフォーマー論文の主要共著者であるNoam Shazeerも、2024年後半に重要なGeminiプロジェクトの技術共同リーダーとして会社に戻りました。

柱1:Gemini 2.5と考えるモデルの時代

エンタープライズのマントラが「モデルだけではない」にシフトした一方で、最高のパフォーマンスを発揮するLLMを持つことは大きな成果であり、優れた研究と効率的な技術アーキテクチャの強力な証明です。Next '25の数週間前にリリースされたGemini 2.5 Proで、Googleはこの地位を決定的に獲得しました。独立したChatbot Arenaリーダーボードでトップに立ち、OpenAIの最新GPT-4oバリアントを大きく上回り、Humanity’s Last Examのような非常に難しい推論ベンチマークで優れていました。Pichaiは基調講演で「これは我々の最も知的なAIモデルであり、世界最高のモデルです」と述べ、別途ツイートでGeminiの使用量が1か月で80%増加したと報告しました。

初めて、Geminiへの需要が急増しました。Gemini 2.5 Proの生の知能以外で私を驚かせたのは、その実証された推論能力でした。Googleは「考える」機能を設計し、モデルが多段階の推論、計画、自己反省を最終応答前に実行できるようにしました。番号付きのステップとサブブレットを使用した構造化された一貫した思考の連鎖(CoT)は、DeepSeekやOpenAIの他のモデルからの冗長または不透明な出力とは異なります。重要なタスクの出力を評価する技術チームにとって、この透明性は前例のない自信を持って検証、修正、リダイレクトを可能にします。

しかし、エンタープライズユーザーにとってより重要なのは、Gemini 2.5 Proが生成AIの最大の応用分野の1つであるコーディングのギャップを劇的に縮めたことです。VentureBeatとのインタビューで、大手小売業者WayfairのCTOであるFiona Tanは、初期テスト後、モデルが「かなり向上した」と述べ、以前は多くの開発者が好んだAnthropicのClaude 3.7 Sonnetと「かなり匹敵する」と述べました。

Googleはまた、モデルに100万トークンの巨大なコンテキストウィンドウを追加し、コードベース全体や長いドキュメントにわたる推論を可能にし、OpenAIやAnthropicのモデルの能力を大きく超えました。(OpenAIは今週、同様に大きなコンテキストウィンドウを持つモデルで対応しましたが、ベンチマークではGemini 2.5 Proが全体的な推論で優位性を維持していることが示唆されています。)この利点は、複雑なマルチファイルソフトウェアエンジニアリングタスクを可能にします。

Proを補完するのは、Next '25で発表され、昨日リリースされたGemini 2.5 Flashです。「考える」モデルでもあるFlashは、低遅延とコスト効率のために最適化されています。モデルの推論量を制御し、予算とパフォーマンスをバランスさせることができます。この階層的なアプローチは、Google幹部が推奨する「ドルあたりの知能」戦略をさらに反映しています。

Vellosoは、知能のスペクトル全体でGoogleモデルが最高の価値を提供していることを示すチャートを見せました。「1年前にこの会話をしていたら…何も見せるものはなかった」とVellosoは認め、急速な巻き返しを強調しました。「今では、どのモデル、どのサイズであっても、Googleでなければお金を無駄にしている。」OpenAIの最新モデルリリースを考慮して更新された同様のチャートも同じことを示しています:Googleのモデルはドルあたりの最高の知能を提供します。以下を参照してください:

WayfairのTanは、2.5 Proの遅延の改善も有望だと観察しました:「Gemini 2.5はより速く戻ってきた」と彼女は言い、これまで他のモデルではそうではなかった「より顧客向けの機能」に使えると述べました。GeminiはWayfairが顧客との対話に使用する最初のモデルになる可能性があると彼女は言いました。

Geminiファミリーの機能はマルチモーダルにも及び、Googleの他の主要モデル(画像生成のImagen 3、ビデオ生成のVeo 2、オーディオのChirp 3、新たに発表されたテキストから音楽へのLyriaなど)とシームレスに統合され、すべてGoogleのエンタープライズユーザー向けプラットフォームVertexを通じてアクセス可能です。Googleは、すべてのモーダルで自社の生成メディアモデルを提供する唯一の企業です。Microsoft、AWS、OpenAIはこれを行うために他の企業と提携する必要があります。

柱2:インフラの卓越性 – エンジンの下

これらの強力なモデルを迅速に反復し効率的に提供する能力は、Googleが数十年にわたって地球規模のサービスを運営してきた、比類なきインフラに由来します。その中心にあるのはテンソル処理ユニット(TPU)です。

Next '25で、Googleは推論と「考えるモデル」の需要に特化して設計された7世代目のTPU、Ironwoodを発表しました。その規模は膨大で、要求の厳しいAIワークロード向けに調整されています:Ironwoodポッドは9,000以上の液体冷却チップを搭載し、425エクサフロップスの計算能力を提供すると主張しています。GoogleのMLシステム副社長Amin Vahdatは、Nextのステージでこれが「現在の世界No.1スーパーコンピュータの24倍以上の計算能力」と述べました。

Googleは、Ironwoodが前世代のTPUであるTrilliumと比較して2倍の性能/ワットを提供すると述べました。これは、エンタープライズ顧客が大規模AI展開のエネルギーコストと可用性が制約になるとますます言う中で重要です。

Google CloudのCTOであるWill Grannisは、この進歩の一貫性を強調しました。年々、Googleはプロセッサで10倍、8倍、9倍、10倍の改善を行っており、彼はこれをAIアクセラレータの「ハイパー・ムーアの法則」と呼びました。彼はVentureBeatとのインタビューで、顧客はGoogleの技術だけでなくロードマップを購入していると述べました。

Googleのポジションは、この持続的なTPU投資を推進しました。20億人以上のユーザー向けにSearch、YouTube、Gmailなどの巨大なサービスを効率的に運用する必要があり、現在の生成AIブームのずっと前からカスタムで最適化されたハードウェアの開発が必要でした。Metaは同様の消費者規模で運営していますが、他の競合他社はこの特定の内部ドライバーを持たず、10年にわたる垂直統合されたAIハードウェア開発を行ってきませんでした。

今、これらのTPU投資は、Google自身のアプリの効率を高めるだけでなく、Geminiを他のユーザーにすべてが等しい条件下でより高いドルあたりの知能で提供することで報われています。

Googleの競合他社がNvidiaから効率的なプロセッサを購入できない理由は何ですか?確かに、NvidiaのGPUプロセッサはLLMの事前トレーニングを支配しています。しかし、市場の需要がこれらのGPUの価格を押し上げ、Nvidiaは自社の利益として大きなシェアを取っています。これにより、チップのユーザーに大きなコストが転嫁されます。また、これまでAIチップの使用は事前トレーニングが主でしたが、企業が実際にこれらのアプリケーションを展開するにつれて状況が変わっています。ここで「推論」が登場し、TPUは大規模なワークロードでGPUよりも効率的だと考えられています。

Googleの幹部にAIの主要な技術的優位性がどこから来るかと尋ねると、彼らは通常TPUを最も重要だと挙げます。Googleのコンピューティングインフラを担当する副社長Mark Lohmeyerは明確でした:TPUは「我々がしていることの非常に差別化された部分…OpenAIにはそのような能力はありません」と。

重要なのは、GoogleがTPUを単独で提示するのではなく、より複雑なエンタープライズAIアーキテクチャの一部として提示することです。技術インサイダーにとって、トップティアのパフォーマンスはますます専門化された技術的ブレークスルーの統合にかかっていることが理解されています。Nextで多くの更新が詳細に説明されました。Vahdatはこれを「スーパーコンピューティングシステム」と表現し、TPU、最新のNvidia GPU(Blackwellや近日中のVera Rubinなど)、Hyperdisk Exapools、Anywhere Cache、Rapid Storageなどの高度なストレージを統合したハードウェアと、アクセラレータを管理するCluster Director、Geminiの分散ランタイムであるPathways(現在顧客に提供)、Nvidia/PyTorchスタックから移行するワークロードを容易にするvLLMの最適化をTPUに適用する統一ソフトウェアスタックを統合しています。この統合システムが、Vahdatが主張する、GPT-4oと比較してGemini 2.0 Flashが24倍高いドルあたりの知能を達成する理由です。

Googleはまた、物理的インフラの範囲を拡大しています。Cloud WANは、Googleの200万マイルの低遅延プライベートファイバーネットワークを企業に提供し、顧客が管理するネットワークと比較して最大40%高速なパフォーマンスと40%低い総所有コスト(TCO)を約束します。

さらに、Google Distributed Cloud(GDC)は、GeminiとNvidiaハードウェア(Dellとのパートナーシップを通じて)を主権、オンサイト、またはエアギャップ環境で実行できるようにし、規制産業や国に最先端のAIをもたらす「非常に巨大な」能力としてNvidiaのCEO Jensen Huangが称賛しました。Nextで、HuangはGoogleのインフラを世界最高と呼びました:「コンピューティングのすべての層でGoogleおよびGoogle Cloud以上に優れた企業はありません」と彼は言いました。

柱3:統合されたフルスタック – 点をつなぐ

Googleの戦略的優位性は、これらのモデルとインフラコンポーネントがどのようにして一貫したプラットフォームに織り込まれているかを考えるとさらに高まります。ギャップを埋めるためにパートナーシップに依存する競合他社とは異なり、Googleはほぼすべての層を制御し、より緊密な統合とより速いイノベーションサイクルを可能にします。

では、Microsoftのような競合他社がOpenAIと提携してインフラの幅とLLMモデルの能力を一致させることができるなら、なぜこの統合が重要なのでしょうか?話したGooglerたちはそれが大きな違いを生むと言い、それを裏付けるエピソードを挙げました。

GoogleのエンタープライズデータベースBigQueryの大幅な改善を例に取ります。このデータベースは現在、LLMがデータをはるかに効率的に検索できるナレッジグラフを提供し、SnowflakeやDatabricksのような競合他社よりも5倍以上の顧客を誇っています。Google Cloudのデータアナリティクス製品責任者Yasmeen Ahmadは、GoogleのデータチームがDeepMindチームと緊密に協力したからこそ、大きな改善が可能だったと述べました。彼らは解決が難しいユースケースに取り組み、Googleの内部テストによると、一般的なクエリに基づいて50%高い精度で正しいデータに到達したと、AhmadはVentureBeatとのインタビューで語りました。Ahmadはこの種のスタック全体での深い統合がGoogleが業界を「飛び越えた」方法だと述べました。

この内部の結束は、Microsoftの「友敵」ダイナミクスと鋭く対照的です。MicrosoftはOpenAIと提携してAzureクラウドでモデルを配布していますが、Microsoftも独自のモデルを構築しています。AI開発者プログラムを現在率いるGoogleの幹部Mat Vellosoは、Windows Copilotの計画をOpenAIのモデル提供と調整することに苛立ち、Microsoftを去りました。「競合する別の会社と製品計画をどうやって共有するのか…それは矛盾している」と彼は振り返りました。「ここではモデルを構築している人々と肩を並べて座っています。」

この統合は、Googleのリーダーたちが彼らの核心的優位性と見なすものを示しています:基礎研究とモデル構築から「惑星規模」のアプリケーション展開とインフラ設計まで、スペクトル全体にわたる深い専門知識をつなぐ独自の能力です。

Vertex AIは、GoogleのエンタープライズAI努力の中心神経系として機能します。そして統合はGoogle自身の提供を超えています。VertexのModel Gardenは、Googleのモデル、MetaのLlama 4、多くのオープンソースオプションを含む200以上の厳選されたモデルを提供します。Vertexはチューニング、評価(Grannisがキーアクセラレータとして強調したAI駆動のEvalsを含む)、展開、モニタリングのツールを提供します。そのグラウンディング機能は、内部のAI対応データベースを活用し、外部ベクトルデータベースとの互換性も備えています。さらに、Google Search、世界最高の検索エンジンでモデルをグラウンドする新しい提供が加わります。

統合はGoogle Workspaceにも及びます。Next '25で発表された新機能、Sheetsの「Help Me Analyze」(はい、Sheetsには今「=AI」式があります)、DocsやWorkspace Flowsのオーディオ概要は、Geminiの機能を日常のワークフローにさらに組み込み、Googleが経験を改善するために使用する強力なフィードバックループを生み出します。

統合されたスタックを推進する一方で、Googleはエコシステムに役立つオープン性も推進しています。Kubernetesの採用を推進した後、現在はAIフレームワークのJAXやエージェント通信のオープンなプロトコル(A2A)、既存の標準(MCP)のサポートを推進しています。Googleはまた、従業員がエージェントを見つけて使用するためのGoogleの新しい統一インターフェースであるAgentspace内で、外部プラットフォームへの数百のコネクタを提供しています。このハブの概念は魅力的です。Agentspaceの基調講演デモ(51:40から開始)はこれを示しています。Googleはユーザーに事前構築されたエージェントを提供するか、従業員や開発者がノーコードAI機能を使用して独自に構築するか、A2Aコネクタを介して外部からエージェントを取り込むことができます。これはChromeブラウザにシームレスに統合されています。

柱4:エンタープライズ価値とエージェントエコシステムへの焦点

おそらく最も重要な変化は、GoogleがAIエージェントを通じて具体的なエンタープライズ問題の解決に鋭く焦点を当てたことです。Google CloudのCEOであるThomas Kurianは、顧客がGoogleを選ぶ3つの理由を挙げました:AI最適化プラットフォーム、既存のITに接続するオープンなマルチクラウドアプローチ、セキュリティ、主権、コンプライアンスに焦点を当てたエンタープライズ対応のアプローチです。

エージェントはこの戦略の鍵です。AgentSpace以外にも、以下が含まれます:

- ビルディングブロック: Nextで発表されたオープンソースのAgent Development Kit(ADK)は、すでに開発者から大きな関心を集めています。ADKはマルチエージェントシステムの作成を簡素化し、提案されたAgent2Agent(A2A)プロトコルは、異なるツール(Gemini ADK、LangGraph、CrewAIなど)で構築されたエージェントが連携できるようにする相互運用性を目指しています。GoogleのGrannisは、A2Aが将来の潜在的に数十万の相互作用するエージェントのスケールとセキュリティの課題を予測していると述べました。

- 目的別エージェント: Googleは、Agentspaceに統合された専門エージェント(NotebookLM、アイデア生成、深層リサーチなど)を展示し、牽引力を得ている5つの主要カテゴリを強調しました:顧客エージェント(Reddit Answers、Verizonのサポートアシスタント、Wendy’sドライブスルーなどのツールを強化)、クリエイティブエージェント(WPP、Brandtech、Sphereで使用)、データエージェント(Mattel、Spotify、Bayerでの洞察を推進)、コーディングエージェント(Gemini Code Assist)、セキュリティエージェント(新しいGoogle Unified Securityプラットフォームに統合)。

この包括的なエージェント戦略は共鳴しているようです。先週、競争上の敏感さから匿名で話した他の3つの大企業の幹部との会話でも、Googleのエージェント戦略に対するこの熱意が反映されました。Google CloudのCOOであるFrancis DeSouzaはインタビューで確認しました:「すべての会話にAIが含まれます。特に、すべての会話にエージェントが含まれます。」

GoogleのAI製品を大いに活用し、他の企業に配布するDeloitteの幹部Kevin Laughridgeは、エージェント市場を「土地の奪い合い」と表現し、Googleのプロトコルと統合プラットフォームによる早期の動きが大きな優位性を提供すると述べました。「最初に進出し、実際に価値を提供するエージェントを最も多く獲得する者がこのレースで勝つ」とLaughridgeはインタビューで述べました。彼はGoogleの進歩が「驚くべきもの」と述べ、1年前にDeloitteが構築したカスタムエージェントが今ではAgentspaceを使って「すぐに」再現可能だと指摘しました。Deloitte自体は、財務、リスク、エンジニアリングなどのミドルオフィス機能向けにプラットフォーム上で100のエージェントを構築していると彼は言いました。

顧客の証明ポイントが増えています。Nextで、Googleは生成AIで「500以上の顧客が本番環境にいる」と引用し、1年前の「数十のプロトタイプ」から増加しました。1年前にMicrosoftが大きくリードしていると見られていたとしても、それはもはや明らかではありません。すべての側からのPR戦争を考えると、誰が本当に勝っているかを決定的に言うのは難しいです。指標は異なります。Googleの500という数字は、Microsoftが宣伝する400のケーススタディと直接比較できません(Microsoftは、報道時点でVentureBeatに対し、この公開数を近日中に600に更新する予定だと述べ、激しいマーケティングを強調しています)。Googleのアプリを通じたAIの配布が重要である一方、Microsoftの365を通じたCopilotの配布も同様に印象的です。両者は現在、APIを通じて数百万の開発者に到達しています。

しかし、Googleの牽引力の例は豊富です:

- Wendy’s: わずか1年でAIドライブスルーシステムを数千の店舗に展開し、従業員体験と注文精度を改善しました。Google CloudのCTOであるWill Grannisは、AIシステムがスラングを理解し、背景ノイズをフィルタリングする能力があり、ライブの顧客対話のストレスを大幅に軽減すると指摘しました。これにより、スタッフは食品準備と品質に集中でき、Grannisはこれを「AIが現実の運用を効率化する素晴らしい例」と呼びました。

- Salesforce: Google Cloudでプラットフォームを初めて実行する(AWSを超えて)大幅な拡張を発表し、Googleの「イノベーションと最適化を支援する能力」を引用しました。

- Honeywell & Intuit: 以前はMicrosoftやAWSと強く関連していた企業が、現在Google CloudとAIイニシアチブで提携しています。

- 主要銀行(Deutsche Bank、Wells Fargo): エージェントとGeminiを活用して、研究、分析、顧客サービスの近代化を行っています。

- 小売業者(Walmart、Mercado Libre、Lowe’s): 検索、エージェント、データプラットフォームを使用しています。

このエンタープライズの牽引力は、Google Cloudの全体的な成長を推進し、過去3四半期でAWSとAzureを上回りました。Google Cloudは2018年の50億ドルから、2024年には440億ドルの年換算収益に達しました。

競争の海を航海する

Googleの上昇は、競合他社が立ち止まっているわけではありません。OpenAIは今週、GPT-4.1(コーディングと長コンテキストに焦点)とoシリーズ(マルチモーダル推論、ツール使用)の迅速なリリースで、継続的なイノベーションを示しました。さらに、OpenAIのGPT-4oの新しい画像生成機能のアップデートは、過去1か月で大きな成長を促進し、ChatGPTが8億ユーザーに到達するのを助けました。Microsoftは広大なエンタープライズの足跡とOpenAIとのパートナーシップを活用し続け、Anthropicは特にコーディングと安全を意識したアプリケーションで強力な競争者です。

しかし、Googleの物語が驚くほど改善したことは議論の余地がありません。わずか1年前、Googleは鈍重で、ためらいがちで、失敗を繰り返す競争者と見られ、AIをリードするチャンスを逃すかもしれないと思われていました。しかし、その独自の統合スタックと企業の堅固さは別のことを明らかにしました:Googleは、チップ設計(TPU)やグローバルインフラから基礎モデル研究(DeepMind)、アプリケーション開発(Workspace、Search、YouTube)、エンタープライズクラウドサービス(Vertex AI、BigQuery、Agentspace)まで、スペクトル全体で世界クラスの能力を持っています。「我々は基礎モデル会話に参加する唯一のハイパースケーラーだ」とdeSouzaは断言しました。このエンドツーエンドの所有権は、「ドルあたりの知能」のような最適化と、パートナーシップに依存するモデルが匹敵するのが難しい統合の深さを可能にします。競合他社はしばしば異なるピースをつなぎ合わせる必要があり、摩擦を生み出したり、イノベーションの速度を制限する可能性があります。

Googleの瞬間は今

AIレースは依然としてダイナミックですが、Googleは市場が求める正確な瞬間にこれらのピースを揃えました。DeloitteのLaughridgeが言ったように、Googleは「市場が求めたところ」でその能力が完全に一致するポイントに達しました。GoogleがエンタープライズAIでその実力を証明するのを待っていたなら、その瞬間を見逃したかもしれません — すでに証明されています。この革命を推進する多くの核心技術を発明した企業は、ついに追いつき、それ以上に、競合他社が追いつく必要があるペースを設定しています。

以下のビデオでは、Next直後に録画され、AI専門家のSam Witteveenと私が現在の風景と新たなトレンド、そしてGoogleのAIエコシステムがなぜこれほど強力に感じられるかを分析しています:

サティヤ・ナデラ、新たなOpenAIとの契約を活用する準備ができている

水曜日に、ウォール・ストリートのアナリストがマイクロソフトのCEOであるサティヤ・ナデラ氏に直接尋ねました。改正されたOpenAIとの提携関係が同社の財務状況にどのような影響を与えるのかと。ナデラ氏はこの新しい協定を「皆にとっての勝利」と表現しました。「OpenAIとの提携については満足しています。私は常にどんな提携でもウィンウィンの関係を築くことに重点を置いています。そうすることで、長期的に良いパートナーシップを維持できるからです。」彼は、マイクロソフトが依然としてOpenAIの知的財産、

サティヤ・ナデラ、新たなOpenAIとの契約を活用する準備ができている

水曜日に、ウォール・ストリートのアナリストがマイクロソフトのCEOであるサティヤ・ナデラ氏に直接尋ねました。改正されたOpenAIとの提携関係が同社の財務状況にどのような影響を与えるのかと。ナデラ氏はこの新しい協定を「皆にとっての勝利」と表現しました。「OpenAIとの提携については満足しています。私は常にどんな提携でもウィンウィンの関係を築くことに重点を置いています。そうすることで、長期的に良いパートナーシップを維持できるからです。」彼は、マイクロソフトが依然としてOpenAIの知的財産、

OpenAIは、公的基金、ロボット税、週4日勤務制を柱とするAI経済の構想を提示した

各国政府が超知能機械による経済的影響への対応に苦慮する中、OpenAIは「知能の時代」において富と労働がどのように再構築されるべきかを概説した一連の政策提言を発表した。その構想は、公的資産基金や社会安全網の拡充といった伝統的な左派的な仕組みと、根本的に資本主義的で市場主導型の経済枠組みとを融合させたものである。OpenAIの提案は本質的に「要望リスト」に相当し、人工知能が労働と経済を変革する中で、

OpenAIは、公的基金、ロボット税、週4日勤務制を柱とするAI経済の構想を提示した

各国政府が超知能機械による経済的影響への対応に苦慮する中、OpenAIは「知能の時代」において富と労働がどのように再構築されるべきかを概説した一連の政策提言を発表した。その構想は、公的資産基金や社会安全網の拡充といった伝統的な左派的な仕組みと、根本的に資本主義的で市場主導型の経済枠組みとを融合させたものである。OpenAIの提案は本質的に「要望リスト」に相当し、人工知能が労働と経済を変革する中で、

Google、インドでChrome向け「Gemini」の提供を開始

水曜日、GoogleはChrome向けGeminiの統合機能を、インド、カナダ、ニュージーランドを含む新たな地域へ拡大すると発表した。この展開により、デスクトップユーザーはサイドバーからGeminiにアクセスできるようになり、画面上のコンテンツについてGoogleのAIチャットボットに質問したり、Gmail、Keep、Drive、YouTubeから情報を取得したり、タブの内容を比較したりすることが

Google、インドでChrome向け「Gemini」の提供を開始

水曜日、GoogleはChrome向けGeminiの統合機能を、インド、カナダ、ニュージーランドを含む新たな地域へ拡大すると発表した。この展開により、デスクトップユーザーはサイドバーからGeminiにアクセスできるようになり、画面上のコンテンツについてGoogleのAIチャットボットに質問したり、Gmail、Keep、Drive、YouTubeから情報を取得したり、タブの内容を比較したりすることが

Interesting read! It's wild how Google went from playing catch-up to leading the pack in enterprise AI so quickly. The Transformer foundation was huge, but maybe the real shift was focusing on enterprise needs instead of just chasing consumer hype? 🤔 Still, with Microsoft and OpenAI pushing hard, I wonder if this lead will last.

Очень странно читать это. Все говорят о лидерстве OpenAI, а Google уже делает реальные продукты для бизнеса. Может, они научились действовать скрытно? 🤔 Это напоминает гонку вооружений в IT... Интересно, какие последствия будут для конкуренции?

Google's AI comeback is wild! 😎 I thought they were out of the game, but their enterprise push is sneaky strong. Wonder if they’ll dominate the market soon?

Google's quiet climb in enterprise AI is wild! 😎 I thought they were out of the game, but this Transformer legacy is no joke. Curious if they’ll outpace Microsoft soon?

GoogleのエンタープライズAIへの進出は感動的だね。追いつくことから先頭に立つまで、彼らは本当にゲームを上げた。でもインターフェースはもう少し改善が必要だね;ちょっとぎこちない。でも、これからどこに向かうのか楽しみだよ!🚀

家

家