AIパフォーマンスの向上と大規模言語モデルにおける簡潔な推論

大規模言語モデル(LLM)は、人工知能(AI)を革新し、人間のようなテキストを生成し、さまざまな産業で複雑な課題に取り組んでいます。これまで専門家は、推論チェーンの拡張が精度を高め、ステップ数が多いほど信頼性の高い結果が得られると考えていました。

2025年のメタのFAIRチームとエルサレム・ヘブライ大学の研究は、この考えに挑戦しています。この研究では、短い推論チェーンがLLMの精度を最大34.5%向上させ、計算コストを40%削減できることが明らかになりました。簡潔な推論は処理を加速し、LLMのトレーニング、展開、スケーラビリティを再構築する可能性を秘めています。

簡潔な推論がAI効率を向上させる理由

従来、長い推論チェーンは、より多くのデータを処理することでAIの成果を向上させると考えられていました。ロジックは単純でした:ステップが多いほど分析が深まり、精度が向上するということです。その結果、AIシステムはパフォーマンス向上のために推論の拡張を優先しました。

しかし、このアプローチには欠点があります。長いチェーンは膨大な計算能力を要求し、処理速度を低下させ、特に迅速な応答が求められるリアルタイムアプリケーションではコストを増加させます。さらに、複雑なチェーンはエラーリスクを高め、スピードと精度の両方が必要な産業での効率とスケーラビリティを低下させます。

メタ主導の研究はこれらの欠点を浮き彫りにし、短い推論チェーンが精度を向上させつつ計算負荷を軽減することを示しています。これにより、信頼性を犠牲にせずにタスク処理が高速化します。

これらの知見は、AI開発の焦点を推論ステップの最大化からプロセス最適化に移します。短いチェーンは効率を高め、信頼性の高い結果を提供し、処理時間を短縮します。

short-m@kフレームワークによる推論の最適化

この研究は、LLMの多段階推論を効率化するために設計されたshort-m@k推論フレームワークを紹介します。従来の逐次処理や多数決方式とは異なり、並列処理と早期終了を利用して効率を高め、コストを削減します。

short-m@kアプローチでは、k個の並列推論チェーンが同時に実行され、最初のm個のチェーンが完了すると停止します。最終的な予測はこれらの早期結果から多数決を用いて行われ、不要な計算を最小限に抑えつつ精度を維持します。

このフレームワークには2つのバリエーションがあります:

short-1@k: k個の並列試行から最初に完了したチェーンを選択し、低リソースで遅延に敏感な設定に最適で、最小限の計算コストで高い精度を提供します。

short-3@k: 最初に完了した3つのチェーンから結果を統合し、従来の方法を精度とスループットで上回り、高性能で大規模な環境に適しています。

short-m@kフレームワークは、モデルの微調整も改善します。簡潔な推論シーケンスでのトレーニングは収束を加速し、トレーニングと展開中の推論精度とリソース効率を向上させます。

AI開発と産業利用への影響

短い推論チェーンは、AIモデルの開発、展開、持続可能性に大きな影響を与えます。

トレーニングでは、簡潔なチェーンが計算の複雑さを軽減し、追加のインフラを必要とせずにコストを下げ、更新を加速します。

展開では、特にチャットボットや取引プラットフォームのような時間に敏感なアプリケーションで、短いチェーンが処理速度を向上させ、システムが高需要下で効率的かつ効果的にスケールできるようにします。

エネルギー効率も利点です。トレーニングと推論中の計算量の削減は消費電力を減らし、コストを削減し、データセンターのエネルギー需要が増加する中での環境目標を支援します。

全体として、これらの効率はAI開発を加速し、AIソリューションの市場投入を迅速化し、組織がダイナミックな技術環境で競争力を維持するのを助けます。

簡潔な推論採用の課題への対応

短い推論チェーンは明らかな利点を提供しますが、実装には課題があります。

従来のAIシステムは長い推論向けに構築されており、モデルアーキテクチャ、トレーニング方法、最適化戦略の再構築が必要で、技術的専門知識と組織の適応力が必要です。

データ品質と構造が重要です。長い推論向けにトレーニングされたデータセットでモデルが短いパスで失敗する可能性があります。簡潔でターゲット指向の推論向けにデータセットをキュレーションすることが精度を維持するために不可欠です。

スケーラビリティも課題です。制御された設定では効果的ですが、eコマースやカスタマーサポートのような大規模アプリケーションでは、パフォーマンスを損なわずに高いリクエスト量を管理する堅牢なインフラが必要です。

これらに対応する戦略には以下が含まれます:

- short-m@kフレームワークの実装:並列処理と早期終了を活用し、リアルタイムアプリケーションでスピードと精度のバランスを取ります。

- トレーニングでの簡潔な推論の重視:短いチェーンを強調する方法を使用してリソースとスピードを最適化します。

- 推論メトリクスの追跡:チェーンの長さとモデルのパフォーマンスをリアルタイムで監視し、継続的な効率と精度を確保します。

これらの戦略により、開発者は短い推論チェーンを採用し、運用およびコスト効率の目標を満たす、より高速で正確かつスケーラブルなAIシステムを構築できます。

結論

簡潔な推論チェーンに関する研究は、AI開発を再定義します。短いチェーンはスピード、精度、コスト効率を向上させ、パフォーマンスを重視する産業にとって重要です。

簡潔な推論を採用することで、AIシステムは追加のリソースなしで改善され、効率的な開発と展開が可能になります。このアプローチは、AIが多様なニーズを満たすことを可能にし、開発者と企業を急速に進化する技術環境で競争力のある位置に保ちます。

関連記事

Magi-1公開:先駆的なAIビデオ生成技術

Magi-1の詳細な分析を探索してください。これは、自己回帰型ビデオ作成を革新する革新的なAIプラットフォームです。この記事では、その独自の機能、価格構造、パフォーマンス指標について詳しく説明します。コンテンツクリエイター、マーケティング担当者、技術愛好者に最適なMagi-1は、ビデオ制作に新たな可能性を開きます。その能力を詳しく見ていきましょう!ハイライトMagi-1は、卓越した品質を提供する最

Magi-1公開:先駆的なAIビデオ生成技術

Magi-1の詳細な分析を探索してください。これは、自己回帰型ビデオ作成を革新する革新的なAIプラットフォームです。この記事では、その独自の機能、価格構造、パフォーマンス指標について詳しく説明します。コンテンツクリエイター、マーケティング担当者、技術愛好者に最適なMagi-1は、ビデオ制作に新たな可能性を開きます。その能力を詳しく見ていきましょう!ハイライトMagi-1は、卓越した品質を提供する最

AI駆動のグラフィックデザイン:2025年のトップツールとテクニック

2025年、人工知能(AI)は産業を再構築しており、グラフィックデザインがその変革の最前線にあります。AIツールは、創造性を高め、ワークフローを最適化し、効率を新たな高みに引き上げ、デザイナーを支援しています。2025年のグラフィックデザイナー向けの最高のAIツールと戦略のガイドで、AIがどのようにあなたのデザインスキルを向上させるかをご覧ください。主なポイントAIは、日常的なタスクを自動化し、新

AI駆動のグラフィックデザイン:2025年のトップツールとテクニック

2025年、人工知能(AI)は産業を再構築しており、グラフィックデザインがその変革の最前線にあります。AIツールは、創造性を高め、ワークフローを最適化し、効率を新たな高みに引き上げ、デザイナーを支援しています。2025年のグラフィックデザイナー向けの最高のAIツールと戦略のガイドで、AIがどのようにあなたのデザインスキルを向上させるかをご覧ください。主なポイントAIは、日常的なタスクを自動化し、新

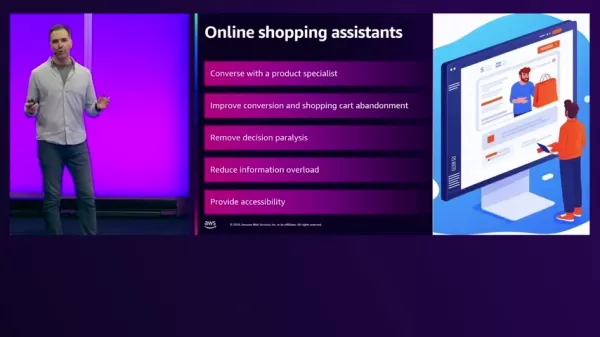

AI駆動のショッピングアシスタントがAWSでEコマースを変革

今日の急速に変化するEコマース環境では、小売業者は顧客体験を向上させ、売上を伸ばす努力をしています。生成AIは、インテリジェントなショッピングアシスタントを活用して、インタラクションのパーソナライズ、商品発見の簡素化、アクセシビリティの向上を実現する革新的なソリューションを提供します。この記事では、オンライン小売の課題を検討し、AWSが高度なAIソリューションの開発を可能にすることでそれらを克服し

コメント (0)

0/200

AI駆動のショッピングアシスタントがAWSでEコマースを変革

今日の急速に変化するEコマース環境では、小売業者は顧客体験を向上させ、売上を伸ばす努力をしています。生成AIは、インテリジェントなショッピングアシスタントを活用して、インタラクションのパーソナライズ、商品発見の簡素化、アクセシビリティの向上を実現する革新的なソリューションを提供します。この記事では、オンライン小売の課題を検討し、AWSが高度なAIソリューションの開発を可能にすることでそれらを克服し

コメント (0)

0/200

大規模言語モデル(LLM)は、人工知能(AI)を革新し、人間のようなテキストを生成し、さまざまな産業で複雑な課題に取り組んでいます。これまで専門家は、推論チェーンの拡張が精度を高め、ステップ数が多いほど信頼性の高い結果が得られると考えていました。

2025年のメタのFAIRチームとエルサレム・ヘブライ大学の研究は、この考えに挑戦しています。この研究では、短い推論チェーンがLLMの精度を最大34.5%向上させ、計算コストを40%削減できることが明らかになりました。簡潔な推論は処理を加速し、LLMのトレーニング、展開、スケーラビリティを再構築する可能性を秘めています。

簡潔な推論がAI効率を向上させる理由

従来、長い推論チェーンは、より多くのデータを処理することでAIの成果を向上させると考えられていました。ロジックは単純でした:ステップが多いほど分析が深まり、精度が向上するということです。その結果、AIシステムはパフォーマンス向上のために推論の拡張を優先しました。

しかし、このアプローチには欠点があります。長いチェーンは膨大な計算能力を要求し、処理速度を低下させ、特に迅速な応答が求められるリアルタイムアプリケーションではコストを増加させます。さらに、複雑なチェーンはエラーリスクを高め、スピードと精度の両方が必要な産業での効率とスケーラビリティを低下させます。

メタ主導の研究はこれらの欠点を浮き彫りにし、短い推論チェーンが精度を向上させつつ計算負荷を軽減することを示しています。これにより、信頼性を犠牲にせずにタスク処理が高速化します。

これらの知見は、AI開発の焦点を推論ステップの最大化からプロセス最適化に移します。短いチェーンは効率を高め、信頼性の高い結果を提供し、処理時間を短縮します。

short-m@kフレームワークによる推論の最適化

この研究は、LLMの多段階推論を効率化するために設計されたshort-m@k推論フレームワークを紹介します。従来の逐次処理や多数決方式とは異なり、並列処理と早期終了を利用して効率を高め、コストを削減します。

short-m@kアプローチでは、k個の並列推論チェーンが同時に実行され、最初のm個のチェーンが完了すると停止します。最終的な予測はこれらの早期結果から多数決を用いて行われ、不要な計算を最小限に抑えつつ精度を維持します。

このフレームワークには2つのバリエーションがあります:

short-1@k: k個の並列試行から最初に完了したチェーンを選択し、低リソースで遅延に敏感な設定に最適で、最小限の計算コストで高い精度を提供します。

short-3@k: 最初に完了した3つのチェーンから結果を統合し、従来の方法を精度とスループットで上回り、高性能で大規模な環境に適しています。

short-m@kフレームワークは、モデルの微調整も改善します。簡潔な推論シーケンスでのトレーニングは収束を加速し、トレーニングと展開中の推論精度とリソース効率を向上させます。

AI開発と産業利用への影響

短い推論チェーンは、AIモデルの開発、展開、持続可能性に大きな影響を与えます。

トレーニングでは、簡潔なチェーンが計算の複雑さを軽減し、追加のインフラを必要とせずにコストを下げ、更新を加速します。

展開では、特にチャットボットや取引プラットフォームのような時間に敏感なアプリケーションで、短いチェーンが処理速度を向上させ、システムが高需要下で効率的かつ効果的にスケールできるようにします。

エネルギー効率も利点です。トレーニングと推論中の計算量の削減は消費電力を減らし、コストを削減し、データセンターのエネルギー需要が増加する中での環境目標を支援します。

全体として、これらの効率はAI開発を加速し、AIソリューションの市場投入を迅速化し、組織がダイナミックな技術環境で競争力を維持するのを助けます。

簡潔な推論採用の課題への対応

短い推論チェーンは明らかな利点を提供しますが、実装には課題があります。

従来のAIシステムは長い推論向けに構築されており、モデルアーキテクチャ、トレーニング方法、最適化戦略の再構築が必要で、技術的専門知識と組織の適応力が必要です。

データ品質と構造が重要です。長い推論向けにトレーニングされたデータセットでモデルが短いパスで失敗する可能性があります。簡潔でターゲット指向の推論向けにデータセットをキュレーションすることが精度を維持するために不可欠です。

スケーラビリティも課題です。制御された設定では効果的ですが、eコマースやカスタマーサポートのような大規模アプリケーションでは、パフォーマンスを損なわずに高いリクエスト量を管理する堅牢なインフラが必要です。

これらに対応する戦略には以下が含まれます:

- short-m@kフレームワークの実装:並列処理と早期終了を活用し、リアルタイムアプリケーションでスピードと精度のバランスを取ります。

- トレーニングでの簡潔な推論の重視:短いチェーンを強調する方法を使用してリソースとスピードを最適化します。

- 推論メトリクスの追跡:チェーンの長さとモデルのパフォーマンスをリアルタイムで監視し、継続的な効率と精度を確保します。

これらの戦略により、開発者は短い推論チェーンを採用し、運用およびコスト効率の目標を満たす、より高速で正確かつスケーラブルなAIシステムを構築できます。

結論

簡潔な推論チェーンに関する研究は、AI開発を再定義します。短いチェーンはスピード、精度、コスト効率を向上させ、パフォーマンスを重視する産業にとって重要です。

簡潔な推論を採用することで、AIシステムは追加のリソースなしで改善され、効率的な開発と展開が可能になります。このアプローチは、AIが多様なニーズを満たすことを可能にし、開発者と企業を急速に進化する技術環境で競争力のある位置に保ちます。

Magi-1公開:先駆的なAIビデオ生成技術

Magi-1の詳細な分析を探索してください。これは、自己回帰型ビデオ作成を革新する革新的なAIプラットフォームです。この記事では、その独自の機能、価格構造、パフォーマンス指標について詳しく説明します。コンテンツクリエイター、マーケティング担当者、技術愛好者に最適なMagi-1は、ビデオ制作に新たな可能性を開きます。その能力を詳しく見ていきましょう!ハイライトMagi-1は、卓越した品質を提供する最

Magi-1公開:先駆的なAIビデオ生成技術

Magi-1の詳細な分析を探索してください。これは、自己回帰型ビデオ作成を革新する革新的なAIプラットフォームです。この記事では、その独自の機能、価格構造、パフォーマンス指標について詳しく説明します。コンテンツクリエイター、マーケティング担当者、技術愛好者に最適なMagi-1は、ビデオ制作に新たな可能性を開きます。その能力を詳しく見ていきましょう!ハイライトMagi-1は、卓越した品質を提供する最

AI駆動のグラフィックデザイン:2025年のトップツールとテクニック

2025年、人工知能(AI)は産業を再構築しており、グラフィックデザインがその変革の最前線にあります。AIツールは、創造性を高め、ワークフローを最適化し、効率を新たな高みに引き上げ、デザイナーを支援しています。2025年のグラフィックデザイナー向けの最高のAIツールと戦略のガイドで、AIがどのようにあなたのデザインスキルを向上させるかをご覧ください。主なポイントAIは、日常的なタスクを自動化し、新

AI駆動のグラフィックデザイン:2025年のトップツールとテクニック

2025年、人工知能(AI)は産業を再構築しており、グラフィックデザインがその変革の最前線にあります。AIツールは、創造性を高め、ワークフローを最適化し、効率を新たな高みに引き上げ、デザイナーを支援しています。2025年のグラフィックデザイナー向けの最高のAIツールと戦略のガイドで、AIがどのようにあなたのデザインスキルを向上させるかをご覧ください。主なポイントAIは、日常的なタスクを自動化し、新

AI駆動のショッピングアシスタントがAWSでEコマースを変革

今日の急速に変化するEコマース環境では、小売業者は顧客体験を向上させ、売上を伸ばす努力をしています。生成AIは、インテリジェントなショッピングアシスタントを活用して、インタラクションのパーソナライズ、商品発見の簡素化、アクセシビリティの向上を実現する革新的なソリューションを提供します。この記事では、オンライン小売の課題を検討し、AWSが高度なAIソリューションの開発を可能にすることでそれらを克服し

AI駆動のショッピングアシスタントがAWSでEコマースを変革

今日の急速に変化するEコマース環境では、小売業者は顧客体験を向上させ、売上を伸ばす努力をしています。生成AIは、インテリジェントなショッピングアシスタントを活用して、インタラクションのパーソナライズ、商品発見の簡素化、アクセシビリティの向上を実現する革新的なソリューションを提供します。この記事では、オンライン小売の課題を検討し、AWSが高度なAIソリューションの開発を可能にすることでそれらを克服し