Google की नवीनतम AI मॉडल रिपोर्ट में प्रमुख सुरक्षा विवरण का अभाव है, विशेषज्ञों का कहना है कि

गुरुवार को, अपनी नवीनतम और सबसे उन्नत AI मॉडल, Gemini 2.5 Pro, लॉन्च करने के हफ्तों बाद, Google ने अपनी आंतरिक सुरक्षा मूल्यांकन के परिणामों का विवरण देने वाली एक तकनीकी रिपोर्ट जारी की। हालांकि, विशेषज्ञों ने रिपोर्ट में विस्तार की कमी के लिए आलोचना की है, जिससे मॉडल से जुड़े संभावित जोखिमों को पूरी तरह समझना मुश्किल हो रहा है।

AI दुनिया में तकनीकी रिपोर्ट महत्वपूर्ण हैं, जो अंतर्दृष्टि प्रदान करती हैं—भले ही वे कभी-कभी अप्रिय हों—जो कंपनियां आमतौर पर सार्वजनिक रूप से साझा नहीं करतीं। AI समुदाय इन रिपोर्टों को स्वतंत्र अनुसंधान को बढ़ावा देने और सुरक्षा मूल्यांकन को बेहतर बनाने के लिए वास्तविक प्रयासों के रूप में देखता है।

Google का सुरक्षा रिपोर्टिंग दृष्टिकोण कुछ प्रतिस्पर्धियों से अलग है। कंपनी केवल तभी तकनीकी रिपोर्ट प्रकाशित करती है जब कोई मॉडल "प्रायोगिक" चरण से आगे बढ़ जाता है। इसके अलावा, Google इन रिपोर्टों में कुछ "खतरनाक क्षमता" मूल्यांकन परिणामों को छोड़ देता है, उन्हें एक अलग ऑडिट के लिए सहेजता है।

इसके बावजूद, कई विशेषज्ञों ने TechCrunch को Gemini 2.5 Pro रिपोर्ट के बारे में निराशा व्यक्त की, जिसमें Google के प्रस्तावित Frontier Safety Framework (FSF) के न्यूनतम कवरेज की ओर इशारा किया। Google ने पिछले साल FSF का अनावरण किया था, जिसका उद्देश्य भविष्य की AI क्षमताओं को पहचानना है जो "गंभीर नुकसान" का कारण बन सकती हैं।

"यह रिपोर्ट बहुत कम जानकारी वाली है, इसमें न्यूनतम जानकारी है, और मॉडल के सार्वजनिक होने के हफ्तों बाद जारी की गई," Institute for AI Policy and Strategy के सह-संस्थापक पीटर विल्डफोर्ड ने TechCrunch को बताया। "यह सत्यापित करना असंभव है कि Google अपनी सार्वजनिक प्रतिबद्धताओं को पूरा कर रहा है या नहीं, और इसलिए उनके मॉडलों की सुरक्षा और संरक्षा का आकलन करना असंभव है।"

Secure AI Project के सह-संस्थापक थॉमस वुडसाइड ने Gemini 2.5 Pro के लिए रिपोर्ट के जारी होने को स्वीकार किया, लेकिन Google की समय पर पूरक सुरक्षा मूल्यांकन प्रदान करने की प्रतिबद्धता पर सवाल उठाया। उन्होंने उल्लेख किया कि Google ने आखिरी बार जून 2024 में खतरनाक क्षमता परीक्षण परिणाम प्रकाशित किए थे, जो उस साल फरवरी में घोषित मॉडल के लिए थे।

चिंताओं को बढ़ाते हुए, Google ने अभी तक Gemini 2.5 Flash के लिए कोई रिपोर्ट जारी नहीं की है, जो पिछले हफ्ते घोषित एक छोटा, अधिक कुशल मॉडल है। एक प्रवक्ता ने TechCrunch को बताया कि Flash के लिए एक रिपोर्ट "जल्द ही आ रही है।"

"मुझे उम्मीद है कि यह Google से अधिक बार अपडेट प्रकाशित करने का वादा है," वुडसाइड ने TechCrunch को बताया। "उन अपडेट्स में उन मॉडलों के मूल्यांकन परिणाम शामिल होने चाहिए जो अभी तक सार्वजनिक रूप से तैनात नहीं किए गए हैं, क्योंकि वे मॉडल भी गंभीर जोखिम पैदा कर सकते हैं।"

हालांकि Google उन पहले AI लैब्स में से था जिन्होंने मॉडलों के लिए मानकीकृत रिपोर्टों का प्रस्ताव रखा, लेकिन पारदर्शिता की कमी के लिए आलोचना का सामना करने वाला यह अकेला नहीं है। Meta ने अपने नए Llama 4 ओपन मॉडलों के लिए इसी तरह की संक्षिप्त सुरक्षा मूल्यांकन जारी किया, और OpenAI ने अपने GPT-4.1 सीरीज के लिए कोई भी रिपोर्ट प्रकाशित नहीं करने का फैसला किया।

Google के नियामकों को AI सुरक्षा परीक्षण और रिपोर्टिंग में उच्च मानकों को बनाए रखने के आश्वासन ने स्थिति पर दबाव बढ़ाया है। दो साल पहले, Google ने अमेरिकी सरकार से वादा किया था कि वह सभी "महत्वपूर्ण" सार्वजनिक AI मॉडलों के लिए सुरक्षा रिपोर्ट प्रकाशित करेगा, इसके बाद अन्य देशों के साथ भी इसी तरह की प्रतिबद्धताएं कीं, जिनमें AI उत्पादों के आसपास "सार्वजनिक पारदर्शिता" का वादा किया गया।

Center for Democracy and Technology में AI गवर्नेंस के वरिष्ठ सलाहकार केविन बैंकस्टन ने छिटपुट और अस्पष्ट रिपोर्टों की प्रवृत्ति को AI सुरक्षा पर "नीचे की ओर दौड़" के रूप में वर्णित किया।

"प्रतिस्पर्धी लैब्स जैसे OpenAI द्वारा रिलीज से पहले सुरक्षा परीक्षण समय को महीनों से दिनों तक कम करने की रिपोर्टों के साथ, Google के शीर्ष AI मॉडल के लिए यह कमजोर दस्तावेजीकरण AI सुरक्षा और पारदर्शिता पर नीचे की ओर दौड़ की एक चिंताजनक कहानी बताता है, क्योंकि कंपनियां अपने मॉडलों को बाजार में लाने की जल्दी में हैं," उन्होंने TechCrunch को बताया।

Google ने कहा है कि, हालांकि इसकी तकनीकी रिपोर्टों में विस्तृत नहीं है, यह मॉडलों के रिलीज से पहले सुरक्षा परीक्षण और "विरोधी रेड टीमें" आयोजित करता है।

4/22 को दोपहर 12:58 बजे प्रशांत समय पर अपडेट किया गया: Google के FSF के संदर्भ में तकनीकी रिपोर्ट की भाषा में संशोधन किया गया।

संबंधित लेख

Google ने उद्यम बाजार में OpenAI के साथ प्रतिस्पर्धा करने के लिए उत्पादन-तैयार Gemini 2.5 AI मॉडल्स का अनावरण किया

Google ने सोमवार को अपनी AI रणनीति को और मजबूत किया, उद्यम उपयोग के लिए अपने उन्नत Gemini 2.5 मॉडल्स को लॉन्च किया और कीमत व प्रदर्शन पर प्रतिस्पर्धा करने के लिए एक लागत-कुशल संस्करण पेश किया।Alphabet

Google ने उद्यम बाजार में OpenAI के साथ प्रतिस्पर्धा करने के लिए उत्पादन-तैयार Gemini 2.5 AI मॉडल्स का अनावरण किया

Google ने सोमवार को अपनी AI रणनीति को और मजबूत किया, उद्यम उपयोग के लिए अपने उन्नत Gemini 2.5 मॉडल्स को लॉन्च किया और कीमत व प्रदर्शन पर प्रतिस्पर्धा करने के लिए एक लागत-कुशल संस्करण पेश किया।Alphabet

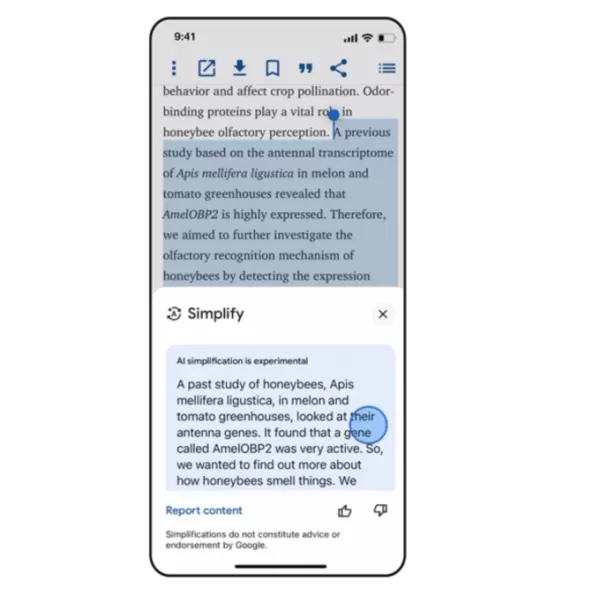

Google ने AI-संचालित Simplify टूल का अनावरण किया जो वेब पढ़ने को आसान बनाता है

Google का iOS ऐप अब एक “Simplify” सुविधा शामिल करता है, जो AI का उपयोग करके जटिल वेब टेक्स्ट को स्पष्ट, समझने योग्य सामग्री में बदल देता है बिना पेज छोड़े।Simplify टूल, जो Google Research द्वारा विकसि

Google ने AI-संचालित Simplify टूल का अनावरण किया जो वेब पढ़ने को आसान बनाता है

Google का iOS ऐप अब एक “Simplify” सुविधा शामिल करता है, जो AI का उपयोग करके जटिल वेब टेक्स्ट को स्पष्ट, समझने योग्य सामग्री में बदल देता है बिना पेज छोड़े।Simplify टूल, जो Google Research द्वारा विकसि

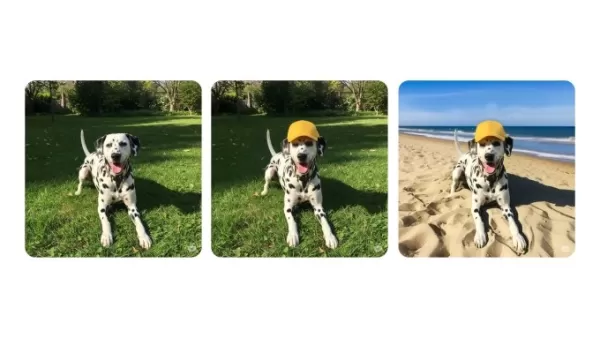

जेमिनी चैटबॉट छवि संपादन क्षमताओं को बढ़ाता है

गूगल का जेमिनी चैटबॉट ऐप अब उपयोगकर्ताओं को फोन या कंप्यूटर से AI-जनरेटेड और अपलोड की गई छवियों को संपादित करने की अनुमति देता है, कंपनी ने बुधवार को एक ब्लॉग पोस्ट में घोषणा की।जेमिनी की अंतर्निहित छ

सूचना (6)

0/200

जेमिनी चैटबॉट छवि संपादन क्षमताओं को बढ़ाता है

गूगल का जेमिनी चैटबॉट ऐप अब उपयोगकर्ताओं को फोन या कंप्यूटर से AI-जनरेटेड और अपलोड की गई छवियों को संपादित करने की अनुमति देता है, कंपनी ने बुधवार को एक ब्लॉग पोस्ट में घोषणा की।जेमिनी की अंतर्निहित छ

सूचना (6)

0/200

![MarkSanchez]() MarkSanchez

MarkSanchez

1 अगस्त 2025 7:17:34 अपराह्न IST

1 अगस्त 2025 7:17:34 अपराह्न IST

Google's AI safety report sounds like a half-baked cake – looks good but lacks substance. 😕 Why skimp on the details? Transparency matters when stakes are this high.

0

0

![WalterKing]() WalterKing

WalterKing

29 अप्रैल 2025 8:49:22 अपराह्न IST

29 अप्रैल 2025 8:49:22 अपराह्न IST

Der Bericht von Google über Gemini 2.5 Pro ist ein bisschen enttäuschend. Ich hatte mehr Details zu den Sicherheitsbewertungen erwartet, aber es scheint, als würden sie Informationen zurückhalten. Ohne die ganze Geschichte ist es schwer, der KI vollständig zu vertrauen. Vielleicht beim nächsten Mal, Google? 🤔

0

0

![CharlesThomas]() CharlesThomas

CharlesThomas

29 अप्रैल 2025 6:47:55 पूर्वाह्न IST

29 अप्रैल 2025 6:47:55 पूर्वाह्न IST

ジェミニ2.5プロのレポート、ちょっとがっかりですね。安全評価の詳細をもっと知りたかったのに、情報が少なすぎる。AIを完全に信頼するのは難しいです。次回はもっと詳しくお願いします!😅

0

0

![AlbertWalker]() AlbertWalker

AlbertWalker

29 अप्रैल 2025 4:45:07 पूर्वाह्न IST

29 अप्रैल 2025 4:45:07 पूर्वाह्न IST

Google's report on Gemini 2.5 Pro is a bit of a letdown. I was expecting more juicy details about the safety assessments, but it feels like they're holding back. It's hard to trust the AI fully without knowing the full story. Maybe next time, Google? 🤔

0

0

![JimmyGarcia]() JimmyGarcia

JimmyGarcia

29 अप्रैल 2025 1:31:42 पूर्वाह्न IST

29 अप्रैल 2025 1:31:42 पूर्वाह्न IST

O relatório do Google sobre o Gemini 2.5 Pro é um pouco decepcionante. Esperava mais detalhes sobre as avaliações de segurança, mas parece que eles estão escondendo algo. É difícil confiar totalmente na IA sem saber toda a história. Talvez na próxima, Google? 🤔

0

0

![BillyThomas]() BillyThomas

BillyThomas

28 अप्रैल 2025 5:11:33 पूर्वाह्न IST

28 अप्रैल 2025 5:11:33 पूर्वाह्न IST

El informe de Google sobre Gemini 2.5 Pro es decepcionante. Esperaba más detalles sobre las evaluaciones de seguridad, pero parece que están ocultando información. Es difícil confiar en la IA sin conocer toda la historia. ¿Tal vez la próxima vez, Google? 🤔

0

0

गुरुवार को, अपनी नवीनतम और सबसे उन्नत AI मॉडल, Gemini 2.5 Pro, लॉन्च करने के हफ्तों बाद, Google ने अपनी आंतरिक सुरक्षा मूल्यांकन के परिणामों का विवरण देने वाली एक तकनीकी रिपोर्ट जारी की। हालांकि, विशेषज्ञों ने रिपोर्ट में विस्तार की कमी के लिए आलोचना की है, जिससे मॉडल से जुड़े संभावित जोखिमों को पूरी तरह समझना मुश्किल हो रहा है।

AI दुनिया में तकनीकी रिपोर्ट महत्वपूर्ण हैं, जो अंतर्दृष्टि प्रदान करती हैं—भले ही वे कभी-कभी अप्रिय हों—जो कंपनियां आमतौर पर सार्वजनिक रूप से साझा नहीं करतीं। AI समुदाय इन रिपोर्टों को स्वतंत्र अनुसंधान को बढ़ावा देने और सुरक्षा मूल्यांकन को बेहतर बनाने के लिए वास्तविक प्रयासों के रूप में देखता है।

Google का सुरक्षा रिपोर्टिंग दृष्टिकोण कुछ प्रतिस्पर्धियों से अलग है। कंपनी केवल तभी तकनीकी रिपोर्ट प्रकाशित करती है जब कोई मॉडल "प्रायोगिक" चरण से आगे बढ़ जाता है। इसके अलावा, Google इन रिपोर्टों में कुछ "खतरनाक क्षमता" मूल्यांकन परिणामों को छोड़ देता है, उन्हें एक अलग ऑडिट के लिए सहेजता है।

इसके बावजूद, कई विशेषज्ञों ने TechCrunch को Gemini 2.5 Pro रिपोर्ट के बारे में निराशा व्यक्त की, जिसमें Google के प्रस्तावित Frontier Safety Framework (FSF) के न्यूनतम कवरेज की ओर इशारा किया। Google ने पिछले साल FSF का अनावरण किया था, जिसका उद्देश्य भविष्य की AI क्षमताओं को पहचानना है जो "गंभीर नुकसान" का कारण बन सकती हैं।

"यह रिपोर्ट बहुत कम जानकारी वाली है, इसमें न्यूनतम जानकारी है, और मॉडल के सार्वजनिक होने के हफ्तों बाद जारी की गई," Institute for AI Policy and Strategy के सह-संस्थापक पीटर विल्डफोर्ड ने TechCrunch को बताया। "यह सत्यापित करना असंभव है कि Google अपनी सार्वजनिक प्रतिबद्धताओं को पूरा कर रहा है या नहीं, और इसलिए उनके मॉडलों की सुरक्षा और संरक्षा का आकलन करना असंभव है।"

Secure AI Project के सह-संस्थापक थॉमस वुडसाइड ने Gemini 2.5 Pro के लिए रिपोर्ट के जारी होने को स्वीकार किया, लेकिन Google की समय पर पूरक सुरक्षा मूल्यांकन प्रदान करने की प्रतिबद्धता पर सवाल उठाया। उन्होंने उल्लेख किया कि Google ने आखिरी बार जून 2024 में खतरनाक क्षमता परीक्षण परिणाम प्रकाशित किए थे, जो उस साल फरवरी में घोषित मॉडल के लिए थे।

चिंताओं को बढ़ाते हुए, Google ने अभी तक Gemini 2.5 Flash के लिए कोई रिपोर्ट जारी नहीं की है, जो पिछले हफ्ते घोषित एक छोटा, अधिक कुशल मॉडल है। एक प्रवक्ता ने TechCrunch को बताया कि Flash के लिए एक रिपोर्ट "जल्द ही आ रही है।"

"मुझे उम्मीद है कि यह Google से अधिक बार अपडेट प्रकाशित करने का वादा है," वुडसाइड ने TechCrunch को बताया। "उन अपडेट्स में उन मॉडलों के मूल्यांकन परिणाम शामिल होने चाहिए जो अभी तक सार्वजनिक रूप से तैनात नहीं किए गए हैं, क्योंकि वे मॉडल भी गंभीर जोखिम पैदा कर सकते हैं।"

हालांकि Google उन पहले AI लैब्स में से था जिन्होंने मॉडलों के लिए मानकीकृत रिपोर्टों का प्रस्ताव रखा, लेकिन पारदर्शिता की कमी के लिए आलोचना का सामना करने वाला यह अकेला नहीं है। Meta ने अपने नए Llama 4 ओपन मॉडलों के लिए इसी तरह की संक्षिप्त सुरक्षा मूल्यांकन जारी किया, और OpenAI ने अपने GPT-4.1 सीरीज के लिए कोई भी रिपोर्ट प्रकाशित नहीं करने का फैसला किया।

Google के नियामकों को AI सुरक्षा परीक्षण और रिपोर्टिंग में उच्च मानकों को बनाए रखने के आश्वासन ने स्थिति पर दबाव बढ़ाया है। दो साल पहले, Google ने अमेरिकी सरकार से वादा किया था कि वह सभी "महत्वपूर्ण" सार्वजनिक AI मॉडलों के लिए सुरक्षा रिपोर्ट प्रकाशित करेगा, इसके बाद अन्य देशों के साथ भी इसी तरह की प्रतिबद्धताएं कीं, जिनमें AI उत्पादों के आसपास "सार्वजनिक पारदर्शिता" का वादा किया गया।

Center for Democracy and Technology में AI गवर्नेंस के वरिष्ठ सलाहकार केविन बैंकस्टन ने छिटपुट और अस्पष्ट रिपोर्टों की प्रवृत्ति को AI सुरक्षा पर "नीचे की ओर दौड़" के रूप में वर्णित किया।

"प्रतिस्पर्धी लैब्स जैसे OpenAI द्वारा रिलीज से पहले सुरक्षा परीक्षण समय को महीनों से दिनों तक कम करने की रिपोर्टों के साथ, Google के शीर्ष AI मॉडल के लिए यह कमजोर दस्तावेजीकरण AI सुरक्षा और पारदर्शिता पर नीचे की ओर दौड़ की एक चिंताजनक कहानी बताता है, क्योंकि कंपनियां अपने मॉडलों को बाजार में लाने की जल्दी में हैं," उन्होंने TechCrunch को बताया।

Google ने कहा है कि, हालांकि इसकी तकनीकी रिपोर्टों में विस्तृत नहीं है, यह मॉडलों के रिलीज से पहले सुरक्षा परीक्षण और "विरोधी रेड टीमें" आयोजित करता है।

4/22 को दोपहर 12:58 बजे प्रशांत समय पर अपडेट किया गया: Google के FSF के संदर्भ में तकनीकी रिपोर्ट की भाषा में संशोधन किया गया।

Google ने उद्यम बाजार में OpenAI के साथ प्रतिस्पर्धा करने के लिए उत्पादन-तैयार Gemini 2.5 AI मॉडल्स का अनावरण किया

Google ने सोमवार को अपनी AI रणनीति को और मजबूत किया, उद्यम उपयोग के लिए अपने उन्नत Gemini 2.5 मॉडल्स को लॉन्च किया और कीमत व प्रदर्शन पर प्रतिस्पर्धा करने के लिए एक लागत-कुशल संस्करण पेश किया।Alphabet

Google ने उद्यम बाजार में OpenAI के साथ प्रतिस्पर्धा करने के लिए उत्पादन-तैयार Gemini 2.5 AI मॉडल्स का अनावरण किया

Google ने सोमवार को अपनी AI रणनीति को और मजबूत किया, उद्यम उपयोग के लिए अपने उन्नत Gemini 2.5 मॉडल्स को लॉन्च किया और कीमत व प्रदर्शन पर प्रतिस्पर्धा करने के लिए एक लागत-कुशल संस्करण पेश किया।Alphabet

Google ने AI-संचालित Simplify टूल का अनावरण किया जो वेब पढ़ने को आसान बनाता है

Google का iOS ऐप अब एक “Simplify” सुविधा शामिल करता है, जो AI का उपयोग करके जटिल वेब टेक्स्ट को स्पष्ट, समझने योग्य सामग्री में बदल देता है बिना पेज छोड़े।Simplify टूल, जो Google Research द्वारा विकसि

Google ने AI-संचालित Simplify टूल का अनावरण किया जो वेब पढ़ने को आसान बनाता है

Google का iOS ऐप अब एक “Simplify” सुविधा शामिल करता है, जो AI का उपयोग करके जटिल वेब टेक्स्ट को स्पष्ट, समझने योग्य सामग्री में बदल देता है बिना पेज छोड़े।Simplify टूल, जो Google Research द्वारा विकसि

जेमिनी चैटबॉट छवि संपादन क्षमताओं को बढ़ाता है

गूगल का जेमिनी चैटबॉट ऐप अब उपयोगकर्ताओं को फोन या कंप्यूटर से AI-जनरेटेड और अपलोड की गई छवियों को संपादित करने की अनुमति देता है, कंपनी ने बुधवार को एक ब्लॉग पोस्ट में घोषणा की।जेमिनी की अंतर्निहित छ

जेमिनी चैटबॉट छवि संपादन क्षमताओं को बढ़ाता है

गूगल का जेमिनी चैटबॉट ऐप अब उपयोगकर्ताओं को फोन या कंप्यूटर से AI-जनरेटेड और अपलोड की गई छवियों को संपादित करने की अनुमति देता है, कंपनी ने बुधवार को एक ब्लॉग पोस्ट में घोषणा की।जेमिनी की अंतर्निहित छ

1 अगस्त 2025 7:17:34 अपराह्न IST

1 अगस्त 2025 7:17:34 अपराह्न IST

Google's AI safety report sounds like a half-baked cake – looks good but lacks substance. 😕 Why skimp on the details? Transparency matters when stakes are this high.

0

0

29 अप्रैल 2025 8:49:22 अपराह्न IST

29 अप्रैल 2025 8:49:22 अपराह्न IST

Der Bericht von Google über Gemini 2.5 Pro ist ein bisschen enttäuschend. Ich hatte mehr Details zu den Sicherheitsbewertungen erwartet, aber es scheint, als würden sie Informationen zurückhalten. Ohne die ganze Geschichte ist es schwer, der KI vollständig zu vertrauen. Vielleicht beim nächsten Mal, Google? 🤔

0

0

29 अप्रैल 2025 6:47:55 पूर्वाह्न IST

29 अप्रैल 2025 6:47:55 पूर्वाह्न IST

ジェミニ2.5プロのレポート、ちょっとがっかりですね。安全評価の詳細をもっと知りたかったのに、情報が少なすぎる。AIを完全に信頼するのは難しいです。次回はもっと詳しくお願いします!😅

0

0

29 अप्रैल 2025 4:45:07 पूर्वाह्न IST

29 अप्रैल 2025 4:45:07 पूर्वाह्न IST

Google's report on Gemini 2.5 Pro is a bit of a letdown. I was expecting more juicy details about the safety assessments, but it feels like they're holding back. It's hard to trust the AI fully without knowing the full story. Maybe next time, Google? 🤔

0

0

29 अप्रैल 2025 1:31:42 पूर्वाह्न IST

29 अप्रैल 2025 1:31:42 पूर्वाह्न IST

O relatório do Google sobre o Gemini 2.5 Pro é um pouco decepcionante. Esperava mais detalhes sobre as avaliações de segurança, mas parece que eles estão escondendo algo. É difícil confiar totalmente na IA sem saber toda a história. Talvez na próxima, Google? 🤔

0

0

28 अप्रैल 2025 5:11:33 पूर्वाह्न IST

28 अप्रैल 2025 5:11:33 पूर्वाह्न IST

El informe de Google sobre Gemini 2.5 Pro es decepcionante. Esperaba más detalles sobre las evaluaciones de seguridad, pero parece que están ocultando información. Es difícil confiar en la IA sin conocer toda la historia. ¿Tal vez la próxima vez, Google? 🤔

0

0