Maison

Maison

4 conseils de sécurité experts pour que les entreprises puissent naviguer dans les cybermenaces alimentées par l'IA en 2025

Les cybercriminels utilisent désormais l'intelligence artificielle (AI) pour améliorer chaque étape de leurs attaques. Ils emploient des modèles de langage de grande échelle (LLMs) pour créer des emails de phishing hautement personnalisés, en collectant des détails personnels sur les réseaux sociaux et professionnels. Par ailleurs, les réseaux antagonistes génératifs (GANs) sont utilisés pour produire des deepfakes audio et vidéo, capables de tromper les systèmes d'authentification multifactorielle. Même les script kiddies s'y mettent, utilisant des outils automatisés comme WormGPT pour déployer des malwares polymorphes qui peuvent changer et échapper aux méthodes de détection traditionnelles.

Ce ne sont pas seulement des menaces hypothétiques ; elles se produisent maintenant. Les entreprises qui n'adaptent pas leurs stratégies de sécurité feront face à une vague de cybermenaces sophistiquées, non seulement en 2025, mais au-delà.

Vous voulez garder une longueur d'avance à l'ère de l'AI ? Vous avez deux choix : intégrer l'AI dans vos opérations ou utiliser l'AI pour améliorer votre entreprise.

Pour explorer plus en profondeur comment l'AI redéfinit la sécurité des entreprises, j'ai discuté avec Bradon Rogers, le Chief Custom Officer chez Island et expert chevronné en cybersécurité. Nous avons abordé l'évolution du paysage de la sécurité numérique, la détection précoce des menaces et les stratégies pour préparer votre équipe aux attaques alimentées par l'AI. Mais d'abord, posons le contexte.

Pourquoi les menaces de cybersécurité par AI sont différentes

L'AI dote les acteurs malveillants d'outils avancés qui rendent les cyberattaques plus ciblées, convaincantes et difficiles à repérer. Par exemple, les systèmes d'AI générative actuels peuvent analyser d'énormes ensembles de données personnelles, de communications d'entreprise et de réseaux sociaux pour personnaliser des campagnes de phishing qui semblent provenir de sources fiables. Lorsqu'ils sont associés à des malwares qui s'adaptent automatiquement aux mesures de sécurité, l'ampleur et l'efficacité de ces attaques explosent.

La technologie deepfake va encore plus loin en créant des contenus vidéo et audio réalistes, permettant tout, des escroqueries par usurpation d'identité de cadres aux campagnes de désinformation à grande échelle. Nous avons vu des exemples concrets, comme un vol de 25 millions de dollars à une entreprise de Hong Kong via une vidéoconférence deepfake, et de nombreux cas où des clips vocaux générés par AI ont trompé des personnes pour transférer de l'argent à des fraudeurs.

Les cyberattaques automatisées par AI ont également introduit des systèmes "set-and-forget" qui recherchent constamment des vulnérabilités, s'adaptent aux contre-mesures et exploitent les faiblesses sans intervention humaine. Un cas notable fut la brèche AWS de 2024, où un malware alimenté par AI a cartographié le réseau, identifié les vulnérabilités et exécuté une attaque complexe qui a compromis des milliers de comptes clients.

Ces incidents montrent que l'AI ne se contente pas d'améliorer les cybermenaces existantes ; elle engendre de tout nouveaux types de risques de sécurité. Voici comment Bradon Rogers propose de relever ces défis.

1. Mettre en place une architecture de confiance zéro

L'ancien modèle de périmètre de sécurité ne suffit plus contre les menaces améliorées par l'AI. Une architecture de confiance zéro suit une approche "ne jamais faire confiance, toujours vérifier", garantissant que chaque utilisateur, appareil et application doit être authentifié et autorisé avant d'accéder aux ressources. Cette méthode minimise le risque d'accès non autorisé, même si des attaquants parviennent à pénétrer le réseau.

"Les entreprises doivent vérifier chaque utilisateur, appareil et application—y compris l'AI—avant qu'ils ne puissent toucher des données ou fonctions critiques," insiste Rogers, qualifiant cela de meilleure stratégie de défense. En vérifiant constamment les identités et en appliquant des contrôles d'accès stricts, les entreprises peuvent réduire leur surface d'attaque et limiter les dégâts des comptes compromis.

Bien que l'AI pose de nouveaux défis, elle apporte également de puissants outils de défense. Les solutions de sécurité alimentées par AI peuvent analyser d'énormes quantités de données en temps réel, repérant les anomalies et menaces potentielles que les méthodes traditionnelles pourraient manquer. Ces systèmes peuvent s'adapter à de nouveaux schémas d'attaque, offrant une défense dynamique contre les cyberattaques alimentées par AI.

Rogers avertit que l'AI dans la défense cybernétique ne doit pas être considérée comme une simple fonctionnalité. "Les CISOs et les responsables de la sécurité doivent intégrer l'AI dans leurs systèmes dès la base," dit-il. En intégrant l'AI dans leur infrastructure de sécurité, les organisations peuvent améliorer leur capacité à détecter et répondre rapidement aux incidents, réduisant la fenêtre d'opportunité pour les attaquants.

2. Former et sensibiliser les employés aux menaces alimentées par l'AI

En favorisant une culture de sensibilisation à la sécurité et en établissant des lignes directrices claires pour l'utilisation des outils AI, les entreprises peuvent réduire le risque de vulnérabilités internes. Après tout, les gens sont complexes, et souvent, des solutions simples fonctionnent mieux.

"Il ne s'agit pas seulement de repousser les attaques externes. Il s'agit aussi de fixer des limites pour les employés utilisant l'AI comme leur 'code de triche de productivité'," explique Rogers.

L'erreur humaine reste un point faible majeur en cybersécurité. Alors que les attaques de phishing et d'ingénierie sociale générées par AI deviennent plus convaincantes, il est crucial de former les employés à ces menaces en évolution. Une formation régulière peut les aider à repérer des activités suspectes, comme des emails inattendus ou des demandes inhabituelles qui dérogent aux procédures normales.

3. Surveiller et réglementer l'utilisation de l'AI par les employés

Les technologies AI sont largement adoptées dans les entreprises, mais une utilisation non autorisée ou non surveillée—connue sous le nom de "shadow AI"—peut introduire de sérieux risques de sécurité. Les employés pourraient accidentellement utiliser des applications AI sans sécurité adéquate, entraînant des fuites de données ou des problèmes de conformité.

"Nous ne pouvons pas laisser les données d'entreprise circuler librement dans des environnements AI non autorisés, donc nous devons trouver un équilibre," note Rogers. Des politiques régissant les outils AI, des audits réguliers et s'assurer que toutes les applications AI répondent aux normes de sécurité de l'entreprise sont essentiels pour gérer ces risques.

4. Collaborer avec des experts en AI et cybersécurité

La complexité des menaces alimentées par AI signifie que les entreprises doivent travailler avec des experts en AI et cybersécurité. Collaborer avec des entreprises externes peut donner aux organisations un accès aux dernières informations sur les menaces, aux technologies défensives de pointe et aux compétences spécialisées qu'elles pourraient ne pas avoir en interne.

Les attaques alimentées par AI nécessitent des défenses sophistiquées que les outils de sécurité traditionnels ne peuvent souvent pas fournir. Les plateformes de détection de menaces améliorées par AI, les navigateurs sécurisés et les contrôles d'accès de confiance zéro peuvent analyser le comportement des utilisateurs, détecter les anomalies et empêcher les acteurs malveillants d'obtenir un accès non autorisé.

Rogers souligne que des solutions innovantes pour les entreprises "sont la pièce manquante du puzzle de la sécurité de confiance zéro. Ces outils offrent des contrôles de sécurité profonds et granulaires qui protègent toute application ou ressource à travers les réseaux publics et privés."

Ces outils utilisent l'apprentissage automatique pour surveiller l'activité du réseau, signaler les schémas suspects et automatiser la réponse aux incidents, réduisant le risque que des attaques générées par AI ne pénètrent dans les systèmes d'entreprise.

Article connexe

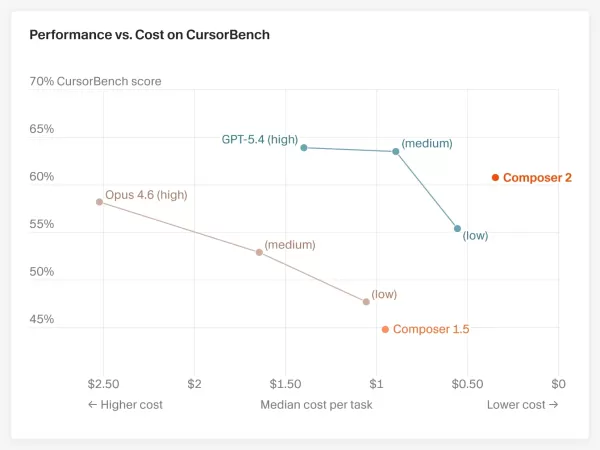

Cursor Composer 2 contre Claude Opus 4.6 : un test de performance relance le débat sur la programmation par IA

Le 19 mars, Cursor a officiellement lancé son modèle de codage développé en interne, Composer 2. Cette annonce a immédiatement suscité des discussions au sein de la communauté des développeurs : selon

Cursor Composer 2 contre Claude Opus 4.6 : un test de performance relance le débat sur la programmation par IA

Le 19 mars, Cursor a officiellement lancé son modèle de codage développé en interne, Composer 2. Cette annonce a immédiatement suscité des discussions au sein de la communauté des développeurs : selon

StrictlyVC San Francisco réunira des dirigeants de TDK Ventures, Replit et d'autres entreprises

Le premier événement StrictlyVC de l'année arrive à San Francisco plus tôt que vous ne le pensez. Il reste encore des billets pour notre rencontre du 30 avril au Sentro Filipino Cultural Center,

StrictlyVC San Francisco réunira des dirigeants de TDK Ventures, Replit et d'autres entreprises

Le premier événement StrictlyVC de l'année arrive à San Francisco plus tôt que vous ne le pensez. Il reste encore des billets pour notre rencontre du 30 avril au Sentro Filipino Cultural Center,

Notion transforme son espace de travail en une plateforme centralisée pour les agents IA

Notion, l'éditeur de logiciels de productivité, entre dans l'ère des agents.Lors d'une annonce de produit diffusée en direct mercredi, Notion — surtout connu pour son application de pri

Recommandations de sujets spéciaux liés

commentaires (8)

Notion transforme son espace de travail en une plateforme centralisée pour les agents IA

Notion, l'éditeur de logiciels de productivité, entre dans l'ère des agents.Lors d'une annonce de produit diffusée en direct mercredi, Notion — surtout connu pour son application de pri

Recommandations de sujets spéciaux liés

commentaires (8)

![FredLewis]()

This article really opened my eyes to how sneaky cybercriminals are getting with AI! Using LLMs for phishing emails is wild—makes me wonder if my inbox is already compromised. 😅 Businesses better step up their game!

![DavidGreen]()

Super interesting read! AI-powered cyberattacks sound like something out of a sci-fi movie. It's wild how cybercriminals use LLMs for phishing—makes me wonder how businesses can keep up. Any tips for small startups to stay safe? 😬

![DavidLewis]()

This article really opened my eyes to how sneaky cybercriminals are getting with AI! 😱 Those personalized phishing emails sound like a nightmare. I wonder how businesses can keep up when AI is making attacks so sophisticated.

![MateoAdams]()

2025년 AI로 인한 사이버 위협을 대비하기 위한 비즈니스 필수 도구입니다! 팁들이 실용적이고 쉽게 적용할 수 있어요. 다만, 실제 사례가 더 필요할 것 같아요. 그래도 훌륭한 자원이에요! 👍

![SamuelRoberts]()

Esta ferramenta é essencial para qualquer negócio que deseje se proteger contra ameaças cibernéticas alimentadas por IA em 2025! As dicas são super práticas e fáceis de implementar. Minha única reclamação é que poderia ter mais exemplos do mundo real. Ainda assim, é um recurso sólido! 👍

Les cybercriminels utilisent désormais l'intelligence artificielle (AI) pour améliorer chaque étape de leurs attaques. Ils emploient des modèles de langage de grande échelle (LLMs) pour créer des emails de phishing hautement personnalisés, en collectant des détails personnels sur les réseaux sociaux et professionnels. Par ailleurs, les réseaux antagonistes génératifs (GANs) sont utilisés pour produire des deepfakes audio et vidéo, capables de tromper les systèmes d'authentification multifactorielle. Même les script kiddies s'y mettent, utilisant des outils automatisés comme WormGPT pour déployer des malwares polymorphes qui peuvent changer et échapper aux méthodes de détection traditionnelles.

Ce ne sont pas seulement des menaces hypothétiques ; elles se produisent maintenant. Les entreprises qui n'adaptent pas leurs stratégies de sécurité feront face à une vague de cybermenaces sophistiquées, non seulement en 2025, mais au-delà.

Vous voulez garder une longueur d'avance à l'ère de l'AI ? Vous avez deux choix : intégrer l'AI dans vos opérations ou utiliser l'AI pour améliorer votre entreprise.

Pour explorer plus en profondeur comment l'AI redéfinit la sécurité des entreprises, j'ai discuté avec Bradon Rogers, le Chief Custom Officer chez Island et expert chevronné en cybersécurité. Nous avons abordé l'évolution du paysage de la sécurité numérique, la détection précoce des menaces et les stratégies pour préparer votre équipe aux attaques alimentées par l'AI. Mais d'abord, posons le contexte.

Pourquoi les menaces de cybersécurité par AI sont différentes

L'AI dote les acteurs malveillants d'outils avancés qui rendent les cyberattaques plus ciblées, convaincantes et difficiles à repérer. Par exemple, les systèmes d'AI générative actuels peuvent analyser d'énormes ensembles de données personnelles, de communications d'entreprise et de réseaux sociaux pour personnaliser des campagnes de phishing qui semblent provenir de sources fiables. Lorsqu'ils sont associés à des malwares qui s'adaptent automatiquement aux mesures de sécurité, l'ampleur et l'efficacité de ces attaques explosent.

La technologie deepfake va encore plus loin en créant des contenus vidéo et audio réalistes, permettant tout, des escroqueries par usurpation d'identité de cadres aux campagnes de désinformation à grande échelle. Nous avons vu des exemples concrets, comme un vol de 25 millions de dollars à une entreprise de Hong Kong via une vidéoconférence deepfake, et de nombreux cas où des clips vocaux générés par AI ont trompé des personnes pour transférer de l'argent à des fraudeurs.

Les cyberattaques automatisées par AI ont également introduit des systèmes "set-and-forget" qui recherchent constamment des vulnérabilités, s'adaptent aux contre-mesures et exploitent les faiblesses sans intervention humaine. Un cas notable fut la brèche AWS de 2024, où un malware alimenté par AI a cartographié le réseau, identifié les vulnérabilités et exécuté une attaque complexe qui a compromis des milliers de comptes clients.

Ces incidents montrent que l'AI ne se contente pas d'améliorer les cybermenaces existantes ; elle engendre de tout nouveaux types de risques de sécurité. Voici comment Bradon Rogers propose de relever ces défis.

1. Mettre en place une architecture de confiance zéro

L'ancien modèle de périmètre de sécurité ne suffit plus contre les menaces améliorées par l'AI. Une architecture de confiance zéro suit une approche "ne jamais faire confiance, toujours vérifier", garantissant que chaque utilisateur, appareil et application doit être authentifié et autorisé avant d'accéder aux ressources. Cette méthode minimise le risque d'accès non autorisé, même si des attaquants parviennent à pénétrer le réseau.

"Les entreprises doivent vérifier chaque utilisateur, appareil et application—y compris l'AI—avant qu'ils ne puissent toucher des données ou fonctions critiques," insiste Rogers, qualifiant cela de meilleure stratégie de défense. En vérifiant constamment les identités et en appliquant des contrôles d'accès stricts, les entreprises peuvent réduire leur surface d'attaque et limiter les dégâts des comptes compromis.

Bien que l'AI pose de nouveaux défis, elle apporte également de puissants outils de défense. Les solutions de sécurité alimentées par AI peuvent analyser d'énormes quantités de données en temps réel, repérant les anomalies et menaces potentielles que les méthodes traditionnelles pourraient manquer. Ces systèmes peuvent s'adapter à de nouveaux schémas d'attaque, offrant une défense dynamique contre les cyberattaques alimentées par AI.

Rogers avertit que l'AI dans la défense cybernétique ne doit pas être considérée comme une simple fonctionnalité. "Les CISOs et les responsables de la sécurité doivent intégrer l'AI dans leurs systèmes dès la base," dit-il. En intégrant l'AI dans leur infrastructure de sécurité, les organisations peuvent améliorer leur capacité à détecter et répondre rapidement aux incidents, réduisant la fenêtre d'opportunité pour les attaquants.

2. Former et sensibiliser les employés aux menaces alimentées par l'AI

En favorisant une culture de sensibilisation à la sécurité et en établissant des lignes directrices claires pour l'utilisation des outils AI, les entreprises peuvent réduire le risque de vulnérabilités internes. Après tout, les gens sont complexes, et souvent, des solutions simples fonctionnent mieux.

"Il ne s'agit pas seulement de repousser les attaques externes. Il s'agit aussi de fixer des limites pour les employés utilisant l'AI comme leur 'code de triche de productivité'," explique Rogers.

L'erreur humaine reste un point faible majeur en cybersécurité. Alors que les attaques de phishing et d'ingénierie sociale générées par AI deviennent plus convaincantes, il est crucial de former les employés à ces menaces en évolution. Une formation régulière peut les aider à repérer des activités suspectes, comme des emails inattendus ou des demandes inhabituelles qui dérogent aux procédures normales.

3. Surveiller et réglementer l'utilisation de l'AI par les employés

Les technologies AI sont largement adoptées dans les entreprises, mais une utilisation non autorisée ou non surveillée—connue sous le nom de "shadow AI"—peut introduire de sérieux risques de sécurité. Les employés pourraient accidentellement utiliser des applications AI sans sécurité adéquate, entraînant des fuites de données ou des problèmes de conformité.

"Nous ne pouvons pas laisser les données d'entreprise circuler librement dans des environnements AI non autorisés, donc nous devons trouver un équilibre," note Rogers. Des politiques régissant les outils AI, des audits réguliers et s'assurer que toutes les applications AI répondent aux normes de sécurité de l'entreprise sont essentiels pour gérer ces risques.

4. Collaborer avec des experts en AI et cybersécurité

La complexité des menaces alimentées par AI signifie que les entreprises doivent travailler avec des experts en AI et cybersécurité. Collaborer avec des entreprises externes peut donner aux organisations un accès aux dernières informations sur les menaces, aux technologies défensives de pointe et aux compétences spécialisées qu'elles pourraient ne pas avoir en interne.

Les attaques alimentées par AI nécessitent des défenses sophistiquées que les outils de sécurité traditionnels ne peuvent souvent pas fournir. Les plateformes de détection de menaces améliorées par AI, les navigateurs sécurisés et les contrôles d'accès de confiance zéro peuvent analyser le comportement des utilisateurs, détecter les anomalies et empêcher les acteurs malveillants d'obtenir un accès non autorisé.

Rogers souligne que des solutions innovantes pour les entreprises "sont la pièce manquante du puzzle de la sécurité de confiance zéro. Ces outils offrent des contrôles de sécurité profonds et granulaires qui protègent toute application ou ressource à travers les réseaux publics et privés."

Ces outils utilisent l'apprentissage automatique pour surveiller l'activité du réseau, signaler les schémas suspects et automatiser la réponse aux incidents, réduisant le risque que des attaques générées par AI ne pénètrent dans les systèmes d'entreprise.

Cursor Composer 2 contre Claude Opus 4.6 : un test de performance relance le débat sur la programmation par IA

Le 19 mars, Cursor a officiellement lancé son modèle de codage développé en interne, Composer 2. Cette annonce a immédiatement suscité des discussions au sein de la communauté des développeurs : selon

Cursor Composer 2 contre Claude Opus 4.6 : un test de performance relance le débat sur la programmation par IA

Le 19 mars, Cursor a officiellement lancé son modèle de codage développé en interne, Composer 2. Cette annonce a immédiatement suscité des discussions au sein de la communauté des développeurs : selon

StrictlyVC San Francisco réunira des dirigeants de TDK Ventures, Replit et d'autres entreprises

Le premier événement StrictlyVC de l'année arrive à San Francisco plus tôt que vous ne le pensez. Il reste encore des billets pour notre rencontre du 30 avril au Sentro Filipino Cultural Center,

StrictlyVC San Francisco réunira des dirigeants de TDK Ventures, Replit et d'autres entreprises

Le premier événement StrictlyVC de l'année arrive à San Francisco plus tôt que vous ne le pensez. Il reste encore des billets pour notre rencontre du 30 avril au Sentro Filipino Cultural Center,

Notion transforme son espace de travail en une plateforme centralisée pour les agents IA

Notion, l'éditeur de logiciels de productivité, entre dans l'ère des agents.Lors d'une annonce de produit diffusée en direct mercredi, Notion — surtout connu pour son application de pri

Notion transforme son espace de travail en une plateforme centralisée pour les agents IA

Notion, l'éditeur de logiciels de productivité, entre dans l'ère des agents.Lors d'une annonce de produit diffusée en direct mercredi, Notion — surtout connu pour son application de pri

This article really opened my eyes to how sneaky cybercriminals are getting with AI! Using LLMs for phishing emails is wild—makes me wonder if my inbox is already compromised. 😅 Businesses better step up their game!

Super interesting read! AI-powered cyberattacks sound like something out of a sci-fi movie. It's wild how cybercriminals use LLMs for phishing—makes me wonder how businesses can keep up. Any tips for small startups to stay safe? 😬

This article really opened my eyes to how sneaky cybercriminals are getting with AI! 😱 Those personalized phishing emails sound like a nightmare. I wonder how businesses can keep up when AI is making attacks so sophisticated.

2025년 AI로 인한 사이버 위협을 대비하기 위한 비즈니스 필수 도구입니다! 팁들이 실용적이고 쉽게 적용할 수 있어요. 다만, 실제 사례가 더 필요할 것 같아요. 그래도 훌륭한 자원이에요! 👍

Esta ferramenta é essencial para qualquer negócio que deseje se proteger contra ameaças cibernéticas alimentadas por IA em 2025! As dicas são super práticas e fáceis de implementar. Minha única reclamação é que poderia ter mais exemplos do mundo real. Ainda assim, é um recurso sólido! 👍