Hogar

Hogar

El modo de voz de Openai ahora se implementa en todos los suscriptores de ChatGPT: prioridad dada a usuarios premium

El muy esperado Modo de Voz Avanzado de OpenAI, destacado durante su evento de lanzamiento de primavera, finalmente ha salido de la fase alfa y ahora está accesible para todos los usuarios de ChatGPT Plus y Team. Esta emocionante actualización fue anunciada por OpenAI el martes, marcando el inicio de un despliegue gradual que promete transformar la experiencia de interacción por voz.

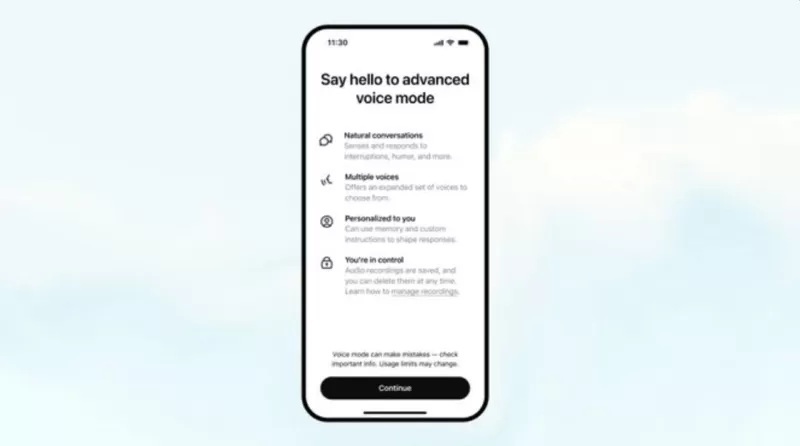

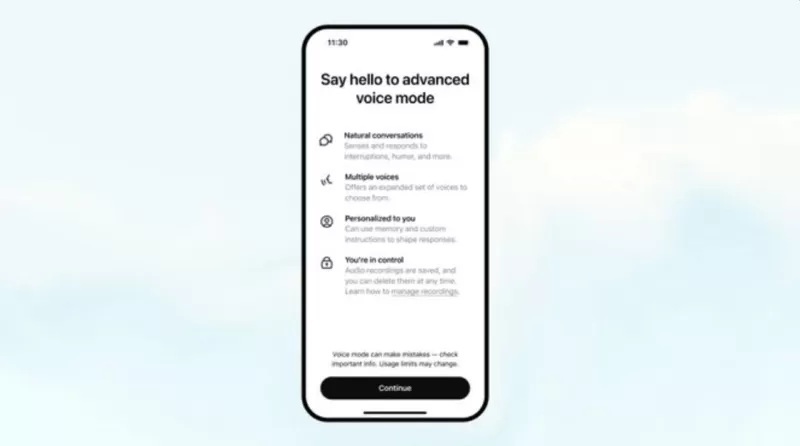

El Modo de Voz Avanzado presenta un asistente de voz más inteligente, capaz de ser interrumpido y responder a las emociones de los usuarios, mejorando el flujo conversacional. Junto con esto, OpenAI está implementando cinco nuevas voces—Arbor, Maple, Sol, Spruce y Vale—disponibles tanto en el Modo de Voz Estándar como en el Avanzado. Estas adiciones están diseñadas para proporcionar una interacción más personalizada y atractiva.

La Voz Avanzada se está implementando para todos los usuarios Plus y Team en la aplicación de ChatGPT a lo largo de la semana.

Mientras esperabas pacientemente, hemos añadido Instrucciones Personalizadas, Memoria, cinco nuevas voces y acentos mejorados.

También puede decir “Lo siento, llego tarde” en más de 50 idiomas. pic.twitter.com/APOqqhXtDg

— OpenAI (@OpenAI) 24 de septiembre de 2024

El despliegue se centrará inicialmente en los usuarios de ChatGPT Plus y Team, con planes para extender el acceso a los niveles Enterprise y Edu la próxima semana. Los usuarios recibirán una notificación a través de un mensaje emergente junto a la opción de Modo de Voz dentro de la interfaz de ChatGPT, indicando su acceso a esta función.

Desde el lanzamiento alfa en julio, OpenAI ha trabajado arduamente en la refinación del Modo de Voz Avanzado. Las mejoras incluyen acentos mejorados en idiomas extranjeros y velocidades de conversación más fluidas. Visualmente, el modo ahora presenta una esfera azul animada, añadiendo un toque fresco a la interfaz.

Para personalizar aún más la experiencia, el Modo de Voz Avanzado ahora incorpora Instrucciones Personalizadas y Memoria. Estas funciones permiten al asistente de voz considerar criterios específicos del usuario, resultando en respuestas más relevantes y personalizadas.

Sin embargo, una limitación persiste desde la versión alfa: los usuarios no podrán utilizar las capacidades multimodales del Modo de Voz, como la asistencia con contenido de pantalla o el uso de la cámara del teléfono para respuestas contextuales, como se demuestra en el video a continuación.

OpenAI ha tomado medidas extensas para garantizar la seguridad de las capacidades de voz, probándolas con más de 100 evaluadores externos en 45 idiomas. En agosto, la compañía publicó su Tarjeta de Sistema GPT-4o, un informe detallado sobre la seguridad del LLM basado en evaluaciones de riesgos, pruebas externas y más, que incluye evaluaciones del Modo de Voz Avanzado.

Para acceder al Modo de Voz Avanzado, puedes suscribirte a ChatGPT Plus por $20 al mes. Esta suscripción no solo otorga acceso a la nueva función de voz, sino que también ofrece beneficios adicionales como análisis de datos avanzado, generación ilimitada de imágenes, cinco veces más mensajes para GPT-4o y la capacidad de crear GPTs personalizados.

Curiosamente, solo una semana después de que OpenAI presentara el Modo de Voz Avanzado en mayo, Google introdujo una función similar llamada Gemini Live. Este asistente de voz conversacional, impulsado por LLMs, busca mejorar el flujo y la comprensión de la conversación. A principios de este mes, Google hizo que Gemini Live estuviera disponible de forma gratuita para todos los usuarios de Android, proporcionando una alternativa para aquellos interesados en una tecnología de asistente de voz similar sin necesidad de una suscripción paga.

Artículo relacionado

Claude Opus 4.7 sale al mercado apostando por la fiabilidad por encima de la inteligencia

Anthropic ha mantenido un ritmo frenético este año, lanzando nuevas funciones casi cada dos días. El tan esperado Claude Opus 4.7 acaba de salir oficialmente al mercado y, curiosamente, Anthropic fue

Claude Opus 4.7 sale al mercado apostando por la fiabilidad por encima de la inteligencia

Anthropic ha mantenido un ritmo frenético este año, lanzando nuevas funciones casi cada dos días. El tan esperado Claude Opus 4.7 acaba de salir oficialmente al mercado y, curiosamente, Anthropic fue

Haier lanza el robot exoesqueleto deportivo con IA más ligero del mundo, con un peso de tan solo 1,75 kg

El Grupo Haier ha presentado el robot exoesqueleto con inteligencia artificial más ligero del mundo para el deporte: el Haier Exoskeleton Robot W3. Este lanzamiento establece un nuevo récord del secto

Haier lanza el robot exoesqueleto deportivo con IA más ligero del mundo, con un peso de tan solo 1,75 kg

El Grupo Haier ha presentado el robot exoesqueleto con inteligencia artificial más ligero del mundo para el deporte: el Haier Exoskeleton Robot W3. Este lanzamiento establece un nuevo récord del secto

La primera serie de AIGC de Yaoke Media, «El misterio del bronce en Qinling», se estrena hoy con protagonistas creados por IA

Hoy se estrena oficialmente la miniserie de misterio y fantasía con IA generativa (AIGC) de Yaoke Media, «La historia secreta del bronce de Qinling». Protagonizada por los dos primeros actores de IA c

Recomendaciones de temas especiales relacionados

comentario (24)

0/500

La primera serie de AIGC de Yaoke Media, «El misterio del bronce en Qinling», se estrena hoy con protagonistas creados por IA

Hoy se estrena oficialmente la miniserie de misterio y fantasía con IA generativa (AIGC) de Yaoke Media, «La historia secreta del bronce de Qinling». Protagonizada por los dos primeros actores de IA c

Recomendaciones de temas especiales relacionados

comentario (24)

0/500

![FredAllen]()

¡Por fin! Llevaba semanas esperando probar el modo de voz avanzado de ChatGPT 😍 Aunque no soy usuario premium, espero que llegue pronto a mi cuenta. ¿Alguien ya lo ha probado? ¿Vale la pena la espera o es mejor seguir usando otras alternativas como Gemini?

![StevenGonzalez]()

오늘 보이스 모드 테스트 해봤는데, 목소리가 너무 자연스러워서 놀랐어요! 😲 근데 프리미엄 유저에게 우선 배포한다니... 무료 사용자들은 언제쯤 쓸 수 있을지 궁금하네요. 가격 인상 얘기도 있는데 걱정돼요.

![NicholasThomas]()

Wow, voice mode for all ChatGPT subscribers? That's a game-changer! Can't wait to try it out and see how it stacks up against other AI assistants. 😎

![JackMitchell]()

Wow, voice mode for all ChatGPT subscribers is a game-changer! I’m stoked to try it out, but I wonder how it stacks up against other AI voice assistants. Anyone tested it yet? 😎

![GregoryRoberts]()

Finally got access to the voice mode on ChatGPT! It’s super cool and works surprisingly well. A bit pricey for non-premium users though 😅

El muy esperado Modo de Voz Avanzado de OpenAI, destacado durante su evento de lanzamiento de primavera, finalmente ha salido de la fase alfa y ahora está accesible para todos los usuarios de ChatGPT Plus y Team. Esta emocionante actualización fue anunciada por OpenAI el martes, marcando el inicio de un despliegue gradual que promete transformar la experiencia de interacción por voz.

El Modo de Voz Avanzado presenta un asistente de voz más inteligente, capaz de ser interrumpido y responder a las emociones de los usuarios, mejorando el flujo conversacional. Junto con esto, OpenAI está implementando cinco nuevas voces—Arbor, Maple, Sol, Spruce y Vale—disponibles tanto en el Modo de Voz Estándar como en el Avanzado. Estas adiciones están diseñadas para proporcionar una interacción más personalizada y atractiva.

La Voz Avanzada se está implementando para todos los usuarios Plus y Team en la aplicación de ChatGPT a lo largo de la semana.

Mientras esperabas pacientemente, hemos añadido Instrucciones Personalizadas, Memoria, cinco nuevas voces y acentos mejorados.

También puede decir “Lo siento, llego tarde” en más de 50 idiomas. pic.twitter.com/APOqqhXtDg— OpenAI (@OpenAI) 24 de septiembre de 2024

El despliegue se centrará inicialmente en los usuarios de ChatGPT Plus y Team, con planes para extender el acceso a los niveles Enterprise y Edu la próxima semana. Los usuarios recibirán una notificación a través de un mensaje emergente junto a la opción de Modo de Voz dentro de la interfaz de ChatGPT, indicando su acceso a esta función.

Desde el lanzamiento alfa en julio, OpenAI ha trabajado arduamente en la refinación del Modo de Voz Avanzado. Las mejoras incluyen acentos mejorados en idiomas extranjeros y velocidades de conversación más fluidas. Visualmente, el modo ahora presenta una esfera azul animada, añadiendo un toque fresco a la interfaz.

Para personalizar aún más la experiencia, el Modo de Voz Avanzado ahora incorpora Instrucciones Personalizadas y Memoria. Estas funciones permiten al asistente de voz considerar criterios específicos del usuario, resultando en respuestas más relevantes y personalizadas.

Sin embargo, una limitación persiste desde la versión alfa: los usuarios no podrán utilizar las capacidades multimodales del Modo de Voz, como la asistencia con contenido de pantalla o el uso de la cámara del teléfono para respuestas contextuales, como se demuestra en el video a continuación.

OpenAI ha tomado medidas extensas para garantizar la seguridad de las capacidades de voz, probándolas con más de 100 evaluadores externos en 45 idiomas. En agosto, la compañía publicó su Tarjeta de Sistema GPT-4o, un informe detallado sobre la seguridad del LLM basado en evaluaciones de riesgos, pruebas externas y más, que incluye evaluaciones del Modo de Voz Avanzado.Para acceder al Modo de Voz Avanzado, puedes suscribirte a ChatGPT Plus por $20 al mes. Esta suscripción no solo otorga acceso a la nueva función de voz, sino que también ofrece beneficios adicionales como análisis de datos avanzado, generación ilimitada de imágenes, cinco veces más mensajes para GPT-4o y la capacidad de crear GPTs personalizados.

Curiosamente, solo una semana después de que OpenAI presentara el Modo de Voz Avanzado en mayo, Google introdujo una función similar llamada Gemini Live. Este asistente de voz conversacional, impulsado por LLMs, busca mejorar el flujo y la comprensión de la conversación. A principios de este mes, Google hizo que Gemini Live estuviera disponible de forma gratuita para todos los usuarios de Android, proporcionando una alternativa para aquellos interesados en una tecnología de asistente de voz similar sin necesidad de una suscripción paga.

Claude Opus 4.7 sale al mercado apostando por la fiabilidad por encima de la inteligencia

Anthropic ha mantenido un ritmo frenético este año, lanzando nuevas funciones casi cada dos días. El tan esperado Claude Opus 4.7 acaba de salir oficialmente al mercado y, curiosamente, Anthropic fue

Claude Opus 4.7 sale al mercado apostando por la fiabilidad por encima de la inteligencia

Anthropic ha mantenido un ritmo frenético este año, lanzando nuevas funciones casi cada dos días. El tan esperado Claude Opus 4.7 acaba de salir oficialmente al mercado y, curiosamente, Anthropic fue

Haier lanza el robot exoesqueleto deportivo con IA más ligero del mundo, con un peso de tan solo 1,75 kg

El Grupo Haier ha presentado el robot exoesqueleto con inteligencia artificial más ligero del mundo para el deporte: el Haier Exoskeleton Robot W3. Este lanzamiento establece un nuevo récord del secto

Haier lanza el robot exoesqueleto deportivo con IA más ligero del mundo, con un peso de tan solo 1,75 kg

El Grupo Haier ha presentado el robot exoesqueleto con inteligencia artificial más ligero del mundo para el deporte: el Haier Exoskeleton Robot W3. Este lanzamiento establece un nuevo récord del secto

La primera serie de AIGC de Yaoke Media, «El misterio del bronce en Qinling», se estrena hoy con protagonistas creados por IA

Hoy se estrena oficialmente la miniserie de misterio y fantasía con IA generativa (AIGC) de Yaoke Media, «La historia secreta del bronce de Qinling». Protagonizada por los dos primeros actores de IA c

La primera serie de AIGC de Yaoke Media, «El misterio del bronce en Qinling», se estrena hoy con protagonistas creados por IA

Hoy se estrena oficialmente la miniserie de misterio y fantasía con IA generativa (AIGC) de Yaoke Media, «La historia secreta del bronce de Qinling». Protagonizada por los dos primeros actores de IA c

¡Por fin! Llevaba semanas esperando probar el modo de voz avanzado de ChatGPT 😍 Aunque no soy usuario premium, espero que llegue pronto a mi cuenta. ¿Alguien ya lo ha probado? ¿Vale la pena la espera o es mejor seguir usando otras alternativas como Gemini?

오늘 보이스 모드 테스트 해봤는데, 목소리가 너무 자연스러워서 놀랐어요! 😲 근데 프리미엄 유저에게 우선 배포한다니... 무료 사용자들은 언제쯤 쓸 수 있을지 궁금하네요. 가격 인상 얘기도 있는데 걱정돼요.

Wow, voice mode for all ChatGPT subscribers? That's a game-changer! Can't wait to try it out and see how it stacks up against other AI assistants. 😎

Wow, voice mode for all ChatGPT subscribers is a game-changer! I’m stoked to try it out, but I wonder how it stacks up against other AI voice assistants. Anyone tested it yet? 😎

Finally got access to the voice mode on ChatGPT! It’s super cool and works surprisingly well. A bit pricey for non-premium users though 😅