Lar

Lar

O Modo de Voz do OpenAI agora sendo lançado para todos os assinantes ChatGPT - Prioridade dada a usuários premium

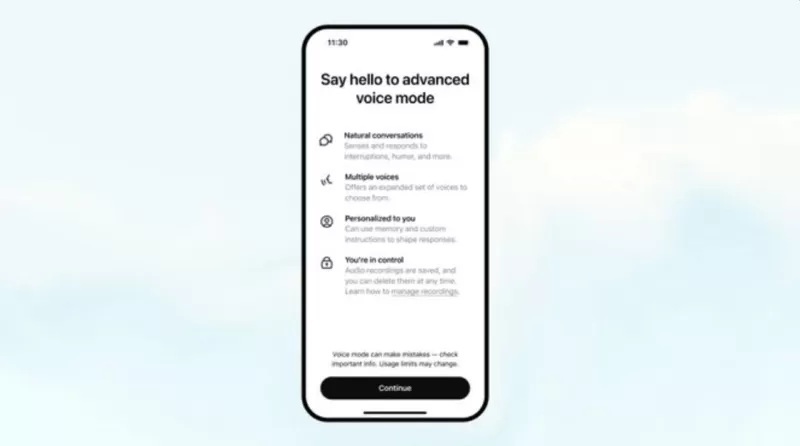

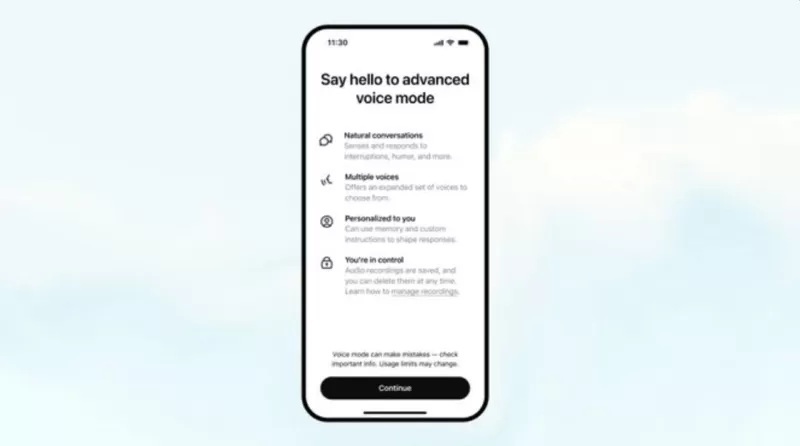

O tão aguardado Modo de Voz Avançado da OpenAI, destacado durante o evento de lançamento de primavera, finalmente saiu da fase alfa e agora está acessível a todos os usuários do ChatGPT Plus e Team. Esta atualização empolgante foi anunciada pela OpenAI na terça-feira, marcando o início de uma implementação gradual que promete transformar a experiência de interação por voz.

O Modo de Voz Avançado apresenta um assistente de voz mais inteligente, capaz de ser interrompido e responder às emoções dos usuários, aprimorando o fluxo da conversa. Junto com isso, a OpenAI está lançando cinco novas vozes — Arbor, Maple, Sol, Spruce e Vale — disponíveis tanto no Modo de Voz Padrão quanto no Avançado. Essas adições foram projetadas para proporcionar uma interação mais personalizada e envolvente.

O Voz Avançada está sendo implementado para todos os usuários Plus e Team no aplicativo ChatGPT ao longo da semana.

Enquanto você esperava pacientemente, adicionamos Instruções Personalizadas, Memória, cinco novas vozes e sotaques aprimorados.

Ele também pode dizer “Desculpe-me por estar atrasado” em mais de 50 idiomas. pic.twitter.com/APOqqhXtDg

— OpenAI (@OpenAI) 24 de setembro de 2024

A implementação inicialmente focará nos usuários do ChatGPT Plus e Team, com planos de expandir o acesso aos níveis Enterprise e Edu na próxima semana. Os usuários receberão uma notificação por meio de uma mensagem pop-up ao lado da opção de Modo de Voz na interface do ChatGPT, indicando o acesso a esse recurso.

Desde o lançamento alfa em julho, a OpenAI tem trabalhado arduamente na aprimoração do Modo de Voz Avançado. As melhorias incluem sotaques aprimorados em idiomas estrangeiros e velocidades de conversa mais fluidas. Visualmente, o modo agora apresenta uma esfera azul animada, adicionando um toque fresco à interface.

Para personalizar ainda mais a experiência, o Modo de Voz Avançado agora incorpora Instruções Personalizadas e Memória. Esses recursos permitem que o assistente de voz considere critérios específicos do usuário, resultando em respostas mais relevantes e personalizadas.

No entanto, uma limitação permanece desde a versão alfa: os usuários não poderão utilizar as capacidades multimodais do Modo de Voz, como assistência com conteúdo da tela ou uso da câmera do telefone para respostas contextuais, conforme demonstrado no vídeo abaixo.

A OpenAI tomou extensas medidas para garantir a segurança das capacidades de voz, testando-as com mais de 100 red teamers externos em 45 idiomas. Em agosto, a empresa lançou o Cartão do Sistema GPT-4o, um relatório detalhado sobre a segurança do LLM baseado em avaliações de risco, red-teaming externo e mais, que inclui avaliações do Modo de Voz Avançado.

Para acessar o Modo de Voz Avançado, você pode assinar o ChatGPT Plus por $20 por mês. Essa assinatura não apenas concede acesso ao novo recurso de voz, mas também oferece benefícios adicionais, como análise de dados avançada, geração ilimitada de imagens, cinco vezes mais mensagens para o GPT-4o e a capacidade de criar GPTs personalizados.

Curiosamente, apenas uma semana após a OpenAI revelar o Modo de Voz Avançado em maio, o Google introduziu um recurso semelhante chamado Gemini Live. Esse assistente de voz conversacional, alimentado por LLMs, visa aprimorar o fluxo e a compreensão da conversa. No início deste mês, o Google disponibilizou o Gemini Live gratuitamente para todos os usuários de Android, proporcionando uma alternativa para aqueles interessados em tecnologia de assistente de voz semelhante sem a necessidade de uma assinatura paga.

Artigo relacionado

Claude Opus 4.7 é lançado com a confiabilidade em detrimento da inteligência

A Anthropic manteve um ritmo acelerado este ano, lançando novos recursos quase a cada dois dias. O tão aguardado Claude Opus 4.7 acaba de ser lançado oficialmente e, curiosamente, a Anthropic foi dire

Claude Opus 4.7 é lançado com a confiabilidade em detrimento da inteligência

A Anthropic manteve um ritmo acelerado este ano, lançando novos recursos quase a cada dois dias. O tão aguardado Claude Opus 4.7 acaba de ser lançado oficialmente e, curiosamente, a Anthropic foi dire

A Haier lança o robô exoesqueleto esportivo com IA mais leve do mundo, pesando apenas 1,75 kg

O Grupo Haier apresentou o robô exoesqueleto com inteligência artificial mais leve do mundo para esportes — o Haier Exoskeleton Robot W3. Este lançamento estabelece um novo recorde do setor em termos

A Haier lança o robô exoesqueleto esportivo com IA mais leve do mundo, pesando apenas 1,75 kg

O Grupo Haier apresentou o robô exoesqueleto com inteligência artificial mais leve do mundo para esportes — o Haier Exoskeleton Robot W3. Este lançamento estabelece um novo recorde do setor em termos

A primeira série dramática com AIGC da Yaoke Media, “O Mistério do Bronze em Qinling”, estreia hoje com protagonistas criados por IA

Hoje marca o lançamento oficial da minissérie de mistério e fantasia com IA da Yaoke Media, “A História Secreta do Bronze de Qinling”. Estrelada pelos dois primeiros atores de IA contratados pela empr

Recomendações de tópicos especiais relacionados

Comentários (24)

A primeira série dramática com AIGC da Yaoke Media, “O Mistério do Bronze em Qinling”, estreia hoje com protagonistas criados por IA

Hoje marca o lançamento oficial da minissérie de mistério e fantasia com IA da Yaoke Media, “A História Secreta do Bronze de Qinling”. Estrelada pelos dois primeiros atores de IA contratados pela empr

Recomendações de tópicos especiais relacionados

Comentários (24)

![FredAllen]()

¡Por fin! Llevaba semanas esperando probar el modo de voz avanzado de ChatGPT 😍 Aunque no soy usuario premium, espero que llegue pronto a mi cuenta. ¿Alguien ya lo ha probado? ¿Vale la pena la espera o es mejor seguir usando otras alternativas como Gemini?

![StevenGonzalez]()

오늘 보이스 모드 테스트 해봤는데, 목소리가 너무 자연스러워서 놀랐어요! 😲 근데 프리미엄 유저에게 우선 배포한다니... 무료 사용자들은 언제쯤 쓸 수 있을지 궁금하네요. 가격 인상 얘기도 있는데 걱정돼요.

![NicholasThomas]()

Wow, voice mode for all ChatGPT subscribers? That's a game-changer! Can't wait to try it out and see how it stacks up against other AI assistants. 😎

![JackMitchell]()

Wow, voice mode for all ChatGPT subscribers is a game-changer! I’m stoked to try it out, but I wonder how it stacks up against other AI voice assistants. Anyone tested it yet? 😎

![GregoryRoberts]()

Finally got access to the voice mode on ChatGPT! It’s super cool and works surprisingly well. A bit pricey for non-premium users though 😅

O tão aguardado Modo de Voz Avançado da OpenAI, destacado durante o evento de lançamento de primavera, finalmente saiu da fase alfa e agora está acessível a todos os usuários do ChatGPT Plus e Team. Esta atualização empolgante foi anunciada pela OpenAI na terça-feira, marcando o início de uma implementação gradual que promete transformar a experiência de interação por voz.

O Modo de Voz Avançado apresenta um assistente de voz mais inteligente, capaz de ser interrompido e responder às emoções dos usuários, aprimorando o fluxo da conversa. Junto com isso, a OpenAI está lançando cinco novas vozes — Arbor, Maple, Sol, Spruce e Vale — disponíveis tanto no Modo de Voz Padrão quanto no Avançado. Essas adições foram projetadas para proporcionar uma interação mais personalizada e envolvente.

O Voz Avançada está sendo implementado para todos os usuários Plus e Team no aplicativo ChatGPT ao longo da semana.

Enquanto você esperava pacientemente, adicionamos Instruções Personalizadas, Memória, cinco novas vozes e sotaques aprimorados.

Ele também pode dizer “Desculpe-me por estar atrasado” em mais de 50 idiomas. pic.twitter.com/APOqqhXtDg— OpenAI (@OpenAI) 24 de setembro de 2024

A implementação inicialmente focará nos usuários do ChatGPT Plus e Team, com planos de expandir o acesso aos níveis Enterprise e Edu na próxima semana. Os usuários receberão uma notificação por meio de uma mensagem pop-up ao lado da opção de Modo de Voz na interface do ChatGPT, indicando o acesso a esse recurso.

Desde o lançamento alfa em julho, a OpenAI tem trabalhado arduamente na aprimoração do Modo de Voz Avançado. As melhorias incluem sotaques aprimorados em idiomas estrangeiros e velocidades de conversa mais fluidas. Visualmente, o modo agora apresenta uma esfera azul animada, adicionando um toque fresco à interface.

Para personalizar ainda mais a experiência, o Modo de Voz Avançado agora incorpora Instruções Personalizadas e Memória. Esses recursos permitem que o assistente de voz considere critérios específicos do usuário, resultando em respostas mais relevantes e personalizadas.

No entanto, uma limitação permanece desde a versão alfa: os usuários não poderão utilizar as capacidades multimodais do Modo de Voz, como assistência com conteúdo da tela ou uso da câmera do telefone para respostas contextuais, conforme demonstrado no vídeo abaixo.

A OpenAI tomou extensas medidas para garantir a segurança das capacidades de voz, testando-as com mais de 100 red teamers externos em 45 idiomas. Em agosto, a empresa lançou o Cartão do Sistema GPT-4o, um relatório detalhado sobre a segurança do LLM baseado em avaliações de risco, red-teaming externo e mais, que inclui avaliações do Modo de Voz Avançado.Para acessar o Modo de Voz Avançado, você pode assinar o ChatGPT Plus por $20 por mês. Essa assinatura não apenas concede acesso ao novo recurso de voz, mas também oferece benefícios adicionais, como análise de dados avançada, geração ilimitada de imagens, cinco vezes mais mensagens para o GPT-4o e a capacidade de criar GPTs personalizados.

Curiosamente, apenas uma semana após a OpenAI revelar o Modo de Voz Avançado em maio, o Google introduziu um recurso semelhante chamado Gemini Live. Esse assistente de voz conversacional, alimentado por LLMs, visa aprimorar o fluxo e a compreensão da conversa. No início deste mês, o Google disponibilizou o Gemini Live gratuitamente para todos os usuários de Android, proporcionando uma alternativa para aqueles interessados em tecnologia de assistente de voz semelhante sem a necessidade de uma assinatura paga.

Claude Opus 4.7 é lançado com a confiabilidade em detrimento da inteligência

A Anthropic manteve um ritmo acelerado este ano, lançando novos recursos quase a cada dois dias. O tão aguardado Claude Opus 4.7 acaba de ser lançado oficialmente e, curiosamente, a Anthropic foi dire

Claude Opus 4.7 é lançado com a confiabilidade em detrimento da inteligência

A Anthropic manteve um ritmo acelerado este ano, lançando novos recursos quase a cada dois dias. O tão aguardado Claude Opus 4.7 acaba de ser lançado oficialmente e, curiosamente, a Anthropic foi dire

A Haier lança o robô exoesqueleto esportivo com IA mais leve do mundo, pesando apenas 1,75 kg

O Grupo Haier apresentou o robô exoesqueleto com inteligência artificial mais leve do mundo para esportes — o Haier Exoskeleton Robot W3. Este lançamento estabelece um novo recorde do setor em termos

A Haier lança o robô exoesqueleto esportivo com IA mais leve do mundo, pesando apenas 1,75 kg

O Grupo Haier apresentou o robô exoesqueleto com inteligência artificial mais leve do mundo para esportes — o Haier Exoskeleton Robot W3. Este lançamento estabelece um novo recorde do setor em termos

A primeira série dramática com AIGC da Yaoke Media, “O Mistério do Bronze em Qinling”, estreia hoje com protagonistas criados por IA

Hoje marca o lançamento oficial da minissérie de mistério e fantasia com IA da Yaoke Media, “A História Secreta do Bronze de Qinling”. Estrelada pelos dois primeiros atores de IA contratados pela empr

A primeira série dramática com AIGC da Yaoke Media, “O Mistério do Bronze em Qinling”, estreia hoje com protagonistas criados por IA

Hoje marca o lançamento oficial da minissérie de mistério e fantasia com IA da Yaoke Media, “A História Secreta do Bronze de Qinling”. Estrelada pelos dois primeiros atores de IA contratados pela empr

¡Por fin! Llevaba semanas esperando probar el modo de voz avanzado de ChatGPT 😍 Aunque no soy usuario premium, espero que llegue pronto a mi cuenta. ¿Alguien ya lo ha probado? ¿Vale la pena la espera o es mejor seguir usando otras alternativas como Gemini?

오늘 보이스 모드 테스트 해봤는데, 목소리가 너무 자연스러워서 놀랐어요! 😲 근데 프리미엄 유저에게 우선 배포한다니... 무료 사용자들은 언제쯤 쓸 수 있을지 궁금하네요. 가격 인상 얘기도 있는데 걱정돼요.

Wow, voice mode for all ChatGPT subscribers? That's a game-changer! Can't wait to try it out and see how it stacks up against other AI assistants. 😎

Wow, voice mode for all ChatGPT subscribers is a game-changer! I’m stoked to try it out, but I wonder how it stacks up against other AI voice assistants. Anyone tested it yet? 😎

Finally got access to the voice mode on ChatGPT! It’s super cool and works surprisingly well. A bit pricey for non-premium users though 😅