New Wave Tech verbessert Android -Emotionen für größere Natürlichkeit

Wenn du jemals mit einem Androiden gechattet hast, der verblüffend menschlich aussieht, hast du vielleicht gespürt, dass etwas "nicht stimmt". Dieses unheimliche Gefühl geht über das bloße Aussehen hinaus; es ist tief mit der Art und Weise verbunden, wie Roboter Emotionen vermitteln und diese emotionalen Zustände aufrechterhalten. Im Wesentlichen geht es um ihre Unfähigkeit, menschliche emotionale Fähigkeiten nachzuahmen.

Heutige Androiden sind geschickt darin, einzelne Gesichtsausdrücke nachzuahmen, aber die echte Herausforderung liegt darin, fließende Übergänge zu gestalten und emotionale Konsistenz zu wahren. Traditionelle Systeme verlassen sich oft auf vorgefertigte Ausdrücke, was sich anfühlt, als würde man durch ein Buch statischer Bilder blättern, anstatt einen natürlichen Fluss von Emotionen zu erleben. Diese Steifheit kann zu einer Diskrepanz zwischen dem, was wir sehen, und dem, was wie echter emotionaler Ausdruck wirkt, führen.

Dies wird besonders bei längeren Interaktionen auffällig. Ein Androide könnte in einem Moment ein perfektes Lächeln zeigen, aber dann Schwierigkeiten haben, nahtlos zu einem anderen Ausdruck überzugehen, was uns daran erinnert, dass wir es mit einer Maschine zu tun haben und nicht mit einem Wesen mit echten Emotionen.

Eine wellenbasierte Lösung

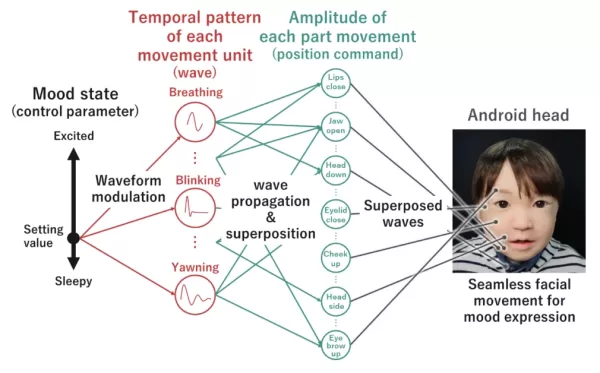

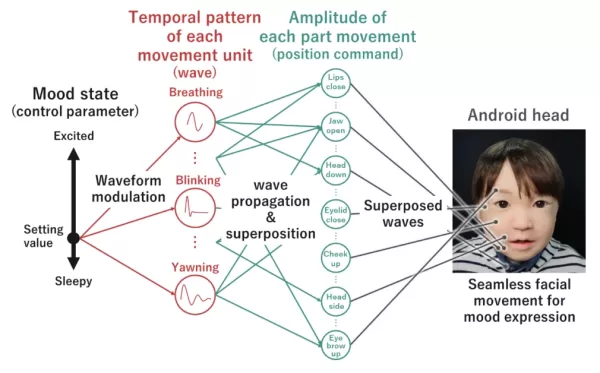

Hier kommt die bahnbrechende Forschung der Universität Osaka ins Spiel, die eine neue Perspektive darauf bietet, wie Androiden Emotionen ausdrücken sollten. Anstatt Gesichtsausdrücke als separate Aktionen zu betrachten, sieht diese neue Technologie sie als miteinander verbundene Wellen von Bewegungen, die natürlich über das Gesicht eines Androiden fließen.

Stell es dir wie eine Symphonie vor, in der verschiedene Instrumente harmonisch zusammenspielen. Dieses System kombiniert verschiedene Gesichtsbewegungen – von subtiler Atmung bis zu Augenblinzeln – zu einem kohärenten Ganzen. Jede Bewegung wird als Welle dargestellt, die in Echtzeit angepasst und mit anderen kombiniert werden kann.

Die Innovation liegt in der dynamischen Natur dieses Ansatzes. Durch das organische Erzeugen von Ausdrücken durch das Überlagern dieser Bewegungs-Wellen entsteht ein flüssigerer und natürlicherer Look, der die robotischen Übergänge beseitigt, die die Illusion authentischen emotionalen Ausdrucks zerstören können.

Der entscheidende technische Fortschritt ist das, was die Forscher als "Wellenformmodulation" bezeichnen. Diese Funktion ermöglicht es, dass der interne Zustand des Androiden direkt beeinflusst, wie sich diese Ausdruckswellen manifestieren, und fördert eine authentischere Verbindung zwischen den programmierten Emotionen des Roboters und seinen physischen Ausdrücken.

Echtzeit-Emotionale Intelligenz

Stell dir die Herausforderung vor, einen Roboter schläfrig aussehen zu lassen. Es geht nicht nur um herabhängende Augenlider; es erfordert die Koordination zahlreicher subtiler Bewegungen, die Menschen instinktiv als Zeichen von Müdigkeit erkennen. Dieses neue System meistert diese Komplexität durch einen cleveren Ansatz zur Bewegungs-Koordination.

Dynamische Ausdrucksfähigkeiten

Die Technologie orchestriert neun grundlegende Arten koordinierter Bewegungen, die mit verschiedenen Erregungszuständen verbunden sind: Atmung, spontanes Blinzeln, unruhige Augenbewegungen, Einnicken, Kopfschütteln, Saugreflex, pendulärer Nystagmus, seitliches Kopfschwingen und Gähnen.

Jede Bewegung wird durch eine "abklingende Welle" gesteuert, ein mathematisches Muster, das bestimmt, wie sich die Bewegung über die Zeit entwickelt. Diese Wellen werden mit fünf Schlüsselnparameter sorgfältig abgestimmt:

- Amplitude: steuert die Intensität der Bewegung

- Dämpfungsverhältnis: bestimmt, wie schnell die Bewegung abklingt

- Wellenlänge: legt den Zeitpunkt der Bewegung fest

- Oszillationszentrum: bestimmt den neutralen Punkt der Bewegung

- Reaktivierungsperiode: bestimmt, wie oft die Bewegung wieder auftritt

Reflexion des internen Zustands

Das herausragende Merkmal dieses Systems ist seine Fähigkeit, diese Bewegungen mit dem internen Erregungszustand des Roboters zu verbinden. Wenn das System hohe Erregung signalisiert (wie Aufregung), passen sich bestimmte Wellenparameter automatisch an – zum Beispiel wird die Atmung häufiger und ausgeprägter. In einem niedrigen Erregungszustand (wie Schläfrigkeit) beobachtest du möglicherweise langsameres, ausgeprägteres Gähnen und gelegentliches Kopfnicken.

Dies wird durch "zeitliches Management" und "haltungsbezogenes Management"-Module erreicht. Das zeitliche Modul bestimmt, wann Bewegungen auftreten, während das haltungsbezogene Modul sicherstellt, dass alle Gesichtskomponenten harmonisch zusammenarbeiten.

Hisashi Ishihara, der Hauptautor dieser Forschung und außerordentlicher Professor am Institut für Maschinenbau, Fakultät für Ingenieurwissenschaften, Universität Osaka, erklärt: "Anstatt oberflächliche Bewegungen zu erzeugen, könnte die weitere Entwicklung eines Systems, in dem interne Emotionen in jedem Detail der Handlungen eines Androiden widergespiegelt werden, zur Schaffung von Androiden führen, die als beseelt wahrgenommen werden."

Verbesserung bei Übergängen

Im Gegensatz zu traditionellen Systemen, die zwischen voraufgezeichneten Ausdrücken wechseln, sorgt dieser Ansatz für flüssige Übergänge, indem diese Wellenparameter kontinuierlich angepasst werden. Die Bewegungen werden durch ein ausgeklügeltes Netzwerk koordiniert, das sicherstellt, dass Gesichtsaktionen natürlich zusammenarbeiten, ähnlich wie die Gesichtsbewegungen eines Menschen unbewusst koordiniert werden.

Das Forschungsteam demonstrierte dies durch Experimente, die zeigten, wie das System verschiedene Erregungsstufen effektiv vermitteln konnte, während es natürlich wirkende Ausdrücke beibehielt.

Zukünftige Implikationen

Die Entwicklung dieses wellenbasierten emotionalen Ausdrucks-Systems eröffnet aufregende Möglichkeiten für die Mensch-Roboter-Interaktion und könnte potenziell mit Technologien wie Embodied AI integriert werden. Während aktuelle Androiden oft ein Gefühl der Unbehaglichkeit bei längeren Interaktionen hervorrufen, könnte diese Technologie helfen, das unheimliche Tal zu überbrücken – jenen beunruhigenden Raum, in dem Roboter fast, aber nicht ganz, menschlich erscheinen.

Der entscheidende Durchbruch liegt darin, eine authentisch wirkende emotionale Präsenz zu schaffen. Durch das Erzeugen flüssiger, kontextgerechter Ausdrücke, die mit internen Zuständen übereinstimmen, könnten Androiden effektiver in Rollen werden, die emotionale Intelligenz und menschliche Verbindung erfordern.

Koichi Osuka, der leitende Autor und Professor am Institut für Maschinenbau der Universität Osaka, bemerkt, dass diese Technologie "die emotionale Kommunikation zwischen Menschen und Robotern erheblich bereichern könnte". Stell dir Gesundheitsbegleiter vor, die angemessene Besorgnis ausdrücken, Bildungsroboter, die Begeisterung zeigen, oder Serviceroboter, die authentisch wirkende Aufmerksamkeit vermitteln.

Die Forschung zeigt besonders vielversprechende Ergebnisse beim Ausdruck verschiedener Erregungsstufen – von hochenergetischer Aufregung bis zu niedrigenergetischer Schläfrigkeit. Diese Fähigkeit könnte in Szenarien entscheidend sein, in denen Roboter Folgendes tun müssen:

- Wachsamkeitsstufen während langfristiger Interaktionen vermitteln

- Angemessene Energieniveaus in therapeutischen Umgebungen ausdrücken

- Ihren emotionalen Zustand an den sozialen Kontext anpassen

- Emotionale Konsistenz während ausgedehnter Gespräche aufrechterhalten

Die Fähigkeit des Systems, natürliche Übergänge zwischen Zuständen zu erzeugen, macht es besonders wertvoll für Anwendungen, die anhaltende Mensch-Roboter-Interaktion erfordern.

Indem emotionaler Ausdruck als flüssiges, wellenbasiertes Phänomen behandelt wird, anstatt als eine Reihe vorprogrammierter Zustände, eröffnet die Technologie viele neue Möglichkeiten, Roboter zu schaffen, die mit Menschen auf emotional bedeutungsvolle Weise interagieren können. Die nächsten Schritte des Forschungsteams werden sich darauf konzentrieren, den emotionalen Bereich des Systems zu erweitern und seine Fähigkeit, subtile emotionale Zustände zu vermitteln, weiter zu verfeinern, was beeinflussen wird, wie wir über Androiden in unserem täglichen Leben denken und mit ihnen interagieren.

Verwandter Artikel

Hugging Face startet Vorbestellungen für Reachy Mini Desktop-Roboter

Hugging Face lädt Entwickler ein, seine neueste Robotik-Innovation zu entdecken.Die AI-Plattform gab am Mittwoch bekannt, dass sie nun Vorbestellungen für ihre Reachy Mini Desktop-Roboter annimmt. Das

Hugging Face startet Vorbestellungen für Reachy Mini Desktop-Roboter

Hugging Face lädt Entwickler ein, seine neueste Robotik-Innovation zu entdecken.Die AI-Plattform gab am Mittwoch bekannt, dass sie nun Vorbestellungen für ihre Reachy Mini Desktop-Roboter annimmt. Das

Nvidia setzt bei humanoider Robotik mit Cloud-Unterstützung fort

Nvidia stürmt mit voller Geschwindigkeit in das Gebiet der menschenähnlichen Roboter vor und lässt nichts außer Acht. Auf der Computex 2025-Messe in Taiwan präsentierte die Firma e

Nvidia setzt bei humanoider Robotik mit Cloud-Unterstützung fort

Nvidia stürmt mit voller Geschwindigkeit in das Gebiet der menschenähnlichen Roboter vor und lässt nichts außer Acht. Auf der Computex 2025-Messe in Taiwan präsentierte die Firma e

Top 5 autonome Roboter für Baustellen im April 2025

Die Bauindustrie ist einer bemerkenswerten Transformation, die durch den Aufstieg von Robotik und Automatisierung getrieben wird. Da der globale Markt für Bauroboter bis 2030 voraussichtlich 3,5 Milliarden US -Dollar erreichen wird, revolutionieren diese Innovationen die Sicherheit und Effizienz auf Jobstandorten. Vom autonomen Stapel D.

Kommentare (6)

0/200

Top 5 autonome Roboter für Baustellen im April 2025

Die Bauindustrie ist einer bemerkenswerten Transformation, die durch den Aufstieg von Robotik und Automatisierung getrieben wird. Da der globale Markt für Bauroboter bis 2030 voraussichtlich 3,5 Milliarden US -Dollar erreichen wird, revolutionieren diese Innovationen die Sicherheit und Effizienz auf Jobstandorten. Vom autonomen Stapel D.

Kommentare (6)

0/200

![RogerRodriguez]() RogerRodriguez

RogerRodriguez

28. Juli 2025 03:18:39 MESZ

28. Juli 2025 03:18:39 MESZ

This article about android emotions is wild! It’s creepy how close they’re getting to human-like vibes, but I wonder if we’re ready for robots that can fake feelings this well. 😅 What’s next, a robot therapist?

0

0

![JerryMoore]() JerryMoore

JerryMoore

23. April 2025 17:33:32 MESZ

23. April 2025 17:33:32 MESZ

뉴 웨이브 테크의 안드로이드 감정 표현은 흥미롭지만, 여전히 어색함이 느껴져요. 자연스러움에 가까워지고 있지만, 아직 갈 길이 멀어요. 계속 노력하세요! 🤖😑

0

0

![JasonMartin]() JasonMartin

JasonMartin

23. April 2025 03:26:44 MESZ

23. April 2025 03:26:44 MESZ

O trabalho da New Wave Tech nas emoções dos androides é interessante, mas ainda parece um pouco estranho. Eles estão se aproximando da naturalidade, mas ainda há um longo caminho a percorrer. Continuem tentando, pessoal! 🤖😒

0

0

![WalterAnderson]() WalterAnderson

WalterAnderson

22. April 2025 17:23:09 MESZ

22. April 2025 17:23:09 MESZ

New Wave Tech's work on android emotions is interesting, but it still feels a bit off. They're getting closer to naturalness, but there's still a way to go. Keep pushing, guys! 🤖😕

0

0

![RobertMartin]() RobertMartin

RobertMartin

22. April 2025 12:44:01 MESZ

22. April 2025 12:44:01 MESZ

ニューウェーブテックのアンドロイドの感情表現は面白いけど、まだ違和感があるね。自然さに近づいてるけど、まだ道のりは長い。頑張って!🤖😐

0

0

![CharlesYoung]() CharlesYoung

CharlesYoung

22. April 2025 03:11:23 MESZ

22. April 2025 03:11:23 MESZ

El trabajo de New Wave Tech en las emociones de los androides es interesante, pero todavía se siente un poco raro. Están acercándose a la naturalidad, pero aún les falta. ¡Sigan adelante, chicos! 🤖😕

0

0

Wenn du jemals mit einem Androiden gechattet hast, der verblüffend menschlich aussieht, hast du vielleicht gespürt, dass etwas "nicht stimmt". Dieses unheimliche Gefühl geht über das bloße Aussehen hinaus; es ist tief mit der Art und Weise verbunden, wie Roboter Emotionen vermitteln und diese emotionalen Zustände aufrechterhalten. Im Wesentlichen geht es um ihre Unfähigkeit, menschliche emotionale Fähigkeiten nachzuahmen.

Heutige Androiden sind geschickt darin, einzelne Gesichtsausdrücke nachzuahmen, aber die echte Herausforderung liegt darin, fließende Übergänge zu gestalten und emotionale Konsistenz zu wahren. Traditionelle Systeme verlassen sich oft auf vorgefertigte Ausdrücke, was sich anfühlt, als würde man durch ein Buch statischer Bilder blättern, anstatt einen natürlichen Fluss von Emotionen zu erleben. Diese Steifheit kann zu einer Diskrepanz zwischen dem, was wir sehen, und dem, was wie echter emotionaler Ausdruck wirkt, führen.

Dies wird besonders bei längeren Interaktionen auffällig. Ein Androide könnte in einem Moment ein perfektes Lächeln zeigen, aber dann Schwierigkeiten haben, nahtlos zu einem anderen Ausdruck überzugehen, was uns daran erinnert, dass wir es mit einer Maschine zu tun haben und nicht mit einem Wesen mit echten Emotionen.

Eine wellenbasierte Lösung

Hier kommt die bahnbrechende Forschung der Universität Osaka ins Spiel, die eine neue Perspektive darauf bietet, wie Androiden Emotionen ausdrücken sollten. Anstatt Gesichtsausdrücke als separate Aktionen zu betrachten, sieht diese neue Technologie sie als miteinander verbundene Wellen von Bewegungen, die natürlich über das Gesicht eines Androiden fließen.

Stell es dir wie eine Symphonie vor, in der verschiedene Instrumente harmonisch zusammenspielen. Dieses System kombiniert verschiedene Gesichtsbewegungen – von subtiler Atmung bis zu Augenblinzeln – zu einem kohärenten Ganzen. Jede Bewegung wird als Welle dargestellt, die in Echtzeit angepasst und mit anderen kombiniert werden kann.

Die Innovation liegt in der dynamischen Natur dieses Ansatzes. Durch das organische Erzeugen von Ausdrücken durch das Überlagern dieser Bewegungs-Wellen entsteht ein flüssigerer und natürlicherer Look, der die robotischen Übergänge beseitigt, die die Illusion authentischen emotionalen Ausdrucks zerstören können.

Der entscheidende technische Fortschritt ist das, was die Forscher als "Wellenformmodulation" bezeichnen. Diese Funktion ermöglicht es, dass der interne Zustand des Androiden direkt beeinflusst, wie sich diese Ausdruckswellen manifestieren, und fördert eine authentischere Verbindung zwischen den programmierten Emotionen des Roboters und seinen physischen Ausdrücken.

Echtzeit-Emotionale Intelligenz

Stell dir die Herausforderung vor, einen Roboter schläfrig aussehen zu lassen. Es geht nicht nur um herabhängende Augenlider; es erfordert die Koordination zahlreicher subtiler Bewegungen, die Menschen instinktiv als Zeichen von Müdigkeit erkennen. Dieses neue System meistert diese Komplexität durch einen cleveren Ansatz zur Bewegungs-Koordination.

Dynamische Ausdrucksfähigkeiten

Die Technologie orchestriert neun grundlegende Arten koordinierter Bewegungen, die mit verschiedenen Erregungszuständen verbunden sind: Atmung, spontanes Blinzeln, unruhige Augenbewegungen, Einnicken, Kopfschütteln, Saugreflex, pendulärer Nystagmus, seitliches Kopfschwingen und Gähnen.

Jede Bewegung wird durch eine "abklingende Welle" gesteuert, ein mathematisches Muster, das bestimmt, wie sich die Bewegung über die Zeit entwickelt. Diese Wellen werden mit fünf Schlüsselnparameter sorgfältig abgestimmt:

- Amplitude: steuert die Intensität der Bewegung

- Dämpfungsverhältnis: bestimmt, wie schnell die Bewegung abklingt

- Wellenlänge: legt den Zeitpunkt der Bewegung fest

- Oszillationszentrum: bestimmt den neutralen Punkt der Bewegung

- Reaktivierungsperiode: bestimmt, wie oft die Bewegung wieder auftritt

Reflexion des internen Zustands

Das herausragende Merkmal dieses Systems ist seine Fähigkeit, diese Bewegungen mit dem internen Erregungszustand des Roboters zu verbinden. Wenn das System hohe Erregung signalisiert (wie Aufregung), passen sich bestimmte Wellenparameter automatisch an – zum Beispiel wird die Atmung häufiger und ausgeprägter. In einem niedrigen Erregungszustand (wie Schläfrigkeit) beobachtest du möglicherweise langsameres, ausgeprägteres Gähnen und gelegentliches Kopfnicken.

Dies wird durch "zeitliches Management" und "haltungsbezogenes Management"-Module erreicht. Das zeitliche Modul bestimmt, wann Bewegungen auftreten, während das haltungsbezogene Modul sicherstellt, dass alle Gesichtskomponenten harmonisch zusammenarbeiten.

Hisashi Ishihara, der Hauptautor dieser Forschung und außerordentlicher Professor am Institut für Maschinenbau, Fakultät für Ingenieurwissenschaften, Universität Osaka, erklärt: "Anstatt oberflächliche Bewegungen zu erzeugen, könnte die weitere Entwicklung eines Systems, in dem interne Emotionen in jedem Detail der Handlungen eines Androiden widergespiegelt werden, zur Schaffung von Androiden führen, die als beseelt wahrgenommen werden."

Verbesserung bei Übergängen

Im Gegensatz zu traditionellen Systemen, die zwischen voraufgezeichneten Ausdrücken wechseln, sorgt dieser Ansatz für flüssige Übergänge, indem diese Wellenparameter kontinuierlich angepasst werden. Die Bewegungen werden durch ein ausgeklügeltes Netzwerk koordiniert, das sicherstellt, dass Gesichtsaktionen natürlich zusammenarbeiten, ähnlich wie die Gesichtsbewegungen eines Menschen unbewusst koordiniert werden.

Das Forschungsteam demonstrierte dies durch Experimente, die zeigten, wie das System verschiedene Erregungsstufen effektiv vermitteln konnte, während es natürlich wirkende Ausdrücke beibehielt.

Zukünftige Implikationen

Die Entwicklung dieses wellenbasierten emotionalen Ausdrucks-Systems eröffnet aufregende Möglichkeiten für die Mensch-Roboter-Interaktion und könnte potenziell mit Technologien wie Embodied AI integriert werden. Während aktuelle Androiden oft ein Gefühl der Unbehaglichkeit bei längeren Interaktionen hervorrufen, könnte diese Technologie helfen, das unheimliche Tal zu überbrücken – jenen beunruhigenden Raum, in dem Roboter fast, aber nicht ganz, menschlich erscheinen.

Der entscheidende Durchbruch liegt darin, eine authentisch wirkende emotionale Präsenz zu schaffen. Durch das Erzeugen flüssiger, kontextgerechter Ausdrücke, die mit internen Zuständen übereinstimmen, könnten Androiden effektiver in Rollen werden, die emotionale Intelligenz und menschliche Verbindung erfordern.

Koichi Osuka, der leitende Autor und Professor am Institut für Maschinenbau der Universität Osaka, bemerkt, dass diese Technologie "die emotionale Kommunikation zwischen Menschen und Robotern erheblich bereichern könnte". Stell dir Gesundheitsbegleiter vor, die angemessene Besorgnis ausdrücken, Bildungsroboter, die Begeisterung zeigen, oder Serviceroboter, die authentisch wirkende Aufmerksamkeit vermitteln.

Die Forschung zeigt besonders vielversprechende Ergebnisse beim Ausdruck verschiedener Erregungsstufen – von hochenergetischer Aufregung bis zu niedrigenergetischer Schläfrigkeit. Diese Fähigkeit könnte in Szenarien entscheidend sein, in denen Roboter Folgendes tun müssen:

- Wachsamkeitsstufen während langfristiger Interaktionen vermitteln

- Angemessene Energieniveaus in therapeutischen Umgebungen ausdrücken

- Ihren emotionalen Zustand an den sozialen Kontext anpassen

- Emotionale Konsistenz während ausgedehnter Gespräche aufrechterhalten

Die Fähigkeit des Systems, natürliche Übergänge zwischen Zuständen zu erzeugen, macht es besonders wertvoll für Anwendungen, die anhaltende Mensch-Roboter-Interaktion erfordern.

Indem emotionaler Ausdruck als flüssiges, wellenbasiertes Phänomen behandelt wird, anstatt als eine Reihe vorprogrammierter Zustände, eröffnet die Technologie viele neue Möglichkeiten, Roboter zu schaffen, die mit Menschen auf emotional bedeutungsvolle Weise interagieren können. Die nächsten Schritte des Forschungsteams werden sich darauf konzentrieren, den emotionalen Bereich des Systems zu erweitern und seine Fähigkeit, subtile emotionale Zustände zu vermitteln, weiter zu verfeinern, was beeinflussen wird, wie wir über Androiden in unserem täglichen Leben denken und mit ihnen interagieren.

Hugging Face startet Vorbestellungen für Reachy Mini Desktop-Roboter

Hugging Face lädt Entwickler ein, seine neueste Robotik-Innovation zu entdecken.Die AI-Plattform gab am Mittwoch bekannt, dass sie nun Vorbestellungen für ihre Reachy Mini Desktop-Roboter annimmt. Das

Hugging Face startet Vorbestellungen für Reachy Mini Desktop-Roboter

Hugging Face lädt Entwickler ein, seine neueste Robotik-Innovation zu entdecken.Die AI-Plattform gab am Mittwoch bekannt, dass sie nun Vorbestellungen für ihre Reachy Mini Desktop-Roboter annimmt. Das

Nvidia setzt bei humanoider Robotik mit Cloud-Unterstützung fort

Nvidia stürmt mit voller Geschwindigkeit in das Gebiet der menschenähnlichen Roboter vor und lässt nichts außer Acht. Auf der Computex 2025-Messe in Taiwan präsentierte die Firma e

Nvidia setzt bei humanoider Robotik mit Cloud-Unterstützung fort

Nvidia stürmt mit voller Geschwindigkeit in das Gebiet der menschenähnlichen Roboter vor und lässt nichts außer Acht. Auf der Computex 2025-Messe in Taiwan präsentierte die Firma e

Top 5 autonome Roboter für Baustellen im April 2025

Die Bauindustrie ist einer bemerkenswerten Transformation, die durch den Aufstieg von Robotik und Automatisierung getrieben wird. Da der globale Markt für Bauroboter bis 2030 voraussichtlich 3,5 Milliarden US -Dollar erreichen wird, revolutionieren diese Innovationen die Sicherheit und Effizienz auf Jobstandorten. Vom autonomen Stapel D.

Top 5 autonome Roboter für Baustellen im April 2025

Die Bauindustrie ist einer bemerkenswerten Transformation, die durch den Aufstieg von Robotik und Automatisierung getrieben wird. Da der globale Markt für Bauroboter bis 2030 voraussichtlich 3,5 Milliarden US -Dollar erreichen wird, revolutionieren diese Innovationen die Sicherheit und Effizienz auf Jobstandorten. Vom autonomen Stapel D.

28. Juli 2025 03:18:39 MESZ

28. Juli 2025 03:18:39 MESZ

This article about android emotions is wild! It’s creepy how close they’re getting to human-like vibes, but I wonder if we’re ready for robots that can fake feelings this well. 😅 What’s next, a robot therapist?

0

0

23. April 2025 17:33:32 MESZ

23. April 2025 17:33:32 MESZ

뉴 웨이브 테크의 안드로이드 감정 표현은 흥미롭지만, 여전히 어색함이 느껴져요. 자연스러움에 가까워지고 있지만, 아직 갈 길이 멀어요. 계속 노력하세요! 🤖😑

0

0

23. April 2025 03:26:44 MESZ

23. April 2025 03:26:44 MESZ

O trabalho da New Wave Tech nas emoções dos androides é interessante, mas ainda parece um pouco estranho. Eles estão se aproximando da naturalidade, mas ainda há um longo caminho a percorrer. Continuem tentando, pessoal! 🤖😒

0

0

22. April 2025 17:23:09 MESZ

22. April 2025 17:23:09 MESZ

New Wave Tech's work on android emotions is interesting, but it still feels a bit off. They're getting closer to naturalness, but there's still a way to go. Keep pushing, guys! 🤖😕

0

0

22. April 2025 12:44:01 MESZ

22. April 2025 12:44:01 MESZ

ニューウェーブテックのアンドロイドの感情表現は面白いけど、まだ違和感があるね。自然さに近づいてるけど、まだ道のりは長い。頑張って!🤖😐

0

0

22. April 2025 03:11:23 MESZ

22. April 2025 03:11:23 MESZ

El trabajo de New Wave Tech en las emociones de los androides es interesante, pero todavía se siente un poco raro. Están acercándose a la naturalidad, pero aún les falta. ¡Sigan adelante, chicos! 🤖😕

0

0