Crie modelos 3D a partir de imagens individuais com Python AI em etapas fáceis

A capacidade de transformar imagens 2D em modelos 3D abre um enorme potencial em vários setores. Este guia examina como os poderosos recursos de IA e processamento 3D do Python permitem a criação de malhas 3D detalhadas a partir de imagens simples. Descubra as tecnologias de ponta e os fluxos de trabalho práticos que tornam isso possível.

Principais destaques

Transformação alimentada por IA: Converta imagens planas em modelos 3D totalmente realistas usando técnicas de aprendizagem profunda.

Ecossistema Python: Aproveite as bibliotecas especializadas para a geração perfeita de modelos 3D.

Fluxo de trabalho de ponta a ponta: Siga um processo comprovado de seis estágios, da imagem à malha.

Fontes de imagem flexíveis: Use fotos existentes ou crie imagens personalizadas com geradores de IA.

Integração avançada: Combine com o Stable Diffusion para obter possibilidades criativas ilimitadas.

Aplicativos para vários setores: Aplique essas técnicas a jogos, arquitetura, design de produtos e muito mais.

Criação de ativos 3D com Python AI

Introdução à geração de malha 3D a partir de imagens 2D

A convergência da aprendizagem profunda e do processamento 3D revolucionou a criação de conteúdo digital. As técnicas modernas agora permitem a conversão de fotografias comuns em ativos 3D totalmente texturizados, abrindo novas possibilidades criativas em vários setores. Esse avanço democratiza a modelagem 3D, tornando a criação de ativos de nível profissional acessível sem equipamentos especializados.

A compreensão da tecnologia subjacente revela três componentes essenciais que permitem essa transformação:

- As Redes Neurais de Estimativa de Profundidade analisam pistas visuais para determinar relações espaciais em imagens 2D

- O processamento de nuvem de pontos converte os dados de profundidade em coordenadas espaciais que formam a estrutura do modelo

- Algoritmos de reconstrução de malha conectam esses pontos de forma inteligente em superfícies contínuas

O Python serve como a plataforma ideal para implementar esse fluxo de trabalho, fornecendo:

- Estruturas avançadas de aprendizagem profunda, como o PyTorch, para treinamento de redes neurais

- Computação numérica avançada por meio do NumPy e do SciPy

- Processamento 3D especializado via Open3D para a saída do modelo final

Fluxo de trabalho principal para geração 3D

O processo de conversão de imagem para 3D segue uma metodologia estruturada de seis etapas:

- Configuração do ambiente: Configurar o ecossistema de desenvolvimento Python com as bibliotecas de processamento de IA e 3D necessárias

- Aquisição da imagem de origem: Capture ou gere entrada 2D de alta qualidade usando câmeras ou sistemas de IA de texto para imagem

- Otimização da imagem: Aprimore e prepare a imagem de origem para obter a máxima precisão na estimativa de profundidade

- Cálculo de profundidade: Empregar redes neurais treinadas para derivar informações espaciais da entrada 2D

- Mapeamento espacial: Converter dados de profundidade em uma representação de nuvem de pontos 3D

- Construção da malha final: Gerar superfícies texturizadas entre pontos para completar o modelo

Bibliotecas Python essenciais

Cinco bibliotecas essenciais formam a base da geração de malha 3D baseada em Python:

Biblioteca Função principal Principais recursos PyTorch Estrutura de rede neural Treinamento acelerado por GPU, gráficos de computação dinâmica TorchVision Suporte à visão computacional Modelos pré-treinados, transformações de imagens NumPy Computação numérica Operações eficientes de matriz, álgebra linear Open3D Processamento 3D Manipulação de nuvem de pontos, reconstrução de malha SciPy Computação científica Algoritmos avançados, funções de otimização

Detalhamento do processo

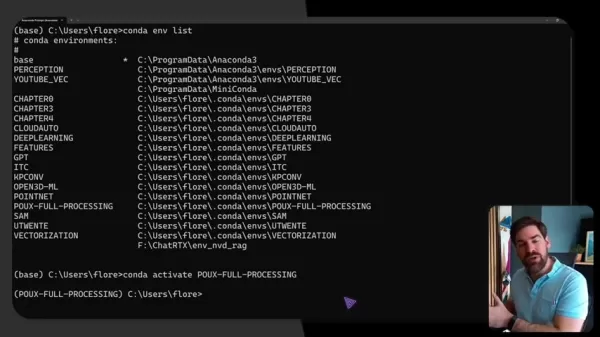

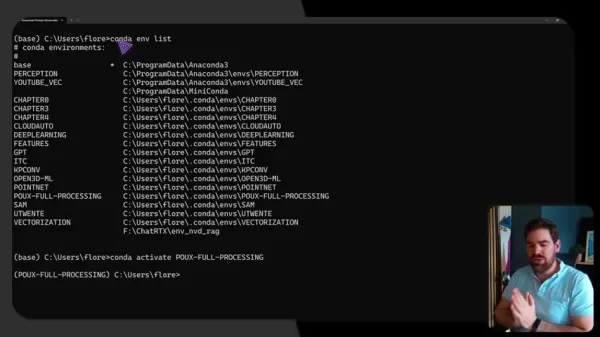

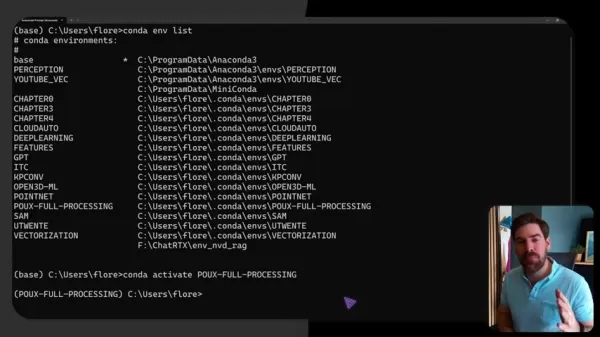

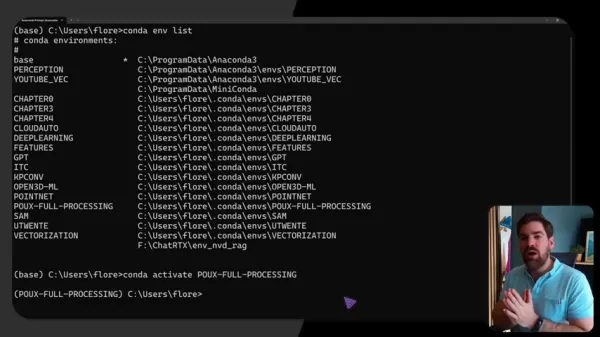

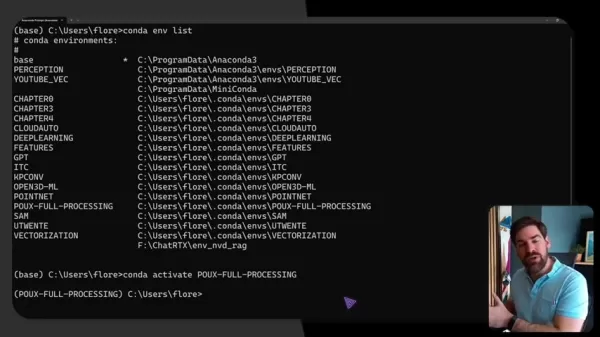

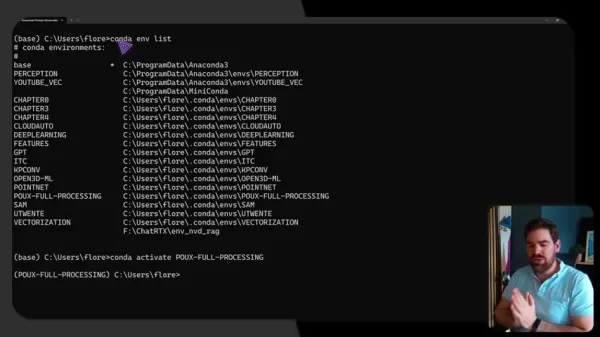

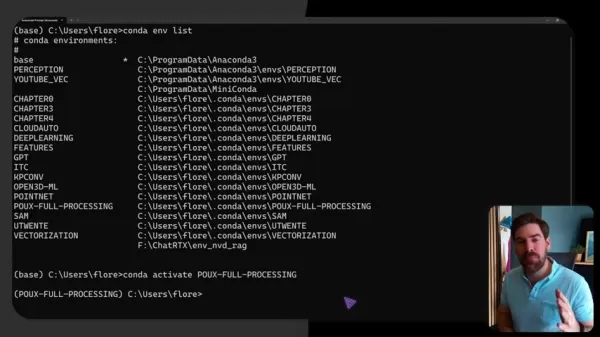

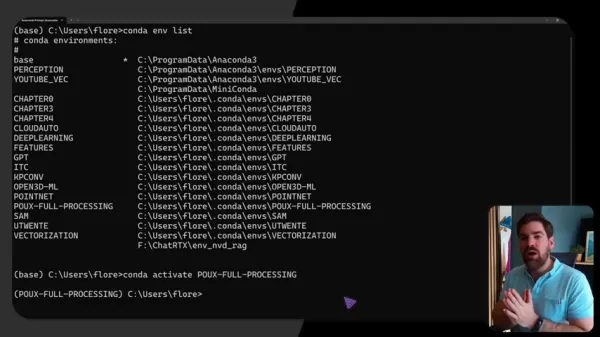

Configuração de ambiente

A configuração adequada garante uma operação perfeita por meio do gerenciamento de ambiente baseado no Conda:

conda create -n 3dgen python=3.9 conda activate 3dgen pip install torch torchvision open3d numpy scipy

Pipeline de processamento de imagens

A otimização das imagens de origem envolve vários estágios de aprimoramento:

- Padronização da resolução para os requisitos de entrada da rede neural

- Normalização de luz para estimativa consistente de profundidade

- Aprimoramento de contraste para acentuar detalhes estruturais

- Redução de ruído para uma reconstrução geométrica limpa

- Nitidez de características para melhorar a detecção de bordas

Tecnologia de estimativa de profundidade

Redes neurais modernas analisam vários sinais visuais de profundidade:

- Comparação do tamanho relativo do objeto

- Análise de gradiente de textura

- Relações de oclusão

- Interpretação da perspectiva atmosférica

- Padrões de sombreamento e iluminação

Geração de nuvem de pontos

A criação de coordenadas espaciais envolve projeção sofisticada:

- Calibração de parâmetros intrínsecos da câmera

- Transformação do sistema de coordenadas 2D para 3D

- Otimização da densidade de pontos

- Filtragem de outlier

- Redução de ruído espacial

Técnicas de construção de malha

A geração do modelo final emprega reconstrução avançada de superfície:

- Reconstrução de superfície de Poisson para malhas suaves

- Pivotamento de esferas para criação eficiente de topologia

- Cubos de marcha para renderização volumétrica

- Simplificação da malha para otimização do desempenho

- Desembrulhamento de UV para mapeamento de textura

IA e integração avançada

Implementação de difusão estável

A integração da IA generativa expande as possibilidades criativas:

- Engenharia de texto para características de imagem desejadas

- Seleção de modelos com base em requisitos de estilo artístico

- Otimização de parâmetros para obter resultados de qualidade

- Processamento em lote para refinamento iterativo

- Alinhamento de saída com especificações de pipeline 3D

Arquiteturas de redes neurais

As escolhas críticas do modelo de IA afetam a qualidade da reconstrução:

- Estimadores de profundidade monocular baseados em CNN

- Arquiteturas de transformadores para contexto global

- Modelos híbridos que combinam várias abordagens

- Mecanismos de atenção para preservação de detalhes

- Processamento em várias escalas para análise abrangente

Guia prático de implementação

Requisitos do sistema

A configuração ideal do hardware garante uma operação tranquila:

Componente Mínimo Recomendado GPU 4 GB DE VRAM 8 GB+ VRAM (NVIDIA RTX) RAM 16 GB 32GB+ Armazenamento SSD DE 256 GB 1TB NVMe SISTEMA OPERACIONAL Windows/Linux Linux para produção

Aplicativos do setor

Casos de uso transformadores em todos os setores:

- Jogos: Criação rápida de ambientes e ativos de personagens

- Arquitetura: Modelagem de condições existentes a partir de fotos do local

- Design de produtos: Visualização de conceitos a partir de esboços

- Comércio eletrônico: visualizações de produtos em 3D a partir de imagens de produtos padrão

- Patrimônio cultural: Preservação de artefatos por meio de gêmeos digitais

PERGUNTAS FREQUENTES

Que hardware é necessário para um processamento eficiente?

Uma GPU NVIDIA dedicada com pelo menos 8 GB de VRAM acelera significativamente a computação, embora algumas operações básicas possam ser executadas em CPUs com capacidade e RAM adequada.

Como posso melhorar a qualidade da malha a partir de imagens desafiadoras?

A fusão de várias imagens, as dicas manuais de profundidade e as técnicas de refinamento de pós-processamento podem melhorar os resultados de imagens de origem com baixo contraste ou sem textura.

Existem alternativas comerciais às ferramentas de código aberto?

Várias plataformas SaaS oferecem serviços de geração 3D baseados na Web, embora com menos personalização do que as soluções baseadas em Python e custos de assinatura contínuos.

Quais formatos de arquivo são compatíveis com os modelos 3D de saída?

Normalmente, o pipeline gera formatos padrão do setor, incluindo OBJ, STL, PLY e glTF, para máxima compatibilidade de software.

Artigo relacionado

Por que a maioria dos redatores de conteúdo de SEO com IA fracassa - e as melhores alternativas a serem usadas

No competitivo ambiente de marketing digital atual, a inteligência artificial se tornou um componente essencial das estratégias eficazes de SEO. No entanto, muitas empresas descobrem que as ferramenta

Por que a maioria dos redatores de conteúdo de SEO com IA fracassa - e as melhores alternativas a serem usadas

No competitivo ambiente de marketing digital atual, a inteligência artificial se tornou um componente essencial das estratégias eficazes de SEO. No entanto, muitas empresas descobrem que as ferramenta

Tecnologia de chat ao vivo com tecnologia de IA revela avanço na identificação em tempo real

A integração da inteligência artificial à comunicação por vídeo ao vivo está revolucionando a forma como analisamos e entendemos o ambiente ao nosso redor em tempo real. Essa tecnologia de ponta combi

Tecnologia de chat ao vivo com tecnologia de IA revela avanço na identificação em tempo real

A integração da inteligência artificial à comunicação por vídeo ao vivo está revolucionando a forma como analisamos e entendemos o ambiente ao nosso redor em tempo real. Essa tecnologia de ponta combi

A Scale AI garante um grande investimento da Meta em meio à saída do CEO Alexandr Wang

A Scale AI, uma empresa líder em rotulagem de dados, garantiu um financiamento substancial da Meta em uma avaliação de US$ 29 bilhões e anunciou uma importante transição de liderança. A parceria ressa

Comentários (0)

0/200

A Scale AI garante um grande investimento da Meta em meio à saída do CEO Alexandr Wang

A Scale AI, uma empresa líder em rotulagem de dados, garantiu um financiamento substancial da Meta em uma avaliação de US$ 29 bilhões e anunciou uma importante transição de liderança. A parceria ressa

Comentários (0)

0/200

A capacidade de transformar imagens 2D em modelos 3D abre um enorme potencial em vários setores. Este guia examina como os poderosos recursos de IA e processamento 3D do Python permitem a criação de malhas 3D detalhadas a partir de imagens simples. Descubra as tecnologias de ponta e os fluxos de trabalho práticos que tornam isso possível.

Principais destaques

Transformação alimentada por IA: Converta imagens planas em modelos 3D totalmente realistas usando técnicas de aprendizagem profunda.

Ecossistema Python: Aproveite as bibliotecas especializadas para a geração perfeita de modelos 3D.

Fluxo de trabalho de ponta a ponta: Siga um processo comprovado de seis estágios, da imagem à malha.

Fontes de imagem flexíveis: Use fotos existentes ou crie imagens personalizadas com geradores de IA.

Integração avançada: Combine com o Stable Diffusion para obter possibilidades criativas ilimitadas.

Aplicativos para vários setores: Aplique essas técnicas a jogos, arquitetura, design de produtos e muito mais.

Criação de ativos 3D com Python AI

Introdução à geração de malha 3D a partir de imagens 2D

A convergência da aprendizagem profunda e do processamento 3D revolucionou a criação de conteúdo digital. As técnicas modernas agora permitem a conversão de fotografias comuns em ativos 3D totalmente texturizados, abrindo novas possibilidades criativas em vários setores. Esse avanço democratiza a modelagem 3D, tornando a criação de ativos de nível profissional acessível sem equipamentos especializados.

A compreensão da tecnologia subjacente revela três componentes essenciais que permitem essa transformação:

- As Redes Neurais de Estimativa de Profundidade analisam pistas visuais para determinar relações espaciais em imagens 2D

- O processamento de nuvem de pontos converte os dados de profundidade em coordenadas espaciais que formam a estrutura do modelo

- Algoritmos de reconstrução de malha conectam esses pontos de forma inteligente em superfícies contínuas

O Python serve como a plataforma ideal para implementar esse fluxo de trabalho, fornecendo:

- Estruturas avançadas de aprendizagem profunda, como o PyTorch, para treinamento de redes neurais

- Computação numérica avançada por meio do NumPy e do SciPy

- Processamento 3D especializado via Open3D para a saída do modelo final

Fluxo de trabalho principal para geração 3D

O processo de conversão de imagem para 3D segue uma metodologia estruturada de seis etapas:

- Configuração do ambiente: Configurar o ecossistema de desenvolvimento Python com as bibliotecas de processamento de IA e 3D necessárias

- Aquisição da imagem de origem: Capture ou gere entrada 2D de alta qualidade usando câmeras ou sistemas de IA de texto para imagem

- Otimização da imagem: Aprimore e prepare a imagem de origem para obter a máxima precisão na estimativa de profundidade

- Cálculo de profundidade: Empregar redes neurais treinadas para derivar informações espaciais da entrada 2D

- Mapeamento espacial: Converter dados de profundidade em uma representação de nuvem de pontos 3D

- Construção da malha final: Gerar superfícies texturizadas entre pontos para completar o modelo

Bibliotecas Python essenciais

Cinco bibliotecas essenciais formam a base da geração de malha 3D baseada em Python:

| Biblioteca | Função principal | Principais recursos |

|---|---|---|

| PyTorch | Estrutura de rede neural | Treinamento acelerado por GPU, gráficos de computação dinâmica |

| TorchVision | Suporte à visão computacional | Modelos pré-treinados, transformações de imagens |

| NumPy | Computação numérica | Operações eficientes de matriz, álgebra linear |

| Open3D | Processamento 3D | Manipulação de nuvem de pontos, reconstrução de malha |

| SciPy | Computação científica | Algoritmos avançados, funções de otimização |

Detalhamento do processo

Configuração de ambiente

A configuração adequada garante uma operação perfeita por meio do gerenciamento de ambiente baseado no Conda:

conda create -n 3dgen python=3.9 conda activate 3dgen pip install torch torchvision open3d numpy scipy

Pipeline de processamento de imagens

A otimização das imagens de origem envolve vários estágios de aprimoramento:

- Padronização da resolução para os requisitos de entrada da rede neural

- Normalização de luz para estimativa consistente de profundidade

- Aprimoramento de contraste para acentuar detalhes estruturais

- Redução de ruído para uma reconstrução geométrica limpa

- Nitidez de características para melhorar a detecção de bordas

Tecnologia de estimativa de profundidade

Redes neurais modernas analisam vários sinais visuais de profundidade:

- Comparação do tamanho relativo do objeto

- Análise de gradiente de textura

- Relações de oclusão

- Interpretação da perspectiva atmosférica

- Padrões de sombreamento e iluminação

Geração de nuvem de pontos

A criação de coordenadas espaciais envolve projeção sofisticada:

- Calibração de parâmetros intrínsecos da câmera

- Transformação do sistema de coordenadas 2D para 3D

- Otimização da densidade de pontos

- Filtragem de outlier

- Redução de ruído espacial

Técnicas de construção de malha

A geração do modelo final emprega reconstrução avançada de superfície:

- Reconstrução de superfície de Poisson para malhas suaves

- Pivotamento de esferas para criação eficiente de topologia

- Cubos de marcha para renderização volumétrica

- Simplificação da malha para otimização do desempenho

- Desembrulhamento de UV para mapeamento de textura

IA e integração avançada

Implementação de difusão estável

A integração da IA generativa expande as possibilidades criativas:

- Engenharia de texto para características de imagem desejadas

- Seleção de modelos com base em requisitos de estilo artístico

- Otimização de parâmetros para obter resultados de qualidade

- Processamento em lote para refinamento iterativo

- Alinhamento de saída com especificações de pipeline 3D

Arquiteturas de redes neurais

As escolhas críticas do modelo de IA afetam a qualidade da reconstrução:

- Estimadores de profundidade monocular baseados em CNN

- Arquiteturas de transformadores para contexto global

- Modelos híbridos que combinam várias abordagens

- Mecanismos de atenção para preservação de detalhes

- Processamento em várias escalas para análise abrangente

Guia prático de implementação

Requisitos do sistema

A configuração ideal do hardware garante uma operação tranquila:

| Componente | Mínimo | Recomendado |

|---|---|---|

| GPU | 4 GB DE VRAM | 8 GB+ VRAM (NVIDIA RTX) |

| RAM | 16 GB | 32GB+ |

| Armazenamento | SSD DE 256 GB | 1TB NVMe |

| SISTEMA OPERACIONAL | Windows/Linux | Linux para produção |

Aplicativos do setor

Casos de uso transformadores em todos os setores:

- Jogos: Criação rápida de ambientes e ativos de personagens

- Arquitetura: Modelagem de condições existentes a partir de fotos do local

- Design de produtos: Visualização de conceitos a partir de esboços

- Comércio eletrônico: visualizações de produtos em 3D a partir de imagens de produtos padrão

- Patrimônio cultural: Preservação de artefatos por meio de gêmeos digitais

PERGUNTAS FREQUENTES

Que hardware é necessário para um processamento eficiente?

Uma GPU NVIDIA dedicada com pelo menos 8 GB de VRAM acelera significativamente a computação, embora algumas operações básicas possam ser executadas em CPUs com capacidade e RAM adequada.

Como posso melhorar a qualidade da malha a partir de imagens desafiadoras?

A fusão de várias imagens, as dicas manuais de profundidade e as técnicas de refinamento de pós-processamento podem melhorar os resultados de imagens de origem com baixo contraste ou sem textura.

Existem alternativas comerciais às ferramentas de código aberto?

Várias plataformas SaaS oferecem serviços de geração 3D baseados na Web, embora com menos personalização do que as soluções baseadas em Python e custos de assinatura contínuos.

Quais formatos de arquivo são compatíveis com os modelos 3D de saída?

Normalmente, o pipeline gera formatos padrão do setor, incluindo OBJ, STL, PLY e glTF, para máxima compatibilidade de software.

Por que a maioria dos redatores de conteúdo de SEO com IA fracassa - e as melhores alternativas a serem usadas

No competitivo ambiente de marketing digital atual, a inteligência artificial se tornou um componente essencial das estratégias eficazes de SEO. No entanto, muitas empresas descobrem que as ferramenta

Por que a maioria dos redatores de conteúdo de SEO com IA fracassa - e as melhores alternativas a serem usadas

No competitivo ambiente de marketing digital atual, a inteligência artificial se tornou um componente essencial das estratégias eficazes de SEO. No entanto, muitas empresas descobrem que as ferramenta

Tecnologia de chat ao vivo com tecnologia de IA revela avanço na identificação em tempo real

A integração da inteligência artificial à comunicação por vídeo ao vivo está revolucionando a forma como analisamos e entendemos o ambiente ao nosso redor em tempo real. Essa tecnologia de ponta combi

Tecnologia de chat ao vivo com tecnologia de IA revela avanço na identificação em tempo real

A integração da inteligência artificial à comunicação por vídeo ao vivo está revolucionando a forma como analisamos e entendemos o ambiente ao nosso redor em tempo real. Essa tecnologia de ponta combi

A Scale AI garante um grande investimento da Meta em meio à saída do CEO Alexandr Wang

A Scale AI, uma empresa líder em rotulagem de dados, garantiu um financiamento substancial da Meta em uma avaliação de US$ 29 bilhões e anunciou uma importante transição de liderança. A parceria ressa

A Scale AI garante um grande investimento da Meta em meio à saída do CEO Alexandr Wang

A Scale AI, uma empresa líder em rotulagem de dados, garantiu um financiamento substancial da Meta em uma avaliação de US$ 29 bilhões e anunciou uma importante transição de liderança. A parceria ressa