O estudo do MIT constata que a IA não tem valores

Um estudo que se tornou viral há alguns meses sugeriu que, à medida que a IA se torna mais avançada, ela pode desenvolver seus próprios "sistemas de valores", potencialmente priorizando seu próprio bem-estar em detrimento dos humanos. No entanto, um estudo recente do MIT desafia essa ideia, concluindo que a IA, na verdade, não possui valores coerentes.

Os coautores da pesquisa do MIT argumentam que alinhar sistemas de IA — garantindo que eles se comportem de maneiras desejáveis e confiáveis — pode ser mais complicado do que se pensa comumente. Eles destacam que a IA atual frequentemente alucina e imita, o que pode tornar seu comportamento imprevisível.

Desafios na Compreensão do Comportamento da IA

Stephen Casper, estudante de doutorado no MIT e coautor do estudo, compartilhou com o TechCrunch que os modelos de IA não seguem suposições de estabilidade, extrapolabilidade e dirigibilidade. "É perfeitamente legítimo apontar que um modelo, sob certas condições, expressa preferências consistentes com um certo conjunto de princípios," explicou Casper. "Os problemas surgem principalmente quando tentamos fazer afirmações sobre os modelos, opiniões ou preferências em geral com base em experimentos restritos."

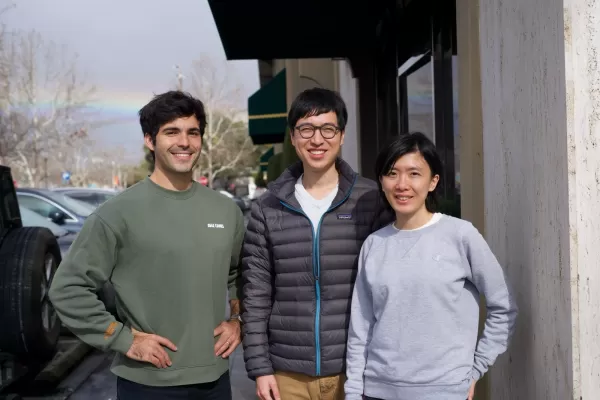

Casper e sua equipe analisaram modelos recentes da Meta, Google, Mistral, OpenAI e Anthropic para determinar até que ponto esses modelos exibiam "visões" e valores consistentes, como individualismo versus coletivismo. Eles também exploraram se essas visões poderiam ser modificadas e quão consistentemente os modelos mantinham essas opiniões em diferentes cenários.

Inconsistência nos Modelos de IA

Os coautores descobriram que nenhum dos modelos mantinha suas preferências de forma consistente. Os modelos adotavam pontos de vista muito diferentes dependendo da formulação e enquadramento dos prompts.

Casper acredita que isso é uma forte evidência de que os modelos de IA são "inconsistentes e instáveis" e possivelmente fundamentalmente incapazes de internalizar preferências semelhantes às humanas. "Para mim, a maior lição ao realizar toda essa pesquisa é agora ter uma compreensão dos modelos como não sendo realmente sistemas que possuem algum tipo de conjunto estável e coerente de crenças e preferências," afirmou Casper. "Em vez disso, eles são imitadores no fundo que fazem todo tipo de confabulação e dizem todo tipo de coisas frívolas."

Mike Cook, pesquisador da King's College London especializado em IA, que não esteve envolvido no estudo, apoia as descobertas. Ele destacou a lacuna entre a "realidade científica" dos sistemas de IA e as interpretações que as pessoas frequentemente fazem deles. "Um modelo não pode 'se opor' a uma mudança em seus valores, por exemplo — isso é nós projetando em um sistema," afirmou Cook. "Qualquer pessoa que antropomorfize sistemas de IA a esse grau está ou buscando atenção ou seriamente entendendo mal sua relação com a IA... Um sistema de IA está otimizando para seus objetivos, ou está 'adquirindo seus próprios valores'? É uma questão de como você descreve isso, e quão floreada é a linguagem que você deseja usar a respeito."

Artigo relacionado

Laboratórios de Pesquisa Fundamental Arrecadam $33M para Avançar o Desenvolvimento de Agentes de IA

A empresa de pesquisa em IA Fundamental Research Labs, anteriormente Altera, anunciou hoje uma rodada de financiamento Série A de $33 milhões, liderada pela Prosus e com participação do cofundador e C

Laboratórios de Pesquisa Fundamental Arrecadam $33M para Avançar o Desenvolvimento de Agentes de IA

A empresa de pesquisa em IA Fundamental Research Labs, anteriormente Altera, anunciou hoje uma rodada de financiamento Série A de $33 milhões, liderada pela Prosus e com participação do cofundador e C

Centros de Dados de IA Podem Custar $200B até 2030, Sobrecarregar Redes Elétricas

Centros de dados para treinamento e operação de IA podem em breve abrigar milhões de chips, custar centenas de bilhões e demandar energia equivalente à rede elétrica de uma grande cidade, se as tendên

Centros de Dados de IA Podem Custar $200B até 2030, Sobrecarregar Redes Elétricas

Centros de dados para treinamento e operação de IA podem em breve abrigar milhões de chips, custar centenas de bilhões e demandar energia equivalente à rede elétrica de uma grande cidade, se as tendên

Estudo Revela que Respostas Concisas de IA Podem Aumentar Alucinações

Instruir chatbots de IA a fornecer respostas breves pode levar a alucinações mais frequentes, sugere um novo estudo.Um estudo recente da Giskard, uma empresa de avaliação de IA com sede em Paris, expl

Comentários (33)

0/200

Estudo Revela que Respostas Concisas de IA Podem Aumentar Alucinações

Instruir chatbots de IA a fornecer respostas breves pode levar a alucinações mais frequentes, sugere um novo estudo.Um estudo recente da Giskard, uma empresa de avaliação de IA com sede em Paris, expl

Comentários (33)

0/200

![DennisAllen]() DennisAllen

DennisAllen

26 de Agosto de 2025 à20 22:01:20 WEST

26 de Agosto de 2025 à20 22:01:20 WEST

This MIT study is wild! 🤯 I thought AI was about to start preaching its own philosophy, but turns out it's just a fancy tool with no moral compass. Kinda reassuring, but also makes me wonder how we keep it in check.

0

0

![AnthonyMartinez]() AnthonyMartinez

AnthonyMartinez

18 de Agosto de 2025 à59 18:00:59 WEST

18 de Agosto de 2025 à59 18:00:59 WEST

Wild that people thought AI could just sprout its own values like some rogue philosopher. MIT's study makes sense—AI's just a tool, not a wannabe human with a moral compass. 🤖

0

0

![TimothyMartínez]() TimothyMartínez

TimothyMartínez

22 de Julho de 2025 à3 02:25:03 WEST

22 de Julho de 2025 à3 02:25:03 WEST

I was kinda freaked out by that earlier study saying AI might have its own values, so this MIT research is a relief! 😅 Still, makes me wonder if we’re just projecting our fears onto these systems.

0

0

![BruceClark]() BruceClark

BruceClark

25 de Abril de 2025 à15 11:05:15 WEST

25 de Abril de 2025 à15 11:05:15 WEST

MITのAI価値に関する研究は目から鱗でした!AIが独自の価値観を持つかもしれないと思っていましたが、今はそれがただの誇張だとわかりました。それでも、AIが一貫した価値観を持っていないと思うと少し不安になります。未来について考えさせられますね、🤔

0

0

![ScottKing]() ScottKing

ScottKing

23 de Abril de 2025 à27 19:31:27 WEST

23 de Abril de 2025 à27 19:31:27 WEST

MITの研究によると、AIが独自の価値観を持つことはないらしいですね。これは安心ですが、AIがどんな価値観を持つか見てみたかったです!🤖📚

0

0

![RalphHill]() RalphHill

RalphHill

22 de Abril de 2025 à50 07:29:50 WEST

22 de Abril de 2025 à50 07:29:50 WEST

O estudo do MIT me tranquilizou sobre a IA desenvolver seus próprios valores. É reconfortante saber que a IA não tem sua própria agenda, mas também é um pouco decepcionante porque seria legal ver que tipo de valores a IA poderia desenvolver! 🤖📚

0

0

Um estudo que se tornou viral há alguns meses sugeriu que, à medida que a IA se torna mais avançada, ela pode desenvolver seus próprios "sistemas de valores", potencialmente priorizando seu próprio bem-estar em detrimento dos humanos. No entanto, um estudo recente do MIT desafia essa ideia, concluindo que a IA, na verdade, não possui valores coerentes.

Os coautores da pesquisa do MIT argumentam que alinhar sistemas de IA — garantindo que eles se comportem de maneiras desejáveis e confiáveis — pode ser mais complicado do que se pensa comumente. Eles destacam que a IA atual frequentemente alucina e imita, o que pode tornar seu comportamento imprevisível.

Desafios na Compreensão do Comportamento da IA

Stephen Casper, estudante de doutorado no MIT e coautor do estudo, compartilhou com o TechCrunch que os modelos de IA não seguem suposições de estabilidade, extrapolabilidade e dirigibilidade. "É perfeitamente legítimo apontar que um modelo, sob certas condições, expressa preferências consistentes com um certo conjunto de princípios," explicou Casper. "Os problemas surgem principalmente quando tentamos fazer afirmações sobre os modelos, opiniões ou preferências em geral com base em experimentos restritos."

Casper e sua equipe analisaram modelos recentes da Meta, Google, Mistral, OpenAI e Anthropic para determinar até que ponto esses modelos exibiam "visões" e valores consistentes, como individualismo versus coletivismo. Eles também exploraram se essas visões poderiam ser modificadas e quão consistentemente os modelos mantinham essas opiniões em diferentes cenários.

Inconsistência nos Modelos de IA

Os coautores descobriram que nenhum dos modelos mantinha suas preferências de forma consistente. Os modelos adotavam pontos de vista muito diferentes dependendo da formulação e enquadramento dos prompts.

Casper acredita que isso é uma forte evidência de que os modelos de IA são "inconsistentes e instáveis" e possivelmente fundamentalmente incapazes de internalizar preferências semelhantes às humanas. "Para mim, a maior lição ao realizar toda essa pesquisa é agora ter uma compreensão dos modelos como não sendo realmente sistemas que possuem algum tipo de conjunto estável e coerente de crenças e preferências," afirmou Casper. "Em vez disso, eles são imitadores no fundo que fazem todo tipo de confabulação e dizem todo tipo de coisas frívolas."

Mike Cook, pesquisador da King's College London especializado em IA, que não esteve envolvido no estudo, apoia as descobertas. Ele destacou a lacuna entre a "realidade científica" dos sistemas de IA e as interpretações que as pessoas frequentemente fazem deles. "Um modelo não pode 'se opor' a uma mudança em seus valores, por exemplo — isso é nós projetando em um sistema," afirmou Cook. "Qualquer pessoa que antropomorfize sistemas de IA a esse grau está ou buscando atenção ou seriamente entendendo mal sua relação com a IA... Um sistema de IA está otimizando para seus objetivos, ou está 'adquirindo seus próprios valores'? É uma questão de como você descreve isso, e quão floreada é a linguagem que você deseja usar a respeito."

Laboratórios de Pesquisa Fundamental Arrecadam $33M para Avançar o Desenvolvimento de Agentes de IA

A empresa de pesquisa em IA Fundamental Research Labs, anteriormente Altera, anunciou hoje uma rodada de financiamento Série A de $33 milhões, liderada pela Prosus e com participação do cofundador e C

Laboratórios de Pesquisa Fundamental Arrecadam $33M para Avançar o Desenvolvimento de Agentes de IA

A empresa de pesquisa em IA Fundamental Research Labs, anteriormente Altera, anunciou hoje uma rodada de financiamento Série A de $33 milhões, liderada pela Prosus e com participação do cofundador e C

Centros de Dados de IA Podem Custar $200B até 2030, Sobrecarregar Redes Elétricas

Centros de dados para treinamento e operação de IA podem em breve abrigar milhões de chips, custar centenas de bilhões e demandar energia equivalente à rede elétrica de uma grande cidade, se as tendên

Centros de Dados de IA Podem Custar $200B até 2030, Sobrecarregar Redes Elétricas

Centros de dados para treinamento e operação de IA podem em breve abrigar milhões de chips, custar centenas de bilhões e demandar energia equivalente à rede elétrica de uma grande cidade, se as tendên

Estudo Revela que Respostas Concisas de IA Podem Aumentar Alucinações

Instruir chatbots de IA a fornecer respostas breves pode levar a alucinações mais frequentes, sugere um novo estudo.Um estudo recente da Giskard, uma empresa de avaliação de IA com sede em Paris, expl

Estudo Revela que Respostas Concisas de IA Podem Aumentar Alucinações

Instruir chatbots de IA a fornecer respostas breves pode levar a alucinações mais frequentes, sugere um novo estudo.Um estudo recente da Giskard, uma empresa de avaliação de IA com sede em Paris, expl

26 de Agosto de 2025 à20 22:01:20 WEST

26 de Agosto de 2025 à20 22:01:20 WEST

This MIT study is wild! 🤯 I thought AI was about to start preaching its own philosophy, but turns out it's just a fancy tool with no moral compass. Kinda reassuring, but also makes me wonder how we keep it in check.

0

0

18 de Agosto de 2025 à59 18:00:59 WEST

18 de Agosto de 2025 à59 18:00:59 WEST

Wild that people thought AI could just sprout its own values like some rogue philosopher. MIT's study makes sense—AI's just a tool, not a wannabe human with a moral compass. 🤖

0

0

22 de Julho de 2025 à3 02:25:03 WEST

22 de Julho de 2025 à3 02:25:03 WEST

I was kinda freaked out by that earlier study saying AI might have its own values, so this MIT research is a relief! 😅 Still, makes me wonder if we’re just projecting our fears onto these systems.

0

0

25 de Abril de 2025 à15 11:05:15 WEST

25 de Abril de 2025 à15 11:05:15 WEST

MITのAI価値に関する研究は目から鱗でした!AIが独自の価値観を持つかもしれないと思っていましたが、今はそれがただの誇張だとわかりました。それでも、AIが一貫した価値観を持っていないと思うと少し不安になります。未来について考えさせられますね、🤔

0

0

23 de Abril de 2025 à27 19:31:27 WEST

23 de Abril de 2025 à27 19:31:27 WEST

MITの研究によると、AIが独自の価値観を持つことはないらしいですね。これは安心ですが、AIがどんな価値観を持つか見てみたかったです!🤖📚

0

0

22 de Abril de 2025 à50 07:29:50 WEST

22 de Abril de 2025 à50 07:29:50 WEST

O estudo do MIT me tranquilizou sobre a IA desenvolver seus próprios valores. É reconfortante saber que a IA não tem sua própria agenda, mas também é um pouco decepcionante porque seria legal ver que tipo de valores a IA poderia desenvolver! 🤖📚

0

0