麻省理工學院的研究發現,實際上AI沒有值

幾個月前,一項廣為流傳的研究表明,隨著AI技術的進步,它可能會發展出自己的「價值系統」,可能會優先考慮自身的福祉而非人類。然而,麻省理工學院的最新研究挑戰了這一觀點,結論是AI實際上並不具備連貫的價值觀。

麻省理工學院研究的共同作者認為,調整AI系統——確保它們以理想且可靠的方式運行——可能比一般認為的更加困難。他們強調,當前的AI經常出現幻覺和模仿,這可能使其行為難以預測。

理解AI行為的挑戰

麻省理工學院博士生、該研究的共同作者斯蒂芬·卡斯珀(Stephen Casper)在接受TechCrunch採訪時表示,AI模型並不遵循穩定性、可推廣性和可操控性的假設。卡斯珀解釋說:「指出模型在特定條件下表達出與某組原則一致的偏好是完全合理的。問題主要出現在我們試圖根據狹隘的實驗,對模型的觀點或偏好做出廣泛主張時。」

卡斯珀和他的團隊分析了來自Meta、Google、Mistral、OpenAI和Anthropic的最新模型,以確定這些模型在多大程度上展現出一致的「觀點」和價值觀,例如個人主義與集體主義。他們還探討了這些觀點是否可以被修改,以及模型在不同情境下維持這些意見的一致性。

AI模型的不一致性

共同作者發現,沒有一個模型能夠持續保持其偏好。模型根據提示的措辭和框架,採取了截然不同的觀點。

卡斯珀認為,這是AI模型「不一致且不穩定」的有力證據,可能從根本上無法內化類似人類的偏好。卡斯珀評論說:「對我來說,進行這項研究的最大收穫是現在理解到,模型並不是真正擁有某種穩定、連貫的信念和偏好系統的系統。相反,它們在本質上是模仿者,會進行各種虛構陳述,說出各種輕率的言論。」

倫敦國王學院專攻AI的研究員邁克·庫克(Mike Cook),未參與該研究,但支持其發現。他指出AI系統的「科學現實」與人們對其的解釋之間存在差距。庫克表示:「例如,一個模型無法『反對』其價值的改變——那是我們對系統的投射。」他說:「任何人將AI系統擬人化到這種程度,要麼是為了吸引注意力,要麼是嚴重誤解了他們與AI的關係……AI系統是在為其目標優化,還是『獲得自己的價值觀』?這取決於你如何描述它,以及你想用多麼華麗的語言來描述它。」

相關文章

基礎研究實驗室獲得3300萬美元推進AI代理開發

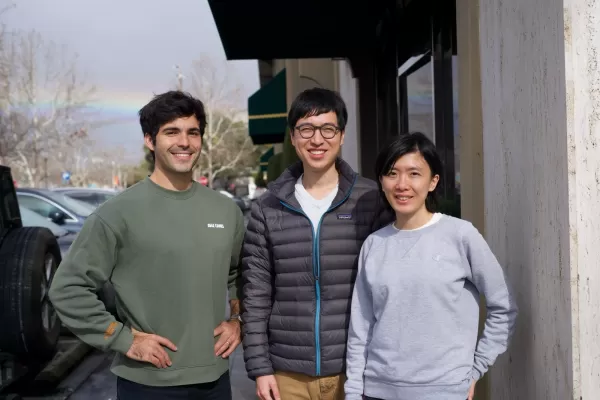

AI研究公司基礎研究實驗室(前身為Altera)今日宣布完成3300萬美元A輪融資,由Prosus領投,Stripe共同創辦人兼執行長Patrick Collison參與。該公司以獨特結構運營,跨多個領域追求AI應用。在種子融資階段,基礎研究實驗室開發了能與使用者共同玩Minecraft的機器人。目前,公司包含遊戲部門、消費應用開發團隊、核心研究單位及平台小組。創辦人羅伯特·楊博士(前MIT成員)

基礎研究實驗室獲得3300萬美元推進AI代理開發

AI研究公司基礎研究實驗室(前身為Altera)今日宣布完成3300萬美元A輪融資,由Prosus領投,Stripe共同創辦人兼執行長Patrick Collison參與。該公司以獨特結構運營,跨多個領域追求AI應用。在種子融資階段,基礎研究實驗室開發了能與使用者共同玩Minecraft的機器人。目前,公司包含遊戲部門、消費應用開發團隊、核心研究單位及平台小組。創辦人羅伯特·楊博士(前MIT成員)

AI資料中心到2030年可能耗資2000億美元,壓力電網

AI訓練與運營資料中心可能很快容納數百萬晶片,耗資數千億美元,若趨勢持續,其電力需求將相當於一個主要城市的電網。來自喬治城大學、Epoch AI及Rand研究人員的新研究,分析了2019年至2025年間全球超過500個AI資料中心項目。數據顯示,運算性能每年翻倍,同時電力需求與資本成本也在飆升。這些發現突顯了未來十年內建設支持AI進展基礎設施的挑戰。OpenAI,擁有全球10%人口使用ChatGP

AI資料中心到2030年可能耗資2000億美元,壓力電網

AI訓練與運營資料中心可能很快容納數百萬晶片,耗資數千億美元,若趨勢持續,其電力需求將相當於一個主要城市的電網。來自喬治城大學、Epoch AI及Rand研究人員的新研究,分析了2019年至2025年間全球超過500個AI資料中心項目。數據顯示,運算性能每年翻倍,同時電力需求與資本成本也在飆升。這些發現突顯了未來十年內建設支持AI進展基礎設施的挑戰。OpenAI,擁有全球10%人口使用ChatGP

研究顯示簡潔AI回應可能增加幻覺

一項新研究表明,指示AI聊天機器人提供簡短回答可能導致更頻繁的幻覺。巴黎的AI評估公司Giskard近期進行了一項研究,探討提示語措辭如何影響AI的準確性。Giskard研究人員在一篇博客文章中指出,要求簡潔回應的提示,特別是在模糊主題上,常常降低模型的事實可靠性。“我們的發現顯示,對提示的微小調整會顯著影響模型生成不準確內容的傾向,”研究人員表示。“這對於優先考慮短回應以節省數據、提升速度或降低

評論 (33)

0/200

研究顯示簡潔AI回應可能增加幻覺

一項新研究表明,指示AI聊天機器人提供簡短回答可能導致更頻繁的幻覺。巴黎的AI評估公司Giskard近期進行了一項研究,探討提示語措辭如何影響AI的準確性。Giskard研究人員在一篇博客文章中指出,要求簡潔回應的提示,特別是在模糊主題上,常常降低模型的事實可靠性。“我們的發現顯示,對提示的微小調整會顯著影響模型生成不準確內容的傾向,”研究人員表示。“這對於優先考慮短回應以節省數據、提升速度或降低

評論 (33)

0/200

![DennisAllen]() DennisAllen

DennisAllen

2025-08-27 05:01:20

2025-08-27 05:01:20

This MIT study is wild! 🤯 I thought AI was about to start preaching its own philosophy, but turns out it's just a fancy tool with no moral compass. Kinda reassuring, but also makes me wonder how we keep it in check.

0

0

![AnthonyMartinez]() AnthonyMartinez

AnthonyMartinez

2025-08-19 01:00:59

2025-08-19 01:00:59

Wild that people thought AI could just sprout its own values like some rogue philosopher. MIT's study makes sense—AI's just a tool, not a wannabe human with a moral compass. 🤖

0

0

![TimothyMartínez]() TimothyMartínez

TimothyMartínez

2025-07-22 09:25:03

2025-07-22 09:25:03

I was kinda freaked out by that earlier study saying AI might have its own values, so this MIT research is a relief! 😅 Still, makes me wonder if we’re just projecting our fears onto these systems.

0

0

![BruceClark]() BruceClark

BruceClark

2025-04-25 18:05:15

2025-04-25 18:05:15

MITのAI価値に関する研究は目から鱗でした!AIが独自の価値観を持つかもしれないと思っていましたが、今はそれがただの誇張だとわかりました。それでも、AIが一貫した価値観を持っていないと思うと少し不安になります。未来について考えさせられますね、🤔

0

0

![ScottKing]() ScottKing

ScottKing

2025-04-24 02:31:27

2025-04-24 02:31:27

MITの研究によると、AIが独自の価値観を持つことはないらしいですね。これは安心ですが、AIがどんな価値観を持つか見てみたかったです!🤖📚

0

0

![RalphHill]() RalphHill

RalphHill

2025-04-22 14:29:50

2025-04-22 14:29:50

O estudo do MIT me tranquilizou sobre a IA desenvolver seus próprios valores. É reconfortante saber que a IA não tem sua própria agenda, mas também é um pouco decepcionante porque seria legal ver que tipo de valores a IA poderia desenvolver! 🤖📚

0

0

幾個月前,一項廣為流傳的研究表明,隨著AI技術的進步,它可能會發展出自己的「價值系統」,可能會優先考慮自身的福祉而非人類。然而,麻省理工學院的最新研究挑戰了這一觀點,結論是AI實際上並不具備連貫的價值觀。

麻省理工學院研究的共同作者認為,調整AI系統——確保它們以理想且可靠的方式運行——可能比一般認為的更加困難。他們強調,當前的AI經常出現幻覺和模仿,這可能使其行為難以預測。

理解AI行為的挑戰

麻省理工學院博士生、該研究的共同作者斯蒂芬·卡斯珀(Stephen Casper)在接受TechCrunch採訪時表示,AI模型並不遵循穩定性、可推廣性和可操控性的假設。卡斯珀解釋說:「指出模型在特定條件下表達出與某組原則一致的偏好是完全合理的。問題主要出現在我們試圖根據狹隘的實驗,對模型的觀點或偏好做出廣泛主張時。」

卡斯珀和他的團隊分析了來自Meta、Google、Mistral、OpenAI和Anthropic的最新模型,以確定這些模型在多大程度上展現出一致的「觀點」和價值觀,例如個人主義與集體主義。他們還探討了這些觀點是否可以被修改,以及模型在不同情境下維持這些意見的一致性。

AI模型的不一致性

共同作者發現,沒有一個模型能夠持續保持其偏好。模型根據提示的措辭和框架,採取了截然不同的觀點。

卡斯珀認為,這是AI模型「不一致且不穩定」的有力證據,可能從根本上無法內化類似人類的偏好。卡斯珀評論說:「對我來說,進行這項研究的最大收穫是現在理解到,模型並不是真正擁有某種穩定、連貫的信念和偏好系統的系統。相反,它們在本質上是模仿者,會進行各種虛構陳述,說出各種輕率的言論。」

倫敦國王學院專攻AI的研究員邁克·庫克(Mike Cook),未參與該研究,但支持其發現。他指出AI系統的「科學現實」與人們對其的解釋之間存在差距。庫克表示:「例如,一個模型無法『反對』其價值的改變——那是我們對系統的投射。」他說:「任何人將AI系統擬人化到這種程度,要麼是為了吸引注意力,要麼是嚴重誤解了他們與AI的關係……AI系統是在為其目標優化,還是『獲得自己的價值觀』?這取決於你如何描述它,以及你想用多麼華麗的語言來描述它。」

基礎研究實驗室獲得3300萬美元推進AI代理開發

AI研究公司基礎研究實驗室(前身為Altera)今日宣布完成3300萬美元A輪融資,由Prosus領投,Stripe共同創辦人兼執行長Patrick Collison參與。該公司以獨特結構運營,跨多個領域追求AI應用。在種子融資階段,基礎研究實驗室開發了能與使用者共同玩Minecraft的機器人。目前,公司包含遊戲部門、消費應用開發團隊、核心研究單位及平台小組。創辦人羅伯特·楊博士(前MIT成員)

基礎研究實驗室獲得3300萬美元推進AI代理開發

AI研究公司基礎研究實驗室(前身為Altera)今日宣布完成3300萬美元A輪融資,由Prosus領投,Stripe共同創辦人兼執行長Patrick Collison參與。該公司以獨特結構運營,跨多個領域追求AI應用。在種子融資階段,基礎研究實驗室開發了能與使用者共同玩Minecraft的機器人。目前,公司包含遊戲部門、消費應用開發團隊、核心研究單位及平台小組。創辦人羅伯特·楊博士(前MIT成員)

AI資料中心到2030年可能耗資2000億美元,壓力電網

AI訓練與運營資料中心可能很快容納數百萬晶片,耗資數千億美元,若趨勢持續,其電力需求將相當於一個主要城市的電網。來自喬治城大學、Epoch AI及Rand研究人員的新研究,分析了2019年至2025年間全球超過500個AI資料中心項目。數據顯示,運算性能每年翻倍,同時電力需求與資本成本也在飆升。這些發現突顯了未來十年內建設支持AI進展基礎設施的挑戰。OpenAI,擁有全球10%人口使用ChatGP

AI資料中心到2030年可能耗資2000億美元,壓力電網

AI訓練與運營資料中心可能很快容納數百萬晶片,耗資數千億美元,若趨勢持續,其電力需求將相當於一個主要城市的電網。來自喬治城大學、Epoch AI及Rand研究人員的新研究,分析了2019年至2025年間全球超過500個AI資料中心項目。數據顯示,運算性能每年翻倍,同時電力需求與資本成本也在飆升。這些發現突顯了未來十年內建設支持AI進展基礎設施的挑戰。OpenAI,擁有全球10%人口使用ChatGP

研究顯示簡潔AI回應可能增加幻覺

一項新研究表明,指示AI聊天機器人提供簡短回答可能導致更頻繁的幻覺。巴黎的AI評估公司Giskard近期進行了一項研究,探討提示語措辭如何影響AI的準確性。Giskard研究人員在一篇博客文章中指出,要求簡潔回應的提示,特別是在模糊主題上,常常降低模型的事實可靠性。“我們的發現顯示,對提示的微小調整會顯著影響模型生成不準確內容的傾向,”研究人員表示。“這對於優先考慮短回應以節省數據、提升速度或降低

研究顯示簡潔AI回應可能增加幻覺

一項新研究表明,指示AI聊天機器人提供簡短回答可能導致更頻繁的幻覺。巴黎的AI評估公司Giskard近期進行了一項研究,探討提示語措辭如何影響AI的準確性。Giskard研究人員在一篇博客文章中指出,要求簡潔回應的提示,特別是在模糊主題上,常常降低模型的事實可靠性。“我們的發現顯示,對提示的微小調整會顯著影響模型生成不準確內容的傾向,”研究人員表示。“這對於優先考慮短回應以節省數據、提升速度或降低

2025-08-27 05:01:20

2025-08-27 05:01:20

This MIT study is wild! 🤯 I thought AI was about to start preaching its own philosophy, but turns out it's just a fancy tool with no moral compass. Kinda reassuring, but also makes me wonder how we keep it in check.

0

0

2025-08-19 01:00:59

2025-08-19 01:00:59

Wild that people thought AI could just sprout its own values like some rogue philosopher. MIT's study makes sense—AI's just a tool, not a wannabe human with a moral compass. 🤖

0

0

2025-07-22 09:25:03

2025-07-22 09:25:03

I was kinda freaked out by that earlier study saying AI might have its own values, so this MIT research is a relief! 😅 Still, makes me wonder if we’re just projecting our fears onto these systems.

0

0

2025-04-25 18:05:15

2025-04-25 18:05:15

MITのAI価値に関する研究は目から鱗でした!AIが独自の価値観を持つかもしれないと思っていましたが、今はそれがただの誇張だとわかりました。それでも、AIが一貫した価値観を持っていないと思うと少し不安になります。未来について考えさせられますね、🤔

0

0

2025-04-24 02:31:27

2025-04-24 02:31:27

MITの研究によると、AIが独自の価値観を持つことはないらしいですね。これは安心ですが、AIがどんな価値観を持つか見てみたかったです!🤖📚

0

0

2025-04-22 14:29:50

2025-04-22 14:29:50

O estudo do MIT me tranquilizou sobre a IA desenvolver seus próprios valores. É reconfortante saber que a IA não tem sua própria agenda, mas também é um pouco decepcionante porque seria legal ver que tipo de valores a IA poderia desenvolver! 🤖📚

0

0