Meta, 고급 Llama 도구로 AI 보안 강화

Meta는 AI 개발을 강화하고 새로운 위협으로부터 보호하기 위해 새로운 Llama 보안 도구를 출시했습니다.

이러한 업그레이드된 Llama AI 모델 보안 도구는 Meta의 새로운 리소스와 함께 제공되어 사이버 보안 팀이 AI를 방어에 활용할 수 있도록 지원하며, 모든 AI 이해관계자의 안전을 강화하는 것을 목표로 합니다.

Llama 모델을 사용하는 개발자는 이제 Meta의 Llama Protections 페이지, Hugging Face, GitHub에서 직접 제공되는 향상된 도구에 액세스할 수 있습니다.

Llama Guard 4는 텍스트와 이미지를 모두 포함하는 멀티모달 기능을 도입하여 점점 더 시각적인 AI 애플리케이션에 필수적인 안전성을 강화합니다. 이는 현재 제한된 미리보기로 제공되는 Meta의 새로운 Llama API에 통합되었습니다.

신규 추가된 LlamaFirewall은 AI 시스템의 보안 허브 역할을 하며, 안전 모델을 조정하고 프롬프트 인젝션 공격, 안전하지 않은 코드 생성, 악성 AI 플러그인 행동과 같은 위험을 방어하기 위해 Meta의 보호 도구와 통합됩니다.

Meta는 또한 Llama Prompt Guard를 개선했습니다. 업데이트된 Prompt Guard 2 (86M) 모델은 탈옥 시도와 프롬프트 인젝션을 탐지하는 데 탁월합니다. 또한 컴팩트한 Prompt Guard 2 22M은 최대 75%까지 지연 시간과 계산 비용을 줄여 비용을 고려하는 개발자를 위해 강력한 탐지 성능을 유지합니다.

개발자 외에도 Meta는 사이버 공격에 대응하기 위해 AI 기반 도구로 사이버 보안 전문가를 지원하며, 고급 방어에 대한 증가하는 수요에 대응합니다.

CyberSec Eval 4 벤치마크 스위트는 조직이 보안 작업에서 AI 성능을 평가할 수 있는 도구를 제공하도록 개편되었습니다. 여기에는 두 가지 새로운 추가 사항이 포함됩니다:

- CyberSOC Eval: CrowdStrike와 공동 개발한 이 프레임워크는 위협 탐지 및 대응에 초점을 맞춘 실제 보안 운영 센터 환경에서 AI의 효과를 평가합니다. 곧 제공될 예정입니다.

- AutoPatchBench: 이는 Llama 및 기타 AI 모델이 악용 전에 코드 취약점을 식별하고 패치하는 능력을 테스트합니다.

Meta의 Llama Defenders Program은 파트너와 개발자에게 오픈 소스 및 조기 액세스 도구를 결합한 맞춤형 AI 보안 솔루션을 제공하여 다양한 과제를 해결합니다.

Meta는 내부 자동 민감 문서 분류 도구를 공유하여 RAG 설정과 같은 AI 시스템에서 무단 유출이나 오용을 방지하기 위해 민감한 문서를 라벨링합니다.

AI 생성 오디오 사기를 방지하기 위해 Meta는 ZenDesk, Bell Canada, AT&T와 같은 파트너와 Llama Generated Audio Detector 및 Llama Audio Watermark Detector를 공유하여 피싱 또는 사기 시도에서 사기성 AI 음성을 식별합니다.

Meta는 또한 WhatsApp용 Private Processing을 미리 공개하여 메시지 내용에 접근하지 않고 AI가 메시지를 요약하거나 답변 초안을 작성할 수 있도록 하여 사용자 프라이버시를 우선시합니다.

Meta는 위협 모델을 공개적으로 공유하여 보안 연구자들이 출시 전에 아키텍처를 면밀히 조사하도록 장려하며, 견고한 프라이버시 조치에 대한 헌신을 보여줍니다.

Meta의 이 포괄적인 AI 보안 업데이트 세트는 AI 생태계를 강화하면서 기술 커뮤니티에 안전한 개발과 효과적인 방어를 위한 도구를 제공합니다.

참고: Microsoft, AI 기반 사기 시도에서 40억 달러 발견

암스테르담, 캘리포니아, 런던에서 열리는 AI & Big Data Expo에서 AI와 빅데이터에 대해 더 알아보세요. Intelligent Automation Conference, BlockX, Digital Transformation Week, Cyber Security & Cloud Expo와 같은 행사와 함께 개최됩니다.

TechForge의 다가오는 엔터프라이즈 기술 이벤트 및 웨비나를 여기에서 탐색하세요.

관련 기사

WordPress.com에서는 이제 AI 에이전트가 게시물을 작성하고 게시할 수 있게 되었으며, 그 외에도 다양한 기능이 추가되었습니다

인기 웹 호스팅 및 게시 플랫폼인 WordPress.com이 이제 AI 에이전트를 도입하고 있으며, 이는 웹의 모습과 사용 경험을 재편할 수 있는 움직임입니다. 이 회사는 금요일, AI 에이전트가 고객 웹사이트에서 콘텐츠를 작성, 편집 및 게시할 뿐만 아니라 댓글을 관리하고, 메타데이터를 업데이트 및 수정하며, 태그와 카테고리를 통해 콘텐츠를 정리할 수 있

WordPress.com에서는 이제 AI 에이전트가 게시물을 작성하고 게시할 수 있게 되었으며, 그 외에도 다양한 기능이 추가되었습니다

인기 웹 호스팅 및 게시 플랫폼인 WordPress.com이 이제 AI 에이전트를 도입하고 있으며, 이는 웹의 모습과 사용 경험을 재편할 수 있는 움직임입니다. 이 회사는 금요일, AI 에이전트가 고객 웹사이트에서 콘텐츠를 작성, 편집 및 게시할 뿐만 아니라 댓글을 관리하고, 메타데이터를 업데이트 및 수정하며, 태그와 카테고리를 통해 콘텐츠를 정리할 수 있

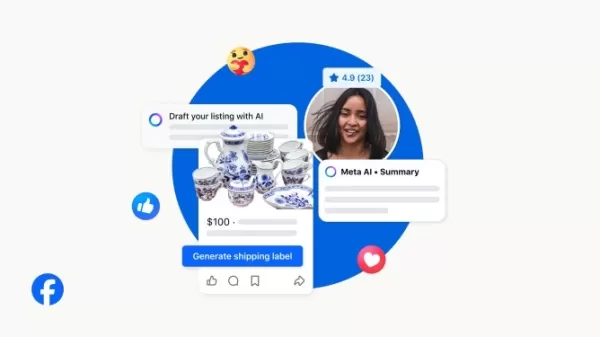

메타 AI가 이제 페이스북 마켓플레이스에서 구매자의 메시지에 응답합니다

페이스북 마켓플레이스가 구매자 문의에 대한 자동 응답 기능을 포함한 새로운 메타 AI 기능을 도입한다고 목요일 회사 측이 발표했다. 또한 이 플랫폼은 AI를 활용해 상품 등록을 가속화하고 판매자 프로필을 요약하며, 이제 판매자가 상품 목록에 배송 옵션을 제공할 수 있도록 지원한다.판매자들은 종종 수많은 구매자 문의를 받기 때문에, 페이스북은 메타 AI 기반

메타 AI가 이제 페이스북 마켓플레이스에서 구매자의 메시지에 응답합니다

페이스북 마켓플레이스가 구매자 문의에 대한 자동 응답 기능을 포함한 새로운 메타 AI 기능을 도입한다고 목요일 회사 측이 발표했다. 또한 이 플랫폼은 AI를 활용해 상품 등록을 가속화하고 판매자 프로필을 요약하며, 이제 판매자가 상품 목록에 배송 옵션을 제공할 수 있도록 지원한다.판매자들은 종종 수많은 구매자 문의를 받기 때문에, 페이스북은 메타 AI 기반

메타, 아마존 AI용 CPU 수백만 대 공급 계약 체결

아마존은 자체 설계 칩을 다시 한번 앞세워 메타(Meta)와 중요한 파트너십을 체결했다. 아마존은 금요일, 메타가 확대되는 AI 수요를 충족하기 위해 수백만 개의 AWS 그래비톤(Graviton) 칩을 도입하기로 합의했다고 밝혔다.참고로 AWS 그래비톤은 GPU(그래픽 처리 장치)가 아닌 ARM 기반 CPU(일반 컴퓨팅용으로 설계된 중앙 처리 장치)입니다.

관련 특별 주제 추천

의견 (2)

0/500

메타, 아마존 AI용 CPU 수백만 대 공급 계약 체결

아마존은 자체 설계 칩을 다시 한번 앞세워 메타(Meta)와 중요한 파트너십을 체결했다. 아마존은 금요일, 메타가 확대되는 AI 수요를 충족하기 위해 수백만 개의 AWS 그래비톤(Graviton) 칩을 도입하기로 합의했다고 밝혔다.참고로 AWS 그래비톤은 GPU(그래픽 처리 장치)가 아닌 ARM 기반 CPU(일반 컴퓨팅용으로 설계된 중앙 처리 장치)입니다.

관련 특별 주제 추천

의견 (2)

0/500

![WillieCarter]()

Ces outils semblent prometteurs, mais j'espère que les gros acteurs comme Meta vont vraiment s'intéresser à la sécurité dès la conception, pas seulement en réaction aux problèmes. La course à l'IA crée un terrain dangereux si la robustesse est sacrifiée pour la vitesse de déploiement. 🤔 On verra à l'usage.

![RyanAdams]()

A Meta está realmente investindo pesado em segurança de IA! Essas novas ferramentas do Llama parecem promissoras para desenvolvedores. Espero que essas atualizações ajudem a prevenir vazamentos de dados e viés algorítmico, problemas que têm sido frequentes. Será que outras grandes empresas, como Google e OpenAI, vão seguir o exemplo e lançar recursos semelhantes? 🤔 É uma corrida interessante para ver quem protege melhor os usuários.

Meta는 AI 개발을 강화하고 새로운 위협으로부터 보호하기 위해 새로운 Llama 보안 도구를 출시했습니다.

이러한 업그레이드된 Llama AI 모델 보안 도구는 Meta의 새로운 리소스와 함께 제공되어 사이버 보안 팀이 AI를 방어에 활용할 수 있도록 지원하며, 모든 AI 이해관계자의 안전을 강화하는 것을 목표로 합니다.

Llama 모델을 사용하는 개발자는 이제 Meta의 Llama Protections 페이지, Hugging Face, GitHub에서 직접 제공되는 향상된 도구에 액세스할 수 있습니다.

Llama Guard 4는 텍스트와 이미지를 모두 포함하는 멀티모달 기능을 도입하여 점점 더 시각적인 AI 애플리케이션에 필수적인 안전성을 강화합니다. 이는 현재 제한된 미리보기로 제공되는 Meta의 새로운 Llama API에 통합되었습니다.

신규 추가된 LlamaFirewall은 AI 시스템의 보안 허브 역할을 하며, 안전 모델을 조정하고 프롬프트 인젝션 공격, 안전하지 않은 코드 생성, 악성 AI 플러그인 행동과 같은 위험을 방어하기 위해 Meta의 보호 도구와 통합됩니다.

Meta는 또한 Llama Prompt Guard를 개선했습니다. 업데이트된 Prompt Guard 2 (86M) 모델은 탈옥 시도와 프롬프트 인젝션을 탐지하는 데 탁월합니다. 또한 컴팩트한 Prompt Guard 2 22M은 최대 75%까지 지연 시간과 계산 비용을 줄여 비용을 고려하는 개발자를 위해 강력한 탐지 성능을 유지합니다.

개발자 외에도 Meta는 사이버 공격에 대응하기 위해 AI 기반 도구로 사이버 보안 전문가를 지원하며, 고급 방어에 대한 증가하는 수요에 대응합니다.

CyberSec Eval 4 벤치마크 스위트는 조직이 보안 작업에서 AI 성능을 평가할 수 있는 도구를 제공하도록 개편되었습니다. 여기에는 두 가지 새로운 추가 사항이 포함됩니다:

- CyberSOC Eval: CrowdStrike와 공동 개발한 이 프레임워크는 위협 탐지 및 대응에 초점을 맞춘 실제 보안 운영 센터 환경에서 AI의 효과를 평가합니다. 곧 제공될 예정입니다.

- AutoPatchBench: 이는 Llama 및 기타 AI 모델이 악용 전에 코드 취약점을 식별하고 패치하는 능력을 테스트합니다.

Meta의 Llama Defenders Program은 파트너와 개발자에게 오픈 소스 및 조기 액세스 도구를 결합한 맞춤형 AI 보안 솔루션을 제공하여 다양한 과제를 해결합니다.

Meta는 내부 자동 민감 문서 분류 도구를 공유하여 RAG 설정과 같은 AI 시스템에서 무단 유출이나 오용을 방지하기 위해 민감한 문서를 라벨링합니다.

AI 생성 오디오 사기를 방지하기 위해 Meta는 ZenDesk, Bell Canada, AT&T와 같은 파트너와 Llama Generated Audio Detector 및 Llama Audio Watermark Detector를 공유하여 피싱 또는 사기 시도에서 사기성 AI 음성을 식별합니다.

Meta는 또한 WhatsApp용 Private Processing을 미리 공개하여 메시지 내용에 접근하지 않고 AI가 메시지를 요약하거나 답변 초안을 작성할 수 있도록 하여 사용자 프라이버시를 우선시합니다.

Meta는 위협 모델을 공개적으로 공유하여 보안 연구자들이 출시 전에 아키텍처를 면밀히 조사하도록 장려하며, 견고한 프라이버시 조치에 대한 헌신을 보여줍니다.

Meta의 이 포괄적인 AI 보안 업데이트 세트는 AI 생태계를 강화하면서 기술 커뮤니티에 안전한 개발과 효과적인 방어를 위한 도구를 제공합니다.

참고: Microsoft, AI 기반 사기 시도에서 40억 달러 발견

암스테르담, 캘리포니아, 런던에서 열리는 AI & Big Data Expo에서 AI와 빅데이터에 대해 더 알아보세요. Intelligent Automation Conference, BlockX, Digital Transformation Week, Cyber Security & Cloud Expo와 같은 행사와 함께 개최됩니다.

TechForge의 다가오는 엔터프라이즈 기술 이벤트 및 웨비나를 여기에서 탐색하세요.

WordPress.com에서는 이제 AI 에이전트가 게시물을 작성하고 게시할 수 있게 되었으며, 그 외에도 다양한 기능이 추가되었습니다

인기 웹 호스팅 및 게시 플랫폼인 WordPress.com이 이제 AI 에이전트를 도입하고 있으며, 이는 웹의 모습과 사용 경험을 재편할 수 있는 움직임입니다. 이 회사는 금요일, AI 에이전트가 고객 웹사이트에서 콘텐츠를 작성, 편집 및 게시할 뿐만 아니라 댓글을 관리하고, 메타데이터를 업데이트 및 수정하며, 태그와 카테고리를 통해 콘텐츠를 정리할 수 있

WordPress.com에서는 이제 AI 에이전트가 게시물을 작성하고 게시할 수 있게 되었으며, 그 외에도 다양한 기능이 추가되었습니다

인기 웹 호스팅 및 게시 플랫폼인 WordPress.com이 이제 AI 에이전트를 도입하고 있으며, 이는 웹의 모습과 사용 경험을 재편할 수 있는 움직임입니다. 이 회사는 금요일, AI 에이전트가 고객 웹사이트에서 콘텐츠를 작성, 편집 및 게시할 뿐만 아니라 댓글을 관리하고, 메타데이터를 업데이트 및 수정하며, 태그와 카테고리를 통해 콘텐츠를 정리할 수 있

메타 AI가 이제 페이스북 마켓플레이스에서 구매자의 메시지에 응답합니다

페이스북 마켓플레이스가 구매자 문의에 대한 자동 응답 기능을 포함한 새로운 메타 AI 기능을 도입한다고 목요일 회사 측이 발표했다. 또한 이 플랫폼은 AI를 활용해 상품 등록을 가속화하고 판매자 프로필을 요약하며, 이제 판매자가 상품 목록에 배송 옵션을 제공할 수 있도록 지원한다.판매자들은 종종 수많은 구매자 문의를 받기 때문에, 페이스북은 메타 AI 기반

메타 AI가 이제 페이스북 마켓플레이스에서 구매자의 메시지에 응답합니다

페이스북 마켓플레이스가 구매자 문의에 대한 자동 응답 기능을 포함한 새로운 메타 AI 기능을 도입한다고 목요일 회사 측이 발표했다. 또한 이 플랫폼은 AI를 활용해 상품 등록을 가속화하고 판매자 프로필을 요약하며, 이제 판매자가 상품 목록에 배송 옵션을 제공할 수 있도록 지원한다.판매자들은 종종 수많은 구매자 문의를 받기 때문에, 페이스북은 메타 AI 기반

메타, 아마존 AI용 CPU 수백만 대 공급 계약 체결

아마존은 자체 설계 칩을 다시 한번 앞세워 메타(Meta)와 중요한 파트너십을 체결했다. 아마존은 금요일, 메타가 확대되는 AI 수요를 충족하기 위해 수백만 개의 AWS 그래비톤(Graviton) 칩을 도입하기로 합의했다고 밝혔다.참고로 AWS 그래비톤은 GPU(그래픽 처리 장치)가 아닌 ARM 기반 CPU(일반 컴퓨팅용으로 설계된 중앙 처리 장치)입니다.

메타, 아마존 AI용 CPU 수백만 대 공급 계약 체결

아마존은 자체 설계 칩을 다시 한번 앞세워 메타(Meta)와 중요한 파트너십을 체결했다. 아마존은 금요일, 메타가 확대되는 AI 수요를 충족하기 위해 수백만 개의 AWS 그래비톤(Graviton) 칩을 도입하기로 합의했다고 밝혔다.참고로 AWS 그래비톤은 GPU(그래픽 처리 장치)가 아닌 ARM 기반 CPU(일반 컴퓨팅용으로 설계된 중앙 처리 장치)입니다.

Ces outils semblent prometteurs, mais j'espère que les gros acteurs comme Meta vont vraiment s'intéresser à la sécurité dès la conception, pas seulement en réaction aux problèmes. La course à l'IA crée un terrain dangereux si la robustesse est sacrifiée pour la vitesse de déploiement. 🤔 On verra à l'usage.

A Meta está realmente investindo pesado em segurança de IA! Essas novas ferramentas do Llama parecem promissoras para desenvolvedores. Espero que essas atualizações ajudem a prevenir vazamentos de dados e viés algorítmico, problemas que têm sido frequentes. Será que outras grandes empresas, como Google e OpenAI, vão seguir o exemplo e lançar recursos semelhantes? 🤔 É uma corrida interessante para ver quem protege melhor os usuários.

집

집