Meta Aprimora a Segurança de IA com Ferramentas Avançadas do Llama

A Meta lançou novas ferramentas de segurança do Llama para fortalecer o desenvolvimento de IA e proteger contra ameaças emergentes.

Essas ferramentas de segurança do modelo de IA Llama atualizadas são combinadas com novos recursos da Meta para capacitar equipes de cibersegurança a utilizar IA para defesa, visando aumentar a segurança para todos os envolvidos com IA.

Desenvolvedores que utilizam modelos Llama agora têm acesso a ferramentas aprimoradas, disponíveis diretamente na página de Proteções do Llama da Meta, Hugging Face e GitHub.

O Llama Guard 4 apresenta capacidades multimodais, permitindo a aplicação de segurança para texto e imagens, essencial para aplicações de IA cada vez mais visuais. Ele está integrado à nova API do Llama da Meta, atualmente em visualização limitada.

O LlamaFirewall, uma nova adição, atua como um centro de segurança para sistemas de IA, coordenando modelos de segurança e integrando-se com as ferramentas de proteção da Meta para combater riscos como ataques de injeção de prompts, geração de código inseguro ou comportamento malicioso de plug-ins de IA.

A Meta também aprimorou o Llama Prompt Guard. O modelo atualizado Prompt Guard 2 (86M) destaca-se na detecção de tentativas de jailbreak e injeções de prompts. Além disso, o compacto Prompt Guard 2 22M reduz a latência e os custos computacionais em até 75%, mantendo uma forte detecção para desenvolvedores preocupados com custos.

Além dos desenvolvedores, a Meta apoia profissionais de cibersegurança com ferramentas impulsionadas por IA para combater ataques cibernéticos, respondendo à crescente demanda por defesas avançadas.

O conjunto de benchmarks CyberSec Eval 4 foi reformulado, oferecendo às organizações ferramentas para avaliar o desempenho da IA em tarefas de segurança. Ele inclui duas novas adições:

- CyberSOC Eval: Desenvolvido com a CrowdStrike, este framework avalia a eficácia da IA em ambientes reais de Centros de Operações de Segurança, focando na detecção e resposta a ameaças. Estará disponível em breve.

- AutoPatchBench: Este testa a capacidade do Llama e outros modelos de IA de identificar e corrigir vulnerabilidades de código antes da exploração.

O Programa Llama Defenders da Meta oferece a parceiros e desenvolvedores soluções de segurança de IA personalizadas, combinando ferramentas de código aberto e de acesso antecipado para enfrentar diversos desafios.

A Meta está compartilhando sua ferramenta interna de Classificação Automatizada de Documentos Sensíveis, que rotula documentos sensíveis para prevenir vazamentos não autorizados ou uso indevido em sistemas de IA como configurações RAG.

Para combater golpes de áudio gerados por IA, a Meta está compartilhando o Detector de Áudio Gerado por Llama e o Detector de Marca d'Água de Áudio do Llama com parceiros como ZenDesk, Bell Canada e AT&T para identificar vozes fraudulentas de IA em tentativas de phishing ou fraude.

A Meta também apresentou o Processamento Privado para o WhatsApp, permitindo que a IA resuma mensagens ou redija respostas sem acessar o conteúdo das mensagens, priorizando a privacidade do usuário.

A Meta compartilha abertamente seu modelo de ameaças, incentivando pesquisadores de segurança a examinar a arquitetura antes do lançamento, demonstrando um compromisso com medidas robustas de privacidade.

Este conjunto abrangente de atualizações de segurança de IA da Meta fortalece seu ecossistema de IA enquanto equipa a comunidade tecnológica com ferramentas para desenvolvimento seguro e defesa eficaz.

Veja também: Microsoft descobre US$4 bilhões em tentativas de fraude impulsionadas por IA

Descubra mais sobre IA e big data na AI & Big Data Expo em Amsterdã, Califórnia e Londres, co-localizada com eventos como Intelligent Automation Conference, BlockX, Digital Transformation Week e Cyber Security & Cloud Expo.

Explore eventos e webinars de tecnologia empresarial futuros da TechForge aqui.

Artigo relacionado

O WordPress.com agora permite que agentes de IA escrevam e publiquem posts, entre outras coisas

O WordPress.com, a popular plataforma de hospedagem e publicação na web, está agora adotando agentes de IA — uma iniciativa que pode transformar a aparência e a experiência da web. A empresa anunciou

O WordPress.com agora permite que agentes de IA escrevam e publiquem posts, entre outras coisas

O WordPress.com, a popular plataforma de hospedagem e publicação na web, está agora adotando agentes de IA — uma iniciativa que pode transformar a aparência e a experiência da web. A empresa anunciou

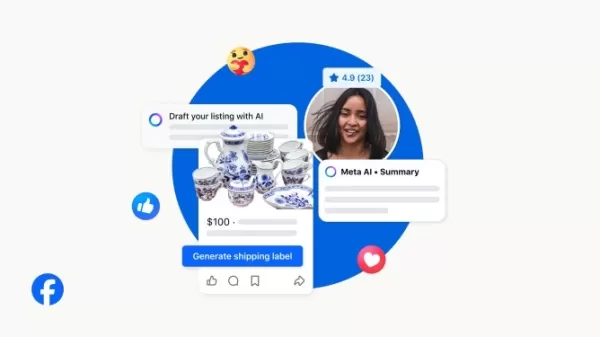

A Meta AI agora responde às mensagens dos compradores no Facebook Marketplace

O Facebook Marketplace lança novos recursos de IA da Meta, incluindo respostas automáticas às consultas dos compradores, anunciou a empresa nesta quinta-feira. A plataforma também utiliza IA para agil

A Meta AI agora responde às mensagens dos compradores no Facebook Marketplace

O Facebook Marketplace lança novos recursos de IA da Meta, incluindo respostas automáticas às consultas dos compradores, anunciou a empresa nesta quinta-feira. A plataforma também utiliza IA para agil

Meta fecha acordo para a aquisição de milhões de CPUs de IA da Amazon

A Amazon fechou uma parceria significativa com a Meta, mais uma vez contando com seus próprios chips projetados sob medida. A Meta concordou em implantar milhões de chips AWS Graviton para atender às

Recomendações de tópicos especiais relacionados

Comentários (2)

Meta fecha acordo para a aquisição de milhões de CPUs de IA da Amazon

A Amazon fechou uma parceria significativa com a Meta, mais uma vez contando com seus próprios chips projetados sob medida. A Meta concordou em implantar milhões de chips AWS Graviton para atender às

Recomendações de tópicos especiais relacionados

Comentários (2)

![WillieCarter]()

Ces outils semblent prometteurs, mais j'espère que les gros acteurs comme Meta vont vraiment s'intéresser à la sécurité dès la conception, pas seulement en réaction aux problèmes. La course à l'IA crée un terrain dangereux si la robustesse est sacrifiée pour la vitesse de déploiement. 🤔 On verra à l'usage.

![RyanAdams]()

A Meta está realmente investindo pesado em segurança de IA! Essas novas ferramentas do Llama parecem promissoras para desenvolvedores. Espero que essas atualizações ajudem a prevenir vazamentos de dados e viés algorítmico, problemas que têm sido frequentes. Será que outras grandes empresas, como Google e OpenAI, vão seguir o exemplo e lançar recursos semelhantes? 🤔 É uma corrida interessante para ver quem protege melhor os usuários.

A Meta lançou novas ferramentas de segurança do Llama para fortalecer o desenvolvimento de IA e proteger contra ameaças emergentes.

Essas ferramentas de segurança do modelo de IA Llama atualizadas são combinadas com novos recursos da Meta para capacitar equipes de cibersegurança a utilizar IA para defesa, visando aumentar a segurança para todos os envolvidos com IA.

Desenvolvedores que utilizam modelos Llama agora têm acesso a ferramentas aprimoradas, disponíveis diretamente na página de Proteções do Llama da Meta, Hugging Face e GitHub.

O Llama Guard 4 apresenta capacidades multimodais, permitindo a aplicação de segurança para texto e imagens, essencial para aplicações de IA cada vez mais visuais. Ele está integrado à nova API do Llama da Meta, atualmente em visualização limitada.

O LlamaFirewall, uma nova adição, atua como um centro de segurança para sistemas de IA, coordenando modelos de segurança e integrando-se com as ferramentas de proteção da Meta para combater riscos como ataques de injeção de prompts, geração de código inseguro ou comportamento malicioso de plug-ins de IA.

A Meta também aprimorou o Llama Prompt Guard. O modelo atualizado Prompt Guard 2 (86M) destaca-se na detecção de tentativas de jailbreak e injeções de prompts. Além disso, o compacto Prompt Guard 2 22M reduz a latência e os custos computacionais em até 75%, mantendo uma forte detecção para desenvolvedores preocupados com custos.

Além dos desenvolvedores, a Meta apoia profissionais de cibersegurança com ferramentas impulsionadas por IA para combater ataques cibernéticos, respondendo à crescente demanda por defesas avançadas.

O conjunto de benchmarks CyberSec Eval 4 foi reformulado, oferecendo às organizações ferramentas para avaliar o desempenho da IA em tarefas de segurança. Ele inclui duas novas adições:

- CyberSOC Eval: Desenvolvido com a CrowdStrike, este framework avalia a eficácia da IA em ambientes reais de Centros de Operações de Segurança, focando na detecção e resposta a ameaças. Estará disponível em breve.

- AutoPatchBench: Este testa a capacidade do Llama e outros modelos de IA de identificar e corrigir vulnerabilidades de código antes da exploração.

O Programa Llama Defenders da Meta oferece a parceiros e desenvolvedores soluções de segurança de IA personalizadas, combinando ferramentas de código aberto e de acesso antecipado para enfrentar diversos desafios.

A Meta está compartilhando sua ferramenta interna de Classificação Automatizada de Documentos Sensíveis, que rotula documentos sensíveis para prevenir vazamentos não autorizados ou uso indevido em sistemas de IA como configurações RAG.

Para combater golpes de áudio gerados por IA, a Meta está compartilhando o Detector de Áudio Gerado por Llama e o Detector de Marca d'Água de Áudio do Llama com parceiros como ZenDesk, Bell Canada e AT&T para identificar vozes fraudulentas de IA em tentativas de phishing ou fraude.

A Meta também apresentou o Processamento Privado para o WhatsApp, permitindo que a IA resuma mensagens ou redija respostas sem acessar o conteúdo das mensagens, priorizando a privacidade do usuário.

A Meta compartilha abertamente seu modelo de ameaças, incentivando pesquisadores de segurança a examinar a arquitetura antes do lançamento, demonstrando um compromisso com medidas robustas de privacidade.

Este conjunto abrangente de atualizações de segurança de IA da Meta fortalece seu ecossistema de IA enquanto equipa a comunidade tecnológica com ferramentas para desenvolvimento seguro e defesa eficaz.

Veja também: Microsoft descobre US$4 bilhões em tentativas de fraude impulsionadas por IA

Descubra mais sobre IA e big data na AI & Big Data Expo em Amsterdã, Califórnia e Londres, co-localizada com eventos como Intelligent Automation Conference, BlockX, Digital Transformation Week e Cyber Security & Cloud Expo.

Explore eventos e webinars de tecnologia empresarial futuros da TechForge aqui.

O WordPress.com agora permite que agentes de IA escrevam e publiquem posts, entre outras coisas

O WordPress.com, a popular plataforma de hospedagem e publicação na web, está agora adotando agentes de IA — uma iniciativa que pode transformar a aparência e a experiência da web. A empresa anunciou

O WordPress.com agora permite que agentes de IA escrevam e publiquem posts, entre outras coisas

O WordPress.com, a popular plataforma de hospedagem e publicação na web, está agora adotando agentes de IA — uma iniciativa que pode transformar a aparência e a experiência da web. A empresa anunciou

A Meta AI agora responde às mensagens dos compradores no Facebook Marketplace

O Facebook Marketplace lança novos recursos de IA da Meta, incluindo respostas automáticas às consultas dos compradores, anunciou a empresa nesta quinta-feira. A plataforma também utiliza IA para agil

A Meta AI agora responde às mensagens dos compradores no Facebook Marketplace

O Facebook Marketplace lança novos recursos de IA da Meta, incluindo respostas automáticas às consultas dos compradores, anunciou a empresa nesta quinta-feira. A plataforma também utiliza IA para agil

Meta fecha acordo para a aquisição de milhões de CPUs de IA da Amazon

A Amazon fechou uma parceria significativa com a Meta, mais uma vez contando com seus próprios chips projetados sob medida. A Meta concordou em implantar milhões de chips AWS Graviton para atender às

Meta fecha acordo para a aquisição de milhões de CPUs de IA da Amazon

A Amazon fechou uma parceria significativa com a Meta, mais uma vez contando com seus próprios chips projetados sob medida. A Meta concordou em implantar milhões de chips AWS Graviton para atender às

Ces outils semblent prometteurs, mais j'espère que les gros acteurs comme Meta vont vraiment s'intéresser à la sécurité dès la conception, pas seulement en réaction aux problèmes. La course à l'IA crée un terrain dangereux si la robustesse est sacrifiée pour la vitesse de déploiement. 🤔 On verra à l'usage.

A Meta está realmente investindo pesado em segurança de IA! Essas novas ferramentas do Llama parecem promissoras para desenvolvedores. Espero que essas atualizações ajudem a prevenir vazamentos de dados e viés algorítmico, problemas que têm sido frequentes. Será que outras grandes empresas, como Google e OpenAI, vão seguir o exemplo e lançar recursos semelhantes? 🤔 É uma corrida interessante para ver quem protege melhor os usuários.

Lar

Lar