Guide complet pour maîtriser la peinture à l'encre à l'aide de la diffusion stable

Stable Diffusion a transformé la génération d'images par IA en offrant un contrôle créatif sans précédent, en particulier grâce à sa puissante fonctionnalité d'inpainting. Ce didacticiel complet vous aide à tirer parti de l'interface intuitive de Forge UI pour maîtriser les fonctionnalités d'inpainting de Stable Diffusion, des techniques fondamentales aux perfectionnements de niveau professionnel, pour des résultats visuels à couper le souffle.

Points clés

Édition précise d'images localisées grâce à un masquage ciblé

Flux de travail rationalisés grâce à l'interface optimisée de Forge UI

Ajustements stratégiques des paramètres pour des intégrations sans faille

Exploration créative grâce à diverses approches d'échantillonnage

Processus d'affinage itératif pour perfectionner les résultats

Comprendre l'Inpainting par Diffusion Stable avec Forge UI

Qu'est-ce que l'inpainting par diffusion stable ?

La fonction d'inpainting de Stable Diffusion révolutionne l'édition d'images en permettant de modifier sélectivement des régions spécifiques tout en préservant la composition globale. Ce système intelligent utilise des techniques de masquage avancées où les utilisateurs définissent des zones éditables, permettant à l'IA de régénérer contextuellement un contenu qui s'intègre parfaitement aux éléments existants.

En analysant les pixels environnants et en interprétant les instructions de l'utilisateur, le modèle de diffusion reconstruit les sections masquées avec une cohérence remarquable. Cette technologie excelle dans diverses applications, notamment la suppression d'objets, les ajouts créatifs, les transformations stylistiques, la correction des imperfections et les extensions de composition.

Forge UI : Une interface conviviale pour la diffusion stable

Forge UI démystifie Stable Diffusion grâce à une interface visuelle accessible qui élimine les besoins de codage. Son espace de travail bien conçu permet de gérer sans effort les modèles, de créer des invites, d'ajuster les paramètres et de générer des images à l'aide de commandes intuitives.

La plateforme améliore les flux de travail de peinture grâce à :

- masquage visuel par dessin direct ou téléchargement

- Optimisation des paramètres à l'aide de curseurs interactifs

- Prévisualisations instantanées pour les raffinements itératifs

- Intégration transparente avec d'autres fonctionnalités de Stable Diffusion

Techniques d'inpainting avancées

Exploiter ControlNet pour un contrôle précis

ControlNet étend les capacités d'inpainting en introduisant un guidage structurel par le biais d'images de référence. Ceci est particulièrement utile pour maintenir la précision architecturale ou pour s'assurer que les nouveaux éléments s'alignent parfaitement avec les compositions existantes. Le flux de travail comprend les étapes suivantes

- L'installation de l'extension ControlNet

- Préparer des images de référence structurelles (cartes de bord, cartes de profondeur, esquisses)

- Chargement des images de contrôle dans Forge UI

- Réglage précis des paramètres d'influence

- Générer avec un guidage amélioré

Utilisation du bruit latent pour des effets créatifs

L'introduction d'un caractère aléatoire contrôlé par l'injection de bruit latent peut produire des résultats créatifs inattendus. Cette technique excelle dans la recherche de variations artistiques ou d'interprétations surréalistes dans les zones peintes. Les paramètres réglables de l'intensité du bruit permettent aux créateurs d'affiner l'équilibre entre la cohérence et l'innovation dans leurs résultats.

Guide étape par étape de l'inpainting avec Forge UI

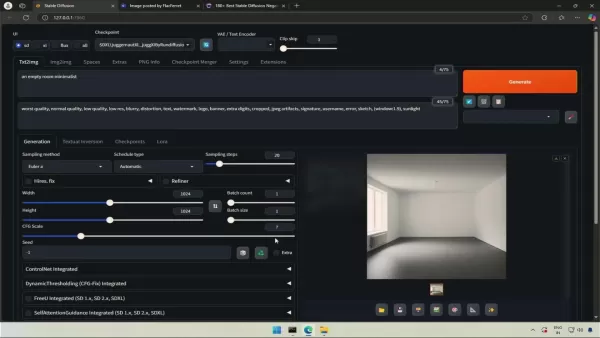

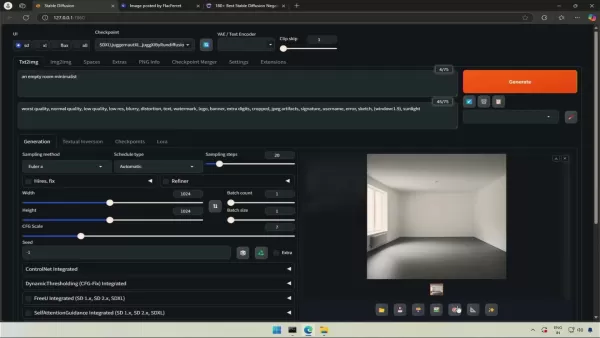

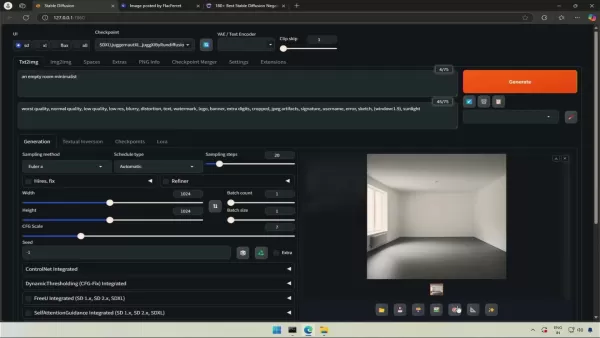

Configuration initiale et sélection du modèle

- Lancer l'application Forge UI

- Sélectionnez le modèle approprié dans la liste déroulante (recommandé : sdxl_juggernautXL_juggernautFlusio).

- Saisir des invites descriptives positives et négatives

- Générer l'image de base avec la fonction texte-image

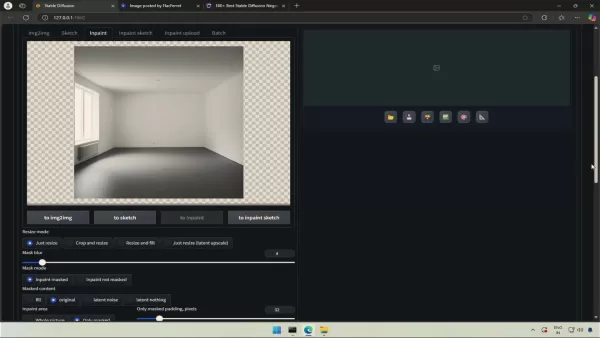

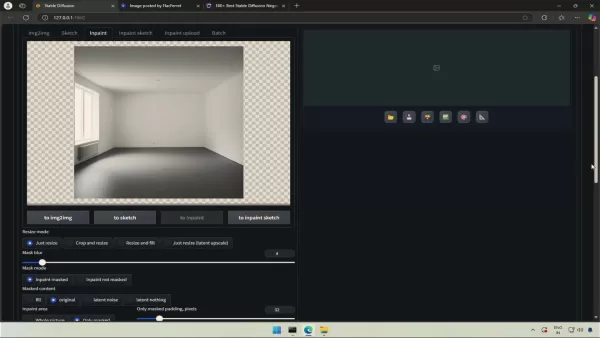

Transfert vers l'onglet Inpaint

- Générer ou importer l'image de base

- Cliquez sur l'icône de la palette rose sous l'image

- Le transfert automatique vers l'onglet Inpaint se produit

Réglage des paramètres d'incrustation

- Régler la zone d'incrustation sur "Masqué uniquement".

- Faire correspondre les méthodes et le calendrier d'échantillonnage d'origine

- Sélectionnez l'outil Pinceau et ajustez la taille pour plus de précision

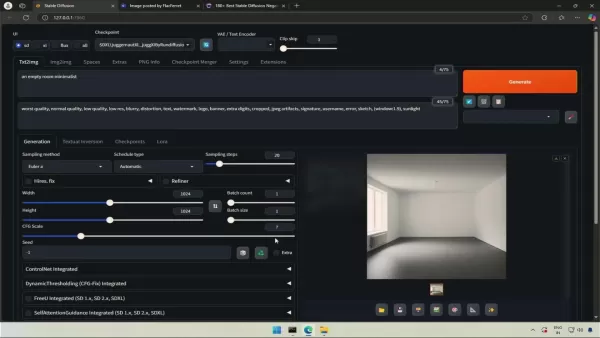

Application du masque et mise en peinture

- Peindre le masque sur la zone cible

- Saisir l'invite de génération détaillée

- Générer et évaluer les résultats

- Affiner itérativement les paramètres et le masquage

Prix de la diffusion stable

Considérations relatives au coût de l'inpainting par diffusion stable

Bien que le logiciel de base reste gratuit, une mise en œuvre efficace nécessite de prendre en compte les éléments suivants :

- Investissement en GPU (haut de gamme recommandé)

- Exigences en matière de mémoire vive (16 Go minimum, 32 Go+ de préférence)

- Stockage SSD pour des performances optimales

- Coûts potentiels de l'informatique en nuage/des services API

Avantages et inconvénients de la peinture par diffusion stable

Avantages

Flexibilité créative inégalée

Résultats transparents de qualité professionnelle

Accessibilité en source ouverte

Extensible grâce à des extensions

Contrôle localisé précis

Inconvénients

Exigences en matière de matériel

Complexité de la configuration initiale

Les résultats varient en fonction de la qualité du message

Nécessite un perfectionnement itératif

Courbe d'apprentissage abrupte

Caractéristiques essentielles pour un Inpainting réussi

Caractéristiques essentielles pour une peinture par diffusion stable

Maîtrisez ces éléments essentiels pour obtenir des résultats professionnels :

- Outils de masquage avancés (pinceau/lasso/polygone)

- Techniques d'incitation stratégique

- Réglage fin des paramètres (débruitage, échelle CFG, échantillonnage)

- Fonctionnalité de prévisualisation en temps réel

- Intégration d'extensions (ControlNet, etc.)

Cas d'utilisation inspirants pour l'inpainting

Applications créatives de la peinture par diffusion stable

Les possibilités de transformation comprennent

- Restauration de photos historiques

- Nettoyage de la composition et suppression d'objets

- Remplacement dynamique de l'arrière-plan

- Variations de la conception des personnages

- Visualisation de concepts architecturaux

- Expérimentation de la création de mode

Questions fréquemment posées

Quelle est la meilleure méthode d'échantillonnage pour l'inpainting ?

Les performances varient selon les projets - expérimentez avec Euler a, DPM++ 2M Karras et DDIM pour déterminer les approches optimales pour des cas d'utilisation spécifiques.

Comment puis-je améliorer mes résultats d'inpainting ?

- Commencez par des images sources de haute résolution

- Créez des masques précis et détaillés

- Développez des invites claires et descriptives

- Ajuster systématiquement les paramètres

- Adopter un processus d'affinage itératif

Puis-je ajouter des éléments complètement nouveaux ?

Absolument. Un masquage stratégique et des invites bien conçues permettent d'intégrer de manière transparente des éléments entièrement nouveaux dans des compositions existantes.

Questions connexes

Quelles sont les erreurs courantes à éviter ?

Les principaux écueils sont un matériel source de faible qualité, un masquage imprécis, des invites vagues, des configurations de paramètres inappropriées et un nombre insuffisant d'itérations d'affinage.

Comment la diffusion stable se compare-t-elle aux autres solutions ?

Les avantages incluent l'accessibilité à une source ouverte, des options de personnalisation étendues, un puissant écosystème d'extensions et des capacités d'IA avancées pour un réalisme et une intégration supérieurs.

Article connexe

Une étude de Microsoft révèle qu'un plus grand nombre de jetons d'IA augmente les erreurs de raisonnement

Nouvelles perspectives sur l'efficacité du raisonnement dans les LLMDe nouvelles recherches menées par Microsoft démontrent que les techniques de raisonnement avancées dans les grands modèles de langa

Une étude de Microsoft révèle qu'un plus grand nombre de jetons d'IA augmente les erreurs de raisonnement

Nouvelles perspectives sur l'efficacité du raisonnement dans les LLMDe nouvelles recherches menées par Microsoft démontrent que les techniques de raisonnement avancées dans les grands modèles de langa

"AI K-Pop Idol Fashion Trends : Se transformer en icône du style"

La révolution de la mode K-Pop : L'IA rencontre le style des idolesLes idoles de la K-Pop ne sont pas seulement des artistes musicaux : ce sont aussi des créateurs de mode dont l'influence sur le styl

"AI K-Pop Idol Fashion Trends : Se transformer en icône du style"

La révolution de la mode K-Pop : L'IA rencontre le style des idolesLes idoles de la K-Pop ne sont pas seulement des artistes musicaux : ce sont aussi des créateurs de mode dont l'influence sur le styl

Adobe Substance 3D Viewer intègre l'IA pour une modélisation 3D avancée

Adobe continue de repousser les limites de la créativité avec sa visionneuse Substance 3D révolutionnaire, qui transforme la manière dont les concepteurs interagissent avec le contenu 3D dans leur flu

commentaires (0)

0/200

Adobe Substance 3D Viewer intègre l'IA pour une modélisation 3D avancée

Adobe continue de repousser les limites de la créativité avec sa visionneuse Substance 3D révolutionnaire, qui transforme la manière dont les concepteurs interagissent avec le contenu 3D dans leur flu

commentaires (0)

0/200

Stable Diffusion a transformé la génération d'images par IA en offrant un contrôle créatif sans précédent, en particulier grâce à sa puissante fonctionnalité d'inpainting. Ce didacticiel complet vous aide à tirer parti de l'interface intuitive de Forge UI pour maîtriser les fonctionnalités d'inpainting de Stable Diffusion, des techniques fondamentales aux perfectionnements de niveau professionnel, pour des résultats visuels à couper le souffle.

Points clés

Édition précise d'images localisées grâce à un masquage ciblé

Flux de travail rationalisés grâce à l'interface optimisée de Forge UI

Ajustements stratégiques des paramètres pour des intégrations sans faille

Exploration créative grâce à diverses approches d'échantillonnage

Processus d'affinage itératif pour perfectionner les résultats

Comprendre l'Inpainting par Diffusion Stable avec Forge UI

Qu'est-ce que l'inpainting par diffusion stable ?

La fonction d'inpainting de Stable Diffusion révolutionne l'édition d'images en permettant de modifier sélectivement des régions spécifiques tout en préservant la composition globale. Ce système intelligent utilise des techniques de masquage avancées où les utilisateurs définissent des zones éditables, permettant à l'IA de régénérer contextuellement un contenu qui s'intègre parfaitement aux éléments existants.

En analysant les pixels environnants et en interprétant les instructions de l'utilisateur, le modèle de diffusion reconstruit les sections masquées avec une cohérence remarquable. Cette technologie excelle dans diverses applications, notamment la suppression d'objets, les ajouts créatifs, les transformations stylistiques, la correction des imperfections et les extensions de composition.

Forge UI : Une interface conviviale pour la diffusion stable

Forge UI démystifie Stable Diffusion grâce à une interface visuelle accessible qui élimine les besoins de codage. Son espace de travail bien conçu permet de gérer sans effort les modèles, de créer des invites, d'ajuster les paramètres et de générer des images à l'aide de commandes intuitives.

La plateforme améliore les flux de travail de peinture grâce à :

- masquage visuel par dessin direct ou téléchargement

- Optimisation des paramètres à l'aide de curseurs interactifs

- Prévisualisations instantanées pour les raffinements itératifs

- Intégration transparente avec d'autres fonctionnalités de Stable Diffusion

Techniques d'inpainting avancées

Exploiter ControlNet pour un contrôle précis

ControlNet étend les capacités d'inpainting en introduisant un guidage structurel par le biais d'images de référence. Ceci est particulièrement utile pour maintenir la précision architecturale ou pour s'assurer que les nouveaux éléments s'alignent parfaitement avec les compositions existantes. Le flux de travail comprend les étapes suivantes

- L'installation de l'extension ControlNet

- Préparer des images de référence structurelles (cartes de bord, cartes de profondeur, esquisses)

- Chargement des images de contrôle dans Forge UI

- Réglage précis des paramètres d'influence

- Générer avec un guidage amélioré

Utilisation du bruit latent pour des effets créatifs

L'introduction d'un caractère aléatoire contrôlé par l'injection de bruit latent peut produire des résultats créatifs inattendus. Cette technique excelle dans la recherche de variations artistiques ou d'interprétations surréalistes dans les zones peintes. Les paramètres réglables de l'intensité du bruit permettent aux créateurs d'affiner l'équilibre entre la cohérence et l'innovation dans leurs résultats.

Guide étape par étape de l'inpainting avec Forge UI

Configuration initiale et sélection du modèle

- Lancer l'application Forge UI

- Sélectionnez le modèle approprié dans la liste déroulante (recommandé : sdxl_juggernautXL_juggernautFlusio).

- Saisir des invites descriptives positives et négatives

- Générer l'image de base avec la fonction texte-image

Transfert vers l'onglet Inpaint

- Générer ou importer l'image de base

- Cliquez sur l'icône de la palette rose sous l'image

- Le transfert automatique vers l'onglet Inpaint se produit

Réglage des paramètres d'incrustation

- Régler la zone d'incrustation sur "Masqué uniquement".

- Faire correspondre les méthodes et le calendrier d'échantillonnage d'origine

- Sélectionnez l'outil Pinceau et ajustez la taille pour plus de précision

Application du masque et mise en peinture

- Peindre le masque sur la zone cible

- Saisir l'invite de génération détaillée

- Générer et évaluer les résultats

- Affiner itérativement les paramètres et le masquage

Prix de la diffusion stable

Considérations relatives au coût de l'inpainting par diffusion stable

Bien que le logiciel de base reste gratuit, une mise en œuvre efficace nécessite de prendre en compte les éléments suivants :

- Investissement en GPU (haut de gamme recommandé)

- Exigences en matière de mémoire vive (16 Go minimum, 32 Go+ de préférence)

- Stockage SSD pour des performances optimales

- Coûts potentiels de l'informatique en nuage/des services API

Avantages et inconvénients de la peinture par diffusion stable

Avantages

Flexibilité créative inégalée

Résultats transparents de qualité professionnelle

Accessibilité en source ouverte

Extensible grâce à des extensions

Contrôle localisé précis

Inconvénients

Exigences en matière de matériel

Complexité de la configuration initiale

Les résultats varient en fonction de la qualité du message

Nécessite un perfectionnement itératif

Courbe d'apprentissage abrupte

Caractéristiques essentielles pour un Inpainting réussi

Caractéristiques essentielles pour une peinture par diffusion stable

Maîtrisez ces éléments essentiels pour obtenir des résultats professionnels :

- Outils de masquage avancés (pinceau/lasso/polygone)

- Techniques d'incitation stratégique

- Réglage fin des paramètres (débruitage, échelle CFG, échantillonnage)

- Fonctionnalité de prévisualisation en temps réel

- Intégration d'extensions (ControlNet, etc.)

Cas d'utilisation inspirants pour l'inpainting

Applications créatives de la peinture par diffusion stable

Les possibilités de transformation comprennent

- Restauration de photos historiques

- Nettoyage de la composition et suppression d'objets

- Remplacement dynamique de l'arrière-plan

- Variations de la conception des personnages

- Visualisation de concepts architecturaux

- Expérimentation de la création de mode

Questions fréquemment posées

Quelle est la meilleure méthode d'échantillonnage pour l'inpainting ?

Les performances varient selon les projets - expérimentez avec Euler a, DPM++ 2M Karras et DDIM pour déterminer les approches optimales pour des cas d'utilisation spécifiques.

Comment puis-je améliorer mes résultats d'inpainting ?

- Commencez par des images sources de haute résolution

- Créez des masques précis et détaillés

- Développez des invites claires et descriptives

- Ajuster systématiquement les paramètres

- Adopter un processus d'affinage itératif

Puis-je ajouter des éléments complètement nouveaux ?

Absolument. Un masquage stratégique et des invites bien conçues permettent d'intégrer de manière transparente des éléments entièrement nouveaux dans des compositions existantes.

Questions connexes

Quelles sont les erreurs courantes à éviter ?

Les principaux écueils sont un matériel source de faible qualité, un masquage imprécis, des invites vagues, des configurations de paramètres inappropriées et un nombre insuffisant d'itérations d'affinage.

Comment la diffusion stable se compare-t-elle aux autres solutions ?

Les avantages incluent l'accessibilité à une source ouverte, des options de personnalisation étendues, un puissant écosystème d'extensions et des capacités d'IA avancées pour un réalisme et une intégration supérieurs.

Une étude de Microsoft révèle qu'un plus grand nombre de jetons d'IA augmente les erreurs de raisonnement

Nouvelles perspectives sur l'efficacité du raisonnement dans les LLMDe nouvelles recherches menées par Microsoft démontrent que les techniques de raisonnement avancées dans les grands modèles de langa

Une étude de Microsoft révèle qu'un plus grand nombre de jetons d'IA augmente les erreurs de raisonnement

Nouvelles perspectives sur l'efficacité du raisonnement dans les LLMDe nouvelles recherches menées par Microsoft démontrent que les techniques de raisonnement avancées dans les grands modèles de langa

"AI K-Pop Idol Fashion Trends : Se transformer en icône du style"

La révolution de la mode K-Pop : L'IA rencontre le style des idolesLes idoles de la K-Pop ne sont pas seulement des artistes musicaux : ce sont aussi des créateurs de mode dont l'influence sur le styl

"AI K-Pop Idol Fashion Trends : Se transformer en icône du style"

La révolution de la mode K-Pop : L'IA rencontre le style des idolesLes idoles de la K-Pop ne sont pas seulement des artistes musicaux : ce sont aussi des créateurs de mode dont l'influence sur le styl

Adobe Substance 3D Viewer intègre l'IA pour une modélisation 3D avancée

Adobe continue de repousser les limites de la créativité avec sa visionneuse Substance 3D révolutionnaire, qui transforme la manière dont les concepteurs interagissent avec le contenu 3D dans leur flu

Adobe Substance 3D Viewer intègre l'IA pour une modélisation 3D avancée

Adobe continue de repousser les limites de la créativité avec sa visionneuse Substance 3D révolutionnaire, qui transforme la manière dont les concepteurs interagissent avec le contenu 3D dans leur flu