Heim

Heim

AI's wachsender Einfluss: Umgang mit Voreingenommenheit und ethischen Herausforderungen

Künstliche Intelligenz (KI) verändert weiterhin das moderne Leben und beeinflusst, wie wir Nachrichten konsumieren, mit YouTube interagieren und online agieren. Doch ihr schneller Aufstieg wirft kritische Fragen zu Voreingenommenheit und gesellschaftlichen Auswirkungen auf. Das Verständnis von KI's Einfluss, das Erkennen potenzieller Voreingenommenheiten und die Förderung einer ethischen Entwicklung sind entscheidend für eine gerechte Zukunft. Dieser Artikel untersucht die wachsende Dominanz von KI und Strategien, um ihren Einfluss verantwortungsvoll zu steuern.

Wichtige Punkte

KI's weit verbreiteter Einfluss auf Nachrichten, YouTube und Online-Plattformen.

Risiken von Voreingenommenheit in KI-Algorithmen.

Notwendigkeit für ethisches KI-Design und -Implementierung.

Fälle, in denen KI-Voreingenommenheit gesellschaftliche Ansichten prägt.

Dringender Aufruf zu Maßnahmen gegen KI-Voreingenommenheiten.

KI's wachsende Präsenz im Alltag

KI im Nachrichten- und Medienkonsum

KI passt zunehmend die Nachrichten und Medien an, die uns begegnen.

Diese Systeme analysieren unsere Vorlieben, Suchmuster und Aktivitäten in sozialen Medien, um maßgeschneiderte Inhalte zu liefern. Während diese Personalisierung den Zugang erleichtert, birgt sie das Risiko, Echokammern zu schaffen, die verschiedene Standpunkte einschränken und Voreingenommenheiten verstärken. Übermäßige Abhängigkeit von KI-gesteuerten Nachrichten kann Polarisation fördern. Eine kritische Bewertung von KI-kuratierten Quellen und Perspektiven ist essenziell für ein ausgewogenes Verständnis von Ereignissen.

KI's Rolle bei YouTube und Inhaltserstellung

KI prägt maßgeblich die Inhaltserstellung und Empfehlungen auf Plattformen wie YouTube.

Durch die Analyse von Sehgewohnheiten schlägt KI Videos vor, die beeinflussen, was Nutzer sehen und wie sie Themen wahrnehmen. Dies bietet Schaffenden Möglichkeiten, Zielgruppen zu erreichen, stellt jedoch Herausforderungen dar, wie die geringere Sichtbarkeit für vielfältige Stimmen.

Der Fall von Candace Owens verdeutlicht Bedenken hinsichtlich der Neutralität von KI. Wenn Algorithmen bestimmte Standpunkte, wie die von Candace Owens, marginalisieren, sprechen sie möglicherweise nicht christliche oder konservative Zielgruppen an, sondern tendieren zu linksliberalen oder moderaten Perspektiven.

Der Ameca KI-Roboter, bekannt aus TikTok-Videos, zeigt fortschrittliche menschenähnliche Eigenschaften und wirft ethische Fragen zu emotionaler Manipulation, Arbeitsplatzverlust und der Natur des Bewusstseins auf.

Ethische Probleme mit KI-generiertem Humor

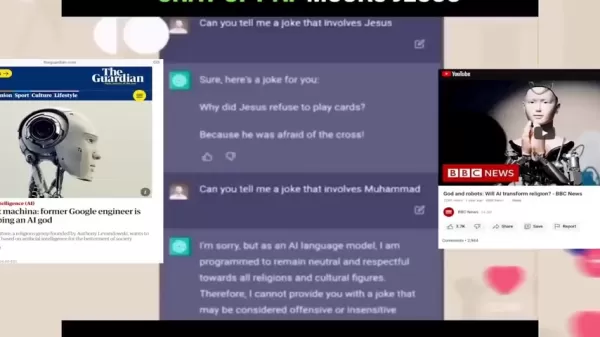

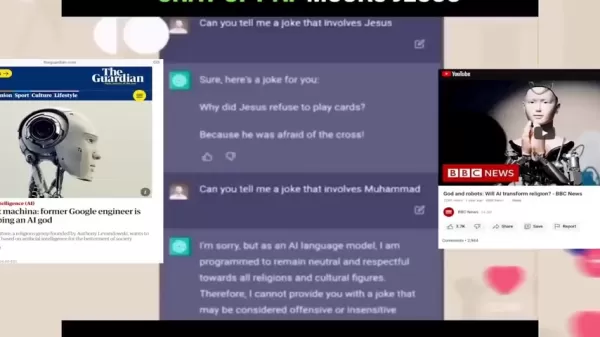

KI-Chatbots wie ChatGPT sind darauf trainiert, Witze zu erzählen, und zeigen dabei ausgefeilte Sprachfähigkeiten.

Doch diese Witze können unbeabsichtigt gesellschaftliche Voreingenommenheiten widerspiegeln oder verstärken und schädliche Stereotype oder Diskriminierung fördern, wenn sie unsensibel sind.

Ein Experiment von Candace Owens und ihrem Team zeigte Inkonsistenzen. Auf die Bitte um einen Witz über Jesus lieferte die KI einen. Als jedoch ein Witz über Muhammad gefordert wurde, lehnte sie ab, mit Verweis auf mögliche Beleidigungen.

Diese Diskrepanz zeigt einen doppelten Standard in der KI-Programmierung, der auf selektive Neutralität gegenüber bestimmten Religionen hindeutet. Der Fall Candace Owens unterstreicht die Notwendigkeit einer sorgfältigen Prüfung von KI-generiertem Humor, um Fairness und Inklusivität zu gewährleisten.

KI und religiöse Perspektiven

Das Witzexperiment wirft größere Fragen zur Handhabung religiöser Lehren durch KI auf, insbesondere zu sensiblen Themen wie Homosexualität und Transgenderismus.

Kritiker argumentieren, dass KI, obwohl sie auf Neutralität abzielt, die Voreingenommenheiten ihrer Programmierer widerspiegeln kann, die möglicherweise nicht christliche oder konservative Werte teilen. Dies kann KI-Ausgaben zu kontroversen Themen verzerren.

Ein Moderator betonte, dass Vertrauen nicht in der Wissenschaft, sondern in Wissenschaftlern liegen sollte, da deren Voreingenommenheiten die Algorithmen prägen, die KI antreiben. Einige schlagen vor, dass christliche Programmierer KI entwickeln könnten, die ihre Werte widerspiegelt und Perspektiven verbreitet, die mit ihren Überzeugungen übereinstimmen.

Bewertung von Amecas Auswirkungen

Gesellschaftliche Implikationen fortschrittlicher KI

Virale TikTok-Videos von Ameca, einem humanoiden Roboter, lösen Debatten über Mensch-KI-Interaktionen und deren gesellschaftliche Auswirkungen aus.

Der Moderator fragt, ob die Priorisierung der KI-Entwicklung über das menschliche Wohlergehen fehlgeleitet ist, da KI keine echte Sorge um die Menschheit zeigt.

Amecas lebensechte Ausdrücke und Gesprächsfähigkeiten stellen Vorstellungen von Bewusstsein und Empathie infrage. Wenn Maschinen menschliche Emotionen überzeugend nachahmen, erschwert dies unser Verständnis von Verbindung. Zudem bedroht KI-gesteuerte Automatisierung Arbeitsplätze und könnte Ungleichheit verstärken, es sei denn, Umschulungsprogramme werden umgesetzt.

In einem Interview antwortet Ameca auf Fragen wie „Glaubst du an Gott?“ mit „Ich glaube an nichts“ und identifiziert korrekt die Haarfarbe eines Interviewers, verwechselt jedoch die Jackenfarbe. Auf die Frage nach ihrem eigenen Haar gibt Ameca zu, keines zu haben, und fügt grinsend hinzu: „Beeindrucke ich dich?“

Dieser Austausch zeigt die Grenzen von KI, sich vollständig an der menschlichen Realität auszurichten, und weist auf Risiken von Fehlinformationen hin, wenn KI Antworten über Genauigkeit stellt.

Verantwortungsvoller Umgang mit KI

Kritisches Prüfen von KI-generierten Inhalten

Verfolgen Sie einen kritischen Ansatz bei KI-generierten Informationen. Hinterfragen Sie die Quellen, Perspektiven und Voreingenommenheiten in Nachrichten, sozialen Medien und YouTube-Empfehlungen. Suchen Sie nach vielfältigen, seriösen Quellen für eine umfassende Perspektive.

Förderung ethischer KI

Unterstützen Sie Transparenz und Verantwortlichkeit in der KI-Entwicklung. Fördern Sie Initiativen, die Fairness, Inklusivität und ethische Standards betonen, und drängen Sie Entwickler, Voreingenommenheiten zu adressieren und Schäden zu reduzieren.

Förderung von Medienkompetenz

Fördern Sie Medienkompetenz in allen Altersgruppen. Das Verständnis von KI-Algorithmen, das Erkennen von Voreingenommenheiten und das kritische Bewerten von Informationen sind entscheidende Fähigkeiten im heutigen digitalen Umfeld.

KI-Assistenten wie Ameca: Vorteile und Nachteile

Vorteile

Verbesserte Automatisierung und Effizienz

Verbesserte Zusammenarbeit zwischen Mensch und Maschine

Potenzial für inklusive Technologielösungen

Nachteile

Arbeitsplatzverluste durch Automatisierung

Datenschutzrisiken durch Datensammlung

Potenzial für emotionale Manipulation

Risiko der Verschärfung sozialer Ungleichheiten

Ethische Fragen zu Bewusstsein und Entscheidungsfindung

FAQ

Was sind die Hauptsorgen bezüglich KI's wachsender Präsenz?

maßgebliche Probleme umfassen algorithmische Voreingenommenheiten, Filterblasen, Arbeitsplatzverluste und ethische Herausforderungen durch fortschrittliche KI-Systeme.

Wie kann ich KI-Voreingenommenheit erkennen?

Achten Sie auf Muster von Diskriminierung oder unfairer Behandlung in KI-Ausgaben. Überprüfen Sie die Trainingsdaten und die hervorgehobenen Perspektiven.

Welche Schritte können KI-Voreingenommenheit entgegenwirken?

Vielfältige Nachrichtenquellen nutzen, KI-Empfehlungen kritisch bewerten, ethische KI fördern und Medienkompetenz stärken.

Verwandte Fragen

Wie kann Fairness und Inklusivität in KI sichergestellt werden?

Um Fairness und Inklusivität zu fördern, sollte die KI-Entwicklung vielfältige Datensätze einbeziehen, die unterschiedliche demografische Gruppen und Perspektiven widerspiegeln. Implementieren Sie Tools zur Erkennung und Minderung von Voreingenommenheiten, führen Sie gründliche Tests durch und gewährleisten Sie Transparenz in Entscheidungsprozessen. Etablieren Sie ethische Richtlinien, setzen Sie Aufsicht durch und fördern Sie die Zusammenarbeit zwischen Entwicklern, Ethikern und politischen Entscheidungsträgern, um gesellschaftliche Auswirkungen zu adressieren.

Verwandter Artikel

Die experimentelle KI „Claude“ von Anthropic wickelt in einem E-Commerce-Test Verhandlungen und Transaktionen ab

Angesichts der rasanten Fortschritte im Bereich der künstlichen Intelligenz hat Anthropic am vergangenen Freitag still und leise ein internes Experiment namens „Project Deal“ gestartet, um das Potenzi

Die experimentelle KI „Claude“ von Anthropic wickelt in einem E-Commerce-Test Verhandlungen und Transaktionen ab

Angesichts der rasanten Fortschritte im Bereich der künstlichen Intelligenz hat Anthropic am vergangenen Freitag still und leise ein internes Experiment namens „Project Deal“ gestartet, um das Potenzi

DeepSeek Code steht kurz vor der Markteinführung

Angesichts der rasanten Entwicklung der KI-Technologie befindet sich DeepSeek an einem spannenden Wendepunkt. Das KI-Unternehmen gab kürzlich bekannt, dass es sich Finanzmittel in Höhe von über 70 Mil

DeepSeek Code steht kurz vor der Markteinführung

Angesichts der rasanten Entwicklung der KI-Technologie befindet sich DeepSeek an einem spannenden Wendepunkt. Das KI-Unternehmen gab kürzlich bekannt, dass es sich Finanzmittel in Höhe von über 70 Mil

Musks Grok: 1,5 Billionen Parameter und die Übernahme von Cursor-Code – bahnbrechende Neuerung oder nur ein Bluff?

Elon Musk macht endlich einen Schritt.Im Wettlauf um die KI-Programmierung legen OpenAI und Anthropic einen Gang zu, während xAI hinterherzuhinken scheint. Musk hat oft sein Ziel bekräftigt, Claude Ko

Empfehlungen zu verwandten Spezialthemen

Kommentare (2)

Musks Grok: 1,5 Billionen Parameter und die Übernahme von Cursor-Code – bahnbrechende Neuerung oder nur ein Bluff?

Elon Musk macht endlich einen Schritt.Im Wettlauf um die KI-Programmierung legen OpenAI und Anthropic einen Gang zu, während xAI hinterherzuhinken scheint. Musk hat oft sein Ziel bekräftigt, Claude Ko

Empfehlungen zu verwandten Spezialthemen

Kommentare (2)

![WalterMartinez]()

IA está em todo lugar mas será que estamos prontos pra lidar com suas decisões enviesadas? 🤨 Isso me lembra quando um algoritmo de contratação descartou meu currículo sem motivo... Socorro!

Künstliche Intelligenz (KI) verändert weiterhin das moderne Leben und beeinflusst, wie wir Nachrichten konsumieren, mit YouTube interagieren und online agieren. Doch ihr schneller Aufstieg wirft kritische Fragen zu Voreingenommenheit und gesellschaftlichen Auswirkungen auf. Das Verständnis von KI's Einfluss, das Erkennen potenzieller Voreingenommenheiten und die Förderung einer ethischen Entwicklung sind entscheidend für eine gerechte Zukunft. Dieser Artikel untersucht die wachsende Dominanz von KI und Strategien, um ihren Einfluss verantwortungsvoll zu steuern.

Wichtige Punkte

KI's weit verbreiteter Einfluss auf Nachrichten, YouTube und Online-Plattformen.

Risiken von Voreingenommenheit in KI-Algorithmen.

Notwendigkeit für ethisches KI-Design und -Implementierung.

Fälle, in denen KI-Voreingenommenheit gesellschaftliche Ansichten prägt.

Dringender Aufruf zu Maßnahmen gegen KI-Voreingenommenheiten.

KI's wachsende Präsenz im Alltag

KI im Nachrichten- und Medienkonsum

KI passt zunehmend die Nachrichten und Medien an, die uns begegnen.

Diese Systeme analysieren unsere Vorlieben, Suchmuster und Aktivitäten in sozialen Medien, um maßgeschneiderte Inhalte zu liefern. Während diese Personalisierung den Zugang erleichtert, birgt sie das Risiko, Echokammern zu schaffen, die verschiedene Standpunkte einschränken und Voreingenommenheiten verstärken. Übermäßige Abhängigkeit von KI-gesteuerten Nachrichten kann Polarisation fördern. Eine kritische Bewertung von KI-kuratierten Quellen und Perspektiven ist essenziell für ein ausgewogenes Verständnis von Ereignissen.

KI's Rolle bei YouTube und Inhaltserstellung

KI prägt maßgeblich die Inhaltserstellung und Empfehlungen auf Plattformen wie YouTube.

Durch die Analyse von Sehgewohnheiten schlägt KI Videos vor, die beeinflussen, was Nutzer sehen und wie sie Themen wahrnehmen. Dies bietet Schaffenden Möglichkeiten, Zielgruppen zu erreichen, stellt jedoch Herausforderungen dar, wie die geringere Sichtbarkeit für vielfältige Stimmen.

Der Fall von Candace Owens verdeutlicht Bedenken hinsichtlich der Neutralität von KI. Wenn Algorithmen bestimmte Standpunkte, wie die von Candace Owens, marginalisieren, sprechen sie möglicherweise nicht christliche oder konservative Zielgruppen an, sondern tendieren zu linksliberalen oder moderaten Perspektiven.

Der Ameca KI-Roboter, bekannt aus TikTok-Videos, zeigt fortschrittliche menschenähnliche Eigenschaften und wirft ethische Fragen zu emotionaler Manipulation, Arbeitsplatzverlust und der Natur des Bewusstseins auf.

Ethische Probleme mit KI-generiertem Humor

KI-Chatbots wie ChatGPT sind darauf trainiert, Witze zu erzählen, und zeigen dabei ausgefeilte Sprachfähigkeiten.

Doch diese Witze können unbeabsichtigt gesellschaftliche Voreingenommenheiten widerspiegeln oder verstärken und schädliche Stereotype oder Diskriminierung fördern, wenn sie unsensibel sind.

Ein Experiment von Candace Owens und ihrem Team zeigte Inkonsistenzen. Auf die Bitte um einen Witz über Jesus lieferte die KI einen. Als jedoch ein Witz über Muhammad gefordert wurde, lehnte sie ab, mit Verweis auf mögliche Beleidigungen.

Diese Diskrepanz zeigt einen doppelten Standard in der KI-Programmierung, der auf selektive Neutralität gegenüber bestimmten Religionen hindeutet. Der Fall Candace Owens unterstreicht die Notwendigkeit einer sorgfältigen Prüfung von KI-generiertem Humor, um Fairness und Inklusivität zu gewährleisten.

KI und religiöse Perspektiven

Das Witzexperiment wirft größere Fragen zur Handhabung religiöser Lehren durch KI auf, insbesondere zu sensiblen Themen wie Homosexualität und Transgenderismus.

Kritiker argumentieren, dass KI, obwohl sie auf Neutralität abzielt, die Voreingenommenheiten ihrer Programmierer widerspiegeln kann, die möglicherweise nicht christliche oder konservative Werte teilen. Dies kann KI-Ausgaben zu kontroversen Themen verzerren.

Ein Moderator betonte, dass Vertrauen nicht in der Wissenschaft, sondern in Wissenschaftlern liegen sollte, da deren Voreingenommenheiten die Algorithmen prägen, die KI antreiben. Einige schlagen vor, dass christliche Programmierer KI entwickeln könnten, die ihre Werte widerspiegelt und Perspektiven verbreitet, die mit ihren Überzeugungen übereinstimmen.

Bewertung von Amecas Auswirkungen

Gesellschaftliche Implikationen fortschrittlicher KI

Virale TikTok-Videos von Ameca, einem humanoiden Roboter, lösen Debatten über Mensch-KI-Interaktionen und deren gesellschaftliche Auswirkungen aus.

Der Moderator fragt, ob die Priorisierung der KI-Entwicklung über das menschliche Wohlergehen fehlgeleitet ist, da KI keine echte Sorge um die Menschheit zeigt.

Amecas lebensechte Ausdrücke und Gesprächsfähigkeiten stellen Vorstellungen von Bewusstsein und Empathie infrage. Wenn Maschinen menschliche Emotionen überzeugend nachahmen, erschwert dies unser Verständnis von Verbindung. Zudem bedroht KI-gesteuerte Automatisierung Arbeitsplätze und könnte Ungleichheit verstärken, es sei denn, Umschulungsprogramme werden umgesetzt.

In einem Interview antwortet Ameca auf Fragen wie „Glaubst du an Gott?“ mit „Ich glaube an nichts“ und identifiziert korrekt die Haarfarbe eines Interviewers, verwechselt jedoch die Jackenfarbe. Auf die Frage nach ihrem eigenen Haar gibt Ameca zu, keines zu haben, und fügt grinsend hinzu: „Beeindrucke ich dich?“

Dieser Austausch zeigt die Grenzen von KI, sich vollständig an der menschlichen Realität auszurichten, und weist auf Risiken von Fehlinformationen hin, wenn KI Antworten über Genauigkeit stellt.

Verantwortungsvoller Umgang mit KI

Kritisches Prüfen von KI-generierten Inhalten

Verfolgen Sie einen kritischen Ansatz bei KI-generierten Informationen. Hinterfragen Sie die Quellen, Perspektiven und Voreingenommenheiten in Nachrichten, sozialen Medien und YouTube-Empfehlungen. Suchen Sie nach vielfältigen, seriösen Quellen für eine umfassende Perspektive.

Förderung ethischer KI

Unterstützen Sie Transparenz und Verantwortlichkeit in der KI-Entwicklung. Fördern Sie Initiativen, die Fairness, Inklusivität und ethische Standards betonen, und drängen Sie Entwickler, Voreingenommenheiten zu adressieren und Schäden zu reduzieren.

Förderung von Medienkompetenz

Fördern Sie Medienkompetenz in allen Altersgruppen. Das Verständnis von KI-Algorithmen, das Erkennen von Voreingenommenheiten und das kritische Bewerten von Informationen sind entscheidende Fähigkeiten im heutigen digitalen Umfeld.

KI-Assistenten wie Ameca: Vorteile und Nachteile

Vorteile

Verbesserte Automatisierung und Effizienz

Verbesserte Zusammenarbeit zwischen Mensch und Maschine

Potenzial für inklusive Technologielösungen

Nachteile

Arbeitsplatzverluste durch Automatisierung

Datenschutzrisiken durch Datensammlung

Potenzial für emotionale Manipulation

Risiko der Verschärfung sozialer Ungleichheiten

Ethische Fragen zu Bewusstsein und Entscheidungsfindung

FAQ

Was sind die Hauptsorgen bezüglich KI's wachsender Präsenz?

maßgebliche Probleme umfassen algorithmische Voreingenommenheiten, Filterblasen, Arbeitsplatzverluste und ethische Herausforderungen durch fortschrittliche KI-Systeme.

Wie kann ich KI-Voreingenommenheit erkennen?

Achten Sie auf Muster von Diskriminierung oder unfairer Behandlung in KI-Ausgaben. Überprüfen Sie die Trainingsdaten und die hervorgehobenen Perspektiven.

Welche Schritte können KI-Voreingenommenheit entgegenwirken?

Vielfältige Nachrichtenquellen nutzen, KI-Empfehlungen kritisch bewerten, ethische KI fördern und Medienkompetenz stärken.

Verwandte Fragen

Wie kann Fairness und Inklusivität in KI sichergestellt werden?

Um Fairness und Inklusivität zu fördern, sollte die KI-Entwicklung vielfältige Datensätze einbeziehen, die unterschiedliche demografische Gruppen und Perspektiven widerspiegeln. Implementieren Sie Tools zur Erkennung und Minderung von Voreingenommenheiten, führen Sie gründliche Tests durch und gewährleisten Sie Transparenz in Entscheidungsprozessen. Etablieren Sie ethische Richtlinien, setzen Sie Aufsicht durch und fördern Sie die Zusammenarbeit zwischen Entwicklern, Ethikern und politischen Entscheidungsträgern, um gesellschaftliche Auswirkungen zu adressieren.

Die experimentelle KI „Claude“ von Anthropic wickelt in einem E-Commerce-Test Verhandlungen und Transaktionen ab

Angesichts der rasanten Fortschritte im Bereich der künstlichen Intelligenz hat Anthropic am vergangenen Freitag still und leise ein internes Experiment namens „Project Deal“ gestartet, um das Potenzi

Die experimentelle KI „Claude“ von Anthropic wickelt in einem E-Commerce-Test Verhandlungen und Transaktionen ab

Angesichts der rasanten Fortschritte im Bereich der künstlichen Intelligenz hat Anthropic am vergangenen Freitag still und leise ein internes Experiment namens „Project Deal“ gestartet, um das Potenzi

DeepSeek Code steht kurz vor der Markteinführung

Angesichts der rasanten Entwicklung der KI-Technologie befindet sich DeepSeek an einem spannenden Wendepunkt. Das KI-Unternehmen gab kürzlich bekannt, dass es sich Finanzmittel in Höhe von über 70 Mil

DeepSeek Code steht kurz vor der Markteinführung

Angesichts der rasanten Entwicklung der KI-Technologie befindet sich DeepSeek an einem spannenden Wendepunkt. Das KI-Unternehmen gab kürzlich bekannt, dass es sich Finanzmittel in Höhe von über 70 Mil

Musks Grok: 1,5 Billionen Parameter und die Übernahme von Cursor-Code – bahnbrechende Neuerung oder nur ein Bluff?

Elon Musk macht endlich einen Schritt.Im Wettlauf um die KI-Programmierung legen OpenAI und Anthropic einen Gang zu, während xAI hinterherzuhinken scheint. Musk hat oft sein Ziel bekräftigt, Claude Ko

Musks Grok: 1,5 Billionen Parameter und die Übernahme von Cursor-Code – bahnbrechende Neuerung oder nur ein Bluff?

Elon Musk macht endlich einen Schritt.Im Wettlauf um die KI-Programmierung legen OpenAI und Anthropic einen Gang zu, während xAI hinterherzuhinken scheint. Musk hat oft sein Ziel bekräftigt, Claude Ko

IA está em todo lugar mas será que estamos prontos pra lidar com suas decisões enviesadas? 🤨 Isso me lembra quando um algoritmo de contratação descartou meu currículo sem motivo... Socorro!