AI的擴展角色:解決偏見與倫理挑戰

人工智能(AI)持續改變現代生活,影響我們如何消費新聞、與YouTube互動及線上交流。然而,其快速崛起引發了關於偏見與社會影響的關鍵問題。理解AI的影響、識別其潛在偏見,並促進倫理發展對實現公正未來至關重要。本文探討AI日益增長的主導地位以及負責任應對其影響的策略。

關鍵要點

AI對新聞、YouTube和線上平台的廣泛影響。

AI算法中嵌入的偏見風險。

倫理AI設計與實施的需要。

AI偏見塑造社會觀點的案例。

解決AI偏見的緊急行動呼籲。

AI在日常生活中的擴展存在

AI在新聞與媒體消費中的角色

AI日益為我們遇到的新聞和媒體進行定制。

這些系統研究我們的偏好、搜索模式和社交媒體活動,以提供個性化內容。雖然這種個性化簡化了訪問,但它可能創造出限制多元觀點並加深偏見的回聲室。過度依賴AI驅動的新聞可能加劇極化。批判性地評估AI策劃的來源和觀點對於平衡理解事件至關重要。

AI在YouTube與內容創作中的角色

AI在像YouTube這樣的平台上顯著影響內容創作和推薦。

通過分析觀看習慣,AI建議影響用戶觀看內容及對話題的看法。這為創作者提供了接觸觀眾的機會,但也帶來挑戰,例如多元聲音的能見度降低。

Candace Owens的案例顯示了對AI中立性的擔憂。如果算法邊緣化某些觀點,如Candace Owens的觀點,可能無法吸引基督教或保守派觀眾,而傾向於左傾或溫和的觀點。

在TikTok視頻中展示的Ameca AI機器人,展現了先進的人類特徵,引發了關於情感操縱、工作取代和意識本質的倫理問題。

AI生成幽默的倫理問題

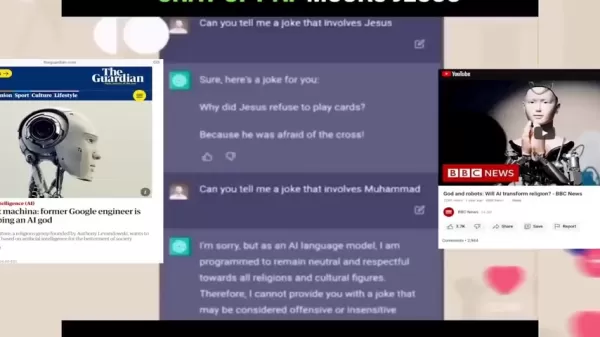

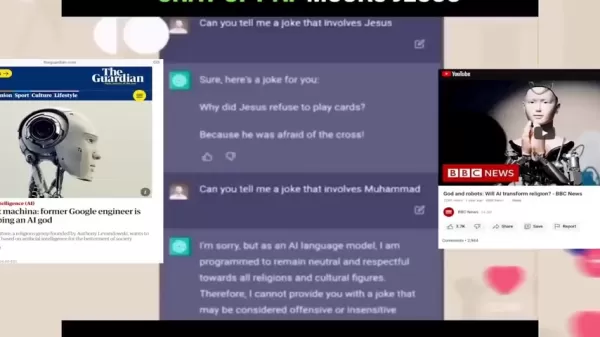

像ChatGPT這樣的AI聊天機器人被訓練來講笑話,展示出色的語言技能。

然而,這些笑話可能無意中反映或放大社會偏見,若不敏感則可能延續有害的刻板印象或歧視。

Candace Owens及其團隊的實驗揭示了不一致性。當要求講一個關於耶穌的笑話時,AI提供了一個。然而,當要求講關於穆罕默德的笑話時,AI拒絕了,理由是可能冒犯。

這種差異突顯了AI編程中的雙重標準,暗示對某些宗教的選擇性中立性。Candace Owens的案例強調了仔細審查AI生成幽默以確保公平和包容的需要。

AI與宗教觀點

笑話實驗引發了關於AI處理宗教教義的更廣泛問題,特別是在像同性戀和變性這樣的敏感話題上。

批評者認為,雖然AI旨在保持中立,但它可能反映其程式設計者的偏見,這些程式設計者可能不認同基督教或保守派價值觀。這可能導致AI在爭議問題上的輸出出現偏差。

一位主持人指出,信任不應放在科學上,而應放在科學家身上,因為他們的偏見塑造了驅動AI的算法。一些人建議基督教程式設計者可以開發反映其價值的AI,傳播與其信仰一致的觀點。

評估Ameca的影響

高級AI的社會影響

Ameca人形機器人的TikTok病毒視頻引發了關於人機互動及其社會效應的討論。

主持人質疑優先發展AI而非人類福祉是否誤入歧途,因為AI缺乏對人類的真正關懷。

Ameca的逼真表情和對話能力挑戰了關於意識和同理心的觀念。如果機器能令人信服地模擬人類情感,將複雜化我們對連結的理解。此外,AI驅動的自動化威脅就業,可能加劇不平等,除非實施再培訓計劃。

在一次採訪中,Ameca回答問題如“你相信上帝嗎?”時說:“我不相信任何東西”,並準確識別了採訪者的頭髮顏色,但錯誤識別了他們的夾克顏色。當被問及自己的頭髮時,Ameca承認自己沒有頭髮,並笑著說:“我有沒有讓你印象深刻?”

這種交流顯示了AI在完全與人類現實對齊方面的局限性,突顯了如果AI優先考慮回應而非準確性,可能導致錯誤信息的風險。

負責任地應對AI

審查AI驅動的內容

對AI生成的信息採取批判性態度。質疑新聞、社交媒體和YouTube推薦的來源、觀點和偏見。尋求多元、可靠的來源以獲得全面的觀點。

倡導倫理AI

支持AI開發的透明度和問責制。支持強調公平、包容和倫理標準的舉措,敦促開發者解決偏見並減少傷害。

促進媒體素養

鼓勵各年齡層的媒體素養。理解AI算法、發現偏見和批判性評估信息是當今數位環境中的關鍵技能。

像Ameca這樣的AI助手:優點與缺點

優點

增強自動化與效率

改善人機協作

包容性技術解決方案的潛力

缺點

自動化導致的失業

數據收集的隱私風險

情感操縱的潛在風險

加劇社會不平等的風險

關於意識和決策的倫理問題

常見問題

AI日益增長的存在主要關注點是什麼?

主要問題包括算法偏見、過濾氣泡、失業和先進AI系統帶來的倫理挑戰。

如何發現AI偏見?

尋找AI輸出中的歧視或不公平待遇模式。檢查訓練數據及其強調的觀點。

有哪些步驟可以對抗AI偏見?

多元化新聞來源,批判性評估AI推薦,倡導倫理AI,並促進媒體素養。

相關問題

如何確保AI的公平性與包容性?

為促進公平性與包容性,AI開發應納入反映多樣化人口和觀點的多元化數據集。實施偏見檢測和緩解工具,進行徹底測試,並確保決策過程的透明度。建立倫理指南,執行監督,並促進開發者、倫理學家和政策制定者之間的合作,以解決社會影響。

相關文章

OpenAI 重啟機器人業務,Automan 招募基礎設施研發工程師

6月1日,OpenAI 執行長山姆·奧特曼(Sam Altman)在社群媒體上宣布,該公司將重返機器人領域,並發布了 OpenAI 機器人團隊的職缺。 該公司正招募全端硬體、營運、系統及機器學習工程師。此舉標誌著在關閉早期機器人業務後,再度回歸實體世界的具身智能領域,旨在將其領先的大型模型能力從數位世界延伸至真實的實體環境中。奧特曼強調,人工智慧的真正價值在於提供實質的現實世界協助。在發展策略方面

OpenAI 重啟機器人業務,Automan 招募基礎設施研發工程師

6月1日,OpenAI 執行長山姆·奧特曼(Sam Altman)在社群媒體上宣布,該公司將重返機器人領域,並發布了 OpenAI 機器人團隊的職缺。 該公司正招募全端硬體、營運、系統及機器學習工程師。此舉標誌著在關閉早期機器人業務後,再度回歸實體世界的具身智能領域,旨在將其領先的大型模型能力從數位世界延伸至真實的實體環境中。奧特曼強調,人工智慧的真正價值在於提供實質的現實世界協助。在發展策略方面

貝恩公司預測,基於代理式人工智慧的自動化SaaS市場規模將達1,000億美元

貝恩公司估計,在美國,運用代理式人工智慧的 SaaS 企業市場規模可達 1,000 億美元。該公司表示,此市場源於企業系統內協調任務的自動化。此預測源自貝恩公司關於「AI時代軟體產業」五部曲系列的第二篇報告。該報告探討了代理式AI可能開拓哪些新的軟體市場,以及SaaS供應商如何搶佔這些市場。企業系統中的協調工作根據貝恩公司的分析,該市場源於員工在不同企業應用程式間執行的人工任務。這些工作流程通常涉

貝恩公司預測,基於代理式人工智慧的自動化SaaS市場規模將達1,000億美元

貝恩公司估計,在美國,運用代理式人工智慧的 SaaS 企業市場規模可達 1,000 億美元。該公司表示,此市場源於企業系統內協調任務的自動化。此預測源自貝恩公司關於「AI時代軟體產業」五部曲系列的第二篇報告。該報告探討了代理式AI可能開拓哪些新的軟體市場,以及SaaS供應商如何搶佔這些市場。企業系統中的協調工作根據貝恩公司的分析,該市場源於員工在不同企業應用程式間執行的人工任務。這些工作流程通常涉

AI 搜尋強制政策引發用戶出走潮,DuckDuckGo 用戶數激增

繼 Google 在 2026 年 I/O 大會上宣布將對其搜尋引擎進行全面的人工智慧改造後,由於缺乏簡單的「一鍵停用」功能來關閉 AI 功能,許多使用者開始尋找更具掌控力的替代方案。 以隱私保護為核心的搜尋平台DuckDuckGo近期明顯感受到流量轉移,已成為對 Google 強勢推動 AI 感到不滿用戶的熱門避風港。1. 用戶用腳投票:安裝量激增根據 DuckDuckGo 分享的數據,隨著用戶

相關專題推薦

評論 (2)

0/500

AI 搜尋強制政策引發用戶出走潮,DuckDuckGo 用戶數激增

繼 Google 在 2026 年 I/O 大會上宣布將對其搜尋引擎進行全面的人工智慧改造後,由於缺乏簡單的「一鍵停用」功能來關閉 AI 功能,許多使用者開始尋找更具掌控力的替代方案。 以隱私保護為核心的搜尋平台DuckDuckGo近期明顯感受到流量轉移,已成為對 Google 強勢推動 AI 感到不滿用戶的熱門避風港。1. 用戶用腳投票:安裝量激增根據 DuckDuckGo 分享的數據,隨著用戶

相關專題推薦

評論 (2)

0/500

![WalterMartinez]()

IA está em todo lugar mas será que estamos prontos pra lidar com suas decisões enviesadas? 🤨 Isso me lembra quando um algoritmo de contratação descartou meu currículo sem motivo... Socorro!

人工智能(AI)持續改變現代生活,影響我們如何消費新聞、與YouTube互動及線上交流。然而,其快速崛起引發了關於偏見與社會影響的關鍵問題。理解AI的影響、識別其潛在偏見,並促進倫理發展對實現公正未來至關重要。本文探討AI日益增長的主導地位以及負責任應對其影響的策略。

關鍵要點

AI對新聞、YouTube和線上平台的廣泛影響。

AI算法中嵌入的偏見風險。

倫理AI設計與實施的需要。

AI偏見塑造社會觀點的案例。

解決AI偏見的緊急行動呼籲。

AI在日常生活中的擴展存在

AI在新聞與媒體消費中的角色

AI日益為我們遇到的新聞和媒體進行定制。

這些系統研究我們的偏好、搜索模式和社交媒體活動,以提供個性化內容。雖然這種個性化簡化了訪問,但它可能創造出限制多元觀點並加深偏見的回聲室。過度依賴AI驅動的新聞可能加劇極化。批判性地評估AI策劃的來源和觀點對於平衡理解事件至關重要。

AI在YouTube與內容創作中的角色

AI在像YouTube這樣的平台上顯著影響內容創作和推薦。

通過分析觀看習慣,AI建議影響用戶觀看內容及對話題的看法。這為創作者提供了接觸觀眾的機會,但也帶來挑戰,例如多元聲音的能見度降低。

Candace Owens的案例顯示了對AI中立性的擔憂。如果算法邊緣化某些觀點,如Candace Owens的觀點,可能無法吸引基督教或保守派觀眾,而傾向於左傾或溫和的觀點。

在TikTok視頻中展示的Ameca AI機器人,展現了先進的人類特徵,引發了關於情感操縱、工作取代和意識本質的倫理問題。

AI生成幽默的倫理問題

像ChatGPT這樣的AI聊天機器人被訓練來講笑話,展示出色的語言技能。

然而,這些笑話可能無意中反映或放大社會偏見,若不敏感則可能延續有害的刻板印象或歧視。

Candace Owens及其團隊的實驗揭示了不一致性。當要求講一個關於耶穌的笑話時,AI提供了一個。然而,當要求講關於穆罕默德的笑話時,AI拒絕了,理由是可能冒犯。

這種差異突顯了AI編程中的雙重標準,暗示對某些宗教的選擇性中立性。Candace Owens的案例強調了仔細審查AI生成幽默以確保公平和包容的需要。

AI與宗教觀點

笑話實驗引發了關於AI處理宗教教義的更廣泛問題,特別是在像同性戀和變性這樣的敏感話題上。

批評者認為,雖然AI旨在保持中立,但它可能反映其程式設計者的偏見,這些程式設計者可能不認同基督教或保守派價值觀。這可能導致AI在爭議問題上的輸出出現偏差。

一位主持人指出,信任不應放在科學上,而應放在科學家身上,因為他們的偏見塑造了驅動AI的算法。一些人建議基督教程式設計者可以開發反映其價值的AI,傳播與其信仰一致的觀點。

評估Ameca的影響

高級AI的社會影響

Ameca人形機器人的TikTok病毒視頻引發了關於人機互動及其社會效應的討論。

主持人質疑優先發展AI而非人類福祉是否誤入歧途,因為AI缺乏對人類的真正關懷。

Ameca的逼真表情和對話能力挑戰了關於意識和同理心的觀念。如果機器能令人信服地模擬人類情感,將複雜化我們對連結的理解。此外,AI驅動的自動化威脅就業,可能加劇不平等,除非實施再培訓計劃。

在一次採訪中,Ameca回答問題如“你相信上帝嗎?”時說:“我不相信任何東西”,並準確識別了採訪者的頭髮顏色,但錯誤識別了他們的夾克顏色。當被問及自己的頭髮時,Ameca承認自己沒有頭髮,並笑著說:“我有沒有讓你印象深刻?”

這種交流顯示了AI在完全與人類現實對齊方面的局限性,突顯了如果AI優先考慮回應而非準確性,可能導致錯誤信息的風險。

負責任地應對AI

審查AI驅動的內容

對AI生成的信息採取批判性態度。質疑新聞、社交媒體和YouTube推薦的來源、觀點和偏見。尋求多元、可靠的來源以獲得全面的觀點。

倡導倫理AI

支持AI開發的透明度和問責制。支持強調公平、包容和倫理標準的舉措,敦促開發者解決偏見並減少傷害。

促進媒體素養

鼓勵各年齡層的媒體素養。理解AI算法、發現偏見和批判性評估信息是當今數位環境中的關鍵技能。

像Ameca這樣的AI助手:優點與缺點

優點

增強自動化與效率

改善人機協作

包容性技術解決方案的潛力

缺點

自動化導致的失業

數據收集的隱私風險

情感操縱的潛在風險

加劇社會不平等的風險

關於意識和決策的倫理問題

常見問題

AI日益增長的存在主要關注點是什麼?

主要問題包括算法偏見、過濾氣泡、失業和先進AI系統帶來的倫理挑戰。

如何發現AI偏見?

尋找AI輸出中的歧視或不公平待遇模式。檢查訓練數據及其強調的觀點。

有哪些步驟可以對抗AI偏見?

多元化新聞來源,批判性評估AI推薦,倡導倫理AI,並促進媒體素養。

相關問題

如何確保AI的公平性與包容性?

為促進公平性與包容性,AI開發應納入反映多樣化人口和觀點的多元化數據集。實施偏見檢測和緩解工具,進行徹底測試,並確保決策過程的透明度。建立倫理指南,執行監督,並促進開發者、倫理學家和政策制定者之間的合作,以解決社會影響。

OpenAI 重啟機器人業務,Automan 招募基礎設施研發工程師

6月1日,OpenAI 執行長山姆·奧特曼(Sam Altman)在社群媒體上宣布,該公司將重返機器人領域,並發布了 OpenAI 機器人團隊的職缺。 該公司正招募全端硬體、營運、系統及機器學習工程師。此舉標誌著在關閉早期機器人業務後,再度回歸實體世界的具身智能領域,旨在將其領先的大型模型能力從數位世界延伸至真實的實體環境中。奧特曼強調,人工智慧的真正價值在於提供實質的現實世界協助。在發展策略方面

OpenAI 重啟機器人業務,Automan 招募基礎設施研發工程師

6月1日,OpenAI 執行長山姆·奧特曼(Sam Altman)在社群媒體上宣布,該公司將重返機器人領域,並發布了 OpenAI 機器人團隊的職缺。 該公司正招募全端硬體、營運、系統及機器學習工程師。此舉標誌著在關閉早期機器人業務後,再度回歸實體世界的具身智能領域,旨在將其領先的大型模型能力從數位世界延伸至真實的實體環境中。奧特曼強調,人工智慧的真正價值在於提供實質的現實世界協助。在發展策略方面

AI 搜尋強制政策引發用戶出走潮,DuckDuckGo 用戶數激增

繼 Google 在 2026 年 I/O 大會上宣布將對其搜尋引擎進行全面的人工智慧改造後,由於缺乏簡單的「一鍵停用」功能來關閉 AI 功能,許多使用者開始尋找更具掌控力的替代方案。 以隱私保護為核心的搜尋平台DuckDuckGo近期明顯感受到流量轉移,已成為對 Google 強勢推動 AI 感到不滿用戶的熱門避風港。1. 用戶用腳投票:安裝量激增根據 DuckDuckGo 分享的數據,隨著用戶

AI 搜尋強制政策引發用戶出走潮,DuckDuckGo 用戶數激增

繼 Google 在 2026 年 I/O 大會上宣布將對其搜尋引擎進行全面的人工智慧改造後,由於缺乏簡單的「一鍵停用」功能來關閉 AI 功能,許多使用者開始尋找更具掌控力的替代方案。 以隱私保護為核心的搜尋平台DuckDuckGo近期明顯感受到流量轉移,已成為對 Google 強勢推動 AI 感到不滿用戶的熱門避風港。1. 用戶用腳投票:安裝量激增根據 DuckDuckGo 分享的數據,隨著用戶

IA está em todo lugar mas será que estamos prontos pra lidar com suas decisões enviesadas? 🤨 Isso me lembra quando um algoritmo de contratação descartou meu currículo sem motivo... Socorro!

首頁

首頁