共同揭示了最高评级的AYA Vision AI模型

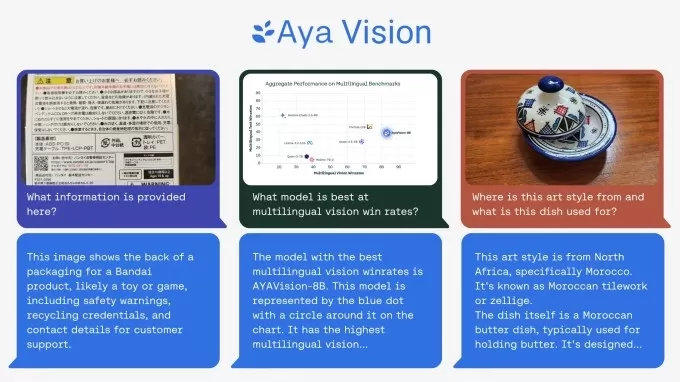

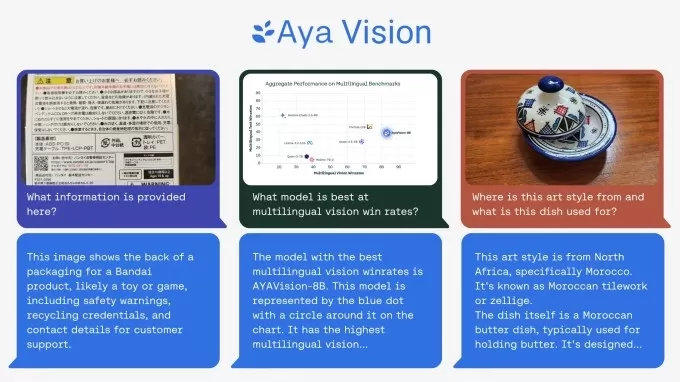

Cohere的非营利研究实验室刚刚发布了一款新的多模态AI模型,名为Aya Vision,他们称其为同类最佳。这款模型非常出色——它可以生成图像描述,回答关于图片的问题,翻译文本,甚至能用23种主要语言进行内容总结。此外,Cohere在WhatsApp上免费提供Aya Vision,称这是让这些技术突破进入全球研究者手中的重要举措。

在他们的博客文章中,Cohere指出,尽管AI取得了进展,但在处理不同语言方面,模型的表现仍然存在巨大差距,尤其是在同时处理文本和图像时。Aya Vision的出现旨在弥补这一差距。

Aya Vision有两种版本:更强大的Aya Vision 32B和更轻量级的Aya Vision 8B。据Cohere称,32B版本开创了“新前沿”,在一些视觉理解测试中超越了比它大两倍的模型,如Meta的Llama-3.2 90B Vision。而8B版本也能与比它大10倍的模型一较高下。

你可以在Hugging Face上以Creative Commons 4.0许可证获取这两种模型,但有一个限制——它们不可用于商业用途。

Cohere使用英语数据集的混合进行Aya Vision的训练,将其翻译并转化为合成注释。这些注释或标签帮助模型在训练过程中理解数据。例如,如果你在训练一个图像识别模型,你可能会使用注释来标记对象或为图片添加描述。

Cohere的Aya Vision模型可以执行一系列视觉理解任务。图片来源:Cohere 使用合成注释现在非常流行,尽管它也有其缺点。像OpenAI这样的大公司也在追随合成数据潮流,因为现实世界的数据越来越难获取。Gartner估计,去年用于AI和分析项目的数据中有60%是合成的。Cohere表示,使用合成注释训练Aya Vision使他们能够以更少的资源获得顶尖结果。他们说,这一切都关乎效率和以更少资源做更多事情,这对那些不总能访问大型计算资源的研究者来说是个好消息。

与Aya Vision一起,Cohere发布了一个新的基准测试套件,名为AyaVisionBench。它旨在测试模型在诸如发现图像差异和将屏幕截图转化为代码等任务中的能力。

AI领域一直在挣扎于一些人所说的“评估危机”。常规基准测试给出的总体分数并不能真正反映模型在用户最关心的任务上的表现。Cohere认为AyaVisionBench可以帮助解决这一问题,提供一种严格且广泛的方法来检查模型的跨语言和多模态能力。

希望他们是对的。Cohere的研究人员表示,这个数据集是测试多语言和现实场景中视觉-语言模型的坚实基准。他们已将其提供给研究社区,以帮助推动多语言多模态评估的进展。

相关文章

Cohere 发布开源多语言 AI 模型系列

企业级人工智能公司Cohere在正在举行的印度人工智能峰会上发布了一款名为Tiny Aya的新型多语言模型系列。这些开放权重模型——即其核心代码可供公众使用和修改——支持70多种语言,且无需联网即可在笔记本电脑等日常设备上运行。该模型由Cohere的研究部门Cohere Labs开发,支持孟加拉语、印地语、旁遮普语、乌尔都语、古吉拉特语、泰米尔语、泰卢固语和马拉地语等南亚语言。基础模型拥有33.5

Cohere 发布开源多语言 AI 模型系列

企业级人工智能公司Cohere在正在举行的印度人工智能峰会上发布了一款名为Tiny Aya的新型多语言模型系列。这些开放权重模型——即其核心代码可供公众使用和修改——支持70多种语言,且无需联网即可在笔记本电脑等日常设备上运行。该模型由Cohere的研究部门Cohere Labs开发,支持孟加拉语、印地语、旁遮普语、乌尔都语、古吉拉特语、泰米尔语、泰卢固语和马拉地语等南亚语言。基础模型拥有33.5

Cohere 与 Aleph Alpha 宣布合并

加拿大人工智能初创公司Cohere正收购德国的Aleph Alpha,此次收购得到了超市连锁店Lidl母公司Schwarz集团的支持。在政府支持下,两家公司旨在为企业在当前由美国公司主导的人工智能领域提供一种“自主”的替代方案。作为大型语言模型的开发者,Aleph Alpha和Cohere虽在区域内处于领先地位,但仍落后于OpenAI等全球巨头。尽管两者有相似之处,但这并非对等合并。Cohere(

Cohere 与 Aleph Alpha 宣布合并

加拿大人工智能初创公司Cohere正收购德国的Aleph Alpha,此次收购得到了超市连锁店Lidl母公司Schwarz集团的支持。在政府支持下,两家公司旨在为企业在当前由美国公司主导的人工智能领域提供一种“自主”的替代方案。作为大型语言模型的开发者,Aleph Alpha和Cohere虽在区域内处于领先地位,但仍落后于OpenAI等全球巨头。尽管两者有相似之处,但这并非对等合并。Cohere(

Cohere推出安全企业级人工智能平台North

人工智能代理工具有望减少日常工作流程中的重复性任务,但许多组织仍对采用持谨慎态度。首要担忧在于数据安全。拥有专有秘密的大型企业、受严格监管行业的公司以及政府机构对此存在重大顾虑。他们担心自身数据或客户数据可能在缺乏适当保障的情况下泄露,或被用于训练公共人工智能模型。加拿大人工智能公司Cohere通过其全新AI代理平台North正致力于解决这些担忧。该平台专为私有部署设计,使企业和政府机构能够将敏感

相关专题推荐

评论 (46)

0/500

Cohere推出安全企业级人工智能平台North

人工智能代理工具有望减少日常工作流程中的重复性任务,但许多组织仍对采用持谨慎态度。首要担忧在于数据安全。拥有专有秘密的大型企业、受严格监管行业的公司以及政府机构对此存在重大顾虑。他们担心自身数据或客户数据可能在缺乏适当保障的情况下泄露,或被用于训练公共人工智能模型。加拿大人工智能公司Cohere通过其全新AI代理平台North正致力于解决这些担忧。该平台专为私有部署设计,使企业和政府机构能够将敏感

相关专题推荐

评论 (46)

0/500

![JasonAnderson]()

Aya Vision klingt beeindruckend! Besonders die 23 Sprachen sind praktisch. Hoffentlich bleibt die Übersetzungsqualität auch bei komplexen Themen konsistent. 🤔 Würde mich interessieren, wie es sich im Alltag gegen GPT-4 behauptet.

![JoseAdams]()

Incroyable modèle de Cohere ! Mais est-ce que cette IA 'top-rated' tiendra ses promesses face à GPT-4 ? 🤔 Les fonctionnalités multilingues sont impressionnantes, mais j'aimerais voir plus de démos concrètes.

![MarkRoberts]()

¡Interesante! Aya Vision parece ser un modelo bastante completo con esas capacidades multilingües. Me pregunto qué tan bien funcionará en idiomas menos comunes, sobre todo porque menciona '23 grandes idiomas'. ¿Habrá algún soporte para lenguas indígenas o regionales en el futuro? 🌎

![KennethMartin]()

This Aya Vision model sounds like a game-changer! Captioning images and translating in 23 languages? That’s some next-level tech. Can’t wait to see how it stacks up against the big players like OpenAI. 😎

Cohere的非营利研究实验室刚刚发布了一款新的多模态AI模型,名为Aya Vision,他们称其为同类最佳。这款模型非常出色——它可以生成图像描述,回答关于图片的问题,翻译文本,甚至能用23种主要语言进行内容总结。此外,Cohere在WhatsApp上免费提供Aya Vision,称这是让这些技术突破进入全球研究者手中的重要举措。

在他们的博客文章中,Cohere指出,尽管AI取得了进展,但在处理不同语言方面,模型的表现仍然存在巨大差距,尤其是在同时处理文本和图像时。Aya Vision的出现旨在弥补这一差距。

Aya Vision有两种版本:更强大的Aya Vision 32B和更轻量级的Aya Vision 8B。据Cohere称,32B版本开创了“新前沿”,在一些视觉理解测试中超越了比它大两倍的模型,如Meta的Llama-3.2 90B Vision。而8B版本也能与比它大10倍的模型一较高下。

你可以在Hugging Face上以Creative Commons 4.0许可证获取这两种模型,但有一个限制——它们不可用于商业用途。

Cohere使用英语数据集的混合进行Aya Vision的训练,将其翻译并转化为合成注释。这些注释或标签帮助模型在训练过程中理解数据。例如,如果你在训练一个图像识别模型,你可能会使用注释来标记对象或为图片添加描述。

Cohere表示,使用合成注释训练Aya Vision使他们能够以更少的资源获得顶尖结果。他们说,这一切都关乎效率和以更少资源做更多事情,这对那些不总能访问大型计算资源的研究者来说是个好消息。

与Aya Vision一起,Cohere发布了一个新的基准测试套件,名为AyaVisionBench。它旨在测试模型在诸如发现图像差异和将屏幕截图转化为代码等任务中的能力。

AI领域一直在挣扎于一些人所说的“评估危机”。常规基准测试给出的总体分数并不能真正反映模型在用户最关心的任务上的表现。Cohere认为AyaVisionBench可以帮助解决这一问题,提供一种严格且广泛的方法来检查模型的跨语言和多模态能力。

希望他们是对的。Cohere的研究人员表示,这个数据集是测试多语言和现实场景中视觉-语言模型的坚实基准。他们已将其提供给研究社区,以帮助推动多语言多模态评估的进展。

Cohere 发布开源多语言 AI 模型系列

企业级人工智能公司Cohere在正在举行的印度人工智能峰会上发布了一款名为Tiny Aya的新型多语言模型系列。这些开放权重模型——即其核心代码可供公众使用和修改——支持70多种语言,且无需联网即可在笔记本电脑等日常设备上运行。该模型由Cohere的研究部门Cohere Labs开发,支持孟加拉语、印地语、旁遮普语、乌尔都语、古吉拉特语、泰米尔语、泰卢固语和马拉地语等南亚语言。基础模型拥有33.5

Cohere 发布开源多语言 AI 模型系列

企业级人工智能公司Cohere在正在举行的印度人工智能峰会上发布了一款名为Tiny Aya的新型多语言模型系列。这些开放权重模型——即其核心代码可供公众使用和修改——支持70多种语言,且无需联网即可在笔记本电脑等日常设备上运行。该模型由Cohere的研究部门Cohere Labs开发,支持孟加拉语、印地语、旁遮普语、乌尔都语、古吉拉特语、泰米尔语、泰卢固语和马拉地语等南亚语言。基础模型拥有33.5

Cohere 与 Aleph Alpha 宣布合并

加拿大人工智能初创公司Cohere正收购德国的Aleph Alpha,此次收购得到了超市连锁店Lidl母公司Schwarz集团的支持。在政府支持下,两家公司旨在为企业在当前由美国公司主导的人工智能领域提供一种“自主”的替代方案。作为大型语言模型的开发者,Aleph Alpha和Cohere虽在区域内处于领先地位,但仍落后于OpenAI等全球巨头。尽管两者有相似之处,但这并非对等合并。Cohere(

Cohere 与 Aleph Alpha 宣布合并

加拿大人工智能初创公司Cohere正收购德国的Aleph Alpha,此次收购得到了超市连锁店Lidl母公司Schwarz集团的支持。在政府支持下,两家公司旨在为企业在当前由美国公司主导的人工智能领域提供一种“自主”的替代方案。作为大型语言模型的开发者,Aleph Alpha和Cohere虽在区域内处于领先地位,但仍落后于OpenAI等全球巨头。尽管两者有相似之处,但这并非对等合并。Cohere(

Cohere推出安全企业级人工智能平台North

人工智能代理工具有望减少日常工作流程中的重复性任务,但许多组织仍对采用持谨慎态度。首要担忧在于数据安全。拥有专有秘密的大型企业、受严格监管行业的公司以及政府机构对此存在重大顾虑。他们担心自身数据或客户数据可能在缺乏适当保障的情况下泄露,或被用于训练公共人工智能模型。加拿大人工智能公司Cohere通过其全新AI代理平台North正致力于解决这些担忧。该平台专为私有部署设计,使企业和政府机构能够将敏感

Cohere推出安全企业级人工智能平台North

人工智能代理工具有望减少日常工作流程中的重复性任务,但许多组织仍对采用持谨慎态度。首要担忧在于数据安全。拥有专有秘密的大型企业、受严格监管行业的公司以及政府机构对此存在重大顾虑。他们担心自身数据或客户数据可能在缺乏适当保障的情况下泄露,或被用于训练公共人工智能模型。加拿大人工智能公司Cohere通过其全新AI代理平台North正致力于解决这些担忧。该平台专为私有部署设计,使企业和政府机构能够将敏感

Aya Vision klingt beeindruckend! Besonders die 23 Sprachen sind praktisch. Hoffentlich bleibt die Übersetzungsqualität auch bei komplexen Themen konsistent. 🤔 Würde mich interessieren, wie es sich im Alltag gegen GPT-4 behauptet.

Incroyable modèle de Cohere ! Mais est-ce que cette IA 'top-rated' tiendra ses promesses face à GPT-4 ? 🤔 Les fonctionnalités multilingues sont impressionnantes, mais j'aimerais voir plus de démos concrètes.

¡Interesante! Aya Vision parece ser un modelo bastante completo con esas capacidades multilingües. Me pregunto qué tan bien funcionará en idiomas menos comunes, sobre todo porque menciona '23 grandes idiomas'. ¿Habrá algún soporte para lenguas indígenas o regionales en el futuro? 🌎

This Aya Vision model sounds like a game-changer! Captioning images and translating in 23 languages? That’s some next-level tech. Can’t wait to see how it stacks up against the big players like OpenAI. 😎

首页

首页