Cohere presenta el modelo AIA AI mejor calificado

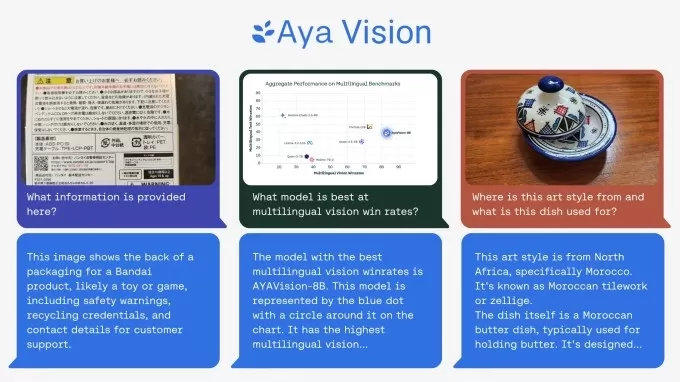

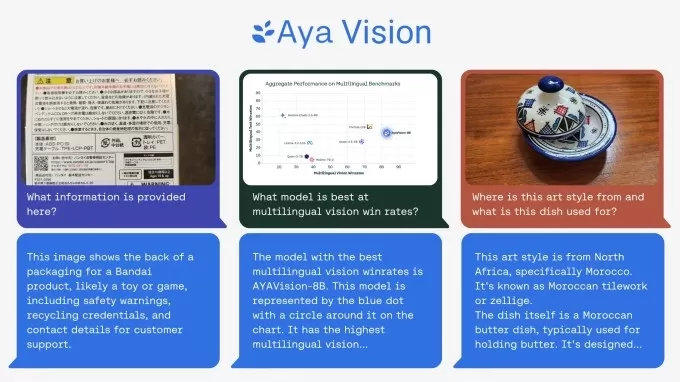

El laboratorio de investigación sin fines de lucro de Cohere acaba de lanzar un nuevo modelo de IA multimodal llamado Aya Vision, y lo califican como el mejor en su clase. Este modelo es bastante impresionante: puede generar subtítulos para imágenes, responder preguntas sobre fotos, traducir texto e incluso resumir contenido en 23 idiomas principales. Además, Cohere está poniendo Aya Vision a disposición de forma gratuita en WhatsApp, diciendo que es un gran paso para llevar estos avances tecnológicos a las manos de investigadores de todo el mundo.

En su publicación de blog, Cohere señaló que, aunque la IA ha estado avanzando, todavía existe una gran brecha en cómo los modelos manejan diferentes idiomas, especialmente cuando se combinan texto e imágenes. Ahí es donde entra Aya Vision, con el objetivo de cerrar esa brecha.

Aya Vision viene en dos versiones: la más robusta Aya Vision 32B y la más ligera Aya Vision 8B. La versión 32B, según Cohere, está estableciendo una "nueva frontera", superando a modelos el doble de grandes, como Llama-3.2 90B Vision de Meta, en algunas pruebas de comprensión visual. ¿Y la versión 8B? Se mantiene firme frente a modelos que son 10 veces más grandes.

Puedes obtener ambos modelos desde Hugging Face bajo una licencia Creative Commons 4.0, pero hay una condición: no son para uso comercial.

Cohere entrenó a Aya Vision usando una mezcla de conjuntos de datos en inglés, que tradujeron y convirtieron en anotaciones sintéticas. Estas anotaciones, o etiquetas, ayudan al modelo a entender los datos durante el entrenamiento. Por ejemplo, si estás entrenando un modelo de reconocimiento de imágenes, podrías usar anotaciones para marcar objetos o añadir subtítulos sobre lo que hay en la imagen.

El modelo Aya Vision de Cohere puede realizar una variedad de tareas de comprensión visual. Créditos de la imagen: Cohere El uso de anotaciones sintéticas está muy de moda ahora, aunque tiene sus inconvenientes. Grandes actores como OpenAI también están subiendo al carro de los datos sintéticos, ya que los datos del mundo real son cada vez más difíciles de conseguir. Gartner estima que el año pasado, el 60% de los datos utilizados para proyectos de IA y análisis fueron sintéticos.Cohere dice que entrenar a Aya Vision con anotaciones sintéticas les permitió usar menos recursos mientras obtenían resultados de primera calidad. Todo se trata de eficiencia y hacer más con menos, dicen, lo cual es una gran noticia para los investigadores que no siempre tienen acceso a grandes recursos computacionales.

Junto con Aya Vision, Cohere lanzó un nuevo conjunto de pruebas llamado AyaVisionBench. Está diseñado para evaluar las habilidades de un modelo en tareas como detectar diferencias entre imágenes y convertir capturas de pantalla en código.

El mundo de la IA ha estado lidiando con lo que algunos llaman una "crisis de evaluación". Los puntos de referencia habituales te dan una puntuación general que no refleja realmente qué tan bien un modelo realiza las tareas que más importan a los usuarios. Cohere piensa que AyaVisionBench puede ayudar a solucionar eso, ofreciendo una forma rigurosa y amplia de evaluar las capacidades multilingües y multimodales de un modelo.

Esperemos que tengan razón. Los investigadores de Cohere dicen que el conjunto de datos es un punto de referencia sólido para probar modelos de visión-lenguaje en escenarios multilingües y del mundo real. Lo han puesto a disposición de la comunidad de investigación para ayudar a avanzar en las evaluaciones multimodales y multilingües.

Artículo relacionado

Cohere presenta una familia de modelos de IA multilingües de código abierto

La empresa de IA empresarial Cohere ha presentado una nueva familia de modelos multilingües, denominada Tiny Aya, durante la Cumbre de IA de la India que se está celebrando estos días. Estos modelos d

Cohere presenta una familia de modelos de IA multilingües de código abierto

La empresa de IA empresarial Cohere ha presentado una nueva familia de modelos multilingües, denominada Tiny Aya, durante la Cumbre de IA de la India que se está celebrando estos días. Estos modelos d

Cohere y Aleph Alpha anuncian su fusión

La startup canadiense de IA Cohere va a adquirir la alemana Aleph Alpha con el respaldo del Grupo Schwarz, la empresa matriz de la cadena de supermercados Lidl. Con el apoyo del Gobierno, las empresas

Cohere y Aleph Alpha anuncian su fusión

La startup canadiense de IA Cohere va a adquirir la alemana Aleph Alpha con el respaldo del Grupo Schwarz, la empresa matriz de la cadena de supermercados Lidl. Con el apoyo del Gobierno, las empresas

Cohere lanza una plataforma segura de inteligencia artificial para empresas North

Las herramientas de agentes de IA tienen el potencial de reducir las tareas repetitivas en los flujos de trabajo diarios, pero muchas organizaciones siguen mostrándose cautelosas a la hora de adoptarl

Recomendaciones de temas especiales relacionados

comentario (46)

0/500

Cohere lanza una plataforma segura de inteligencia artificial para empresas North

Las herramientas de agentes de IA tienen el potencial de reducir las tareas repetitivas en los flujos de trabajo diarios, pero muchas organizaciones siguen mostrándose cautelosas a la hora de adoptarl

Recomendaciones de temas especiales relacionados

comentario (46)

0/500

![JasonAnderson]()

Aya Vision klingt beeindruckend! Besonders die 23 Sprachen sind praktisch. Hoffentlich bleibt die Übersetzungsqualität auch bei komplexen Themen konsistent. 🤔 Würde mich interessieren, wie es sich im Alltag gegen GPT-4 behauptet.

![JoseAdams]()

Incroyable modèle de Cohere ! Mais est-ce que cette IA 'top-rated' tiendra ses promesses face à GPT-4 ? 🤔 Les fonctionnalités multilingues sont impressionnantes, mais j'aimerais voir plus de démos concrètes.

![MarkRoberts]()

¡Interesante! Aya Vision parece ser un modelo bastante completo con esas capacidades multilingües. Me pregunto qué tan bien funcionará en idiomas menos comunes, sobre todo porque menciona '23 grandes idiomas'. ¿Habrá algún soporte para lenguas indígenas o regionales en el futuro? 🌎

![KennethMartin]()

This Aya Vision model sounds like a game-changer! Captioning images and translating in 23 languages? That’s some next-level tech. Can’t wait to see how it stacks up against the big players like OpenAI. 😎

El laboratorio de investigación sin fines de lucro de Cohere acaba de lanzar un nuevo modelo de IA multimodal llamado Aya Vision, y lo califican como el mejor en su clase. Este modelo es bastante impresionante: puede generar subtítulos para imágenes, responder preguntas sobre fotos, traducir texto e incluso resumir contenido en 23 idiomas principales. Además, Cohere está poniendo Aya Vision a disposición de forma gratuita en WhatsApp, diciendo que es un gran paso para llevar estos avances tecnológicos a las manos de investigadores de todo el mundo.

En su publicación de blog, Cohere señaló que, aunque la IA ha estado avanzando, todavía existe una gran brecha en cómo los modelos manejan diferentes idiomas, especialmente cuando se combinan texto e imágenes. Ahí es donde entra Aya Vision, con el objetivo de cerrar esa brecha.

Aya Vision viene en dos versiones: la más robusta Aya Vision 32B y la más ligera Aya Vision 8B. La versión 32B, según Cohere, está estableciendo una "nueva frontera", superando a modelos el doble de grandes, como Llama-3.2 90B Vision de Meta, en algunas pruebas de comprensión visual. ¿Y la versión 8B? Se mantiene firme frente a modelos que son 10 veces más grandes.

Puedes obtener ambos modelos desde Hugging Face bajo una licencia Creative Commons 4.0, pero hay una condición: no son para uso comercial.

Cohere entrenó a Aya Vision usando una mezcla de conjuntos de datos en inglés, que tradujeron y convirtieron en anotaciones sintéticas. Estas anotaciones, o etiquetas, ayudan al modelo a entender los datos durante el entrenamiento. Por ejemplo, si estás entrenando un modelo de reconocimiento de imágenes, podrías usar anotaciones para marcar objetos o añadir subtítulos sobre lo que hay en la imagen.

Cohere dice que entrenar a Aya Vision con anotaciones sintéticas les permitió usar menos recursos mientras obtenían resultados de primera calidad. Todo se trata de eficiencia y hacer más con menos, dicen, lo cual es una gran noticia para los investigadores que no siempre tienen acceso a grandes recursos computacionales.

Junto con Aya Vision, Cohere lanzó un nuevo conjunto de pruebas llamado AyaVisionBench. Está diseñado para evaluar las habilidades de un modelo en tareas como detectar diferencias entre imágenes y convertir capturas de pantalla en código.

El mundo de la IA ha estado lidiando con lo que algunos llaman una "crisis de evaluación". Los puntos de referencia habituales te dan una puntuación general que no refleja realmente qué tan bien un modelo realiza las tareas que más importan a los usuarios. Cohere piensa que AyaVisionBench puede ayudar a solucionar eso, ofreciendo una forma rigurosa y amplia de evaluar las capacidades multilingües y multimodales de un modelo.

Esperemos que tengan razón. Los investigadores de Cohere dicen que el conjunto de datos es un punto de referencia sólido para probar modelos de visión-lenguaje en escenarios multilingües y del mundo real. Lo han puesto a disposición de la comunidad de investigación para ayudar a avanzar en las evaluaciones multimodales y multilingües.

Cohere presenta una familia de modelos de IA multilingües de código abierto

La empresa de IA empresarial Cohere ha presentado una nueva familia de modelos multilingües, denominada Tiny Aya, durante la Cumbre de IA de la India que se está celebrando estos días. Estos modelos d

Cohere presenta una familia de modelos de IA multilingües de código abierto

La empresa de IA empresarial Cohere ha presentado una nueva familia de modelos multilingües, denominada Tiny Aya, durante la Cumbre de IA de la India que se está celebrando estos días. Estos modelos d

Cohere y Aleph Alpha anuncian su fusión

La startup canadiense de IA Cohere va a adquirir la alemana Aleph Alpha con el respaldo del Grupo Schwarz, la empresa matriz de la cadena de supermercados Lidl. Con el apoyo del Gobierno, las empresas

Cohere y Aleph Alpha anuncian su fusión

La startup canadiense de IA Cohere va a adquirir la alemana Aleph Alpha con el respaldo del Grupo Schwarz, la empresa matriz de la cadena de supermercados Lidl. Con el apoyo del Gobierno, las empresas

Cohere lanza una plataforma segura de inteligencia artificial para empresas North

Las herramientas de agentes de IA tienen el potencial de reducir las tareas repetitivas en los flujos de trabajo diarios, pero muchas organizaciones siguen mostrándose cautelosas a la hora de adoptarl

Cohere lanza una plataforma segura de inteligencia artificial para empresas North

Las herramientas de agentes de IA tienen el potencial de reducir las tareas repetitivas en los flujos de trabajo diarios, pero muchas organizaciones siguen mostrándose cautelosas a la hora de adoptarl

Aya Vision klingt beeindruckend! Besonders die 23 Sprachen sind praktisch. Hoffentlich bleibt die Übersetzungsqualität auch bei komplexen Themen konsistent. 🤔 Würde mich interessieren, wie es sich im Alltag gegen GPT-4 behauptet.

Incroyable modèle de Cohere ! Mais est-ce que cette IA 'top-rated' tiendra ses promesses face à GPT-4 ? 🤔 Les fonctionnalités multilingues sont impressionnantes, mais j'aimerais voir plus de démos concrètes.

¡Interesante! Aya Vision parece ser un modelo bastante completo con esas capacidades multilingües. Me pregunto qué tan bien funcionará en idiomas menos comunes, sobre todo porque menciona '23 grandes idiomas'. ¿Habrá algún soporte para lenguas indígenas o regionales en el futuro? 🌎

This Aya Vision model sounds like a game-changer! Captioning images and translating in 23 languages? That’s some next-level tech. Can’t wait to see how it stacks up against the big players like OpenAI. 😎

Hogar

Hogar